OpenClawをlaozhang.aiに接続するには、openclaw.jsonのmodels.providersにプロバイダー設定ブロックを追加し、baseUrl(https://api.laozhang.ai/v1 )、APIキー、apiタイプ(openai-completions)を入力するだけで、GPT-4o、Claude Sonnet 4、Geminiなど200以上のAIモデルに即座にアクセスできます。設定にかかる時間はわずか3分。設定完了後は、OpenClawのターミナル環境で自由にモデルを切り替え、中国国内から直接接続・従量課金でAIプログラミング体験を実現できます。

laozhang.aiをOpenClawのAPIプロバイダーとして選ぶ理由

OpenClawは現在最も注目されているオープンソースAIプログラミングエージェントです(GitHub 199K Stars、2026年3月時点)。OpenAI、Anthropic、Google Geminiなど14社のプロバイダーへの対応が組み込まれています。しかし、中国国内の開発者がこれらの公式APIを直接利用する場合、3つの現実的な障壁に直面します。ネットワーク接続の不安定さによるリクエストタイムアウト、海外クレジットカードの登録が必要なこと、そして単一プロバイダーでは使いたい全モデルをカバーできないことです。これこそがlaozhang.aiのようなAPI統合プラットフォームの存在価値です。

laozhang.aiは200以上の主要AIモデルを1つの統一されたOpenAI互換エンドポイントに集約しています(docs.laozhang.ai、2026年3月確認)。1つのAPIキーだけで、GPT-4o、Claude Sonnet 4、Gemini 2.5 Pro、DeepSeek R1、Kimi K2.5など、さまざまなプロバイダーのモデルにアクセスできます。OpenClawユーザーにとっては、OpenAI、Anthropic、Googleなど複数のプラットフォームのアカウントとキーを個別に登録する必要がなく、laozhang.aiの設定1つですべてを代替できるということです。さらに重要なのは、laozhang.aiのサーバーは中国国内から直接接続でき、VPNやプロキシなしで安定した呼び出しが可能であること。日常的にAIと頻繁にやり取りするプログラミングの場面では、これが特に重要です。

コスト面では、laozhang.aiは従量課金制を採用しており、月額料金は不要で、登録時に$0.05のテストクレジットが付与されます。公式APIの直接利用($5〜20の事前チャージが必要)や、$20/月のChatGPT Plusサブスクリプションと比較して、laozhang.aiなら少額で効果をテストしてから、実際の使用量に応じてチャージ金額を決められます。AIプログラミングアシスタントを始めて探索する開発者にとって、このリスクゼロの入門方法は明らかにフレンドリーです。まだOpenClawをインストールしていない場合は、先にOpenClawインストールデプロイガイドを参考に基本環境を構築してから、本記事のAPI設定に戻ってください。

設定前の準備作業

設定ファイルの変更に取りかかる前に、2つのものを準備する必要があります。laozhang.aiのAPIキーと、OpenClawがシステムに正しくインストールされていることの確認です。この2つの準備ステップはそれぞれ約1分で完了し、その後すぐにコア設定に進めます。

laozhang.ai APIキーの取得

laozhang.ai公式サイトにアクセスして登録を完了したら、コンソールのAPIキー管理ページに入り、「新しいキーを作成」ボタンをクリックしてsk-で始まるAPIキーを生成します。このキーはlaozhang.aiサービスとの通信に使用する唯一の認証情報です。作成後すぐにコピーして安全な場所に保存してください。ページを閉じると完全なキーを再表示できなくなります。登録時にクレジットカードの登録は不要で、$0.05のテストクレジットが自動的に付与されます。本記事のすべての設定検証ステップを完了するには十分な額です。以前OpenClawの使用中にAPIキー関連の問題が発生した場合は、OpenClaw APIキーエラー排査ガイドに詳しい診断方法が記載されています。

OpenClawのインストール状態を確認

ターミナルを開き、openclaw --versionを実行してOpenClawが正しくインストールされていることを確認します。コマンドがバージョン番号を返せば(最新バージョンの使用を推奨)、インストールは正常です。次にopenclaw doctorを実行して全体の動作状態を確認します。この診断コマンドは設定ファイルのパス、設定済みプロバイダー、認証ステータスなどの重要情報をチェックします。赤い警告が表示された場合は、指示に従って修正してから先に進んでください。OpenClawの設定ファイルは~/.openclaw/openclaw.jsonにあります(一部のシステムでは~/.config/openclaw/openclaw.json5)。任意のテキストエディタで開けます。このファイルがまだ存在しない場合は、openclawを一度実行するとデフォルト設定が自動的に作成されます。

3分でコア設定を完了

コア設定の本質は非常にシンプルです。openclaw.jsonのmodels.providersセクションにlaozhangという名前のプロバイダー定義を追加し、OpenClawにこのプロバイダーのAPIアドレス、認証キー、通信プロトコルを伝えるだけです。以前OpenClawカスタムモデル追加ガイドをお読みになったことがあれば、ここでの設定構造がまったく同じであることに気づくでしょう。laozhang.aiは標準的なカスタムプロバイダーの1つにすぎません。

最小構成(初心者におすすめ)

~/.openclaw/openclaw.jsonを開き、modelsセクションを見つけて(または作成して)、以下の設定を追加します。

json{ "models": { "mode": "merge", "providers": { "laozhang": { "baseUrl": "https://api.laozhang.ai/v1", "apiKey": "sk-laozhang-あなたのキー", "api": "openai-completions", "models": [ { "id": "gpt-4o-mini", "name": "GPT-4o Mini" }, { "id": "gpt-4o", "name": "GPT-4o" }, { "id": "claude-sonnet-4-20250514", "name": "Claude Sonnet 4" }, { "id": "claude-opus-4", "name": "Claude Opus 4" }, { "id": "deepseek-chat", "name": "DeepSeek V3" } ] } } } }

この設定にはいくつかの重要なポイントがあります。mode: "merge"は、追加したlaozhangプロバイダーがOpenClawの14個の組み込みプロバイダーと統合されることを保証します。置き換えではありません。この行を省略すると、以前設定した組み込みプロバイダー(直接OpenAI接続など)がすべて無効になります。baseUrlには/v1サフィックスを含める必要があります。これはOpenAI互換APIの標準パスプレフィックスで、省略すると404エラーが発生します。apiフィールドをopenai-completionsに設定するのは、laozhang.aiが完全なOpenAI Chat Completions APIフォーマットを実装しているためです。ClaudeやGeminiモデルを呼び出す場合でも、リクエストフォーマットはOpenAI互換で、laozhang.aiがバックエンドでプロトコル変換を行います。

環境変数によるキーの保護

APIキーを設定ファイルに平文で書くのは便利ですが、安全とは言えません。特にdotfilesをGitリポジトリで管理している場合はなおさらです。より安全な方法は環境変数参照を使用することです。設定のapiKeyフィールドを環境変数参照形式に変更します。

json"apiKey": "${LAOZHANG_API_KEY}"

次に、シェル設定ファイル(~/.zshrcまたは~/.bashrc)に以下を追加します。

bashexport LAOZHANG_API_KEY="sk-laozhang-あなたのキー"

source ~/.zshrcを実行(またはターミナルを再起動)して環境変数を有効にします。これにより、APIキーが設定ファイルに表示されなくなり、他の人があなたのopenclaw.jsonを見てもキーを取得できなくなります。OpenClawは設定の読み込み時に${VAR_NAME}構文を自動的に解析し、対応する環境変数から実際の値を読み取ります。

設定完了後のクイック検証

設定ファイルを保存したら、以下のコマンドで設定が有効になっているか確認します。

bashopenclaw models list --provider laozhang # laozhangのモデルに切り替え openclaw models set laozhang/gpt-4o-mini # 対話テストを開始 openclaw

openclaw models listコマンドで設定に定義した5つのモデルが正しく表示されれば、プロバイダー設定がOpenClawに正常に認識されています。次にopenclaw models setでlaozhangプロバイダーのモデルに切り替え、openclawを起動して簡単なメッセージを送信し接続性をテストします。正常な応答が返ってくれば、おめでとうございます。laozhang.aiのOpenClawへの接続が完了です。

推奨モデル設定プラン

laozhang.aiは200以上のモデルへのアクセスを提供していますが、OpenClawのAIプログラミングシーンでは、すべてを設定する必要はありません。タスクの種類に応じて3〜5個のコアモデルを選択すれば十分です。以下は実際の使用で検証された推奨モデルプランで、軽量な用途からヘビーな用途まで順に紹介します。

日常プログラミングタスク:laozhang/gpt-4o-mini

GPT-4o Miniはコストパフォーマンスが最も高い選択肢で、128Kのコンテキストウィンドウと極めて高速なレスポンス(50+ tokens/s)を備えています。ファイル編集、シンプルなコード生成、コードフォーマット、クイック質問応答などの日常的な操作には十分な性能を発揮し、コストはGPT-4oの約10分の1です。日々のOpenClawとのやり取りがこのような軽量タスク中心であれば(ほとんどの開発者がそうです)、GPT-4o Miniをメインモデルに設定することでAPI支出を大幅に削減できます。代替案としてlaozhang/deepseek-chat(DeepSeek V3)があり、中国語プログラミングの場面では同様に優れたパフォーマンスを発揮し、価格もさらに低く抑えられています。

複雑な推論とアーキテクチャ設計:laozhang/claude-sonnet-4-20250514

マルチファイルリファクタリング、複雑なアルゴリズム設計、アーキテクチャの意思決定分析、あるいは詳細なコードレビューが必要な場合、Claude Sonnet 4は能力と価格のベストバランスです。200Kのコンテキストウィンドウを持ち、ツール呼び出しの信頼性は極めて高く、大規模コードベースのコンテキスト関係の理解において優れた性能を発揮します。同レベルのGPT-4oと比較して、Claude Sonnet 4はコード生成の正確性と一貫性で通常優位に立ちます。これはOpenClaw公式が推奨するデフォルトのメインモデルでもあります。代替案としてlaozhang/gpt-4oがあり、マルチモーダル機能が必要な場合(スクリーンショットのUI問題分析など)に画像モデルとして使用できます。

最高性能とディープ推論:laozhang/claude-opus-4

Claude Opus 4は現在利用可能な最も強力な推論モデルの1つで、システムレベルのリファクタリング、複雑なAgentオーケストレーション、深い思考を要するアーキテクチャ設計タスクに適しています。能力の天井は最も高いですが、コストもそれに応じて高くなります。日常のメインモデルとしてではなく、フォールバックモデルとして設定し、メインモデルが複雑なタスクに対応できない場合にのみ手動で切り替えることを推奨します。代替案としてlaozhang/o3(OpenAIの推論モデル)があり、数学や論理推論が集中するシーンで独自の強みを発揮します。

openclaw.jsonでメインモデルとフォールバックモデルを設定する方法は以下の通りです。OpenClawはデフォルトでGPT-4o Miniを使用して日常タスクを処理し、/modelコマンドで手動切り替えするか、メインモデルが利用できない場合にのみフォールバックモデルを有効にします。

json{ "agents": { "defaults": { "model": { "primary": "laozhang/gpt-4o-mini", "fallbacks": ["laozhang/claude-sonnet-4-20250514"] }, "imageModel": { "primary": "laozhang/gpt-4o" } } } }

マルチモデルルーティングとコスト最適化

マルチモデルルーティング戦略を適切に活用することが、APIコストを管理する鍵です。実際の使用経験に基づくと、約80%の日常プログラミングのやり取りは軽量モデル(GPT-4o MiniまたはDeepSeek V3)で完了でき、複雑なタスクで高性能モデル(Claude Sonnet 4またはOpus 4)を呼び出す必要があるのは20%程度です。軽量モデルをメインモデルに設定し、高性能モデルをオンデマンド切り替えのフォールバックオプションにすることで、出力品質を維持しながら月間APIコストを$5〜15の範囲に抑えることができます。公式APIの直接利用($50〜200/月)と比較して、70〜90%程度のコスト削減が見込めます。OpenClawのコスト管理についてより深く知りたい場合は、OpenClawコスト最適化&トークン管理ガイドに詳細な戦略分析が記載されています。

OpenClawのフォールバック機能は実際の使用において非常に便利です。メインモデルが一時的な過負荷やネットワーク変動でエラーを返した場合、システムは自動的にfallbacksリスト内の次のモデルを試行し、このプロセス全体がユーザーに対して透過的に行われます。agents.defaults.model.fallbacks配列に優先度順に複数のフォールバックモデルを配置できます。同レベルだが異なるプロバイダーのモデルを交互に並べることを推奨します。これにより、あるアップストリームプロバイダーに障害が発生しても、他のプロバイダーのモデルが引き継ぐことができます。例えば、メインモデルにlaozhang/gpt-4o-mini、フォールバックにlaozhang/deepseek-chatとlaozhang/claude-sonnet-4-20250514を順に設定すれば、コストから能力まで段階的な保証チェーンが形成されます。

設定完了後、openclaw models fallbacks listで現在有効なフォールバックチェーンを確認でき、openclaw models fallbacks add laozhang/deepseek-chatでコマンドラインからフォールバックモデルを素早く追加したり、openclaw models fallbacks clearですべてのフォールバック設定をクリアして再設定したりできます。日常使用中に、あるモデルの回答が現在のタスクに十分でないと感じた場合は、OpenClawのチャットインターフェースで/model laozhang/claude-sonnet-4-20250514コマンドを使って一時的により強力なモデルに切り替え、完了後にメインモデルに戻して日常作業を継続できます。

以下の表は、異なるモデル組み合わせ戦略の月間コスト見積もりを比較したもので、使用頻度に応じて適切な設定を選択する参考になります。

| 使用パターン | メインモデル | フォールバックモデル | 月額予想 | 対象ユーザー |

|---|---|---|---|---|

| ライトユース | gpt-4o-mini | なし | $2-5 | たまにAI支援を利用 |

| スタンダード | gpt-4o-mini | claude-sonnet-4 | $5-15 | 一般的な開発者(推奨) |

| ヘビーユース | claude-sonnet-4 | claude-opus-4 | $15-40 | 常時AIプログラミング |

| 公式直接利用 | claude-sonnet-4 (公式) | - | $50-200 | 比較参考用 |

設定検証とよくある問題の解決

設定完了後、体系的な検証を行うことで潜在的な問題を素早く発見できます。以下は推奨する4ステップの診断フローで、実行順序に沿って並んでおり、各ステップで問題の範囲を絞り込むことができます。

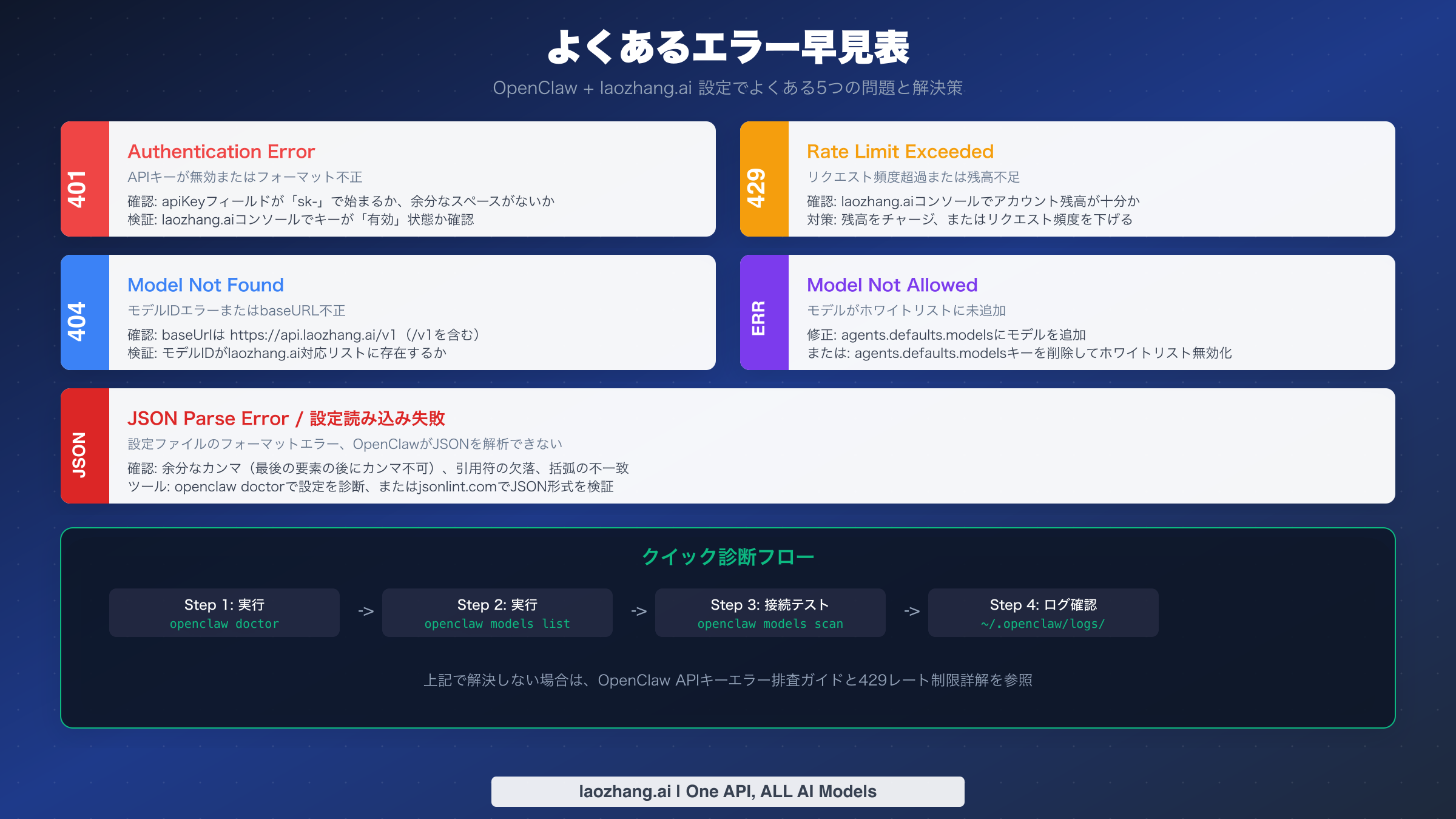

第1ステップはopenclaw doctorの実行です。この組み込み診断ツールは、設定ファイルのJSON構文、プロバイダー定義の完全性、認証ステータスをチェックします。設定ファイルにフォーマットエラー(余分なカンマや引用符の欠落など)がある場合、doctorが問題の行番号を直接指摘します。第2ステップはopenclaw models list --provider laozhangの実行で、定義したすべてのモデルが正しく認識されているか確認します。ここで空の表示になる場合は、プロバイダー名の不一致やmodels配列の定義ミスが考えられます。第3ステップはopenclaw models scanの実行で、実際にlaozhang.aiにリクエストを送信して接続性をテストし、各モデルのツール呼び出しと画像処理機能を検出します。第4ステップはログファイル~/.openclaw/logs/のチェックで、完全なAPIリクエストとレスポンスの記録が含まれており、難しい問題を特定する最後の手段です。

よくあるエラー早見表

401 Authentication ErrorはAPIキーが無効またはフォーマットが不正であることを示します。まずキーがsk-で始まっているか、余分なスペースや改行が入っていないか確認してください。環境変数参照(${LAOZHANG_API_KEY})を使用している場合は、変数が正しくエクスポートされているか確認します。echo $LAOZHANG_API_KEYを実行して検証してください。また、laozhang.aiコンソールでキーのステータスが「有効」であり「無効」でないことを確認します。

429 Rate Limit Exceededはリクエスト頻度の超過またはアカウント残高不足を示します。まずlaozhang.aiコンソールでアカウント残高が十分かどうか確認してください。残高がゼロの場合、すべてのリクエストが429を返します。残高が十分でもこのエラーが発生する場合は、短時間にリクエストが集中している可能性がありますので、しばらく待ってから再試行してください。429エラーの詳細な分析については、OpenClaw 429レート制限詳解を参照してください。

404 Model Not Foundは通常2つの原因で発生します。baseUrlに/v1サフィックスがないか、モデルIDのスペルミスです。baseUrlがhttps://api.laozhang.ai/v1(末尾の/v1に注意 )になっているか慎重に確認し、models配列のidフィールドがlaozhang.aiでサポートされているモデルIDと完全に一致していることを確認してください。利用可能なすべてのモデルの正確なIDは、docs.laozhang.aiのモデル一覧ページで確認できます。

Model Not Allowedエラーは、agents.defaults.modelsホワイトリストを設定しているにもかかわらず、新しいモデルをリストに追加していない場合に発生します。解決方法は2つあります。laozhangのモデルをホワイトリスト配列に追加するか、agents.defaults.modelsキーを削除してホワイトリスト制限を無効にするか(後者は個人利用のシーンにより適しています)です。

上級テクニックとベストプラクティス

基本設定をマスターしたら、以下の上級テクニックでOpenClaw + laozhang.aiの組み合わせをより効率的に活用できます。

モデルエイリアスで切り替えを簡略化。laozhang/claude-sonnet-4-20250514のような長いモデル名を頻繁に入力するのは効率的ではありません。OpenClawはモデルのショートエイリアス作成をサポートしています。openclaw models aliases add sonnet laozhang/claude-sonnet-4-20250514でsonnetというエイリアスを作成すれば、チャット中は/model sonnetと入力するだけで素早く切り替えできます。最もよく使う3〜5個のモデルにエイリアスを作成することをお勧めします。例えばminiをGPT-4o Mini、opusをClaude Opus 4、dsをDeepSeek V3に割り当てれば、タスク間のモデル切り替えが数回のキー入力で済みます。

モデル能力の宣言でルーティングを最適化。models配列のモデル定義にオプションフィールドを追加することで、OpenClawがよりインテリジェントなルーティング判断を行えます。例えば、画像入力をサポートするモデルに"input": ["text", "image"]を宣言すれば、スクリーンショットや画像の分析が必要な場合にOpenClawがテキスト専用モデルではなく自動的にそのモデルを選択します。同様に、推論能力の高いモデルに"reasoning": trueを設定すれば、複雑なタスク処理時にOpenClawがこれらのモデルを優先的に検討します。正確なcontextWindow値を設定すればコンテキストの切り詰めを防止できます。モデルが実際には128Kコンテキストをサポートしているのに宣言がなければ、OpenClawが長いファイルの送信時に不必要にコンテンツを切り詰める可能性があります。

マルチ環境設定戦略。個人プロジェクトと会社プロジェクトを同時に持っている場合、環境変数でAPIキーとモデル戦略を使い分けることができます。個人環境ではLAOZHANG_API_KEYを個人のキーに設定し、コスト効率の良いGPT-4o Miniをメインモデルに設定。会社環境では別の環境変数を使って会社アカウントのキーを指定し、コード品質を確保するためにClaude Sonnet 4をメインモデルに設定します。OpenClawの環境変数参照構文(${VAR_NAME})により、このようなマルチ環境の切り替えが非常に自然に行えます。OpenClawモデル設定のより高度な使い方、ローカルモデル(Ollama、vLLM)やエンタープライズ級のデプロイメント方案については、OpenClaw LLM設定完全ガイドを参照してください。

まとめと次のステップ

本記事の3ステップ設定フロー(APIキーの取得、openclaw.jsonの編集、検証と使用開始)により、OpenClawとlaozhang.aiの接続が完了し、1つの統一エンドポイントから200以上のAIモデルにアクセスする能力を手に入れました。設定の核心はmodels.providers内の3つの重要パラメータです。baseUrlをhttps://api.laozhang.ai/v1に、apiをopenai-completionsに、apiKeyにあなたのキーを入 力するだけです。

次に、実際のニーズに合わせて設定の最適化を続けられます。コストを節約したい場合は、本記事で推奨したマルチモデルルーティング戦略に従い、GPT-4o Miniをメインモデル、Claude Sonnet 4をフォールバックモデルに設定して、80%の日常タスクを低コストモデルで処理しましょう。OpenClawのモデル動作をより深くカスタマイズしたい場合、ローカルモデルの追加、エンタープライズプロキシの設定、より複雑なルーティング戦略の実装については、OpenClawカスタムモデル追加完全ガイドが次の参考資料です。

最後に実用的なアドバイスを1つ。本格的に使い始める前に、laozhang.aiの$0.05テストクレジットを使ってさまざまなモデルを試し、ワークフローに最適なモデルの組み合わせを見つけてください。開発者ごとにプログラミングの習慣は異なり、最適なモデルの選択も人それぞれです。実際の体験から主力モデルを決めることが、どんな推奨リストよりも確実です。laozhang.aiの詳細な使用ドキュメントとモデルリストはdocs.laozhang.aiで確認できます。