2026년 4월 9일 기준으로, 모두에게 동일하게 열려 있는 하나의 Seedance 2.0 free online 사이트는 없습니다. 지금 중요한 질문은 어디가 공식 경로인가, free가 장기 무료를 뜻하는가 아니면 제한된 입구인가, 기본 공식 루트가 막혔을 때 어떤 정도의 마찰과 신뢰 부담을 감수할 것인가입니다.

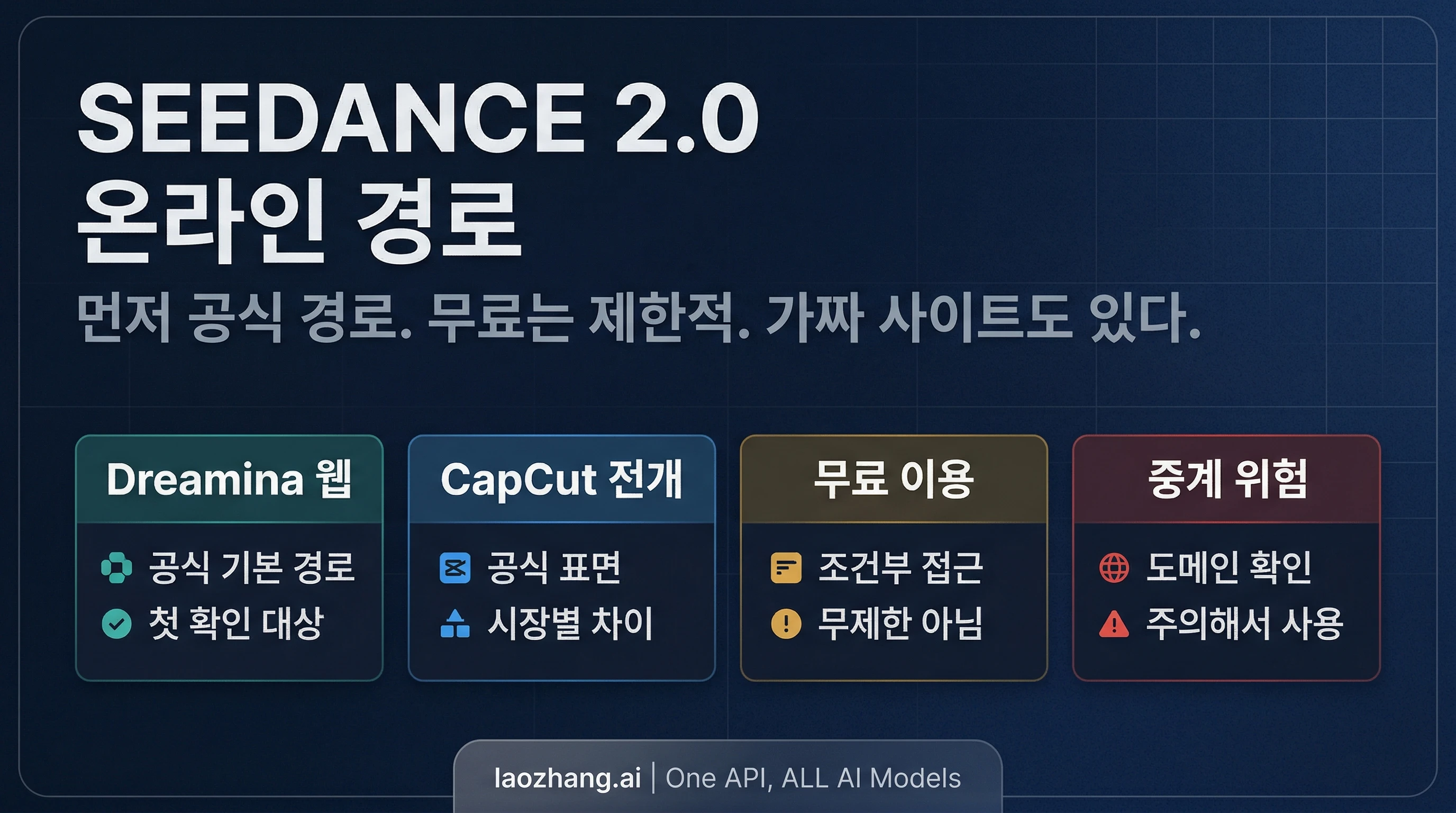

가장 안전한 첫 클릭만 고르자면 보통 순서는 이렇습니다. 먼저 Dreamina 공식 페이지를 본다. 다음으로 CapCut 경로가 내 계정과 지역에서 실제로 열려 있는지 확인한다. 중국 앱을 현실적으로 사용할 수 있다면 그것은 별도 레인으로 판단한다. 그리고 공식 경로가 불편하다는 이유로 third-party 페이지를 쓰더라도, 그것을 공식 접근과 같은 계약으로 취급하지 않는다.

먼저 어느 경로를 열어야 하나

online free라고 적힌 페이지를 한 묶음으로 보지 않을수록 판단이 빨라집니다.

| 지금 필요한 것 | 첫 클릭 | 왜 이 경로가 더 안전한가 | 감수해야 할 점 |

|---|---|---|---|

| 가장 명확한 공식 웹 입구 | Dreamina 공식 페이지 | 공식 경로 여부를 가장 빠르게 확인하기 쉽다 | 실제 접근은 계정 상태와 surface에 따라 달라질 수 있다 |

| 이미 CapCut을 쓰는 편집 워크플로우 | CapCut 안의 Seedance 2.0 경로 | wrapper가 아니라 공식 CapCut 경로다 | rollout은 시장과 surface별로 다르다 |

| 중국 앱 사용이 현실적인 경우 | Jimeng 또는 Xiaoyunque | ByteDance 계열의 실제 first-party 루트다 | 언어, 계정, 지역 마찰이 있다 |

| 공식 경로가 당장 막혀 있어 우선 체험만 하고 싶은 경우 | third-party 경로를 fallback으로만 사용 | 모델을 시험해 볼 수는 있다 | 공식 접근과 같은 신뢰 경계가 아니다 |

이 route board가 이 페이지의 핵심 답입니다. 이후 내용은 공식 경로가 무엇인지, free를 어떻게 읽어야 하는지, 그리고 어떤 도메인을 피해야 하는지를 보강하는 역할만 합니다.

지금 공식이라고 말할 수 있는 입구는 어디인가

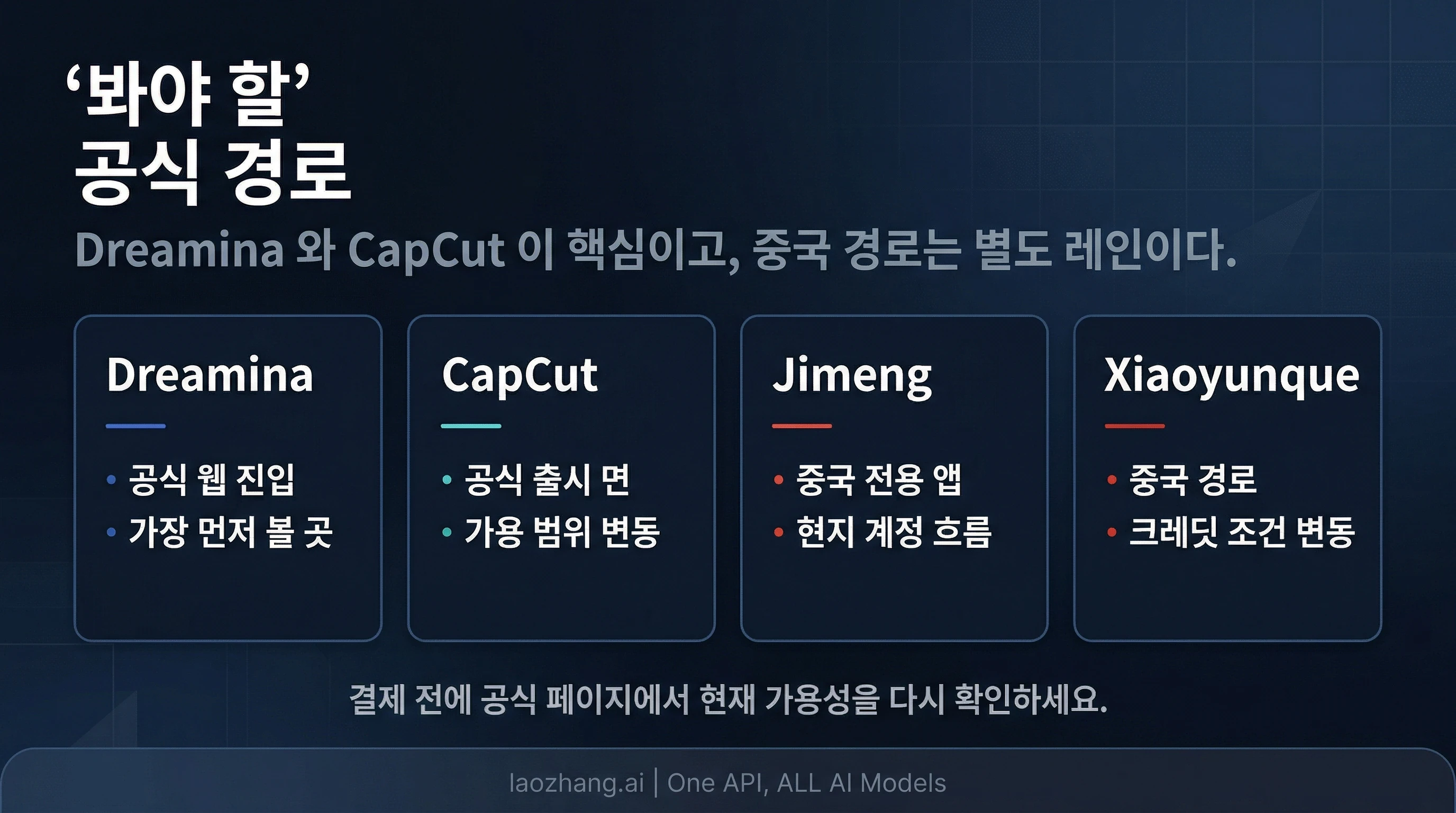

현재 Seedance 2.0의 공식 접근은 하나의 독립적인 Seedance 전용 사이트에 모여 있지 않습니다. 실제 사용자 입장에서는 Dreamina와 CapCut이 핵심 consumer-facing 입구입니다.

Dreamina는 여전히 가장 명확한 공식 웹 루트다

브라우저에서 시작하고 legitimacy를 먼저 확인하고 싶다면 Dreamina가 가장 깔끔한 첫 정거장입니다. 공식 페이지가 스스로를 official website / official access surface로 설명하기 때문에, 첫 단계에서 이게 진짜 공식인가를 확인하기 쉽습니다.

다만 여기서 많이 과장됩니다. 현재 공식 페이지 문구는 누구나 안정적으로 무제한 무료로 온라인 사용 가능하다는 해석을 뒷받침하지 않습니다. Dreamina는 공식 웹 루트지만, 실제 접근 범위는 계정과 현재 페이지 상태에 따라 달라질 수 있다고 보는 편이 안전합니다.

CapCut도 공식이지만 Dreamina와 같은 계약은 아니다

CapCut의 공식 도구 페이지와 newsroom은 Seedance 2.0을 실제 온라인 도구로 안내합니다. 문제는 rollout wording입니다. 접근은 시장, 시기, surface에 따라 다르게 풀리고 있으며, 한 번에 전 세계가 동일하게 열린 것처럼 써서는 안 됩니다.

그래서 더 정확한 이해는 Dreamina와 CapCut은 둘 다 공식이지만 같은 access contract는 아니다입니다. 이미 CapCut 워크플로우 안에 있다면 CapCut이 편할 수 있지만, 공식성 확인만 먼저 하고 싶다면 Dreamina가 여전히 더 깨끗한 첫 클릭입니다.

중국 앱 경로는 별도 레인으로 봐야 한다

한국어 검색 결과에서도 Dreamina, CapCut, Jimeng, Xiaoyunque, 여러 wrapper 페이지를 한꺼번에 사용 가능한 경로로 나열하는 글이 많습니다. 하지만 reader job에는 너무 거친 지도입니다.

Jimeng과 Xiaoyunque는 중국향 first-party 경로입니다. 중국어, 계정, 지역 전제가 현실적이라면 실용적인 선택지가 될 수 있습니다. 그러나 국제 웹 접근의 한 버튼처럼 설명해서는 안 됩니다.

free는 실제로 무엇을 뜻하나

이 주제에서 가장 위험한 단어가 바로 free입니다. 공식 페이지에 try for free가 보이는 것은 사실이지만, 그것이 모든 사용자에게 동일한 장기 무료 계약을 뜻하지는 않습니다.

free는 최소한 네 가지로 나누어 읽는 편이 안전합니다.

- 공식 웹 surface에서의 제한적 체험 입구

- rollout 조건 일부로서의 단계적 접근

- 중국 앱에서의 로컬 무료 또는 저마찰 입구

- wrapper 페이지가 광고 문구로 쓰는

free online

따라서 더 좋은 질문은 Seedance 2.0이 무료인가가 아니라 이 경로가 충분히 낮은 마찰로 Seedance 2.0이 내 워크플로우에 맞는지 검증하게 해 주는가입니다.

이 페이지가 과거의 정확한 credit 숫자와 package 숫자를 반복하지 않는 이유도 같습니다. 현재 공식 페이지는 Dreamina, CapCut, 그 밖의 경로를 모두 커버하는 안정적인 universal pricing table을 보여주지 않습니다. 가격과 무료 체험의 가치가 핵심이라면 영어 pricing guide로 가는 편이 더 정확합니다.

공식 루트가 막혀 있을 때는 어떻게 생각해야 하나

많은 독자가 원하는 것은 절대적인 1등 도구가 아니라, 공식 페이지를 눌렀는데 지금 내게는 안 열린다. 그다음은?에 대한 답입니다.

공식 경로 근처에 최대한 남고 싶다면

먼저 Dreamina와 CapCut 사이에서 다른 official surface를 다시 확인하세요. 첫 third-party 결과로 바로 뛰는 것보다, 현재 나에게 열려 있는 공식 경로가 있는지 한 번 더 보는 편이 안전합니다.

중국향 first-party 경로가 현실적이라면

그것을 별도 루트로 평가해야 합니다. 국제 웹 접근의 숨겨진 버전이라고 보면 안 됩니다. 언어와 지역 마찰을 감수할 수 있다면 선택지가 될 수 있지만, 감수할 수 없다면 단지 더 싸 보인다는 이유로 기본 답으로 삼아서는 안 됩니다.

그래도 third-party 페이지를 쓰고 싶다면

여기서 필요한 것은 convenience보다 trust calibration입니다. third-party 경로는 테스트용 입구가 될 수는 있어도 Dreamina나 CapCut의 legitimacy를 자동으로 이어받지 않습니다. 최소한 다음을 따로 확인해야 합니다.

- 누가 운영하는가

- 과금 구조가 투명한가

- 장기 안정성이 보이는가

- fallback을 공식 경로처럼 포장하고 있지 않은가

가장 간단한 규칙은 이것입니다. 공식 루트가 불편해서 third-party를 쓰는 것이라면, 그것은 fallback이지 공식 경로가 아닙니다.

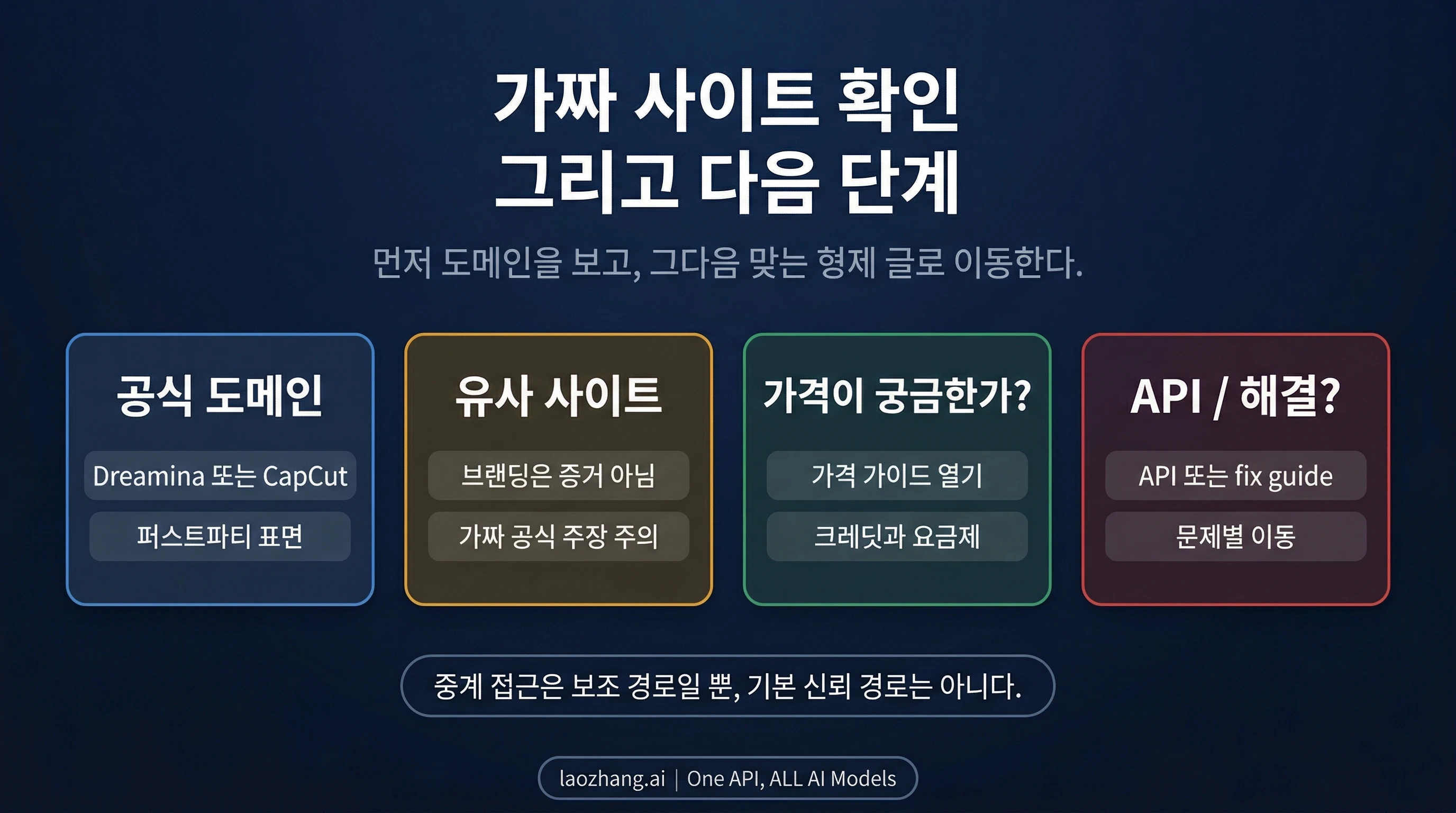

클릭 전에 반드시 도메인을 확인하라

Dreamina 공식 페이지는 seedance2.ai, seedance2.app, seedance.tv가 공식 ByteDance 사이트가 아니라고 직접 경고합니다. 현재 검색 환경에서는 이것이 FAQ 말미의 작은 팁이 아니라 main answer의 일부입니다.

가입이나 결제 전에 한 가지만 확인한다면 도메인 확인을 먼저 하세요.

- 아직 Dreamina, CapCut, 또는 ByteDance가 직접 운영하는 surface 위에 있는지 확인한다.

Seedance라는 이름만으로 official이라고 판단하지 않는다.free online을 크게 약속하면서 운영 주체를 흐리는 페이지는 특히 조심한다.

모든 third-party 페이지가 자동으로 악성이라는 뜻은 아닙니다. 다만 official route는 legitimacy에서 출발하고 그다음에 나에게 열려 있는가를 묻습니다. 반대로 third-party route는 convenience에서 출발하고, legitimacy를 별도로 입증해야 합니다. 이 순서를 바꾸지 않는 것이 중요합니다.

다음에 읽어야 할 페이지

이 페이지의 일은 route choice까지입니다. 여기서 가격, API, troubleshooting, comparison을 전부 다시 떠안으면 다시 broad guide로 무너집니다.

질문이 다음 단계로 바뀌었다면 아래 페이지로 분기하는 편이 낫습니다.

- 비용, 무료 체험, 장기 사용 판단은 영어 pricing guide

- programmatic access 상태는 영어 API guide

- 공식 경로인데 surface가 열리지 않거나 이상하게 동작하면 영어 troubleshooting guide

- access 문제가 끝났고 model family를 비교하고 싶다면 영어 comparison guide

이 분리를 지키면 이 페이지는 온라인 접근 판단이라는 본래 역할을 유지할 수 있습니다.

자주 묻는 질문

Seedance 2.0에 공식 사이트가 있나

있습니다. 다만 검색 결과가 암시하는 것처럼 하나의 도메인이 모든 것을 해결한다는 형태는 아닙니다. 모델 자체는 공식이지만, 일반 사용자의 실질적인 온라인 입구는 Dreamina와 CapCut에 나뉘어 있습니다.

Seedance 2.0을 무료로 쓸 수 있나

제한적이거나 surface-specific한 무료 입구를 얻을 수는 있지만, 그것을 universal한 장기 무료 계약으로 읽으면 안 됩니다. 공식 try for free는 먼저 bounded entry path로 이해하는 편이 안전합니다.

seedance.tv는 공식인가

아닙니다. Dreamina 공식 페이지는 seedance.tv, seedance2.ai, seedance2.app가 공식 ByteDance 사이트가 아니라고 명시합니다.

Dreamina나 CapCut이 내게 열리지 않을 때는 어떻게 하나

다른 official surface를 기다릴 것인지, 중국향 first-party 경로가 현실적인지, 아니면 더 높은 신뢰 비용의 third-party fallback을 받아들일 것인지를 먼저 정해야 합니다. 핵심은 어떤 마찰을 감수할지 선택하는 것입니다.

가격, API, 비교는 어디서 보면 되나

가격은 영어 pricing guide, API는 영어 API guide, 장애 상황은 영어 troubleshooting guide, 모델 비교는 영어 comparison guide 가 가장 빠른 경로입니다.