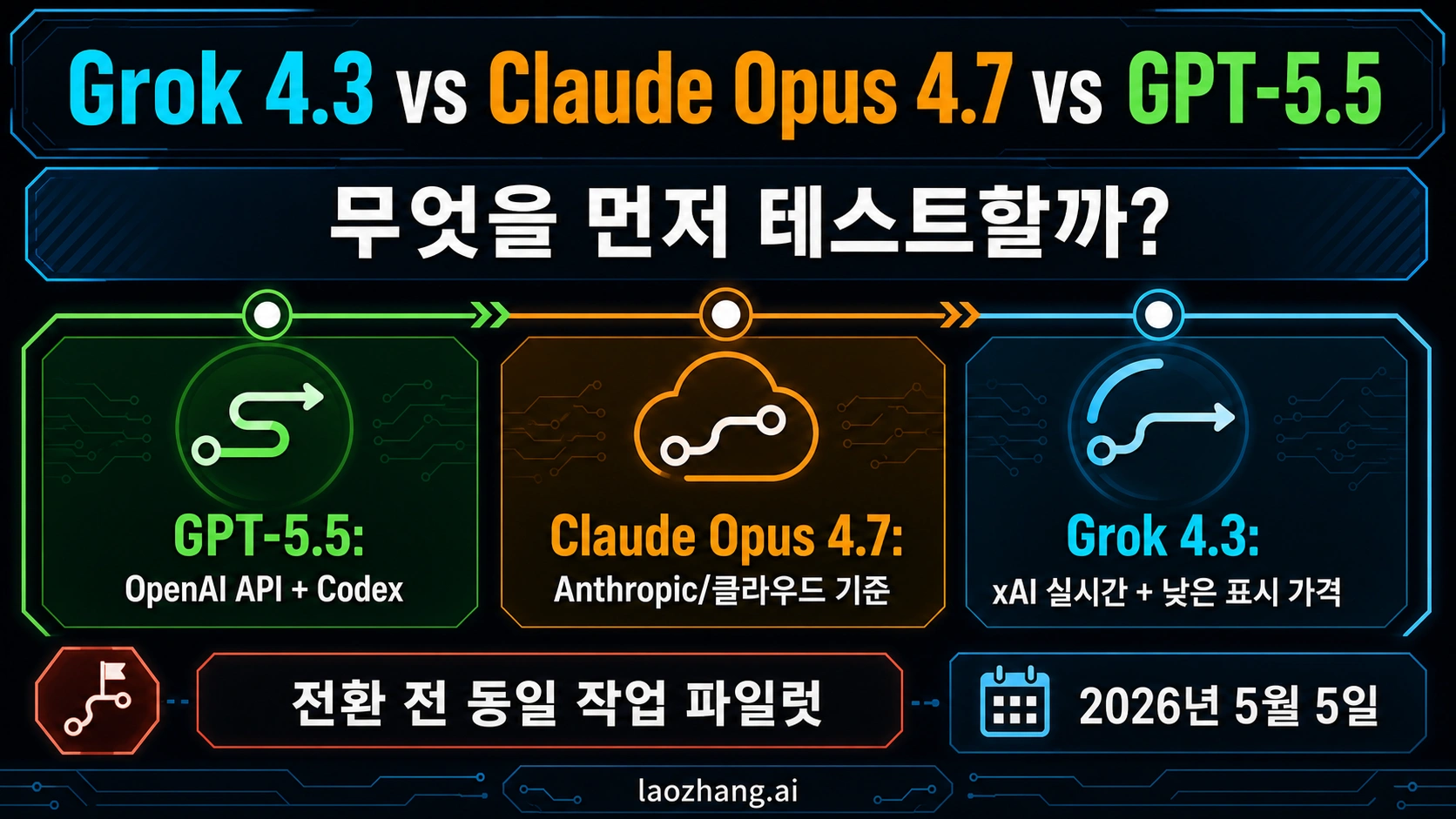

2026년 5월 5일 기준으로 가장 안전한 답은 하나의 우승 모델을 고르는 것이 아니라, 먼저 어떤 배포 경로를 테스트할지 정하는 것입니다. 이미 OpenAI API, Responses API, Codex, structured outputs, hosted tools, OpenAI eval에 묶인 제품이라면 GPT-5.5를 먼저 테스트합니다. Anthropic API, Claude 제품, Bedrock, Vertex AI, Microsoft Foundry, 또는 실패 비용이 큰 coding agent를 운영한다면 Claude Opus 4.7을 premium control로 둡니다. 비교 이유가 xAI 계정, realtime/X search, 낮은 표시 가격, long-context pilot이라면 Grok 4.3부터 시작합니다.

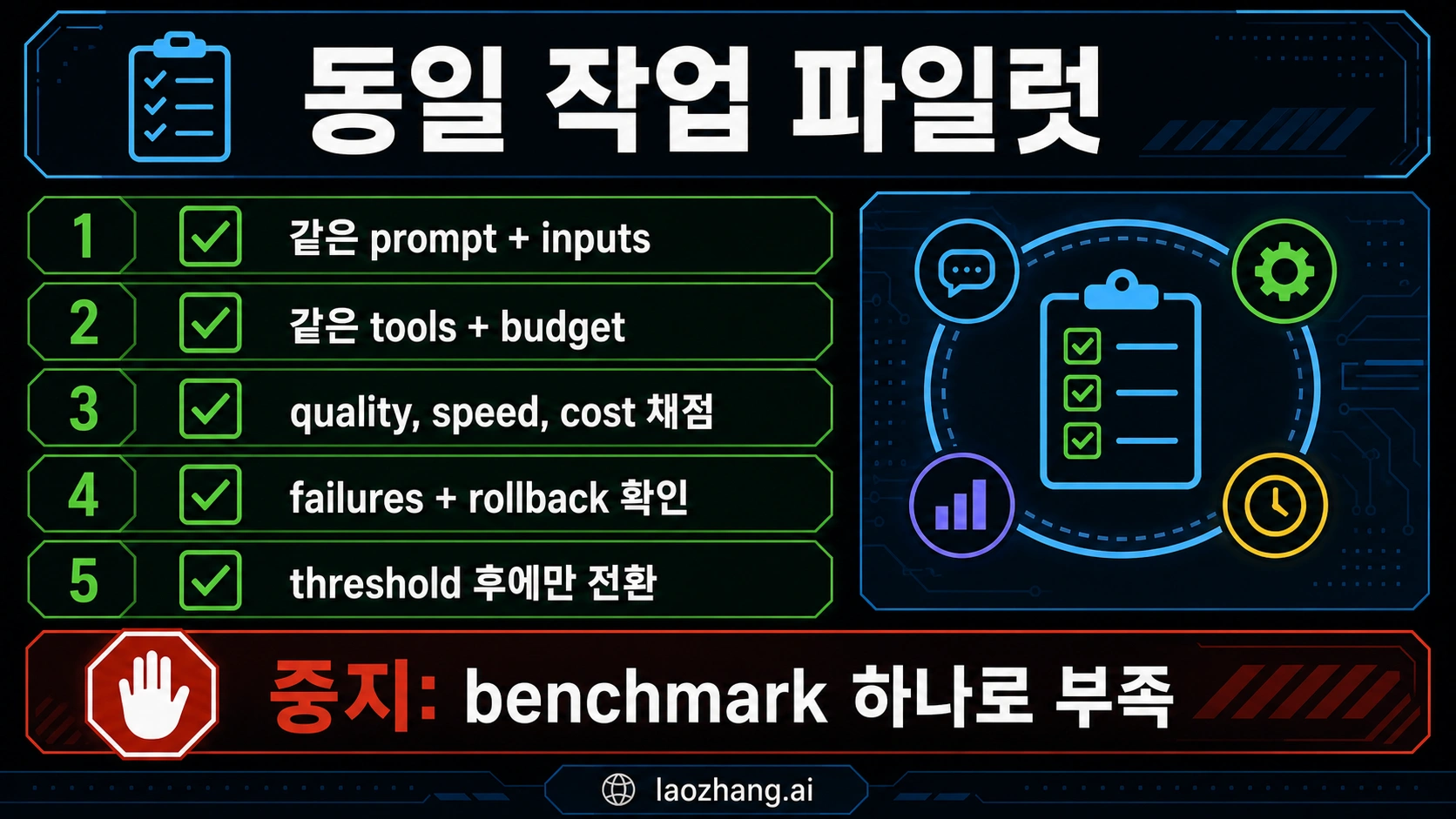

단일 벤치마크, 영상, 출시 직후 인상만 보고 production default를 바꾸면 안 됩니다. 같은 prompt, 같은 files, 같은 tools, 같은 budget, 같은 scoring rubric, 같은 rollback threshold를 적용해야 모델 비교가 실제 의사결정이 됩니다.

| 먼저 테스트할 경로 | 맞는 상황 | 바로 가정하면 안 되는 것 |

|---|---|---|

| GPT-5.5 | OpenAI API, Responses API, Codex, tool-heavy reasoning, structured outputs, OpenAI eval을 이미 사용한다. | Codex 표시, API key, API 가격, Codex credits, rate limits가 같은 계약이다. |

| Claude Opus 4.7 | Anthropic API, Claude products, Bedrock, Vertex AI, Microsoft Foundry, high-risk coding agents가 필요하다. | premium control이 output, tokenizer, retries, review time까지 포함해 항상 더 싸다. |

| Grok 4.3 | xAI route, realtime/X freshness, lower listed token price, long-context experiment가 이유다. | 낮은 token price가 동일 작업 성공 비용 검증을 대체한다. |

실제로 호출할 수 있는 계약부터 확인하기

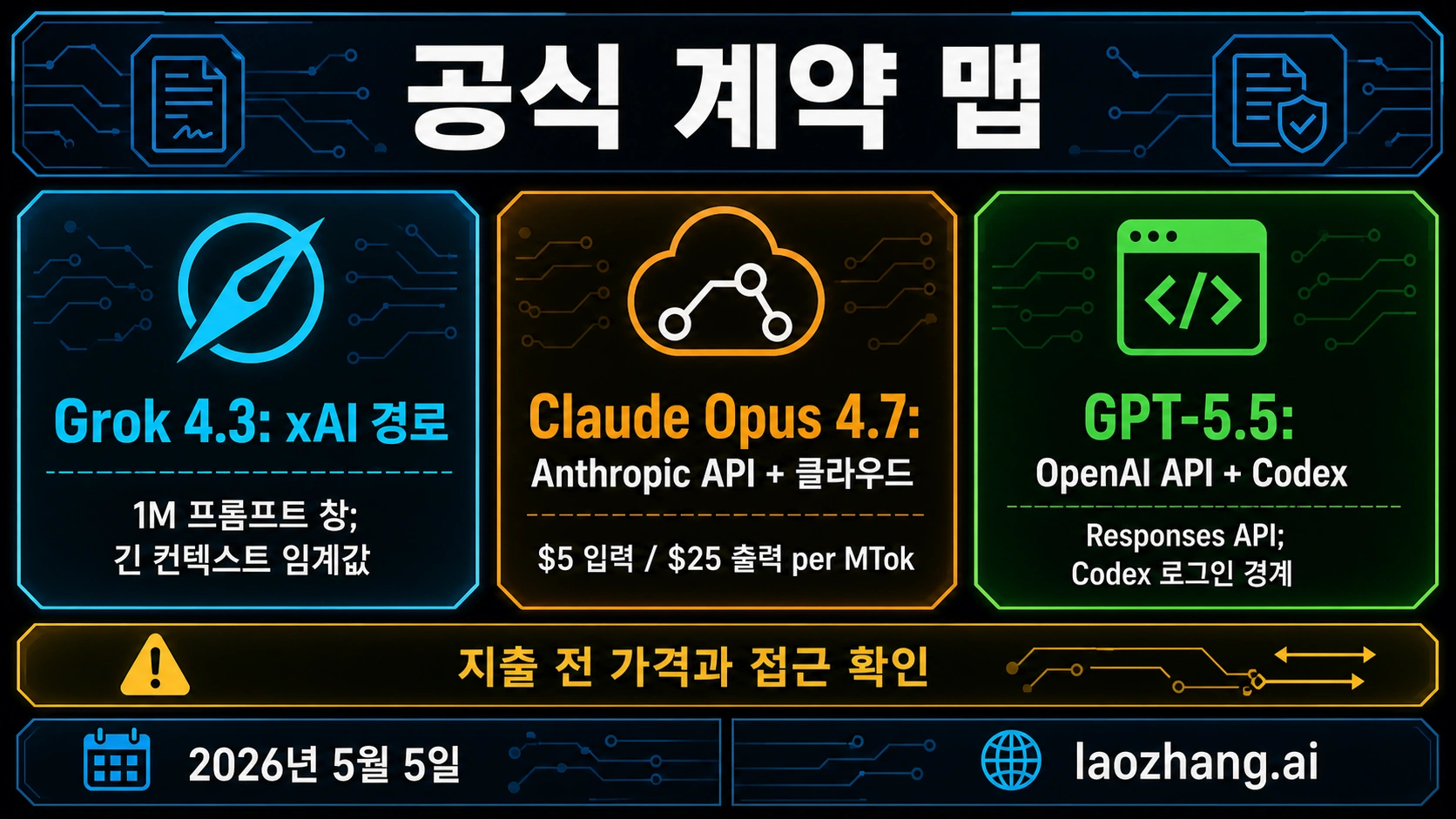

이 비교의 출발점은 브랜드 인상이 아니라 route ownership입니다. OpenAI는 GPT-5.5 API, Responses API, Codex surface의 사실을 소유합니다. Anthropic은 Claude Opus 4.7의 Claude products, Anthropic API, cloud provider route를 소유합니다. xAI는 Grok 4.3, console visibility, aliases, server-side search tools, long-context thresholds, account availability를 소유합니다. 외부 비교는 무엇을 테스트할지 제안할 수 있지만, model ID, endpoint behavior, pricing row, context limit, production access를 결정할 권한은 없습니다.

| 계약 항목 | GPT-5.5 | Claude Opus 4.7 | Grok 4.3 |

|---|---|---|---|

| route owner | OpenAI developer platform, Responses API, Codex | Anthropic API, Claude products, Bedrock, Vertex AI, Microsoft Foundry | xAI API, xAI Console, Grok docs, server-side search tools |

| 확인할 모델 라벨 | GPT-5.5와 OpenAI docs의 dated snapshots | claude-opus-4-7과 cloud model IDs | grok-4.3, grok-4.3-latest 또는 console alias |

| 가장 강한 첫 테스트 이유 | OpenAI-native tools, structured outputs, Codex, existing evals | high-risk coding agents와 cloud deployment의 premium control | xAI realtime/X search, lower listed price, long-context pilot |

| 비용 주의점 | OpenAI API pricing과 Codex credits를 분리해야 한다. | Anthropic은 $5 input, $25 output per MTok과 tokenizer caveat를 제시한다. | xAI console, alias, long-context threshold, search-tool costs를 다시 확인해야 한다. |

| 섞지 말 것 | API route, ChatGPT/Codex login, API-key auth, credits, rate limits | Claude app, Anthropic API, cloud route, priority tier, tokenizer cost | Grok chat, xAI API, Web/X Search, aliases, region/account availability |

OpenAI의 GPT-5.5 guidance는 Responses API 문맥에서 읽어야 합니다. reasoning effort, verbosity, Structured Outputs, prompt caching, hosted tools, state handling, Agents SDK가 같은 운영 표면에 있습니다. Codex docs도 GPT-5.5를 complex coding, computer use, knowledge work, research workflow의 frontier choice로 둡니다. OpenAI-native 팀에게 중요한 것은 단순한 점수가 아니라, production과 가까운 표면에서 format drift, tool failure, retry, billing behavior를 관찰할 수 있다는 점입니다.

Anthropic의 Opus 4.7 공개 자료는 Claude products, Anthropic API, Amazon Bedrock, Google Vertex AI, Microsoft Foundry에서 일반 제공된다고 설명합니다. claude-opus-4-7, 1M context, $5 input, $25 output per million tokens, tokenizer caveat도 확인해야 할 경계입니다. 이 때문에 Opus는 심각한 결함, rollback, reviewer time이 큰 agent에서 control route로 남길 가치가 있습니다.

xAI의 Grok 4.3은 server-side search tools와 함께 봐야 합니다. realtime events는 Web Search나 X Search가 필요하며, 기본 모델 기억이 최신 사실을 자동 보장하는 것이 아닙니다. Grok를 선택하는 이유가 realtime/X freshness라면, pilot은 tool calls, search failures, citation quality, tool cost까지 계산해야 합니다.

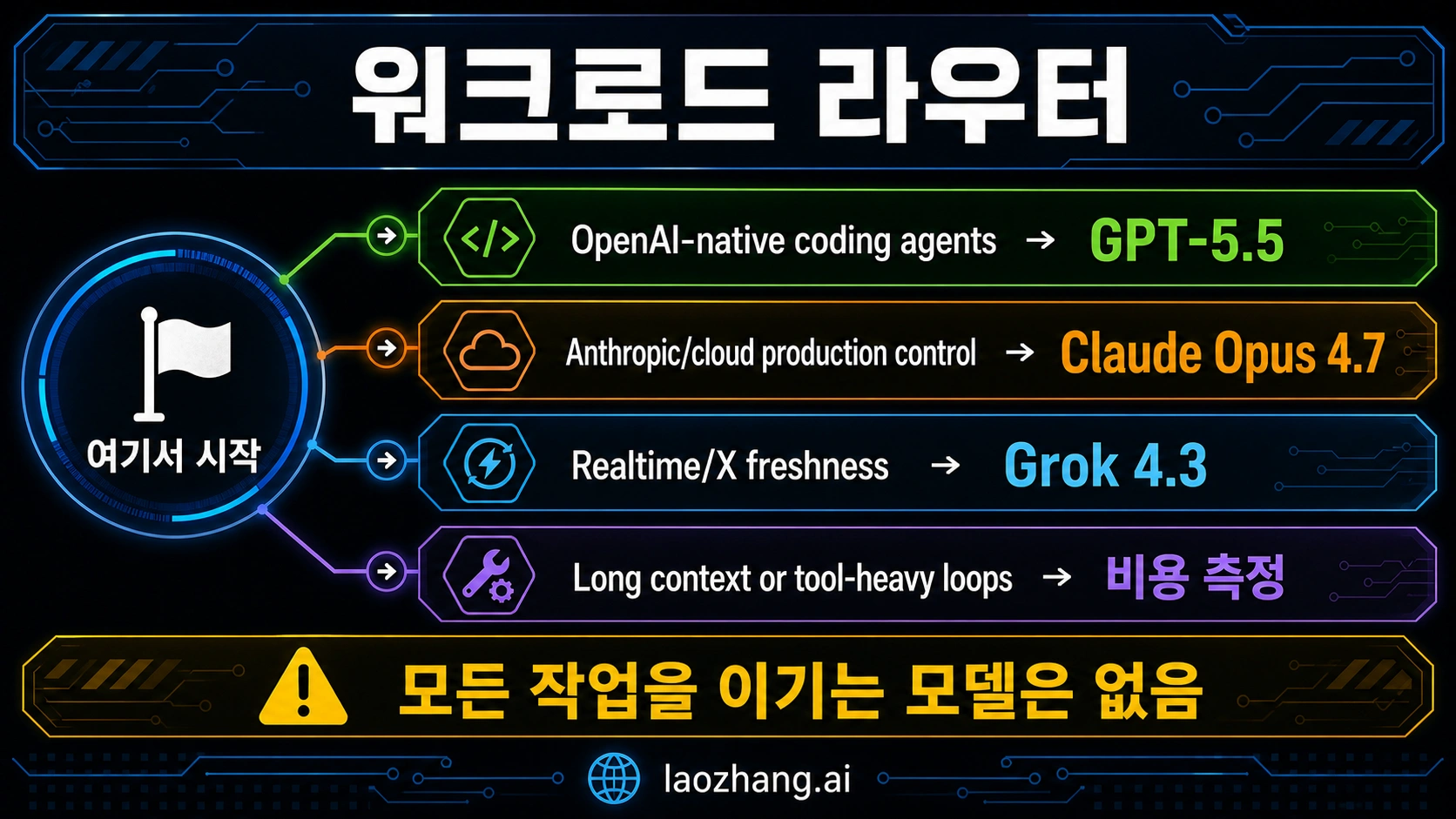

작업 유형별 첫 테스트 경로

유용한 질문은 "어떤 모델이 최고인가"가 아니라 "이 workload에서 어떤 경로가 첫 controlled test를 받을 자격이 있는가"입니다. 이렇게 보면 벤치마크 논쟁을 배포 실험으로 바꿀 수 있습니다.

| 작업 유형 | 첫 경로 | 맞는 이유 | 점수화할 것 |

|---|---|---|---|

| OpenAI-native coding, Codex, Responses API tools, structured outputs | GPT-5.5 | OpenAI tooling, Codex workflow, existing eval harness와 가장 가깝다. | accepted diffs, tool recovery, format stability, review time, token/credits. |

| correctness-sensitive coding agents, multi-tool workflows, cloud deployment | Claude Opus 4.7 | 실패 비용이 큰 작업의 Anthropic/cloud premium control. | defect severity, rollback behavior, tool reliability, reviewer trust, latency. |

| realtime 또는 X-informed answers | Grok 4.3 | xAI가 Grok와 search tools 경로를 소유한다. | freshness, tool count, search cost, citation quality, false freshness claims. |

| long-context repository, document, evidence analysis | route-specific test | 세 모델 모두 large-context story가 있지만 limits와 price threshold가 다르다. | truncation, recall, output length, long-context threshold, completed-task cost. |

| budget-sensitive exploration | Grok 4.3 first, then GPT-5.5 or Opus control | 표시 가격은 pilot 이유가 되지만 quality와 retry가 버텨야 한다. | success rate, retry count, p95 latency, repair time, accepted-result cost. |

| production default change | candidate와 incumbent dual-run | 공개 비교는 당신의 prompts, files, tools, permissions, failure cost를 측정하지 못한다. | regressions, human minutes, cost, rollback success, user-visible failures. |

GPT-5.5는 OpenAI-native integration이 가치일 때 먼저 테스트합니다. Responses API state, hosted tools, structured outputs, prompt caching, file search, computer use, Codex workflow를 이미 쓰고 있다면, 실제 production 운영면에서 GPT-5.5를 관찰할 수 있습니다. 그 안에서 tool failure, format drift, retry, latency, cost가 함께 드러납니다.

Claude Opus 4.7은 premium control lane입니다. high-risk agents, complex code migration, permission-sensitive tools, regulated review, cloud deployment에서는 싼 후보나 빠른 후보가 정말 안전한지 비교할 기준이 필요합니다. 표시 가격이 높아도 심각한 버그와 긴 review loop를 줄이면 총비용은 낮아질 수 있습니다.

Grok 4.3은 좁게 써야 합니다. xAI access, realtime/X freshness, lower listed price, long-context pressure가 핵심이면 먼저 테스트합니다. search tools도 xAI-specific access도 cost pressure도 없다면 Grok는 비교 대상이지만 production default를 자동으로 가져가면 안 됩니다.

비용은 같은 과금 표면에서 비교해야 한다

raw token row는 첫 필터일 뿐입니다. GPT-5.5는 OpenAI API pricing, account controls, Codex credits 중 어떤 표면인지가 다릅니다. Claude Opus 4.7은 Anthropic direct와 cloud provider billing이 다를 수 있습니다. Grok 4.3은 model tokens, Web Search, X Search, aliases, long-context thresholds, account visibility가 함께 작동할 수 있습니다. 이를 섞으면 잘못된 승자가 나옵니다.

GPT-5.5로 API 서비스를 만든다면 현재 OpenAI API 또는 console row를 봐야 합니다. Codex를 평가할 때만 Codex credits를 봅니다. Codex credit rate를 backend API token price로 쓰면 안 됩니다. Claude Opus 4.7에서는 tokenizer caveat가 중요합니다. 긴 prompt, tool logs, repeated repo context는 같은 텍스트라도 counted tokens를 바꿀 수 있습니다. Grok 4.3에서는 낮은 표시 가격을 "테스트할 이유"로만 취급해야 합니다.

| 비용 변수 | 순위가 바뀌는 이유 |

|---|---|

| input과 cached input | 긴 prompt, 반복 repo context, prompt caching이 청구를 바꾼다. |

| output length | output-heavy agent에서는 싼 input row가 덜 중요해진다. |

| tool calls | search, files, browser, computer use, custom tools가 주비용이 될 수 있다. |

| retry rate | 싼 모델도 여러 번 실패하면 진다. |

| human review minutes | coding agent에서는 사람이 accept, repair, rollback하는 시간이 비싸다. |

| rollback cost | 드물지만 심각한 실패는 평균 token cost보다 위험하다. |

비교해야 할 값은 successful-task cost입니다. accepted answer 하나, merged diff 하나, correct agent action 하나, completed analysis packet 하나에 얼마가 드는지 봅니다. Grok가 이 ledger에서 이기면 확대합니다. Opus가 심각한 실패를 줄이면 premium이 정당화됩니다. GPT-5.5가 OpenAI-native integration friction을 줄이면 운영상 더 싼 경로가 될 수 있습니다.

벤치마크는 테스트 힌트이지 배포 결론이 아니다

벤치마크와 영상은 유용하지만 default를 결정하지 않습니다. coding-agent tests, browsing tasks, long-context recall, math, safety, visual reasoning, cost-per-score tables는 서로 다른 일입니다. OpenAI-native agent benchmark에서 GPT-5.5가 강하면 GPT-5.5를 당신의 OpenAI harness에 넣을 이유가 됩니다. 그것이 Opus control을 제거하거나 Grok cost pilot을 생략할 이유는 아닙니다.

반대도 같습니다. Anthropic launch claim은 Opus를 control lane에 남길 이유이지 same-task measurement를 건너뛸 이유가 아닙니다. Grok price나 speed claim은 measured cost pilot을 만들 이유이지 high-risk coding default를 바꿀 이유가 아닙니다.

네 단계 evidence ladder를 쓰면 됩니다. 공식 docs는 route가 존재하는지, model name이 무엇인지, access surface가 무엇인지, pricing/limit을 어디서 확인해야 하는지 정합니다. 공개 benchmarks는 어떤 workload를 테스트할지 제안합니다. 당신의 same-task harness가 traffic 이동 여부를 정합니다. staged rollout이 실제 users, quotas, latency, permissions, failures를 견디는지 증명합니다.

이 ladder는 하나의 task shape만 측정한 증거로 절대 승자를 선언하는 오류를 막습니다. 결론은 의도적으로 좁습니다. GPT-5.5는 OpenAI-native first test입니다. Claude Opus 4.7은 premium Anthropic/cloud control입니다. Grok 4.3은 xAI realtime, lower listed price, long-context pilot의 경로입니다.

기본 모델을 바꾸기 전에 동일 작업 pilot을 돌리기

pilot은 작아도 되지만 공정해야 합니다. 한 모델에만 더 좋은 prompt, 더 넓은 context, 더 느슨한 output format, 더 쉬운 tool budget을 주고 비교라고 부르면 안 됩니다.

| pilot gate | 고정할 것 | 통과 조건 |

|---|---|---|

| route access | model label, endpoint, account, region, quota, billing surface, fallback | 배포할 경로를 실제로 호출할 수 있다. |

| prompt and files | 같은 system prompt, user task, repo/document pack | 차이가 더 나은 입력이 아니라 model behavior에서 나온다. |

| tool budget | 같은 tools, permissions, timeout, retry rule, search availability | tool-heavy success가 비교 가능하다. |

| task sample | easy, hard, long-context, strict-format, failure-prone tasks | 돈과 review를 쓰는 실제 작업과 맞다. |

| scoring | correctness, severity, security risk, format, review minutes, accepted rate | demo quality가 아니라 total work를 줄인다. |

| cost and latency | input, cached input, output, tools, retries, p95, completed-task cost | full-task accounting에서도 savings가 남는다. |

| rollback | failure threshold, fallback model, routing switch, monitoring owner | 이전 경로로 돌아갈 수 있다. |

이미 안정된 default가 있다면 incumbent를 유지하고 candidate를 shadow-run합니다. candidate가 total work를 줄이고 새로운 high-severity failure를 만들지 않으며 monitoring과 rollback을 통과할 때만 traffic을 늘립니다. 첫 모델을 고르는 팀은 stack route에서 시작합니다. OpenAI-native product는 GPT-5.5, Anthropic/cloud-heavy team은 Opus, realtime/X freshness나 가격 압력이 진짜 이유라면 Grok입니다.

인접한 결정

이 삼자 비교의 범위는 좁습니다. Grok 4.3, Claude Opus 4.7, GPT-5.5 중 어떤 경로를 먼저 동일 작업 테스트에 넣을지입니다.

OpenAI와 Anthropic만 비교하면 GPT-5.5 vs Claude Opus 4.7을 보세요. xAI realtime이 아니라 DeepSeek cost lane이 필요하면 DeepSeek V4 Pro vs Claude Opus 4.7 vs GPT-5.5를 보세요. 더 넓은 low-cost pool이 필요하면 Kimi K2.6 vs DeepSeek V4 vs GPT-5.5 vs Claude Opus 4.7을 사용합니다.

이전 official frontier API route를 비교하는 중이라면 Claude Opus 4.7 vs GPT-5.4 vs Gemini 3.1 Pro을 보세요. 원칙은 같습니다. 호출할 수 있는 route를 고르고, 실제로 실행할 task를 측정하고, rollback path를 남깁니다.

자주 묻는 질문

GPT-5.5가 Claude Opus 4.7과 Grok 4.3보다 더 좋은가요?

OpenAI-native system, 특히 Responses API, Codex, tool-heavy reasoning, structured outputs, OpenAI eval을 쓰는 경우 GPT-5.5가 더 좋은 첫 테스트입니다. 그러나 모든 작업의 절대 승자는 아닙니다. Claude Opus 4.7은 premium control이고, Grok 4.3은 realtime/X search, lower listed price, long-context pilot이 비교 이유일 때 먼저 테스트할 가치가 있습니다.

Grok 4.3이 GPT-5.5와 Claude Opus 4.7보다 싼가요?

Grok 4.3은 xAI listed token row에서 싸게 보일 수 있습니다. 하지만 console visibility, long-context threshold, search-tool charges, retry, latency, accepted-result rate를 모두 확인해야 합니다. 모델 token만이 아니라 completed-task cost를 비교해야 합니다.

coding agent에는 Claude Opus 4.7을 써야 하나요?

실패 비용이 크고 Anthropic 또는 cloud route가 deployment에 맞으며 correctness가 raw token price보다 중요하다면 Opus를 premium control로 둡니다. OpenAI-native agent라면 GPT-5.5를 먼저 테스트하고, realtime/X data, xAI access, lower listed price가 중요하면 Grok를 추가합니다.

GPT-5.5는 API로 사용할 수 있나요?

OpenAI developer docs는 GPT-5.5 API guidance와 developer surface의 GPT-5.5 snapshots를 제공합니다. 하지만 API access, Codex access, API-key authentication, credits, rate limits, organization visibility는 별도 계약입니다. production traffic 전에 account와 deployment route에서 확인하세요.

Grok 4.3은 기본적으로 realtime data를 갖고 있나요?

아닙니다. xAI docs는 realtime events에 Web Search나 X Search 같은 server-side search tools가 필요하다고 설명합니다. freshness가 Grok 선택 이유라면 해당 tool calls를 cost, scoring, failure review에 포함해야 합니다.

long-context work는 무엇을 먼저 테스트해야 하나요?

실제로 배포할 수 있는 route를 먼저 테스트합니다. 세 모델 모두 large-context story가 있지만 limits, billing, threshold, output behavior, recall quality가 다릅니다. 같은 long prompt, retrieval pack, output budget, scoring rubric을 사용하세요.

가장 안전한 production switch rule은 무엇인가요?

benchmark, launch claim, listed price gap만으로 바꾸지 않는 것입니다. candidate와 incumbent를 같은 prompts, tools, files, budgets, acceptance tests, rollback threshold로 dual-run합니다. staged rollout에서 total work가 줄어든 뒤에만 promote합니다.