2026年4月9日時点で、誰にとっても同じ条件で使える一つの Seedance 2.0 free online サイトは存在しません。いま本当に必要なのは、「どこが公式なのか」「free は長期無料なのか、それとも限定的な入り口なのか」「公式ルートが使えないときにどの fallback を許容するのか」を先に整理することです。

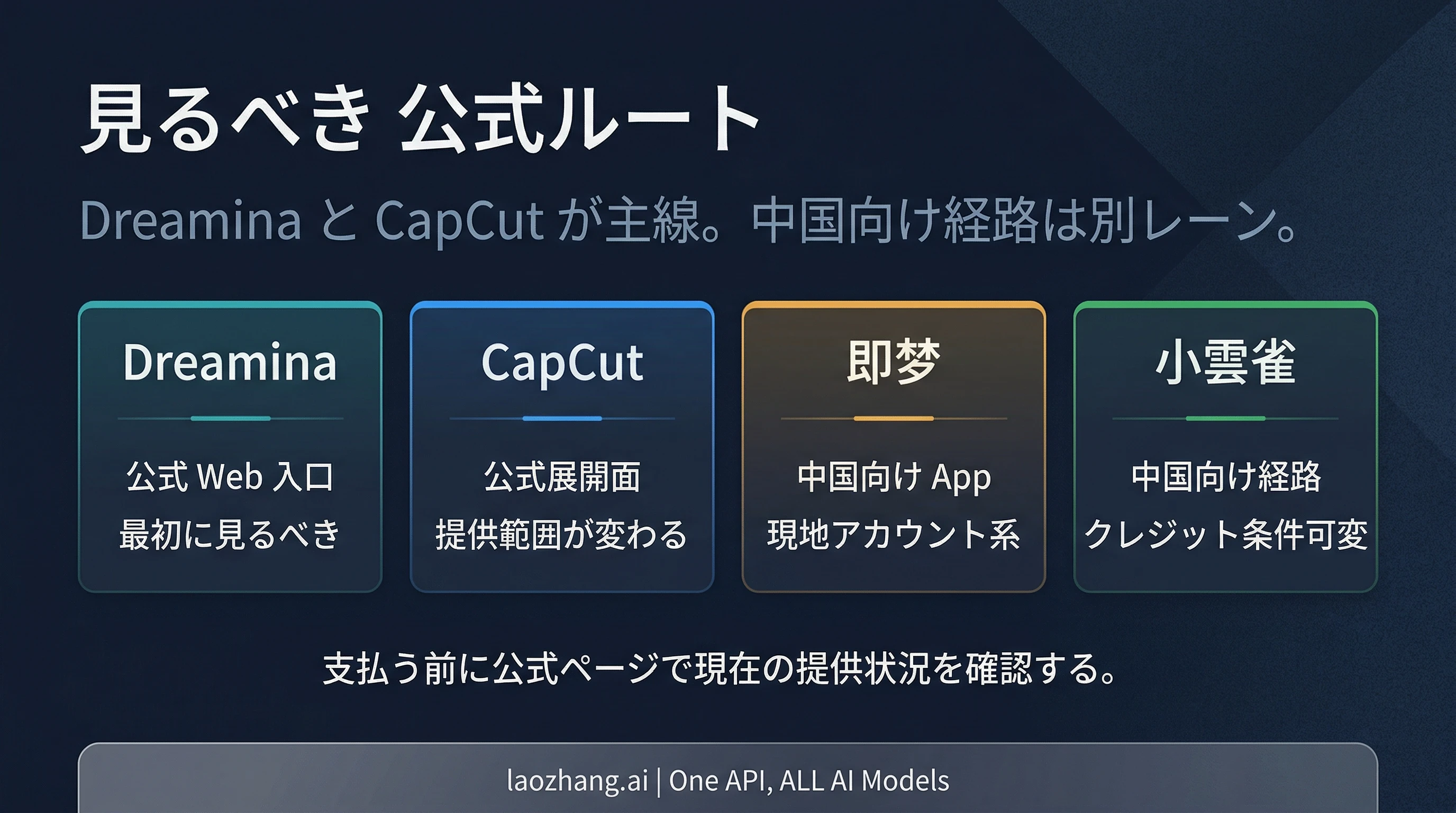

最初の一手だけを決めるなら、順番はこうです。まず Dreamina の公式ページを見る。次に、自分の地域やアカウントで CapCut のルートが実際に開いているか確認する。中国向けアプリを使える人はそれを別レーンとして判断する。そして、公式ルートが不便だからという理由で third-party ページを使う場合でも、それを公式アクセスと同じものだと見なさないことです。

最初に開くべきルートはどれか

online free と書かれたページを全部同じ契約として扱わないほうが、最初の判断は早くて安全です。

| 今ほしいもの | 最初に開くルート | それが安全な理由 | 注意点 |

|---|---|---|---|

| いちばん分かりやすい公式Web入口 | Dreamina 公式ページ | 正規ルートかどうかを最も早く確認しやすい | 実際の利用可否はアカウント状態や surface に依存する |

| すでに CapCut を使っている | CapCut 内の Seedance 2.0 ルート | 公式 CapCut ルートであり wrapper ではない | rollout は市場や surface ごとで、全員一律ではない |

| 中国向けアプリを現実的に使える | Jimeng または Xiaoyunque | これは ByteDance 系の実在する first-party ルート | 言語、アカウント、地域条件の摩擦がある |

| 公式ルートが今は使えず、とりあえず試したい | third-party ルートを fallback としてだけ使う | とりあえずモデルを触る手段にはなる | 公式アクセスと同じ信頼境界ではない |

この route board が、このページの中心的な答えです。以降の説明は、どれが公式か、free をどう解釈すべきか、そして偽サイトをどう避けるかを補強するためだけにあります。

いま本当に公式と言える入口

いまの Seedance 2.0 の公式アクセスは、一つの独立した Seedance 専用サイトに集約されているわけではありません。実際にユーザーが触る consumer-facing なオンライン入口は Dreamina と CapCut に分かれています。

Dreamina はいまも最も分かりやすい公式Webルート

ブラウザから始めて、まず legitimacy を確認したいなら、Dreamina が最も分かりやすい公式ルートです。公式ページ自体が Seedance 2.0 の official website / official access surface として書かれているため、最初の trust check をここで済ませやすいからです。

ただし、ここをそのまま「誰でも安定して永久無料で使える」と読むのは危険です。Dreamina はあくまで公式のWebルートであって、具体的な利用条件はアカウントやページ状態に左右される、と理解するほうが安全です。

CapCut も公式だが、Dreamina と同じ契約ではない

CapCut の公式ツールページや newsroom は、Seedance 2.0 を real online tool として案内しています。ただし、その rollout wording は一貫して、地域、surface、時期によってアクセスが違うことを示しています。これは「どこでも同じように開いている」という話ではありません。

だから正しい理解は、「Dreamina と CapCut はどちらも公式だが、同じアクセス契約ではない」です。CapCut をすでに使っている人には統合ルートが便利ですが、最初に official access の信頼境界だけを確認したいなら、Dreamina のほうが第一クリックとしては明快です。

中国向けアプリは別レーンとして扱う

日本語の検索結果でも、Dreamina、CapCut、Jimeng、Xiaoyunque、そして各种 wrapper を一つの 使い方まとめ に入れてしまうページが少なくありません。しかし、それは reader job に対して雑すぎます。

Jimeng と Xiaoyunque は中国向けの first-party ルートです。中国語、登録条件、地域的な前提が許容できるなら現実的な選択肢ですが、Dreamina や CapCut と同じ international web access の枝として扱うべきではありません。

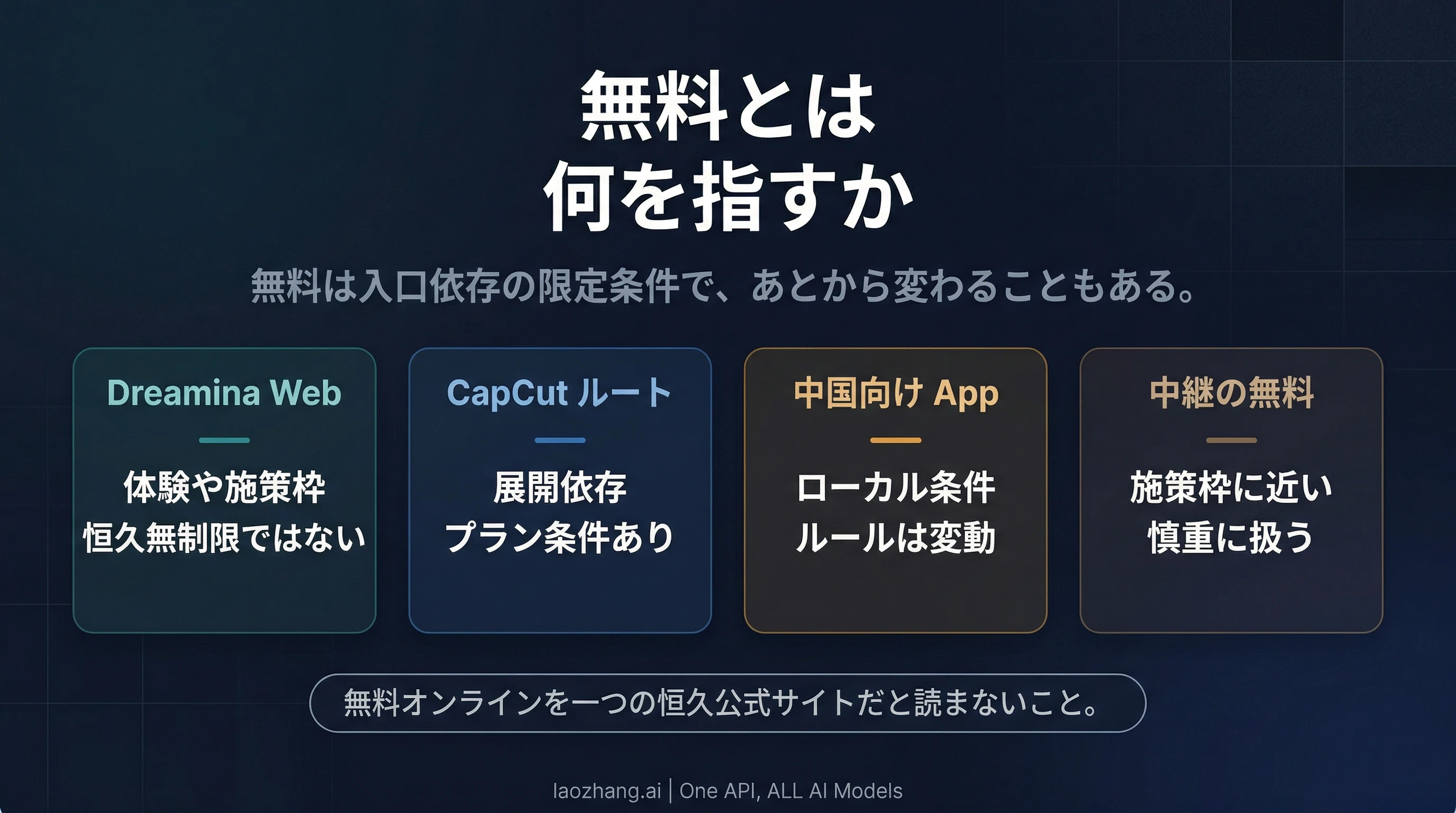

free をどう読むべきか

このテーマでいちばん危ない語は free です。公式ページに try for free が出てくること自体は事実ですが、それは universal な long-term free contract を意味しません。

free は少なくとも次の四つに分けて読むと誤解しにくくなります。

- 公式Web surface 上の限定的な試用入口

- rollout 条件の一部としての段階的なアクセス

- 中国向けアプリでのローカルな無料または低価格の入り口

- wrapper サイトが広告文句として使う

free online

つまり問うべきなのは、無料かどうか ではなく、このルートが十分に低摩擦で、Seedance 2.0 が自分に合うかを検証できるか です。

このページが古い credit 数や package 数字を繰り返さないのも同じ理由です。現時点の公式ページは、Dreamina、CapCut、その他のルートを一枚にまとめた安定した universal pricing table を示していません。価格や無料枠の価値判断が主題なら、英語の pricing guide を見るほうが適切です。

公式ルートが使えないときの考え方

多くの読者に必要なのは、ベストワンを決めることではなく、「公式ページを開いたが自分には今は使えない。その次にどう考えるか」です。

できるだけ公式ルートの近くに残りたいなら

最初にやるべきは、Dreamina と CapCut の間で別 surface を再確認することです。すぐに third-party ページへ飛ぶのではなく、いま自分に開いている official route はどれか をもう一度見直したほうが安全です。

中国向け first-party ルートが現実的なら

それは独立した route として評価してください。国際向けWebの隠しルートだと考えないことが大切です。言語や地域の摩擦を受け入れられるなら選択肢になりますが、受け入れられないなら 紙の上では安い という理由だけで本命にするべきではありません。

それでも third-party ページを使いたいなら

ここで必要なのは convenience ではなく trust calibration です。third-party のルートはテスト用の入り口にはなりえても、Dreamina や CapCut と同じ legitimacy を自動では引き継ぎません。少なくとも次を確認する必要があります。

- 誰が運営しているか

- 課金条件が明確か

- 長期的な安定性が見えるか

- fallback を公式ルートのように見せていないか

一番簡単な rule はこうです。公式ルートが今は不便だから third-party を使うのであれば、それは fallback であって official route ではありません。

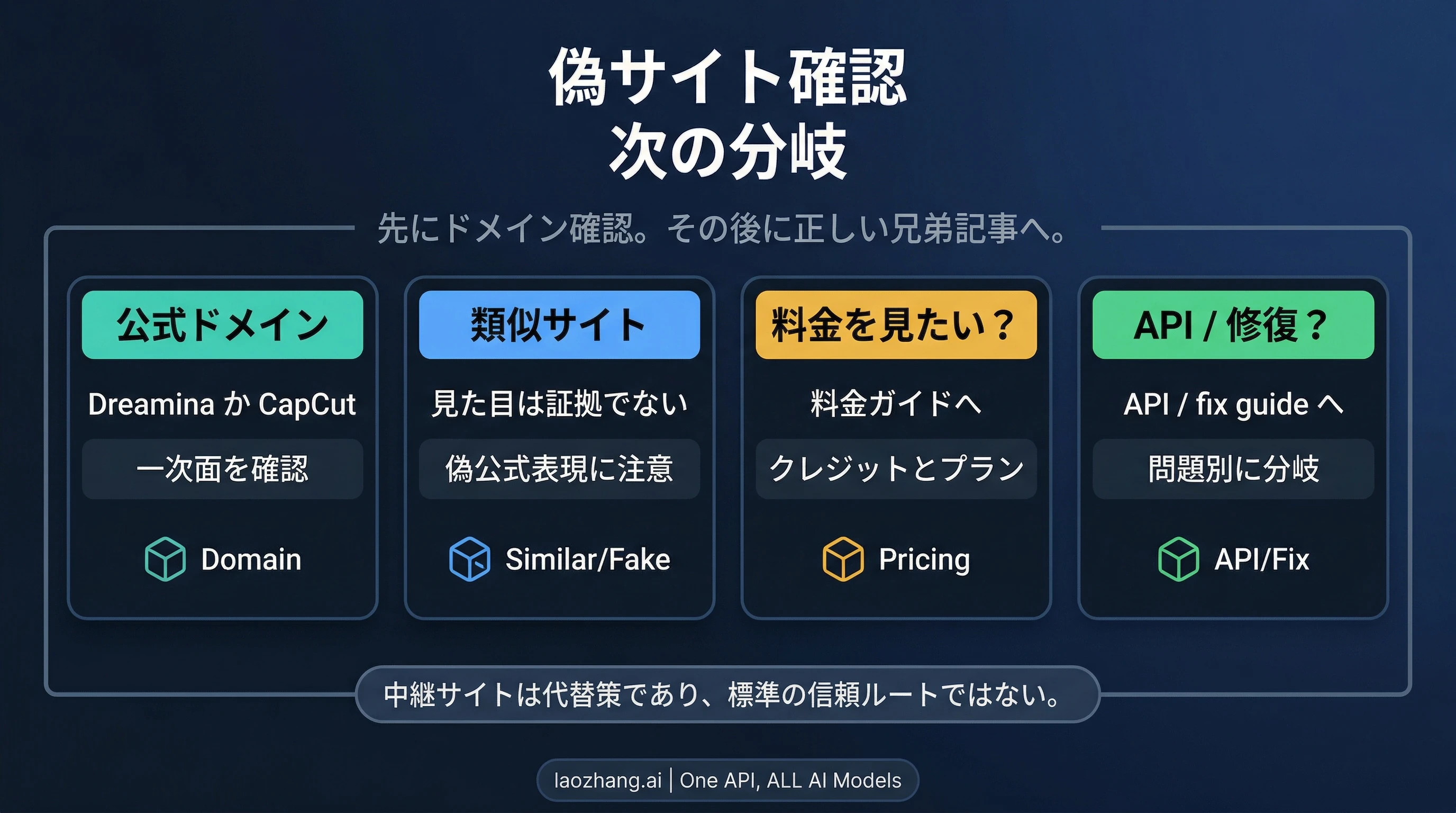

クリック前に必ずドメインを確認する

Dreamina の公式ページは、seedance2.ai、seedance2.app、seedance.tv が公式 ByteDance サイトではないと明示しています。現在の検索結果の状態では、これは FAQ の片隅ではなく、 main answer の一部です。

登録や支払いの前に一つだけ確認するなら、ドメイン確認を優先してください。

- まだ Dreamina、CapCut、または ByteDance-owned surface 上にいるか確認する。

Seedanceという名前だけで official だと判断しない。free onlineを強く約束するのに、運営主体を曖昧にしているページには特に慎重になる。

third-party のすべてが即座に危険だと言いたいわけではありません。ただ、公式ルートは legitimacy から始まり、その後に 自分に開いているか を問います。third-party ルートは convenience から始まり、 legitimacy をあとから別に証明しなければなりません。この順序を入れ替えないことが重要です。

次に読むべきページ

このページの仕事は route choice までです。ここから先を pricing、API、troubleshooting、comparison まで一ページで抱えるべきではありません。

質問が次の段階に移ったら、以下のページへ分岐してください。

- コスト、無料枠、長期利用の判断なら英語の pricing guide

- programmatic access の状態なら英語の API guide

- 公式ルートなのに surface が開かない、壊れている、挙動が不安定なら英語の troubleshooting guide

- access 問題が解けて、次に model family を比較したいなら英語の comparison guide

この切り分けを守ることで、このページは オンラインアクセスの判断 に集中したままでいられます。

よくある質問

Seedance 2.0 に公式サイトはありますか?

あります。ただし、検索結果が示すような 一つのドメインがすべてを解決する 形ではありません。モデル自体は公式ですが、一般ユーザーの practical なオンライン入口は Dreamina と CapCut に分かれています。

Seedance 2.0 は無料で使えますか?

限定的または surface-specific な無料入口を使える可能性はありますが、それを universal な long-term free contract と読まないほうが安全です。try for free は、まずは bounded entry path と理解するのが妥当です。

seedance.tv は公式ですか?

いいえ。Dreamina の公式ページは seedance.tv、seedance2.ai、seedance2.app が公式 ByteDance サイトではないと明記しています。

Dreamina や CapCut が使えないときはどうすればいいですか?

公式 surface の別ルートを待つか、中国向け first-party ルートが現実的かを判断するか、あるいは higher-trust-cost の third-party fallback を使うかを選びます。重要なのは、どの摩擦を受け入れるかを決めることです。

価格、API、比較はどこで見ればいいですか?

価格は英語の pricing guide、API は英語の API guide、不具合は英語の troubleshooting guide、比較は英語の comparison guide を使うのが最短です。