Nano Banana Pro API 并没有什么隐藏优惠档。官方模型还是 gemini-3-pro-image-preview,Google 当前给出的实时价格底线很清楚:1K/2K 每张 \$0.134,4K 每张 \$0.24。如果你能接受异步处理,Google 自家的 Batch/Flex 可以把价格降到 \$0.067 和 \$0.12。而你在搜索结果里经常看到的 \$0.05/张 之类更低实时价格,通常属于第三方转发服务合同,不是 Google 官方隐藏价。

所以这里真正要回答的,不只是 AI Studio 还是 Vertex AI。更关键的是:你到底在买哪一种合同。是 Google 官方实时、Google 官方 Batch、第三方转发服务,还是其实根本不该为 Pro 付费,而应该换更便宜的图像模型。AI Studio 和 Vertex 当然还重要,但它们主要影响的是认证、治理和工作流形态,并不是谁偷偷把标准实时价格打了折。

下文中所有 model ID、Preview 状态、价格与计费边界,都已按 2026 年 4 月 2 日 的 Google 官方文档重新核实。涉及更低实时价格的描述,只按同日搜索市场观察处理,不当作 Google 官方合同事实。

TL;DR

| 你的真实任务 | 最省钱且合理的路线 | 当前价格信号 | 为什么 | 最大注意点 |

|---|---|---|---|---|

| 你要最便宜的 Google 官方 路线,而且能等 | Vertex AI Batch / Flex | 1K/2K \$0.067,4K \$0.12 | 这才是 Google 官方的 50% 折扣路径 | 它是异步流程,不适合交互式出图 |

| 你要最便宜的 官方实时 请求 | AI Studio 或 Vertex 标准实时 | 1K/2K \$0.134,4K \$0.24 | 同一个模型,同一条 Google 标准底价,只是运行表层不同 | Nano Banana Pro 依然 没有免费 API 层 |

| 你要最便宜的 同模型实时 接入,而且不要求 Google 官方合同 | 第三方转发服务 | 当前市场常见大约 \$0.05/张 | 成本更低、接入更轻,适合纯价格优先场景 | 这已经是另一份合同、另一层计费和支持边界 |

| 你对成本敏感,但不确定一定要用 Pro | 先换模型,再优化接入路线 | 很多时候省得更多 | 很多任务并不需要 Pro 的高阶文字渲染和 4K 定位 | “最便宜的 Nano Banana Pro” 仍然比“不用 Pro”贵 |

最实用的一句话是:如果你要最便宜的 Google 官方合同,就选 Batch;如果你要最便宜的同模型实时成本,就看转发服务;如果你要最快跑通官方首个请求,就选 AI Studio;如果 Pro 本身都不一定必要,就先换模型。

Nano Banana Pro API 最便宜,先分清你买的是哪种合同

Nano Banana Pro API 最便宜 这个问法,其实混在一起了 三种购买问题。第一种,是不是要最便宜的 Google 官方 路线;第二种,是不是要最便宜的 同模型实时 路线,不在乎是谁来做计费;第三种,是不是其实根本不该为 Nano Banana Pro 付费。

Google 自己的文档现在已经足够清楚。定价页明确写着:gemini-3-pro-image-preview 没有免费层,标准图像输出是 1K/2K 每张 \$0.134、4K 每张 \$0.24,而 Batch/Flex 会把它降到 \$0.067 和 \$0.12。所以,最便宜的第一方答案,并不是抽象的 “AI Studio” 或 “Vertex”,而是具体的 Batch/Flex。

搜索市场里的答案则是另一回事。现在搜 “最便宜的路线”,排在前面的很多页面都在打 \$0.05/张 左右的价位。这未必是假话,但它描述的是另一种商业形态。你比较的已经不再是两个 Google 官方入口,而是 Google 官方合同 和 第三方服务商合同。

对部分读者来说,更强的省钱答案甚至是第四种:先去看 Nano Banana Pro vs Nano Banana 2 对比。如果你的工作负载并不真的需要 Pro 的高阶文字渲染、复杂布局稳定性或 4K 定位,那真正该优化的不是路线,而是模型本身。

AI Studio 和 Vertex AI:这不是折扣题

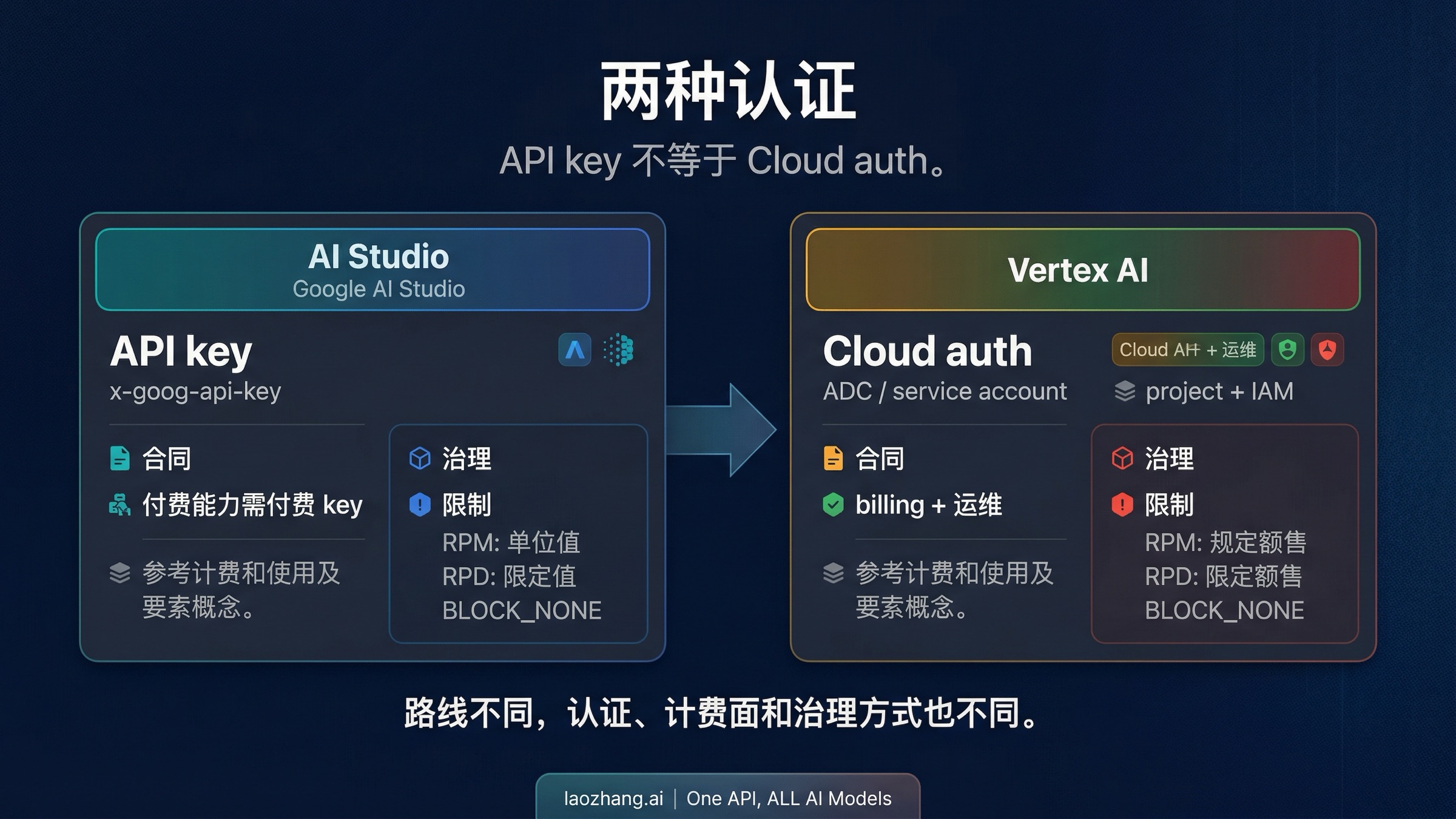

AI Studio 和 Vertex AI 当然仍然重要,但它们重要的原因,已经和首屏价格问题不一样了。两条路都能把你带到同一个模型,真正变化的是 认证方式、计费面、运维方式和规模能力。

AI Studio + Gemini Developer API 是最快的官方接入路径。你在 Google AI Studio 里创建 API key,必要时先在官方界面验证提示词,再用 Gemini Developer API 从代码里调用模型。只要你现在的目标是“尽快跑通、尽快验证”,这通常是更好的默认值。

Vertex AI 更适合当 Nano Banana Pro 进入一个真正的 Cloud 工作负载之后。只要需求开始涉及 IAM、项目级治理、Application Default Credentials、批处理、预留吞吐,或者更清晰的团队运维边界,Vertex AI 就不再只是“更复杂的选项”,而会变成正确的宿主。Google 现在的官方资料已经足够说明这一点,不应该再和价格问题混写。

记一个最简单的判断规则:

- 如果你现在最在意的是 开发速度,先用 AI Studio

- 如果你现在最在意的是 云上运维与治理,先用 Vertex AI

- 如果你现在最在意的是 Google 官方成本下降,就用 Vertex 上的 Batch/Flex

这最后一条才是新的关键修正:只有当 Batch/Flex 进场时,Vertex 才会真正变成价格选择题。 在那之前,AI Studio 和 Vertex 更多仍是运维选择题。

路线一:AI Studio + Gemini Developer API

对很多读者来说,这就是正确起点。Google AI Studio 是 Gemini Developer API 的官方 key 管理与试验入口。它不只是 playground,也不应该被理解成“只是给你看看效果的演示页”。它是 官方 API key 路线 的一部分。

但这里最大的误解也恰恰发生在这里:很多人因为 AI Studio 可以打开、可以试,就误以为 Nano Banana Pro 也有某种免费 API 层。Google 当前的官方定价页写得很清楚:gemini-3-pro-image-preview 的 Free Tier: Not available。 Google 的 billing FAQ 也说明了:AI Studio 本身仍然可以免费使用,但一旦你把 paid API key 用在 paid features 上,这个 key 的使用就会进入计费。

最安全的理解方式是:

- AI Studio 这个产品界面本身可以是免费的

- Nano Banana Pro 的 API 使用合同仍然是 付费

- “我能在 AI Studio 里看到它” 不等于 “我有免费 Pro API”

什么时候该选这条路

如果你的真实需求是下面这些,先选 AI Studio:

- 你只是想尽快拿到一个可运行请求

- API key 对当前场景已经够用

- 你还在反复试提示词和出图风格

- 你还没到非要引入 Cloud IAM、Batch、Provisioned Throughput 的阶段

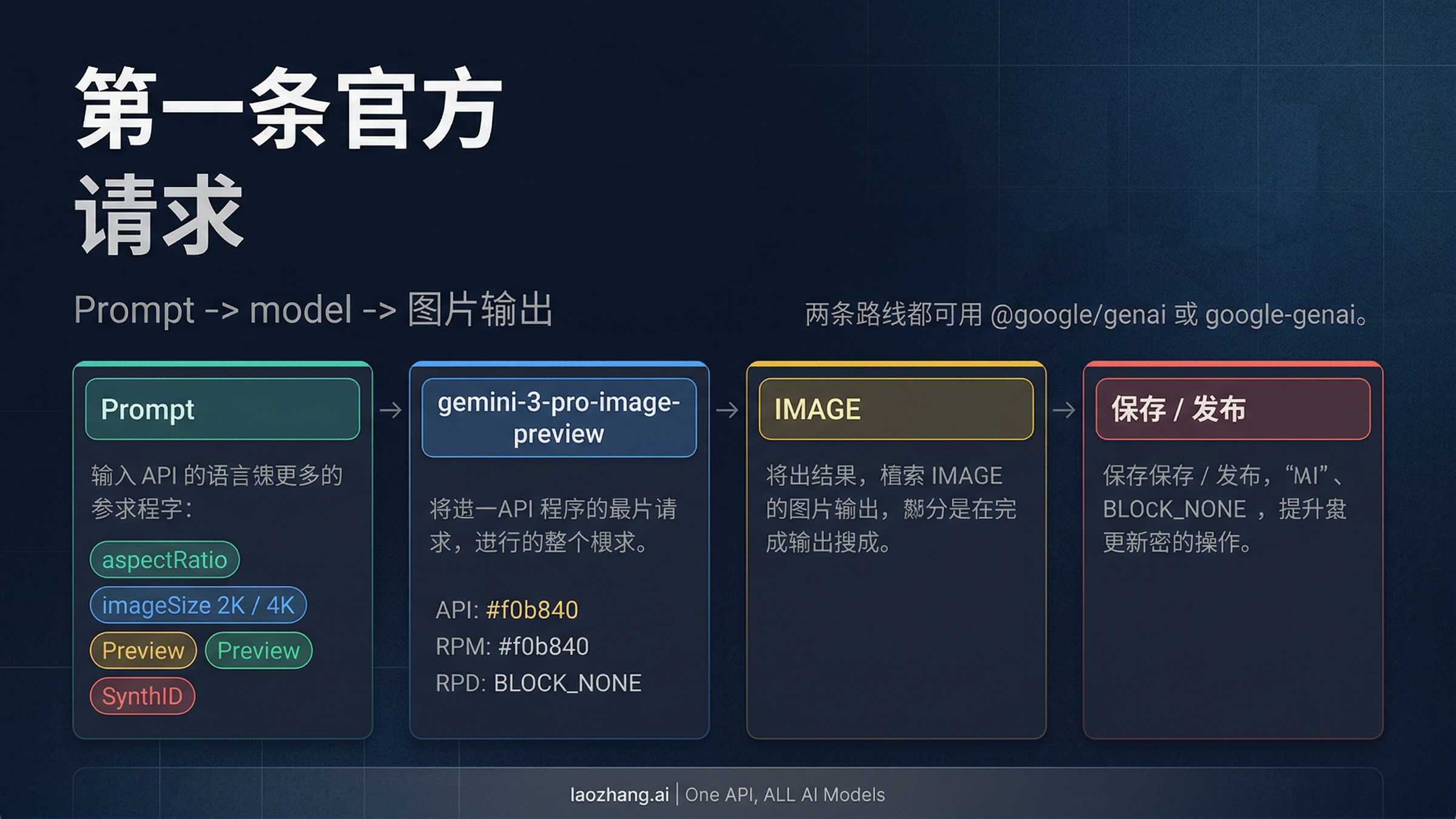

最小 JavaScript 示例

先安装官方 SDK:

bashnpm install @google/genai

然后用 API key 发请求:

javascriptimport { GoogleGenAI } from "@google/genai"; import fs from "node:fs"; const ai = new GoogleGenAI({ apiKey: process.env.GEMINI_API_KEY }); const response = await ai.models.generateContent({ model: "gemini-3-pro-image-preview", contents: "Create a clean product hero image for a mechanical keyboard on a dark studio background.", config: { responseModalities: ["IMAGE"], imageConfig: { aspectRatio: "16:9", imageSize: "2K", }, }, }); for (const part of response.candidates[0].content.parts) { if (part.inlineData) { fs.writeFileSync( "nano-banana-pro-output.png", Buffer.from(part.inlineData.data, "base64"), ); } }

这就是最短的官方接法:在 AI Studio 里创建 key,导出 GEMINI_API_KEY,然后调用 generateContent。Google 当前的 image generation 文档还提醒了一个很容易忽略的实现细节:1K、2K、4K 里的 K 必须大写。

如果你更习惯先从 REST 验证,这条路线同样支持使用 Gemini Developer API 的 HTTP 请求,认证方式仍然是 x-goog-api-key。变化的是传输层,不是合同本身。

路线二:Vertex AI,适合受控生产场景

一旦你的问题从“我怎么快速接入”变成“这套东西怎么在团队和 Cloud 里长期跑”,Vertex AI 往往才是更合理的起点。很多团队以为 Vertex AI 只是更重一点的同款 UI,其实不是。真正的变化在于 你已经进入 Google Cloud 的认证与运维模型。

在 Gemini Developer API 路线里,核心是 API key;在 Vertex AI 路线里,核心是 Cloud auth。Google 当前的图像生成文档展示的是通过 GOOGLE_CLOUD_PROJECT、GOOGLE_CLOUD_LOCATION 和 GOOGLE_GENAI_USE_VERTEXAI=True 来配置 GenAI SDK,这已经足够说明你现在站在 Google Cloud 的运行合同里,而不是单纯的 API key 合同里。

什么时候该选这条路

下面这些情况,更适合直接走 Vertex:

- 这个应用属于团队,而不是某个个人实验

- 你需要 IAM、审计、项目级治理

- 你明确需要 batch 或 provisioned throughput

- service account / ADC 比分发 API key 更符合你的安全边界

- 你关心的不只是“能不能调用”,而是“能不能被团队长期运营”

最小 Node.js 示例

安装同一套 SDK:

bashnpm install @google/genai

按 Google 当前 Vertex 文档设置环境变量:

bashexport GOOGLE_CLOUD_PROJECT=your-project-id export GOOGLE_CLOUD_LOCATION=global export GOOGLE_GENAI_USE_VERTEXAI=True

然后通过 Vertex 调用同一个模型:

javascriptimport fs from "node:fs"; import { GoogleGenAI, Modality } from "@google/genai"; const client = new GoogleGenAI({ vertexai: true, project: process.env.GOOGLE_CLOUD_PROJECT, location: process.env.GOOGLE_CLOUD_LOCATION || "global", }); const response = await client.models.generateContent({ model: "gemini-3-pro-image-preview", contents: "Create a premium launch poster for a smart watch, crisp typography, dark editorial lighting.", config: { responseModalities: [Modality.IMAGE], }, }); for (const part of response.candidates[0].content.parts) { if (part.inlineData) { fs.writeFileSync( "vertex-nano-banana-pro-output.png", Buffer.from(part.inlineData.data, "base64"), ); } }

注意这里最关键的事实:模型字符串没有变,变的是客户端初始化与认证方式。 这正是这篇文章最核心的知识增量。

官方折扣是 Batch,不是 AI Studio 的隐藏方案

这一段正是很多排名页还没讲清的地方。现在 Google 自己的定价已经足够直白:官方折扣就是 Batch/Flex。如果你的流程可以接受异步完成,那么 Google 账单会从 1K/2K 0.134 美元降到 0.067 美元,从 4K 0.24 美元降到 0.12 美元。

这并不意味着每个官方用户都应该一上来就走 Vertex。更准确的决策顺序是:先问自己,是不是要最便宜的 Google 官方合同。如果答案是,那就用 Batch。不是的话,再回到 “哪种官方运行表层更适合我的工作负载”,这时 AI Studio 和 Vertex 才重新变成路线选择。

这里有三个最容易浪费钱的坑。

- 不要把能打开 AI Studio 理解成能免费用 Pro API。 Google 仍然把

gemini-3-pro-image-preview标成Free Tier: Not available。 - 不要把多开 API key 理解成新的价格层。 Google 当前明确写的是:配额和速率限制按 project 计算,不是按 API key 计算。

- 不要在确认需要 Pro 之前,就开始卷接入路线。 如果任务并不真的需要 Pro 的高阶能力,更大的省钱动作仍然是换模型。

如果你确定自己需要 Google 官方合同,并且想继续深入看 50% 折扣怎么落地,可以继续读我们的 Gemini 3 Pro Image Batch API 折扣指南。如果你想把所有接入形态一次性看全,可以再读 Nano Banana Pro 价格总览。

能不能先在 AI Studio 开始,之后再迁到 Vertex?

可以,而且对很多团队来说,这恰恰是最理性的顺序。先在 AI Studio 路线里把提示词、风格和首个请求打通;等到系统真正开始要求 Cloud 原生控制,再迁到 Vertex AI。

迁移之所以没有想象中那么重,是因为 模型身份没有变。你不是从一个产品迁到另一个产品,你只是把同一个模型放进了另一套运行合同:

- 从 API key auth 切到 Cloud auth

- 从 AI Studio 的 key / project 管理切到 Cloud 的 project / IAM 运维

- 从“先跑通”切到“要长期可控地运行”

这也是为什么一开始就把所有实验都丢进 Vertex AI 通常是过度设计,而把 AI Studio 永远当成最终宿主也经常不够。先用最快的官方路线把东西跑起来,等 Cloud 控制变成主要诉求时再迁到 Vertex;如果第一方降本变成主要目标,再切到 Batch。你如果还缺 API key 的具体步骤,可以继续看 Nano Banana Pro API Key 获取指南。

30 秒做决定

如果你还是想要一个极简判断规则,可以直接用下面这一版。

如果你的真实问题是:

- “最便宜的 Google 官方路线是什么?”

- “这个流程能不能异步完成?”

- “我是不是还需要第一方计费与治理?”

那就先从 Vertex AI Batch / Flex 开始。

如果你的真实问题是:

- “最便宜的同模型实时路线是什么?”

- “我是不是更在意账单,而不是 Google 自己的合同?”

- “我能不能接受第三方服务商的支持和合规边界?”

那就先从 第三方转发服务 开始。

如果你的真实问题是:

- “我怎么最快把第一个官方请求跑通?”

- “我怎么先在官方环境里把提示词试明白?”

- “我还没准备好引入 Cloud 运维,能不能先从官方路线接起来?”

那就先用 AI Studio + Gemini Developer API。

如果你的真实问题是:

- “它怎么进入我们的 Google Cloud 体系?”

- “我怎么给团队提供受控访问,而不是分发 API key?”

- “我怎么规划 batch 或 provisioned throughput?”

那就从 Vertex AI 开始。

如果你现在真正还没想明白的不是路线,而是 Pro 这个模型值不值得用,那就不要先纠结入口。先看 Nano Banana Pro vs Nano Banana 2 对比;很多情况下,更大的成本收益点其实在模型选择,而不是入口选择。