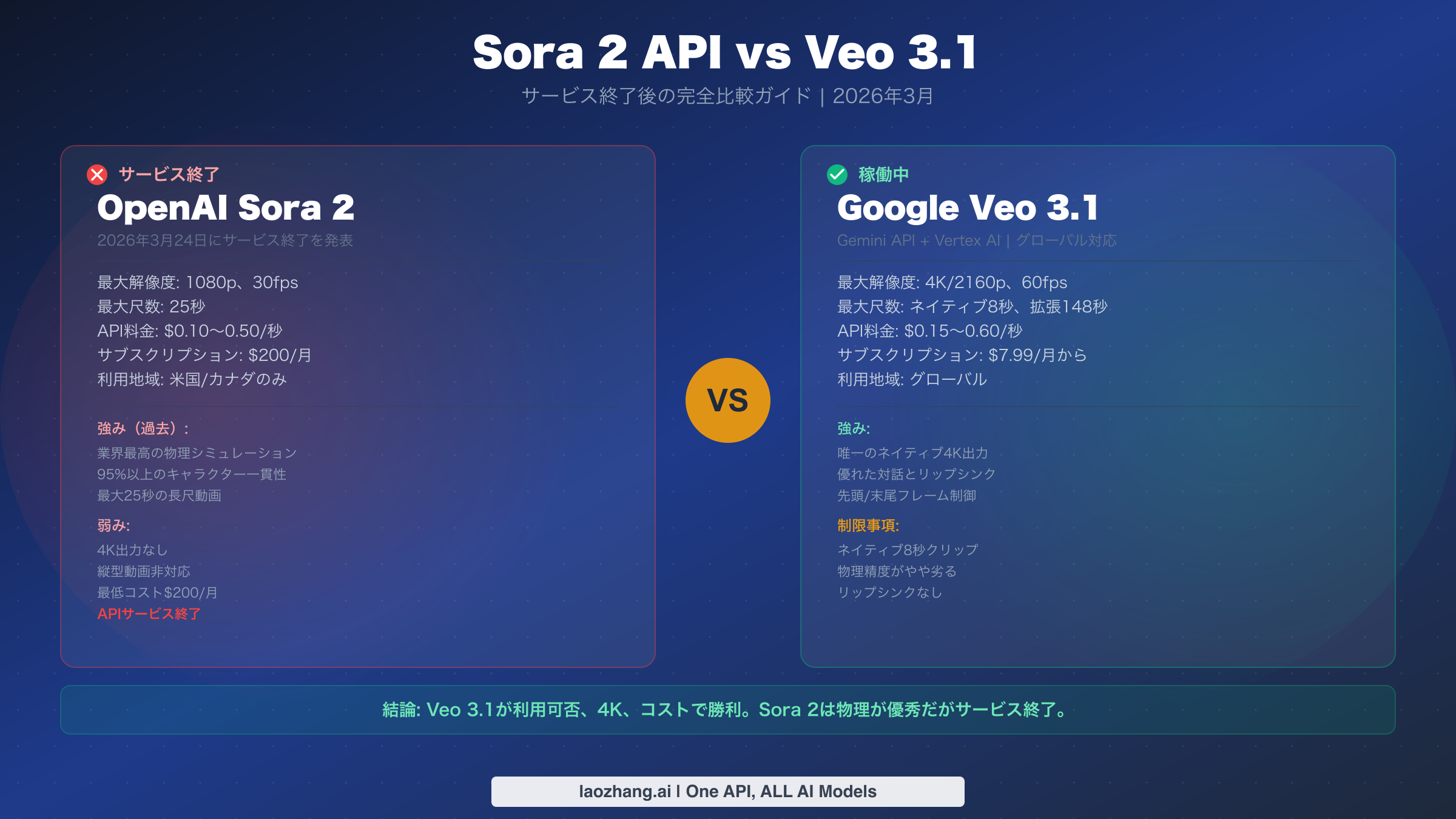

2026年3月24日以前に公開されたSora 2とVeo 3.1の比較記事は、すべて根本的に古くなっています。この日、OpenAIはSoraアプリケーション、API、およびSora.comプラットフォームの完全なサービス終了を発表しました。これにより、比較の性質は「どちらを選ぶべきか」から「移行先で何が得られるのか」へと変わりました。Veo 3.1は11項目中7項目で優位に立ち、サブスクリプションレベルでは最大96%のコスト削減が可能で、コード変更わずか2行で30分以内に移行できます。

まとめ

2026年3月時点で、この2つの動画生成APIのどちらを選ぶべきか迷っている開発者の方へ、結論をお伝えします。

- Sora 2 APIはサービス終了 — 2026年3月24日に確定。モデル自体はChatGPT内に残りますが、スタンドアロンAPIは廃止されます。Sora 2サービス終了の詳細分析もご参照ください

- Veo 3.1が11項目中7項目で勝利:解像度(4K vs 1080p)、音声品質、縦型動画、グローバルアクセス、サブスクリプション費用、API利用可否、レート制限

- Sora 2が優位な3項目:物理シミュレーション、キャラクター一貫性、単一クリップの長さ(25秒 vs ネイティブ8秒)

- コスト差は圧倒的:Veo 3.1は月額$7.99から、Sora 2は最低月額$200 — 96%の削減

- 移行は極めて簡単:laozhang.ai経由で

base_urlとmodelパラメータを変更するだけ。残りのコードはそのまま使えます

Sora 2 APIのサービス終了 — 比較に与える影響

この記事が存在する理由は、AI動画生成分野における劇的な変化にあります。2026年3月24日、OpenAIはX上で「Soraに別れを告げます」と投稿しました。Bloomberg、NBC News、TechCrunch、Varietyのすべてが、iOSアプリ、Sora.com、およびSora 2 APIの廃止を確認しています。正確なサービス終了日はまだ発表されていませんが、OpenAIはタイムラインの詳細を近日中に共有すると述べています。

サービス終了の背景には、Soraのビジネスモデルが抱える根本的な課題があります。WentuoAIの分析によると、Soraの収益は約210万ドルである一方、GPUコストは年間数億ドルを超えていました。OpenAIは約7,300億ドルの評価額でIPOを準備しており(NBC News、2026年3月24日)、このペースで資本を消費し続ける製品を維持することは不可能になりました。同社はそのコンピューティングリソースを、AnthropicやGoogleに対してより強い競争優位性を持つコーディング、推論、テキスト生成の分野に振り向けています。

実際にはどういう意味があるのでしょうか。Sora 2モデル自体はPlusおよびProサブスクライバー向けにChatGPT内で存続するため、チャットインターフェースを通じてSora品質の動画を生成することは引き続き可能です。しかし、開発者がアプリケーションに統合していたプログラマティックアクセスであるAPIは完全に廃止されます。もしあなたのプロダクトがSora 2 APIの呼び出しに依存しているなら、移行が必要です。以下の比較では、Veo 3.1への移行で何が得られ、何を失うのか、そしてその移行をできるだけスムーズに行う方法を詳しく解説します。

Sora 2 vs Veo 3.1 — 全機能比較

この2つのモデルの比較は、一方がすべての面で優れているという単純なものではありません。それぞれに明確な技術的強みがあり、正しい移行判断を行うためには具体的なトレードオフを理解することが不可欠です。以下は、2026年3月のSERP検証データに基づく項目別の詳細分析です。

解像度とフレームレートは、Veo 3.1の最も劇的な優位性を示しています。Sora 2が最大1080p、24〜30fpsであるのに対し、Veo 3.1はアップスケーリング不要でネイティブ4K(2160p)、60fpsの出力を実現します。映像の品質が重要なアプリケーション — プロの映像制作、商用コンテンツ、大画面表示 — において、これは決定的な差別化要因です。Veo 3.1は2026年3月時点で、真のネイティブ4K出力を提供する唯一のAI動画生成APIであり、他の競合が追随できていない機能です。

動画の長さについては、Sora 2がVeo 3.1では直接対抗できない明確な優位性を持っています。Sora 2は1回の生成で最大25秒のクリップを作成できますが、Veo 3.1はネイティブでは8秒に制限されています。ただし、Veo 3.1には拡張機能があり、7秒ずつの延長(1動画あたり最大20回)でクリップを連結し、合計約148秒まで延ばすことができます。生成される動画は適度な連続性を維持しますが、連結されたセグメント間のトランジションはSora 2の単一生成出力ほどシームレスではありません。スムーズなモーションを伴う15〜25秒の連続クリップが必要なアプリケーションの場合、移行時に認識しておくべき実質的なギャップがここに残ります。

物理シミュレーションとモーションのリアリズムはSora 2の代名詞とも言える強みであり、この比較においても依然として優れています。Sora 2の動画では、物体が重力、運動量、衝突に対して業界最高レベルの忠実度で反応します。Android Authorityのテストでは、Sora 2が複雑な都市シーンにおいて「都市の雰囲気や車両の乗員まで正確に再現した」と評価されています。Veo 3.1は優れたビジュアル品質を生み出しますが、テスターが「摩擦のない物理」と表現するもの — 現実世界のモーションを説得力のあるものにする微細な不完全さなしに、やや滑らかすぎる物体の動き — が時折見られます。この違いが最も重要になるのは、水、布、群衆、車両など、複雑な物理的インタラクションを含むシーンです。

音声生成と対話については、Veo 3.1が意味のある優位性を持っています。両モデルともネイティブ音声を生成しますが、Veo 3.1はより優れた対話レンダリングを実現し、より明瞭なイントネーション、高精度のリップシンク、より自然な発話パターンを備えています。Sora 2の音声の強みはフォーリーエフェクト — 足音、ドアの閉まる音、環境音などの物理的インタラクションの環境音 — にあります。対話品質が重要なプロジェクト(マーケティング動画、解説コンテンツ、キャラクター主導のナラティブ)ではVeo 3.1が有利です。一方、環境の雰囲気やリアリズムに重点を置くプロジェクトでは、Sora 2のフォーリー精度がより適したツールでしたが、サービス終了により、この優位性は学術的なものとなりました。

キャラクター一貫性については、複数回の生成にわたるSora 2のもう一つの強みでした。Character Cameo APIは、開発者がクリップ間で再利用するキャラクタープロファイルをアップロードすることで、95%以上の顔の一貫性を達成しました(WentuoAI分析)。Veo 3.1は異なるアプローチでキャラクター一貫性に取り組んでおり、「Ingredients to Video」機能を通じたリファレンス画像と、先頭・末尾フレーム制御を使用しています。この方法は効果的ですが、Sora 2のより自動化されたアプローチと比べて、より慎重なプロンプトエンジニアリングとリファレンス画像の準備が必要です。

APIの利用可否とアクセスについては、比較は明白です。Sora 2のAPIはサービス終了 — それ以上の議論は不要です。Veo 3.1は、充実したドキュメントを備えたRESTエンドポイントを持つGemini API、Google Cloud Platformユーザー向けのVertex AI、およびサードパーティのアグリゲーターを通じてグローバルに利用可能です。本番環境のレート制限は、Gemini APIとVertex AIの両方で毎分50リクエストをサポートし、プレビューモデルは10 RPMに制限されています。これら2つ以外の代替手段も含めた幅広い比較については、マルチモデル比較ガイドおよびベストAI動画モデルランキングをご覧ください。

| 機能 | Sora 2 | Veo 3.1 | 勝者 |

|---|---|---|---|

| 最大解像度 | 1080p、30fps | 4K/2160p、60fps | Veo 3.1 |

| 最大尺数 | 25秒 | ネイティブ8秒、拡張148秒 | Sora 2 |

| 物理リアリズム | 業界最高 | 良好(時折問題あり) | Sora 2 |

| 音声/対話 | 良好なフォーリー | 優れた対話+リップシンク | Veo 3.1 |

| キャラクター一貫性 | 95%以上(組み込み) | リファレンス画像ベース | Sora 2 |

| ネイティブ4K | なし | あり | Veo 3.1 |

| 縦型動画(9:16) | なし | あり | Veo 3.1 |

| グローバル対応 | 米国/カナダのみ | グローバル | Veo 3.1 |

| 最低サブスクリプション | $200/月 | $7.99/月 | Veo 3.1 |

| APIレート制限 | N/A(サービス終了) | 50 RPM(本番) | Veo 3.1 |

| APIステータス | サービス終了 | 稼働中 | Veo 3.1 |

最終的なスコアは、Veo 3.1が7項目、Sora 2が3項目で勝利し、API料金はティアによってほぼ同等です。しかし、APIステータスという項目が他のすべてを圧倒します。アクセスできない優れた製品の実用的な価値はゼロだからです。

各モデルの真の強み — 正直な評価

サービス終了後であっても、各モデルの本当の強みを理解することは重要です。Veo 3.1で何が置き換えられ、何が置き換えられないのかについて現実的な期待を設定し、Veo 3.1を他の代替手段で補完する必要があるケースを特定するのに役立つからです。

Sora 2が競合他社よりも優れていた点、そして移行後に本当に失われるものは、3つの具体的な機能に集約されます。第一に、物理エンジンは重力、運動量、材質特性が現実世界と同様に振る舞う動画を生成しました — 水はリアルに飛び散り、布は自然に垂れ、物体には説得力のある重量感がありました。第二に、25秒の単一クリップ長により、短いクリップを連結する際の視覚的連続性の課題なしに、完全なシーンを生成できました。第三に、Character Cameoシステムは、Veo 3.1のリファレンス画像アプローチよりも少ない手作業でキャラクターの一貫性を自動化しました。これら3つの具体的な機能に大きく依存するユースケースの場合、Veo 3.1単体でSora 2のワークフローを完全に置き換えられると想定するのではなく、複数の代替手段をテストすべきです。Kling 3.0は強力な物理表現と最大180秒の長さを提供しており、長尺コンテンツのVeo 3.1の補完として評価する価値があります。

Veo 3.1が優れている点、そしてほとんどのSora 2ユーザーにとって自然な後継となる理由は、単に利用可能であること以上に広がります。ネイティブ4K出力(60fps)はプロの映像制作において真に画期的です — どれだけアップスケーリングしても、その解像度でのネイティブレンダリングと同じ鮮明さは得られません。正確なリップシンクを伴う対話生成は、Sora 2では十分に対応できなかったユースケース、特にキャラクター主導のコンテンツやボイスオーバー付きのマーケティング動画を可能にします。縦型動画サポート(9:16)は、モバイルプラットフォーム、ソーシャルメディア、ショートフォームコンテンツをターゲットとするアプリケーションには事実上必須です。そして、グローバル対応により大きな障壁が取り除かれました — Sora 2は米国とカナダに限定されており、世界の大多数の開発者やコンテンツクリエイターを排除していました。

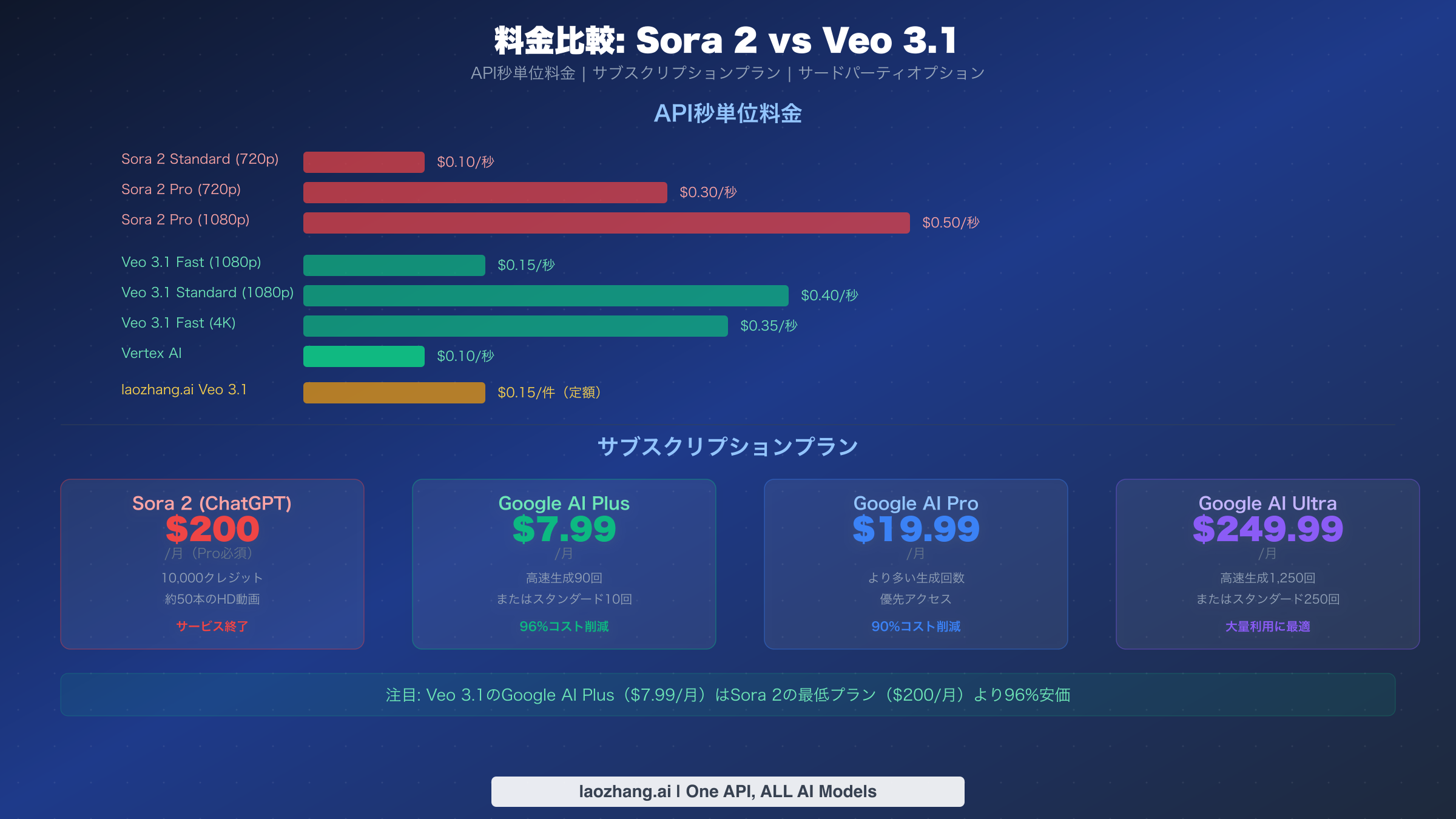

料金比較 — 各APIの実際のコスト

料金はサービス終了前からSora 2の最大の弱点の一つでしたが、Veo 3.1のコスト構造により、以前Sora 2の出力品質に満足していた場合でも、移行は財務的に魅力的です。

APIレベルでは、Sora 2は標準720p動画で1秒あたり$0.10、1080p Pro品質では1秒あたり$0.50まで上昇しました。Veo 3.1の料金はFastモード(720p/1080p)で1秒あたり$0.15から、音声付きのStandardモードで1秒あたり$0.40です。4KティアはFastで1秒あたり$0.35、Standardで1秒あたり$0.60です。Vertex AIを通じて、開発者はVeo 3.1に1秒あたり$0.10でアクセスできます — Sora 2の最安ティアと同額でありながら、4K対応の出力が得られます。

サブスクリプションの比較はさらに劇的です。Sora 2にアクセスするための最低コストはChatGPT Proの月額$200で、10,000クレジット(約50本のHD動画に相当)が含まれていました。GoogleはVeo 3.1へのアクセスを、Google AI Plusの月額わずか$7.99(高速生成90回)、Google AI Proの月額$19.99、Google AI Ultraの月額$249.99(高速生成1,250回またはスタンダード250回)で提供しています。エントリーレベルの比較は明白です:$7.99対$200 — 基本アクセスで96%のコスト削減です。

サブスクリプションではなくAPIアクセスを利用する開発者にとって、サードパーティのアグリゲータープラットフォームはさらなるコスト最適化を提供します。laozhang.aiを通じて、Veo 3.1 Fastアクセスは1リクエストあたり$0.15の定額制(秒単位課金ではなく)で利用でき、非同期エンドポイントにより生成失敗時の課金は一切ありません。この失敗時無課金ポリシーは、新しいモデルに合わせてプロンプトやパラメータを調整する際に多くの実験的なリクエストを生成する可能性がある移行テスト期間中に特に価値があります。利用可能なすべてのAPIの動画生成コストをより広く比較するには、AI動画生成コスト総合ガイドをご覧ください。

| シナリオ | Sora 2コスト | Veo 3.1コスト | 削減率 |

|---|---|---|---|

| 月100本(サブスクリプション) | $200(Pro必須) | $7.99(AI Plus) | 96% |

| 月100本(API、各10秒) | $100〜500 | $15〜150 | 70〜97% |

| 月1,000本(API) | $1,000〜5,000 | $150〜600 | 85〜97% |

| 月10,000本(API) | $10,000〜50,000 | $1,500〜6,000 | 85〜97% |

API統合 — 開発者体験の比較

両APIともOpenAI互換フォーマットに準拠しているため、移行は大幅に簡素化されます。Sora 2は非同期生成に標準の/v1/videosエンドポイント、ストリーミング出力に/v1/chat/completionsを使用していました。Gemini APIを通じたVeo 3.1はわかりやすい認証付きのRESTエンドポイントを使用し、laozhang.aiのようなアグリゲータープラットフォームを通じて、Sora 2開発者が既に慣れ親しんでいるものと同じOpenAI互換インターフェースを維持しています。

単純なAPI互換性を超えた開発者体験の違いも注目に値します。GoogleのGemini APIを通じたVeo 3.1のドキュメントは包括的でよく整備されており、テキストからの動画生成、画像からの動画生成、独自の先頭・末尾フレームモードについて明確な例が提供されています。レート制限は透明で予測可能です — 本番環境で50 RPM、プレビューで10 RPM。これは、Sora 2のより不透明なクレジットベースのシステム(本番ワークロードのコスト予測を困難にしていた)と対照的です。

Veo 3.1のアーキテクチャの大きな利点の一つは、開発者がプログラマティックに動画セグメントを連結できるエクステンションAPIです。より長い動画においてSora 2の単一生成アプローチと比較して追加のロジックが必要ですが、ナラティブフローのきめ細かな制御が可能になります。4秒のクリップを生成し、出力を評価し、品質基準を満たすセグメントのみを延長できます。これにより、一部分の調整が必要な場合に25秒のクリップ全体を再生成するよりも、大幅なコンピューティングコストの節約が可能になります。

エラーハンドリングも移行によって改善される分野です。Gemini APIを通じたVeo 3.1は、明確な修復ガイダンス付きの構造化エラーコードを返します。laozhang.aiの非同期エンドポイントにおける失敗時無課金ポリシーと組み合わせると、エッジケース — コンテンツモデレーションの却下、タイムアウトエラー、容量制限 — のハンドリングにおける開発者体験は、失敗がどの段階で発生したかによって課金が発生する可能性があったSora 2のアプローチよりも予測可能でコスト効率が高くなっています。

移行ガイド — Sora 2からVeo 3.1への切り替え

Sora 2からVeo 3.1への移行は、最もシンプルなAPI移行の一つです。主な理由は、両方がOpenAI互換APIフォーマットに準拠していること、そしてアグリゲータープラットフォームがプロバイダー固有の差異を抽象化してくれるからです。以下は、ほとんどの統合で30分以内に完了する具体的なプロセスです。

コードの変更は2行だけです。 現在OpenAI SDKを使用してSora 2を呼び出している場合、laozhang.aiを通じたVeo 3.1への移行では、base_urlとmodelパラメータを変更するだけで済みます。認証フロー、リクエスト構造、レスポンス解析、エラーハンドリングなど、その他すべてはそのままです。laozhang.aiがサポートするすべての動画モデルに対してOpenAI互換エンドポイントを維持しているため、既存のSDK統合がこの2つの設定値の変更以外に修正なしで動作します。

pythonfrom openai import OpenAI client = OpenAI(api_key="sk-openai-key") response = client.chat.completions.create( model="sora-2", messages=[{"role": "user", "content": [{"type": "text", "text": "A sunset over the ocean"}]}], stream=True ) # After: Veo 3.1 via laozhang.ai (change 2 lines) from openai import OpenAI client = OpenAI( api_key="your_laozhang_api_key", base_url="https://api.laozhang.ai/v1" ) response = client.chat.completions.create( model="veo-3.1-fast", # or "veo-3.1" for standard quality messages=[{"role": "user", "content": [{"type": "text", "text": "A sunset over the ocean"}]}], stream=True )

基本的な移行に加えて、Veo 3.1の機能を最大限に活用するために行う価値のある3つの調整があります。第一に、Sora 2の最大解像度が1080pだったために出力を1080pに制限していた場合、適切な箇所で4Kをリクエストするように解像度パラメータを更新してください — 映像品質の向上は大きく、コスト増は控えめです(Fastモードで$0.35/秒 vs $0.15/秒)。第二に、8秒以上の動画が必要な場合、Gemini APIの動画拡張エンドポイントを使用した拡張チェーンロジックを実装してください。第三に、シーン遷移の精密な制御が必要なシナリオでは、先頭・末尾フレームパラメータの追加を検討してください — この機能はSora 2に相当するものがなく、マルチショットワークフローにおけるナラティブの連続性を大幅に改善できます。

本番デプロイメントでは、コード変更ではなく設定変更で動画プロバイダーを切り替えられるモデル抽象化レイヤーを実装してください。これにより将来的な中断から保護され、異なるリクエストタイプを最適なモデルにルーティングできます — 4Kおよび対話コンテンツにはVeo 3.1、長尺シーンにはKling 3.0、そしてエコシステムの進化に応じて他のモデルも活用できます。

FAQ — Sora 2 vs Veo 3.1に関するよくある質問

Veo 3.1はSora 2の完全な代替になりますか?

ほとんどのユースケースでは、はい。Veo 3.1は11項目中7項目でSora 2と同等以上です。Sora 2が優れていた3分野 — 物理シミュレーション、キャラクター一貫性、単一クリップの長さ — は、主に特定の制作ワークフローで重要になります。大多数の開発者にとって、Veo 3.1は妥協ではなく改善となるでしょう。特に4K出力、より良い音声、そして劇的なコスト削減を考慮すれば、なおさらです。

APIサービス終了後もSora 2モデルにアクセスできますか?

Sora 2モデルは、Plus(月額$20)およびPro(月額$200)サブスクライバー向けにChatGPT内で引き続き利用可能です。ChatGPTインターフェースを通じて手動で動画を生成できますが、プログラマティックなAPI呼び出しはできません。つまり、Sora 2は単発のクリエイティブ作業には引き続き使用可能ですが、自動化された制作パイプラインには使用できなくなります。

Sora 2 APIが停止するまでどのくらいの猶予がありますか?

OpenAIは2026年3月26日時点で具体的な日付を発表していません。過去の廃止パターン(GPT-3とCodexはいずれも約90日の猶予期間がありました)に基づくと、正式なタイムラインが発表されてから30〜90日を想定すべきです。期限を待たずに、今すぐ移行を開始してください。

Sora 2の物理シミュレーションの優位性について — 同等のものはありますか?

KuaishouのKling 3.0が、Sora 2の物理シミュレーション品質に最も近く、最大180秒の長さを1秒あたり$0.07〜0.14で提供しています。物理のリアリズムがユースケースにとって重要な場合、Veo 3.1のみに頼るのではなく、Kling 3.0をVeo 3.1の補完として使用することを検討してください。

移行は本当にコード2行だけですか?

laozhang.aiのようなOpenAI互換アグリゲーターを通じてであれば、はい。base_urlとmodelパラメータを変更するだけで、残りのコード — 認証、リクエストフォーマット、レスポンス解析 — はそのままです。OpenAI APIを直接呼び出している場合(アグリゲーターを通さない場合)は、エンドポイントURL、APIキー、モデル名の更新が必要になりますが、それでも5行未満の変更です。

GoogleもOpenAIがSoraを終了したようにVeo 3.1を終了しますか?

将来を確実に予測することはできませんが、リスクプロファイルは大きく異なります。Veo 3.1はGoogleのより広いGeminiエコシステムとGoogle Cloud Platformに統合されており、スタンドアロンのコンシューマー製品ではありません。Googleの規模は、Soraを沈めたコンピューティングの経済性がそれほど問題にならないことを意味します — 動画生成は収益性の高いクラウドプラットフォームの多くの機能の一つであり、独自のGPUコストを単独で正当化する必要があるスタンドアロン製品ではないのです。