OpenClawはClaude、GPT、Gemini、DeepSeekなど10種類以上のAIモデルに対応していますが、これだけ選択肢があると、多くのユーザーが「どのモデルを使えばいいのか?」と悩みます。Claude Sonnet 4.6(入力$3、出力$15/M tokens)はほとんどの日常シーンで最適な出発点であり、DeepSeek V3.2(入力$0.28、出力$0.42/M tokens)は予算が限られている場合のコストパフォーマンスに優れた選択肢です。本記事は2026年3月の最新検証データに基づき、9種類の主要モデルの価格・性能・実際の設定方法を比較し、あなたに最適なモデルの選び方をお伝えします。

OpenClawとは?なぜモデル選択が使用体験を左右するのか

OpenClawはオープンソースのパーソナルAIアシスタントプラットフォームで、コミュニティ主導で開発されています。ユーザーが自分のAPIキーで各主要モデルプロバイダーに接続し、統一されたインターフェースで日常タスク、コーディング、コンテンツ作成、複雑な推論を行うことを目的としています。ChatGPTやClaude.aiのような単一ベンダーが運営するクローズドプラットフォームとは異なり、OpenClawの最大の特徴はそのマルチモデルアーキテクチャにあります。同じワークスペース内でAnthropicのClaude、OpenAIのGPT、GoogleのGemini、DeepSeekのオープンソースモデルを自由に切り替えたり、Ollamaを通じてローカルにデプロイしたLlamaモデルを実行したりできます。これらすべてが統一されたprovider/model設定フォーマット(例:anthropic/claude-sonnet-4-6)で管理されます。

モデル選択がOpenClawの使用体験にとって極めて重要な理由は、モデルごとに推論能力、応答速度、ツール呼び出しの安定性、価格に大きな違いがあるためです。具体的な例を挙げると、主な用途がメール処理、質問応答、カレンダー管理であれば、Claude Opus 4.6(出力価格$25/M tokens)を使うのはフェラーリで買い物に行くようなもの——性能が大幅に余り、コストも不必要に高くなります。一方、Claude Sonnet 4.6やGPT-4oなら十分に対応でき、月額コストは$200から$15〜30に下がります。逆に、複数ファイルのアーキテクチャリファクタリングや複雑なマルチステップ推論タスクが必要な場合、DeepSeek V3.2のような軽量モデルでは、安価ではあるものの結果の品質が要件を満たせない可能性があります。OpenClawのSaaS版は2026年2月28日に正式リリースされ(GitHubリポジトリ:github.com/openclaw/openclaw)、ブラウザから直接利用できるようになり、導入のハードルがさらに下がりました。

日本語ユーザーにとって、このガイドは現時点で最も包括的なOpenClawモデル選択リファレンスです。英語コミュニティにはすでに複数の比較記事がありますが、アジア圏ユーザーが関心を持つAPI中継サービスやローカライズされた設定アドバイスが不足しがちです。以下では、価格・性能・シーンの3つの軸で、あなたに最適なモデルの組み合わせを見つけるお手伝いをします。

2026年 9つの主要モデル価格徹底比較

AIモデルを選ぶ際、価格は最初のフィルタリング条件になることが多いです。以下の表はOpenClawが対応する9つの主要モデルの最新価格データをまとめたもので、すべての価格は2026年3月7日に検証済み、データソースは各ベンダーの公式価格ページです。特に注意すべき点として、AIモデルの価格設定は「入力/出力」の二重価格体系を採用しています。モデルに送信するテキストは入力価格で課金され、モデルが生成する回答は出力価格で課金されます。出力価格は通常、入力価格の2〜5倍であるため、月額コストに最も影響するのは出力価格です。

| モデル | ベンダー | 入力価格 | 出力価格 | コンテキストウィンドウ | 月額コスト目安 |

|---|---|---|---|---|---|

| Claude Opus 4.6 | Anthropic | $5/M | $25/M | 200K | $80-200 |

| Claude Sonnet 4.6 | Anthropic | $3/M | $15/M | 200K | $15-50 |

| Claude Haiku 4.5 | Anthropic | $1/M | $5/M | 200K | $3-15 |

| GPT-4o | OpenAI | $2.50/M | $10/M | 128K | $10-40 |

| GPT-4o mini | OpenAI | $0.15/M | $0.60/M | 128K | $1-5 |

| Gemini 2.5 Pro | $1.25/M | $10/M | 1M | $10-40 | |

| Gemini 2.5 Flash | $0.30/M | $2.50/M | 1M | $2-10 | |

| DeepSeek R1 | DeepSeek | $0.50/M | $2.18/M | 64K | $3-15 |

| DeepSeek V3.2 | DeepSeek | $0.28/M | $0.42/M | 64K | $2-8 |

表を見ると、驚くべき価格幅があることがわかります。最も高価なClaude Opus 4.6の出力価格は、最も安価なDeepSeek V3.2の約60倍です。しかし、安い=お得というわけではありません。DeepSeek V3.2は単純な分類や基本的なQ&Aでは非常にコスパが高いですが、深い推論を要するアーキテクチャ設計タスクでは、精度と完成度においてOpusとの差が顕著です。月額コスト目安は1日10〜30タスクの典型的な個人ユーザーシーンに基づいており、実際の費用は利用頻度と各会話のトークン消費量に左右されます。Claudeシリーズモデルの詳細な価格分析については、Claude Opus 4.6 料金プランとサブスクリプション完全ガイドを参照してください。

日本を含むアジア圏のユーザーにとって、laozhang.aiのようなAPI中継プラットフォームを経由してこれらのモデルにアクセスすれば、テキストモデルの価格は各主要プラットフォームとほぼ同水準で、海外決済やネットワーク環境の問題を回避できます。登録するだけで無料枠がもらえます(詳細は https://docs.laozhang.ai/ )。

5大モデルファミリー徹底評価

価格を理解した上で、さらに重要なのは各モデルファミリーのコア強みと適用範囲を知ることです。OpenClawが対応するモデルは5つの大きなファミリーに分類でき、それぞれに独自の「性格」があります。具体的なバージョンにこだわるよりも、適切なファミリーを選ぶことの方が重要です。

Claudeファミリー(Anthropic)

Claudeは現在、OpenClawコミュニティで最も利用率の高いモデルファミリーで、アクティブユーザーの約55%がClaudeをデフォルトモデルとして設定しています。これは偶然ではなく、Claudeはツール呼び出し(tool use)における安定性がすべてのモデルの中で最も優れており、外部ツールを頻繁に呼び出すOpenClawのようなAIアシスタントにとって極めて重要です。Opus 4.6は現時点で最強の推論モデルで、アーキテクチャ設計、セキュリティ監査、複雑なマルチステップタスクに適しています。Sonnet 4.6は高品質を維持しながらコストをOpusの60%に削減し、日常業務における最適なバランスポイントです。Haiku 4.5はバックグラウンドでのバッチ処理や単純な分類タスクに適しています。Claudeファミリーの統一された200Kコンテキストウィンドウにより、単一の会話で大量のコードファイルや長文ドキュメントを処理できます。OpenClawでのOpusの使い方について詳しく知りたい方は、OpenClawでClaude Opus 4.6を使う完全チュートリアルをご覧ください。

GPTファミリー(OpenAI)

GPT-4oはOpenAIのフラッグシップマルチモーダルモデルで、最大の強みは応答速度の速さと構造化出力の能力にあります。ワークフローでJSON形式の構造化データを素早く返す必要がある場合、GPT-4oの信頼性は他のモデルをわずかに上回ります。GPT-4o miniは現在市場で最もコスパの高い軽量モデルの一つで、出力価格はわずか$0.60/M tokens、高頻度・低複雑度のタスクシーンに最適です。ただし、GPTファミリーはツール呼び出しの一貫性においてClaudeにやや劣り、パラメータ形式のエラーが発生することがあります。

Geminiファミリー(Google)

Geminiのコア競争力は2つのポイントにあります。超大容量コンテキストウィンドウと無料枠です。Gemini 2.5 Proは最大100万トークンのコンテキストウィンドウに対応しており、Claudeの5倍です。単一の会話でコードリポジトリ全体や超長文ドキュメントを分析する必要がある場合、Geminiが唯一の選択肢となります。Gemini 2.5 Flashは優れた速度と低価格を提供し、高速レスポンスが必要なシーンに適しています。Google AI Studioはかなり寛大な無料利用枠を提供しており、予算が限られたユーザーにとって良い入門の選択肢です。

DeepSeekファミリー

DeepSeekは中国チームが開発したオープンソースモデルで、最大の強みは極めて低い価格です。V3.2の出力価格はわずか$0.42/M tokensで、Claude Opusの1/60。大量の簡単なタスクのバッチ処理に適しています。R1はDeepSeekの推論強化版で、数学や論理推論において優れた性能を発揮し、出力価格$2.18/M tokensは同レベルのClaudeやGPTモデルと比べて大幅に低価格です。注意すべき点として、DeepSeekモデルは複雑なマルチステップのツール呼び出しタスクにおいて、安定性と精度でClaudeとの明確な差があるため、主力モデルではなく補助モデルとして使用するのがより適切です。

ローカルモデル(Ollama)

データプライバシーに厳格な要件がある場合やオフラインで使用する必要がある場合、OpenClawはOllamaを通じてローカルにデプロイされたオープンソースモデル(Llama 3.3の70Bおよび7B版など)に対応しています。ローカルモデルのAPI費用はゼロですが、ハードウェアを自前で用意する必要があります。70Bパラメータモデルの実行には最低48GBのメモリ(専用GPU推奨)、7Bパラメータモデルなら16GBのメモリでスムーズに動作します。ローカルモデルの推論能力はクラウド上のOpusやGPT-4oには及びませんが、簡単なテキスト処理やコード補完タスクには十分対応可能で、データが自分のマシンから外に出ることは決してありません。

ゼロコストプラン:OpenClawを無料で使う方法

予算が限られていてもOpenClawを使えないわけではありません。無料リソースを適切に組み合わせることで、ゼロコストでOpenClawのコア機能を体験できます。現在、主に3つの無料利用パスがあり、それぞれ適用シーンと制限事項があります。

1つ目の方法は、各ベンダーが提供する無料APIクレジットの活用です。GoogleのGemini APIはAI Studioを通じて現在最も寛大な無料枠を提供しており、Gemini 2.5 FlashやGemini 2.5 Proの制限付き無料呼び出しが含まれます。OpenAIは新規登録ユーザーに一定額の無料APIクレジットを提供しており、通常は初期体験に十分です。Anthropicも時折無料トライアル枠を提供しますが、枠は限られています。OpenClawでこれらの無料APIキーを設定するのは非常に簡単で、設定画面で対応ベンダーのAPIキーを入力し、対応する無料モデルを選択するだけで利用を開始できます。

2つ目の方法はローカルモデルのデプロイです。Ollamaを使ってローカルマシンでLlama 3.3 7Bなどの軽量オープンソースモデルを実行すれば、API費用は完全に無料です。設定方法もシンプルで、Ollamaをインストール後、OpenClawでproviderをollamaに設定し、modelをローカルモデル名(ollama/llama3.3など)に指定します。この方法の前提条件はPCに最低16GBのメモリがあることで、ローカルモデルの推論能力の限界を受け入れる必要があります。日常的なQ&A、ドキュメント要約、簡単なコード生成には、ローカル7Bモデルの性能は十分に許容範囲内です。

3つ目の方法はハイブリッド戦略です。無料のGemini APIで大部分の日常タスクを処理し、より強い推論能力が必要な場面でのみ有料モデルに切り替えます。この方法で月額コストを$5以内に抑えつつ、90%以上のユースケースをカバーできます。OpenClawのマルチモデル切り替え機能により、このハイブリッド戦略の実装はとてもスムーズで、会話中にproviderを切り替えるだけで異なるモデルを利用できます。

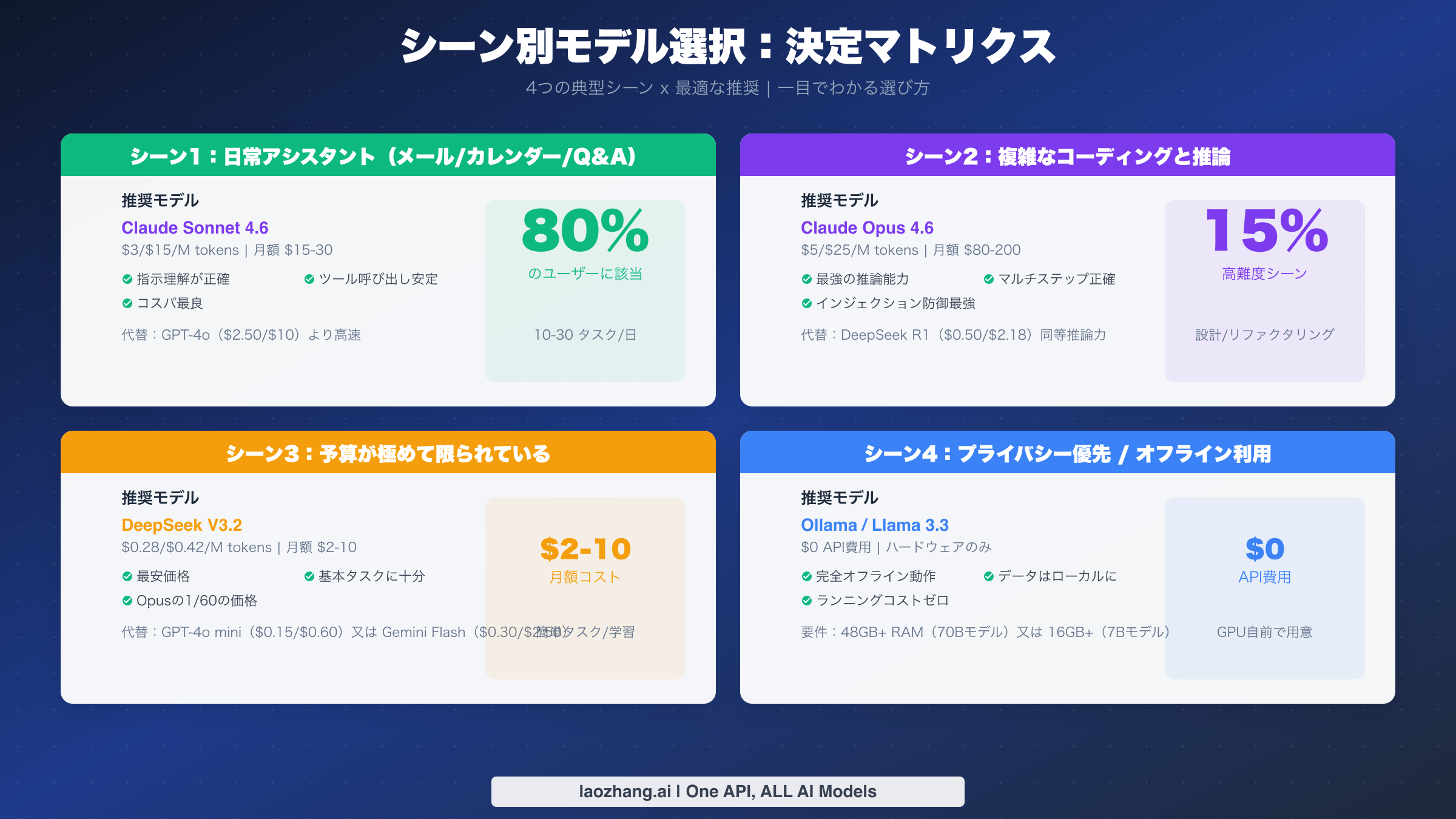

シーン別推奨:ニーズに合わせたモデル選択マトリクス

各モデルの価格と特徴がわかったところで、最も実用的な質問は「自分のシーンではどのモデルを使うべきか?」です。以下の4つの典型的なシーンはOpenClawユーザーの95%以上のニーズをカバーしており、それぞれ明確な推奨モデルと代替案があります。

シーン1:日常アシスタント(メール・カレンダー・Q&A)──推奨:Claude Sonnet 4.6

これは80%のユーザーにとって主な使用シーンです。日常アシスタントタスクの特徴は、頻度が高く、複雑さは中程度で、応答速度にある程度の要件があることです。Claude Sonnet 4.6はこのシーンで最もバランスの取れたパフォーマンスを発揮します。指示理解は正確で、ツール呼び出しは安定しており、出力価格$15/M tokensはミッドレンジモデルの中で競争力があります。1日10〜30タスクで計算すると、月額コストは約$15〜30です。応答速度をより重視する場合は、GPT-4o($2.50/$10)が検討に値する代替案です。特にカレンダー管理やデータ整理タスクでは、その構造化出力能力が際立ちます。

シーン2:複雑なコーディングと深い推論──推奨:Claude Opus 4.6

アーキテクチャ設計、複数ファイルのリファクタリング、セキュリティ監査、複雑なマルチステップ推論タスクを行う場合、Claude Opus 4.6が現時点で最も信頼できる選択肢です。プロンプトインジェクション耐性においてもすべてのモデル中最強であり、信頼できない入力を処理する自動化タスクには特に重要です。Opusの出力価格は$25/M tokensと高めですが、このような高価値タスクでは、1回のアーキテクチャ判断ミスによる手戻りコストの方がモデル費用の差をはるかに上回ります。予算が限られているが強い推論能力が必要な場合、DeepSeek R1($0.50/$2.18)は興味深い代替案です。数学的推論や論理分析においてOpusに近いレベルの性能を持ちながら、価格はOpusの1/12に過ぎません。

シーン3:予算が極めて限られている──推奨:DeepSeek V3.2

月額AI予算が$10以内の場合、DeepSeek V3.2が最も現実的な選択肢です。出力価格$0.42/M tokensは、毎日大量に使用しても月額が$8を超えることはほぼありません。V3.2は基本的なQ&A、テキスト要約、簡単なコード生成において満足のいく性能を発揮します。複雑な推論タスクではClaudeやGPTとの明確な差がありますが、予算が限られた学生ユーザーやライトユーザーには十分対応できます。代替案としては、GPT-4o mini($0.15/$0.60、より高速)やGemini 2.5 Flash($0.30/$2.50、より大きなコンテキスト)があります。

シーン4:プライバシー最優先またはオフライン利用──推奨:Ollama + Llama 3.3

企業ユーザーが機密データを扱う場合や、ネットワークのない環境でAIを使用する必要がある場合、Ollamaを通じてLlama 3.3をローカルにデプロイすることが唯一の実行可能な方法です。API費用はゼロで、データは完全にローカルに留まりますが、ハードウェアを自前で用意する必要があります。70Bパラメータモデルには48GB以上のメモリ、7Bパラメータモデルには16GB以上が必要です。ローカルモデルの推論能力はクラウドのトップモデルには及びませんが、ドキュメント処理、コード補完、基本的な会話においてはほとんどのニーズを満たすことができます。

マルチモデルルーティング実践:一つの設定で70%コスト削減

前述のシーン別推奨は「どのモデルを使うか」という問題を解決しましたが、本当のコスト最適化の達人は1つのモデルだけを使いません。タスクの複雑さに応じてモデルを動的に切り替えます。これがマルチモデルルーティング戦略の核心的な考え方です。適切なタスクを適切なモデルに割り当てることで、品質を保ちながらコストを制御します。

三層ルーティングアーキテクチャはコミュニティで検証されたベストプラクティスで、すべてのタスクを3つの層に分類し、各層に異なるモデルを対応させます。第1層はフロンティアモデル(タスクの約15%)で、Claude Opus 4.6がアーキテクチャ設計、複数ファイルのリファクタリング、セキュリティに敏感な操作を処理します。第2層はバランスモデル(タスクの約55%)で、Claude Sonnet 4.6が日常的なコード生成、コンテンツ作成、一般的なQ&Aを処理します。第3層は軽量モデル(タスクの約30%)で、DeepSeek V3.2がヘルスチェック、簡単な分類、基本的な自動化を処理します。この階層化により、月額総コストをOpusのみ使用時の$200以上から$30〜70に削減でき、65%以上の節約になります。タスク完了品質にはほぼ影響しません。

OpenClawでマルチモデルルーティングを実装する設定は複雑ではありません。以下は典型的な三層ルーティング設定の例です:

json{ "models": { "tier1_frontier": { "provider": "anthropic", "model": "claude-opus-4-6", "usage": "アーキテクチャ設計、セキュリティ監査、複雑な推論" }, "tier2_balanced": { "provider": "anthropic", "model": "claude-sonnet-4-6", "usage": "日常コーディング、コンテンツ作成、一般Q&A" }, "tier3_budget": { "provider": "deepseek", "model": "deepseek-v3", "usage": "簡単な分類、ステータスチェック、バッチ処理" } }, "default": "tier2_balanced" }

実際の操作では、OpenClawの設定画面で異なるワークスペースやプロジェクトごとにデフォルトモデルを指定できますし、会話中にproviderを切り替えて手動で選択することも可能です。さらに高度な使い方として、OpenClawのカスタムモデル設定機能を活用し、特定のタスクタイプにモデルルールをプリセットできます。カスタムモデルの詳細な設定方法については、OpenClawカスタムモデル設定ガイドを参照してください。トークン消費のモニタリングやコスト管理のテクニックについて詳しく知りたい方は、OpenClaw トークン管理とコスト最適化完全ガイドをお読みください。

ルーティング戦略の核心は「できるだけ安いモデルを使う」ことではなく、「各タスクに最適なモデルをマッチングさせる」ことです。深い推論が必要なアーキテクチャタスクを軽量モデルに任せると、1回あたりのコストは安くても、品質が基準に達せず繰り返し修正が必要になれば、トータルコストはかえって高くなる可能性があります。良いルーティング戦略とは、品質とコストの最適なバランスポイントを見つけることです。

日本ユーザー向け:API中継とコスト最適化

日本を含むアジア圏のユーザーにとって、Anthropic、OpenAI、GoogleのAPIを直接使用する際の主な障壁は2つあります。ネットワーク環境による接続の不安定さと、海外決済手段のハードルです。API中継プラットフォームはまさにこの2つの問題を解決するために存在しており、海外にサーバーを展開して各ベンダーのAPIと接続し、アクセス可能なドメインを通じて転送サービスを提供します。ユーザーはOpenClawのAPIエンドポイント(base URL)を中継プラットフォームに向けるだけで正常に利用できます。

laozhang.aiを例にすると、これは現在アジア圏のコミュニティで広く使われているAPI中継プラットフォームの一つで、Claude、GPT、Gemini、DeepSeekなどの主要モデルを集約しており、テキストモデルの価格は各主要プラットフォームとほぼ同水準です。OpenClawでlaozhang.aiを設定する手順はシンプルです。まずlaozhang.aiでアカウントを登録してAPIキーを取得し(登録で無料枠付与、最低$5からチャージ可能)、次にOpenClawのモデル設定でbase URLをlaozhang.aiのAPIエンドポイントに変更し、対応するAPIキーを入力するだけです。設定完了後、OpenClawですべての対応モデルをシームレスに利用でき、ネットワーク接続性を心配する必要がなくなります。

アクセス問題の解決に加えて、中継プラットフォームにはもう一つの利点があります。それは統一された課金と管理です。Anthropic、OpenAI、Google、DeepSeekの4つのプラットフォームにそれぞれアカウント登録と支払い方法の紐付けを行う必要がなく、1つのプラットフォームにチャージするだけですべてのモデルを利用できます。これにより、実際の使用における管理の複雑さが大幅に軽減されます。laozhang.aiの完全なAPIドキュメントは https://docs.laozhang.ai/ で確認できます。

コスト最適化については、前述のマルチモデルルーティング戦略に加えて、以下のテクニックも検討できます。オフピーク時間帯にAPIを使用すると通常レスポンスが速く成功率も高くなります。max_tokensパラメータを適切に設定して不必要なトークン消費を避けましょう。繰り返しのクエリに対しては、アプリケーション層で簡単なキャッシュ機構を実装することでAPI呼び出し頻度を大幅に削減できます。

よくある質問

OpenClawで最も推奨されるモデルは?

ほとんどのユーザーにとって、Claude Sonnet 4.6が最も推奨されるデフォルトモデルです。指示理解、ツール呼び出しの安定性、出力品質のバランスが最も優れており、月額コスト$15〜30は個人ユーザーにとって合理的な範囲内です。主な用途が複雑なコーディングやアーキテクチャ設計の場合は、デフォルトモデルをSonnet 4.6に設定し、高難度タスクの処理時にOpus 4.6に手動で切り替えることをお勧めします。

DeepSeekモデルはOpenClawで使いやすい?

DeepSeek V3.2とR1はどちらもOpenClawで正常に使用でき、価格面のアドバンテージは非常に大きいです。V3.2は簡単なタスクや予算が限られたシーンに適しており、R1は数学的推論において優れた性能を発揮します。ただし、DeepSeekモデルは複雑なマルチステップのツール呼び出しタスクにおける安定性がClaudeに及ばず、フォーマットエラーやパラメータの欠落が発生することがあります。DeepSeekは主力モデルではなく、補助モデルとして使用することをお勧めします。

OpenClawで複数のモデルを同時に使える?

はい、使えます。OpenClawのコア設計理念がまさにマルチモデル対応です。異なるワークスペースに異なるデフォルトモデルを設定でき、会話中にいつでもモデルを切り替えられます。これがマルチモデルルーティング戦略の基盤であり、同じワークフロー内でタスクの複雑さに応じて最適なモデルを動的に選択します。

無料モデルの品質は十分?

ニーズによります。Google Geminiの無料枠は日常的なQ&Aやドキュメント要約において十分な性能を発揮します。ローカルにデプロイしたLlama 3.3 7Bは基本的なコード補完やテキスト生成を処理できます。ただし、複雑な推論、マルチステップのツール呼び出し、高品質なコンテンツ作成が必要な場合、無料モデルの能力には明確な限界があります。推奨される戦略は、無料モデルで簡単なタスクを処理し、重要なタスクには有料モデルを使用することで、月額コストを$5〜10以内に抑えることです。

月額API費用の見積もり方法は?

シンプルな見積もり方法として、1日に約何回AI会話を行い、各会話が平均何ラウンドのやり取りか数えます。Claude Sonnet 4.6を例にすると、各ラウンドの会話は約1,000〜3,000出力トークン(回答の長さによる)を消費します。1日20回の会話、各3ラウンドで計算すると、1日の出力は約120,000トークン、月間約3.6Mトークン、コストは約$54です。マルチモデルルーティング戦略を使用して簡単なタスクの30%をDeepSeek V3.2に振り分ければ、月額コストは約$35まで下がります。

日本からOpenClawを使うのにVPNは必要?

OpenClaw自体の使用にVPNは不要ですが、海外API(Anthropic、OpenAIなど)を直接呼び出す場合は安定したネットワーク環境が必要です。解決策はlaozhang.aiのようなAPI中継プラットフォームを使用することで、APIリクエストをアクセス可能なドメインを通じて転送し、追加のネットワークツールなしですべてのモデルを正常に利用できます。