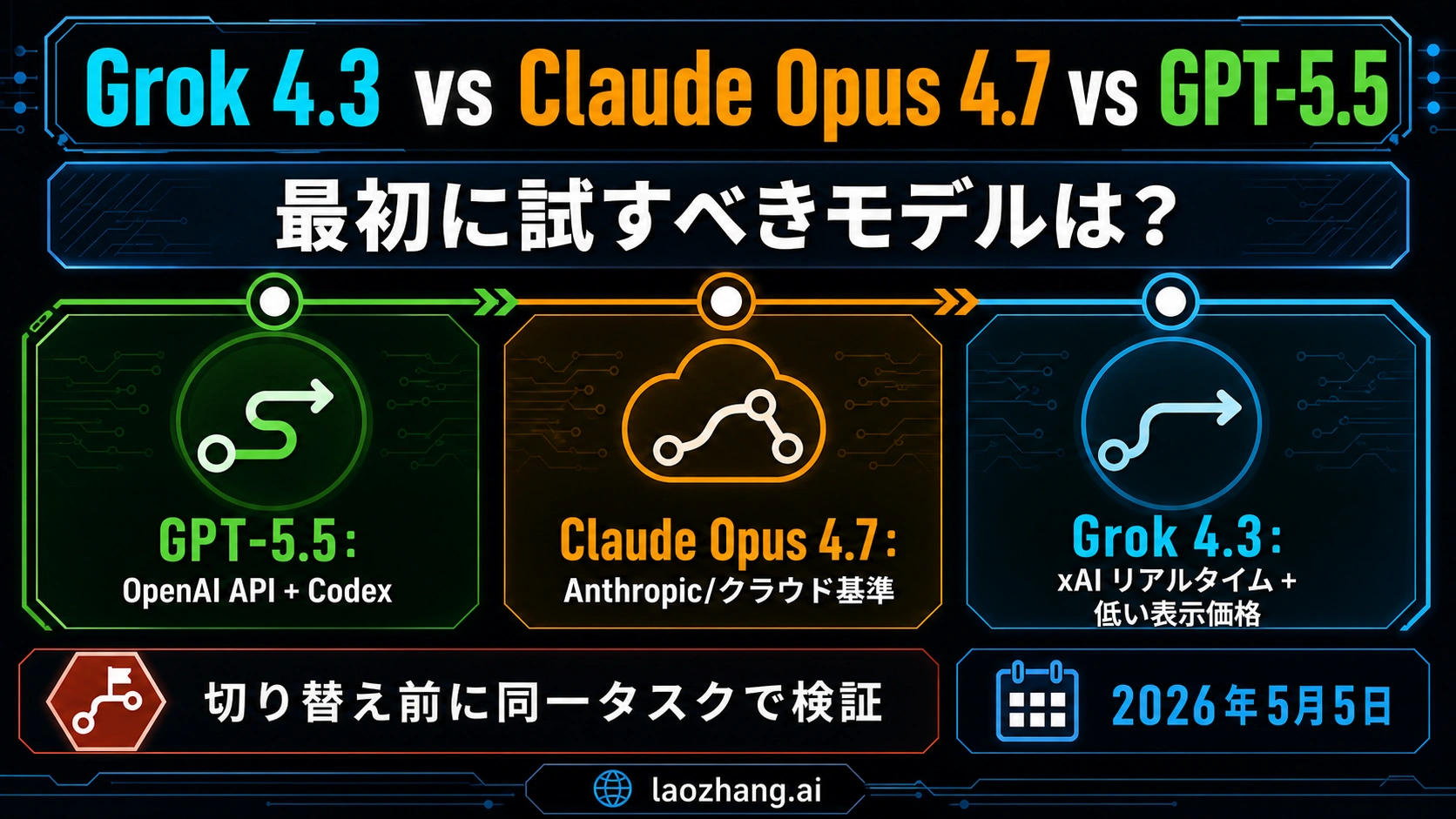

2026年5月5日時点では、三つのモデルを一つの総合勝者として扱うより、まず「どのルートを最初に検証するか」で分けるほうが安全です。OpenAI API、Responses API、Codex、structured outputs、hosted tools、既存のOpenAI evalに依存しているならGPT-5.5を先に検証します。Anthropic API、Claude製品、Bedrock、Vertex AI、Microsoft Foundry、または高リスクなcoding agentの制御線が必要ならClaude Opus 4.7をpremium controlとして残します。xAIアカウント、リアルタイム/X検索、低い表示価格、長いコンテキストの実験が比較理由ならGrok 4.3から始めます。

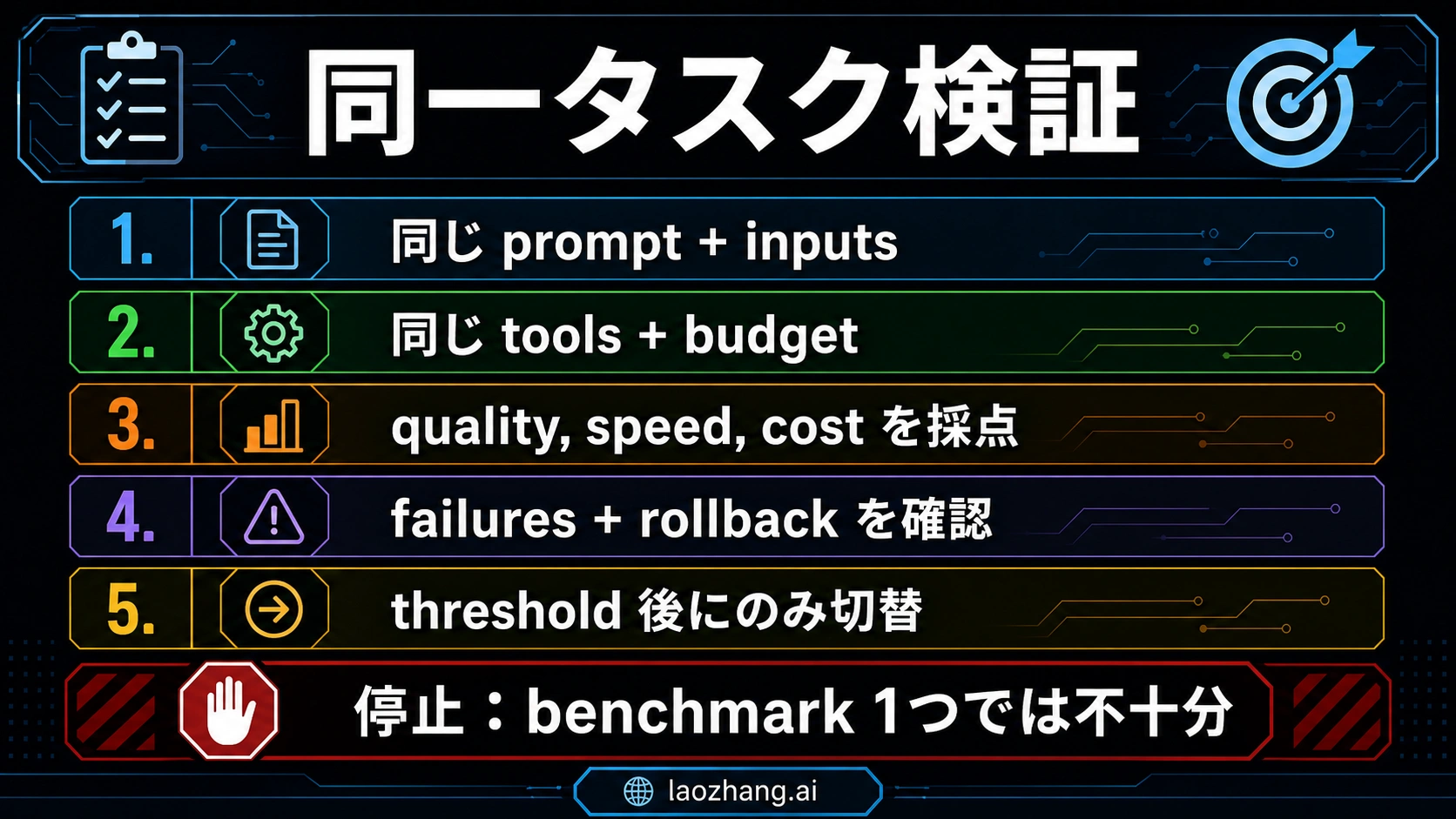

一つのベンチマーク、動画、ローンチ直後の印象だけで本番デフォルトを変えてはいけません。同じプロンプト、同じファイル、同じツール、同じ予算、同じ評価表、同じロールバック条件で測って初めて、モデル比較は意思決定になります。

| 最初に検証するルート | 使うべき場面 | 直接仮定してはいけないこと |

|---|---|---|

| GPT-5.5 | OpenAI API、Responses API、Codex、ツール推論、構造化出力、OpenAI evalをすでに使う。 | Codexの表示、API key、API価格、Codex credits、rate limitsが同じ契約である。 |

| Claude Opus 4.7 | Anthropic API、Claude製品、Bedrock、Vertex AI、Microsoft Foundry、または高リスクagentの制御線。 | 高品質なcontrolが、出力量、tokenizer、再試行、review時間を含めても必ず安い。 |

| Grok 4.3 | xAIルート、リアルタイム/X freshness、低い表示価格、長文コンテキスト試験。 | 低いtoken表示価格が、同一タスクの成功コスト検証を置き換える。 |

まず実際に呼び出せる契約を確認する

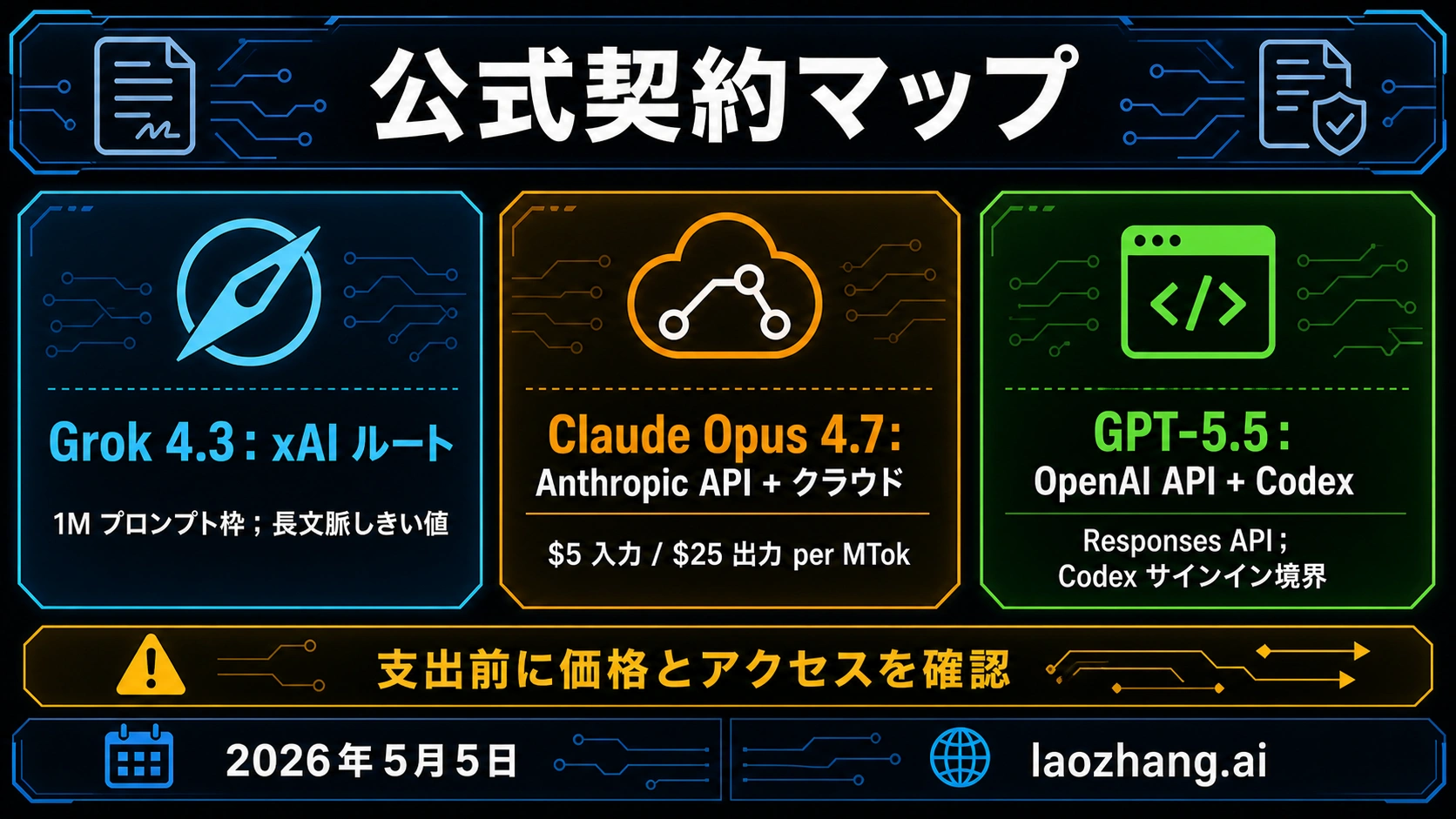

この比較で最初に見るべきものは、モデルの印象ではなくroute ownershipです。OpenAIはGPT-5.5 API、Responses API、Codexの事実を持ちます。AnthropicはClaude Opus 4.7のClaude製品、Anthropic API、クラウド提供ルートを持ちます。xAIはGrok 4.3、コンソール表示、alias、server-side search tools、長いコンテキストの閾値、アカウント可用性を持ちます。第三者レビューは検証対象を提案できますが、model ID、endpoint、価格、context limit、本番アクセスを決める根拠にはなりません。

| 契約項目 | GPT-5.5 | Claude Opus 4.7 | Grok 4.3 |

|---|---|---|---|

| ルート所有者 | OpenAI developer platform、Responses API、Codex | Anthropic API、Claude製品、Bedrock、Vertex AI、Microsoft Foundry | xAI API、xAI Console、Grok docs、server-side search tools |

| 確認するモデル名 | GPT-5.5とOpenAI docsのdated snapshots | claude-opus-4-7とcloud model IDs | grok-4.3、grok-4.3-latest、または現在のconsole alias |

| 最も強い初回検証理由 | OpenAIネイティブのtools、structured outputs、Codex、既存eval | 高リスクcoding agentとクラウド展開のpremium control | xAI realtime/X検索、低い表示価格、長文試験 |

| コスト注意点 | OpenAI API pricingとCodex creditsを分けて確認する。 | Anthropicは$5 input、$25 output per MTokとtokenizer caveatを出している。 | xAI console、alias、長文閾値、検索ツール費用を再確認する。 |

| 混ぜてはいけない面 | API、ChatGPT/Codex login、API-key auth、credits、rate limits | Claude app、Anthropic API、cloud route、priority tier、tokenizer cost | Grok chat、xAI API、Web/X Search、alias、地域/アカウント可用性 |

OpenAIのGPT-5.5 guidanceはResponses APIの文脈で読むべきです。reasoning effort、verbosity、Structured Outputs、prompt caching、hosted tools、state handling、Agents SDKが同じ運用面にあります。Codex docsでもGPT-5.5は複雑なcoding、computer use、knowledge work、research workflowのfrontier choiceとして扱われます。OpenAIネイティブなチームにとって価値があるのは、強さそのものより、実運用に近い面で失敗とコストを観察できることです。

AnthropicのOpus 4.7資料は、Claude products、Anthropic API、Amazon Bedrock、Google Vertex AI、Microsoft Foundryでの一般提供を示します。claude-opus-4-7、1M context、$5 input、$25 output per million tokens、tokenizer caveatといった契約境界も確認対象です。これは、失敗のコストが高いagentでOpusをcontrolとして残す理由になります。

xAIのGrok 4.3は、server-side search toolsと一緒に見ないと判断を誤ります。リアルタイムの出来事にはWeb SearchやX Searchが必要で、基盤モデルの記憶だけで最新性が保証されるわけではありません。Grokを選ぶ理由がリアルタイム/Xなら、検索ツール呼び出し、検索失敗、引用品質、ツール費用までpilotに含めます。

ワークロードごとに最初の検証ルートを分ける

有用な質問は「どれが最高か」ではなく、「この仕事で最初に制御されたテストに入れるべきルートはどれか」です。これにより、ベンチマークの勝敗をそのままデプロイ判断にしてしまう危険を避けられます。

| ワークロード | 最初のルート | 合う理由 | 評価するもの |

|---|---|---|---|

| OpenAIネイティブcoding、Codex、Responses API tools、structured outputs | GPT-5.5 | OpenAI tools、Codex workflow、既存evalに最も近い。 | accepted diffs、tool recovery、format stability、review time、token/credits。 |

| correctness-sensitive coding agents、多ツールflow、cloud deployment | Claude Opus 4.7 | 失敗が高い場面のAnthropic/cloud premium control。 | defect severity、rollback、tool reliability、reviewer trust、latency。 |

| リアルタイムまたはX-informed answers | Grok 4.3 | xAIがGrokとsearch toolsのroute ownerである。 | freshness、tool count、search cost、citation quality、false freshness。 |

| 長いrepo、文書、evidence analysis | route-specific test | 三者とも大きなcontext storyを持つが、制限と価格閾値が違う。 | truncation、recall、output length、long-context threshold、completed-task cost。 |

| 予算重視の探索 | Grok 4.3から始め、GPT-5.5またはOpusでcontrol | 表示価格は魅力だが、品質とretryが保たれる場合のみ。 | success rate、retry count、p95 latency、repair time、accepted-result cost。 |

| 本番デフォルト変更 | 候補と既存モデルをdual-run | 公開比較はあなたのprompt、file、tool、permission、failure costを測れない。 | regression、human minutes、cost、rollback success、user-visible failure。 |

GPT-5.5は、OpenAIの統合面そのものが価値であるときに先に試します。Responses API state、hosted tools、structured outputs、prompt caching、file search、computer use、Codex workflowを使っているなら、GPT-5.5を実運用に近い形で観察できます。そこでは、format drift、tool failure、retry、billing behaviorも早く見えます。

Claude Opus 4.7はpremium control laneです。高リスクなagent、複雑なcode migration、permission-sensitive tools、regulated review、cloud deploymentでは、安い候補や速い候補が本当に安全かどうかを測る軸が必要です。token単価が高くても、重大バグや長いreviewを減らすなら総コストは下がります。

Grok 4.3は狭く使うべきです。xAI access、realtime/X freshness、低い表示価格、長文context pressureが主理由なら先に試します。search toolsもxAI固有アクセスもコスト圧力もないなら、Grokは比較対象には入りますが、自動的に本番defaultになるべきではありません。

コストは同じ課金面で比較する

token priceは入口でしかありません。GPT-5.5はOpenAI API pricing、account controls、Codex creditsのどれで見るかが違います。Claude Opus 4.7はAnthropic directとcloud providerで課金が違う可能性があります。Grok 4.3はmodel tokens、Web Search、X Search、alias、long-context threshold、account visibilityが一緒に効きます。これらを混ぜると、安いという結論も高いという結論もずれます。

GPT-5.5でAPIサービスを作るなら、現在のOpenAI APIまたはconsole価格を見ます。Codex評価ならCodex creditsを見ます。Codex credit rateをバックエンドAPIのtoken価格として扱ってはいけません。Claude Opus 4.7ではtokenizer caveatが重要です。長いprompt、tool log、repo contextの反復は、同じテキストでも請求単位を動かします。Grok 4.3では低い表示価格を「検証理由」に留め、決定にはしません。

| コスト変数 | 順位が変わる理由 |

|---|---|

| inputとcached input | 長いprompt、反復repo context、prompt cachingが請求を変える。 |

| output length | 出力が長いagentでは安いinput価格の意味が薄れる。 |

| tool calls | search、file、browser、computer use、custom toolsが主コストになることがある。 |

| retry rate | 安いモデルでも複数回やり直すなら負ける。 |

| human review minutes | coding agentでは人間のaccept、repair、rollback時間が高い。 |

| rollback cost | まれでも重大な失敗は平均token costより危険。 |

比較すべき数字はsuccessful-task costです。一つのaccepted answer、一つのmerged diff、一つの正しいagent action、一つのcompleted analysis packetにいくらかかるかを見ます。Grokがこのledgerで勝てば拡大します。Opusが重大失敗を防ぐならpremiumは説明できます。GPT-5.5がOpenAIネイティブ統合の摩擦を減らすなら、運用上は安いルートになり得ます。

ベンチマークは検証候補であって結論ではない

ベンチマークや動画は有用ですが、本番defaultを決めるものではありません。coding-agent tests、browsing tasks、long-context recall、math、safety、visual reasoning、cost-per-score tablesは別々の仕事です。OpenAI-native agent benchmarkでGPT-5.5が強いなら、それはあなたのOpenAI harnessにGPT-5.5を入れる理由であって、Opus controlを消す理由でもGrok cost pilotを省く理由でもありません。

逆も同じです。Anthropicのlaunch claimはOpusをcontrolに残す理由であり、同一タスク測定を省く理由ではありません。Grokのpriceやspeed claimはcost pilotを作る理由であり、高リスクcoding defaultを置き換える理由ではありません。

四段階の証拠梯子を使います。公式docsでrouteの存在、model name、access surface、price/limitの確認場所を決める。公開benchmarkでどのworkloadを測るかを決める。自分のsame-task harnessでtraffic移動の可否を決める。staged rolloutで実ユーザー、quota、latency、permission、failureに耐えるかを見る。

この梯子は、一つのtask shapeしか測っていない証拠から万能winnerを宣言するミスを防ぎます。答えは意図的に狭いものです。GPT-5.5はOpenAI-native first test。Claude Opus 4.7はpremium Anthropic/cloud control。Grok 4.3はxAI realtime、低い表示価格、long-context pilotのルートです。

本番デフォルトを変える前に同一タスクで試す

pilotは小さくて構いませんが、公平でなければいけません。一つのモデルにだけ良いprompt、広いcontext、緩いformat、楽なtool budgetを与えたら、それは比較ではありません。

| pilot gate | 固定するもの | 合格条件 |

|---|---|---|

| route access | model label、endpoint、account、region、quota、billing surface、fallback | デプロイ予定の同じルートを呼び出せる。 |

| prompt and files | 同じsystem prompt、user task、repo/document pack | 差は入力ではなくmodel behaviorから出る。 |

| tool budget | 同じtools、permissions、timeout、retry rule、search availability | tool-heavy successを比較できる。 |

| task sample | easy、hard、long-context、strict-format、failure-prone tasks | 実際に金とreviewを消費する仕事に近い。 |

| scoring | correctness、severity、security risk、format、review minutes、accepted rate | demo qualityではなくtotal workを減らす。 |

| cost and latency | input、cached input、output、tools、retries、p95、completed-task cost | full-task accountingでも節約が残る。 |

| rollback | failure threshold、fallback model、routing switch、monitoring owner | 古いルートへ戻せる。 |

すでに安定したdefaultがあるなら、候補モデルをshadow-runしながら現行モデルを維持します。候補がtotal workを減らし、新しいhigh-severity failureを入れず、monitoringとrollbackに耐えるときだけtrafficを増やします。最初のモデルを選ぶチームはstackから始めます。OpenAI-nativeならGPT-5.5、Anthropic/cloud-heavyならOpus、realtime/X freshnessや価格圧力が本当の問題ならGrokです。

隣接する判断

この三モデル比較は狭い判断です。Grok 4.3、Claude Opus 4.7、GPT-5.5のどれを先に同一タスク検証へ入れるか、という話に限定しています。

OpenAI対Anthropicだけが本題なら、GPT-5.5 vs Claude Opus 4.7を使います。xAI realtimeではなくDeepSeekのcost laneが必要なら、DeepSeek V4 Pro vs Claude Opus 4.7 vs GPT-5.5を使います。さらに広い低コスト候補を見たいなら、Kimi K2.6 vs DeepSeek V4 vs GPT-5.5 vs Claude Opus 4.7です。

一つ前の公式frontier API routeを比較しているなら、Claude Opus 4.7 vs GPT-5.4 vs Gemini 3.1 Proを使います。原則は同じです。呼び出せるルートを選び、実際の仕事を測り、rollback pathを残します。

よくある質問

GPT-5.5はClaude Opus 4.7やGrok 4.3より優れていますか?

OpenAI-nativeなsystem、特にResponses API、Codex、tool-heavy reasoning、structured outputs、OpenAI evalを使うなら、GPT-5.5は最初に検証する価値が高いモデルです。ただし万能winnerではありません。Claude Opus 4.7はpremium controlであり、Grok 4.3はrealtime/X search、低い表示価格、long-context pilotが比較理由のときに先に試す価値があります。

Grok 4.3はGPT-5.5やClaude Opus 4.7より安いですか?

Grok 4.3はxAIの表示token価格では安く見える場合があります。ただしconsole visibility、long-context threshold、search-tool charges、retry、latency、accepted-result rateを含めて確認する必要があります。見るべき数字はmodel tokenだけでなくcompleted-task costです。

coding agentにはClaude Opus 4.7を使うべきですか?

失敗が高くつくcoding agent、Anthropicまたはcloud deploymentに合うworkload、正確性がraw token priceより重要な場面では、Claude Opus 4.7をpremium controlにします。OpenAI-native agentならGPT-5.5を先に測り、realtime/X dataやxAI accessや低い表示価格が中心ならGrokを加えます。

GPT-5.5はAPIで使えますか?

OpenAI developer docsにはGPT-5.5 API guidanceとdeveloper surfaceのGPT-5.5 snapshotsがあります。ただしAPI access、Codex access、API-key authentication、credits、rate limits、organization visibilityは別契約です。本番trafficの前に自分のaccountとdeployment routeで確認してください。

Grok 4.3はデフォルトでリアルタイムデータを持ちますか?

いいえ。xAI docsでは、realtime eventsにはWeb SearchやX Searchなどのserver-side search toolsが必要です。Grokを選ぶ理由がfreshnessなら、そのtool callsをcost、scoring、failure reviewに含めます。

長いコンテキスト作業ではどれを先に試すべきですか?

実際にdeployできるrouteを先に試します。三者とも大きなcontext storyを持ちますが、limit、billing、threshold、output behavior、recall qualityが違います。同じlong prompt、同じretrieval pack、同じoutput budget、同じscoring rubricで測ってください。

最も安全なproduction switch ruleは何ですか?

benchmark、launch claim、listed price gapだけで切り替えないことです。候補と現行モデルを同じprompt、tools、files、budget、acceptance tests、rollback thresholdでdual-runします。staged rolloutでtotal workが減ると確認できた場合だけpromoteします。