A fecha de 9 de abril de 2026, no existe un único sitio Seedance 2.0 free online que funcione igual para todos. La pregunta útil ahora no es dónde pone gratis, sino qué ruta es realmente oficial, cuándo free significa solo una entrada limitada y qué nivel de riesgo aceptas si terminas usando un wrapper o una ruta no oficial.

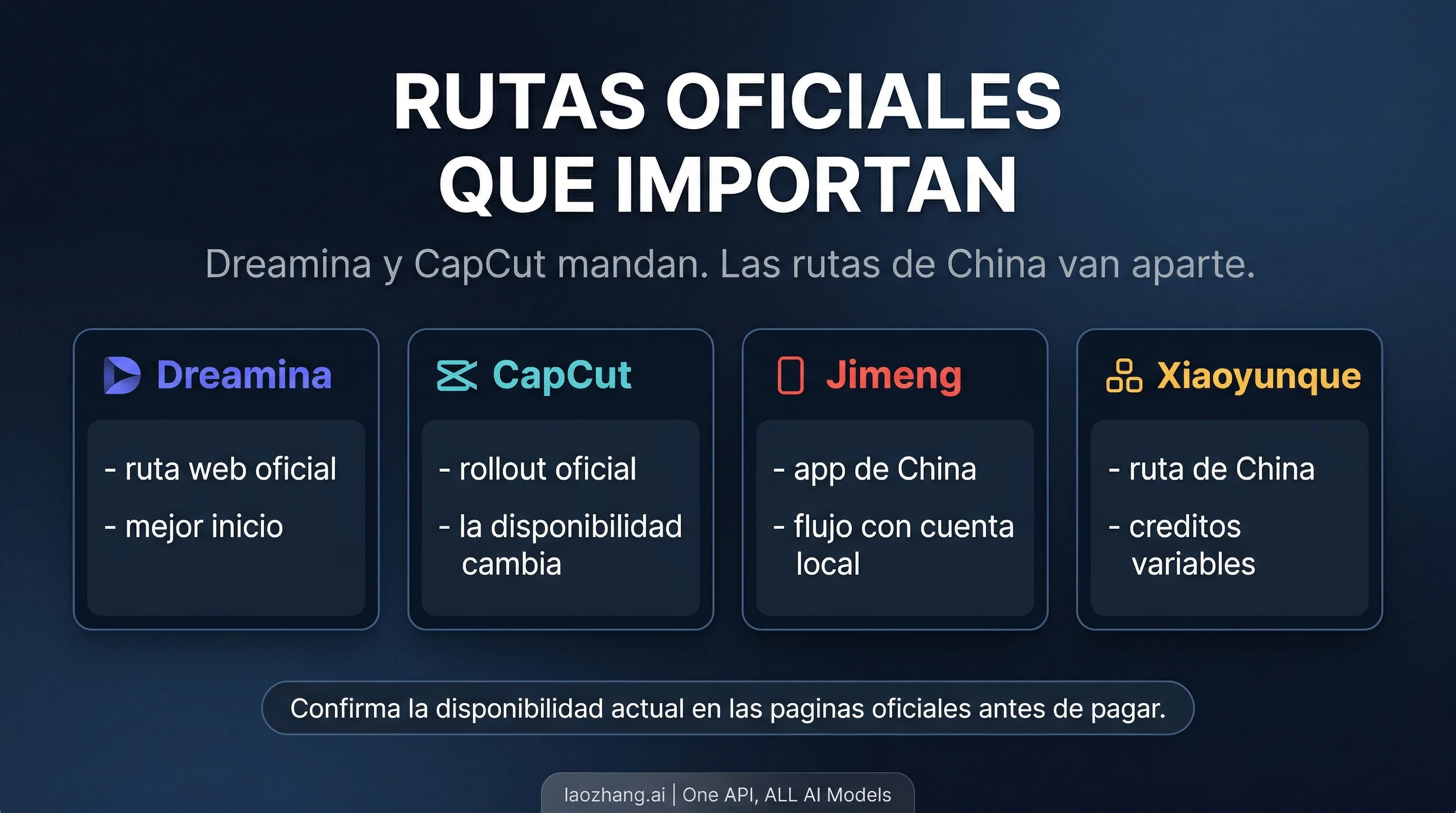

Si solo quieres acertar con el primer clic, el orden más seguro suele ser este: primero revisar Dreamina, después comprobar si la ruta de CapCut está abierta para tu cuenta y tu mercado; si para ti tiene sentido usar apps chinas, evaluarlas como una vía separada; y solo si las rutas oficiales no te sirven, tratar un tercero como fallback, no como equivalente del acceso oficial.

Qué ruta deberías abrir primero

La forma más rápida de decidir bien es no mezclar todas las páginas con online free como si ofrecieran el mismo contrato.

| Si necesitas… | Primer clic | Por qué es el movimiento más seguro | Qué debes asumir |

|---|---|---|---|

| La ruta web oficial más clara | Página oficial de Dreamina | Es la superficie oficial más fácil de verificar | El acceso real sigue dependiendo de la cuenta y del surface |

| Integrarlo en un flujo de edición que ya usas | Ruta de Seedance 2.0 dentro de CapCut | Es un camino oficial de CapCut, no un wrapper | El rollout depende de mercado y surface |

| Una vía china first-party que sí puedes usar | Jimeng o Xiaoyunque, solo si de verdad te encaja | Es una ruta real dentro del ecosistema ByteDance | Hay fricción de idioma, cuenta y región |

| Probar el modelo cuando la ruta oficial está cerrada | Un tercero solo como fallback | Puede servir para experimentar | No tiene la misma frontera de confianza que el acceso oficial |

Ese route board es la respuesta central de esta página. Lo demás solo sirve para que no confundas acceso oficial, entrada gratis limitada y páginas de terceros que prometen demasiado.

Qué entradas son realmente oficiales hoy

La historia del acceso oficial ya no cabe en un supuesto sitio único de Seedance. Para usuarios normales, las superficies importantes hoy son Dreamina y CapCut.

Dreamina sigue siendo la ruta web oficial más limpia

Si empiezas desde el navegador y quieres resolver primero la duda de legitimidad, Dreamina sigue siendo la mejor parada inicial. Sus páginas oficiales se presentan explícitamente como official website / official access surface, así que es el lugar más sencillo para confirmar que no has caído en un sitio imitador.

Eso no significa que Dreamina prometa acceso gratuito, ilimitado y estable para cualquier lector. La lectura prudente es otra: Dreamina es una ruta web oficial, pero el acceso concreto sigue siendo surface-specific y puede variar según la cuenta.

CapCut también es oficial, pero no es el mismo contrato

CapCut posiciona Seedance 2.0 como una herramienta online real y habla de web, desktop y mobile. La clave está en cómo lo comunica: el rollout ha sido por mercados, por fechas y por superficies, no como un lanzamiento global uniforme.

Por eso la frase correcta no es Dreamina y CapCut están abiertos igual para todos. La frase útil es: Dreamina y CapCut son dos rutas oficiales relacionadas, pero no equivalentes. Si ya trabajas dentro de CapCut, puede ser la vía más cómoda. Si tu prioridad es confirmar cuál es el acceso oficial más claro, Dreamina sigue siendo el primer clic más limpio.

Las apps chinas deben tratarse como un carril aparte

En español también aparecen artículos que meten Dreamina, CapCut, Jimeng, Xiaoyunque y páginas wrapper en un solo listado de formas de usar Seedance. Eso reduce demasiado la decisión real del lector.

Jimeng y Xiaoyunque forman una ruta china first-party. Puede ser práctica si para ti son realistas el idioma, el registro y la fricción regional. Pero no deberían presentarse como una simple variante escondida del mismo acceso web internacional.

Qué significa de verdad free

La palabra más engañosa en este espacio ahora mismo es free. Las páginas oficiales sí usan expresiones como try for free, pero eso no equivale a un contrato universal de uso gratis a largo plazo.

Lo más útil es separar free en cuatro casos distintos:

- una entrada limitada o de prueba dentro de una superficie oficial;

- un rollout que todavía depende de mercado, cuenta o capa de pago;

- una ruta local china con sus propias condiciones;

- una promesa publicitaria de un wrapper que suena más amplia que el nivel real de confianza.

La pregunta buena, por tanto, no es ¿Seedance 2.0 es gratis?, sino ¿esta ruta me da suficiente acceso con baja fricción para comprobar si Seedance 2.0 me sirve de verdad?.

Por eso esta página evita repetir de memoria cifras exactas de créditos o tablas de precios antiguas. Las páginas oficiales actuales no ofrecen una tabla universal y estable que cubra Dreamina, CapCut y el resto de rutas a la vez. Si tu decisión ya gira alrededor de precio y uso recurrente, es mejor saltar al pricing guide en inglés.

Qué hacer si la ruta oficial no está disponible

Muchos lectores no necesitan un ganador absoluto, sino una respuesta más concreta: probé la página oficial y ahora mismo no me deja entrar; ¿qué hago después?

Si quieres quedarte lo más cerca posible del acceso oficial

Antes de irte a un tercero, revisa otra vez Dreamina y CapCut. A menudo el mejor fallback no es otro servicio, sino otro surface oficial o la simple constatación de que el rollout todavía no te incluye de forma uniforme.

Si la ruta china first-party es realista para ti

Evalúala como una vía separada, no como una versión escondida del mismo acceso internacional. Si aceptas la fricción de idioma y región, puede ser útil. Si no, no deberías convertirla en la respuesta por defecto solo porque en papel parezca más barata.

Si aun así vas a usar un tercero

Aquí lo importante ya no es la comodidad, sino la calibración de confianza. Un tercero puede servir para probar el modelo, pero no hereda automáticamente la legitimidad de Dreamina o CapCut. Deberías comprobar al menos:

- quién opera la página;

- si el precio y la facturación son transparentes;

- si hay alguna señal de estabilidad real;

- si el sitio está presentando un fallback como si fuera acceso oficial.

La regla más útil es simple: si usas un tercero porque la ruta oficial hoy te resulta incómoda, entonces estás usando un fallback, no una ruta oficial.

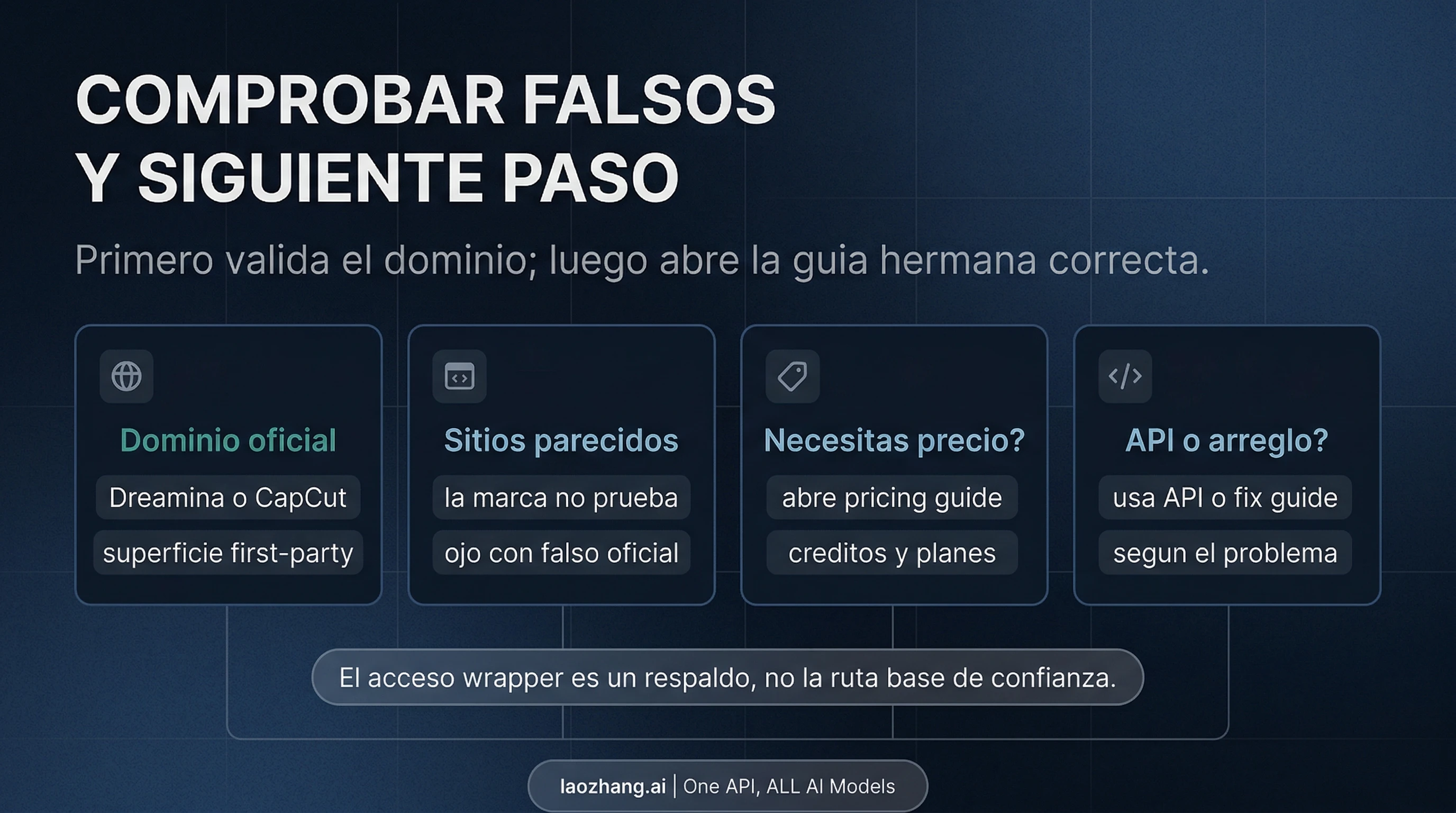

Verifica el dominio antes de hacer clic

Dreamina hace algo que muchos resultados del buscador no hacen: avisa de forma explícita de que seedance2.ai, seedance2.app y seedance.tv no son sitios oficiales de ByteDance. En el estado actual del buscador, eso no es una nota menor; es parte de la respuesta principal.

Si solo vas a hacer una comprobación antes de registrarte o pagar, que sea la del dominio:

- Confirma que sigues en una superficie de Dreamina, CapCut o ByteDance.

- No tomes el nombre

Seedancecomo prueba de oficialidad. - Ten más cuidado todavía con las páginas que prometen

free onlinesin decir claramente quién las opera.

Eso no significa que todo tercero sea automáticamente malicioso. Significa algo más concreto: la ruta oficial parte de la legitimidad y luego pregunta si está abierta para ti. La ruta no oficial parte de la utilidad y tiene que demostrar la legitimidad por separado. No conviene invertir ese orden.

Qué leer después

El trabajo de esta página termina cuando te ayuda a elegir ruta. No debería volver a convertirse en una mezcla de pricing guide, API guide y tutorial completo.

Si tu pregunta ya cambió, estos son los siguientes saltos útiles:

- si ahora comparas coste, pruebas gratis y uso recurrente, ve al pricing guide en inglés;

- si tu problema real es el acceso programático, ve al API guide en inglés;

- si la ruta es oficial pero la superficie falla o se comporta de forma rara, ve al troubleshooting guide en inglés;

- si la cuestión del acceso ya está resuelta y ahora quieres comparar familias de modelos, ve al comparison guide en inglés.

Esa separación es deliberada. Así esta página se mantiene como una guía de decisión sobre acceso online, no como otro tutorial completo genérico.

Preguntas frecuentes

¿Existe un sitio oficial de Seedance 2.0?

Sí, pero no en el sentido simplificado que sugieren muchos resultados. Seedance 2.0 es una tecnología oficial de ByteDance, pero el acceso online práctico para usuarios normales se reparte hoy entre Dreamina y CapCut.

¿Se puede usar Seedance 2.0 gratis?

Es posible encontrar una entrada gratis limitada o surface-specific, pero no conviene leer eso como un contrato universal de uso gratis a largo plazo. La interpretación más segura es que try for free significa un acceso acotado salvo que la propia superficie demuestre algo más.

¿seedance.tv es oficial?

No. Dreamina avisa explícitamente de que seedance.tv, seedance2.ai y seedance2.app no son sitios oficiales de ByteDance.

¿Qué hago si Dreamina o CapCut no están disponibles para mí?

Primero decide si prefieres esperar otro surface oficial, si una ruta china first-party es realista en tu caso o si aceptas un fallback no oficial con mayor coste de confianza. El siguiente paso correcto depende del tipo de fricción que aceptas.

¿Dónde miro precios, API y comparativas?

Para precios usa el pricing guide en inglés, para API el API guide en inglés, para problemas de acceso el troubleshooting guide en inglés y para comparar modelos el comparison guide en inglés.