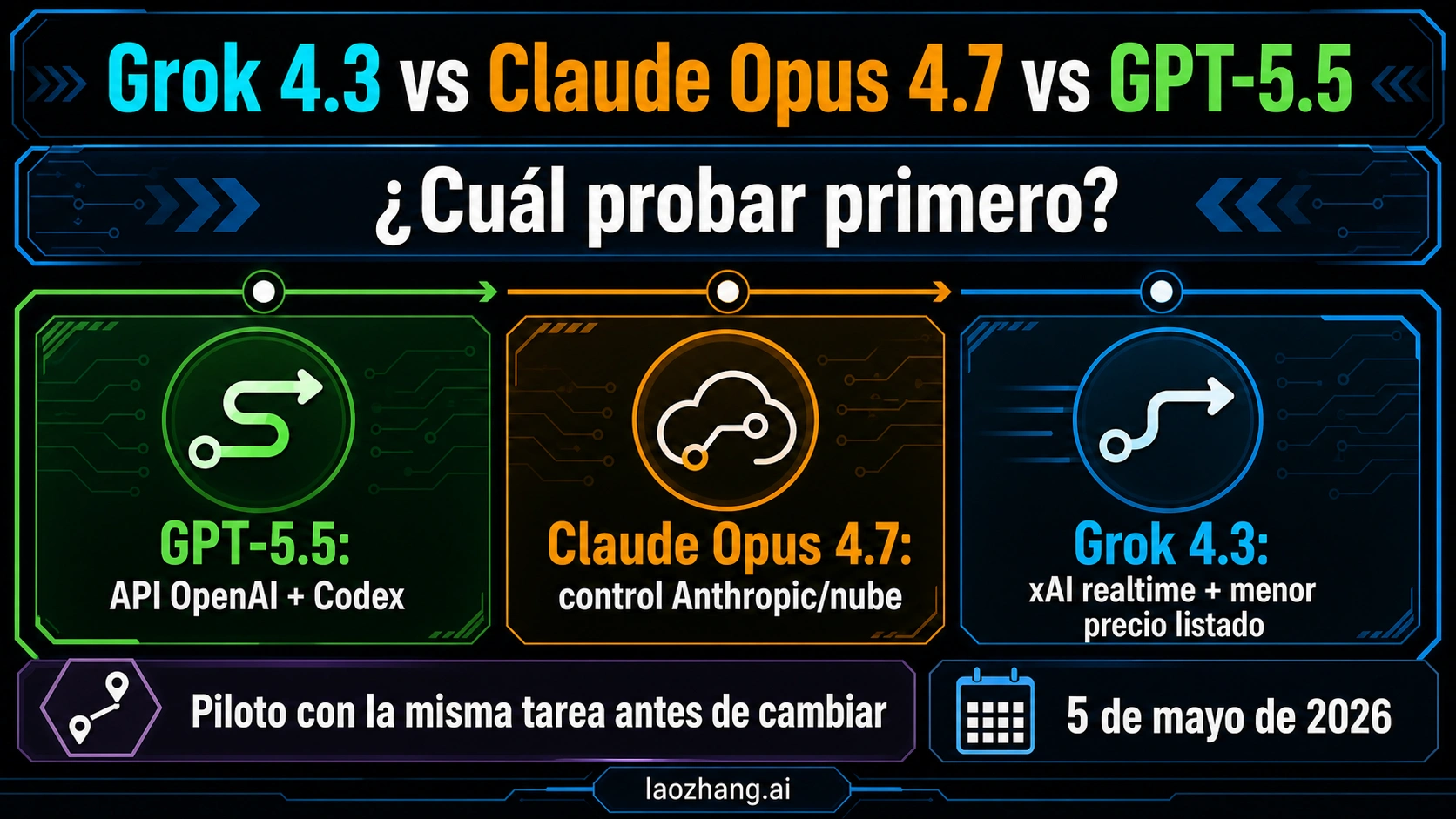

El 5 de mayo de 2026, la respuesta mas segura no es declarar un campeon unico. Es elegir la primera ruta que merece una prueba controlada. Prueba GPT-5.5 primero si tu stack ya es OpenAI-native: API de OpenAI, Responses API, Codex, herramientas, structured outputs o un harness de evaluacion de OpenAI. Mantén Claude Opus 4.7 como control premium si tu riesgo esta en agentes de codigo, rutas Anthropic o despliegue en cloud. Empieza por Grok 4.3 si la razon real es xAI, realtime/X search, menor precio listado o un piloto de contexto largo.

No cambies un default de produccion por un benchmark, un video o una impresion de lanzamiento. La comparacion solo sirve cuando usas el mismo prompt, los mismos archivos, las mismas herramientas, el mismo presupuesto, la misma rubrica y el mismo umbral de rollback.

| Ruta que probar primero | Cuando encaja | No asumas |

|---|---|---|

| GPT-5.5 | API de OpenAI, Responses API, Codex, tool-heavy reasoning, structured outputs o evals existentes. | Que acceso Codex, API key, precio API, credits y rate limits sean el mismo contrato. |

| Claude Opus 4.7 | Anthropic API, Claude products, Bedrock, Vertex AI, Microsoft Foundry o agentes de codigo de alto riesgo. | Que el control premium sea mas barato despues de salida, tokenizer, retries y review humano. |

| Grok 4.3 | Ruta xAI, realtime/X freshness, menor precio listado o experimento long-context. | Que el precio por token reemplace una prueba de coste por tarea completada. |

Empieza por la ruta que puedes llamar de verdad

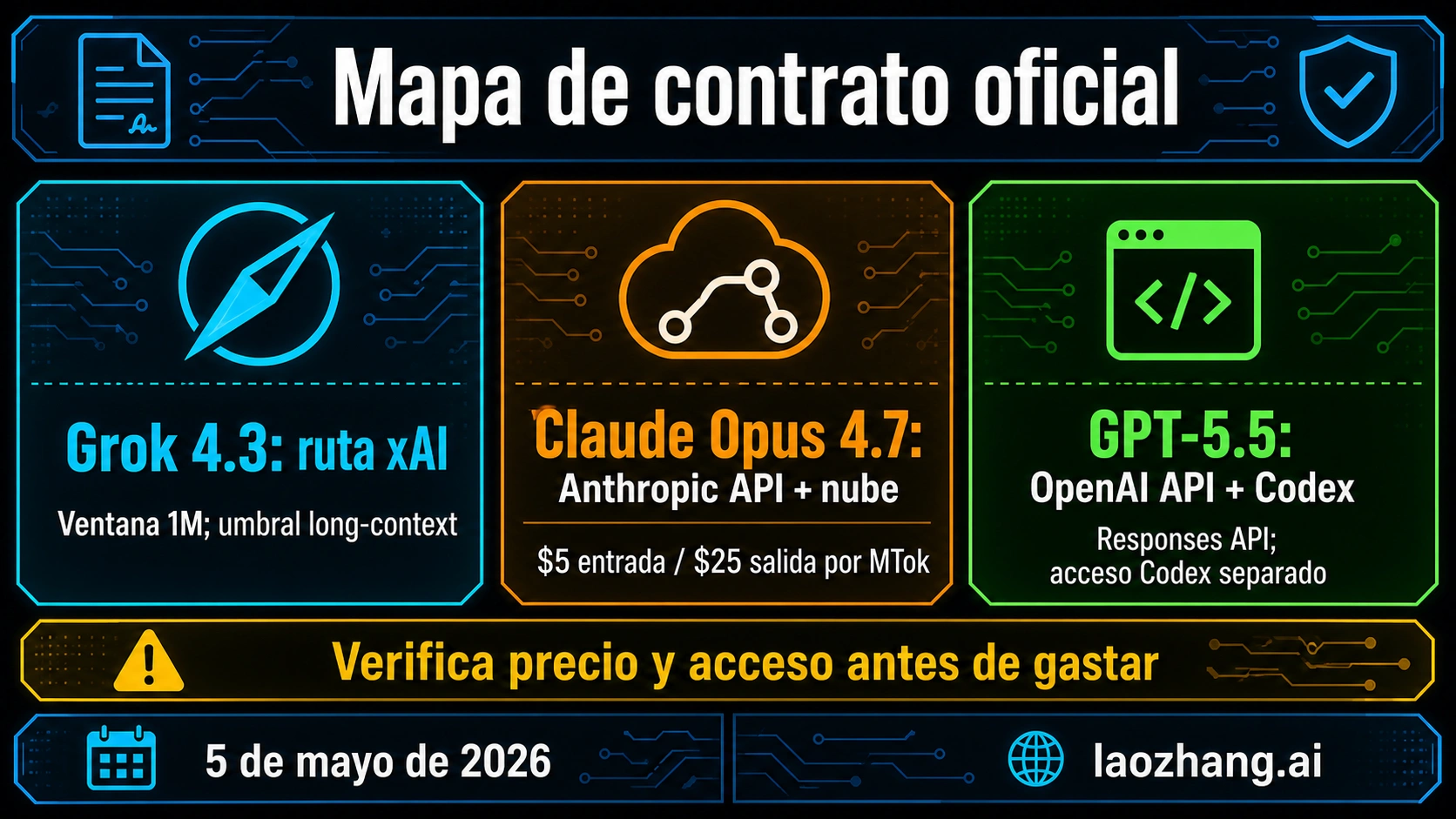

La comparacion util empieza por route ownership. OpenAI posee los hechos de GPT-5.5 API, Responses API y Codex. Anthropic posee Claude Opus 4.7 en Claude products, Anthropic API y las rutas cloud. xAI posee Grok 4.3, console visibility, aliases, server-side search tools, umbrales de contexto largo y disponibilidad de cuenta. Un articulo externo puede sugerir que probar, pero no debe decidir model ID, endpoint, pricing row, context limit o acceso de produccion.

| Punto de contrato | GPT-5.5 | Claude Opus 4.7 | Grok 4.3 |

|---|---|---|---|

| Route owner | OpenAI developer platform, Responses API, Codex | Anthropic API, Claude products, Bedrock, Vertex AI, Microsoft Foundry | xAI API, xAI Console, Grok docs, server-side search tools |

| Etiqueta a verificar | GPT-5.5 y snapshots fechados en docs de OpenAI | claude-opus-4-7 y cloud model IDs | grok-4.3, grok-4.3-latest o alias actual de consola |

| Mejor razon de primera prueba | Tools OpenAI-native, structured outputs, Codex, evals existentes | Control premium para coding agents y cloud deployment | xAI realtime/X search, menor precio listado, piloto long-context |

| Caveat de coste | Separa OpenAI API pricing de Codex credits. | Anthropic lista $5 input y $25 output por MTok con caveat de tokenizer. | Revisa consola xAI, aliases, umbral long-context y costes de search tools. |

| No mezclar | API route, login ChatGPT/Codex, API-key auth, credits, rate limits | Claude app, Anthropic API, cloud route, priority tier, tokenizer cost | Grok chat, xAI API, Web/X Search, aliases, region/account availability |

La guia de GPT-5.5 de OpenAI pertenece al contexto de Responses API: reasoning effort, verbosity, Structured Outputs, prompt caching, hosted tools, state handling y Agents SDK. Los docs de Codex tambien colocan GPT-5.5 como opcion frontier para coding complejo, computer use, knowledge work y research workflows. Para un equipo OpenAI-native, el valor esta en probar dentro de la misma superficie operativa que llevara produccion.

Los materiales de Anthropic para Opus 4.7 dicen que el modelo esta disponible en Claude products, Anthropic API, Amazon Bedrock, Google Vertex AI y Microsoft Foundry. El contrato publico incluye claude-opus-4-7, 1M context, $5 input y $25 output por millon de tokens, mas caveat de tokenizer. Por eso Opus funciona bien como control cuando los defectos severos, rollback y tiempo de review pesan mas que el precio bruto.

Grok 4.3 debe leerse junto con las search tools de xAI. Los eventos realtime requieren Web Search o X Search; no son memoria automatica del modelo base. Si la razon de probar Grok es realtime/X freshness, el piloto debe contar tool calls, search failures, citation quality y tool cost, no solo tokens de modelo.

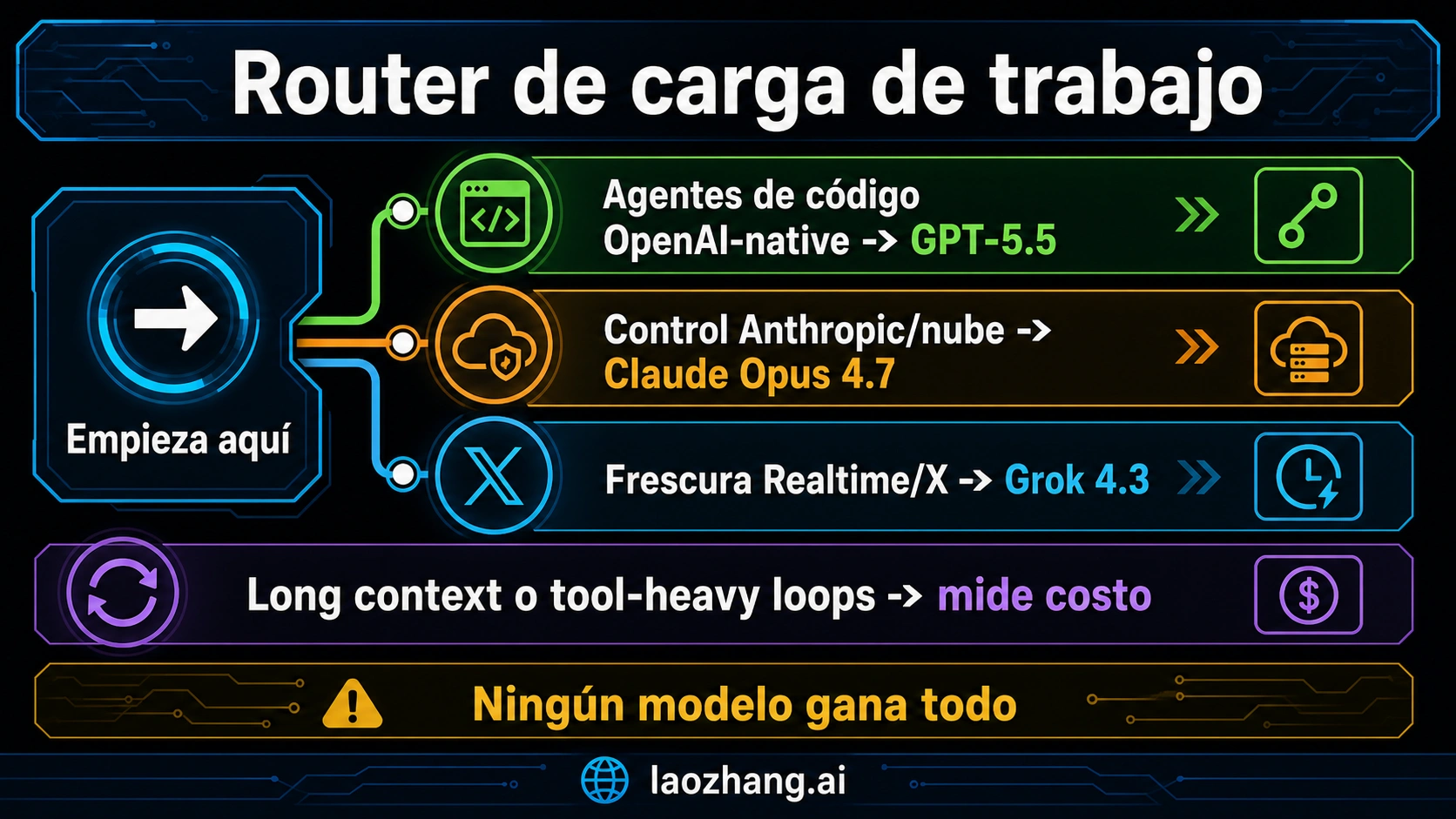

Que carga apunta a cada primera prueba

La pregunta limpia no es "que modelo es mejor". La pregunta util es "que ruta merece la primera prueba controlada para esta carga". Asi conviertes una pelea de benchmarks en un experimento desplegable.

| Carga | Primera ruta | Por que encaja | Que medir |

|---|---|---|---|

| OpenAI-native coding, Codex, Responses API tools, structured outputs | GPT-5.5 | Es la ruta mas cercana a OpenAI tooling, Codex workflow y evals existentes. | Accepted diffs, tool recovery, format stability, review time, token/credits. |

| Correctness-sensitive coding agents, multi-tool workflows, cloud deployment | Claude Opus 4.7 | Control premium Anthropic/cloud cuando fallar cuesta caro. | Defect severity, rollback, tool reliability, reviewer trust, latency. |

| Realtime or X-informed answers | Grok 4.3 | xAI posee Grok y las search tools que meten datos vivos en la peticion. | Freshness, tool count, search cost, citation quality, false freshness claims. |

| Repo, documento o analisis de evidencia long-context | Prueba por ruta | Los tres tienen historia de contexto largo, pero limites y precios cambian. | Truncation, recall, output length, long-context threshold, completed-task cost. |

| Exploracion sensible a presupuesto | Grok 4.3 primero, luego control con GPT-5.5 u Opus | El precio listado atrae si calidad y retries sostienen. | Success rate, retry count, p95 latency, repair time, accepted-result cost. |

| Cambio de default en produccion | Dual-run candidato contra incumbent | Una comparacion publica no mide tus prompts, files, tools, permisos ni coste de fallo. | Regressions, human minutes, cost, rollback success, user-visible failures. |

GPT-5.5 merece la primera prueba cuando el valor es integracion OpenAI-native. Si ya usas Responses API state, hosted tools, structured outputs, prompt caching, file search, computer use o Codex workflows, puedes observar GPT-5.5 dentro del mismo sistema operativo que correra produccion. Alli aparecen antes el format drift, tool failure, retry, latency y coste real.

Claude Opus 4.7 pertenece al carril de control premium. High-risk agents, migraciones de codigo, herramientas con permisos, review regulado y cloud deployment necesitan una referencia fuerte para saber si un candidato mas barato o mas rapido es seguro. Un precio listado mayor puede ser mas barato si evita defectos graves y largas rondas de review.

Grok 4.3 conviene con un motivo estrecho: xAI access, realtime/X freshness, lower listed price o long-context pressure. Si la tarea no necesita search tools, acceso xAI ni piloto de coste, Grok puede entrar en la comparacion, pero no deberia ganar el default automaticamente.

El coste necesita una comparacion de la misma superficie

Las filas de precio por token son solo el primer filtro. GPT-5.5 puede verse por OpenAI API pricing, account controls o Codex credits. Claude Opus 4.7 puede facturarse directo por Anthropic o por cloud providers. Grok 4.3 puede combinar model tokens con Web Search, X Search, aliases, long-context thresholds y account visibility. Mezclar esas superficies crea un ganador falso.

Para GPT-5.5, usa la fila actual de OpenAI API o consola si construyes un servicio API, y usa Codex credits solo si evaluas Codex. Un credit rate de Codex no reemplaza el precio token de un backend. Para Claude Opus 4.7, el caveat de tokenizer importa porque prompts largos, tool logs y repo context repetido cambian los tokens contados. Para Grok 4.3, el precio menor es una razon para testear, no una decision de rollout.

| Variable de coste | Por que cambia el ranking |

|---|---|

| Input y cached input | Prompts largos, repo context repetido y prompt caching cambian la factura. |

| Output length | Agentes que escriben mucho vuelven irrelevante una entrada barata. |

| Tool calls | Search, files, browser, computer use o custom tools pueden dominar el coste. |

| Retry rate | Un modelo barato pierde si necesita varios intentos. |

| Human review minutes | En coding agents, lo caro suele ser aceptar, reparar o revertir. |

| Rollback cost | Fallos raros pero graves pesan mas que el token medio. |

La metrica clave es successful-task cost: una respuesta aceptada, un diff mergeado, una accion correcta de agent o un analysis packet completo. Si Grok gana ese ledger, amplia la prueba. Si Opus evita fallos caros, su premium se justifica. Si GPT-5.5 reduce friccion en OpenAI-native workflows, puede ser la ruta operativa mas barata.

Lee los benchmarks como sugerencias de prueba

Benchmarks y videos son inputs utiles, pero no deben elegir el default. Coding-agent tests, browsing tasks, long-context recall, math, safety, visual reasoning y cost-per-score tables miden trabajos distintos. Un buen resultado de GPT-5.5 en un benchmark OpenAI-native es una razon para probar GPT-5.5 en tu harness, no una prueba de que Opus ya no sirve o de que Grok no pueda ser mas barato.

Lo mismo aplica al reves. Un launch claim de Anthropic es una razon para mantener Opus en el control lane, no para saltarse tu same-task harness. Un claim de precio o velocidad de Grok es una razon para montar un piloto medido, no para reemplazar high-risk coding work.

Usa una escalera de evidencia. Official docs deciden si la ruta existe, como se llama el modelo, que access surface aplica y donde verificar pricing o limits. Public benchmarks sugieren que workloads cubrir. Tu same-task harness decide si debe moverse traffic. Un staged rollout prueba si la mejora sobrevive usuarios reales, quotas, latency, permissions y failures.

Esta escalera evita el error comun: declarar un ganador absoluto con evidencia de una sola forma de tarea. La respuesta de ruta es mas estrecha. GPT-5.5 es la primera prueba OpenAI-native. Claude Opus 4.7 es el control premium Anthropic/cloud. Grok 4.3 es la ruta xAI para realtime, menor precio listado y pilotos long-context.

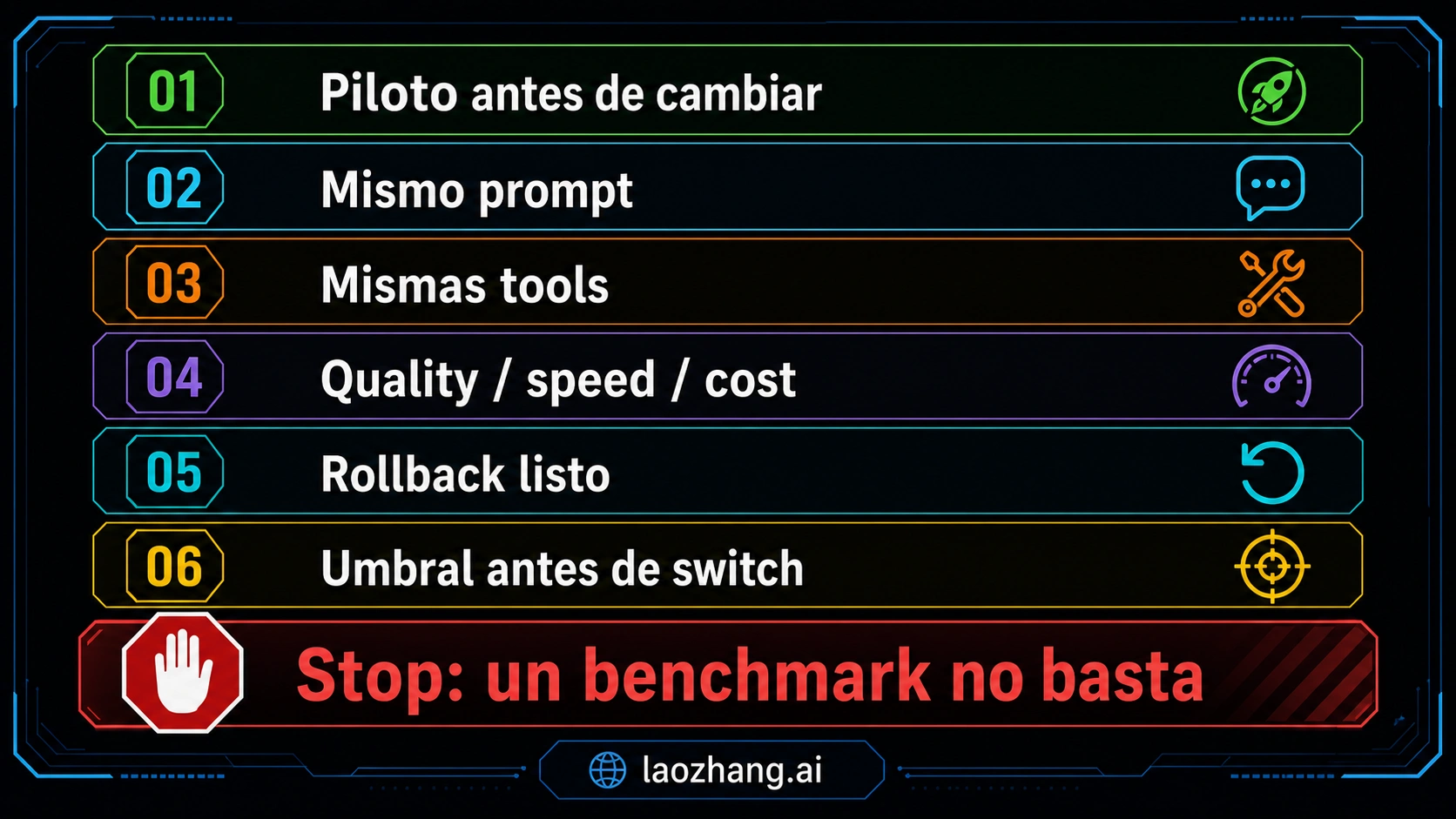

Antes de cambiar el default, ejecuta un piloto con la misma tarea

Un piloto puede ser pequeño, pero tiene que ser justo. No des a un modelo mejor prompt, mas contexto, output schema mas laxo o tool budget mas facil y luego lo llames comparacion.

| Pilot gate | Mantener constante | Condicion de pase |

|---|---|---|

| Route access | Model label, endpoint, account, region, quota, billing surface, fallback | El equipo puede llamar la ruta que desplegara. |

| Prompt and files | Mismo system prompt, user task, repo o document pack | La diferencia viene del modelo, no de mejores inputs. |

| Tool budget | Mismas tools, permissions, timeout, retry rule, search availability | El exito con herramientas es comparable. |

| Task sample | Easy, hard, long-context, strict-format, failure-prone tasks | La muestra refleja trabajo que cuesta dinero o review. |

| Scoring | Correctness, severity, security risk, format, reviewer minutes, accepted rate | El candidato reduce total work, no solo demo quality. |

| Cost and latency | Input, cached input, output, tools, retries, p95, completed-task cost | El ahorro sobrevive al full-task accounting. |

| Rollback | Failure threshold, fallback model, routing switch, monitoring owner | La ruta antigua puede volver sin reconstruir el sistema. |

Si ya tienes un default estable, mantén el incumbent y ejecuta el candidato en shadow. Promociona solo si reduce total work y no introduce un fallo nuevo de alta severidad. Si eliges primer modelo, empieza por la ruta del stack: GPT-5.5 para productos OpenAI-native, Opus para equipos Anthropic/cloud-heavy y Grok cuando realtime/X freshness o precio listado sea la razon real.

Decisiones cercanas

Esta pagina es estrecha: Grok 4.3 vs Claude Opus 4.7 vs GPT-5.5 como decision de primera prueba por ruta. Si tu decision es mas estrecha, usa la guia mas estrecha.

Si solo comparas OpenAI contra Anthropic, usa GPT-5.5 vs Claude Opus 4.7. Si necesitas el carril de coste DeepSeek en vez de xAI realtime/X freshness, usa DeepSeek V4 Pro vs Claude Opus 4.7 vs GPT-5.5. Si quieres un pool low-cost mas amplio, usa Kimi K2.6 vs DeepSeek V4 vs GPT-5.5 vs Claude Opus 4.7.

Si sigues comparando rutas frontier API anteriores, usa Claude Opus 4.7 vs GPT-5.4 vs Gemini 3.1 Pro. El principio es el mismo: elige la ruta que puedes llamar, mide la tarea que ejecutaras y conserva rollback path.

Preguntas frecuentes

GPT-5.5 es mejor que Claude Opus 4.7 y Grok 4.3?

GPT-5.5 es la mejor primera prueba cuando el sistema ya es OpenAI-native, sobre todo Responses API, Codex, tool-heavy reasoning, structured outputs o evals existentes. No es un ganador universal. Claude Opus 4.7 sigue siendo el control premium, y Grok 4.3 merece la primera prueba xAI cuando realtime/X search, precio o long-context pilot son la razon.

Grok 4.3 es mas barato que GPT-5.5 y Claude Opus 4.7?

Grok puede parecer mas barato en la fila listada de xAI, pero hay que revisar console visibility, long-context threshold, search-tool charges, retries, latency y accepted-result rate. Compara completed-task cost, no solo model tokens.

Deberia usar Claude Opus 4.7 para coding agents?

Usa Opus como control premium cuando fallar cuesta caro, la ruta Anthropic o cloud encaja y correctness importa mas que raw token price. Usa GPT-5.5 primero si el agent es OpenAI-native. Agrega Grok cuando realtime/X data, xAI access o menor precio listado sean centrales.

GPT-5.5 esta disponible por API?

OpenAI developer docs publican guidance de GPT-5.5 API y snapshots de GPT-5.5 en superficies developer. API access, Codex access, API-key authentication, credits, rate limits y organization visibility siguen separados. Verifica el modelo en tu cuenta antes de production traffic.

Grok 4.3 trae datos en vivo sin herramientas?

No. xAI docs dicen que realtime events requieren server-side search tools como Web Search o X Search. Si freshness es la razon para elegir Grok, incluye esas llamadas en coste, scoring y failure review.

Que modelo probar primero para long-context work?

Prueba la ruta que puedes desplegar. Los tres tienen large-context stories, pero limits, billing, thresholds, output behavior y recall quality difieren. Usa el mismo long prompt, retrieval pack, output budget y scoring rubric.

Cual es la regla mas segura para cambiar production?

No cambies por benchmark, launch claim o listed price gap. Ejecuta candidato e incumbent con los mismos prompts, tools, files, budgets, acceptance tests y rollback threshold. Promociona solo cuando un staged rollout reduzca total work.