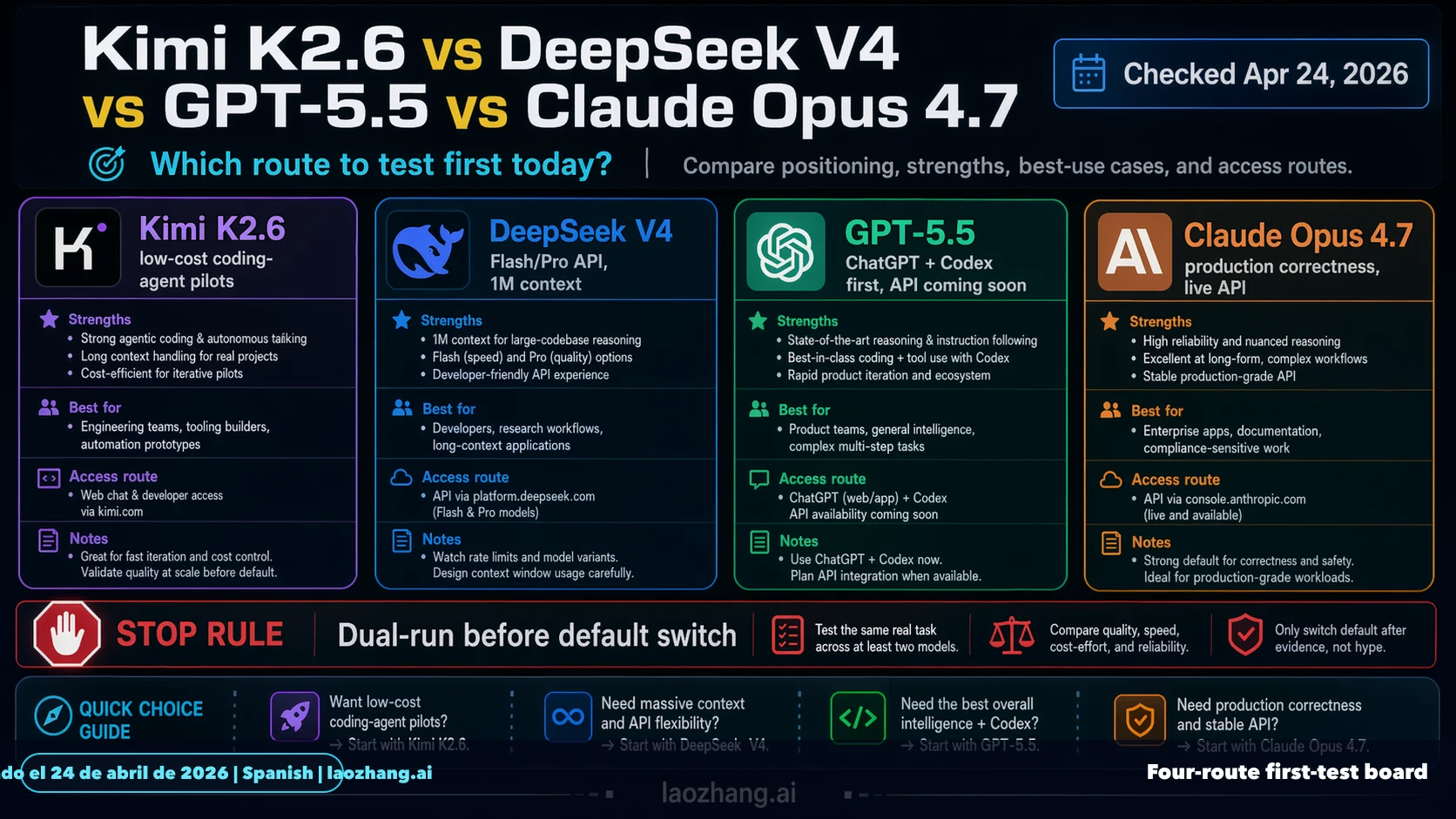

A 24 de abril de 2026, esta comparación debe girar alrededor de DeepSeek V4. Prueba Kimi K2.6 primero cuando el trabajo sea exploración barata con coding agents. Prueba DeepSeek V4 Flash o V4 Pro cuando necesites una ruta API barata y llamable hoy. Usa GPT-5.5 dentro de ChatGPT o Codex cuando el valor sea el flujo nativo de OpenAI. Mantén Claude Opus 4.7 primero cuando los defectos ocultos, el contexto largo y el costo de revisión importen más que el precio por token.

La regla práctica no es escoger el lanzamiento más ruidoso. Primero elige la ruta cuyo contrato oficial encaja con el trabajo; después ejecuta la misma tarea antes de cambiar defaults. El mismo repositorio, prompt, herramientas, pruebas, reviewer y umbral de rollback importan más que una captura de benchmark.

| Ruta | Cuándo probar primero | Límite actual | Regla de parada |

|---|---|---|---|

| Kimi K2.6 | Muchos intentos baratos, scaffolding y tareas de bajo riesgo. | Kimi documenta K2.6, precios en RMB, entrada multimodal y contexto de clase 256k. | No hacerlo default de producción sin victorias repetidas en el mismo flujo. |

| DeepSeek V4 | Necesitas la API actual de DeepSeek con precios bajos. | DeepSeek documenta deepseek-v4-flash/pro, 1M context y 384K max output. | No usar etiquetas antiguas como objetivo de despliegue. |

| GPT-5.5 | Trabajas dentro de ChatGPT o Codex. | OpenAI dice que GPT-5.5 está en ChatGPT y Codex, con API coming soon. | No inventar model ID ni precio de API. |

| Claude Opus 4.7 | Migraciones, código sensible, long context o alto costo de revisión. | Anthropic documenta claude-opus-4-7, 1M context y Opus pricing. | No cambiar sin same-task dual-run. |

Respuesta rápida

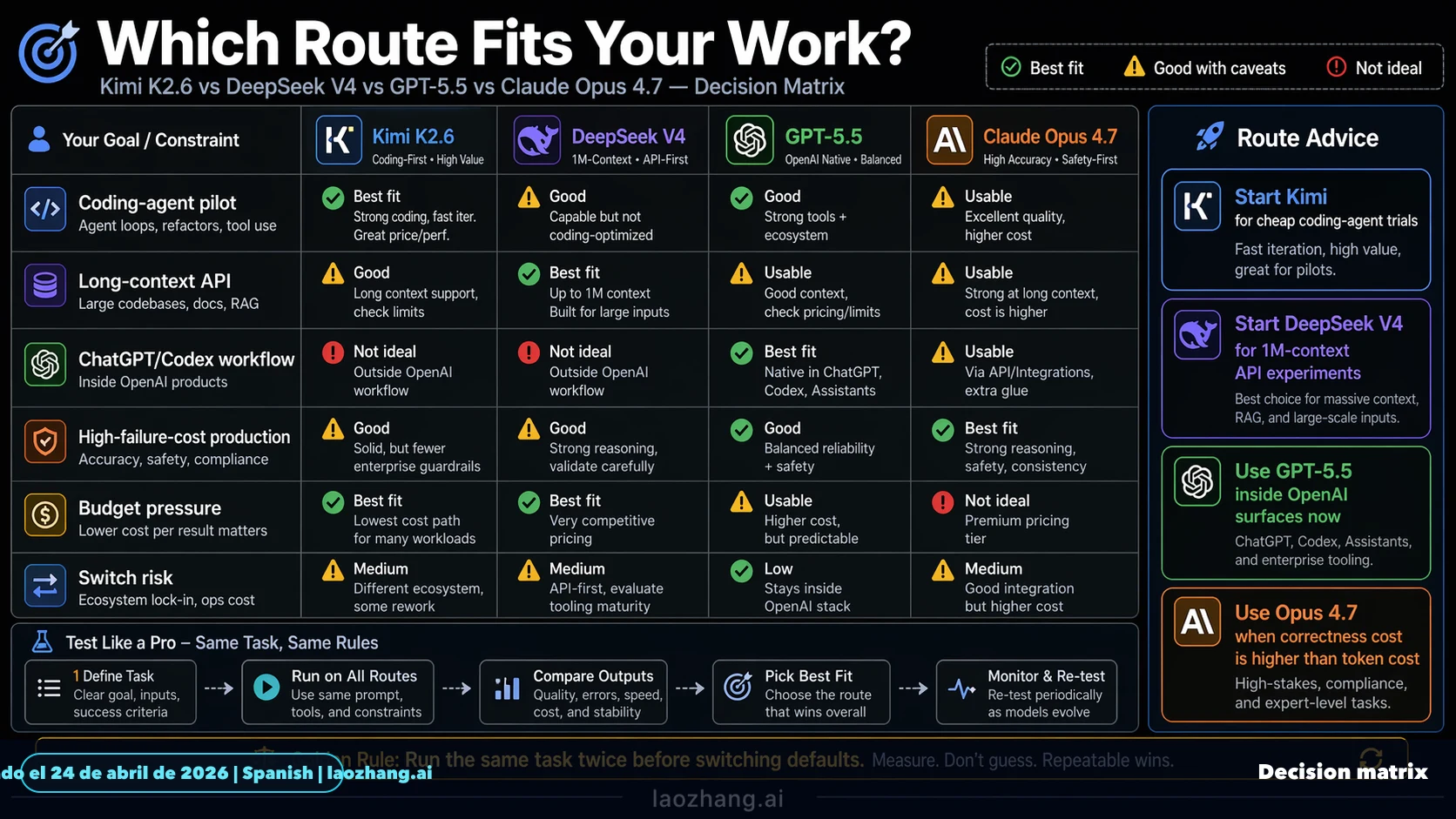

El primer modelo depende de la ruta. Kimi K2.6 es el cheap pilot route cuando necesitas más intentos y cobertura de bajo riesgo. DeepSeek V4 es la ruta DeepSeek que debes medir ahora porque Flash y Pro tienen filas actuales de API. GPT-5.5 vale primero dentro de ChatGPT y Codex, sobre todo si la experiencia de operación es parte del valor. Claude Opus 4.7 sigue siendo la ruta de control para trabajo donde un defecto oculto cuesta más que los tokens.

Esto no es una tabla de ganadores. Es una política de enrutamiento. Para trabajo masivo de bajo riesgo, empieza por Kimi y DeepSeek V4. Para una migración difícil, usa Opus como control. Para equipos que ya viven en Codex, mide GPT-5.5 en esa superficie antes de planear una migración de API.

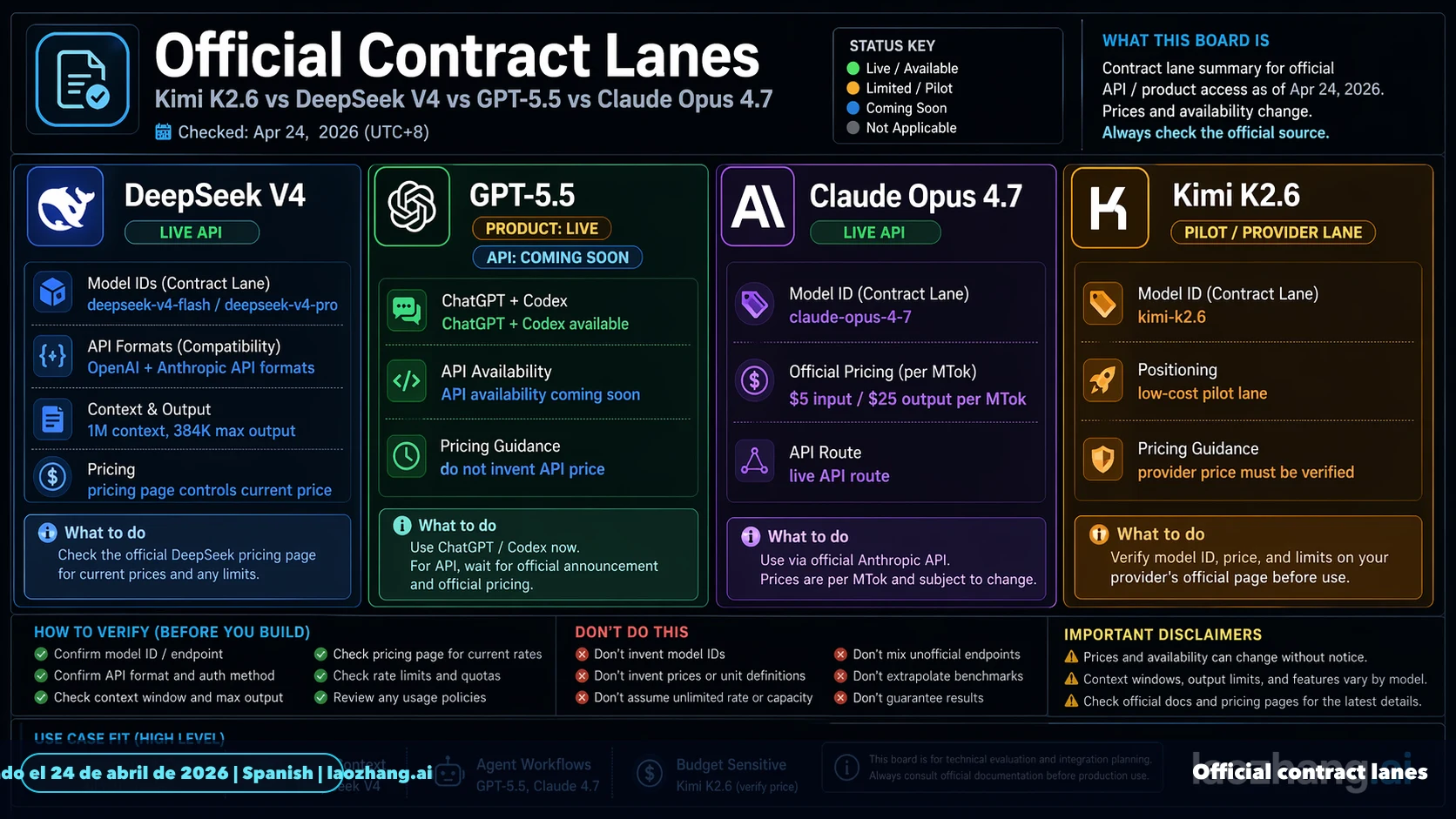

Rutas de contrato oficial

Los documentos oficiales mantienen la comparación limpia. Kimi describe K2.6 como su modelo más nuevo, con entrada de texto, imagen y video, y una ruta de contexto de clase 256k. DeepSeek muestra deepseek-v4-flash y deepseek-v4-pro, base URL en formato OpenAI y Anthropic, 1M context, 384K maximum output y precios para cache hit, cache miss y output. La guía actual de OpenAI sigue usando GPT-5.4 como referencia de API y dice que GPT-5.5 está disponible en ChatGPT y Codex con API availability coming soon. Anthropic lista Claude Opus 4.7 con 1M context y $5 input / $25 output por MTok.

| Contrato | Kimi K2.6 | DeepSeek V4 | GPT-5.5 | Claude Opus 4.7 |

|---|---|---|---|---|

| Dueño de ruta | Kimi platform | DeepSeek API | ChatGPT y Codex primero | Anthropic API y cloud |

| Etiqueta de despliegue | kimi-k2.6 | deepseek-v4-flash / deepseek-v4-pro | revisar cuando salga API | claude-opus-4-7 |

| Contexto | clase 256k | 1M, 384K max output | API context pendiente | 1M |

| Precio | página RMB de Kimi | página USD de DeepSeek | sin fila API de GPT-5.5 aún | página USD de Anthropic |

Fuentes verificadas el 24 de abril de 2026: lanzamiento de DeepSeek V4, precios de DeepSeek, precios de Kimi K2.6, guía de modelos recientes de OpenAI, resumen de modelos Claude y precios de Claude. Vuelve a comprobarlas antes de cambiar un default de producción.

Por qué DeepSeek V4 cambia la comparación

DeepSeek V4 no es solo un nombre nuevo. Le da a la ruta DeepSeek un model ID actual, una fila de precio, un contexto y una ruta de compatibilidad. Flash es el candidato barato; Pro es el candidato DeepSeek más fuerte cuando quieres seguir dentro del contrato DeepSeek antes de pagar economía Opus.

Por eso no conviene comparar un Kimi actual, una superficie OpenAI actual y una API Anthropic actual contra una etiqueta antigua de DeepSeek. La comparación justa es ruta actual contra ruta actual. Si un desarrollador puede llamar deepseek-v4-flash o deepseek-v4-pro hoy, esas son las filas que debe medir.

El precio es una señal de piloto, no de reemplazo

Los tokens baratos importan porque el trabajo agentic necesita retries, variantes y recovery. Pero una ejecución barata se vuelve cara si crea defectos ocultos, revisión manual, tool loops o rollback work. La unidad real es una tarea aceptada después de revisión.

| Costo | Qué registrar | Para qué sirve |

|---|---|---|

| Token cost | input, cache hit, cache miss, output, retries, tool calls | muestra la factura real |

| Quality cost | blocker, major, minor, format misses | muestra si el resultado sirve |

| Time cost | latency, queue, reviewer minutes, reruns | detecta costo trasladado a humanos |

| Integration cost | model ID, auth, context behavior, tool behavior, billing owner | evita un default frágil |

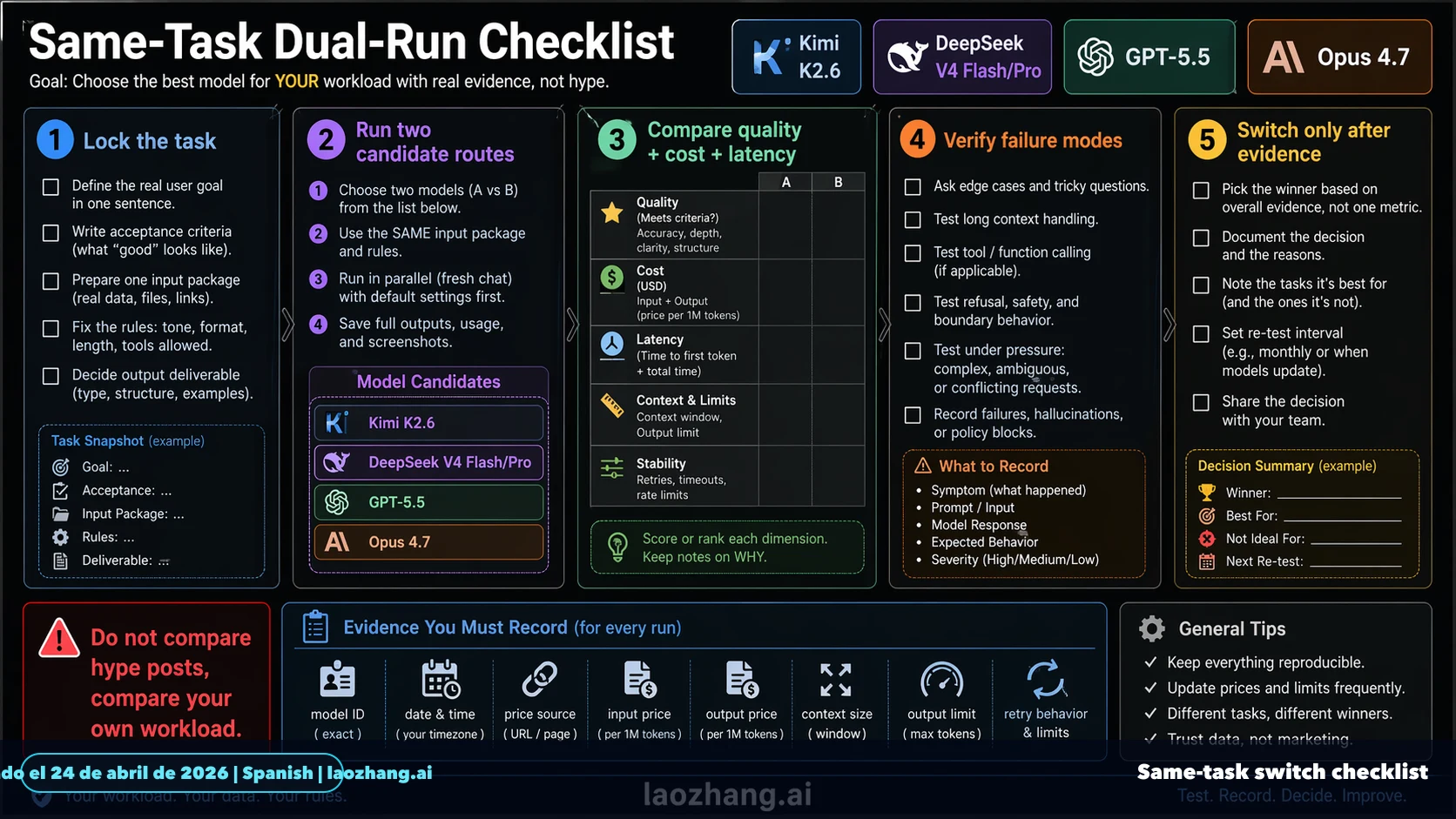

Checklist de same-task pilot

Cambiar el modelo por defecto es un cambio de producción. Elige cinco a diez tareas reales: un bug pequeño, un refactor, una tarea de pruebas, un análisis de contexto largo y una tarea ambigua. La ruta candidata y el default actual deben usar el mismo repo snapshot, spec, tools, timeout, test command y reviewer.

Fija los umbrales antes de correr. Un blocker detiene la promoción. Tres major defects dejan la ruta en pilot mode. Reviewer time por encima de 2x suele significar que el ahorro de tokens se movió a trabajo humano. Inestabilidad de herramientas o formato significa que la ruta puede funcionar en chat, pero fallar como agent default.

Cómo decidir si ya usas una ruta

Si ya usas Kimi, añade DeepSeek V4 Flash y Pro al cheap-route pool y conserva Opus como high-risk control. Si ya usas DeepSeek, actualiza primero el harness a V4 model IDs. Si ya usas OpenAI API, aprende de GPT-5.5 dentro de ChatGPT y Codex, pero espera el official API contract para server routing. Si ya usas Claude Opus 4.7, mantenlo para migraciones, correctness-sensitive work y long context mientras las rutas baratas se prueban en clases de bajo riesgo.

Para decisiones más estrechas, usa Kimi K2.6 vs Claude Opus 4.7 y GPT-5.5 vs Claude Opus 4.7.

Preguntas frecuentes

DeepSeek V4 es la keyword correcta ahora?

Sí. DeepSeek V4 Flash y Pro son las filas actuales de API, así que DeepSeek V4 debe ser el tema del título y de la decisión de despliegue.

GPT-5.5 está disponible por API?

Trátalo como live en ChatGPT y Codex. Para production API, espera model ID, price row, limits y tool behavior oficiales.

Qué ruta debe probar primero un equipo de coding agents?

Kimi para volumen barato de bajo riesgo, DeepSeek V4 para API llamable barata, GPT-5.5 dentro de Codex para flujo OpenAI-native y Opus 4.7 para correctness de alto riesgo.

DeepSeek V4 puede reemplazar a Claude Opus 4.7?

No solo por precio. DeepSeek V4 puede ganar workloads baratos de API, pero Opus sigue siendo control route cuando el costo de falla oculta domina.

Cuál es la regla de cambio más segura?

Same-task dual-run y promoción solo tras victorias repetidas en accepted diff, defect severity, reviewer time, latency, retry cost y rollback risk.