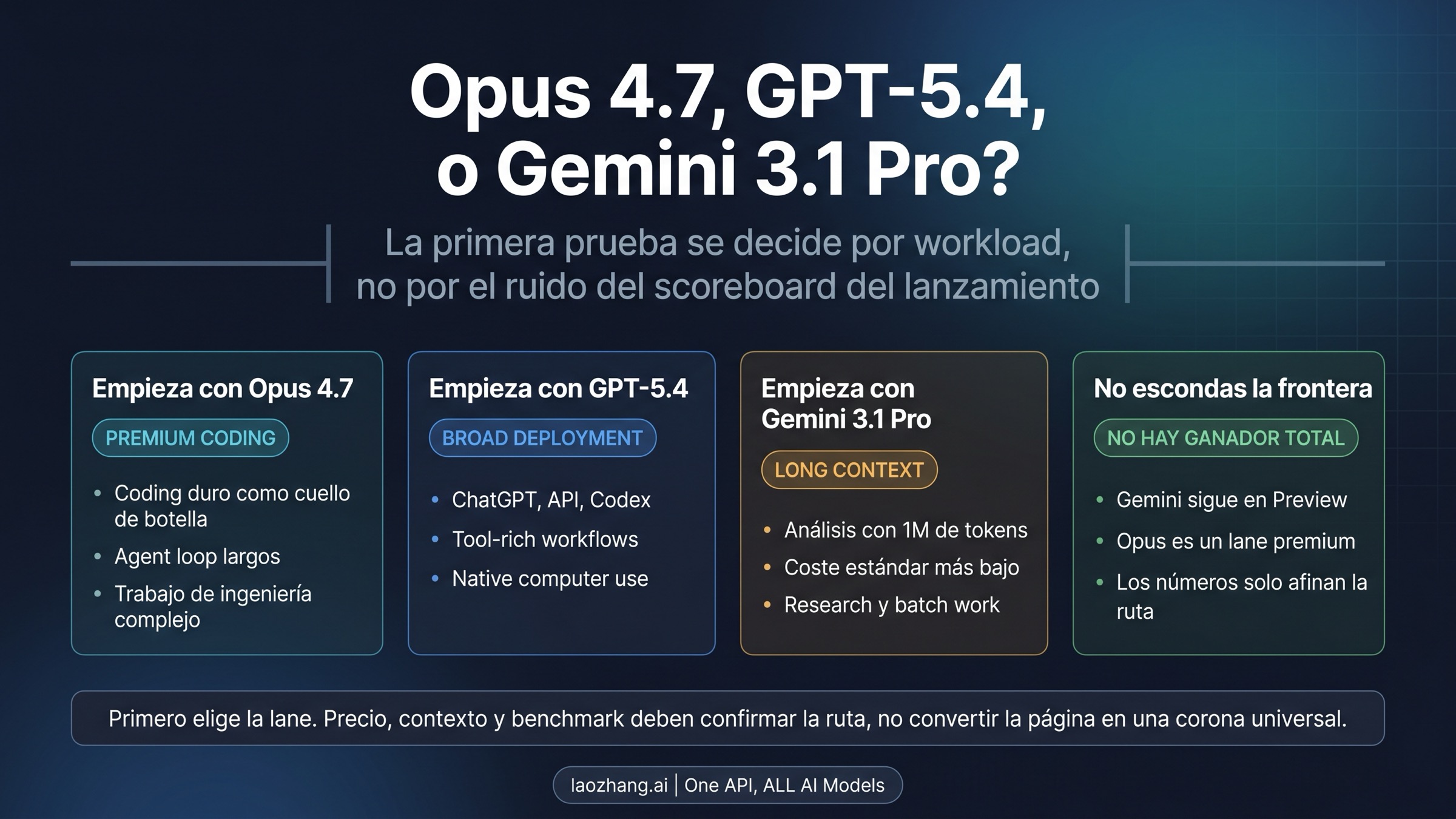

La pregunta útil ahora no es cuál de estos tres modelos gana un ranking universal, sino con cuál conviene hacer la primera prueba seria según tu trabajo real.

Si tu cuello de botella está en coding duro, agentes largos y software engineering complejo, lo más lógico es empezar por Claude Opus 4.7. Si lo que más pesa es una ruta desplegable ya viva entre ChatGPT, la API y Codex, entonces GPT-5.4 suele ser el mejor primer paso. Si tu trabajo depende sobre todo de contexto muy largo, documentos enormes, codebases grandes y una economía de tokens más favorable, Gemini 3.1 Pro merece ir primero.

A fecha de 18 de abril de 2026, estas tres rutas siguen siendo distintas. Gemini 3.1 Pro todavía es Preview, GPT-5.4 ya existe como contrato amplio en varias superficies de OpenAI y Opus 4.7 sigue siendo la ruta premium de Anthropic para coding complejo y agentic work. Por eso el orden correcto no es benchmark primero. Es workload primero.

La respuesta rápida

Separar la primera prueba por carga real aclara más que cualquier scoreboard.

| Si tu problema real se parece a este | Qué conviene probar primero | Por qué gana esa ruta al inicio | Qué frontera no deberías olvidar |

|---|---|---|---|

| Coding complejo, agentes largos, trabajo de ingeniería difícil | Claude Opus 4.7 | Anthropic lo posiciona hoy de forma más clara como ruta premium para software engineering y workflows agentic | Es una ruta de precio premium y el coste real puede crecer por el remapeo de tokens |

| Despliegue amplio, herramientas, trabajo repartido entre varias superficies OpenAI | GPT-5.4 | Tiene la superficie viva más completa entre ChatGPT, API y Codex | Más desplegable no significa mejor por defecto para premium coding o long-context economics |

| Análisis con millón de tokens, documentos enormes, codebases grandes, sensibilidad al coste | Gemini 3.1 Pro | Google deja muy claro su papel de ruta de contexto largo y coste estándar más bajo | Sigue siendo Preview y esa frontera debe quedar visible desde el principio |

Ese cuadro resume la tesis completa. Aquí no eliges una corona eterna. Eliges la primera ruta que merece una evaluación real. Si tu necesidad aún es difusa y solo puedes hacer una pasada amplia, GPT-5.4 suele ser el punto de partida más seguro. Pero si el trabajo ya es obviamente heavy coding o claramente long-context, ese default intermedio retrasa la decisión correcta.

Por qué conviene mirar primero Claude Opus 4.7

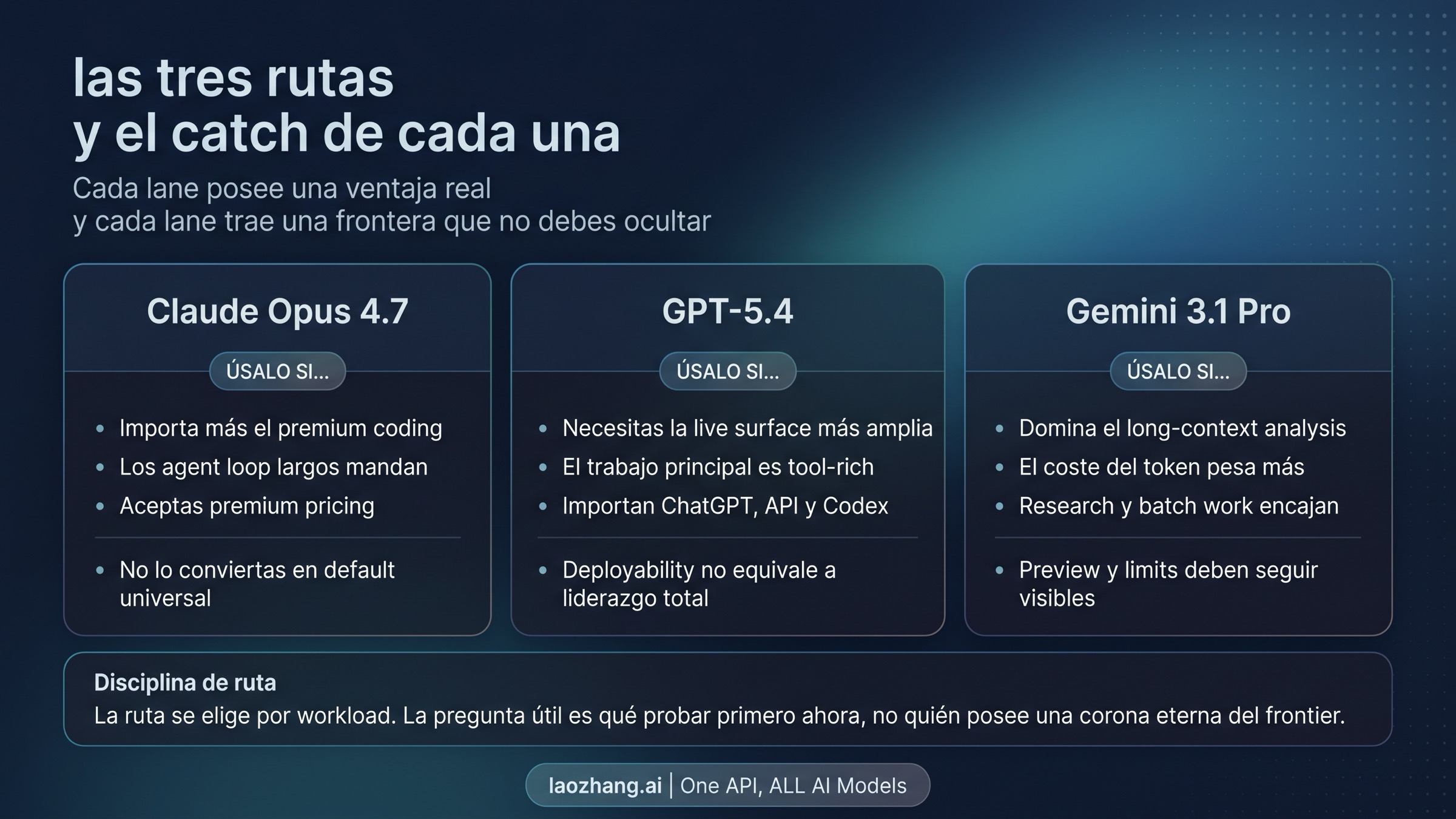

La ventaja de Opus 4.7 no es una etiqueta vaga tipo “más inteligente”. La ventaja está en que Anthropic lo describe hoy de forma muy explícita como ruta premium para professional software engineering y complex agent workflows. Su página actual de producto mantiene esa lectura y además no lo deja encerrado en una sola superficie. Para una evaluación seria, eso importa más que cualquier frase de marketing.

La segunda razón es el tipo de control que ofrece para trabajo largo. Anthropic mantiene 1M de contexto y añade xhigh effort junto con task budgets en beta. Eso no es un adorno para chat casual. Es exactamente el tipo de palanca que interesa cuando un modelo trabaja como operador de una secuencia compleja y no como un simple generador de una respuesta suelta.

La frontera de coste también tiene que ir en el mismo párrafo. El precio oficial sigue en 5 dólares por millón de tokens de entrada y 25 por los de salida, pero Anthropic avisa de que la misma entrada puede convertirse en aproximadamente 1.0x-1.35x más tokens según el contenido. Por tanto, Opus 4.7 hay que leerlo como una ruta premium de coding que puede merecer la pena, no como un reemplazo neutro y gratis del resto.

Si después de esto tu decisión real ya no es tri-modelo sino “¿cambio ya desde 4.6 o mantengo una control route?”, la página correcta es Claude Opus 4.7 vs Claude Opus 4.6.

Por qué conviene mirar primero GPT-5.4

GPT-5.4 gana cuando lo que más importa es la amplitud del contrato vivo. OpenAI lo tiene ahora mismo en ChatGPT, la API y Codex, y además lo acompaña con native computer use, tool search y hasta 1M de contexto. Para muchos equipos, la primera prueba no se decide por la línea más bonita del benchmark, sino por qué modelo se convierte antes en software que funciona.

Eso vuelve especialmente fuerte a GPT-5.4. Puedes prototipar en ChatGPT, pasar la carga a la API y ejecutar flujos operatorios en Codex sin cambiar de familia. Ese tipo de continuidad entre superficies es justo lo que hace que esta ruta sea tan buena como primer filtro cuando la organización aún está afinando por dónde quiere desplegar.

Los números públicos de OpenAI encajan mejor leídos así. OSWorld, BrowseComp, GDPval o GPQA Diamond son útiles no para declarar que GPT gana todo, sino para sostener que hoy es la ruta deployable más amplia para trabajo profesional mixto con herramientas.

Su límite también debe permanecer visible. La mayor amplitud de despliegue no demuestra por sí sola liderazgo en premium coding ni en economía de contexto largo. Si lo que realmente define el éxito en tu caso es hardest coding, Opus 4.7 merece ir primero. Si manda el coste con contexto enorme, Gemini 3.1 Pro merece ir primero.

Por qué conviene mirar primero Gemini 3.1 Pro

Gemini 3.1 Pro se vuelve la mejor primera prueba cuando contexto largo y economía de tokens pesan más que la amplitud del despliegue. La página actual del modelo lo sigue presentando como gemini-3.1-pro-preview y deja por escrito 1.048.576 tokens de entrada y 65.536 de salida. Para documentos enormes, repositorios grandes o síntesis de investigación, esa escala no es un detalle secundario. Es una decisión de ruta.

La estructura de precio refuerza esa lectura. Google muestra hoy 2 dólares de entrada y 12 de salida hasta 200k tokens, y 4 y 18 por encima de ese umbral. Eso cambia la evaluación inicial cuando el trabajo depende de prompts largos, análisis extensos o lotes grandes donde el coste estándar por token sí importa.

Que sea Preview no invalida la ruta, pero sí obliga a escribirla con honestidad. La formulación correcta es esta: si tu trabajo está dominado por contexto largo y coste, Gemini 3.1 Pro puede ser la mejor primera prueba; simplemente debes aceptar límites más estrictos y una madurez más baja. La propia documentación de rate limits de Google sigue recordando que las preview models tienen más restricciones.

Por eso Gemini no debería quedar reducido a una línea secundaria dentro de la comparación. En algunos workloads es la ruta principal desde el primer minuto.

Qué cambian de verdad las pruebas compartidas

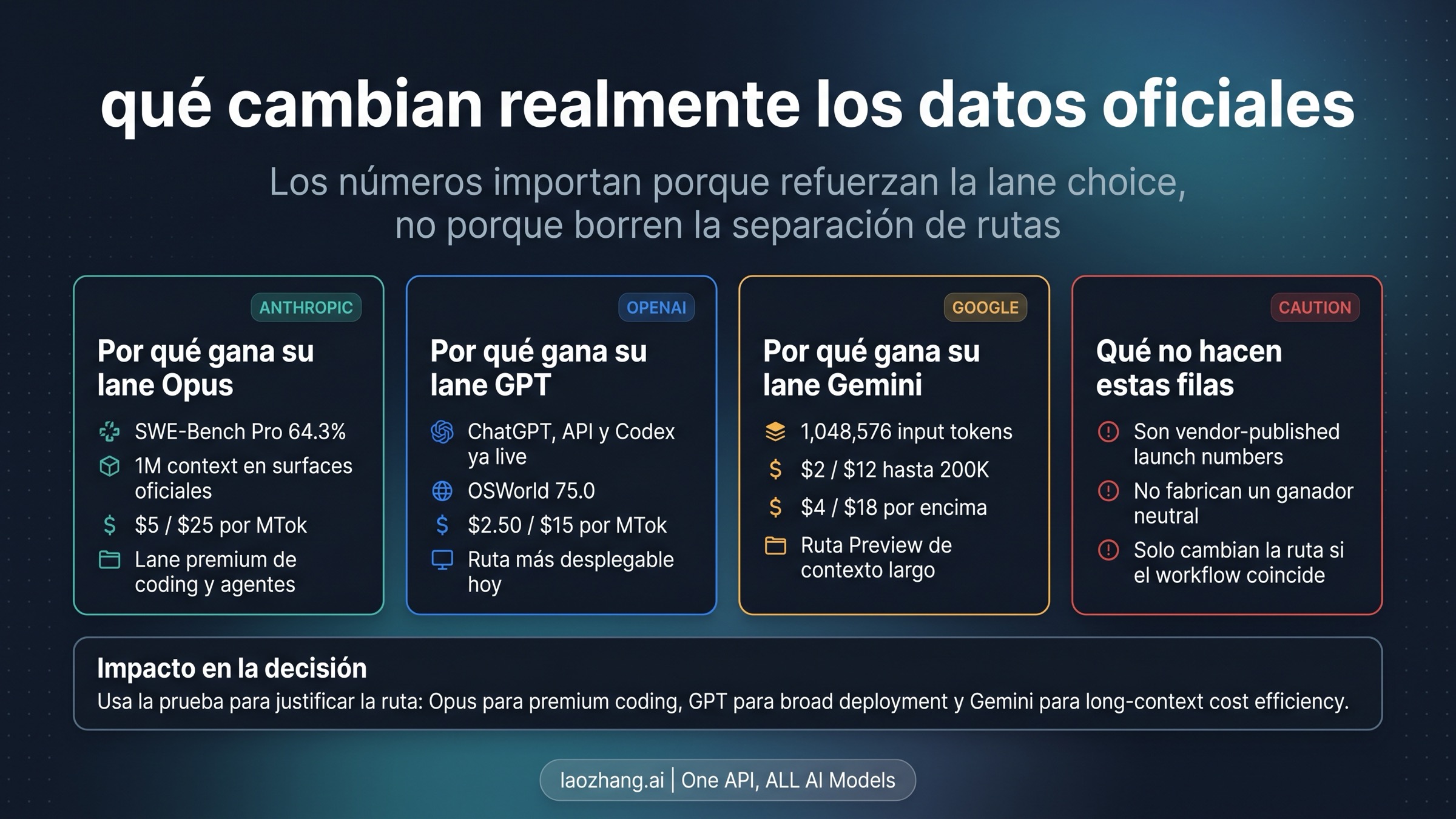

El primer error habitual consiste en aplastar todas las cifras públicas de Anthropic, OpenAI y Google en un leaderboard supuestamente neutral. Cada proveedor subraya fortalezas distintas y buena parte de esas cifras son vendor-published launch evidence. No por eso dejan de servir. Lo que cambia es cómo deben leerse: como material para reforzar la elección de ruta, no como una coronación definitiva.

El segundo error es ignorar la superficie contractual y leer solo números. Lo más fuerte de GPT-5.4 no es una métrica aislada, sino la combinación ChatGPT + API + Codex. Lo más fuerte de Gemini no es una sola línea de benchmark, sino el contexto masivo unido al coste estándar más bajo. Lo más fuerte de Opus 4.7 no es una etiqueta de inteligencia general, sino la ruta premium para coding y trabajo agentic de alto valor.

| Pregunta de decisión | Claude Opus 4.7 | GPT-5.4 | Gemini 3.1 Pro |

|---|---|---|---|

| Qué señal oficial define mejor la ruta | Posicionamiento premium de Anthropic para software engineering y agent work con 1M de contexto | Contrato vivo en ChatGPT, API y Codex con computer use nativo | 1.048.576 tokens de entrada y estructura de precio de contexto largo |

| Qué número sostiene mejor la ruta | SWE-Bench Pro 64.3, 1M de contexto y precio 5/25 | OSWorld 75.0, 1M de contexto y 2.50/15 | 2/12 y 4/18, más la escala de un millón de tokens |

| Qué frontera cambia la elección | Precio premium y posible deriva de coste real | Más despliegue no equivale a liderazgo universal | Preview y límites más estrictos |

La lectura útil, por tanto, es muy simple. Primero eliges la ruta y después usas la prueba para confirmar la decisión. Si inviertes el orden, acabas persiguiendo la fila más brillante en lugar del primer test correcto.

Qué leer después cuando la decisión se estrecha

Esta comparación de tres modelos solo sigue siendo útil mientras actúe como front door. Cuando la ruta probable ya está clara, la mejor experiencia para el lector es pasar a la página más estrecha que sí posee ese trade-off.

- Si tu duda real ya es interna a Anthropic y gira en torno a upgrade, control route y coste real, sigue con Claude Opus 4.7 vs Claude Opus 4.6.

- Si el dilema es despliegue amplio frente a economía de contexto largo, pasa a la guía en inglés GPT-5.4 vs Gemini 3.1 Pro.

- Si la decisión es premium coding frente a contexto largo y coste, sigue con Gemini 3.1 vs Claude Opus 4.6.

No merece la pena meter todos los detalles pairwise otra vez en una sola comparativa tri-modelo. Lo útil es acelerar la primera elección y dejar el trade-off profundo al sibling correcto.

FAQ

Si el workload aún es difuso, con qué modelo conviene empezar normalmente

Si solo puedes hacer una pasada amplia, GPT-5.4 suele ser el punto de partida más seguro porque hoy tiene la superficie desplegable más completa. Pero eso no lo convierte en un ganador universal. Si el cuello de botella ya es claramente premium coding, empieza por Opus 4.7. Si ya es claramente contexto largo con sensibilidad al coste, empieza por Gemini 3.1 Pro.

¿Que Gemini 3.1 Pro siga en Preview significa que no conviene probarlo primero?

No. Significa que hay que usarlo con honestidad. Preview implica límites más estrechos y menor madurez, no que deje de ser la mejor primera ruta cuando el trabajo está dominado por contexto largo y economía de tokens.

¿Claude Opus 4.7 siempre compensa su ruta de precio premium?

No. Compensa como primera prueba cuando premium coding, agentes largos y trabajo complejo de ingeniería son el verdadero cuello de botella. Si lo más importante es la superficie desplegable, GPT-5.4 encaja mejor. Si lo más importante es la economía con contexto largo, Gemini encaja mejor.

¿Se pueden leer los benchmarks como una tabla neutral y completamente comparable?

No del todo. Lo útil es tratarlos como pruebas públicas de lanzamiento que apuntan hacia una ruta. Eso basta para una decisión route-first. No basta para justificar un veredicto eterno de mejor modelo global.