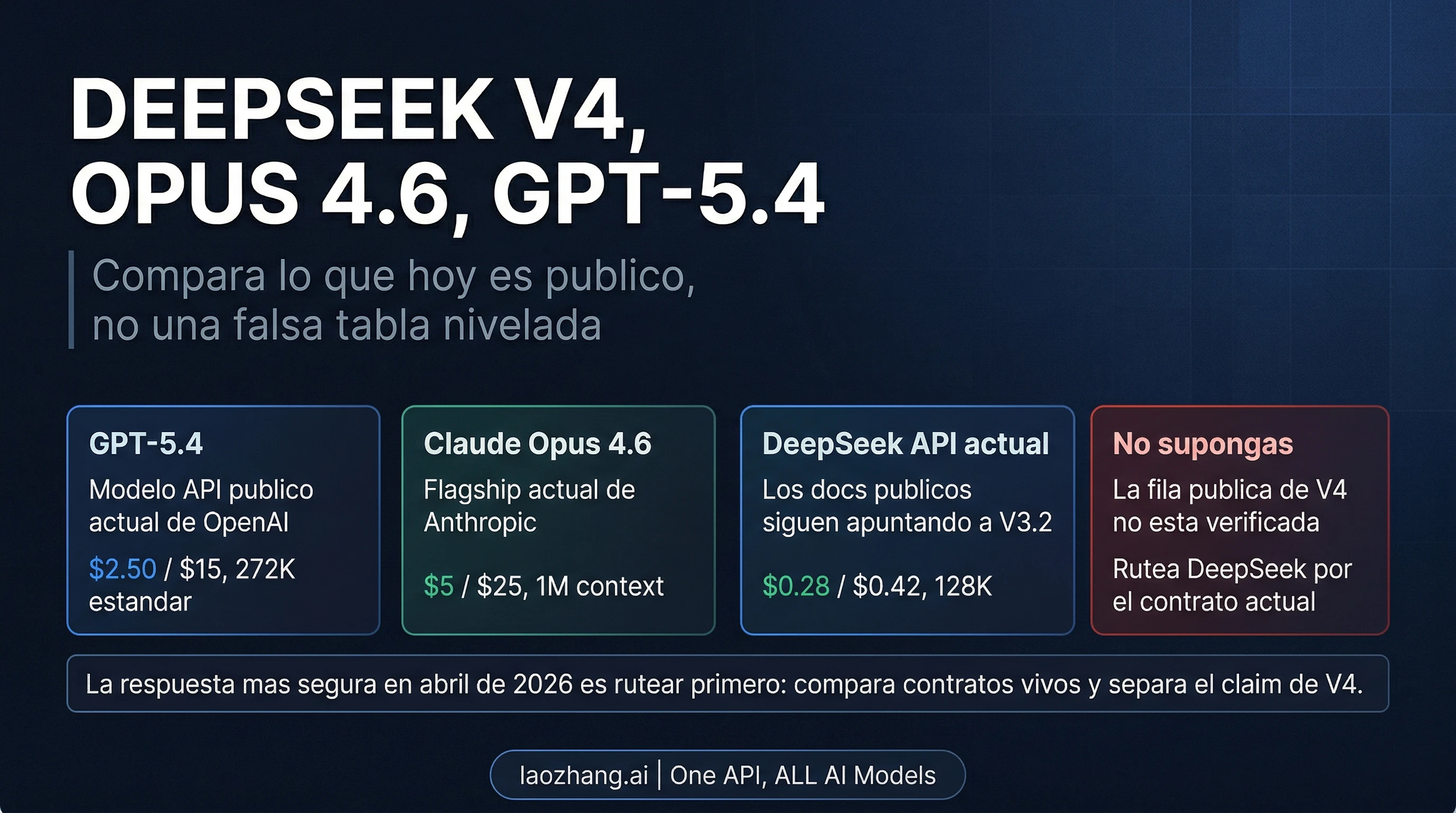

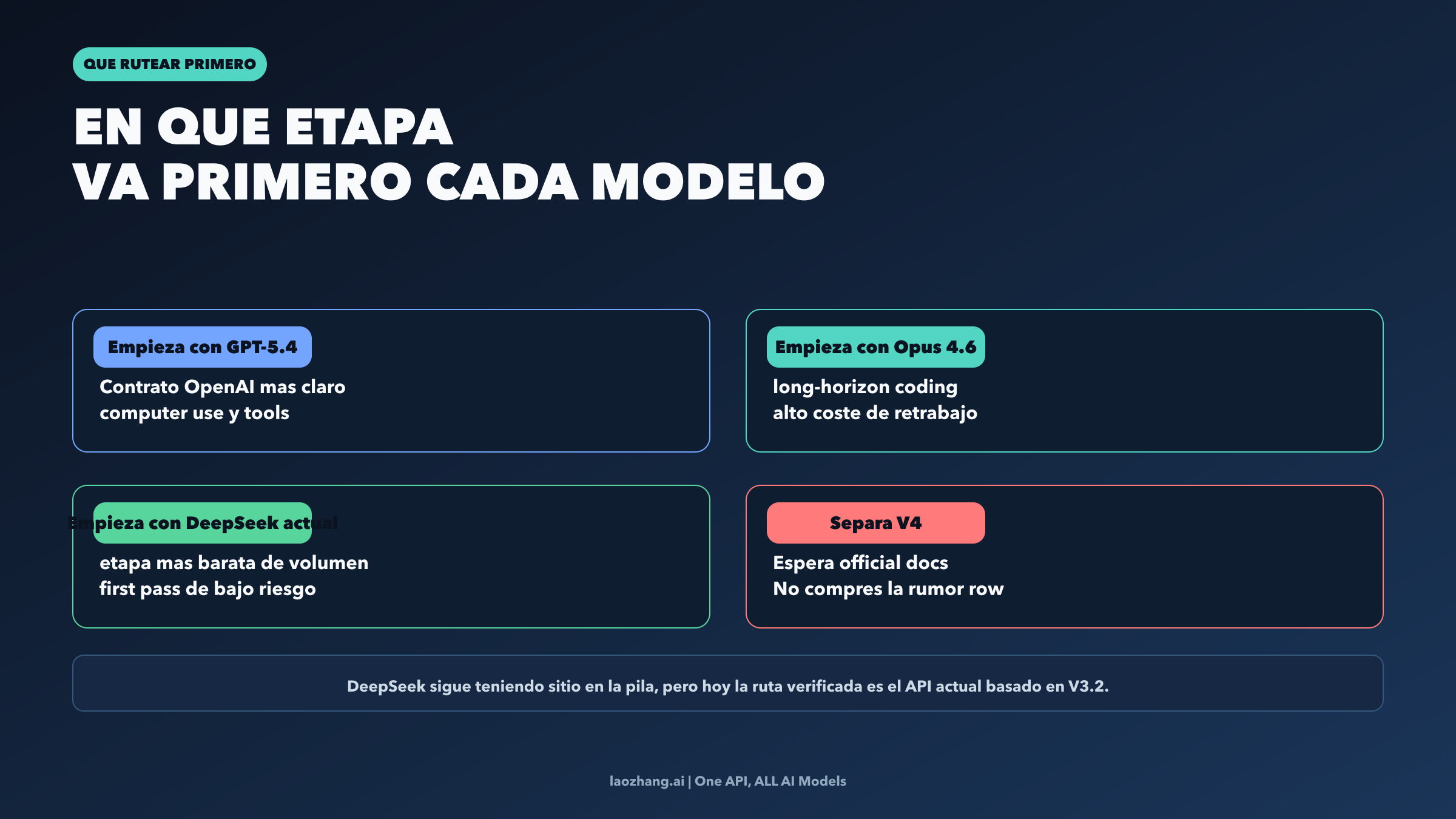

Si necesitas tomar una decision de produccion hoy, no empieces fingiendo que DeepSeek V4, Claude Opus 4.6 y GPT-5.4 son tres contratos publicos igual de claros. La forma mas util de leer este tema es otra. GPT-5.4 merece ser la primera prueba si lo que valoras es el contrato actual de OpenAI mas claro, una historia oficial mas fuerte sobre computer use y tool use, y una ruta que siga encajando con Codex. Claude Opus 4.6 merece la primera prueba cuando la parte cara del trabajo no es el precio por token sino el coste de un first pass debil en coding largo, con mucho contexto o con mucho retrabajo humano despues. DeepSeek actual sigue siendo importante cuando el primer limite es el cost floor, pero incluso en ese caso la lectura correcta pasa por el public API actual basado en DeepSeek-V3.2, no por una fila publica DeepSeek V4 que hoy no esta verificada.

Ese matiz no es academicismo. Cambia el propio objeto de comparacion. A 4 de abril de 2026, OpenAI y Anthropic publican paginas actuales de modelo y pricing para GPT-5.4 y Claude Opus 4.6. En cambio, los current public API docs de DeepSeek siguen haciendo que deepseek-chat y deepseek-reasoner apunten a DeepSeek-V3.2. Eso no vuelve irrelevante a DeepSeek. Solo significa que la comparacion honesta de hoy no es una tabla de "tres ganadores posibles", sino un proceso en dos pasos: comparar primero los dos frontier contracts vivos y despues decidir en que stage del stack entra el DeepSeek publico actual.

| Si tu bottleneck real se parece a esto... | Ruta que conviene probar primero | Por que |

|---|---|---|

| Quieres el contrato actual de OpenAI mas claro y el upside documentado de computer use / tool use | GPT-5.4 | OpenAI publica pricing, benchmark rows y la diferencia entre el contexto estandar y el soporte experimental 1M en Codex |

| Lo caro de verdad es el retrabajo despues de un mal first pass en tareas largas de coding o agentes | Claude Opus 4.6 | Anthropic publica un flagship actual con 1M context y 128k max output pensado para ese tipo de carga |

| Lo primero que necesitas es el stage publico mas barato | DeepSeek API actual | Los docs publicos de DeepSeek apuntan a un contrato V3.2-backed con un precio muy inferior al de GPT-5.4 u Opus 4.6 |

Nota de verificacion: las paginas actuales de OpenAI, Anthropic y DeepSeek se revisaron el 4 de abril de 2026. En esa fecha no se pudo verificar en los current docs de DeepSeek una model page publica ni una pricing row publica separada para DeepSeek V4; las filas publicas seguian apuntando a DeepSeek-V3.2.

Primero hay que corregir el objeto que se esta comparando

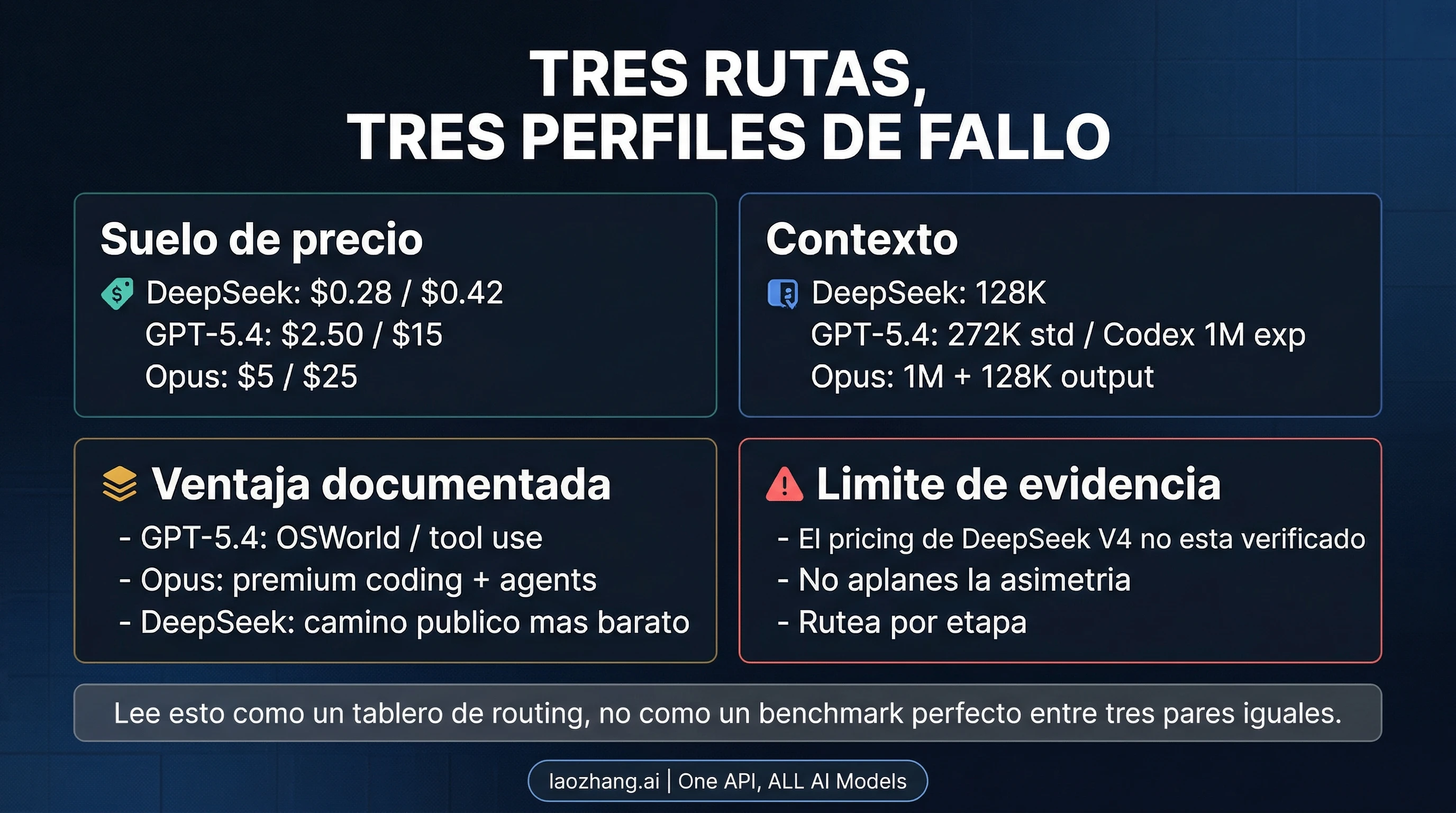

La correccion mas util aqui no es filosofica. Es operacional. GPT-5.4 y Claude Opus 4.6 se pueden comparar directamente como current public contracts porque ambos vendors publican modelo, pricing, contexto y capability surface con bastante claridad. Con DeepSeek la situacion es mas asimetrica. Los current public API docs muestran DeepSeek-V3.2, 128K context, tool use en thinking mode y un pricing actual de $0.28 por millon de input tokens y $0.42 por millon de output tokens. Ese es un contrato real y usable. Lo que no es, por ahora, es una public row verificada de DeepSeek V4.

Por eso una comparacion tipica de "quien gana mas categorias" se queda corta. Una comparacion limpia presupone que las tres filas son igual de publicas, igual de documentadas e igual de actuales. Aqui no pasa eso. En OpenAI, gpt-5.4 es un current public route y ademas existe gpt-5.4-pro para el tier superior. En Anthropic, claude-opus-4-6 es el flagship actual y los current docs describen explicitamente 1M context y 128k max output. En DeepSeek, el camino publico verificable hoy es el API basado en V3.2. Eso no mata la comparacion. Solo cambia que tipo de afirmacion honesta puedes hacer.

La implicacion practica es directa. Si alguien te dice "DeepSeek V4 es 20 veces mas barato que Claude Opus 4.6" o "DeepSeek V4 es el rival real de GPT-5.4", la primera respuesta deberia ser: que contrato publico exacto estas comparando. No es una pregunta pedante. Es la diferencia entre una decision de routing o procurement bien apoyada y una comparacion construida sobre una fila inestable.

| Ruta | Current public contract verificado el 4 de abril de 2026 | Precio | Contexto | Lo que el vendor documenta con claridad hoy | Lo que no deberias asumir |

|---|---|---|---|---|---|

| GPT-5.4 | OpenAI API model gpt-5.4 | $2.50 input / $15 output | 272K estandar, 1M experimental en Codex | pricing, API availability, benchmark rows, soporte en Codex | No conviertas el contrato estandar 272K en un "modelo 1M" generico para todo |

| Claude Opus 4.6 | Anthropic API model claude-opus-4-6 | $5 input / $25 output | 1M context, 128k max output | posicionamiento flagship para agents y coding, launch status, output window | No sigas citando numeros viejos de 192K / 200K sacados de paginas desactualizadas |

| DeepSeek API actual | deepseek-chat y deepseek-reasoner apuntan a DeepSeek-V3.2 | $0.28 input / $0.42 output | 128K | precio muy bajo, public API V3.2-backed, tool use en thinking mode | No trates una pricing row DeepSeek V4 no verificada como si ya fuera hecho publico |

Esa tabla es el first screen correcto. Una vez que la aceptas, el articulo deja de ser un concurso de belleza entre tres filas y pasa a ser un problema de routing.

Cuando GPT-5.4 deberia ir primero

GPT-5.4 es la primera prueba adecuada cuando la claridad del contrato actual de OpenAI ya es una ventaja en si misma. No se trata solo de si es mas caro o mas barato, sino de si quieres evaluar sobre la surface actual de OpenAI, con un modelo que tenga una historia oficial clara sobre computer use y tool use, y con continuidad razonable hacia Codex. La launch page de GPT-5.4 ayuda bastante aqui porque OpenAI publica el pricing actual, deja claro que el modelo esta disponible como gpt-5.4, separa el 272K standard context del soporte experimental 1M dentro de Codex, y ademas muestra benchmark rows como 75.1 en Terminal-Bench 2.0, 75.0 en OSWorld-Verified y 82.7 en BrowseComp.

Esa separacion importa porque el punto donde mas se vuelven flojas las comparativas es precisamente el claim sobre contexto. Si necesitas un contrato limpio para una decision de arquitectura, la frase segura no es "GPT-5.4 tiene 1M de contexto" y ya esta. La frase segura es que GPT-5.4 mantiene un 272K standard context y que OpenAI documenta ademas experimental 1M support inside Codex. Son hechos relacionados, pero no son el mismo contrato operativo. En cuanto separas esas dos capas, el rol de GPT-5.4 se vuelve mucho mas facil de entender: una middle route fuerte, actual y oficialmente explicada para equipos que quieren el ecosystem actual de OpenAI y un profile documentado de tool/computer use.

La historia de benchmark refuerza ese papel, pero no autoriza el atajo de escribir que GPT-5.4 gana automaticamente en cualquier tarea de coding. Lo que si refuerza es que, si lo que estas evaluando es "puede operar bien en entornos reales, con tools y con trabajo tipo terminal, sin obligarme a leer rumores de producto", GPT-5.4 es el first test mas seguro de estos tres caminos. Si tu siguiente paso despues de este articulo es entender mejor la capa de producto actual de OpenAI, sigue con OpenAI Codex en marzo de 2026.

La trampa tambien importa. GPT-5.4 no es la ruta barata, y los materiales oficiales actuales tampoco autorizan a escribir que simplemente aplasta a Claude Opus 4.6 en todo. El caso mas fuerte de GPT-5.4 aparece cuando el valor del contrato oficial mas claro de OpenAI pesa mas que la diferencia de precio.

Cuando Claude Opus 4.6 si merece el premium

Claude Opus 4.6 deberia ir primero no cuando buscas "el modelo mas fuerte en abstracto", sino cuando la pregunta real es cuanto cuesta un mal first pass. Esa es la lectura mas estable de Opus 4.6. Anthropic no necesita montar un gran teatro de benchmark para justificarlo. El current contract ya dice bastante: 1M context, 128k max output, y el posicionamiento de Opus 4.6 como el Claude mas capaz para agents y coding. Ese es el tipo de contrato que pesa cuando el trabajo depende de un horizonte largo y de un working set grande.

Por eso el argumento de "pero los tokens son mas caros" suele quedarse demasiado corto. Si. Claude Opus 4.6 es bastante mas caro que GPT-5.4 en precio oficial, y muchisimo mas caro que el DeepSeek publico actual. Pero la factura real no es solo el precio del token. Si tu workload incluye repo-scale coding, cadenas largas de ejecucion o outputs grandes donde no quieres mandar al revisor a rescatar una primera version floja, lo caro no es el invoice. Lo caro es el cleanup humano despues de un mal primer intento. Justo ahi el premium de Opus 4.6 se vuelve defendible.

Los numeros de 1M context y 128k output importan porque cambian la estructura del trabajo. Reducen la necesidad de comprimir demasiado pronto el problema, de trocear el contexto en exceso o de trabajar desde una slice artificialmente estrecha. Si despues de esta conclusion quieres mirar mejor el lado de coste en Anthropic, la siguiente lectura correcta es Claude Opus 4.6 pricing guide. Aqui usamos el articulo en ingles porque todavia no hay una version en espanol del mismo slug.

Tambien hay un limite claro. Claude Opus 4.6 no es la respuesta por defecto cuando el bottleneck principal sigue siendo el precio o cuando importa mas un current official contract de OpenAI que una apuesta premium de contexto largo. Por eso este articulo insiste en pensar en rutas, no en coronas.

Por que el DeepSeek actual sigue teniendo sitio en el stack

Seria un error corregir demasiado y sacar a DeepSeek de la conversacion solo porque V4 no tiene una public proof limpia hoy. La correccion correcta es mas estrecha: meter a DeepSeek en el stack a traves del contrato que si esta documentado ahora mismo. Y ese contrato hoy es el public API basado en V3.2.

Eso sigue dejando a DeepSeek con un papel muy real. Con $0.28 input y $0.42 output por millon de tokens, el current DeepSeek API es mucho mas barato que GPT-5.4 o Claude Opus 4.6. Y no es solo un slogan de "barato". Los docs publicos dan una historia operativa concreta: el API publico actual se apoya en DeepSeek-V3.2, ofrece 128K context y mantiene tool use en thinking mode. Eso basta para justificar su papel en stages low-risk y cost-sensitive como summarizacion de primera pasada, bulk classification, drafting inicial o cualquier tramo de mucho volumen donde pagar un premium frontier no se justifica tan bien.

Lo que esos facts no justifican es escribir como si DeepSeek V4 ya fuera un frontier peer publicamente verificado, con pricing rows, benchmark evidence y proof surface comparables a GPT-5.4 y Opus 4.6. Ahí es donde muchas comparativas se pasan. Si tu interes real es "puedo mantener un stage barato en mi stack hoy", la respuesta es si. Si tu interes real es "puedo citar una public row V4 totalmente verificada al lado de GPT-5.4 y Opus 4.6", la respuesta segura a 4 de abril de 2026 sigue siendo no.

Eso no es anti-DeepSeek. Es una posicion a favor de la calidad de la decision. Un modelo puede ser util hoy sin que primero le inventes un contrato publico mas fuerte del que el vendor documenta.

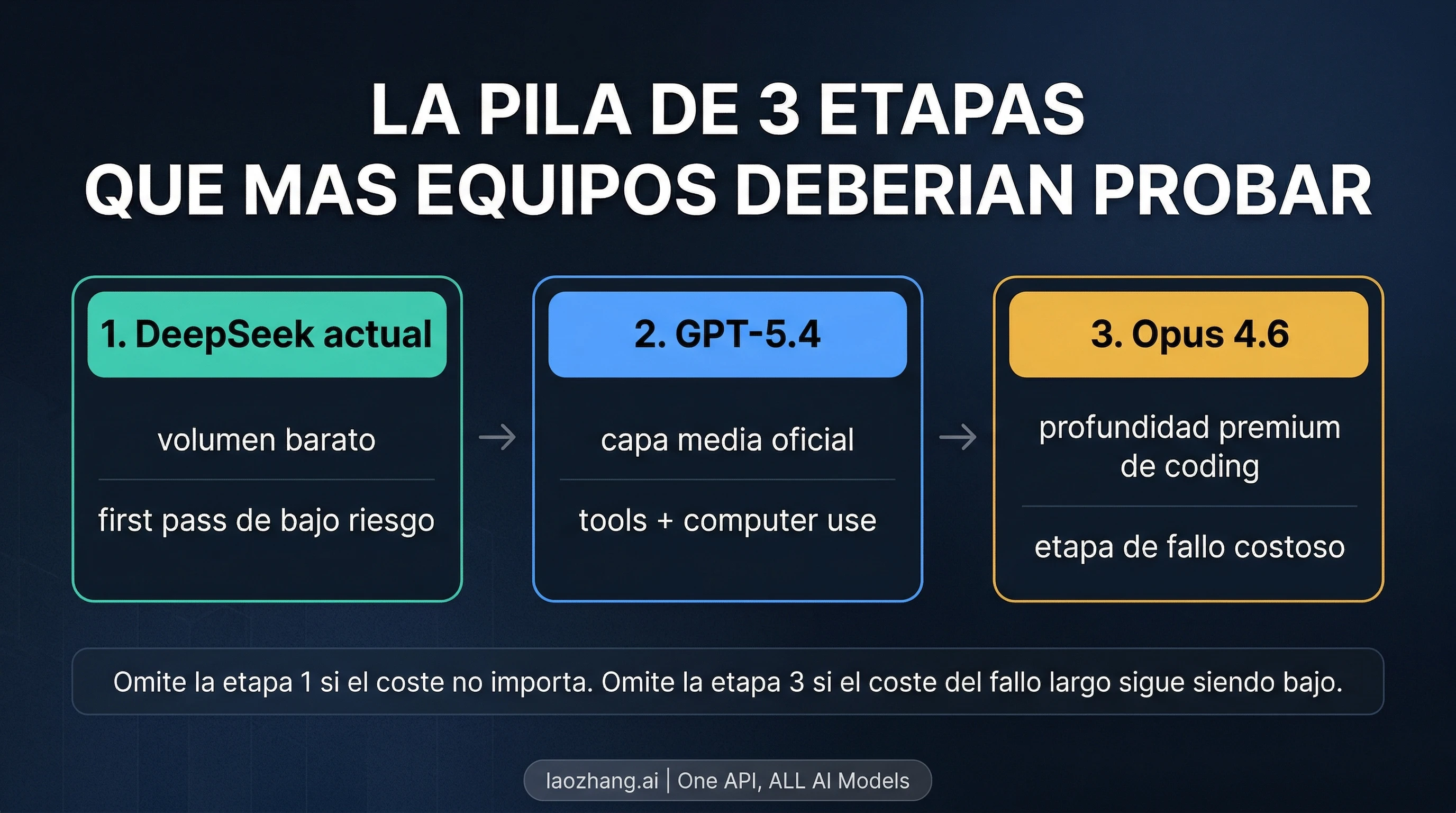

El stack de tres stages que la mayoria de equipos deberia probar de verdad

En cuanto dejas de forzar un ganador universal falso, el system design correcto aparece casi solo.

Stage 1: DeepSeek actual para el first pass publico mas barato. Usa el current DeepSeek API cuando el trabajo sea sensible al precio, vaya en gran volumen o tenga un riesgo suficientemente bajo como para que el objetivo principal sea mover trabajo barato y no comprar la mejor ejecucion frontier documentada. Este stage trata de disciplina de tokens, no de fingir que DeepSeek ya publico un frontier V4 contract.

Stage 2: GPT-5.4 como la middle route oficial mas clara. Sube a GPT-5.4 cuando la tarea necesite mejor tool use documentado, mejor upside de computer use o simplemente un current OpenAI contract mas limpio. Para muchos equipos este es el middle layer mas facil de defender. Si despues de este articulo tu siguiente necesidad es mas de acceso que de teoria de modelos, la mejor continuacion es nuestra guia de acceso a GPT-5.4. Aqui tambien enlazamos a la version en ingles porque el slug aun no existe en espanol.

Stage 3: Claude Opus 4.6 para el tier donde fallar sale caro. Sube otra vez cuando el coste de un first pass debil pase a ser mayor que el propio token bill. Ese es el momento de Opus 4.6: coding a escala de repo, cadenas largas de ejecucion u outputs donde no quieres que el revisor tenga que rescatar demasiado.

Esto no es complejidad por complejidad. Es lo que ocurre cuando la public evidence es asimetrica y los precios estan demasiado separados como para ignorarlos. Algunos equipos reduciran el stack a dos stages. Si el coste apenas importa, pueden saltarse el DeepSeek actual y comparar directamente GPT-5.4 con Opus 4.6. Si el trabajo nunca sube a un nivel de long-horizon high-stakes, no hace falta pagar por Opus 4.6. Pero el cambio mental importante es otro: deja de preguntar por un unico ganador entre tres filas que no llevan el mismo tipo de prueba publica.

Si tu pregunta real es sobre toolchain y no sobre model contract

Una parte de los lectores que llegan por este query en realidad esta preguntando otra cosa: no "que contrato de modelo es mas fuerte hoy", sino "que workflow o toolchain me conviene". Esa ya es otra capa de decision. Si lo que necesitas es la foto actual del lado OpenAI, sigue con OpenAI Codex en marzo de 2026. Si la duda real es entre guiado en vivo y delegacion asincrona, la siguiente lectura util es Claude Code vs Codex en 2026. Este articulo se queda a proposito en la capa de model contract para no convertir la comparacion en una mezcla demasiado amplia.

FAQ

DeepSeek V4 esta oficialmente publico hoy

A 4 de abril de 2026, en los current public API docs de DeepSeek no se pudo verificar una model page publica separada ni una pricing row publica para DeepSeek V4. Las filas publicas seguian apuntando a DeepSeek-V3.2.

Que modelo deberian probar primero los developers

Prueba GPT-5.4 primero si quieres el current OpenAI contract mas claro y el upside documentado de computer use / tool use. Prueba Claude Opus 4.6 primero si dominan el long-horizon coding y el coste de cleanup humano. Prueba DeepSeek actual primero solo si el centro del problema es el cost floor y el contrato publico V3.2-backed te basta.

Se puede decir simplemente que GPT-5.4 es un modelo de 1M de contexto

La redaccion cuidadosa es otra. Los current materiales de OpenAI hablan de 272K standard context y tambien documentan experimental 1M support inside Codex. Son hechos relacionados, pero no el mismo contrato operativo, asi que no conviene aplanarlos en una sola frase.

Sigue teniendo sentido usar el DeepSeek actual si V4 no esta verificado

Si. La correccion no es "ignorar DeepSeek", sino "usarlo a traves del contrato que hoy si es publico". Para stages low-risk y cost-sensitive, el current public DeepSeek API sigue teniendo bastante sentido.

Todavia tiene sentido comparar DeepSeek con GPT-5.4 y Opus 4.6

Si, pero solo despues de separar current public DeepSeek de una supuesta public row DeepSeek V4. Cuando haces esa separacion, la comparacion vuelve a ser util no como scoreboard plano, sino como decision de routing por coste, calidad de evidencia y coste del fallo.

Bottom line

La respuesta honesta mas corta es esta: compara directamente GPT-5.4 y Claude Opus 4.6 como los dos frontier contracts limpios de hoy, y deja a DeepSeek dentro de la decision a traves del public API actual basado en V3.2, no a traves de una fila V4 que todavia no esta verificada. Empieza con GPT-5.4 cuando la ventaja sea el current OpenAI contract mas claro. Empieza con Claude Opus 4.6 cuando dominen el long-horizon coding y el cleanup caro. Empieza con DeepSeek actual cuando el problema principal sea el cost floor. Solo con reformular la pregunta asi, esta comparacion deja de ser ruido y se vuelve operativa.