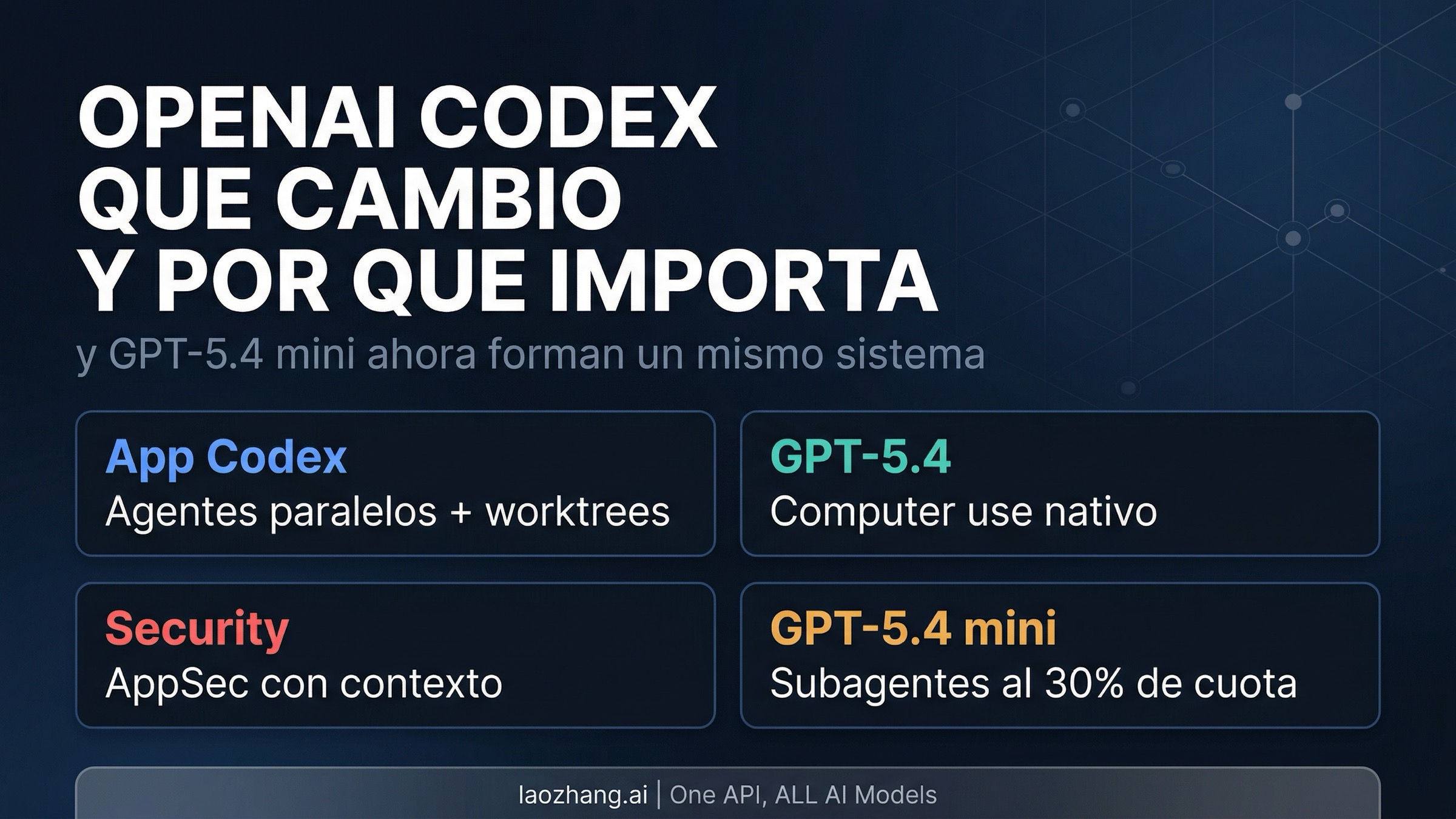

Si tu modelo mental de Codex sigue siendo "el agente de codigo en la nube de OpenAI", ya se quedo corto despues de marzo de 2026. El cambio importante no fue una sola funcion nueva. Lo que realmente ocurrio es que Codex empezo a encajar como un sistema de agentes mas completo: una app de escritorio para manejar agentes en paralelo, GPT-5.4 como nuevo cerebro principal, GPT-5.4 mini para trabajo de apoyo mas barato, Codex Security para workflows de revision y una frontera mucho mas clara entre lo local y lo cloud.

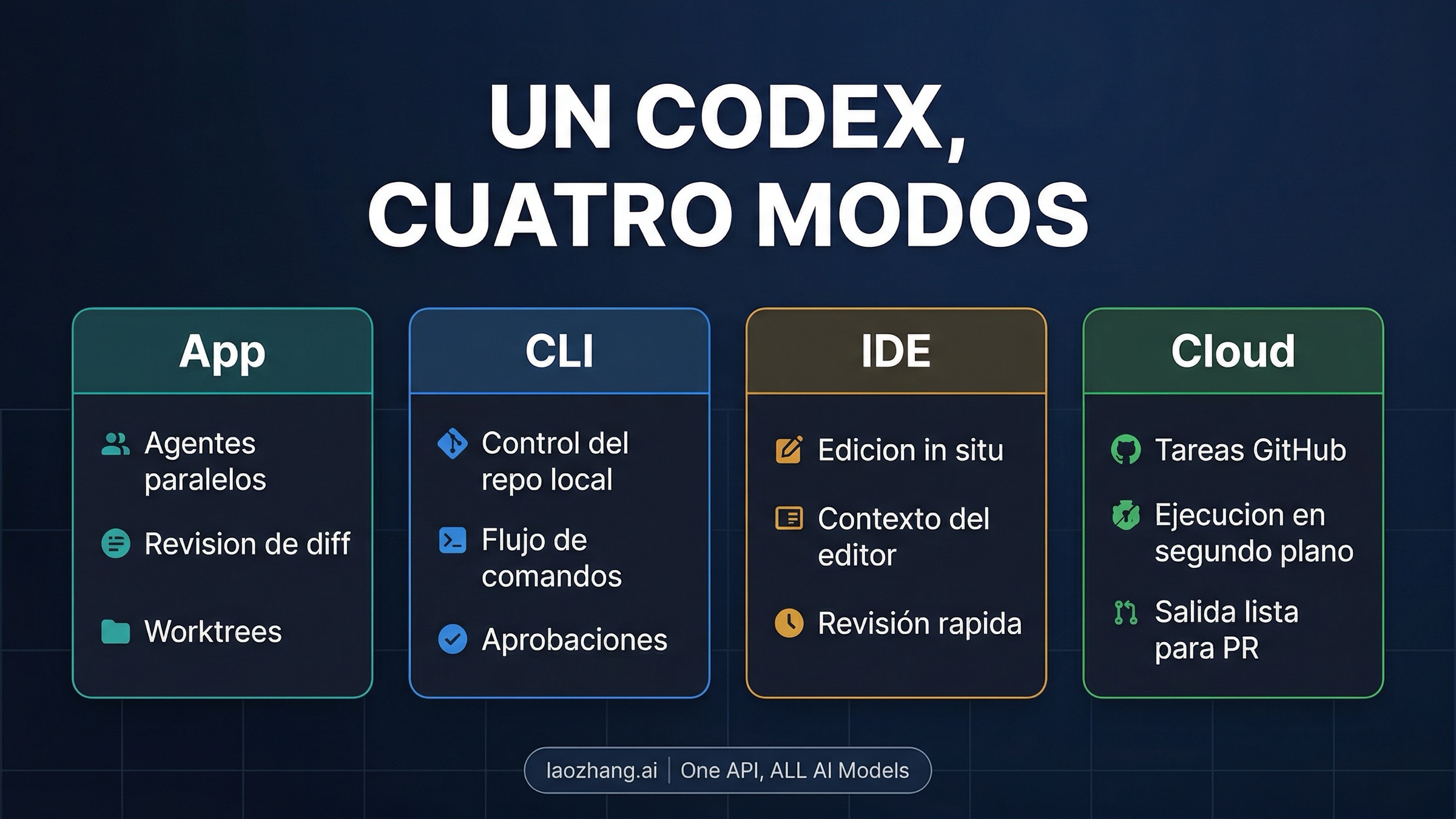

Eso importa porque el producto actual solo se entiende bien cuando lees esas capas juntas. Codex ya no es solo un ejecutor de tareas en cloud, ni solo una herramienta de CLI para programar, ni solo "el modelo de OpenAI para codigo". OpenAI ya lo documenta de forma explicita a traves de app, CLI, IDE y cloud, y esas superficies ya no viven como piezas separadas: ahora se refuerzan entre si.

Respuesta rapida (verificado el 2026-04-01)

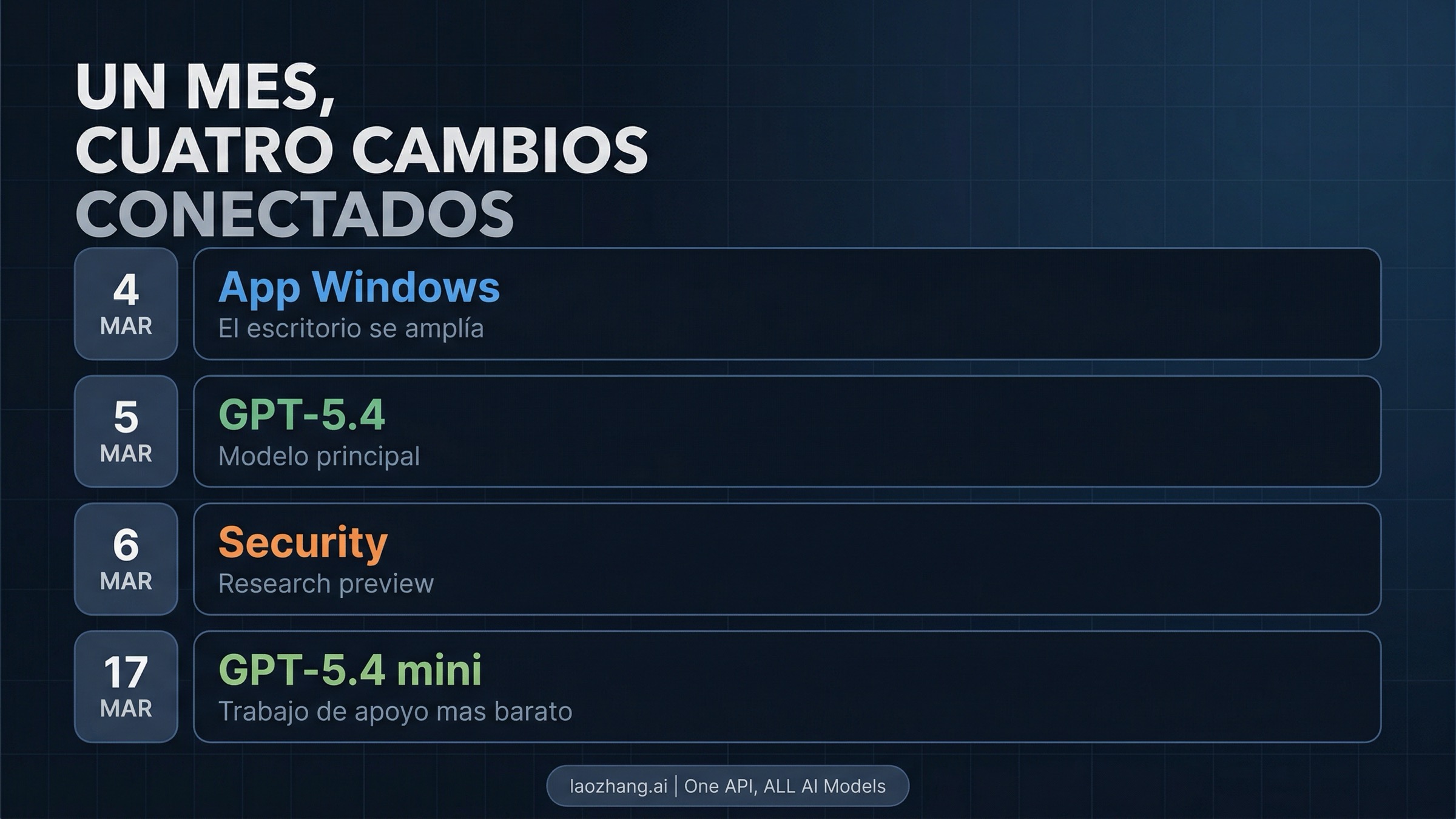

- 5 de marzo de 2026: GPT-5.4 llego a Codex y paso a ser el modelo principal. OpenAI lo presenta como el modelo insignia para trabajo importante, con computer use nativo y workflows de herramientas mas fuertes.

- 17 de marzo de 2026: GPT-5.4 mini entro en Codex en app, CLI, IDE y web. Usa solo el 30% de la quota de GPT-5.4 y sirve para subtareas mas rapidas y mas baratas.

- 6 de marzo de 2026: Codex Security entro en research preview a traves de Codex web y metio la revision de seguridad con contexto dentro del stack de Codex.

- 2 de febrero de 2026 mas la actualizacion del 4 de marzo: la app de Codex salio primero en macOS y luego llego a Windows, consolidandose como una superficie real para agentes paralelos, worktrees, skills y Automations.

- La conclusion util: hoy Codex se entiende mejor como un sistema de agentes que cruza varias superficies, no como una sola interfaz ni como un solo modelo.

Nota de evidencia: este articulo usa paginas de producto y docs oficiales actuales de OpenAI, revisadas el 1 de abril de 2026. La disponibilidad, el ruteo de modelos y las quotas pueden cambiar rapido, asi que conviene leerlo como una foto operativa con fecha.

El cambio de marzo fue un cambio de stack, no una sola novedad

La forma mas facil de entender mal Codex es leer cada anuncio de marzo por separado.

Si solo lees el lanzamiento de la app de Codex, puede parecer que OpenAI solo saco una envoltura de escritorio mas agradable. Si solo lees el lanzamiento de GPT-5.4, puedes pensar que Codex simplemente heredo un modelo mas fuerte. Si solo lees el anuncio de GPT-5.4 mini, la historia se reduce a "ahora hay una opcion mas barata". Si solo lees lo de Codex Security, es facil verlo como un producto de seguridad aparte, al lado de Codex y no dentro de el.

Pero la lectura mas fuerte es otra. Marzo de 2026 volvio a Codex mas coherente.

La app le dio a Codex una superficie mejor para manejar varios agentes largos a la vez. GPT-5.4 elevo el techo del agente principal. Codex Security empujo la plataforma hacia workflows de revision con mayor nivel de confianza. GPT-5.4 mini hizo mas realista el patron donde un modelo grande se encarga de planificar y juzgar, mientras modelos mas baratos se ocupan del trabajo de apoyo. Si juntas esas piezas, Codex deja de parecer "otra herramienta de AI para codigo" y empieza a parecer un sistema de trabajo con agentes.

Por eso la actualizacion para Windows del 4 de marzo de 2026 importa mas de lo que parece. Aislada, solo es cobertura de plataforma. Dentro de la secuencia de marzo, senala que la app de Codex ya no es un experimento accesorio para usuarios de Mac, sino una parte duradera del producto.

Codex ahora es un sistema de cuatro superficies

La documentacion actual de OpenAI describe Codex a traves de cuatro superficies principales:

- la app de Codex

- el CLI

- la extension de IDE

- Codex cloud

Eso importa porque la pregunta util ya no es "cual de estas es el Codex verdadero". Ahora todas lo son. La pregunta que de verdad ayuda es para que sirve mejor cada superficie.

La app es la mejor pista de como OpenAI quiere que trabajemos con agentes ahora. La pagina oficial no la presenta como una simple ventana de chat, sino como un command center para agentes. Puedes ejecutar varios threads en paralelo. Los agentes trabajan en worktrees aislados. Puedes revisar diffs, comentar cambios y dejar que el trabajo siga avanzando en segundo plano sin tocar tu estado local de git. Eso es muy distinto a la idea de "abro la terminal y le pido a la IA un parche".

El CLI y la extension de IDE siguen siendo importantes porque mantienen a Codex pegado al repo local y al entorno real de edicion. De hecho, la app recupera el historial de sesion y la configuracion del CLI y del IDE. Eso es una senal fuerte sobre el diseno del producto: OpenAI no esta intentando reemplazar el workflow local, sino unificarlo.

Luego esta Codex cloud. Cuando la tarea ya esta lo bastante clara como para conectar el repo, lanzar el trabajo, mirar logs solo si hace falta y volver al final a revisar un diff limpio o un pull request, esa ruta sigue siendo una de las mayores fortalezas de Codex. Y lo es, en parte, porque OpenAI documenta ese flujo con bastante claridad.

Lo que une todas estas superficies son las skills, las rules y unas Automations cada vez mas importantes. La pagina de la app lo deja bastante claro: puedes crear skills en la app, usarlas en la app, en el CLI o en el IDE, e incluso guardarlas en el repo para compartirlas con el equipo. En ese punto Codex deja de parecer solo "un asistente con memoria" y empieza a parecer un workflow engine con forma de repo.

GPT-5.4 subio el techo de lo que Codex puede hacer

El mayor cambio de capacidad en marzo sigue siendo el 5 de marzo de 2026, cuando GPT-5.4 entro en Codex.

Eso importa por al menos tres razones.

Primero, OpenAI presenta GPT-5.4 como el modelo principal para trabajo importante en ChatGPT, la API y Codex. No fue una actualizacion silenciosa de backend. Cambio la expectativa por defecto sobre la que se evalua Codex.

Segundo, OpenAI describe GPT-5.4 en Codex y en la API como su primer modelo general-purpose con computer use nativo. Esto importa porque empuja a Codex fuera del espacio de "editar unas cuantas lineas". Un agente que trabaja mejor con herramientas, entornos de software e interfaces tambien se vuelve mas util para testing, revision de UI, validacion de workflows, pipelines de documentacion, generacion de spreadsheets o presentaciones mediante skills y tareas que mezclan navegador y codigo.

Tercero, GPT-5.4 tambien mejora el perfil de trabajo de largo horizonte. OpenAI habla de hasta 1 millon de tokens de contexto y de un mejor tool search en ecosistemas grandes de herramientas. No conviene traducir eso como "ahora Codex resuelve automaticamente cualquier tarea larga". Seria exagerado. Pero si cambia el techo practico. Le da al agente principal mejores posibilidades de mantener plan, coordinacion y verificacion cuando el trabajo abarca mas archivos, mas herramientas y mas pasos de los que asumian las explicaciones viejas.

Por eso la historia actual de Codex no se resume en "el modelo es mas listo". GPT-5.4 es tambien lo que hace mas creible la historia de la app, las skills y las automatizaciones. Una superficie multiagente solo importa de verdad si debajo hay un agente capaz de sostener tareas largas y usar herramientas con mas fiabilidad. Marzo fue el momento en que esas capas empezaron a alinearse.

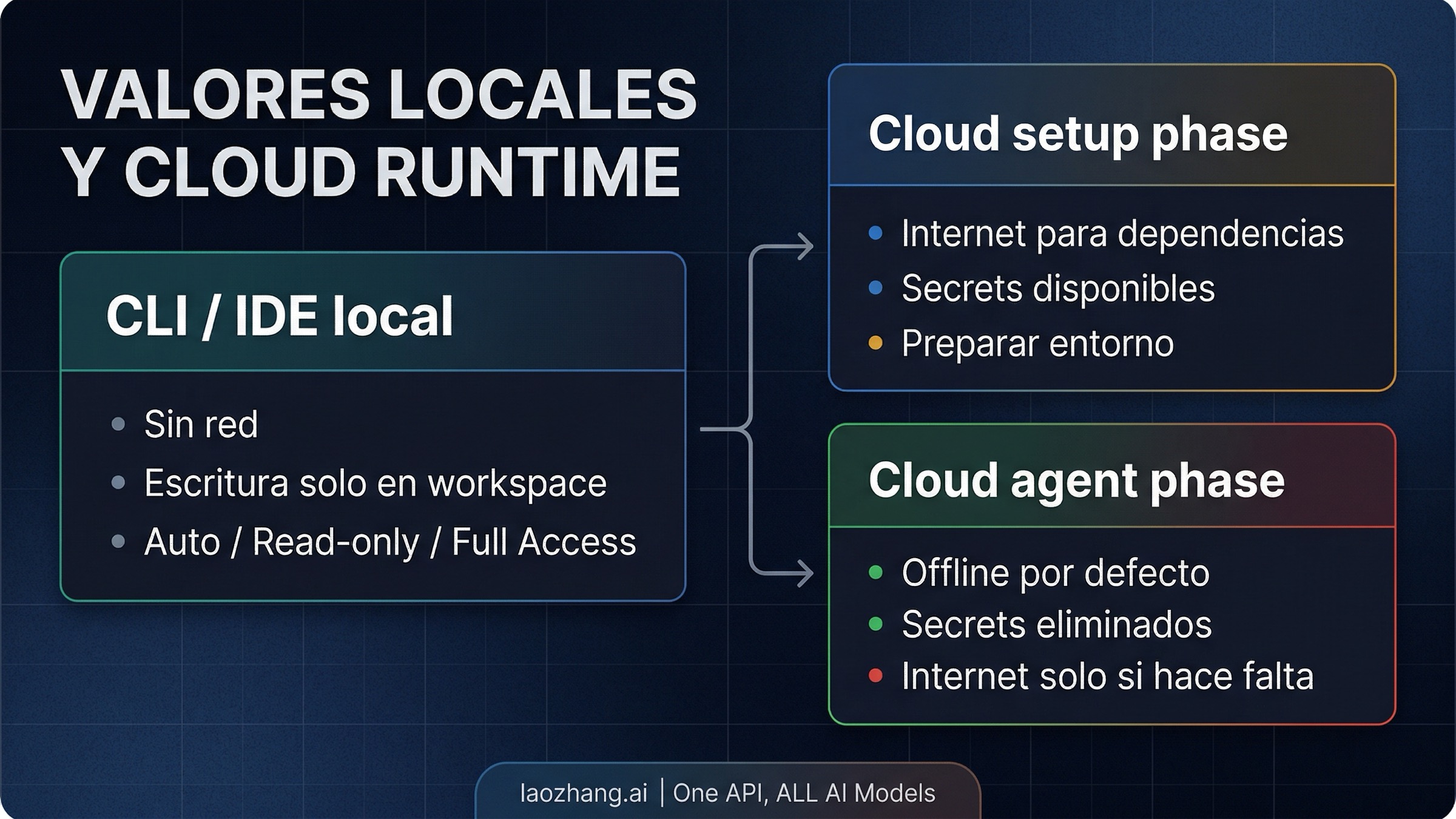

La frontera de confianza por fin esta explicita

Uno de los cambios mas utiles en la documentacion actual de Codex ni siquiera es una capacidad nueva. Es que OpenAI ahora explica mucho mejor la frontera de confianza.

En CLI e IDE locales, el comportamiento por defecto es:

- sin acceso a red

- escritura limitada al workspace activo

Eso es mucho mas util que la frase generica "es seguro por defecto", porque te dice de forma concreta cual es la caja de seguridad inicial.

En Codex cloud, OpenAI describe un runtime en dos fases:

- la setup phase puede usar red para instalar dependencias y preparar el entorno

- la agent phase principal queda offline por defecto salvo que habilites internet de forma explicita

OpenAI tambien documenta que los secrets estan disponibles durante setup y se eliminan antes de la agent phase principal. Ese detalle no es menor. Cambia por completo como razonas sobre la instalacion de dependencias, la preparacion de builds y la ejecucion posterior porque la frontera operativa por fin esta descrita con precision.

La conclusion practica es simple. La historia moderna de Codex ya no es solo "deja correr al agente". Ahora puedes pensar con bastante claridad:

- que puede tocar el trabajo local por defecto

- cuando entra en juego la red

- como cambia el comportamiento cloud antes y despues del setup

- y en que momento estas elevando permisos de forma deliberada

Para equipos que se preocupan por policy, capacidad de revision y separacion del riesgo local frente al riesgo cloud, esa claridad es una capacidad por derecho propio.

La adicion de marzo mas infravalorada es GPT-5.4 mini

Es facil infravalorar el lanzamiento de GPT-5.4 mini del 17 de marzo de 2026 si lo lees solo como una nota de precio. Dentro de Codex es mas interesante que eso.

OpenAI dice de forma explicita que GPT-5.4 mini esta disponible en app, CLI, extension de IDE y web, y que solo usa el 30% de la quota de GPT-5.4. Eso ya es importante para cualquiera que quiera pasadas mas rapidas y mas baratas sobre tareas sencillas. Pero lo mas interesante es el patron de trabajo que OpenAI asocia a ese modelo dentro de Codex.

La propia publicacion de GPT-5.4 mini dice que en Codex un modelo mas grande como GPT-5.4 puede encargarse de la planificacion, la coordinacion y el juicio final, mientras que subagentes con GPT-5.4 mini resuelven en paralelo tareas mas estrechas, por ejemplo:

- buscar en un codebase

- revisar un archivo grande

- procesar documentos de apoyo

Eso ya no es la historia de "elige un modelo y usalo para todo". Se parece mucho mas a un sistema de ruteo interno entre agentes. Y eso, a su vez, hace mas importante la superficie multiagente de la app de Codex, porque la estrategia de modelos y la interfaz empiezan a reforzarse mutuamente.

Tambien hay una frontera importante aqui: GPT-5.4 nano no forma parte de las superficies de Codex. OpenAI lo coloca como API-only. Asi que la historia actual de modelos en Codex, en la practica, es esta:

- GPT-5.4 para planificacion pesada y juicio final

- GPT-5.4 mini para trabajo de apoyo mas barato y mas estrecho

Esa lectura es bastante mas util que limitarse a listar nombres de modelos.

Donde Codex es mas fuerte ahora mismo

Si juntas todas las piezas de marzo, Codex se ve especialmente fuerte en cuatro tipos de situaciones.

1. Trabajo en segundo plano en paralelo, pero con salida revisable.

La estructura de threads de la app, los worktrees y el flujo de revision centrado en diffs estan hechos para esto. Si la tarea ya esta clara, Codex ahora se parece mucho mas a un sistema para mover varias cosas a la vez y revisarlas al final que a un asistente conversacional de un solo hilo.

2. Tareas que mezclan codigo, herramientas e interfaces.

Aqui pesa mucho la direccion de GPT-5.4 hacia computer use. Tambien pesan la capa de app y la capa de skills. Codex ya no intenta solo tocar archivos; cada vez encaja mejor en workflows que cruzan codigo, documentacion, navegador, assets y herramientas de apoyo.

3. Tareas repetitivas de ingenieria que deberian convertirse en trabajo programado.

Automations es una de las piezas mas subestimadas de toda la historia de la app. OpenAI dice que las usa para issue triage, resumenes de fallos de CI, release briefs y checks de bugs. Ese tipo de trabajo encaja mucho mejor con "el agente termina y deja el resultado en una review queue" que con "un asistente esperando en un chat".

4. Workflows de revision con mayor nivel de confianza, especialmente alrededor de seguridad.

Codex Security no es toda la historia de Codex, pero si muestra hacia donde se esta expandiendo la plataforma. OpenAI esta llevando Codex mas alla de generar codigo, hacia review, validacion y patching, es decir, hacia trabajos que exigen mas contexto y menos ruido.

Nada de esto significa que Codex pase a ser automaticamente la mejor eleccion para cualquier trabajo de programacion. Lo que si significa es que la forma correcta de evaluarlo ya cambio. Si sigues viendolo como un coding assistant de una sola superficie, vas a perder precisamente la parte que mas se esta fortaleciendo.

Si tu siguiente pregunta es "entonces, frente a otro agente de codigo, cual deberia usar primero en el dia a dia", el siguiente paso natural es leer nuestra comparativa Claude Code vs Codex. Esa comparacion se vuelve bastante mas clara una vez que tu modelo mental de Codex ya esta actualizado.

FAQ

Codex ahora es principalmente una app?

No. La app es importante porque organiza mejor agentes paralelos, worktrees, skills y Automations, pero OpenAI sigue documentando Codex de forma explicita a traves de app, CLI, extension de IDE y cloud.

Que modelo impulsa Codex ahora mismo?

Segun la documentacion actual de OpenAI, GPT-5.4 es el modelo principal de Codex. GPT-5.4 mini tambien esta disponible en Codex para trabajo de apoyo mas rapido y mas barato. GPT-5.4 nano es API-only.

Sigue teniendo sentido Codex para trabajo local?

Si. OpenAI documenta que el CLI y el IDE locales arrancan por defecto sin red y con escritura limitada al workspace activo. Codex no es un producto solo para cloud.

Que es realmente nuevo en Codex Security?

No es simplemente "hay un escaner de seguridad". Es un agente de application security dentro de Codex web que construye contexto del proyecto, valida hallazgos probables y propone patches. Lo importante no es solo que exista una funcion de seguridad, sino que Codex esta entrando en workflows de revision de mayor confianza.

Por que GPT-5.4 mini importa tanto?

Porque cambia el workflow, no solo el costo. OpenAI lo presenta de forma explicita como el modelo para subagentes paralelos mas estrechos, mientras GPT-5.4 conserva planificacion y juicio final.

Cual es el modelo mental mas simple para Codex hoy?

La forma mas correcta es pensar en Codex como un sistema de agentes que cruza varias superficies. La app organiza trabajo en paralelo, las superficies locales lo mantienen cerca del repo, la ruta cloud sirve para tareas de handoff, GPT-5.4 eleva el techo del agente principal, GPT-5.4 mini hace practico el trabajo de apoyo barato y el modelo de seguridad ya es lo bastante explicito como para influir en decisiones reales de despliegue.

Sintesis propia: marzo de 2026 fue el momento en que Codex dejo de parecer un conjunto de funciones sueltas y empezo a parecer un stack de agentes coherente. Esa es la actualizacion de verdad. No solo que Codex haga mas cosas, sino que sus superficies, modelos y frontera de confianza ahora encajan mejor entre si.