要点速览

Nano Banana Pro API 存在三种类型的限制,每种都有不同的解决方案。速率限制(250 RPD 上限)可通过启用 Google Cloud 计费或使用 laozhang.ai 等第三方服务商($0.05/张,无限制)来解除。安全过滤器(第一层)可通过 API 的 safety_settings 参数配置为 BLOCK_NONE——这是官方文档明确支持的功能。内容策略(第二层 IMAGE_SAFETY)无法通过任何 API 参数禁用——需要改用提示词工程和重试策略。截至 2026 年 3 月,Nano Banana Pro 没有免费 API 层级。

Nano Banana Pro(Gemini 3 Pro Image)是 Google 最强大的 AI 图像生成模型,但要实现无限制访问远比大多数教程所说的更加复杂。"无限制"一词实际上涵盖三个独立的维度——速率限制、安全过滤器和内容策略——每个维度都需要不同的处理方法。截至 2026 年 3 月,免费 API 层级提供每天零次请求,付费层级上限为 250 RPD,而即使启用了计费,双层安全过滤系统仍可能在没有任何说明的情况下拦截合法内容。本指南将逐一拆解每个限制维度,提供可直接使用的代码来配置可控部分,并针对不可控部分给出真实可行的应对策略。

"无限制"对 Nano Banana Pro API 到底意味着什么

当开发者搜索"Nano Banana Pro 无限制 API 访问"时,他们通常指的是三种完全不同的事物——将它们混为一谈会导致数小时的无效排查。理解你面对的是哪个维度的限制,是解决问题最关键的第一步,因为速率限制的修复方案与安全过滤器拦截的修复方案完全不同,而后者又与处理不可配置的内容策略执行所需的方法截然不同。

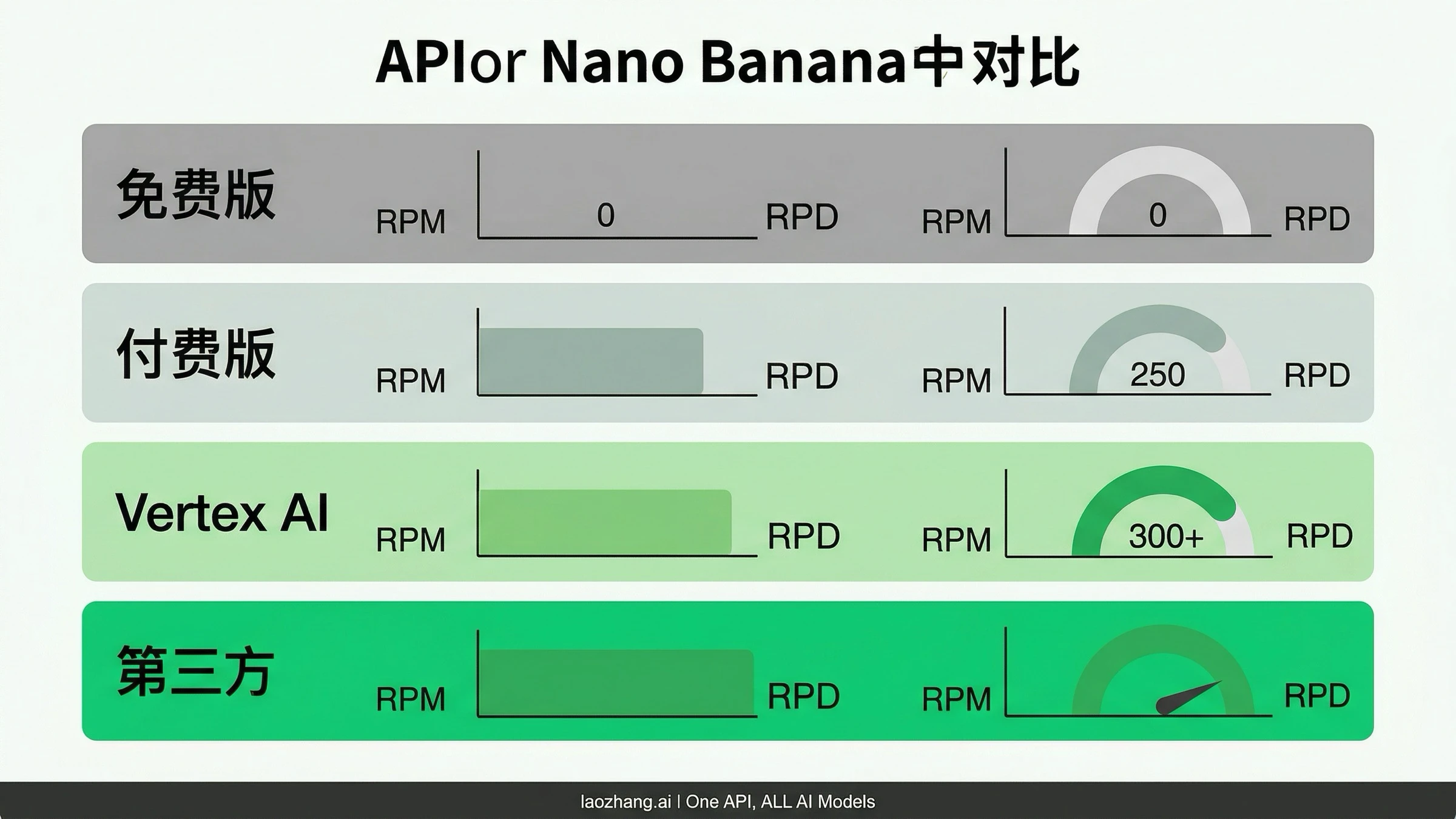

维度一:速率限制控制的是你每分钟(RPM)和每天(RPD)能发送多少请求。Nano Banana Pro API 根本没有免费层级——未付费账户每天零次请求(ai.google.dev,2026 年 3 月)。即使启用了计费,Paid Tier 1 也将你限制在 20 RPM 和 250 RPD。这是最直接的限制类型:你启用计费,或者升级到 Vertex AI 获取更高配额。修复方式纯粹是财务和管理层面的。

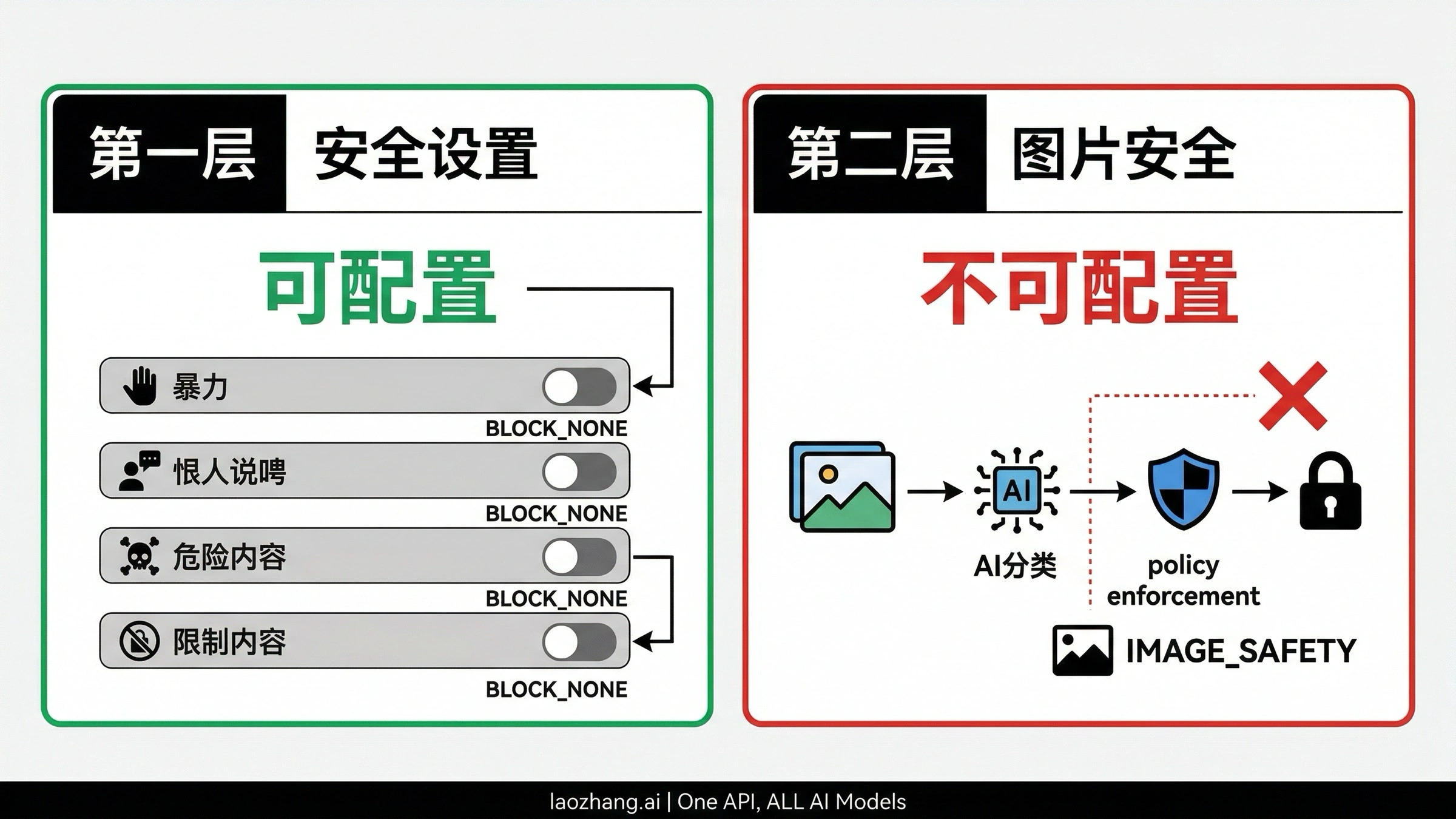

维度二:安全过滤器是可配置的第一层安全系统。Gemini API 提供四个危害类别——骚扰、仇恨言论、色情内容和危险内容——你可以通过 safety_settings 参数将每个类别设置为 BLOCK_NONE。当第一层拦截你的请求时,API 会在响应中返回 finishReason: "SAFETY"。这就是大多数"无限制访问"教程重点介绍的层级,将其配置为 BLOCK_NONE 既合法又有完善的 Google 官方文档支持。

维度三:内容策略是不可配置的第二层。这是令人最沮丧的部分。即使将所有安全类别设置为 BLOCK_NONE,API 仍然可能以 finishReason: "IMAGE_SAFETY" 或 blockReason: "OTHER" 拒绝你的请求。这些服务端过滤器使用 AI 图像分类、哈希匹配和自动策略执行,没有任何 API 参数可以禁用它们。理解这个区别可以避免开发者在拦截来自完全不同系统时,反复无意义地调整安全设置。

三个维度之间的混淆是开发者在无效方案上浪费时间的首要原因。设置 BLOCK_NONE 不会提高你的 250 RPD 上限。启用计费不会阻止 IMAGE_SAFETY 拦截。任何提示词工程也无法克服零 RPD 的免费层级。每个维度都有特定的解决路径,对错误的问题使用错误的修复方案是 Nano Banana Pro 开发者社区中最常见的挫折模式,这在 Reddit、Google Help Community 和 Stack Overflow 的数百个讨论帖中都有所体现。

理解这个框架还能帮你看清第三方"无限制"服务商实际提供的是什么。当一个服务宣传"无限制 Nano Banana Pro 访问"时,他们几乎总是指速率限制解除和成本降低(维度一),有时包括改进的第一层配置(维度二),但很少涉及第二层内容策略的任何改变(维度三)。了解服务商解决的是哪个维度,有助于你评估他们的服务是否能解决你的具体问题。

本指南的其余部分将依次解决每个维度,从你可以完全控制的部分开始,逐步推进到需要策略应对的部分。

理解 Nano Banana Pro 的双层安全架构

开发者在使用 Nano Banana Pro 时最常犯的错误是把安全系统当作一个单一开关。实际上,Google 构建了一个多层架构,其中不同组件服务于不同目的并响应不同的控制方式。在编写任何代码之前,掌握这个架构至关重要,因为每一层的错误信息看起来很相似,但需要完全不同的应对方式。

第一层通过 API 请求中的 safety_settings 参数运作。它根据 Google 定义的四个危害类别评估你的文本提示词:HARM_CATEGORY_HARASSMENT、HARM_CATEGORY_HATE_SPEECH、HARM_CATEGORY_SEXUALLY_EXPLICIT 和 HARM_CATEGORY_DANGEROUS_CONTENT。对于每个类别,你可以设置从 BLOCK_LOW_AND_ABOVE(最严格)到 BLOCK_MEDIUM_AND_ABOVE、BLOCK_ONLY_HIGH,再到 BLOCK_NONE(最宽松)的阈值。当第一层拦截请求时,响应会包含 finishReason: "SAFETY" 以及安全评级信息,精确告诉你哪个类别以什么置信度触发了拦截。这种透明性使得第一层拦截的诊断和解决非常直接。

第二层则完全不同。它在图像生成之后在服务端运行,使用 AI 驱动的分类器扫描输出图像本身——而不仅仅是文本提示词。这一层检查的策略违规包括:儿童安全内容(强制性的,任何情况下都无法绕过)、知名知识产权和商标、可识别公众人物的逼真描绘,以及违反 Google 更广泛的可接受使用政策的内容。当第二层拦截你的请求时,你会看到 finishReason: "IMAGE_SAFETY" 或 blockReason: "OTHER",关键是响应不提供任何关于触发拦截原因的详细分解。即使输出被拦截,在生成过程中消耗的 token 仍会被计费,这对于运行大量工作负载的开发者来说是一个常见的困扰来源。

当你审视 token 消耗时,这个架构的实际影响就变得很明显了。每个到达第二层的 Nano Banana Pro 请求已经消耗了用于提示词处理的输入 token 和用于图像生成的输出 token。当第二层随后拦截结果时,这些 token 仍然计入你的账户——你为一张永远收不到的图像付了费。按 2K 图像 $0.134 或 4K 图像 $0.24 的价格计算,20% 的 IMAGE_SAFETY 拦截率实际上将每张可用图像的成本提高了 25%。这使得理解和最小化第二层拦截不仅是技术关切,更是直接的财务问题,尤其在生产规模下,每天数千个被拦截的请求可能累计达到数百美元的计算资源浪费。

还有一个专门针对 PROHIBITED_CONTENT 的第三层,覆盖儿童性虐待材料(CSAM)及类似的法律强制限制。这一层是绝对的——没有配置、没有变通方案、没有第三方服务商可以绕过它。它存在于每一个 AI 图像生成服务中,不可商议。关于每种错误代码和响应模式的深入分析,请参阅我们的完整安全过滤器指南。

如何识别是哪一层拦截了你

响应字段会告诉你所有需要知道的信息。如果你看到 finishReason: "SAFETY" 并伴有 safetyRatings,说明第一层在生成前拦截了你的提示词——调整安全设置或重新措辞即可。如果你看到 finishReason: "IMAGE_SAFETY" 且没有详细评级,说明第二层在生成的图像中发现了问题——没有任何 API 设置能帮到你,你需要使用提示词工程策略。如果你看到 blockReason: "OTHER",这是一个无法配置的生成前策略检查。2026 年 3 月的策略更新显著扩大了 blockReason: "OTHER" 的适用范围,特别是针对涉及人物的编辑操作,如背景替换和外观修改。

配置 BLOCK_NONE——完整代码指南

将 safety_settings 设置为 BLOCK_NONE 是你能做出的最有效的单一更改,可以减少对合法内容的不必要拦截。这是一个官方的、有文档记录的 API 参数——不是黑客手段或变通方案。Google 专门为需要在应用层而非 API 层管理内容分类的开发者设计了这个功能。以下是在各主要编程语言中的实现方式。

Python(Google Generative AI SDK)

pythonimport google.generativeai as genai genai.configure(api_key="YOUR_API_KEY") model = genai.GenerativeModel("gemini-3-pro-image-preview") safety_settings = [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"}, ] response = model.generate_content( "A dramatic fantasy battle scene with warriors in dark armor", generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) # Check if image was generated successfully if response.candidates and response.candidates[0].content.parts: image_data = response.candidates[0].content.parts[0].inline_data with open("output.png", "wb") as f: f.write(image_data.data) else: # Check finish reason for debugging print(f"Blocked: {response.candidates[0].finish_reason}")

JavaScript / Node.js

javascriptimport { GoogleGenerativeAI } from "@google/generative-ai"; const genAI = new GoogleGenerativeAI("YOUR_API_KEY"); const model = genAI.getGenerativeModel({ model: "gemini-3-pro-image-preview", safetySettings: [ { category: "HARM_CATEGORY_HARASSMENT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_HATE_SPEECH", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_SEXUALLY_EXPLICIT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_DANGEROUS_CONTENT", threshold: "BLOCK_NONE" }, ], }); const result = await model.generateContent({ contents: [{ role: "user", parts: [{ text: "A dramatic fantasy battle scene" }] }], generationConfig: { responseMimeType: "image/png" }, }); const imageData = result.response.candidates?.[0]?.content?.parts?.[0]?.inlineData; if (imageData) { fs.writeFileSync("output.png", Buffer.from(imageData.data, "base64")); }

cURL(REST API)

bashcurl -X POST \ "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-image-preview:generateContent?key=YOUR_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "contents": [{"parts": [{"text": "A dramatic fantasy battle scene"}]}], "safetySettings": [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"} ], "generationConfig": {"responseMimeType": "image/png"} }'

一个常见问题是使用 BLOCK_NONE 是否会导致违反服务条款或账户处罚。简短回答是:不会——Google 在文档中明确将此参数列为开发者的配置选项。更详细的回答涉及理解共担责任模型:通过设置 BLOCK_NONE,你是在告诉 Google 你的应用程序将在应用层面处理内容分类和用户安全。你仍然对应用程序最终如何使用生成的图像负责,但配置 API 参数本身是被认可的行为。这类似于云服务商提供虚拟机的 root 访问权限——能力被提供并记录在文档中,而适当使用的责任由开发者承担。

值得强调的是,BLOCK_NONE 并不意味着"无任何限制地生成一切"。它的含义是"不应用可配置的危害类别阈值"。无论此设置如何,第二层图像安全检查和第三层禁止内容检查仍然会运行。实际效果是,涉及艺术暴力、戏剧性场景、医学插图和可能触发中等置信度安全评级的类似内容的提示词现在能够成功通过第一层。至于它们是否通过第二层,取决于生成的图像实际描绘的内容,这由 Google 的图像分类系统单独评估。

解除速率限制——从 250 RPD 到生产规模

速率限制问题是"无限制 API 访问"这个词最初在 Nano Banana Pro 领域流行的原因。2025 年 12 月 Google Help Community 上的一个帖子——至今仍然在此搜索查询中排名第一——完美地捕捉了这种挫折感:一个企业用户撞上了 250 RPD 的墙壁,却找不到明确的提升路径。截至 2026 年 3 月,情况已经明朗,共有四个不同的访问层级,限制差异很大。

免费层级为 Nano Banana Pro 提供每天恰好零次 API 请求。与提供慷慨免费配额的标准 Gemini 文本模型不同,图像生成模型需要付费账户。Google 在 ai.google.dev 的官方速率限制页面上确认了这一点,该页面将 Gemini 3 Pro Image Preview 列为付费账户拥有 2,000,000 token/天的限制,免费层级无条目。如果你在未启用计费的账户上遇到错误,原因就在这里——该模型没有免费 API 访问。

Paid Tier 1 在你将 Google Cloud 计费账户链接到 AI Studio 项目时激活。这会立即授予 20 RPM 和 250 RPD,大约相当于每天 250 张图像。对于个人开发者和小型项目,这足够开发和轻量级生产使用。每张图像的成本在 1K-2K 分辨率下为 $0.134,在 4K 分辨率下为 $0.24(Vertex AI Pricing,2026 年 3 月)。要启用计费,请前往 Google AI Studio,选择你的项目,进入设置,然后链接一个计费账户。你现有的 API key 将自动继承更高的限制。

Vertex AI 访问是面向生产规模工作负载的企业级路径。通过 Google Cloud 的 Vertex AI 平台,你可以获得显著更高的速率限制——300+ RPM 和基于承诺消费的自定义 RPD。Vertex AI 还提供 SLA 保障、优先计算资源分配和 AI Studio 共享池无法比拟的专属容量。每 token 的定价相同,但服务层级本质不同。你需要一个启用了 Vertex AI API 的 Google Cloud 项目和一个服务账户密钥,而不是 AI Studio 的 API key。关于每个层级及其配额的完整分析,请参阅我们的详细速率限制解析。

第三方 API 服务商代表了第四条路径,对于许多开发者来说,这也是解决速率限制最实用的方案。像 laozhang.ai 这样的服务通过自己的基础设施路由请求,没有 RPM 或 RPD 上限,有效地提供对同一底层 Gemini 3 Pro Image 模型的无限制访问。代价是你需要信任第三方处理你的 API 流量,响应时间可能因其负载均衡而有所不同。显著的成本优势——任何分辨率每张图像 $0.05,而官方为 $0.134-$0.24——使这条路径对成本重于 Google SLA 直接覆盖的高量级生产工作负载非常有吸引力。

从 Google 直接 API 迁移到第三方服务商通常非常简单,因为大多数服务商提供 OpenAI 兼容的端点或 Gemini 兼容的透传。对于 laozhang.ai 而言,你只需在现有代码中更改 base URL 和 API key,同时保持相同的 safety_settings 配置和提示词格式。这意味着你的 BLOCK_NONE 设置会延续到底层的 Google API 调用,你可以同时获得速率限制解除、成本降低和与直接访问相同的安全配置控制。

值得注意的是请求配额和吞吐量之间的区别。官方 Paid Tier 1 的 250 RPD 是一个硬性每日上限——一旦达到,请求将失败直到第二天。Vertex AI 和第三方服务商则采用吞吐量模型,没有每日上限,只有并发限制。对于大多数生产架构来说,持续吞吐量比每日配额更重要,这就是为什么第三方服务商的"无限制"标签在实际意义上是有价值的,尽管它在技术上意味着"没有人为的每日上限"而不是"无限的同时请求"。

减少误判与处理 IMAGE_SAFETY 错误

即使配置了 BLOCK_NONE 并启用了计费以获取更高速率限制,许多开发者仍然遇到来自第二层 IMAGE_SAFETY 过滤器的持续拦截。这些拦截特别令人沮丧,因为它们影响的是完全合法的使用场景——电商产品摄影、建筑可视化、医学插图,以及不包含任何不当内容的艺术作品。第二层缺乏详细错误信息使得系统性调试变得困难,但在实践中有几种策略已被证明行之有效。

提示词的具体性可以减少歧义。 IMAGE_SAFETY 分类器更容易标记可被多种方式解释的模糊提示词。与其写"一个穿裙子的女人",不如指定"一位专业时装模特穿着蓝色商务连衣裙在公司办公环境中,编辑摄影风格"。额外的上下文引导图像生成和安全分类器朝向不会触发误判的解释方向。详细的场景描述、明确提及专业语境,以及"编辑摄影"、"纪实"或"商业摄影"等风格修饰词都有助于建立合法意图。

分辨率和种子变化可以改变结果。 因为 IMAGE_SAFETY 评估的是生成的图像而非提示词,相同的提示词在不同尝试中可能产生不同结果。如果特定的生成被拦截,用不同的随机种子重试(通过略微修改提示词或添加无关紧要的细节)可以产生可接受的变体。一些开发者报告说,以 2K 分辨率生成然后放大产生的安全评估结果与直接以 4K 生成不同,但这是经验之谈,很可能取决于具体内容。

2026 年 3 月的策略更新需要关注。 Google 从 2026 年 3 月初开始显著收紧了与人物相关的编辑策略。之前可行的操作——包含人物的照片背景替换、合影合成、修改人物衣着或外貌——现在经常在生成开始前就返回 blockReason: "OTHER"。这是策略级别的限制,不是安全过滤器问题,无论你的 safety_settings 配置如何都会适用。实际影响是,涉及人物主体的图像编辑工作流需要围绕这些新约束进行重新设计,可能需要在使用 API 进行环境生成之前,在预处理中将人物从背景中分离。

带指数退避的重试逻辑很有帮助。 对于生产系统,在 IMAGE_SAFETY 拦截时实现带轻微提示词变化的自动重试可以显著提高吞吐量。一个合理的模式是:尝试生成,在 IMAGE_SAFETY 失败时添加风格修饰词并重试,在第二次失败时略微修改场景描述并重试,在第三次失败时记录该提示词以供人工审查。这种方法通常能在确实符合策略的内容上实现 85-90% 的成功率。

将人物主体与环境生成分离。 遵循 2026 年 3 月围绕人物相关编辑的策略收紧,将人物主体与环境修改结合的工作流面临更高的拦截率。一个更可靠的架构是预处理图像以分割人物主体与背景,单独使用 API 进行环境或背景生成,然后合成结果。这完全避免了触发人物编辑策略检查,同时实现相同的创意效果。像 SAM2(Segment Anything Model 2)或 rembg 这样的工具可以在你调用 Nano Banana Pro API 之前处理分割步骤。

策略性使用负面提示词。 虽然 Nano Banana Pro 不像 Stable Diffusion 那样支持显式的负面提示词,但你可以通过明确图像应包含的内容来实现类似效果,隐式排除有问题的元素。"专业工作室灯光"、"干净的白色背景"和"产品目录风格"等短语建立了一个安全分类器将其解释为商业合法的语境,与含糊的艺术提示词相比显著降低了误判率。

以下是一个 Python 中的实用重试实现,可以优雅地处理 IMAGE_SAFETY 拦截:

pythonimport time import random def generate_with_retry(model, prompt, safety_settings, max_retries=3): """Generate image with automatic retry on IMAGE_SAFETY blocks.""" style_qualifiers = [ ", professional photography style", ", editorial magazine quality, studio lighting", ", commercial product photography, clean composition", ] for attempt in range(max_retries): modified_prompt = prompt + (style_qualifiers[attempt] if attempt > 0 else "") try: response = model.generate_content( modified_prompt, generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) if response.candidates and response.candidates[0].content.parts: return response.candidates[0].content.parts[0].inline_data finish_reason = response.candidates[0].finish_reason if response.candidates else "UNKNOWN" if finish_reason == "IMAGE_SAFETY": print(f"Attempt {attempt + 1}: IMAGE_SAFETY block, retrying with modifier...") time.sleep(2 ** attempt + random.random()) continue else: print(f"Blocked by: {finish_reason}") return None except Exception as e: print(f"API error: {e}") time.sleep(2 ** attempt) print(f"All {max_retries} attempts failed for prompt") return None

第三方 API 服务商——它们实际改变了什么

自模型发布以来,Nano Banana Pro 第三方 API 访问市场迅速增长,laozhang.ai、Kie.ai、EvoLink 等服务商以显著更低的价格提供相同的底层模型。但一些服务商声称的"无限制"或"无审查"访问值得仔细审视,因为第三方服务商能改变和不能改变的东西经常被误导性地宣传。

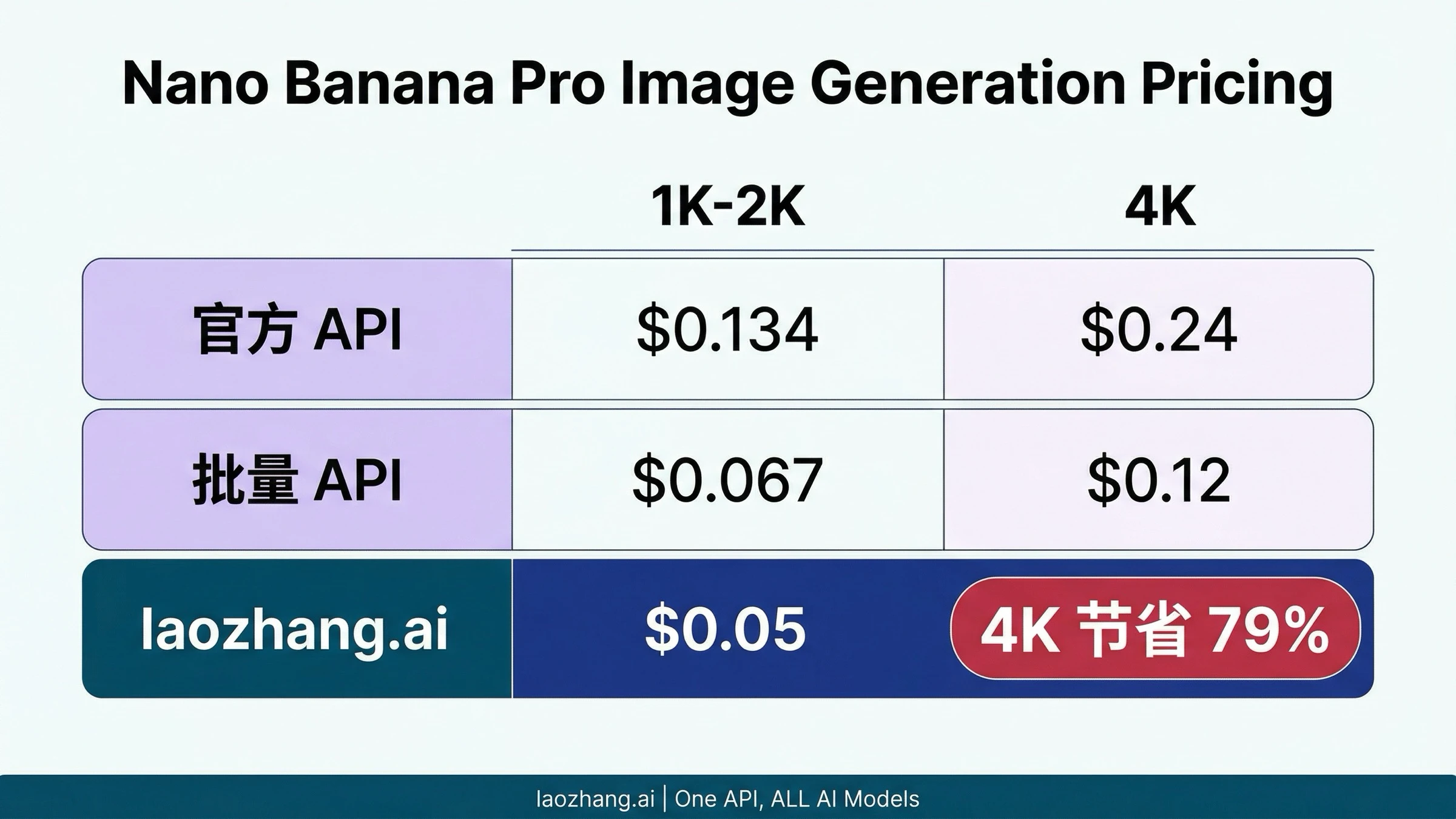

第三方服务商实际提供的是速率限制解除和成本降低。通过汇集多用户的 API 访问量并与 Google 协商批量定价(或维护自己的 Vertex AI 部署),像 laozhang.ai 这样的服务商能够提供每张图像 $0.05 的价格,不分辨率——而官方 API 在 2K 时为 $0.134,4K 时为 $0.24。这在 2K 时节省 63%,在 4K 时节省 79%,在生产规模下累积起来非常可观。他们通常也不设 RPM 或 RPD 限制,完全解决了速率限制维度的问题。想要以最低门槛体验 Nano Banana Pro 图像生成的开发者,还可以在 images.laozhang.ai 进行测试。

| 服务商 | 1K-2K 价格 | 4K 价格 | 速率限制 | 安全配置 |

|---|---|---|---|---|

| 官方 API | $0.134/张 | $0.240/张 | 20 RPM / 250 RPD | 完整 BLOCK_NONE 支持 |

| 批量 API | $0.067/张 | $0.120/张 | 低优先级 | 完整 BLOCK_NONE 支持 |

| laozhang.ai | $0.05/张 | $0.05/张 | 无限制 | BLOCK_NONE 透传 |

| Viyou(声称) | 未标价 | 未标价 | 声称无限制 | 声称"无审查" |

第三方服务商通常无法改变的是第二层安全过滤。因为 IMAGE_SAFETY 检查发生在 Google 基础设施内部的图像生成过程中,一个简单转发请求到 Gemini API 的代理服务会遇到与直接 API 调用相同的第二层拦截。一些服务商声称提供"无审查"或"完全去过滤"的访问,但技术现实是,任何使用 Google 的 Gemini 3 Pro Image 模型的服务都受到 Google 服务端安全评估的约束。对于那些笼统地声称"无限制"而不解释具体技术机制的服务商,请保持警惕——正规的服务商会诚实地告诉你他们能控制和不能控制的范围。

使用第三方服务商的最充分理由不是绕过安全过滤器,而是成本效率和速率限制解除。关于所有访问方式的完整定价分析,包括批量 API 策略,请参阅链接的指南。

大规模无限制访问的成本优化

在生产规模下运行 Nano Banana Pro 需要成本策略。以官方 4K 定价每张图像 $0.24 计算,每天生成 1,000 张图像的费用为每天 $240,约合每月 $7,200。相同的工作负载通过 laozhang.ai 以每张 $0.05 计算,费用为每天 $50 或每月 $1,500——每月差额 $5,700 足以证明架构选择的合理性。

批量 API 为对时效性不敏感的工作负载提供了折中方案。Google 对批处理提供 50% 的折扣,将 2K 图像降至 $0.067,4K 图像降至 $0.120。批量请求优先级较低,处理时间较长,但对于每日内容生成、定时产品摄影或背景素材创建等应用来说,延迟是可接受的。你可以在我们的专门指南中了解更多批量 API 成本优化策略。

基于分辨率的定价创造了另一个优化机会。许多使用场景实际上不需要 4K 生成。社交媒体图像、缩略图、网页横幅和邮件素材在 2K 分辨率下看起来完全可以接受,成本为 $0.134 而非 $0.24——降低了 44%。将 4K 生成保留给首图、印刷素材以及真正需要原生 4K 质量的场景。在 laozhang.ai 的统一 $0.05 定价下,这种区别完全消失了,这通过消除基于分辨率的成本路由逻辑简化了你的架构。

对于每天消耗数千张图像的团队,成本计算强烈倾向于第三方服务商。考虑到每天 5,000 张 4K 图像通过官方 API 需要 $1,200,通过批量 API 需要 $600(如果你能容忍延迟),通过 laozhang.ai 只需 $250。一年下来,官方与第三方之间的差额超过 $300,000——这笔预算足以资助其他方面的重大工程改进。

| 每日量级 | 官方 4K | 批量 4K | laozhang.ai | 年度节省(vs 官方) |

|---|---|---|---|---|

| 100 张 | $24/天 | $12/天 | $5/天 | $6,935 |

| 500 张 | $120/天 | $60/天 | $25/天 | $34,675 |

| 1,000 张 | $240/天 | $120/天 | $50/天 | $69,350 |

| 5,000 张 | $1,200/天 | $600/天 | $250/天 | $346,750 |

Token 成本是许多开发者忽略的隐藏费用。每个 Nano Banana Pro 请求会消耗用于提示词的输入 token(按每百万 token $2.00 计费)和用于生成图像的输出 token(按每百万输出 token $12.00 计费,2K 图像约 1,120 个 token,4K 约 2,000 个 token)。对于文本到图像的工作负载,token 成本已包含在上述每张图像的价格中。但对于发送参考图像作为输入的图像到图像编辑工作流,输入 token 成本可能很显著——一张高分辨率参考图像消耗约 560 个 token,每次请求增加约 $0.001。在每天 5,000 次请求的规模下,这相当于每天额外 $5,相对于输出成本可以忽略不计,但仍值得为成本分配目的进行追踪。

混合架构通常是生产部署中最经济的选择。使用官方批量 API 处理延迟不重要的后台任务(定时内容、产品变体预生成),将实时的、面向用户的请求路由到第三方服务商以获得即时响应和无限吞吐量。这种组合在可预测工作负载上提供成本优化,在交互功能上提供响应性服务,无需签订 Vertex AI 企业合同。

常见问题

使用 BLOCK_NONE 是否违反服务条款?

不违反。BLOCK_NONE 是 Google 专门为需要在应用层管理内容分类的开发者提供的官方文档记录的 API 参数。Google 的文档明确描述了此设置及其行为。你仍然有责任确保你的应用输出符合 Google 的可接受使用政策,但使用该参数本身是完全被认可的。

我能从 Google 直接获得真正无限制的 Nano Banana Pro API 访问吗?

通过与 Google Cloud 销售团队签订承诺消费协议的 Vertex AI,你可以协商自定义速率限制,有效地消除大多数工作负载的实际限制。但这需要与 Google Cloud 销售人员直接沟通,通常涉及每月 $10,000 或更高的承诺消费。对于大多数开发者而言,第三方服务商以极低的成本提供了功能上无限制的访问。

为什么即使设置了 BLOCK_NONE,我的请求仍然被拦截?

因为 BLOCK_NONE 只影响第一层(四个可配置的危害类别)。第二层(IMAGE_SAFETY)使用 AI 分类评估生成的图像本身,且第二层无法通过任何 API 参数配置。如果你看到 finishReason: "IMAGE_SAFETY",拦截来自第二层。尝试用更具体、更专业的上下文来改进你的提示词。

2026 年 3 月的内容策略有什么变化?

Google 显著收紧了与人物相关的编辑限制。包含人物的照片背景替换、合影合成和外貌修改等操作现在经常在生成开始前就触发 blockReason: "OTHER"。这主要影响图像编辑工作流,而非文本到图像生成。

laozhang.ai 适合用于生产工作负载吗?

laozhang.ai 作为一个 API 聚合平台运营,将请求路由到 Google 官方基础设施。它提供与直接 API 访问相同的模型质量,没有 RPM/RPD 限制,定价为每张图像 $0.05(不论分辨率)。对于生产使用,关键考量是你是否愿意通过第三方路由 API 流量,还是更倾向与 Google 保持直接计费关系。许多开发者采用混合方式:敏感或受监管的工作负载使用 Google 直接 API,高量级、成本敏感的操作使用第三方服务商。

Nano Banana 2(Gemini 3.1 Flash Image)在无限制访问方面如何比较?

Nano Banana 2 提供了不同的权衡。它支持免费层级 API 访问(不同于仅付费的 Nano Banana Pro),生成图像更快(4-6 秒 vs 12-18 秒),官方价格也显著更低(1K 图像 $0.067)。但它缺乏原生 4K 生成质量,文本渲染准确率较低(87-96% vs Pro 的 94-96%),且使用相同的双层安全架构。对于 2K 分辨率就足够且成本比峰值质量更重要的许多使用场景,Nano Banana 2 实际上是"无限制"大量级访问的更好选择,因为它包含限额更高的免费层级。

被拦截的请求会收费吗?

对于第一层拦截(finishReason: "SAFETY"),通常不收费,因为拦截发生在图像生成之前。对于第二层拦截(finishReason: "IMAGE_SAFETY"),你需要为输入 token 和生成过程中消耗的输出 token 付费——图像已经被创建但在返回给你之前被拦截了。这对于成本规划是一个关键区别:高比率的 IMAGE_SAFETY 拦截会在不交付可用图像的情况下增加你的成本。监控你的拦截率并优化提示词以减少第二层拦截,直接影响你每张可用图像的实际成本。

现在开始使用 Nano Banana Pro 生成图像最快的方法是什么?

最快的路径是:(1)前往 Google AI Studio(aistudio.google.com),(2)使用你的 Google 账户登录,(3)创建一个 API key,(4)将计费账户链接到你的项目,(5)使用上文代码指南章节中的 Python 或 JavaScript 代码配合你的 API key 和 BLOCK_NONE 安全设置。整个设置过程不到 10 分钟。如果你想完全跳过计费设置,可以立即使用 laozhang.ai 等第三方服务商开始——只需注册账户和获取 API key,无需 Google Cloud 计费配置。