По состоянию на 9 апреля 2026 года нет одного универсального Seedance 2.0 free online сайта, который одинаково и стабильно работал бы для всех. Полезный вопрос сейчас другой: какой путь к Seedance 2.0 действительно официальный, где free означает лишь ограниченный вход, а где перед вами просто удобный, но неофициальный wrapper.

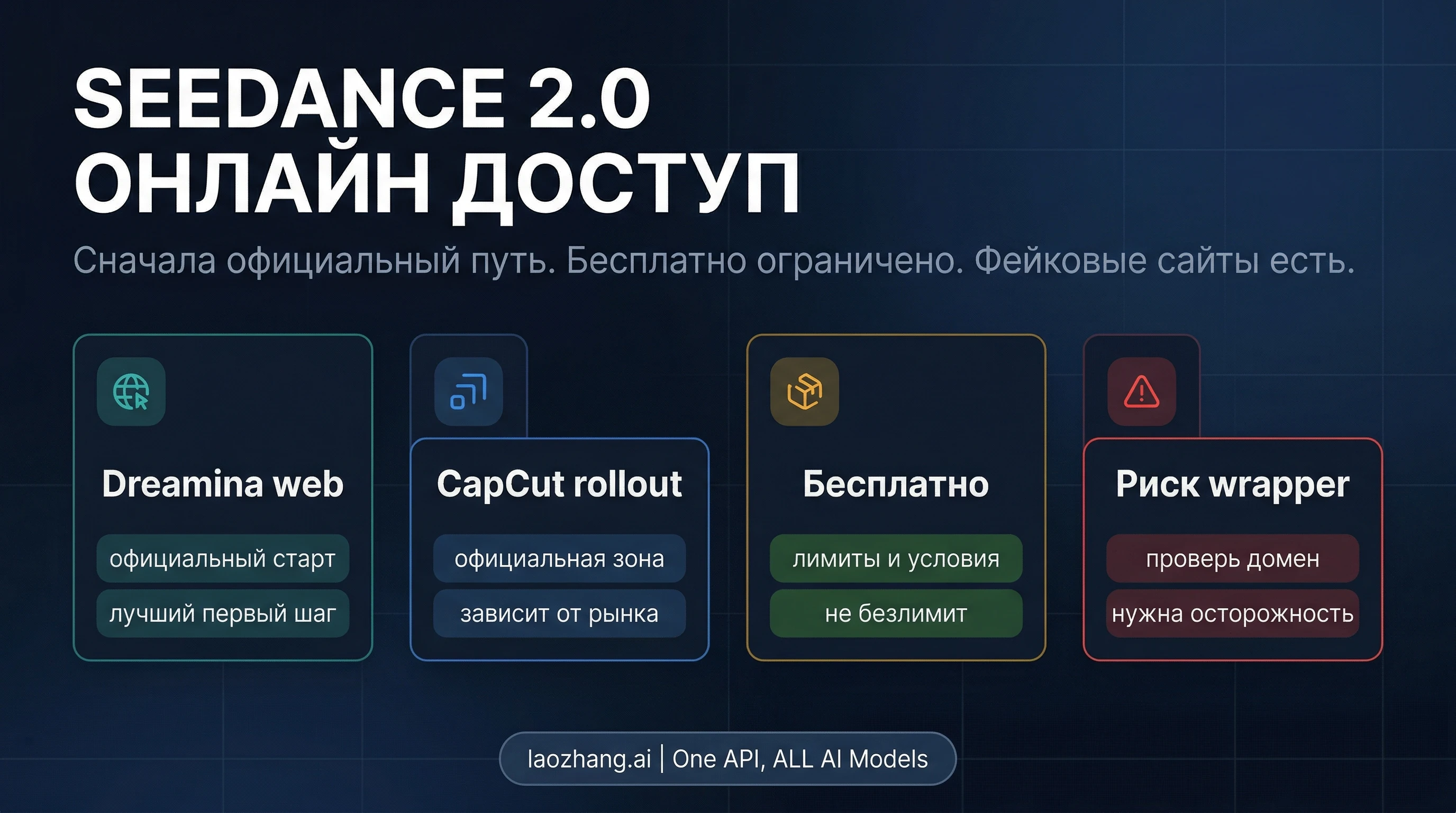

Если вам нужен самый безопасный первый клик, логика обычно такая: сначала проверяйте официальный маршрут через Dreamina, затем смотрите, открыт ли для вас путь через CapCut; если для вас реалистичен китайский first-party путь, оценивайте его отдельно; и только если официальные поверхности недоступны, рассматривайте третьи сайты как fallback, но не как равнозначную замену официального доступа.

Какой путь открыть первым?

Быстрее всего сделать правильный выбор, если не смешивать все страницы с надписью online free в один контракт.

| Если вам нужно… | Первый клик | Почему это самый безопасный старт | Где скрыт подвох |

|---|---|---|---|

| Самый понятный официальный веб-маршрут | Официальная страница Dreamina | Это самый чистый официальный веб-вход и лучший способ быстро проверить легитимность | Конкретный доступ всё ещё зависит от аккаунта и surface |

| Интеграция в редакторский workflow | Путь Seedance 2.0 внутри CapCut | Это официальный маршрут CapCut, а не mimic site | Rollout идёт волнами по рынкам и поверхностям, а не одним глобальным релизом |

| Реально доступный китайский first-party путь | Jimeng или Xiaoyunque, только если это жизнеспособно именно для вас | Это настоящая линия ByteDance, а не слух из старых обзоров | Язык, аккаунт и региональная фрикция здесь реальны |

| Запасной путь, когда официальный маршрут закрыт | Третий сайт только после проверки, кто им управляет | Иногда он помогает просто протестировать модель | Это не тот же уровень доверия, что официальный доступ |

Это и есть главное решение по запросу. Всё остальное в статье нужно только для того, чтобы не перепутать официальный доступ, ограниченный бесплатный вход и неофициальные страницы, которые выглядят слишком убедительно.

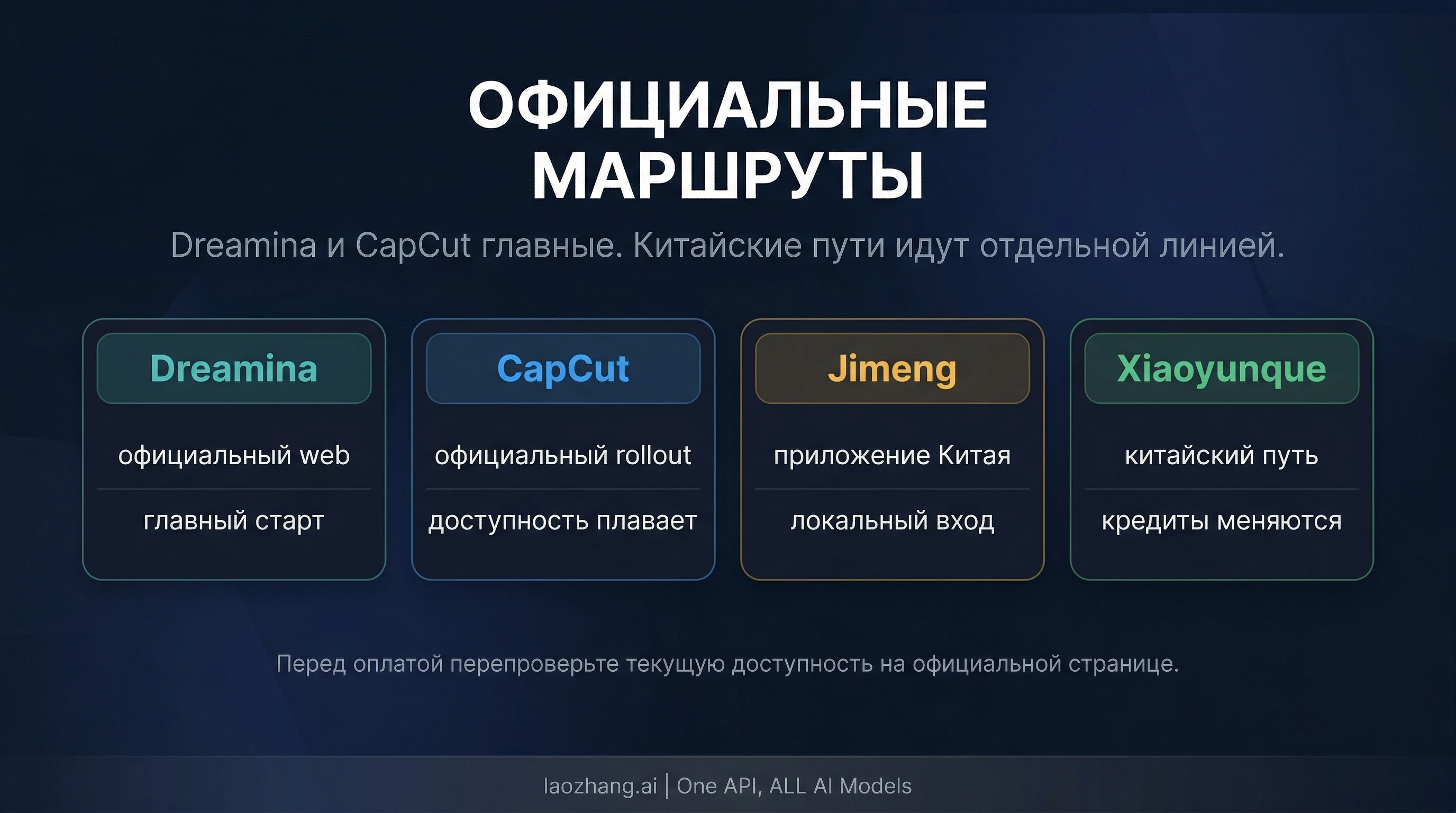

Какие пути сегодня действительно официальные?

История официального доступа сейчас проходит не через один самостоятельный сайт Seedance, а через Dreamina и CapCut. Официальная страница самой модели подтверждает, что Seedance 2.0 это реальная мультимодальная система ByteDance. Но для обычного пользователя практический вопрос доступа решается именно на страницах Dreamina и CapCut, а не на каком-то едином домене с одинаковыми условиями для всех стран и аккаунтов.

Dreamina остаётся самым чистым официальным веб-маршрутом

Если вы начинаете из браузера и хотите сначала закрыть вопрос доверия, Dreamina остаётся лучшей первой остановкой. Именно там официальный текст прямо позиционирует маршрут как официальный веб-вход, а не как стороннюю упаковку вокруг чужого продукта.

При этом Dreamina часто переоценивают. Текущие официальные страницы не поддерживают тезис о том, что каждый читатель получает одинаковый, стабильный и бессрочный бесплатный онлайн-доступ. Безопаснее считать Dreamina официальной веб-поверхностью, а затем уже смотреть, что именно открыто вашему аккаунту и вашему текущему surface.

CapCut официальен тоже, но это не тот же самый контракт

CapCut продвигает Seedance 2.0 как реальный онлайн-инструмент и говорит о web, desktop и mobile-поверхностях. Но в официальном rollout-языке важна оговорка: доступ разворачивается поэтапно и зависит от рынка и surface, а не выглядит как единый глобальный запуск, одновременно открытый всем.

Поэтому правильная формулировка не такая: Dreamina и CapCut одинаково открыты везде. Правильнее так: Dreamina и CapCut это два связанных официальных маршрута с разной логикой доступа. Если вы уже живёте внутри CapCut, его путь может быть самым удобным. Если вы просто хотите понять, где сегодня самый понятный официальный вход, Dreamina по-прежнему чище как первый клик.

Китайские приложения нужно держать в отдельной полосе

Русскоязычные разборы часто делают здесь ту же ошибку, что и англоязычные старые гайды: они складывают Dreamina, CapCut, Jimeng, Xiaoyunque и случайные wrapper-страницы в один список где можно пользоваться. Но для читателя это плохая карта.

Корректнее сказать так: Jimeng и Xiaoyunque это отдельный китайский first-party путь. Он может быть практичным, если для вас реальны китайский язык, регистрация и региональная фрикция. Но он не должен выглядеть как просто ещё одна кнопка того же международного веб-маршрута.

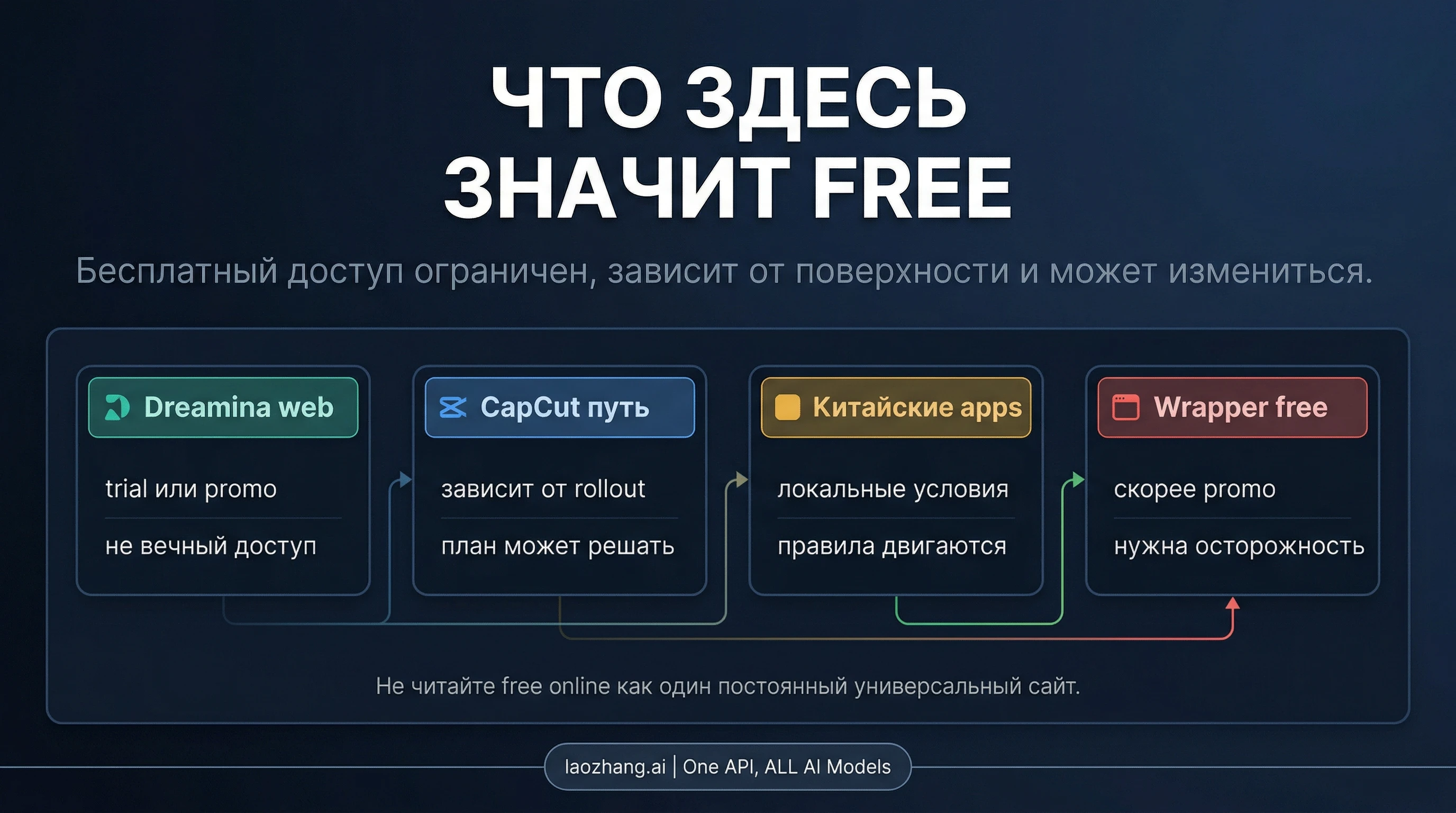

Что на самом деле означает free?

Самое опасное слово в этой теме сейчас именно free. На официальных страницах вы действительно встретите try for free, но это не то же самое, что универсальный долгосрочный бесплатный контракт для любого пользователя.

Полезнее читать free как одно из четырёх разных состояний:

- ограниченный вход или пробный старт на официальной веб-поверхности;

- поэтапный rollout, где доступ зависит от рынка, аккаунта или платного слоя;

- китайский локальный путь со своими условиями доступа;

- маркетинговое обещание wrapper-страницы, которое звучит шире, чем реальный уровень доверия.

Поэтому вопрос не в том, бесплатен ли Seedance 2.0 вообще. Гораздо полезнее спросить: дает ли этот маршрут достаточно дешёвый и низкотрения вход, чтобы я понял, подходит ли мне Seedance 2.0 вообще.

Именно поэтому эта обновлённая страница не повторяет из памяти старые точные числа по кредитам и пакетам. Текущие официальные страницы не дают одной стабильной таблицы, которую можно честно перенести на Dreamina, CapCut и все остальные пути сразу. Если ваш реальный вопрос уже перешёл в цену и окупаемость, лучше сразу открыть ценовой гид.

Что делать, если официальный путь недоступен?

Многим читателям нужен не абсолютный победитель, а ответ на более приземлённый вопрос: я попробовал официальный вход, он мне сейчас не открылся, что дальше.

Если вы хотите остаться как можно ближе к официальному доступу

Сначала перепроверьте Dreamina и CapCut, а не бегите к первому попавшемуся стороннему результату. Часто лучший fallback это не другой сервис, а другой официальный surface или просто признание того, что текущий rollout пока не делает этот путь одинаково доступным всем.

Если для вас реалистичен китайский first-party путь

Смотрите на него как на отдельный маршрут, а не как на скрытую версию той же международной схемы. Если вы готовы к языковому и региональному трению, он может быть практичным вариантом. Если нет, не стоит объявлять его настоящим ответом только потому, что он кажется дешевле на бумаге.

Если вы уже смотрите на неофициальный третий сайт

Здесь и нужна калибровка доверия. Такой путь действительно может помочь просто протестировать модель, но он не наследует автоматически легитимность Dreamina или CapCut. Вам нужно отдельно проверить:

- кто управляет сайтом;

- насколько прозрачно там устроено ценообразование;

- насколько понятны ограничения и долгосрочная стабильность;

- не выдаёт ли сайт запасной путь за официальный.

Самое полезное правило здесь простое: если третья страница нужна вам только потому, что официальный вход сейчас неудобен, значит это fallback, а не официальный маршрут.

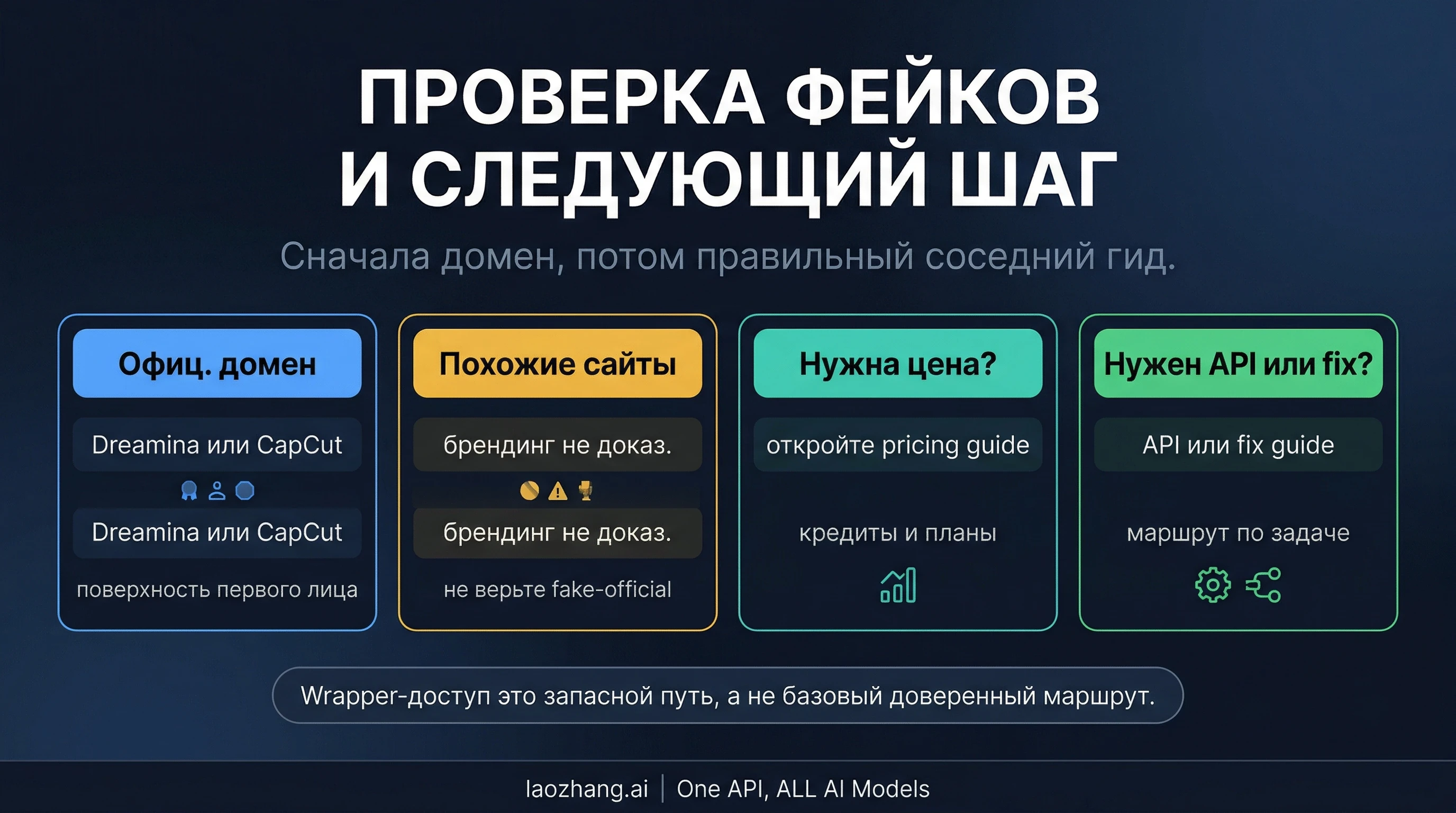

Как проверить домен до клика

Dreamina делает полезную вещь, которую многие обзорные статьи не делают: прямо предупреждает, что seedance2.ai, seedance2.app и seedance.tv не являются официальными сайтами ByteDance. В текущем поисковом ландшафте это не мелкая деталь, а часть главного ответа.

Если делать только одну проверку перед регистрацией или оплатой, пусть это будет проверка домена:

- Подтвердите, что вы всё ещё на официальной Dreamina-, CapCut- или ByteDance-поверхности.

- Не считайте сам бренд

Seedanceдоказательством официальности. - Особенно осторожно относитесь к страницам, которые обещают широкий

free onlineдоступ, но не говорят честно, кто ими управляет.

Это не означает, что каждый третий сайт автоматически вредоносный. Но официальный путь начинается с легитимности и дальше спрашивает, открыт ли он вам. Неофициальный путь начинается с удобства и только потом должен отдельно доказывать легитимность. Если перепутать этот порядок, статья превращается в список самых кликабельных кнопок, а не в нормальный гид по доступу.

Куда идти дальше, когда вопрос доступа уже решён

У этой страницы должна быть узкая задача: помочь выбрать маршрут. Она не должна заново превращаться в ценовой гид, API-гид и troubleshooting-энциклопедию одновременно.

Если ваш вопрос уже сменился, используйте соседние страницы:

- если теперь вы сравниваете пробный доступ, долгосрочные расходы и стоимость разных путей, откройте ценовой гид по Seedance 2.0;

- если вас интересует программный доступ, откройте гид по API Seedance 2.0;

- если маршрут официальный, но поверхность работает странно или не открывается, откройте гайд по устранению неполадок Seedance 2.0;

- если вопрос доступа уже закрыт, а дальше нужно выбирать семейство моделей, откройте сравнение Seedance 2.0, Kling 3, Sora 2 и Veo 3.1.

Такое разделение сделано специально: оно удерживает эту страницу в роли route-choice гида вместо старой формы полное руководство обо всём сразу.

Часто задаваемые вопросы

Есть ли официальный сайт Seedance 2.0?

Да, но не в том упрощённом смысле, который создают многие поисковые результаты. Seedance 2.0 это официальная модель ByteDance, однако практический онлайн-доступ для обычного пользователя сегодня проходит через поверхности Dreamina и CapCut.

Можно ли пользоваться Seedance 2.0 бесплатно?

Вы можете получить ограниченный или surface-specific бесплатный вход, но не стоит читать это как универсальный бессрочный бесплатный контракт. Самая безопасная формулировка: официальный try for free нужно понимать как ограниченный вход, если только конкретная поверхность не докажет большее.

Официальен ли seedance.tv?

Нет. На официальной странице Dreamina прямо указано, что seedance.tv, seedance2.ai и seedance2.app не являются официальными сайтами ByteDance.

Что делать, если Dreamina или CapCut мне недоступны?

Сначала решите, хотите ли вы оставаться внутри официальных поверхностей и ждать другой вход, реалистичен ли для вас китайский first-party путь, или вы готовы использовать неофициальный fallback с более высоким порогом доверия. Правильный следующий шаг зависит от того, какое трение вы готовы принять.

Где смотреть цены, API и сравнение с другими моделями?

За ценами идите в ценовой гид, за программным доступом в API-гид, за проблемами доступа в гайд по устранению неполадок, а за выбором семейства моделей в сравнение моделей.