Gemma 4 — это не одна модель. Если запомнить только одну мысль, пусть это будет она: E2B и E4B — это edge-ветка, а 26B A4B и 31B — ветка для рабочей станции. По состоянию на 3 апреля 2026 года это разделение важнее любого отдельного benchmark-скриншота, потому что именно оно определяет, с чего вам начинать: с телефона, ноутбука, рабочей станции или официального онлайн-входа для быстрого теста.

Именно этим Gemma 4 отличается от обычного анонса «ещё одной новой модели». Это не просто следующий open release от Google в абстрактном смысле. Это семейство из четырёх моделей под Apache 2.0, где малая ветка построена вокруг эффективности, локального запуска и мобильных сценариев, а большая ветка — вокруг более длинного контекста и более тяжёлого локального вывода на железе разработчика. Если читать только launch pages, всё это легко кажется перегруженным. Практически полезнее свести решение к одному вопросу: вам нужна модель для устройства или модель для рабочей станции?

Ключевые факты этой статьи сверены 3 апреля 2026 года по release log Gemma, launch blog, model card Gemma 4, pricing page Gemini Developer API и Android Developers Blog.

С чего начать: какую ветку Gemma 4 выбрать первой

| Если ваша реальная цель — | Начинать стоит с | Почему | Главный компромисс |

|---|---|---|---|

| Offline или low-latency модель для edge, mobile и небольших локальных устройств | E4B | Самый разумный базовый вариант для edge: заметно сильнее E2B, но всё ещё ориентирован на эффективный локальный запуск | Потолок ниже, чем у большой ветки; это не лучший выбор для самого тяжёлого workstation reasoning |

| Самая лёгкая точка входа в Gemma 4 при сохранении преимуществ нового семейства | E2B | Логичный выбор, когда RAM, battery или latency — это реальное ограничение | Возможности ниже, чем у E4B, особенно на более сложных задачах |

| Сильная workstation-class локальная модель без автоматического перехода к самому тяжёлому dense варианту | 26B A4B | MoE-архитектура активирует только 3.8B параметров на инференсе, поэтому для многих это и есть практический default | История модели сложнее, чем у обычного dense flagship |

| Самый тяжёлый dense вариант в семействе Gemma 4 | 31B | Имеет смысл, когда вы сознательно выбираете raw dense-model quality или базу для fine-tuning | Потребности по железу выше, чем у 26B A4B |

| Попробовать большую ветку до self-hosting | 26B A4B или 31B в AI Studio | Самый быстрый официальный путь почувствовать большую ветку до сборки локального стека | Текущая pricing page не описывает Gemma 4 как обычный платный hosted SKU |

| On-device audio / speech understanding | E4B или E2B | Audio нативно поддерживается на малой ветке | У больших моделей такая же аудио-позиция не заявлена |

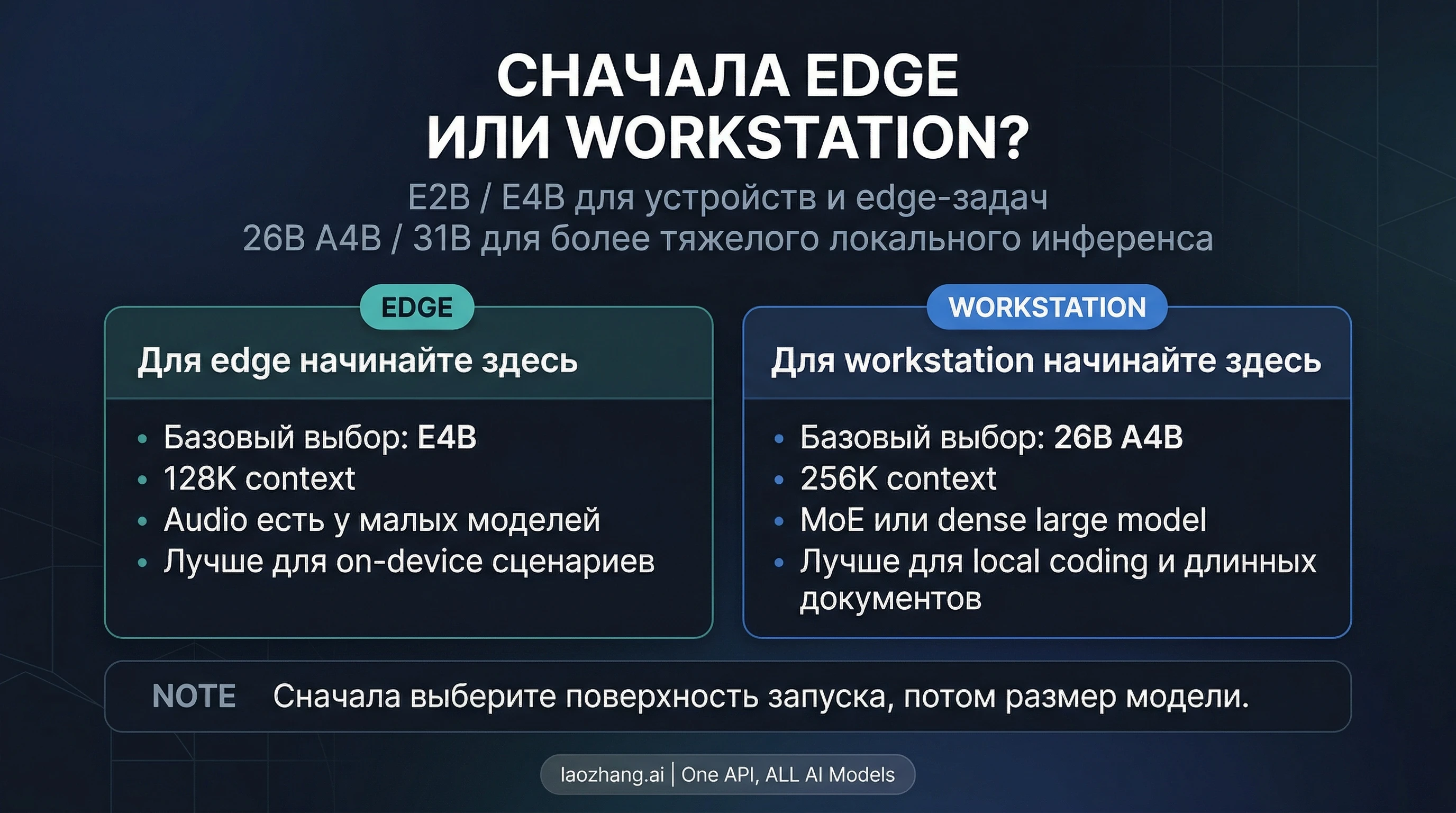

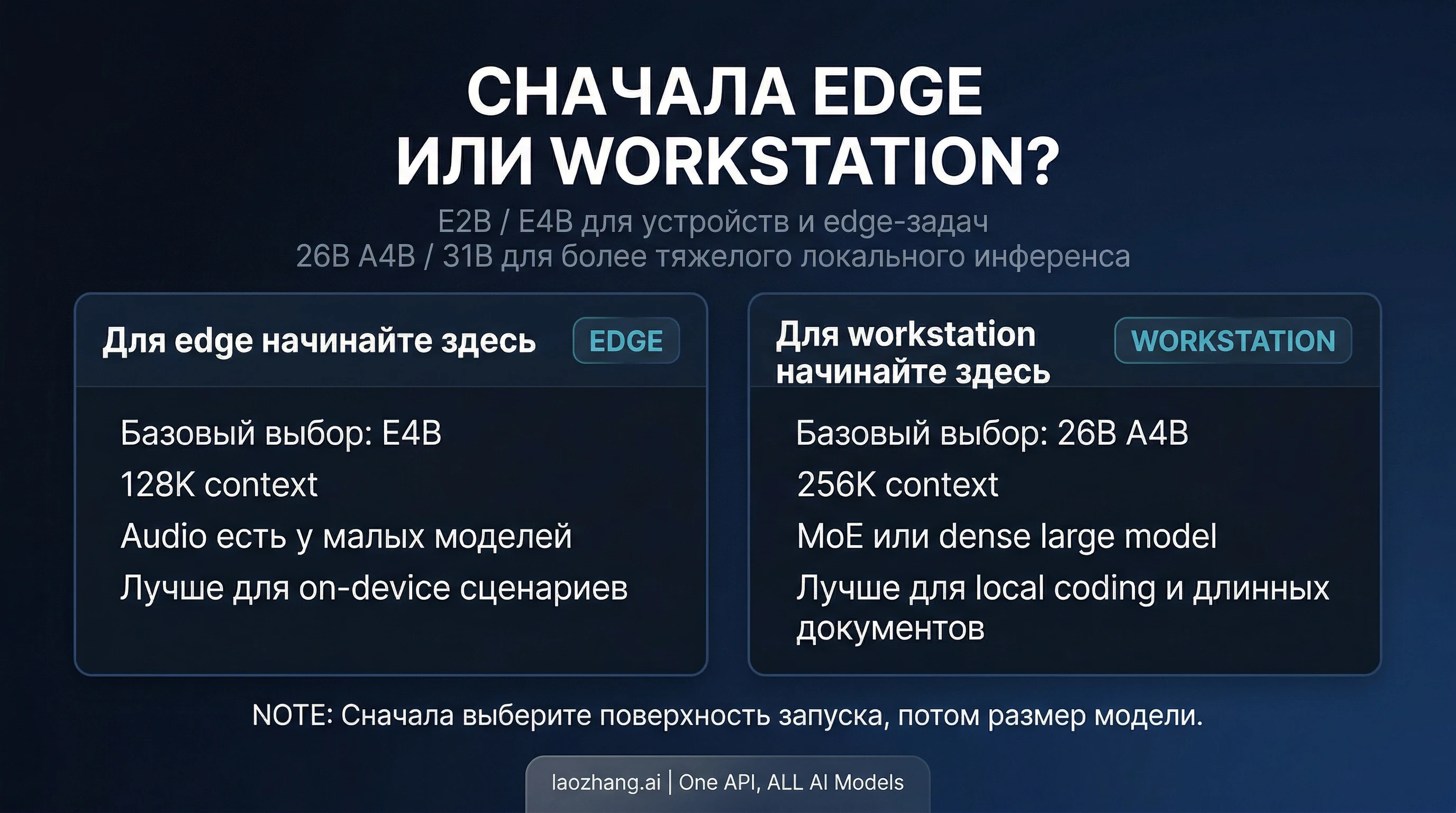

Самая чистая рекомендация очень проста: если вы стартуете с edge-железа, начинайте с E4B; если вы стартуете с рабочей станции, начинайте с 26B A4B. Это две самые разумные первые точки оценки, если только вы заранее не знаете, что вам нужен либо самый маленький footprint, либо сознательно dense 31B.

Что такое Gemma 4 на самом деле

Gemma 4 — это новейшее открытое семейство моделей Google. В official release log оно зафиксировано 31 марта 2026 года, а публичный launch blog датирован 2 апреля 2026 года. Google позиционирует Gemma 4 как open-model ветку, стоящую рядом с исследовательской и инфраструктурной линией Gemini 3, но это не означает, что Gemma 4 — просто «Gemini подешевле». Реальное различие здесь операционное: Gemma — это open-weight семейство, которое вы можете запускать, адаптировать и разворачивать сами, а Gemini — это управляемая модельная линия Google.

Это важно, потому что меняет сам тип решения. Выбор Gemini чаще всего является решением про цену, API и managed access. Выбор Gemma 4 — это сначала решение о том, где вы вообще собираетесь ее запускать. Вы выбираете между локальной edge-моделью, локальной моделью для рабочей станции и онлайн-точкой входа, которая нужна лишь для оценки open model до того, как вы решите, как именно её разворачивать.

Google в этот раз также гораздо яснее очерчивает продуктовую границу, чем во многих других циклах запусков. Официальный model card описывает Gemma 4 как семейство multimodal open models с text и image input, с native audio на малой ветке и text output по всей линейке. Эту деталь стоит проговорить напрямую, потому что вокруг неё легко возникает путаница: Gemma 4 не является image generator или video generator. Это открытое мультимодальное семейство для text output, reasoning, coding, OCR-подобного понимания и смежных сценариев.

Настоящий разлом: edge-модели против workstation-моделей

Самый полезный способ читать семейство Gemma 4 — не спрашивать, какая модель «лучшая вообще». Гораздо полезнее спросить, какую deployment-проблему решает каждая ветка.

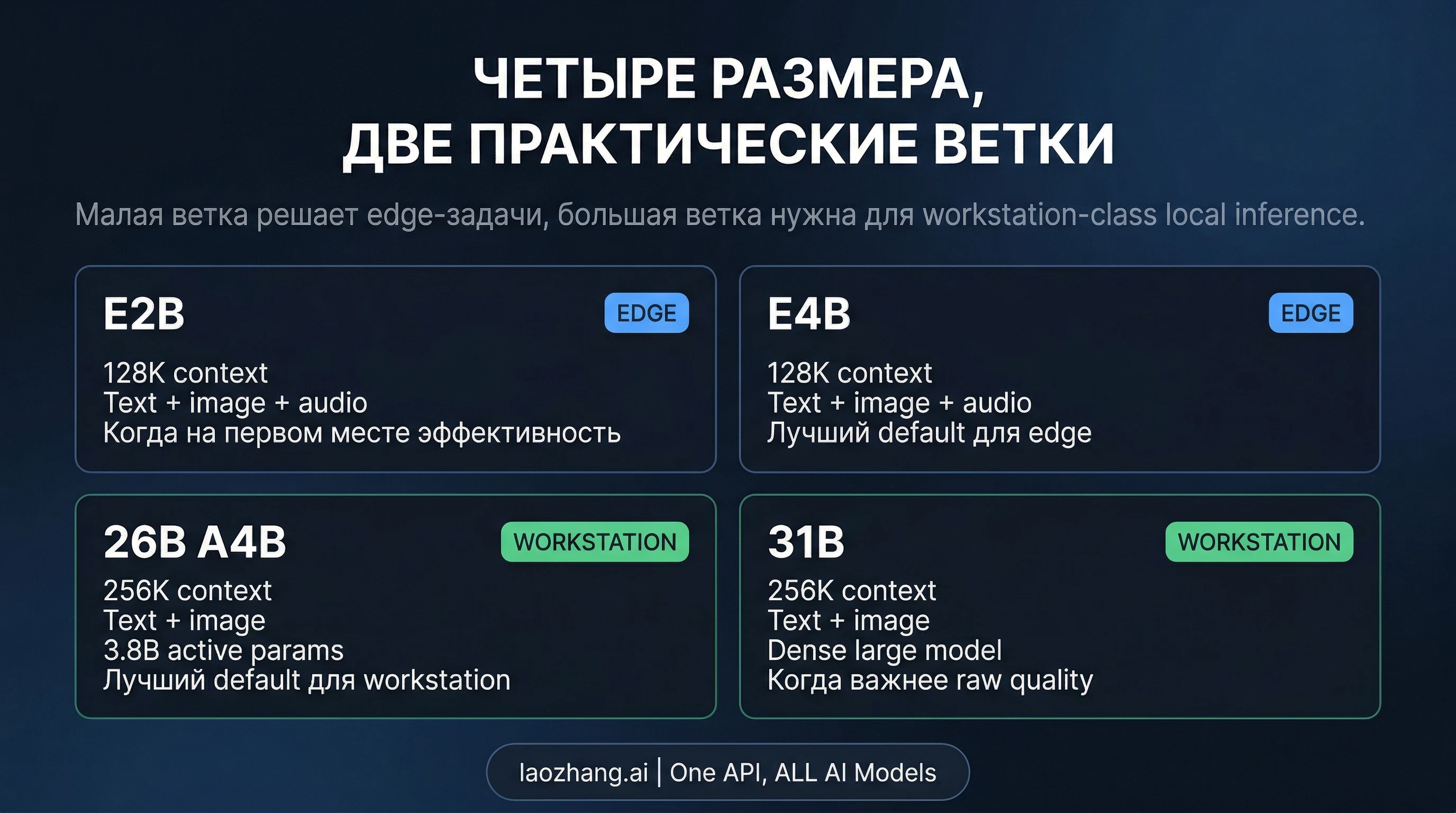

Edge-ветка — это E2B и E4B. Согласно official model card, обе модели поддерживают 128K context, text и image input, а также native audio input. Android announcement от Google тоже ясно показывает, что именно эта ветка должна питать следующий этап Gemini Nano на устройствах. Это означает, что эти модели не просто «меньше». Это часть семейства, которая должна иметь значение там, где latency, local execution, battery life и ограниченное железо важнее максимального ceiling.

Внутри этой ветки именно E4B выглядит лучшим default для большинства серьёзных сценариев. Она даёт больше запаса, чем E2B, но остаётся в той части семейства, которую Google явно продвигает в on-device и edge workflows. E2B — более специализированный выбор: к нему стоит идти, когда эффективность является первым ограничением и вы осознанно меняете потолок на меньший footprint.

Workstation-ветка — это 26B A4B и 31B. Обе модели поднимают окно до 256K context, а это реальная прибавка для длинных документов, больших code contexts и более тяжёлых local reasoning flows. Они также сдвигают Gemma 4 из чисто edge-сценария в сторону developer hardware, рабочих станций и production-style self-hosting.

Здесь особенно интересна 26B A4B. Official model card описывает её как Mixture-of-Experts модель с 25.2B total parameters, но только 3.8B active parameters во время инференса. На практике это делает её наиболее вероятным workstation default для очень многих читателей. Вы получаете длинный контекст и более сильную reasoning-ветку, не превращая самый тяжёлый dense вариант в автоматическую стартовую точку. Если вам нужен «большой Gemma 4» без обязательного перехода к максимальному dense footprint, то 26B A4B — первая серьёзная остановка.

31B — это dense large model. Она имеет смысл тогда, когда вы сознательно хотите raw dense-model quality или более тяжёлую dense-base для экспериментов и fine-tuning и готовы заплатить соответствующую цену по железу. Важный момент: не стоит автоматически делать из 31B ответ по умолчанию только потому, что у неё самый большой номер. Для многих локальных разработчиков 26B A4B останется более практичной первой точкой.

Что реально изменилось по сравнению с Gemma 3

Переход от Gemma 3 к Gemma 4 важен не по самой поверхностной причине вроде «числа на benchmark стали выше». Более глубокое изменение в том, что Google привёл семейство в гораздо более пригодную к использованию форму.

Во-первых, большая ветка теперь даёт 256K context, тогда как малая ветка держит 128K. Это важно, потому что делает Gemma 4 более серьёзным кандидатом для long-document и repository-scale local work, чем типичный релиз маленькой open model. Во-вторых, и launch materials, и model card явно подчёркивают native system-role support и native function-calling posture, что имеет значение для agentic и structured workflows. В-третьих, сама форма семейства стала осмысленнее: edge-модели больше не выглядят как побочный довесок, а workstation-ветка больше не сводится к одному неразличимому «большому варианту».

Есть и конкретные capability gains. В official model card модель 31B показывает существенно более сильные reasoning-результаты, чем Gemma 3 27B, на ряде показательных benchmark'ов, включая AIME-подобную математику и LiveCodeBench-подобный coding. Это не значит, что всю статью нужно превращать в культ benchmark'ов. Это значит, что релиз не косметический. Под новой семейной конструкцией лежит реальная история роста возможностей.

Ещё одно важное изменение — ясность по способам запуска. Google явно показывает Gemma 4 как семейство, которое можно использовать с нескольких сторон: AI Studio для быстрой проверки большой ветки, AI Edge и Android для on-device сценариев, а также Hugging Face Transformers, Ollama, MLX, llama.cpp и vLLM для self-hosted запусков. Это полезнее, чем просто сказать «Gemma 4 стала умнее». Правильнее сказать иначе: Google яснее показал, куда в реальном мире должна вставать каждая ветка Gemma 4.

Где сегодня запускать Gemma 4

То, где именно стоит запускать Gemma 4, зависит от того, какую ветку вы только что выбрали.

Если вам нужен самый простой официальный способ попробовать большую ветку, launch blog Google указывает на AI Studio для 31B и 26B A4B. Это самый быстрый официальный путь, чтобы почувствовать workstation-ветку без предварительной сборки локального стека. Но здесь есть важная граница: текущая pricing page Gemini Developer API показывает Gemma 4 как free only и не оформляет её как обычный paid Gemma API tier. Иными словами, «попробовать онлайн можно» — это верно. Но описывать текущую картину как стандартный платный hosted-вариант, аналогичный managed Gemini route, было бы неточно.

Если вас интересует edge-ветка, официальные сигналы ведут в другую сторону. Android Developers Blog связывает Gemma 4 с AICore Developer Preview и будущими Gemini Nano 4-enabled devices, а launch materials указывают на AI Edge как на основной путь для E4B и E2B. Благодаря этому малая ветка выглядит не как игрушечный релиз, а как реальный путь для on-device use.

Если вам нужен self-hosted local control, в launch materials Google перечисляет привычную open-model ecosystem: Hugging Face, Kaggle, Ollama, Transformers, MLX, llama.cpp, vLLM и другие runtimes. Именно туда стоит идти, если ваша реальная цель — локально запустить Gemma 4 на рабочей станции, встроить её в coding workflow или включить в более широкий local stack. Если это ваш следующий шаг, то практичнее читать не ещё один launch recap, а наш полный гид по настройке LLM в OpenClaw.

Если же вы уже думаете о production-scale deployment, Google ведёт эту историю в сторону Google Cloud, а не в сторону простого pay-as-you-go Gemma 4 line item в текущей Gemini pricing table. Это важная продуктовая граница. Фраза «Gemma 4 можно запускать внутри экосистемы Google» — верна. Фраза «Gemma 4 сейчас ведёт себя как обычная платная hosted Gemini model» — не соответствует тому, что сегодня показывает pricing page.

Лучшие стартовые выборы по сценариям

Если вам нужен общий default для edge-сценариев, начинайте с E4B. Именно эта модель лучше всего балансирует очевидный продуктовый push Google в сторону edge и реальную достаточность для локального multimodal use.

Если ваш реальный bottleneck — это tight memory, battery или latency, начинайте с E2B. Это не default для всего семейства, но это самый честный ответ, когда footprint важнее потолка возможностей.

Если вам нужна локальная coding или reasoning модель на workstation-class hardware, начинайте с 26B A4B. Это самый важный практический вывод из всей статьи. MoE-архитектура даёт путь в большую ветку без того, чтобы самый тяжёлый dense вариант автоматически становился первой остановкой. Для многих разработчиков, которым нужен локальный open model для coding, reasoning и более длинного контекста, именно 26B A4B будет самым умным первым кандидатом на оценку.

Если на первом месте raw dense-model quality или запас для fine-tuning, переходите к 31B. Плотная 31B — правильный выбор, когда у вас более сильный hardware budget и вы сознательно хотите dense-маршрут, а не просто идёте за самым большим числом в линейке.

Если вам нужен именно on-device audio understanding, оставайтесь на ветке E2B / E4B. Model card достаточно ясно описывает продуктовую границу audio support, и она важнее, чем погоня за максимальным числом параметров не в той ветке.

Если вы просто хотите понять, стоит ли Gemma 4 вашего времени, не тратьте часы на сборку локального стека раньше времени. Для большой ветки начинайте с AI Studio, для малой — с Android / AI Edge preview пути. Наихудший первый шаг — это собирать local deployment для ветки, которую вы ещё даже не выбрали.

Когда Gemma 4 — неправильный ответ

Gemma 4 легко переоценить, потому что она одновременно попадает в несколько очень привлекательных категорий: open weights, Apache 2.0, длинный контекст, сильный reasoning posture и реальная edge ambition. Но это всё равно не делает её лучшим маршрутом для каждого пользователя.

Если на самом деле вам нужен понятный managed API с прозрачной платной схемой, Gemma 4 сегодня не так прямолинейна, как managed Gemini route. Именно в этом и состоит ценность текущей pricing page: она достаточно честно показывает эту границу. В таком случае полезнее перейти к нашему руководству по ценам Gemini API, потому что именно там разбирается логика managed-стоимости.

Если вам нужен максимально сильный closed-model frontier stack без какого-либо self-hosting или работы с open weights, Gemma 4 тоже может оказаться не тем, что вы реально ищете. Её сила в открытости и deployability, а не в том, чтобы стереть разницу между open models и managed frontier systems.

Если же вам нужны генерация изображений или видео, Gemma 4 тем более не является правильным семейством. Official model card здесь достаточно ясен: Gemma 4 — это multimodal open model family, которое принимает текст и визуальный input и генерирует text output. Это не image-generation и не video-generation продуктовая линия Google.

Правильная ментальная модель

Лучше всего думать о Gemma 4 не как о ещё одном launch-week бренде, а как о двухветочном открытом семействе.

Первая ветка — это edge-ветка: E2B и E4B, где важнее local execution, multimodal on-device use и device-level practicality. Вторая ветка — это ветка для рабочей станции: 26B A4B и 31B, где смысл в длинном контексте и более тяжёлом local reasoning. Если вы сначала правильно выбираете ветку, всё остальное в Gemma 4 становится довольно простым. Если же вы пропускаете этот шаг, четыре модели снова сливаются в одну запутанную массу.

Поэтому и самый полезный quick answer остаётся самым простым: если вам нужна серьёзная edge-ветка, начинайте с E4B; если нужна серьёзная workstation-ветка, начинайте с 26B A4B. В меньшую сторону идите только тогда, когда bottleneck — это эффективность, а в большую dense-сторону — только если вы заранее понимаете цену 31B.