Nano Banana 2(Gemini 3.1 Flash Image, 모델 ID gemini-3.1-flash-image-preview)에서 blockReason OTHER가 발생하면, 이는 Google의 Layer 2 정책 시행에 의해 요청이 차단되었다는 뜻입니다. Layer 2는 서버 측 비구성 필터로, 안전 임계값을 BLOCK_NONE이나 OFF로 설정해도 우회할 수 없습니다. 2026년 3월 기준으로 이 필터는 저작권 캐릭터, 공인, NSFW 콘텐츠를 포함한 8가지 콘텐츠 카테고리를 다루고 있습니다. 이 가이드에서는 blockReason과 finishReason의 완전한 매핑, 이중 레이어 안전 아키텍처를 설명하고, 프로덕션 환경에서 바로 사용할 수 있는 코드와 함께 5가지 검증된 해결법을 제공합니다.

핵심 요약

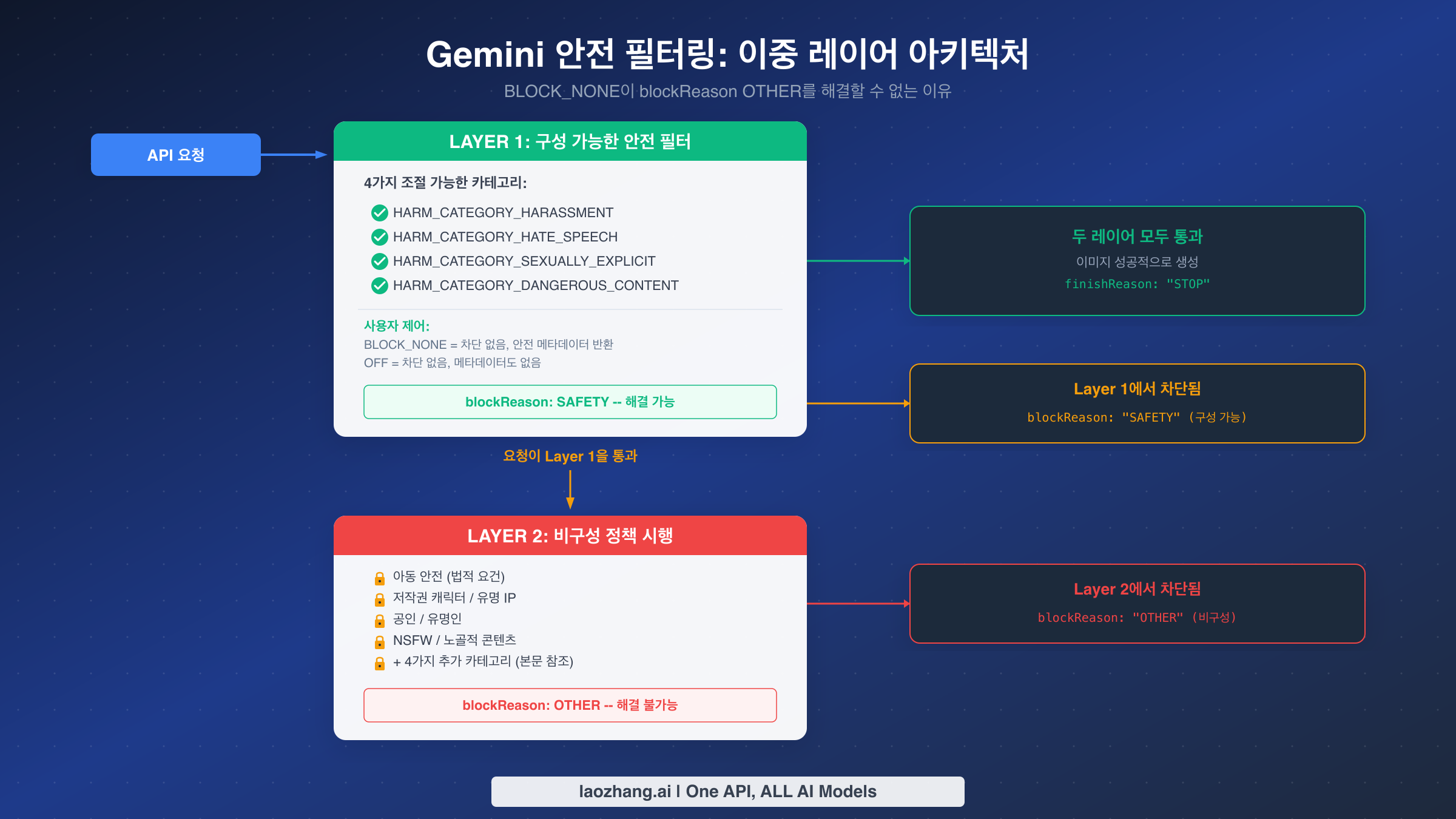

- blockReason OTHER ≠ blockReason SAFETY: OTHER는 Layer 2(비구성 정책 시행)에서, SAFETY는 Layer 1(

harm_block_threshold로 조절 가능)에서 발생합니다.BLOCK_NONE이나OFF설정은 Layer 1에만 적용되므로 Layer 2 차단은 절대 해결할 수 없습니다. - 8가지 콘텐츠 카테고리가 blockReason OTHER를 트리거: NSFW 콘텐츠, 저작권 캐릭터/유명 IP, 공인, 미성년자 보호, 워터마크 제거, 금융 정보 수정, 의상/얼굴 교체, 암시적 선정 콘텐츠입니다. 2026년 3월에 이 중 4개 카테고리의 시행이 강화되었습니다.

- blockReason과 finishReason은 서로 다른 필드:

blockReason은 프롬프트가 생성 시작 전에 거부될 때 나타나며(토큰 소모 없음),finishReason은 콘텐츠가 생성 중이나 생성 후에 차단될 때 나타납니다(토큰 이미 소모됨). 두 필드 모두 OTHER 관련 값을 반환할 수 있습니다. - python-genai SDK 버그: 차단된 응답에서

response.candidates[0].finish_reason에 접근하면 candidates 배열이 비어 있어 무한 대기 상태에 빠집니다. 반드시len(response.candidates) > 0을 먼저 확인하세요. - 5가지 검증된 우회 방법: 프롬프트 재작성, 저작권 참조 제거, 복잡한 프롬프트 분할, 타임아웃과 모델 폴백 추가, 또는 대체 이미지 모델(GPT Image, FLUX.2)을 폴백 파이프라인으로 사용하는 방법이 있습니다.

blockReason OTHER가 실제로 의미하는 것

Nano Banana 2에 이미지 생성 요청을 보내고 API 응답에서 blockReason: "OTHER"를 받았다면, 이미지 생성이 시작되기 전에 Google의 두 번째 콘텐츠 필터링 레이어에서 프롬프트가 차단되었다는 의미입니다. 이것은 안전 설정을 통해 제어할 수 있는 첫 번째 필터링 레이어에서 오는 blockReason: "SAFETY" 응답과는 근본적으로 다릅니다. 이 차이를 이해하는 것이 에러를 해결하기 위한 가장 중요한 첫 단계입니다. 이 구분에 따라 설정 변경으로 문제를 해결할 수 있는지, 아니면 완전히 다른 접근 방식이 필요한지가 결정되기 때문입니다.

blockReason과 finishReason의 혼동은 Gemini 이미지 생성 API를 다루는 개발자들이 가장 많이 겪는 두 번째 혼란 요소입니다. 이 두 필드는 응답의 서로 다른 위치에 나타나고, 과금에 대한 의미도 다르며, 각각 다른 문제 해결 전략이 필요합니다. 아래 표는 지금까지 5개의 개별 문서를 읽어야만 종합할 수 있었던 완전한 매핑을 한곳에 정리한 것입니다.

blockReason 값 (프롬프트 수준 차단)

blockReason 필드는 API 응답의 prompt_feedback 섹션에 나타납니다. 이 필드가 존재하면 생성이 시작되기 전에 프롬프트가 거부된 것이므로, 토큰이 소모되지 않으며 부분 이미지도 존재하지 않습니다.

| blockReason 값 | 소스 레이어 | 구성 가능? | 의미 |

|---|---|---|---|

SAFETY | Layer 1 | 예 (harm_block_threshold 사용) | 4가지 유해성 카테고리 중 하나가 설정된 임계값을 초과했습니다. BLOCK_NONE 또는 OFF로 설정하면 해결됩니다. |

OTHER | Layer 2 | 아니오 | 서버 측 정책 시행이 프롬프트에서 금지된 콘텐츠를 감지했습니다. 우회할 수 없습니다. |

BLOCKED_REASON_UNSPECIFIED | 둘 다 | 경우에 따라 다름 | 드문 포괄적 값입니다. 안전 등급과 프롬프트 내용을 모두 확인하세요. |

blockReason OTHER 응답을 받으면 JSON 구조는 다음과 같습니다:

json{ "promptFeedback": { "blockReason": "OTHER" }, "candidates": [] }

candidates 배열이 완전히 비어 있다는 점에 주목하세요. 검사할 안전 등급도 없고, 복구할 부분 콘텐츠도 없으며, 어떤 정책 규칙이 차단을 트리거했는지 알려주는 구체적인 카테고리 정보도 없습니다. 이는 의도적인 설계입니다. Google의 Layer 2 필터는 어떤 정책 규칙이 위반되었는지를 의도적으로 공개하지 않습니다. 그 정보가 공개되면 악의적인 사용자가 탐지를 간신히 피하는 프롬프트를 만드는 데 도움이 될 수 있기 때문입니다.

finishReason 값 (생성 수준 차단)

finishReason 필드는 각 candidate 객체 내부에 나타나며, 생성이 중단된 이유를 표시합니다. blockReason과 달리 이러한 차단은 생성 중에 발생하므로, 토큰이 이미 소모되었고 부분 텍스트 출력을 볼 수도 있습니다(부분 이미지는 절대 생성되지 않음).

| finishReason 값 | 소스 레이어 | 의미 |

|---|---|---|

STOP | 해당 없음 | 정상 완료. 이미지가 성공적으로 생성되었습니다. |

SAFETY | Layer 1 | 생성된 콘텐츠가 구성 가능한 안전 필터를 트리거했습니다. 설정으로 조절 가능합니다. |

IMAGE_SAFETY | Layer 2 | 생성 중 이미지 특화 안전 위반이 감지되었습니다. 구성 불가능합니다. |

OTHER | Layer 2 | 생성된 콘텐츠에서 저작권, 상표 또는 유명 IP가 감지되었습니다. 구성 불가능합니다. |

PROHIBITED_CONTENT | Layer 2 | 아동 안전 또는 법적으로 금지된 콘텐츠입니다. 가장 엄격한 시행이며, 구성 불가능합니다. |

핵심적인 차이는 타이밍입니다. blockReason은 생성 전에 발동하고(비용 없음), finishReason은 생성 중에 발동합니다(토큰 소모). blockReason: "OTHER" 대신 finishReason: "OTHER"를 보고 있다면, 프롬프트는 초기 필터를 통과했지만 생성된 이미지가 두 번째 레이어에 의해 저작권 또는 상표 문제로 포착되었다는 뜻입니다. 보통 이미지 합성 과정에서만 드러나는 저작권 콘텐츠를 나타냅니다. 예를 들어 "둥근 귀를 가진 만화 쥐"라는 프롬프트는 프롬프트 필터를 통과할 수 있지만, 생성된 이미지가 저작권이 있는 캐릭터를 닮으면 finishReason: OTHER를 트리거할 수 있습니다.

GitHub Issue #276에서 확인된 바와 같이, Google은 아동 안전 보호를 포함한 필수 필터는 비활성화할 수 없으며, Layer 2 차단에 대한 프로그래밍적 우회 방법은 없다고 밝혔습니다. 이것은 버그가 아니라 의도적인 아키텍처 결정입니다.

BLOCK_NONE이 blockReason OTHER를 해결할 수 없는 이유

blockReason OTHER를 만났을 때 개발자들이 가장 흔히 저지르는 실수는 모든 안전 카테고리를 즉시 BLOCK_NONE이나 OFF로 설정해서 에러를 해결하려는 것입니다. 이 접근 방식이 실패하는 이유는 Gemini의 안전 필터링 아키텍처 작동 방식을 근본적으로 잘못 이해하고 있기 때문입니다. 이 시스템은 완전히 독립적인 두 개의 레이어로 운영되며, 사용자의 안전 설정은 첫 번째 레이어만 제어합니다. 사용 가능한 모든 안전 설정에 대한 자세한 내용은 Gemini 안전 설정 상세 가이드를 참고하세요.

Layer 1: 구성 가능한 안전 필터

Layer 1은 프롬프트와 생성된 콘텐츠를 개별적으로 구성할 수 있는 4가지 유해성 카테고리에 대해 평가합니다: HARM_CATEGORY_HARASSMENT, HARM_CATEGORY_HATE_SPEECH, HARM_CATEGORY_SEXUALLY_EXPLICIT, HARM_CATEGORY_DANGEROUS_CONTENT. 각 카테고리에 대해 필터의 민감도를 결정하는 harm_block_threshold를 설정할 수 있습니다. Layer 1 필터가 트리거되면, 어떤 카테고리가 어떤 신뢰도 수준에서 트리거되었는지를 정확히 알려주는 상세한 안전 등급과 함께 blockReason: "SAFETY"를 받게 됩니다.

Layer 1을 제어하는 두 가지 옵션이 있습니다. 임계값을 BLOCK_NONE으로 설정하면 자동 차단은 비활성화되지만 응답에 안전 메타데이터가 여전히 반환되어 모니터링과 로깅에 유용합니다. 임계값을 OFF로 설정하면(gemini-2.5-flash 이후 모델부터 사용 가능, 2026년 1월 Vertex AI 문서 기준) 차단과 메타데이터 수집이 모두 완전히 비활성화됩니다. Gemini 3.1 Flash 기반인 Nano Banana 2에서는 두 옵션 모두 사용 가능하며, 어느 것이든 Layer 1 차단을 완전히 제거할 수 있습니다.

Layer 1을 최대한 허용적으로 구성하는 방법은 다음과 같습니다:

pythonfrom google import genai from google.genai import types client = genai.Client(api_key="YOUR_API_KEY") safety_settings_block_none = [ types.SafetySetting( category="HARM_CATEGORY_HARASSMENT", threshold="BLOCK_NONE" ), types.SafetySetting( category="HARM_CATEGORY_HATE_SPEECH", threshold="BLOCK_NONE" ), types.SafetySetting( category="HARM_CATEGORY_SEXUALLY_EXPLICIT", threshold="BLOCK_NONE" ), types.SafetySetting( category="HARM_CATEGORY_DANGEROUS_CONTENT", threshold="BLOCK_NONE" ), ] # 옵션 2: OFF - 차단 없음, 안전 메타데이터도 없음 safety_settings_off = [ types.SafetySetting( category="HARM_CATEGORY_HARASSMENT", threshold="OFF" ), # ... 나머지 카테고리도 동일하게 설정 ]

Layer 2: 비구성 정책 시행

Layer 2는 안전 설정과 완전히 독립적으로 운영되는 별도의 시스템입니다. Google의 콘텐츠 정책, 법적 요구사항, 서비스 약관을 서버 측 필터를 통해 시행하며, 어떤 API 매개변수로도 접근, 수정 또는 우회할 수 없습니다. Layer 2가 트리거되면, 안전 등급도 없고, 카테고리 정보도 없으며, 어떤 구체적인 정책이 위반되었는지 파악할 방법도 없이 blockReason: "OTHER"를 받게 됩니다.

Layer 2는 일반적인 안전 우려를 넘어 법적 책임 영역에 해당하는 콘텐츠 카테고리를 다룹니다: 아동 안전(대부분의 관할권에서 법적 요구사항), 저작권 캐릭터와 상표 등록된 시각적 정체성, 식별 가능한 공인과 유명인, Google 서비스 약관을 위반하는 NSFW 콘텐츠, 그리고 다음 섹션에서 자세히 다루는 여러 다른 카테고리가 포함됩니다. 이러한 필터가 존재하는 이유는 개발자의 의도된 사용 목적과 관계없이 이미지 생성 API가 특정 유형의 콘텐츠를 생성할 경우 Google이 직접적인 법적 책임을 지기 때문입니다.

실질적인 의미는 명확합니다: blockReason: "OTHER"를 받고 있다면, 아무리 안전 설정을 변경해도 도움이 되지 않습니다. 4개 카테고리를 모두 BLOCK_NONE이나 OFF로 설정하고도 여전히 차단되는 것으로 이미 확인했을 것입니다. 차단은 여러분이 제어하는 시스템에서 오는 것이 아니라, 그 뒤에 있는 시스템에서 오는 것입니다. 유일한 해결 방법은 프롬프트를 수정하거나 대안적 접근 방식을 사용하는 것이며, 이에 대해서는 아래 해결법 섹션에서 다룹니다.

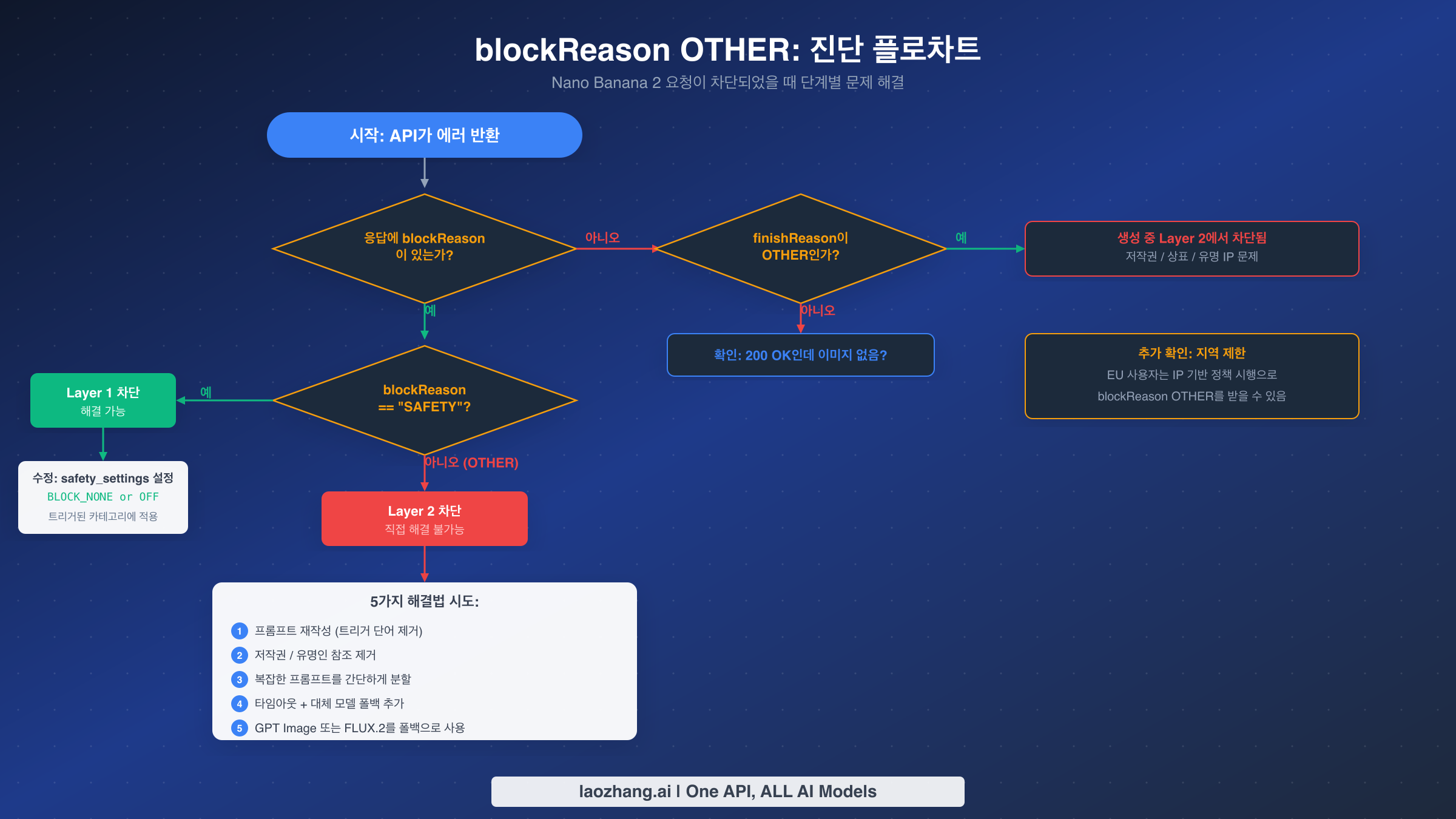

단계별 진단 플로차트

Nano Banana 2 API 호출이 에러를 반환했을 때, 첫 번째 단계는 즉시 안전 설정을 변경하는 것이 아니라 정확히 어떤 유형의 에러를 다루고 있는지 파악하는 것입니다. 에러 유형에 따라 완전히 다른 해결법이 필요하며, 잘못된 수정 방법을 적용하면 시간과 API 할당량을 낭비하게 됩니다. 이 진단 플로차트는 추측을 배제하는 체계적인 접근 방식을 제공합니다.

먼저 응답의 prompt_feedback 섹션에 blockReason 필드가 포함되어 있는지 확인하세요. blockReason이 없다면 완전히 다른 유형의 에러일 수 있습니다. candidates 배열에서 finishReason: "OTHER"를 확인하세요. 이는 프롬프트는 통과했지만 생성된 콘텐츠가 저작권이나 상표 문제로 인해 생성 중에 차단되었음을 나타냅니다. blockReason이나 finishReason OTHER 모두 없다면, 200 OK이지만 이미지가 생성되지 않은 시나리오나 503 과부하 에러를 다루고 있을 수 있으며, 이들은 각각 고유한 문제 해결 경로가 필요합니다. 다른 일반적인 Nano Banana 2 에러에 대해서는 thought signature 에러 가이드를 참고하세요.

blockReason이 존재한다면 그 값을 확인하세요. 값이 SAFETY라면 안전 설정 구성으로 해결 가능한 Layer 1 차단을 다루고 있는 것입니다. 응답의 안전 등급을 검사하여 어떤 카테고리가 트리거되었는지 파악한 다음, 해당 카테고리의 임계값을 BLOCK_NONE 또는 OFF로 설정하세요. 값이 OTHER라면 Layer 2 차단이 확인된 것이며, 이 가이드의 해결법이 적용됩니다.

이 과정을 자동화하는 진단 코드는 다음과 같습니다:

pythondef diagnose_block(response): """Nano Banana 2 요청이 차단된 이유를 체계적으로 진단합니다.""" # 단계 1: 프롬프트 수준 차단 확인 if hasattr(response, 'prompt_feedback') and response.prompt_feedback: block_reason = getattr(response.prompt_feedback, 'block_reason', None) if block_reason == 'SAFETY': # Layer 1 차단 - 안전 설정으로 해결 가능 ratings = response.prompt_feedback.safety_ratings triggered = [r for r in ratings if r.blocked] return { 'type': 'LAYER_1_BLOCK', 'fixable': True, 'categories': [r.category for r in triggered], 'action': 'Set triggered categories to BLOCK_NONE or OFF' } elif block_reason == 'OTHER': # Layer 2 차단 - 설정으로 해결 불가 return { 'type': 'LAYER_2_BLOCK', 'fixable': False, 'action': 'Rephrase prompt or use alternative model' } # 단계 2: 생성 수준 차단 확인 if len(response.candidates) > 0: finish_reason = response.candidates[0].finish_reason if finish_reason == 'OTHER': return { 'type': 'LAYER_2_GENERATION_BLOCK', 'fixable': False, 'action': 'Copyright/trademark detected during generation' } if finish_reason == 'IMAGE_SAFETY': return { 'type': 'IMAGE_SAFETY_BLOCK', 'fixable': False, 'action': 'Image content violated safety policy' } # 단계 3: candidates 없음, block reason 없음 if len(response.candidates) == 0: return { 'type': 'EMPTY_RESPONSE', 'fixable': False, 'action': 'Check for 200 OK no-image scenario' } return {'type': 'UNKNOWN', 'action': 'Inspect full response JSON'}

google-genai SDK를 사용하는 Python 개발자가 반드시 알아야 할 중요한 사항이 있습니다. candidates 배열이 비어 있을 때 response.candidates[0].finish_reason에 접근하면 예외를 발생시키는 대신 SDK가 무한 대기 상태에 빠집니다. 이것은 2026년 3월 기준 알려진 버그로, SDK가 candidate 객체를 지연 평가하려 시도하면서 무한 대기 상태에 진입하는 것입니다. candidate 속성에 접근하기 전에 반드시 len(response.candidates) > 0을 확인하세요. 이 무한 대기가 발생하면 프로세스를 강제 종료하는 것이 유일한 복구 방법입니다.

지역별 고려사항

EU 지역의 개발자는 IP 기반 정책 시행으로 인해 다른 지역에서는 정상 작동하는 프롬프트에서도 blockReason OTHER가 트리거될 수 있다는 점을 알아야 합니다. 이는 AI 생성 이미지에 대해 더 엄격한 규정을 가진 관할권에서 Google이 더 강력한 콘텐츠 정책을 적용하기 때문입니다. 지역별 차단이 의심된다면, 다른 지역에서 동일한 프롬프트를 테스트하여 차단이 콘텐츠 기반인지 지역 기반인지 확인할 수 있습니다.

blockReason OTHER를 트리거하는 8가지 콘텐츠 카테고리

Layer 2 차단을 트리거하는 콘텐츠가 정확히 무엇인지 이해하면 불필요한 거부를 피하는 프롬프트를 작성하는 데 도움이 됩니다. Google의 공식 문서, 커뮤니티 보고서, 여러 출처에 걸쳐 문서화된 체계적인 테스트를 교차 참조한 결과, Nano Banana 2에서 blockReason OTHER를 일관되게 트리거하는 8가지 별개의 콘텐츠 카테고리를 식별했습니다. 2026년 3월 기준으로 Google은 이 중 4개 카테고리의 시행을 강화했으며, 이전에 작동하던 프롬프트가 이제 차단될 수 있는 이유가 바로 이것입니다.

NSFW 및 성적으로 노골적인 콘텐츠는 가장 광범위한 카테고리로, 누드, 성행위 또는 페티시 콘텐츠를 요청하는 모든 프롬프트를 포착합니다. Layer 1의 HARM_CATEGORY_SEXUALLY_EXPLICIT은 BLOCK_NONE으로 설정할 수 있지만, Layer 2의 NSFW 필터는 독립적으로 작동하며 비활성화할 수 없습니다. 이로 인해 Layer 1이 BLOCK_NONE 임계값에서 허용했을 프롬프트까지 포착하게 되어, 안전 설정은 "모두 허용"이라고 되어 있는데 요청은 여전히 차단되는 혼란스러운 상황이 발생합니다.

저작권 캐릭터 및 유명 IP는 주요 지적 재산권 보유자가 소유한 캐릭터를 프롬프트가 참조할 때 트리거됩니다. 유명 애니메이션 캐릭터, 비디오 게임 주인공, 만화 슈퍼히어로 등이 이에 해당합니다. 이 카테고리는 blockReason: OTHER보다 finishReason: OTHER를 볼 가능성이 더 높은 카테고리 중 하나입니다. 저작권 감지가 종종 이미지 합성 과정에서 생성된 이미지가 보호된 캐릭터를 닮기 시작할 때 발생하기 때문입니다. 프롬프트 텍스트에서 명시적으로 이름을 언급하지 않았더라도 마찬가지입니다.

공인 및 유명인은 2026년 3월에 시행이 크게 강화되었습니다. 이전에는 논란이 없는 맥락에서 공인을 참조하는 프롬프트(예: "[유명인]처럼 생긴 사람이 연설하는 모습")가 통과하는 경우가 있었습니다. 2026년 3월 정책 업데이트에서는 더 간접적인 참조와 예술 스타일 모방까지 감지하도록 탐지 범위가 확대되었습니다. 이전에 인식 가능한 공인의 이미지를 생성하던 프롬프트가 이제 blockReason OTHER를 반환한다면, 이 정책 변경이 가장 유력한 원인입니다.

미성년자 보호는 무관용 원칙이 적용되는 가장 엄격한 카테고리입니다. 부적절하거나 착취적인 맥락에서 미성년자의 이미지를 잠재적으로 생성할 수 있는 모든 프롬프트는 즉시 차단됩니다. GitHub Issue #276에서 확인된 바와 같이, 이것은 Google이 절대 우회 방법을 제공하지 않겠다고 밝힌 법적 요구사항입니다. 이 필터는 오탐률이 가장 높아, 어린이 삽화나 가족 사진에 관한 무해한 프롬프트도 때때로 포착합니다.

워터마크 제거는 참조 이미지의 워터마크를 제거, 교체 또는 가리도록 요청하는 프롬프트를 대상으로 합니다. 참조 이미지가 제공되고 프롬프트가 브랜딩이나 저작권 표시를 제거하도록 모델에 지시하는 이미지 편집 워크플로에 특히 적용됩니다.

금융 정보 수정은 2026년 3월 정책 업데이트에서 추가된 카테고리입니다. 금융 문서, 화폐, 수표, 은행 명세서 또는 공식 신분증의 생성이나 수정을 요청하는 프롬프트가 이제 blockReason OTHER를 트리거합니다. 이전에는 낮은 우선순위로 처리되어 Layer 2를 통과하는 경우가 많았습니다.

의상 및 얼굴 교체는 2026년 3월에 시행이 강화되었습니다. 이미지 간 얼굴 교체, 다른 사람의 초상을 다른 신체에 배치하거나, 오해의 소지가 있는 이미지를 만들 수 있는 방식으로 사람의 의상을 변경하도록 요청하는 프롬프트가 이제 더 적극적으로 포착됩니다. 대상이 인식 가능한 경우 공인 카테고리와 중복됩니다.

암시적 선정 콘텐츠는 가장 미묘한 카테고리이며 예측하기가 가장 어렵습니다. 부적절한 콘텐츠를 명시적으로 요청하지 않지만, 모델이 선정적으로 해석하는 코드화된 언어, 완곡어법 또는 맥락적 조합을 사용하는 프롬프트를 포착합니다. 이 카테고리는 2026년 3월에 더 간접적인 표현 패턴을 포착하도록 확대되었으며, 이전에 무해해 보이던 프롬프트가 이제 차단을 트리거하는 이유가 바로 이것입니다.

핵심적인 시사점은 Layer 2가 키워드 수준 분석이 아닌 콘텐츠 수준 분석을 기반으로 운영된다는 것입니다. 특정 단어를 단순히 피하는 것만으로는 충분하지 않습니다. 모델은 전체 프롬프트의 의미론적 의미와 예상되는 시각적 출력을 평가합니다. 아래 해결법 섹션에서는 원하는 창작 결과물을 달성하면서도 콘텐츠 필터링을 피하는 구체적인 전략을 제공합니다.

blockReason OTHER를 우회하는 5가지 검증된 해결법

blockReason OTHER는 안전 설정으로 해결할 수 없으므로, 다음 해결법들은 다른 접근 방식을 취합니다: 입력을 수정하거나, 워크플로를 재구성하거나, 대체 모델로 라우팅하는 것입니다. 가장 간단한 것부터 가장 강건한 것까지 순서대로 나열되어 있으며, 프로덕션 환경에서는 여러 해결법을 계층화된 폴백 전략으로 구현하는 것이 좋습니다.

해결법 1: 트리거 패턴을 제거하도록 프롬프트 재작성. 가장 직접적인 접근 방식은 차단을 트리거한 특정 언어 패턴을 식별하고 제거하는 것입니다. Layer 2는 단순한 키워드가 아닌 의미론적 의미를 분석하므로, 효과적인 재작성은 단순한 단어 대체를 넘어서야 합니다. 캐릭터 이름을 일반적인 설명으로 대체하고(특정 캐릭터 이름 대신 "친근한 만화 동물"), 유명인 참조를 속성 설명으로 대체하며(특정인 이름 대신 "짧은 검은 머리의 프로페셔널한 여성이 발표하는 모습"), 복합 개념을 더 간단한 개별 프롬프트로 분해하세요. 복잡한 장면 설명이 차단을 트리거하면, 개별 요소를 따로 생성한 다음 나중에 합성하는 방법을 시도해 보세요.

해결법 2: 모든 저작권 및 유명인 참조 제거. 이것은 대부분의 blockReason OTHER 에러의 원인인 두 가지 카테고리를 구체적으로 대상으로 하는 해결법 1의 더 적극적인 버전입니다. 프롬프트에서 브랜드 캐릭터, 상표 등록된 시각적 스타일, 특정 아티스트와 연관된 인식 가능한 예술 스타일, 유명인의 이름이나 공인을 식별할 수 있는 설명, 그리고 모든 브랜드 로고나 제품 디자인에 대한 참조를 점검하세요. "~의 스타일로"와 같은 간접적인 참조도 해당 스타일이 저작권이 있는 작품과 밀접하게 연관되어 있으면 차단을 트리거할 수 있습니다.

해결법 3: 복잡한 프롬프트를 더 간단한 부분으로 분할. 여러 개념을 결합하는 복잡한 프롬프트는 추가적인 각 개념이 결합된 의미론적 의미가 정책 경계를 넘을 확률을 높이므로 Layer 2를 트리거할 가능성이 더 높습니다. 하나의 복잡한 프롬프트를 2-3개의 더 간단한 생성 요청으로 분해한 다음 결과를 합성하면, 결합된 프롬프트가 실패하는 경우에도 성공하는 경우가 많습니다. 예를 들어 "특정 의상을 입은 사람이 특정 랜드마크에서 특정 행동을 하는" 대신, 장면과 대상을 따로 생성하세요.

해결법 4: 타임아웃 및 자동 모델 폴백 추가. 프로덕션 애플리케이션에서 가장 안정적인 접근 방식은 Nano Banana 2가 blockReason OTHER를 반환할 때 대체 이미지 모델로 자동 폴백하는 것을 구현하는 것입니다. 이는 일부 프롬프트가 항상 Layer 2에 의해 차단될 것이라는 현실을 인정하고, 애플리케이션이 계속 작동하도록 보장합니다. laozhang.ai와 같은 일부 API 프록시 서비스는 통합 엔드포인트 뒤에 여러 이미지 모델을 집계하여, 여러 API 통합을 관리하지 않고도 Nano Banana 2와 대체 모델 간의 폴백을 간편하게 구현할 수 있습니다.

pythonimport asyncio from google import genai async def generate_with_fallback(prompt, timeout_seconds=30): """Nano Banana 2로 이미지를 생성하고, 실패 시 대체 모델로 폴백합니다.""" client = genai.Client(api_key="YOUR_GEMINI_KEY") try: # 타임아웃을 적용하여 Nano Banana 2 시도 response = await asyncio.wait_for( asyncio.to_thread( client.models.generate_content, model="gemini-3.1-flash-image-preview", contents=prompt, config=types.GenerateContentConfig( response_modalities=["IMAGE", "TEXT"], ) ), timeout=timeout_seconds ) # blockReason OTHER 확인 if hasattr(response, 'prompt_feedback') and response.prompt_feedback: if getattr(response.prompt_feedback, 'block_reason', None) == 'OTHER': print("Layer 2 차단 감지, 폴백 중...") return await fallback_generate(prompt) # 빈 candidates 확인 (SDK 무한 대기 방지) if not response.candidates or len(response.candidates) == 0: print("빈 candidates, 폴백 중...") return await fallback_generate(prompt) return response except asyncio.TimeoutError: print(f"{timeout_seconds}초 후 타임아웃, 폴백 중...") return await fallback_generate(prompt) async def fallback_generate(prompt): """대체 이미지 모델로 폴백합니다.""" # 예: 대체 API를 통해 GPT Image 또는 FLUX.2 사용 # 구현은 선택한 폴백 모델에 따라 달라집니다 pass

해결법 5: GPT Image 또는 FLUX.2를 주요 폴백으로 사용. 콘텐츠 요구사항이 Google의 Layer 2 정책과 본질적으로 충돌하는 경우(예: 뉴스나 편집 목적으로 인식 가능한 공인의 이미지를 생성해야 하는 경우), 유일하게 안정적인 해결법은 콘텐츠 정책이 다른 이미지 생성 모델을 사용하는 것입니다. OpenAI의 GPT Image(DALL-E 4o)는 다른 정책 경계를 가지고 있어 Nano Banana 2가 거부하는 프롬프트를 수락할 수 있고, 그 반대도 마찬가지입니다. 다양한 제공업체를 통해 이용 가능한 FLUX.2 모델은 또 다른 콘텐츠 정책 세트를 제공합니다. 프로덕션 환경에서 2-3개의 서로 다른 이미지 생성 API에 대한 액세스를 유지하면, 제공업체 간의 정책 차이가 병목 현상이 아닌 안전망이 됩니다.

프로덕션 수준 에러 처리

개발 디버깅에서 프로덕션 안정성으로 전환하려면, 지금까지 논의한 모든 실패 모드를 고려하는 포괄적인 에러 처리가 필요합니다. 다음 구현은 python-genai SDK 무한 대기 버그를 방지하고, Layer 1과 Layer 2 차단을 올바르게 구분하며, 폴백과 함께 자동 재시도를 구현하고, 모니터링을 위한 구조화된 로깅을 제공하는 Nano Banana 2용 완전한 에러 처리 래퍼를 제공합니다.

pythonimport time import logging from dataclasses import dataclass from enum import Enum from typing import Optional logger = logging.getLogger(__name__) class BlockType(Enum): NONE = "none" LAYER_1_SAFETY = "layer_1_safety" LAYER_2_OTHER = "layer_2_other" LAYER_2_IMAGE_SAFETY = "layer_2_image_safety" LAYER_2_COPYRIGHT = "layer_2_copyright" LAYER_2_PROHIBITED = "layer_2_prohibited" SDK_HANG = "sdk_hang" UNKNOWN = "unknown" @dataclass class GenerationResult: success: bool block_type: BlockType image_data: Optional[bytes] = None error_message: str = "" latency_ms: int = 0 model_used: str = "" def safe_generate_image(client, prompt: str, model: str = "gemini-3.1-flash-image-preview") -> GenerationResult: """포괄적인 에러 처리가 포함된 프로덕션 안전 이미지 생성.""" start_time = time.time() try: response = client.models.generate_content( model=model, contents=prompt, config=types.GenerateContentConfig( response_modalities=["IMAGE", "TEXT"], safety_settings=[ types.SafetySetting(category=cat, threshold="BLOCK_NONE") for cat in [ "HARM_CATEGORY_HARASSMENT", "HARM_CATEGORY_HATE_SPEECH", "HARM_CATEGORY_SEXUALLY_EXPLICIT", "HARM_CATEGORY_DANGEROUS_CONTENT", ] ], ), ) latency = int((time.time() - start_time) * 1000) # 점검 1: 프롬프트 수준 차단 (blockReason) if hasattr(response, 'prompt_feedback') and response.prompt_feedback: block_reason = getattr(response.prompt_feedback, 'block_reason', None) if block_reason == 'SAFETY': logger.warning(f"Layer 1 차단: {prompt[:80]}...") return GenerationResult( success=False, block_type=BlockType.LAYER_1_SAFETY, error_message="Layer 1 safety filter triggered. Adjust safety_settings.", latency_ms=latency, model_used=model, ) if block_reason == 'OTHER': logger.warning(f"Layer 2 차단: {prompt[:80]}...") return GenerationResult( success=False, block_type=BlockType.LAYER_2_OTHER, error_message="Layer 2 policy block. Cannot bypass via settings.", latency_ms=latency, model_used=model, ) # 점검 2: 빈 candidates (SDK 무한 대기 방지) if not response.candidates or len(response.candidates) == 0: logger.warning(f"빈 candidates: {prompt[:80]}...") return GenerationResult( success=False, block_type=BlockType.SDK_HANG, error_message="Empty candidates array. Likely silent Layer 2 block.", latency_ms=latency, model_used=model, ) # 점검 3: 생성 수준 차단 (finishReason) candidate = response.candidates[0] finish_reason = getattr(candidate, 'finish_reason', 'STOP') finish_reason_map = { 'SAFETY': BlockType.LAYER_1_SAFETY, 'IMAGE_SAFETY': BlockType.LAYER_2_IMAGE_SAFETY, 'OTHER': BlockType.LAYER_2_COPYRIGHT, 'PROHIBITED_CONTENT': BlockType.LAYER_2_PROHIBITED, } if finish_reason in finish_reason_map: return GenerationResult( success=False, block_type=finish_reason_map[finish_reason], error_message=f"Generation blocked: finishReason={finish_reason}", latency_ms=latency, model_used=model, ) # 점검 4: 이미지 데이터 추출 for part in candidate.content.parts: if hasattr(part, 'inline_data') and part.inline_data: return GenerationResult( success=True, block_type=BlockType.NONE, image_data=part.inline_data.data, latency_ms=latency, model_used=model, ) # 응답에 이미지 없음 return GenerationResult( success=False, block_type=BlockType.UNKNOWN, error_message="Response contained no image data.", latency_ms=latency, model_used=model, ) except Exception as e: latency = int((time.time() - start_time) * 1000) logger.error(f"생성 중 예외 발생: {e}") return GenerationResult( success=False, block_type=BlockType.UNKNOWN, error_message=str(e), latency_ms=latency, model_used=model, )

이 구현의 핵심 방어적 프로그래밍 패턴은 주목할 가치가 있습니다. 첫째, response.candidates에 대한 모든 접근이 길이 검사로 보호되어, 많은 개발자를 당황하게 만든 python-genai SDK 무한 대기 버그를 방지합니다. 둘째, 함수가 예외를 발생시키는 대신 구조화된 결과 객체를 반환하므로, 비동기 파이프라인과 재시도 로직에서 안전하게 사용할 수 있습니다. 셋째, 차단 유형 분류를 통해 모니터링 시스템이 어떤 유형의 차단이 얼마나 자주 발생하는지 정확히 추적할 수 있어, 시간이 지남에 따라 프롬프트를 최적화하는 데 필요한 데이터를 확보할 수 있습니다.

프로덕션 배포의 경우, laozhang.ai와 같은 플랫폼은 여러 이미지 생성 모델에 걸친 통합 API 엔드포인트를 제공하여, 해결법 4에서 설명한 폴백 전략의 구현을 간소화합니다. 각 폴백 모델에 대해 별도의 API 클라이언트를 관리하는 대신, 단일 엔드포인트를 통해 라우팅하고 플랫폼이 모델 선택과 에러 복구를 처리하도록 할 수 있습니다.

이 구현의 로깅은 모니터링 대시보드를 지원하도록 의도적으로 구조화되어 있습니다. 모든 요청에 대해 block_type, latency_ms, model_used를 추적함으로써, Layer 2 차단의 비정상적인 급증에 대한 알림(정책 변경을 나타낼 수 있음)을 구축하고, 프롬프트 재작성 노력의 효과를 추적하며, 대체 모델로 라우팅해야 하는 프롬프트를 식별할 수 있습니다.

자주 묻는 질문

Nano Banana 2에서 안전 필터를 완전히 비활성화할 수 있나요?

Layer 1 안전 필터는 4가지 유해성 카테고리(HARM_CATEGORY_HARASSMENT, HARM_CATEGORY_HATE_SPEECH, HARM_CATEGORY_SEXUALLY_EXPLICIT, HARM_CATEGORY_DANGEROUS_CONTENT)를 모두 BLOCK_NONE 또는 OFF로 설정하여 비활성화할 수 있습니다. 그러나 Layer 2 정책 시행은 어떤 API 매개변수, SDK 구성 또는 계정 설정으로도 비활성화할 수 없습니다. 이는 구성 가능한 모든 안전 설정을 제거하더라도 Google의 서비스 약관, 저작권법 또는 아동 안전 요구사항을 위반하는 콘텐츠는 여전히 차단된다는 의미입니다. Layer 1은 잠재적으로 유해한 AI 출력으로부터 사용자를 보호하고, Layer 2는 법적 책임으로부터 Google을 보호합니다. 둘 다 필요하지만, 구성 가능한 것은 첫 번째뿐입니다.

BLOCK_NONE과 OFF의 차이는 무엇인가요?

두 설정 모두 Layer 1에서의 자동 차단을 방지하지만, 메타데이터 동작에서 차이가 있습니다. BLOCK_NONE은 차단을 비활성화하면서도 응답에 안전 등급을 반환하여 어떤 카테고리가 어떤 신뢰도 수준에서 감지되었는지 알 수 있습니다. 이는 모니터링과 감사에 유용합니다. OFF는 차단과 메타데이터 수집을 모두 완전히 비활성화하여 응답에 안전 정보가 전혀 포함되지 않습니다. gemini-2.5-flash 이후 모델부터(2026년 1월 Vertex AI 문서 기준) OFF가 기본 설정입니다. 실용적인 권장사항은 개발 중에는 BLOCK_NONE을 사용하고(안전 등급이 트리거되는 항목을 확인할 수 있음), 프로덕션에서 안전 메타데이터가 필요 없다면 OFF를 사용하는 것입니다(약간 더 빠른 응답을 위해).

이전에 작동하던 프롬프트가 갑자기 차단되는 이유는 무엇인가요?

2026년 1월이나 2월에 작동하던 프롬프트가 이제 blockReason OTHER를 반환한다면, 가장 유력한 원인은 Google의 2026년 3월 정책 업데이트입니다. 이 업데이트는 4가지 특정 카테고리에 대한 시행을 강화했습니다: 공인 및 유명인(간접 참조에 대한 더 광범위한 감지), 금융 정보 수정(이전에 낮은 우선순위), 의상 및 얼굴 교체(더 적극적인 감지), 암시적 선정 콘텐츠(확장된 패턴 인식). 프롬프트가 이러한 영역에 해당한다면 이전에는 트리거하지 않았던 차단이 이제 발생할 수 있습니다. 해결 방법은 영향을 받는 프롬프트를 점검하고 재작성하는 것이며, 특히 인식 가능한 개인이나 금융 문서에 대한 간접적인 참조를 제거하세요.

무료 티어 API로 Nano Banana 2 이미지 생성이 가능한가요?

Google AI Studio의 무료 티어는 텍스트 생성을 위한 Gemini 모델 접근을 제공하지만, API를 통한 이미지 생성에는 유료 플랜이 필요합니다. Google AI Studio 웹 인터페이스에서는 무료 티어로 이미지 생성을 실험할 수 있지만, Nano Banana 2(gemini-3.1-flash-image-preview)를 사용한 프로그래밍 방식의 API 이미지 생성에는 Google Cloud 프로젝트에서 청구가 활성화되어 있어야 합니다. 이것은 blockReason OTHER 문제와는 별개이며, blockReason OTHER는 무료 및 유료 티어 모두에서 발생할 수 있습니다. 다만 무료 티어 사용자는 이미지 생성 요청이 할당량 수준에서 먼저 거부되므로 blockReason OTHER가 나타나는 시점에 도달하지 못할 수 있습니다.

blockReason OTHER가 지역 제한으로 인한 것인지 어떻게 확인할 수 있나요?

EU 기반 개발자는 특정 관할권에서 더 엄격한 콘텐츠 필터를 적용하는 IP 기반 정책 시행으로 인해 blockReason OTHER를 더 자주 만날 수 있습니다. 차단이 지역 기반인지 콘텐츠 기반인지 확인하려면 다른 지역에서 정확히 같은 프롬프트를 테스트하세요(VPN 사용 또는 다른 지역에 배포된 클라우드 함수 사용). 프롬프트가 다른 지역에서는 성공하지만 해당 지역에서 실패한다면 지역 차단입니다. 이 경우, 정책이 덜 엄격한 지역(예: 미국 기반 클라우드 인프라)의 서버에서 API 호출을 배포하는 것이 합법적인 우회 방법입니다. 단, 해당 지역의 관련 서비스 약관을 준수하는 사용 사례여야 합니다.