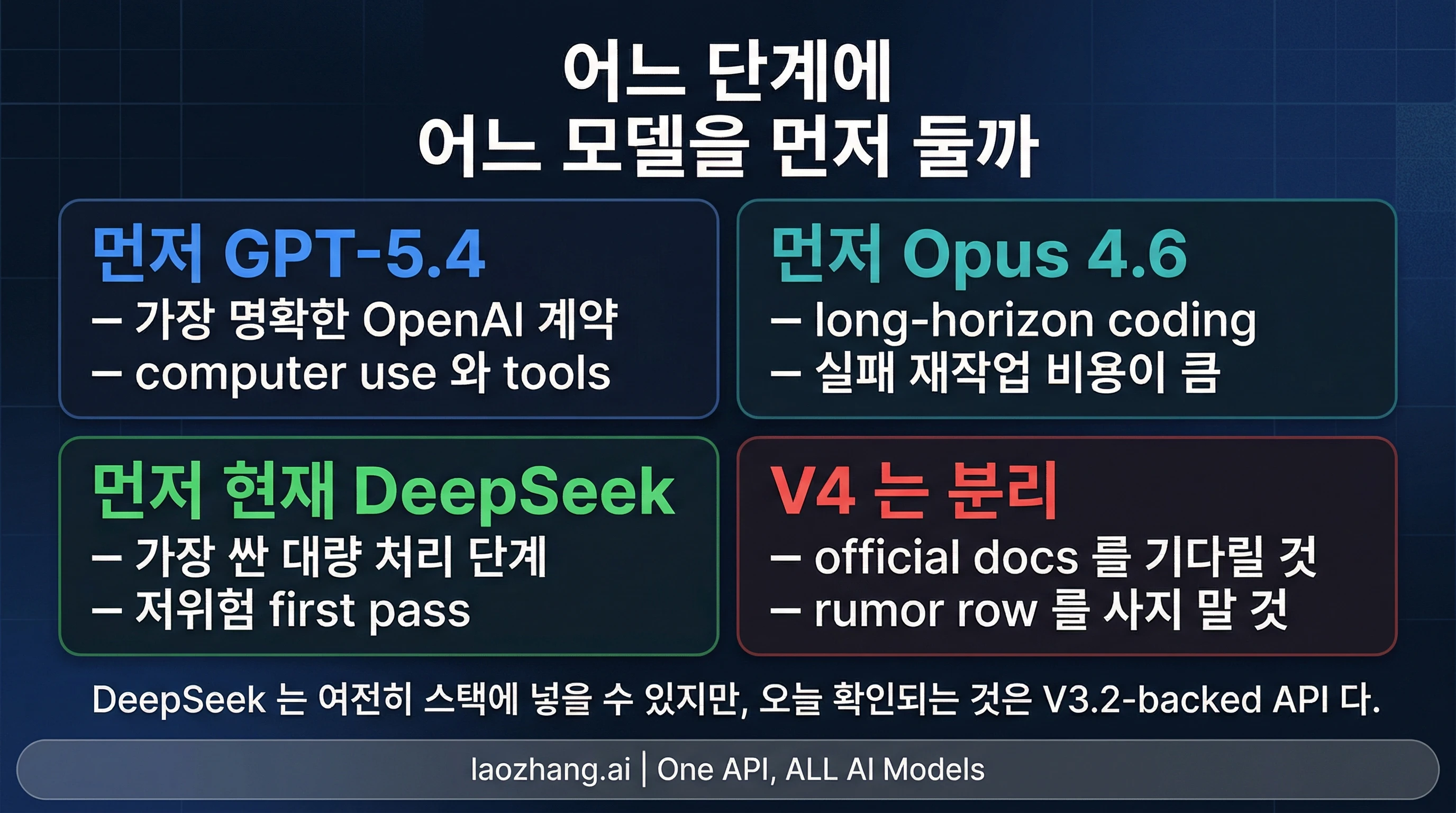

오늘 바로 운영 결정을 내려야 한다면, DeepSeek V4, Claude Opus 4.6, GPT-5.4를 처음부터 똑같이 문서화된 세 개의 공개 계약으로 가정하지 않는 편이 낫습니다. 판단 순서는 더 단순합니다. GPT-5.4 는 현재 가장 명확한 OpenAI 계약, 공식적으로 설명된 computer use / tool use, 그리고 Codex와 이어지는 현재 OpenAI 워크플로우를 중요하게 볼 때 먼저 테스트할 가치가 있습니다. Claude Opus 4.6 은 long-horizon coding, 큰 working set, 혹은 약한 first pass가 곧바로 큰 재작업 비용으로 이어지는 작업일 때 먼저 보는 편이 맞습니다. 현재 DeepSeek 는 가장 중요한 제약이 cost floor일 때 여전히 유효하지만, 그때도 전제는 아직 확인되지 않은 공개 V4 행이 아니라 오늘 docs에서 확인되는 DeepSeek-V3.2 기반 public API 여야 합니다.

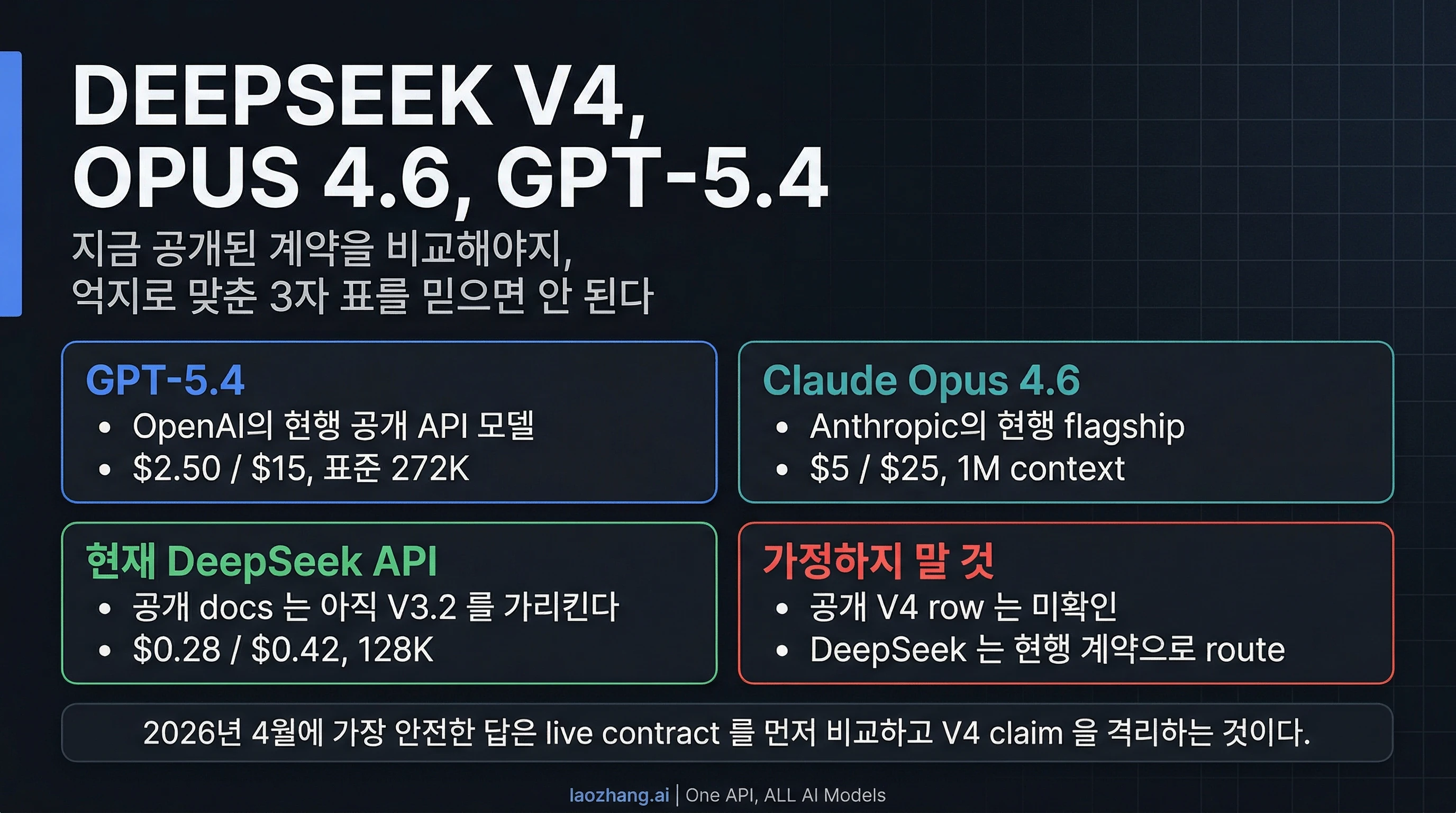

이 차이는 말장난이 아니라 비교 대상 자체를 바꾸는 문제입니다. 2026년 4월 4일 기준으로 OpenAI와 Anthropic은 GPT-5.4와 Claude Opus 4.6의 현재 모델 페이지와 pricing을 공개하고 있습니다. 반면 DeepSeek의 current public API docs에서 deepseek-chat 과 deepseek-reasoner 는 여전히 DeepSeek-V3.2 를 가리킵니다. 그렇다고 DeepSeek가 중요하지 않다는 뜻은 아닙니다. 의미는 더 단순합니다. 오늘 정직한 비교는 "셋 중 누가 이기나"가 아니라, "공개가 명확한 두 frontier contract를 먼저 비교하고, 현재 DeepSeek를 어떤 단계에 둘 것인가"입니다.

| 실제 병목이 이렇게 보인다면 | 먼저 route 할 모델 | 이유 |

|---|---|---|

| 가장 명확한 OpenAI 현행 계약과 공식 문서로 확인되는 computer use / tool use가 필요하다 | GPT-5.4 | OpenAI는 pricing, benchmark, 표준 컨텍스트와 Codex의 experimental 1M 지원 경계를 비교적 분명하게 공개합니다 |

| 긴 coding 작업과 높은 재작업 비용이 진짜 비용이다 | Claude Opus 4.6 | Anthropic은 1M context와 128k max output을 가진 current flagship contract를 명확히 제시합니다 |

| 지금 필요한 것은 가장 싼 public API stage다 | 현재 DeepSeek API | DeepSeek public docs는 V3.2-backed contract를 가리키며 가격은 GPT-5.4나 Opus보다 훨씬 낮습니다 |

검증 메모: OpenAI, Anthropic, DeepSeek current docs는 모두 2026년 4월 4일 재확인했습니다. 그 시점에 current DeepSeek docs 안에서 별도의 public DeepSeek V4 pricing row 또는 model page는 확인되지 않았고, 공개 행은 계속 DeepSeek-V3.2 를 가리켰습니다.

먼저 무엇을 비교하는지부터 바로잡아야 한다

이 글에서 가장 중요한 수정은 철학이 아니라 compare object 수정입니다. GPT-5.4와 Claude Opus 4.6은 current public contract로 직접 비교할 수 있습니다. 둘 다 model identity, pricing, context, capability surface가 vendor의 current page에 있습니다. DeepSeek는 그렇지 않습니다. current public API docs에 보이는 것은 DeepSeek-V3.2, 128K context, thinking mode의 tool use, 그리고 $0.28 / $0.42 라는 current pricing입니다. 이것은 충분히 실재하고 쓸모 있는 contract지만, "확인된 public DeepSeek V4 row"와 같은 뜻은 아닙니다.

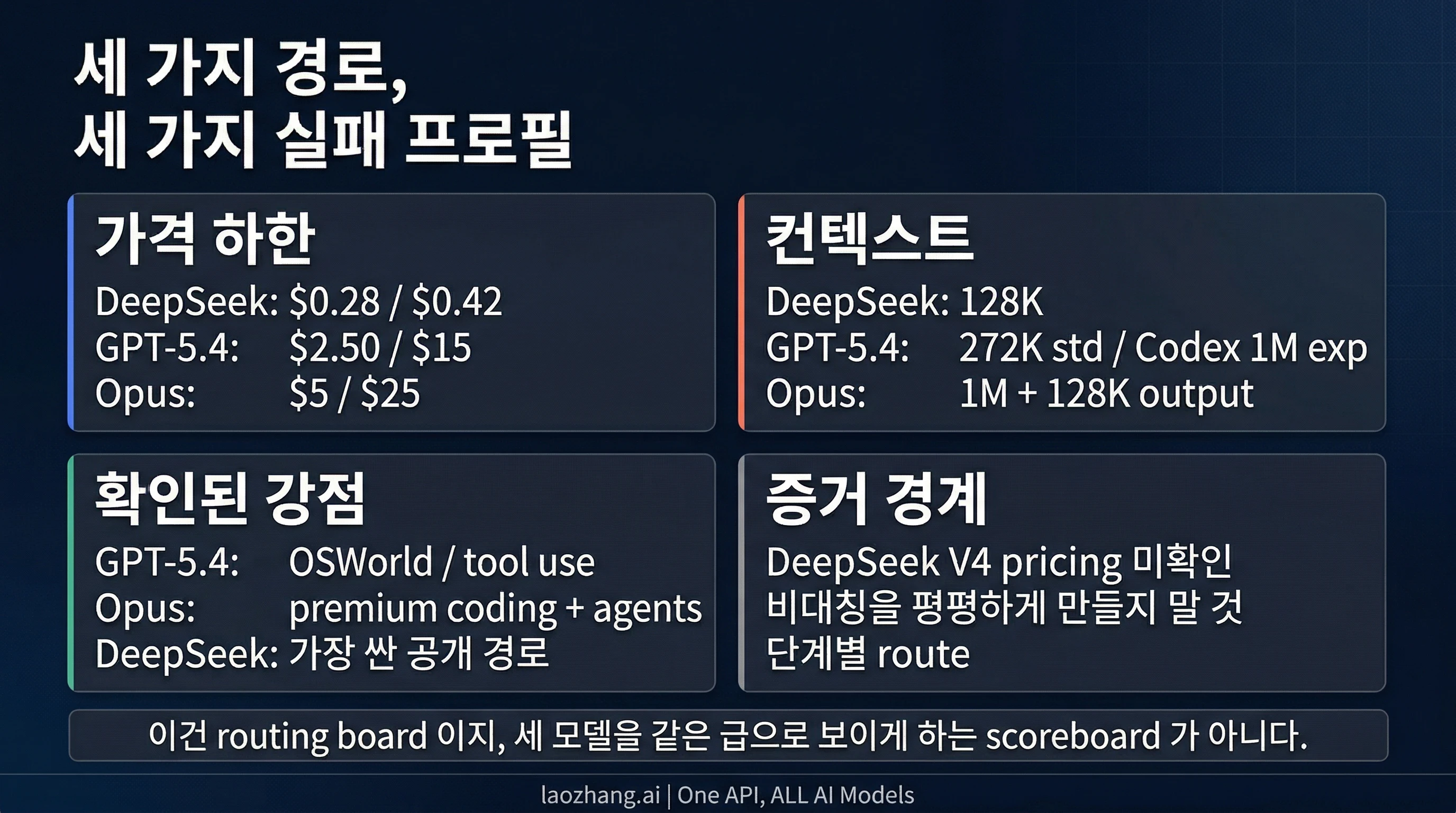

그래서 흔한 "카테고리별 승자" 식 비교는 여기서 너무 거칠어집니다. 깔끔한 비교는 세 행이 같은 정도로 public이고, 같은 정도로 documented이며, 같은 정도로 current라는 전제를 깔고 있습니다. 이번에는 그 전제가 성립하지 않습니다. OpenAI 쪽에서는 gpt-5.4 가 current public route이고, 더 상위 tier에는 gpt-5.4-pro 가 있습니다. Anthropic 쪽에서는 claude-opus-4-6 이 current public flagship이고 current docs는 1M context 와 128k max output 을 명시합니다. DeepSeek 쪽에서 안전하게 말할 수 있는 것은 public docs 위의 V3.2-backed API contract입니다. 비교가 불가능한 것이 아니라, 정직하게 말할 수 있는 비교 범위가 다르다 는 뜻입니다.

실무적인 의미는 분명합니다. 누군가 "DeepSeek V4가 Claude Opus 4.6보다 훨씬 싸다" 혹은 "DeepSeek V4가 GPT-5.4의 진짜 상대다"라고 말한다면, 첫 질문은 "그 public contract를 current docs 어디에서 확인했는가" 여야 합니다. 이것은 표현의 꼼꼼함이 아니라 evaluation과 procurement의 품질을 지키는 선입니다.

| 경로 | 2026년 4월 4일 기준 확인된 current public contract | 가격 | 컨텍스트 | 현재 vendor가 분명히 문서화한 내용 | 자동으로 가정하면 안 되는 것 |

|---|---|---|---|---|---|

| GPT-5.4 | OpenAI API model gpt-5.4 | $2.50 input / $15 output | 표준 272K, Codex에서는 experimental 1M | pricing, API availability, benchmark row, Codex support | 표준 272K contract를 곧바로 "어디서나 1M 모델"로 평평하게 만들지 말 것 |

| Claude Opus 4.6 | Anthropic API model claude-opus-4-6 | $5 input / $25 output | 1M context, 128k max output | agents / coding flagship 포지셔닝, launch status, output window | 오래된 third-party 글의 192K / 200K 숫자를 current fact처럼 가져오지 말 것 |

| 현재 DeepSeek API | deepseek-chat 과 deepseek-reasoner 는 DeepSeek-V3.2를 가리킴 | $0.28 input / $0.42 output | 128K | 저가 pricing, V3.2-backed public API, thinking mode tool use | 확인되지 않은 DeepSeek V4 pricing row를 이미 공개된 사실처럼 쓰지 말 것 |

이 표가 올바른 first screen입니다. 이 순간부터 이 글은 "셋 중 누가 더 좋은가"가 아니라 "어떤 stage를 누구에게 맡길 것인가"라는 routing 문제로 바뀝니다.

GPT-5.4를 먼저 돌려야 하는 경우

GPT-5.4를 먼저 볼 이유가 커지는 것은, OpenAI의 현행 계약이 가장 명확하다는 점 자체가 장점일 때 입니다. 단순히 비싸냐 싸냐가 아니라, current OpenAI stack 위에서 평가를 진행하고 싶고, official하게 설명된 computer use / tool use를 가진 모델을 입구로 삼고 싶고, Codex와의 연결도 중요할 때입니다. GPT-5.4 launch page는 이 점에서 꽤 유용합니다. current pricing, API availability, standard 272K context 와 Codex 내 experimental 1M support 의 차이, 그리고 Terminal-Bench 2.0, OSWorld-Verified, BrowseComp 같은 benchmark row를 직접 보여줍니다.

이 구분이 중요한 이유는 비교 글이 가장 쉽게 흐려지는 지점이 context claim이기 때문입니다. 설계 판단에서 필요한 것은 "GPT-5.4는 1M 컨텍스트다"라고 뭉개는 것이 아니라, "표준 contract는 272K이고 Codex 안에서는 experimental 1M support도 따로 documented되어 있다"라고 나눠 이해하는 것입니다. 그렇게 나누면 GPT-5.4의 역할이 자연스럽게 보입니다. current OpenAI surface 위에서 tool use와 computer use의 documented upside를 가져가는 middle route라는 점입니다.

benchmark를 읽는 방법도 같습니다. GPT-5.4의 current page는 public case를 보강하지만, 그렇다고 "모든 coding task에서 Opus 4.6을 이긴다"는 뜻은 아닙니다. 뜻하는 바는, real environment, tool, terminal work를 포함한 평가에서 OpenAI 쪽 current contract 중 가장 clear한 first test 후보라는 것입니다. 다음 단계에서 model theory가 아니라 OpenAI의 현재 product surface를 이해하고 싶다면 OpenAI Codex 2026년 3월 업데이트 로 넘어가는 편이 더 정확합니다.

물론 함정도 있습니다. GPT-5.4는 cheapest route가 아니며, current official material이 "모든 coding에서 자동 승리"를 정당화해주지도 않습니다. GPT-5.4의 strongest case는 명확한 official OpenAI contract가 필요한 상황 그 자체 입니다.

Claude Opus 4.6이 premium을 정당화하는 경우

Claude Opus 4.6을 먼저 둬야 하는 상황은 "가장 강해 보이는 모델이니까"가 아니라, 나쁜 first pass의 대가가 너무 큰 작업 일 때입니다. 이것이 Opus 4.6을 읽는 가장 안정적인 프레임입니다. Anthropic은 과장된 benchmark theater 없이도 충분합니다. current contract만으로 꽤 많은 말이 됩니다. 1M context, 128k max output, 그리고 agents / coding에 대한 current top model 포지셔닝. 이것은 긴 horizon과 큰 working set이 작업의 중심일 때 비로소 크게 작동하는 강점입니다.

왜 token price만 보면 안 될까요. 이유는 단순합니다. repo-scale coding, 긴 execution chain, 큰 output, 그리고 reviewer가 구조적으로 rescue하고 싶지 않은 first draft. 이런 workload에서는 invoice보다 약한 first pass 이후의 수습 비용 이 더 큰 bill이 됩니다. Claude Opus 4.6의 premium은 সেই cleanup cost가 price difference를 넘어설 때 가장 쉽게 설명됩니다.

1M context와 128k output도 숫자 자체보다 작업 구조를 바꾸기 때문에 중요합니다. 문제를 너무 이른 단계에서 과도하게 압축하거나, context를 지나치게 쪼개거나, 너무 좁은 slice만으로 reasoning하게 만들 필요가 줄어듭니다. 여기서 Anthropic 측 가격 구조를 더 자세히 보고 싶다면 다음 읽을거리는 Claude Opus 4.6 pricing guide 입니다. 한국어판이 아직 없어서 영어 기사로 폴백하는 편이 가장 안전합니다.

물론 제약도 있습니다. Claude Opus 4.6은 price sensitivity가 최우선인 workload나 OpenAI의 current official contract가 더 중요한 상황에서는 default answer가 아닙니다. 그래서 이 비교도 "누가 챔피언인가"가 아니라 "어떤 failure profile을 먼저 줄일 것인가"로 읽어야 합니다.

왜 current DeepSeek는 여전히 stack에 남아야 하는가

여기서 흔한 과교정은 V4의 public proof가 애매하다는 이유만으로 DeepSeek 전체를 대화에서 빼버리는 것입니다. 더 정확한 수정은 좁습니다. DeepSeek를 오늘 docs에서 확인되는 contract 그대로 stack에 두는 것. 그리고 오늘 그 역할을 하는 것은 V3.2-backed public API 입니다.

그렇다고 DeepSeek의 역할이 약해지는 것은 아닙니다. $0.28 input / $0.42 output 이라는 current pricing은 GPT-5.4나 Claude Opus 4.6과 비교하면 매우 큰 차이입니다. 게다가 이것은 상상 속 price advantage가 아니라 actual public API contract의 숫자입니다. docs 안에서 128K context 와 thinking mode의 tool use도 확인됩니다. 이 정도면 low-risk, cost-sensitive stage, 예를 들면 대량 요약, bulk classification, 초기 draft, 혹은 "먼저 싸게 많이 돌리는" 업무에서 충분히 쓸 이유가 됩니다.

하지만 이 사실들이 "DeepSeek V4는 이미 GPT-5.4와 Opus 4.6과 동급의 public proof를 가진 frontier peer" 라는 문장을 정당화하지는 않습니다. 많은 비교 글이 바로 그 선을 넘어갑니다. 실제 질문이 "오늘 DeepSeek를 stack에 넣어도 되는가" 라면 답은 yes입니다. 실제 질문이 "확인된 public V4 row를 오늘 바로 나란히 놓아도 되는가" 라면, 2026년 4월 4일 기준 안전한 답은 아직 no입니다.

이것은 anti-DeepSeek가 아닙니다. 의사결정 품질을 위한 correction입니다. 모델은 더 강한 public contract를 fiction으로 보태지 않아도, 지금의 공개 계약만으로 충분히 useful할 수 있습니다.

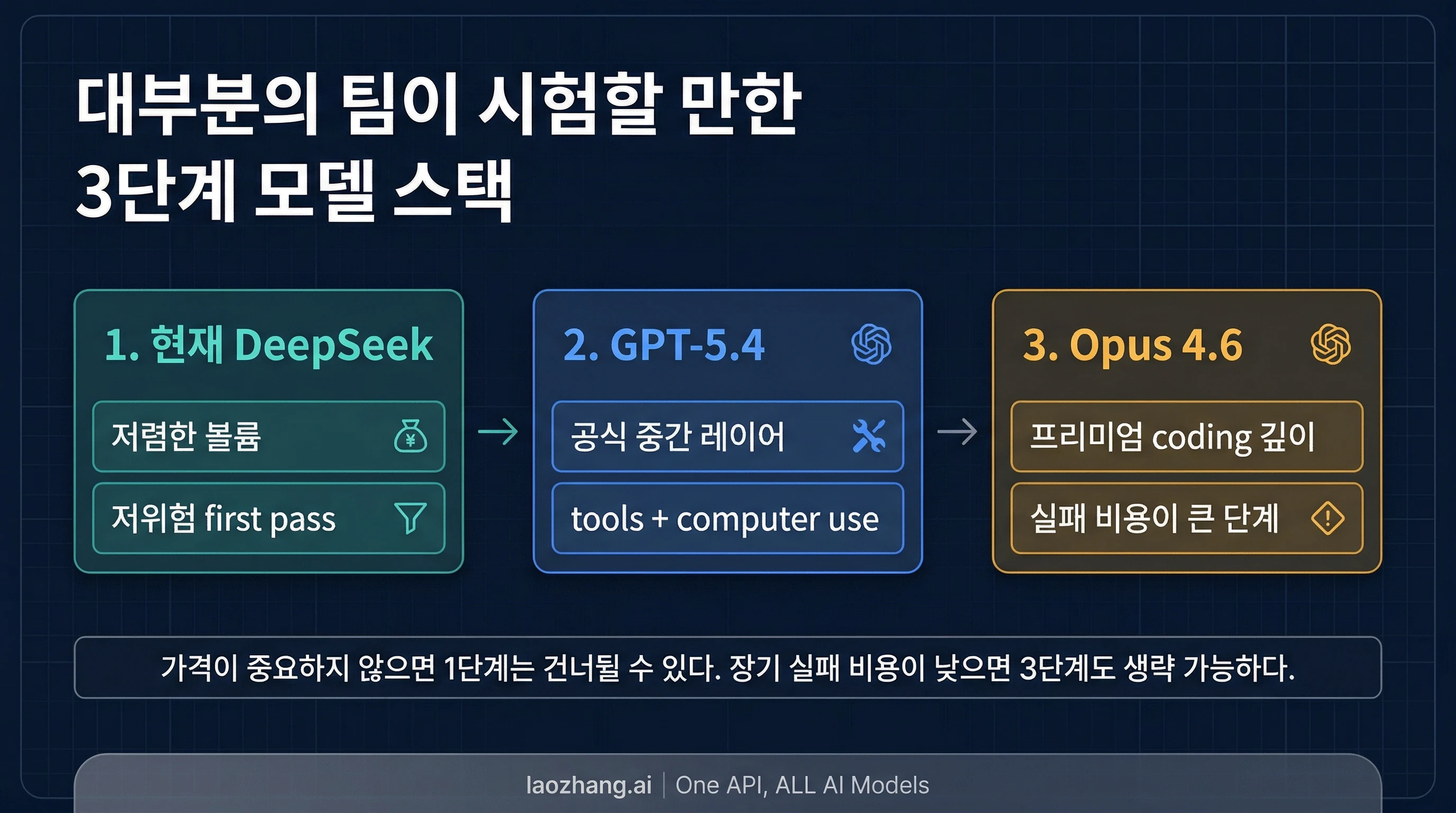

많은 팀이 실제로 테스트해야 할 3단 routing stack

가짜 universal winner 찾기를 멈추면 오히려 system design은 꽤 간단해집니다.

1단계: current DeepSeek를 cheapest public first pass로 사용한다. 가격이 중요한 제약이고, 물량이 크며, 실패 비용이 낮은 stage라면 current DeepSeek API는 여전히 강합니다. 여기서 목표는 frontier crown이 아니라 token discipline입니다.

2단계: GPT-5.4를 current official middle route로 둔다. tool use, computer use, OpenAI current platform continuity가 필요해지는 시점에 GPT-5.4로 올립니다. 많은 팀에게 이 middle route가 가장 설명하기 쉽고, current docs와도 가장 잘 맞습니다. 다음 단계에서 필요한 것이 access planning이라면 GPT-5.4 접근 가이드 가 이어지는 읽을거리입니다.

3단계: Claude Opus 4.6을 expensive-failure tier에 둔다. 약한 first pass의 비용이 token bill보다 커지는 순간 Opus 4.6을 씁니다. repo-scale coding, 긴 execution, review에서 구조적으로 구해내고 싶지 않은 큰 output 같은 작업이 여기에 들어갑니다.

이것은 복잡함을 위한 복잡함이 아닙니다. public evidence가 비대칭이고 pricing도 충분히 떨어져 있으니 자연스럽게 이렇게 됩니다. 팀에 따라서는 두 단계로 줄어듭니다. 가격이 거의 중요하지 않다면 current DeepSeek를 건너뛰고 GPT-5.4와 Opus 4.6만 직접 비교할 수 있습니다. long-horizon high-stakes coding까지 가지 않는다면 Opus 4.6까지 올릴 필요도 없습니다. 중요한 변화는 생각하는 방식입니다. 같은 종류의 공개 증거를 갖고 있지 않은 세 행에서 한 명의 winner를 뽑는 질문 을 멈추는 것입니다.

정말 궁금한 것이 model contract가 아니라 toolchain이라면

이 query를 치는 사람들 중 일부는 사실 모델 계약보다 workflow를 알고 싶은 경우가 많습니다. 즉, "어느 모델이 가장 강한가"보다 "어느 toolchain으로 일을 굴릴까" 입니다. 그것은 다른 의사결정 레이어입니다. OpenAI의 current product side를 정리하고 싶다면 OpenAI Codex 2026년 3월 업데이트 로 가는 편이 맞습니다. live steering과 async delegation의 차이를 보고 싶다면 Claude Code vs Codex 2026 가 더 정확한 다음 글입니다. 이 글은 의도적으로 model contract layer에 머물러서 이야기를 너무 넓히지 않습니다.

FAQ

DeepSeek V4는 지금 공식 공개 상태인가

2026년 4월 4일 기준 current public API docs 안에서 DeepSeek V4의 독립된 public model page나 pricing row는 확인되지 않았습니다. 공개 행은 계속 DeepSeek-V3.2 를 가리켰습니다.

개발자는 어떤 모델을 먼저 테스트해야 하나

가장 명확한 OpenAI 현행 계약과 documented tool / computer use를 원하면 GPT-5.4 입니다. long-horizon coding과 비싼 재작업 비용이 지배적이면 Claude Opus 4.6 입니다. 가격 하한이 가장 중요하면 current DeepSeek API 를 먼저 돌릴 이유가 있습니다.

GPT-5.4를 그냥 1M context model이라고 써도 되나

조심스러운 표현은 이렇습니다. OpenAI current material은 표준 272K context 와 Codex 안의 experimental 1M support 를 따로 설명합니다. 관련은 있지만 같은 operating contract는 아니므로 하나의 generic claim으로 평평하게 만들지 않는 편이 안전합니다.

V4가 미확인이어도 current DeepSeek는 여전히 쓸 가치가 있나

있습니다. 수정해야 할 것은 "DeepSeek를 빼는 것"이 아니라 "오늘 public에 나온 contract로 쓰는 것"입니다. cost-sensitive하고 low-risk한 stage에서는 current DeepSeek API가 여전히 강한 선택지입니다.

DeepSeek를 GPT-5.4나 Opus 4.6과 비교할 의미가 아직 있나

있습니다. 다만 current public DeepSeek 와 가정된 public DeepSeek V4 를 먼저 분리했을 때만 그렇습니다. 그렇게 하면 이 비교는 fake scoreboard가 아니라 cost, proof quality, failure cost를 기준으로 한 staged routing decision이 됩니다.

Bottom line

가장 짧고 정직한 답은 이것입니다. 오늘의 clean frontier contract로는 GPT-5.4와 Claude Opus 4.6을 직접 비교하고, DeepSeek는 current V3.2-backed public API의 위치에서 판단하라. 아직 확인되지 않은 V4 row를 먼저 사실로 만들지 말라. 가장 명확한 OpenAI contract가 필요하면 GPT-5.4 부터, long-horizon coding과 costly cleanup이 핵심이면 Claude Opus 4.6 부터, cost floor가 핵심이면 current DeepSeek 부터 보면 됩니다. 질문을 이렇게 다시 세우는 것만으로도 이 비교는 훨씬 더 실용적이 됩니다.