Claude Opus 4.6이 갑자기 별로라고 느껴져도, 먼저 Anthropic이 공식적으로 모델을 낮춘 것 아닌가부터 생각할 필요는 없습니다. 2026년 4월 10일 기준 Anthropic의 공식 문서와 status history는 universal downgrade를 확인하지 않습니다. 실제로 더 자주 도움이 되는 질문은 따로 있습니다. 지금 보고 있는 현상이 thinking mode mismatch인지, 긴 대화의 컨텍스트 처리 문제인지, shared usage pressure인지, 아니면 claude.ai·Claude Code·Desktop·API 사이의 route difference인지입니다.

가장 안전한 첫 단계는 단순합니다. surface 하나를 고정하고, fresh session을 열고, 한 번에 변수 하나만 바꾸세요. prompt, model, thinking setting, route를 동시에 바꾸면 진단이 바로 흐려집니다. branch-specific control test 뒤에도 같은 task가 계속 얕거나, 컨텍스트를 잃거나, 들쭉날쭉하다면 그때부터 repeatable issue로 보고 evidence를 남길 가치가 생깁니다.

확인 메모: Opus 4.6 관련 release notes, extended thinking help, usage and length limits help, 현재 product behavior는 2026년 4월 10일에 다시 확인했습니다. 이 문제는 기억보다 current surface behavior에 더 민감하기 때문입니다.

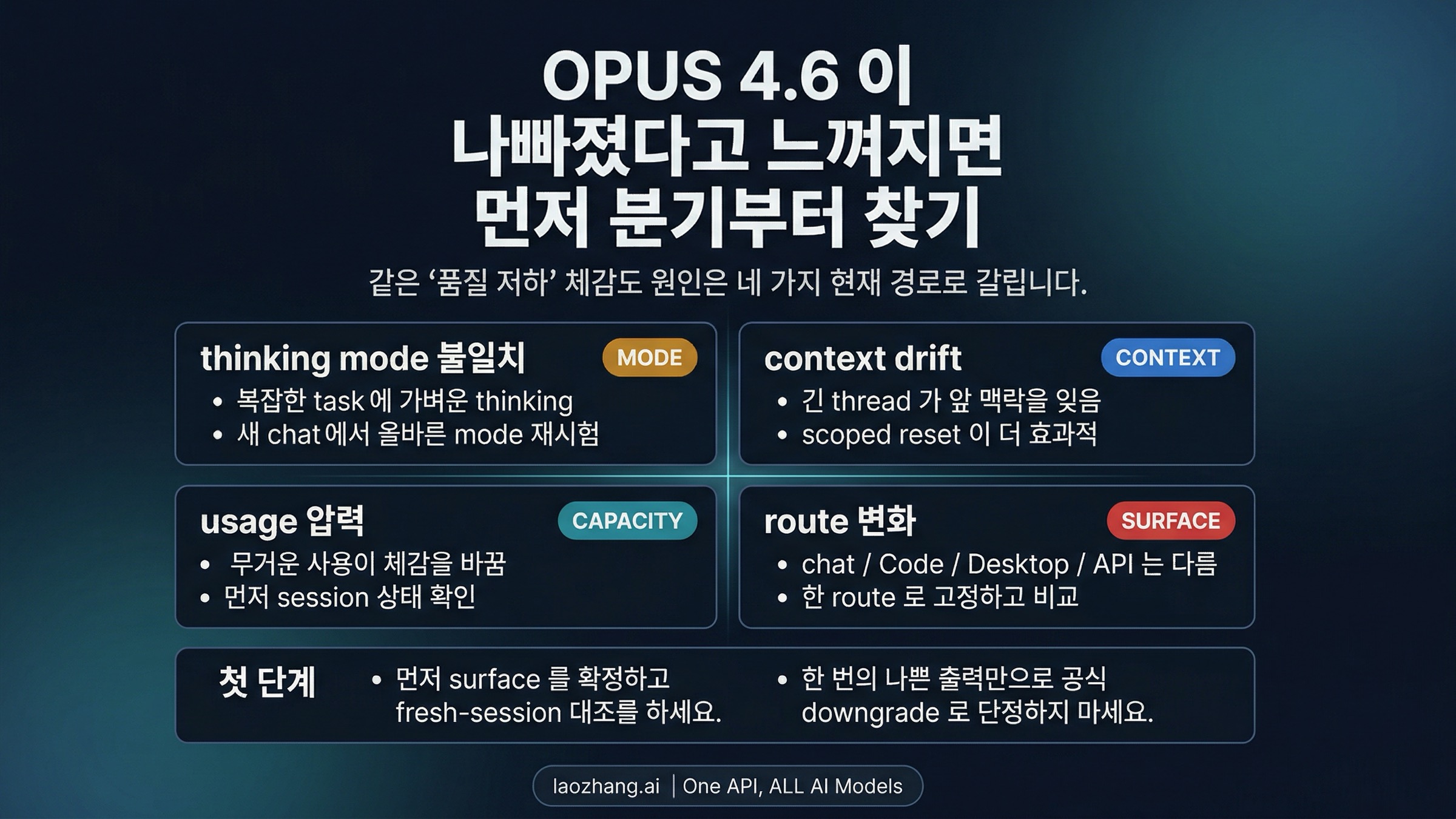

먼저 내가 어느 분기에 있는가부터 결정하세요

Opus 4.6이 나빠졌다는 말은 하나의 증상처럼 들리지만, 실제로는 서로 다른 원인으로 갈라지는 경우가 많습니다.

| 보이는 현상 | 가장 가능성 높은 분기 | 첫 행동 | 무엇이 확인 신호가 되는가 |

|---|---|---|---|

| claude.ai에서 어려운 작업이 갑자기 얕아진다 | thinking mode mismatch | 새 chat에서 같은 task를 explicit thinking으로 다시 돌린다 | thinking을 고정하면 quality가 좋아진다 |

| 긴 thread가 지시나 이전 결론을 자꾸 놓친다 | 컨텍스트 처리 | 짧은 handoff로 새 scoped session을 만든다 | 새 session이 핵심 제약을 더 잘 유지한다 |

| heavy-use day 이후 전체 체감이 나빠진다 | shared usage pressure | usage state를 보고 cleaner window에서 다시 시도한다 | 낮은 pressure에서는 훨씬 안정적이다 |

| claude.ai, Claude Code, Desktop, API가 너무 다르게 느껴진다 | route differences | one route만 고정해 same-task를 비교한다 | fixed route 안에서는 결과가 더 일관된다 |

이렇게 나누는 이유는 설명을 그럴듯하게 만들기 위해서가 아니라, 첫 행동을 틀리지 않기 위해서입니다. 컨텍스트 문제인데 prompt만 계속 손보면 노이즈만 늘어나고, route difference인데 benchmark만 보면 진단은 한 걸음도 가지 않습니다.

2026년에 공식적으로 바뀐 것 중, 체감에 영향을 주는 것들

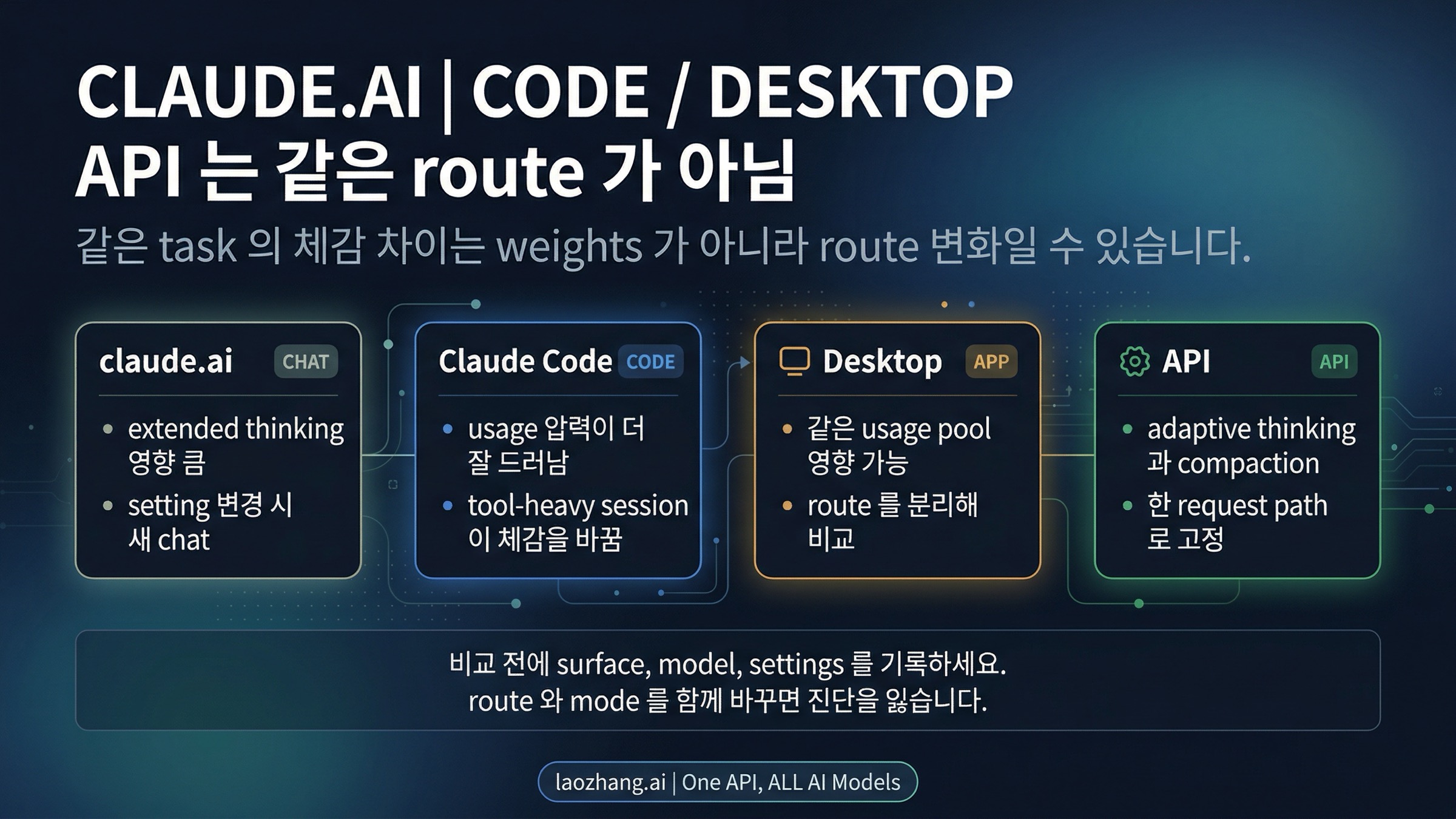

Anthropic의 release notes에 따르면 Claude Opus 4.6은 2026년 2월 5일에 출시되었습니다. API 쪽에서는 adaptive thinking과 effort가 현재 reasoning control로 안내됩니다. 반면 consumer chat에서는 extended thinking이 optional mode입니다. 즉 API와 claude.ai의 thinking behavior를 같은 기본값으로 취급하면 바로 비교가 어긋납니다.

Anthropic help pages는 extended thinking을 켜거나 끄면 새 chat이 시작되고, model version을 바꿔도 새 chat이 열린다고 설명합니다. 많은 사용자가 자신은 같은 작업을 전후 비교한다고 생각하지만, 실제로는 long thread와 fresh chat, 혹은 서로 다른 thinking state를 비교하고 있는 셈입니다.

또 하나 중요한 층위는 컨텍스트 관리입니다. Anthropic은 긴 conversation에서 earlier messages를 summarize한다고 설명하고, API에서는 compaction을 별도 mechanism으로 문서화합니다. 이 둘은 진단에 중요한 공식 사실이지만, 그 자체로 universal downgrade 증거가 되는 것은 아닙니다.

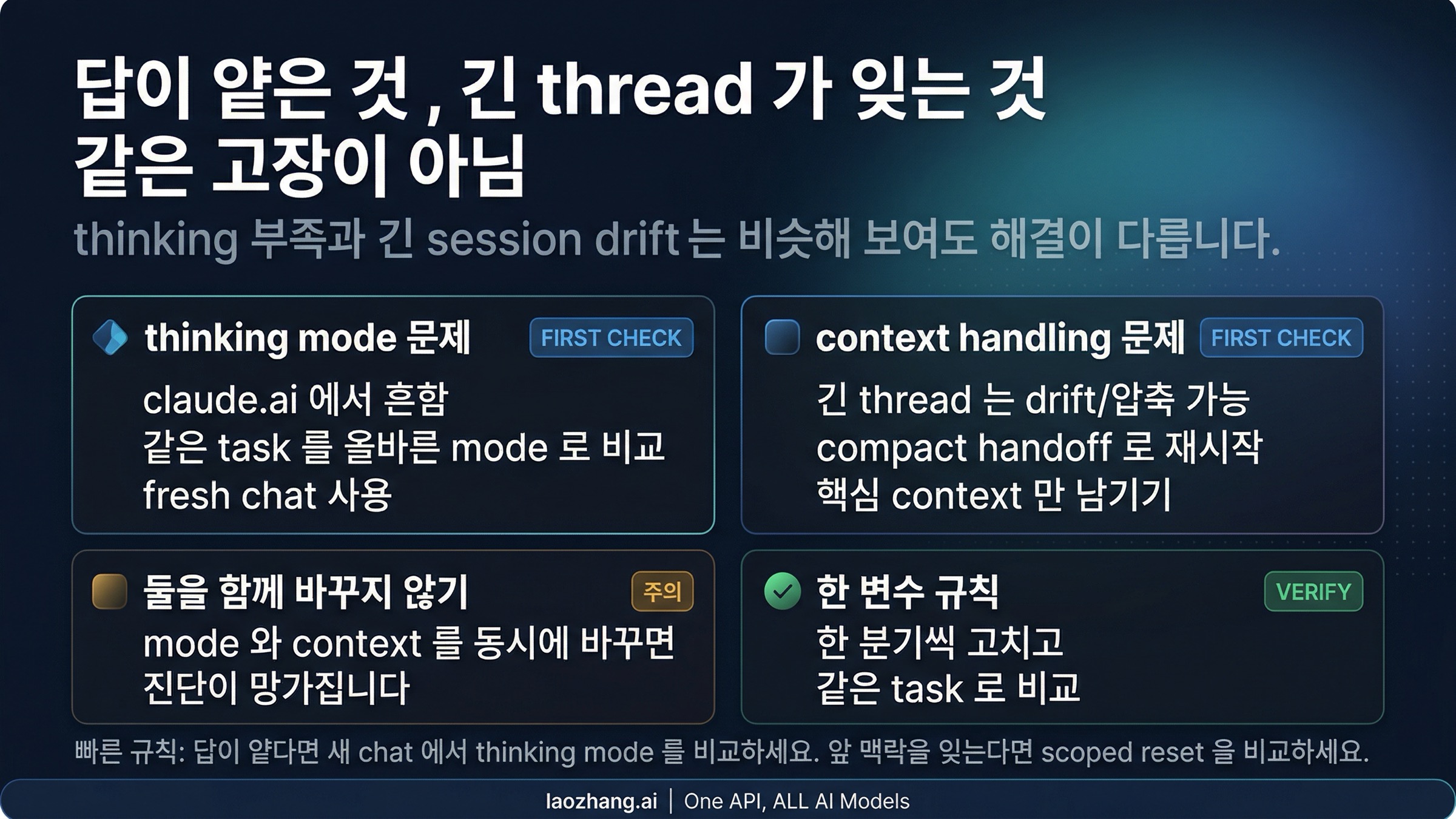

분기 1: thinking mismatch는 가장 쉽게 모델이 약해졌다로 오해됩니다

답이 갑자기 얕아졌다는 complaint에서는 benchmark보다 먼저 thinking behavior를 확인해야 합니다. Claude chat의 extended thinking과 API의 adaptive thinking은 모두 reasoning depth에 영향을 주지만, 하나의 universal switch는 아닙니다.

그래서 thinking을 고정하지 않은 비교는 쉽게 misleading해집니다. 빠른 consumer answer, 낮은 effort의 API call, 더 깊게 생각했던 예전 session을 섞어 비교하면 체감 차이가 크게 날 수밖에 없습니다. 이를 그대로 모델이 나빠졌다로 읽는 순간, route와 setting 차이를 regression으로 오독하게 됩니다.

가장 useful한 control test는 간단합니다. 어려운 task 하나를 고르고, route 하나를 고정한 뒤, fresh session에서 explicit thinking으로 다시 비교합니다. gap이 대부분 줄어든다면, 그 진단은 downgrade보다 thinking mismatch에 더 가깝습니다.

분기 2: 긴 대화의 context drift는 능력 저하와 같은 말이 아닙니다

두 번째로 흔한 complaint는 얕은 답변이 아니라 갑자기 맥락을 놓친다는 감각입니다. Anthropic의 현재 문서는 consumer chat에서 earlier messages가 summary화된다고 설명하고, API에서는 compaction을 별도 continuation path로 설명합니다. 세션이 길어질수록 처음과 같은 형태로 컨텍스트가 유지된다고 가정할 수 없습니다.

그래서 잊었다와 모델이 약해졌다를 같은 뜻으로 쓰면 진단이 흐려집니다. 중요한 제약이 원문 그대로 남아 있는 것이 아니라 summary 형태로만 유지될 수 있기 때문입니다. 이런 환경에서는 같은 task도 체감이 달라질 수 있습니다.

여기서 first fix는 긴 mega-prompt가 아니라 clean handoff입니다. 목표, 반드시 지켜야 할 조건, 정말 필요한 files만 짧게 적고 새 scoped session에서 다시 시작하세요. fresh session이 눈에 띄게 안정되면, 문제는 context-handling branch 쪽일 가능성이 큽니다.

분기 3: shared usage pressure는 비교 조건 자체를 바꿉니다

Anthropic은 claude.ai, Claude Code, Claude Desktop이 하나의 usage pool을 공유한다고 말합니다. headroom은 model, feature, file size, conversation length에 따라 달라집니다. 이 사실만으로도 heavy-use day와 light-use day의 체감 차이는 충분히 설명됩니다.

여기서 조심할 점은 unsupported claim으로 뛰지 않는 것입니다. 공식 문서는 usage가 높으면 Opus를 의도적으로 더 나쁘게 만든다고 말하지 않습니다. 다만 비교하고 있는 conditions가 이미 다르면, 그 체감 차이를 그대로 model quality difference로 읽으면 안 된다는 정도까지는 충분히 말해 줍니다.

그래서 먼저 usage state를 보고, cleaner window에서 같은 종류의 task를 다시 시도해 보는 것이 맞습니다. 문제가 high-pressure 조건에서만 강하다면, 그것은 universal downgrade보다 noisy comparison에 더 가깝습니다. 더 넓은 shared-usage 설명이 필요하다면 Claude daily limit 가이드, Code 중심 pain이라면 Claude Code usage limits 가이드가 더 맞습니다.

분기 4: claude.ai, Claude Code, Desktop, API는 원래 하나의 경험이 아닙니다

많은 혼란은 여러 execution surfaces를 하나의 Claude story로 묶는 데서 시작합니다. Claude chat은 model switching, extended thinking, conversation handling이라는 product behavior를 가지고 있습니다. Claude Code는 tools와 repo context를 가져옵니다. Desktop은 consumer chat에 가깝지만 완전히 같지는 않습니다. API는 독립적인 thinking controls, long-context contract, compaction surface를 가집니다.

그래서 same-task라도 surface를 넘나드는 비교는 very noisy합니다. Claude Code에서만 나빠 보이는 complaint는 tool-heavy workflow나 old session을 설명할 수 있고, API와 chat의 차이는 route logic 차이일 수 있습니다. 둘 다 real experience이지만 자동으로 universal downgrade를 뜻하지는 않습니다.

공정한 비교는 one fixed route에서만 가능합니다. surface와 context state를 고정하고도 문제가 남아야 serious issue 가능성이 올라갑니다. route를 섞은 비교에서는 결론보다 노이즈가 빨리 커집니다.

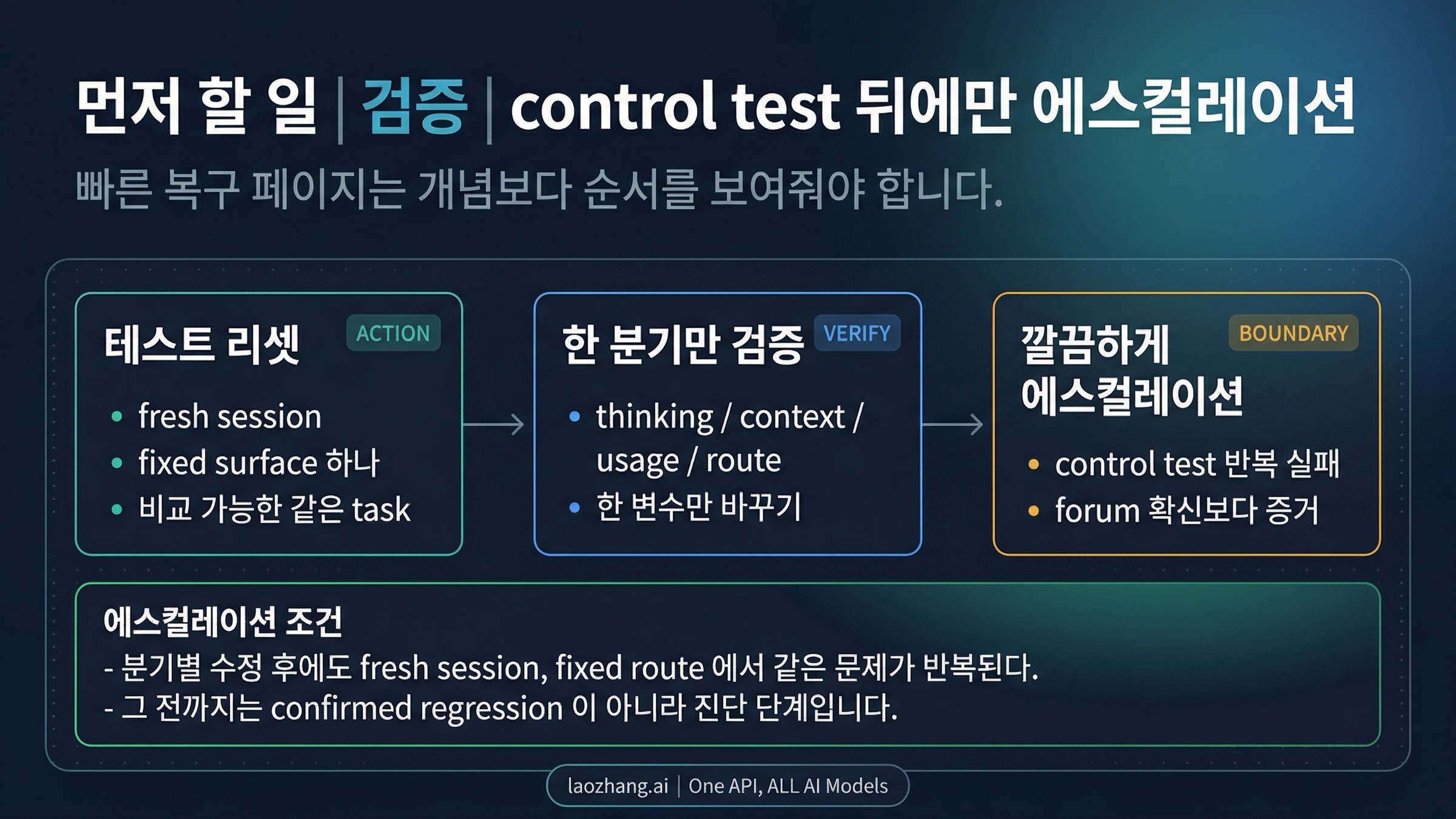

가장 빠른 recovery order

이 페이지에서 가장 중요한 것은 이론보다 순서입니다.

- surface 하나를 고정한다.

chat, Code, Desktop, API를 한 번에 비교하지 않는다. - fresh session을 만든다.

오래된 컨텍스트는 진단을 가장 빨리 흐린다. - thinking을 explicit하게 둔다.

기본 상태를 추측하지 않는다. - 변수는 한 번에 하나만 바꾼다.

route, thread age, thinking setting을 같이 움직이지 않는다. - usage pressure를 확인한다.

heavy-use day였다면 cleaner window에서 다시 본다. - repeatable failure만 escalation한다.

나쁜 하루와 재현 가능한 issue는 다르다.

언제 route를 바꾸고, 언제 model을 바꾸고, 언제 escalation할까

surface를 바꾸는 것은 evidence가 route-specific problem을 가리킨 뒤가 맞습니다. model을 바꾸는 것은 그보다 늦어야 합니다. thinking mismatch, context drift, mixed-route comparison을 정리하기 전에 model switch를 하면 원인만 가려질 수 있습니다.

escalation이 필요한 시점은 one fixed route에서 fresh-session control test를 했고, branch-specific fix도 해 봤는데, 같은 task가 여전히 disproportionate하게 실패할 때입니다. 그때는 surface, 새 session인지 resumed인지, thinking setting, 대략적인 usage state, 재현 task를 함께 남기세요.

FAQ

Anthropic이 Claude Opus 4.6의 공식 downgrade를 인정했나요?

아니요. 2026년 4월 10일 기준 공식 문서와 status history는 universal downgrade를 확인하지 않습니다.

긴 thread에서 컨텍스트를 잊는 것은 능력 저하의 증거인가요?

항상 그렇지는 않습니다. consumer chat의 summary 처리와 API의 compaction 같은 current behavior를 먼저 의심하는 쪽이 더 자연스럽습니다.

Extended thinking과 adaptive thinking은 같은 건가요?

같지 않습니다. consumer chat과 API는 다른 surface behavior를 가지고 있습니다.

왜 claude.ai와 API는 다른 제품처럼 느껴지나요?

원래 route가 다르기 때문입니다. thinking controls와 context contract도 완전히 같지 않습니다.

언제 prompt tuning을 멈추고 escalation으로 넘어가야 하나요?

one fixed route에서 fresh-session control test와 branch-specific fix를 거쳤는데도 같은 문제가 계속 재현될 때입니다.