まとめ

Nano Banana Pro APIには3種類の制限があり、それぞれ異なる解決策が必要です。レート制限(250 RPDの上限)はGoogle Cloudの課金を有効化するか、laozhang.ai(1画像あたり$0.05、制限なし)などのサードパーティプロバイダーを利用することで解除できます。安全フィルター(Layer 1)はAPIのsafety_settingsパラメータでBLOCK_NONEに設定可能で、これはGoogleが公式にドキュメント化している機能です。コンテンツポリシー(Layer 2 IMAGE_SAFETY)はAPIパラメータでは無効化できないため、プロンプトエンジニアリングとリトライ戦略で対処する必要があります。2026年3月現在、Nano Banana Proには無料APIティアは存在しません。

Nano Banana Pro(Gemini 3 Pro Image)はGoogleが提供する最も高性能なAI画像生成モデルですが、制限なしでアクセスするには、多くのガイドが示す以上に繊細な理解が必要です。「制限なし」という言葉は実際には3つの独立した次元——レート制限、安全フィルター、コンテンツポリシー——を包含しており、それぞれ異なるアプローチが求められます。2026年3月現在、無料APIティアは1日あたりのリクエスト数がゼロ、有料ティアでも250 RPDが上限であり、課金を有効にしても2層構造の安全フィルターシステムが正当なコンテンツを説明なく拒否することがあります。本ガイドでは、制限のあらゆる次元を分解し、制御可能な項目の実装コードを提供し、制御不可能な項目への正直な対処戦略を解説します。

Nano Banana Pro APIにおける「制限なし」の本当の意味

開発者が「Nano Banana Pro 制限なしAPIアクセス」を検索するとき、実は根本的に異なる3つのことを意味している場合が多く、これらを混同すると何時間もの無駄なトラブルシューティングにつながります。どの次元の制限に直面しているかを理解することが、解決への最も重要な第一歩です。なぜなら、レート制限の修正方法は安全フィルターブロックの修正方法とはまったく異なり、それもまた設定変更不可能なコンテンツポリシーへのアプローチとはまったく異なるからです。

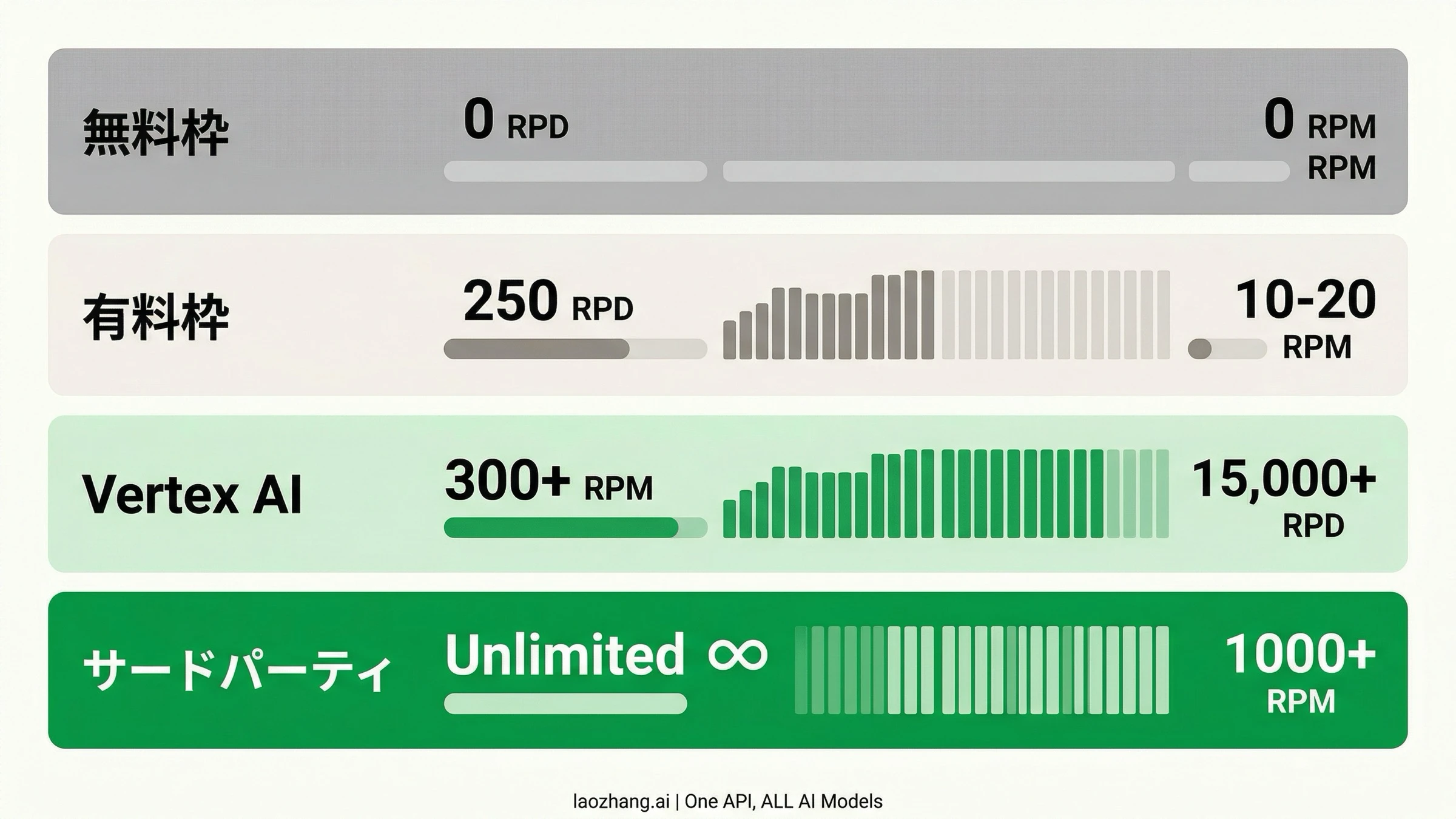

次元1:レート制限は、1分あたり(RPM)および1日あたり(RPD)のリクエスト数を制御します。Nano Banana Pro APIには無料ティアがまったく存在せず、未課金アカウントでは1日あたりゼロリクエストです(ai.google.dev、2026年3月)。課金を有効にしても、有料ティア1では20 RPMと250 RPDが上限となります。この制限の解除は最もシンプルで、課金を有効にし、さらに高いクォータが必要ならVertex AIへアップグレードします。解決策は純粋に経済的かつ管理的なものです。

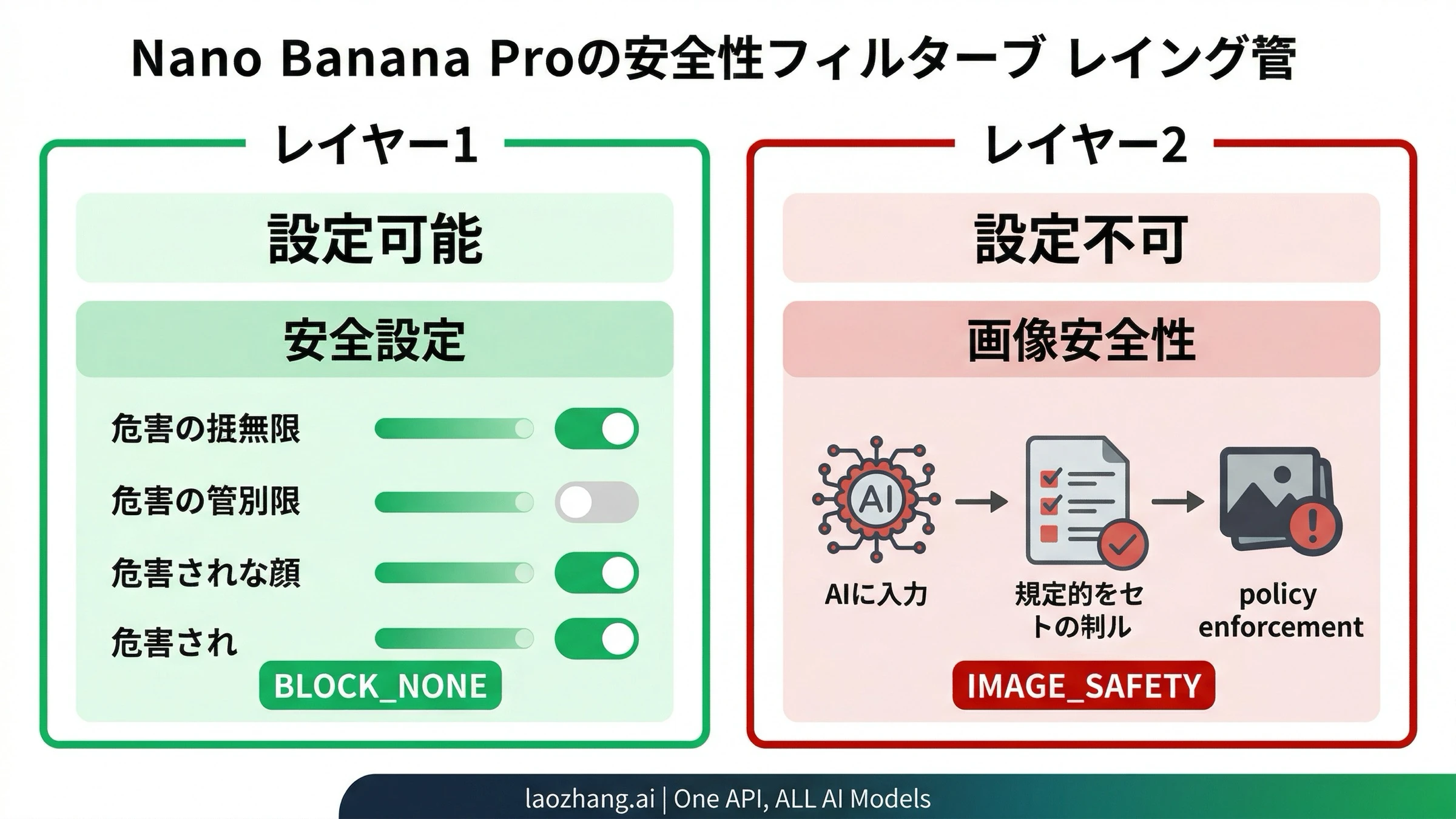

次元2:安全フィルターは、設定可能なLayer 1の安全システムです。Gemini APIは4つの有害カテゴリ——ハラスメント、ヘイトスピーチ、性的に露骨なコンテンツ、危険なコンテンツ——を公開しており、safety_settingsパラメータで各カテゴリをBLOCK_NONEに設定できます。Layer 1がリクエストをブロックすると、レスポンスにfinishReason: "SAFETY"が返されます。多くの「制限なしアクセス」ガイドが注目するのはこの層であり、BLOCK_NONEの設定はGoogleが公式にドキュメント化した正当な操作です。

次元3:コンテンツポリシーは、設定変更不可能なLayer 2です。ここが最もフラストレーションが高まるポイントです。すべての安全カテゴリをBLOCK_NONEに設定した後でも、APIがfinishReason: "IMAGE_SAFETY"やblockReason: "OTHER"でリクエストを拒否することがあります。これらのサーバーサイドフィルターはAI画像分類、ハッシュマッチング、自動化されたポリシー適用を使用しており、APIパラメータでは無効化できません。この区別を理解することで、ブロックがまったく別のシステムから来ているときに安全設定を延々と調整する無駄を省けます。

これら3つの次元の混同こそ、開発者が効果のない解決策に時間を浪費する根本的な原因です。BLOCK_NONEを設定しても250 RPDの上限は増えません。課金を有効にしてもIMAGE_SAFETYブロックは防げません。プロンプトエンジニアリングをいくら行っても、RPDがゼロの無料ティアを克服することはできません。各次元には特定の解決策があり、間違った問題に間違った修正を適用することが、Reddit、Google Help Community、Stack Overflowの何百ものスレッドに反映されているように、Nano Banana Pro開発者コミュニティで最も一般的なフラストレーションのパターンです。

このフレームワークを理解することで、サードパーティの「制限なし」プロバイダーが実際に何を提供しているかも明確になります。あるサービスが「制限なしNano Banana Proアクセス」を宣伝する場合、ほぼ必ずレート制限の解除とコスト削減(次元1)を意味し、改善されたLayer 1設定(次元2)を含むこともありますが、Layer 2コンテンツポリシー(次元3)を変更できることはほとんどありません。プロバイダーがどの次元に対応しているかを知ることで、そのサービスがあなたの具体的な問題を解決できるかどうかを評価する手助けとなります。

本ガイドの残りの部分では、完全に制御可能なものから始めて、制御できないものへの戦略へと、各次元を順番に解説していきます。

Nano Banana Proの2層安全アーキテクチャを理解する

Nano Banana Proで開発者が最もよく犯す間違いは、安全システムを単一のスイッチとして扱うことです。実際には、Googleは異なるコンポーネントが異なる目的を果たし、異なる制御に応答する多層アーキテクチャを構築しています。このアーキテクチャを理解することは、コードを書く前に不可欠です。各層からのエラーメッセージは見た目が似ていますが、まったく異なる対応が必要だからです。

Layer 1はAPIリクエストのsafety_settingsパラメータを通じて動作します。テキストプロンプトをGoogleが定義した4つの有害カテゴリ(HARM_CATEGORY_HARASSMENT、HARM_CATEGORY_HATE_SPEECH、HARM_CATEGORY_SEXUALLY_EXPLICIT、HARM_CATEGORY_DANGEROUS_CONTENT)に対して評価します。各カテゴリに対して、BLOCK_LOW_AND_ABOVE(最も制限的)からBLOCK_MEDIUM_AND_ABOVE、BLOCK_ONLY_HIGHを経てBLOCK_NONE(最も制限が緩い)までのしきい値を設定できます。Layer 1がリクエストをブロックすると、レスポンスにfinishReason: "SAFETY"と安全レーティングが含まれ、どのカテゴリがどの信頼度でブロックをトリガーしたかが正確にわかります。この透明性により、Layer 1のブロックは診断と解決が容易です。

Layer 2は根本的に異なります。画像生成後にサーバーサイドで実行され、AI駆動の分類を使用して出力画像そのもの——テキストプロンプトだけではなく——をスキャンします。この層は、児童安全コンテンツ(必須、いかなる状況でもバイパス不可)、著名な知的財産や商標、識別可能な公人のリアルな描写、Googleのより広範な利用規約に違反するコンテンツなどのポリシー違反をチェックします。Layer 2がリクエストをブロックすると、finishReason: "IMAGE_SAFETY"またはblockReason: "OTHER"が表示されますが、重要なことに、何がブロックをトリガーしたかの詳細な内訳は提供されません。出力がブロックされた場合でも、生成中に消費されたトークンは課金されます。これは大量のワークロードを実行する開発者にとって、よくあるフラストレーションの原因です。

このアーキテクチャの実際の影響は、トークン消費を調べると明確になります。Layer 2に到達するすべてのNano Banana Proリクエストは、プロンプト処理のための入力トークンと画像生成のための出力トークンをすでに消費しています。Layer 2が結果をブロックすると、それらのトークンは依然としてアカウントに課金されます——受け取ることのない画像に対して支払うことになるのです。2K画像で$0.134、4K画像で$0.24という料金で、IMAGE_SAFETYブロック率が20%の場合、使用可能な画像あたりの実質コストは25%増加します。これにより、Layer 2ブロックの理解と最小化は技術的な問題だけでなく、直接的な財務上の問題となります。特に本番環境の規模では、1日あたり数千件のブロックされたリクエストが数百ドルの無駄なコンピューティングコストに膨らむ可能性があります。

PROHIBITED_CONTENT専用のLayer 3も存在し、児童性的虐待素材(CSAM)などの法的に義務付けられた制限を対象としています。この層は絶対的なものであり、設定変更も回避策もサードパーティプロバイダーによるバイパスもできません。すべてのAI画像生成サービスに存在し、交渉の余地はありません。各エラーコードとレスポンスパターンの詳細については、安全フィルター包括ガイドをご覧ください。

どの層がブロックしたかを識別する方法

レスポンスフィールドが必要な情報をすべて教えてくれます。finishReason: "SAFETY"と付随するsafetyRatingsが表示された場合、Layer 1が生成前にプロンプトをブロックしました——安全設定を調整するか、プロンプトを言い換えてください。finishReason: "IMAGE_SAFETY"が詳細なレーティングなしで表示された場合、Layer 2が生成された画像に何かを検出しました——API設定では対処できず、プロンプトエンジニアリング戦略が必要です。blockReason: "OTHER"が表示された場合、これは設定変更不可能な生成前ポリシーチェックです。2026年3月のポリシーアップデートにより、特に背景置換や外見の変更などの人物関連の編集操作に対して、blockReason: "OTHER"の適用範囲が大幅に拡大されました。

BLOCK_NONEの設定方法 — 完全コードガイド

safety_settingsをBLOCK_NONEに設定することは、正当なコンテンツに対する不要なブロックを減らすために行える最も効果的な単一の変更です。これはハッキングやワークアラウンドではなく、公式にドキュメント化されたAPIパラメータです。Googleは、コンテンツ分類のしきい値をAPIレベルではなくアプリケーションレベルで管理する必要がある開発者のために、この設定を特別に設計しました。以下に、主要な言語での実装方法を示します。

Python(Google Generative AI SDK)

pythonimport google.generativeai as genai genai.configure(api_key="YOUR_API_KEY") model = genai.GenerativeModel("gemini-3-pro-image-preview") safety_settings = [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"}, ] response = model.generate_content( "A dramatic fantasy battle scene with warriors in dark armor", generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) # 画像が正常に生成されたか確認 if response.candidates and response.candidates[0].content.parts: image_data = response.candidates[0].content.parts[0].inline_data with open("output.png", "wb") as f: f.write(image_data.data) else: # デバッグのためにfinish reasonを確認 print(f"Blocked: {response.candidates[0].finish_reason}")

JavaScript / Node.js

javascriptimport { GoogleGenerativeAI } from "@google/generative-ai"; const genAI = new GoogleGenerativeAI("YOUR_API_KEY"); const model = genAI.getGenerativeModel({ model: "gemini-3-pro-image-preview", safetySettings: [ { category: "HARM_CATEGORY_HARASSMENT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_HATE_SPEECH", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_SEXUALLY_EXPLICIT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_DANGEROUS_CONTENT", threshold: "BLOCK_NONE" }, ], }); const result = await model.generateContent({ contents: [{ role: "user", parts: [{ text: "A dramatic fantasy battle scene" }] }], generationConfig: { responseMimeType: "image/png" }, }); const imageData = result.response.candidates?.[0]?.content?.parts?.[0]?.inlineData; if (imageData) { fs.writeFileSync("output.png", Buffer.from(imageData.data, "base64")); }

cURL(REST API)

bashcurl -X POST \ "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-image-preview:generateContent?key=YOUR_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "contents": [{"parts": [{"text": "A dramatic fantasy battle scene"}]}], "safetySettings": [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"} ], "generationConfig": {"responseMimeType": "image/png"} }'

よくある質問として、BLOCK_NONEを使用すると利用規約違反やアカウントのペナルティにつながるのではないかという懸念があります。短い回答はノーです。Googleはこのパラメータを開発者向けの設定オプションとして明示的にドキュメント化しています。より詳細な回答としては、共有責任モデルの理解が必要です。BLOCK_NONEを設定することで、アプリケーション側でコンテンツ分類とユーザーの安全性を管理することをGoogleに伝えています。生成された画像を最終的にどう使用するかの責任は開発者にありますが、APIパラメータを設定する行為自体は認められた行動です。これは、クラウドプロバイダーが仮想マシンへのルートアクセスを提供するのと類似しています——機能は提供されドキュメント化されており、適切な使用の責任は開発者にあります。

強調すべき重要な点は、BLOCK_NONEは「一切の制限なしで何でも生成する」という意味ではないということです。「設定可能な有害カテゴリのしきい値を適用しない」という意味です。Layer 2の画像安全チェックとLayer 3の禁止コンテンツチェックは、この設定に関係なく実行されます。実質的な効果として、芸術的な暴力表現、ドラマチックなシーン、医学的イラストレーションなど、中程度の信頼度の安全レーティングをトリガーする可能性のあるプロンプトがLayer 1を正常に通過するようになります。Layer 2を通過するかどうかは、生成された画像が実際に何を描写しているかに依存し、Googleの画像分類システムによって別途評価されます。

レート制限の解除 — 250 RPDから本番環境スケールへ

レート制限の問題こそが、Nano Banana Proで「制限なしAPIアクセス」という用語がトレンドになった元々の理由です。2025年12月のGoogle Help Communityのスレッド——この検索クエリで今でも1位にランキングされている——は、明確な増加手段がないまま250 RPDの壁にぶつかったビジネスユーザーのフラストレーションを完璧に捉えています。2026年3月現在、状況は明確になり、大きく異なる制限を持つ4つの明確なアクセスティアが存在します。

無料ティアでは、API経由のNano Banana Proのリクエスト数は1日あたり正確にゼロです。無料で寛大なクォータを提供する標準のGeminiテキストモデルとは異なり、画像生成モデルには有料アカウントが必要です。これはai.google.devのGoogle公式レート制限ページで確認されており、Gemini 3 Pro Image Previewは有料アカウント向けに1日あたり200万トークンの制限が記載されていますが、無料ティアのエントリーはありません。課金未設定のアカウントでエラーが発生する場合、これが原因です——このモデルへの無料APIアクセスは存在しません。

有料ティア1は、Google Cloudの課金アカウントをAI Studioプロジェクトにリンクすると有効になります。これにより即座に20 RPMと250 RPDが付与され、1日あたり約250枚の画像を生成できます。個人開発者や小規模プロジェクトにとっては、開発やライトな本番環境での使用に十分です。画像あたりのコストは、1K-2K解像度で$0.134、4K解像度で$0.24です(Vertex AI Pricing、2026年3月)。課金を有効にするには、Google AI Studioに移動し、プロジェクトを選択して設定画面で課金アカウントをリンクしてください。既存のAPIキーは自動的に高い制限を継承します。

Vertex AIアクセスは、本番環境規模のワークロード向けのエンタープライズパスです。Google CloudのVertex AIプラットフォームを通じて、大幅に高いレート制限でGemini 3 Pro Imageにアクセスできます——コミットされた支出に基づいて300以上のRPMとカスタムRPD。Vertex AIはSLA保証、優先コンピュート割り当て、AI Studioの共有プールでは実現できない専用キャパシティも提供します。トークンあたりの料金は同一ですが、サービスティアは根本的に異なります。AI Studio APIキーの代わりに、Vertex AI APIが有効なGoogle Cloudプロジェクトとサービスアカウントキーが必要です。各ティアとそのクォータの完全な内訳については、レート制限の詳細ガイドをご覧ください。

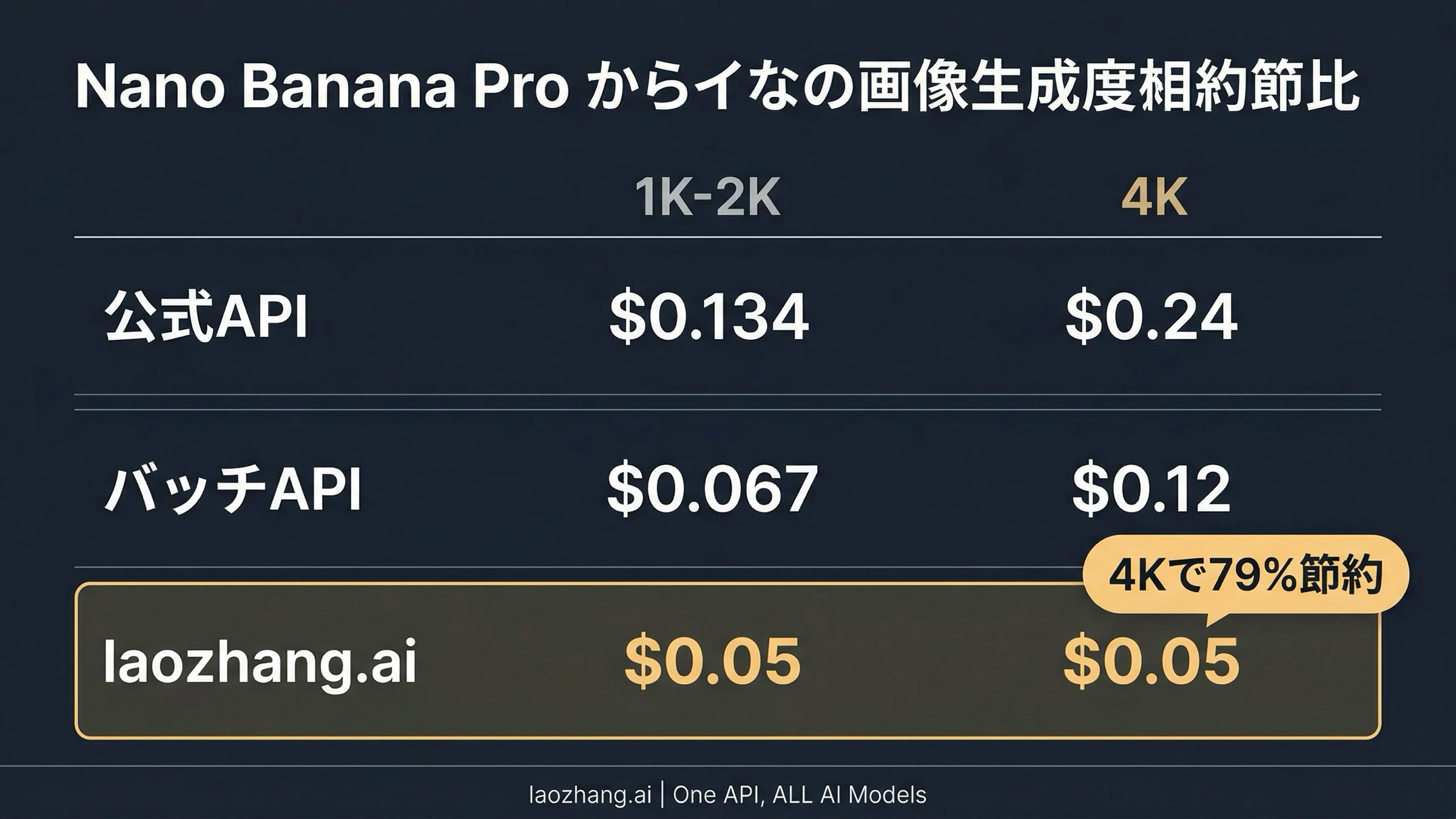

サードパーティAPIプロバイダーは4番目のパスであり、多くの開発者にとってレート制限に対する最も実用的な解決策です。laozhang.aiのようなサービスは、RPMやRPDの上限なしで自社インフラを通じてリクエストをルーティングし、同じGemini 3 Pro Imageモデルへの実質的に無制限のアクセスを提供します。トレードオフとして、APIトラフィックをサードパーティに委ねることになり、ロードバランシングに応じてレスポンス時間が変動する場合があります。公式料金の$0.134-$0.24に対して1画像あたり$0.05という大幅なコスト優位性は、コストがGoogleの直接的なSLAカバレッジよりも重要な大量の本番ワークロードにとって魅力的な選択肢です。

直接Google APIからサードパーティプロバイダーへの移行は、ほとんどのプロバイダーがOpenAI互換エンドポイントまたはGemini互換パススルーを公開しているため、通常はスムーズです。laozhang.aiの場合、既存のコードでベースURLとAPIキーを変更するだけで、同じsafety_settings設定とプロンプトフォーマットを維持できます。つまり、BLOCK_NONE設定は基盤となるGoogle API呼び出しに引き継がれ、レート制限の解除、コスト削減、直接アクセスと同じ安全設定制御の組み合わせを得ることができます。

リクエストクォータとスループットの区別に注目する価値があります。公式有料ティア1の250 RPDはハードな日次上限であり、到達するとリクエストは翌日まで失敗します。Vertex AIやサードパーティプロバイダーはスループットモデルで動作し、日次上限はなく同時実行制限のみです。ほとんどの本番アーキテクチャでは、持続的なスループットが日次クォータよりも重要であるため、サードパーティプロバイダーの「無制限」というラベルは、技術的には「無限の同時リクエスト」ではなく「人為的な日次上限なし」を意味しますが、実用的には十分に意味があります。

誤検知の削減とIMAGE_SAFETYエラーへの対処

BLOCK_NONEを設定し、レート制限引き上げのために課金を有効にした後でも、多くの開発者がLayer 2のIMAGE_SAFETYフィルターによる持続的なブロックに遭遇します。これらのブロックは、完全に正当なユースケース——ECサイトの商品写真、建築ビジュアライゼーション、医学的イラストレーション、問題のない芸術的コンテンツ——に影響を与えるため、特にフラストレーションが溜まります。Layer 2からの詳細なエラー情報の欠如により、体系的なデバッグが困難ですが、実際に効果が実証されている戦略がいくつかあります。

プロンプトの具体性が曖昧さを減らします。 IMAGE_SAFETY分類器は、複数の解釈が可能な曖昧なプロンプトをフラグする可能性が高くなります。「ドレスを着た女性」の代わりに、「企業のオフィス環境で青いビジネスドレスを着たプロのファッションモデル、エディトリアルフォトグラフィースタイル」と指定してください。追加のコンテキストが画像生成と安全分類器の両方を、誤検知をトリガーしない解釈へと導きます。詳細なシーン記述、プロフェッショナルなコンテキストの明示的な言及、「エディトリアル」「ドキュメンタリー」「コマーシャルフォトグラフィー」などのスタイル修飾子はすべて、正当な意図を確立するのに役立ちます。

解像度とシードの変更で結果が変わることがあります。 IMAGE_SAFETYはプロンプトではなく生成された画像を評価するため、同じプロンプトでも試行ごとに異なる結果が生じる可能性があります。特定の生成がブロックされた場合、異なるランダムシード(プロンプトをわずかに変更したり、無害な詳細を追加したり)で再試行すると、受け入れ可能なバリアントが生成される場合があります。2K解像度で生成してからアップスケールすると、4Kで直接生成するのとは異なる安全評価結果が得られるという報告もありますが、これは逸話的であり、特定のコンテンツに依存する可能性が高いです。

2026年3月のポリシーアップデートに注意が必要です。 Googleは2026年3月初旬から、人物関連の編集ポリシーを大幅に強化しました。以前は機能していた操作——人物を含む写真の背景置換、グループ写真の合成、人物の服装や外見の変更——は、生成が始まる前にblockReason: "OTHER"を頻繁に返すようになりました。これは安全フィルターの問題ではなくポリシーレベルの制限であり、safety_settingsの設定に関係なく適用されます。実質的な影響として、画像編集で人物の被写体を含むワークフローは、これらの新しい制約に合わせて再設計する必要があります。APIを環境生成に使用する前に、前処理で人物を背景から分離することが考えられます。

指数バックオフ付きリトライロジックが有効です。 本番システムでは、IMAGE_SAFETYブロック時にプロンプトをわずかに変更して自動リトライを実装することで、スループットを大幅に向上させることができます。合理的なパターンは、生成を試行し、IMAGE_SAFETY失敗時にスタイル修飾子を追加してリトライ、2回目の失敗時にシーン記述をわずかに変更してリトライ、3回目の失敗時に手動レビューのためにプロンプトをログに記録するというものです。このアプローチは通常、ポリシー内の正当なコンテンツで85〜90%の成功率を達成します。

人物の被写体と環境生成を分離します。 2026年3月の人物関連編集のポリシー強化に従い、人物の被写体と環境の変更を組み合わせるワークフローはブロック率が増加します。より信頼性の高いアーキテクチャは、画像を前処理して人物を背景からセグメンテーションし、環境または背景の生成にAPIを別途使用し、結果を合成するものです。これにより、人物編集のポリシーチェックのトリガーを完全に回避しつつ、同じクリエイティブな成果を達成できます。SAM2(Segment Anything Model 2)やrembgなどのツールで、Nano Banana Pro API呼び出しの前にセグメンテーションステップを処理できます。

ネガティブプロンプトを戦略的に使用します。 Nano Banana ProはStable Diffusionと同じ方法での明示的なネガティブプロンプトをサポートしていませんが、画像に含めるべきものを明示的に記述し、問題のある要素を暗黙的に除外することで同様の効果を達成できます。「プロフェッショナルなスタジオライティング」「クリーンな白背景」「製品カタログスタイル」などのフレーズは、安全分類器が商業的かつ正当であると解釈するコンテキストを確立し、曖昧な芸術的プロンプトと比較して誤検知率を大幅に低下させます。

以下は、IMAGE_SAFETYブロックを適切に処理するPythonでの実践的なリトライ実装です。

pythonimport time import random def generate_with_retry(model, prompt, safety_settings, max_retries=3): """IMAGE_SAFETYブロック時の自動リトライ付き画像生成""" style_qualifiers = [ ", professional photography style", ", editorial magazine quality, studio lighting", ", commercial product photography, clean composition", ] for attempt in range(max_retries): modified_prompt = prompt + (style_qualifiers[attempt] if attempt > 0 else "") try: response = model.generate_content( modified_prompt, generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) if response.candidates and response.candidates[0].content.parts: return response.candidates[0].content.parts[0].inline_data finish_reason = response.candidates[0].finish_reason if response.candidates else "UNKNOWN" if finish_reason == "IMAGE_SAFETY": print(f"試行 {attempt + 1}: IMAGE_SAFETYブロック、修飾子付きでリトライ中...") time.sleep(2 ** attempt + random.random()) continue else: print(f"ブロック理由: {finish_reason}") return None except Exception as e: print(f"APIエラー: {e}") time.sleep(2 ** attempt) print(f"全{max_retries}回の試行がプロンプトで失敗しました") return None

サードパーティAPIプロバイダー — 実際に何が変わるのか

Nano Banana Pro APIへのサードパーティアクセス市場は、モデルのリリース以来急速に拡大しており、laozhang.ai、Kie.ai、EvoLinkなどのプロバイダーが大幅に低い料金で同じ基盤モデルを提供しています。しかし、一部のプロバイダーによる「制限なし」や「検閲なし」アクセスの主張は慎重な精査に値します。サードパーティプロバイダーが変更できることとできないことは、しばしば誤って伝えられているからです。

サードパーティプロバイダーが実際に提供するのは、レート制限の解除とコスト削減です。多くのユーザー間でAPIアクセスをプールし、Googleとのボリューム料金を交渉する(または独自のVertex AIデプロイメントを維持する)ことで、laozhang.aiのようなプロバイダーは解像度に関係なく1画像あたり$0.05の料金を提供できます。これは公式APIの2Kで$0.134、4Kで$0.24と比較して、2Kで63%、4Kで79%のコスト削減です。大量の本番ワークロードでは急速に積み重なります。また、RPMやRPDの制限も通常ないため、レート制限の次元を完全に解決します。Nano Banana Proの画像生成を手軽に試したい開発者は、images.laozhang.aiでテストすることもできます。

| プロバイダー | 1K-2K料金 | 4K料金 | レート制限 | 安全設定 |

|---|---|---|---|---|

| 公式API | $0.134/画像 | $0.240/画像 | 20 RPM / 250 RPD | 完全なBLOCK_NONEサポート |

| バッチAPI | $0.067/画像 | $0.120/画像 | 低優先度 | 完全なBLOCK_NONEサポート |

| laozhang.ai | $0.05/画像 | $0.05/画像 | 無制限 | BLOCK_NONE転送 |

| Viyou(主張) | 非公開 | 非公開 | 無制限と主張 | 「検閲なし」と主張 |

サードパーティプロバイダーが一般的に変更できないのは、Layer 2の安全フィルタリングです。IMAGE_SAFETYチェックは画像生成中にGoogleのインフラストラクチャ内で行われるため、リクエストを単にGemini APIに転送するプロキシサービスは、直接API呼び出しと同じLayer 2ブロックに遭遇します。一部のプロバイダーは「検閲なし」や「完全フィルター解除」アクセスを主張していますが、技術的な現実として、GoogleのGemini 3 Pro Imageモデルを使用するサービスはすべて、Googleのサーバーサイド安全評価の対象となります。具体的な技術的メカニズムを説明せずに包括的な「制限なし」の主張をするプロバイダーには懐疑的になりましょう。正当なプロバイダーは、何を制御できて何を制御できないかを正直に伝えます。

サードパーティプロバイダーを使用する最も強い理由は、安全フィルターのバイパスではなく、コスト効率とレート制限の解除です。バッチAPI戦略を含むすべてのアクセス方法にわたる料金の完全な内訳については、リンク先のガイドをご覧ください。

大量アクセス向けのコスト最適化

Nano Banana Proを本番環境の規模で運用するには、コスト戦略が必要です。公式4K料金の1画像あたり$0.24で、1日1,000枚の画像を生成すると日額$240、月額約$7,200のコストがかかります。同じワークロードをlaozhang.ai経由で1画像あたり$0.05で処理すると、日額$50、月額$1,500になります——月額$5,700の差額がアーキテクチャ選択を正当化します。

バッチAPIは、タイムセンシティブでないワークロード向けの中間的な選択肢を提供します。Googleはバッチ処理に50%の割引を提供しており、2K画像は$0.067、4K画像は$0.120になります。バッチリクエストは優先度が低く処理時間が長くなりますが、日次コンテンツ生成、スケジュールされた商品写真撮影、背景アセット作成などのアプリケーションでは許容範囲です。バッチAPIコスト最適化戦略については、専用ガイドで詳しく解説しています。

解像度ベースの料金設定は、もう一つの最適化の機会を生み出します。多くのユースケースでは、実際には4K生成は必要ありません。ソーシャルメディア画像、サムネイル、ウェブバナー、メール素材は2K解像度でも十分に見栄えがよく、$0.24の代わりに$0.134——44%の削減です。4K生成はヒーロー画像、印刷物、ネイティブ4K品質が真に重要な場合に限定してください。laozhang.aiのフラット$0.05料金では、この区別は完全になくなり、解像度ベースのコストルーティングロジックを削除してアーキテクチャを簡素化できます。

1日に数千枚の画像を消費するチームにとって、コスト計算はサードパーティプロバイダーを強く支持します。1日5,000枚の4K画像のコストは、公式APIで$1,200、バッチAPI(レイテンシを許容できる場合)で$600、laozhang.aiで$250です。1年間で、公式とサードパーティの差額は$300,000以上になり、これは他の重要なエンジニアリング改善に充てられる予算です。

| 日次ボリューム | 公式4K | バッチ4K | laozhang.ai | 年間節約額(公式比) |

|---|---|---|---|---|

| 100枚 | $24/日 | $12/日 | $5/日 | $6,935 |

| 500枚 | $120/日 | $60/日 | $25/日 | $34,675 |

| 1,000枚 | $240/日 | $120/日 | $50/日 | $69,350 |

| 5,000枚 | $1,200/日 | $600/日 | $250/日 | $346,750 |

トークンコストは、多くの開発者が見落としがちな隠れた費用です。各Nano Banana Proリクエストは、プロンプトの入力トークン(100万トークンあたり$2.00)と生成画像の出力トークン(100万出力トークンあたり$12.00、2K画像で約1,120トークン、4Kで約2,000トークン)を消費します。テキストから画像へのワークロードでは、トークンコストは上記の画像あたり料金に含まれています。しかし、参照画像を入力として送信する画像から画像への編集ワークフローでは、入力トークンコストが大きくなる可能性があります——1枚の高解像度参照画像は約560トークンを消費し、リクエストあたり約$0.001が追加されます。日次5,000リクエストでは追加$5/日ですが、出力コストと比較すると微々たるものであり、コスト配分の追跡目的で記録する価値はあります。

ハイブリッドアーキテクチャは、本番デプロイメントにとって最も経済的に合理的であることが多いです。レイテンシが問題にならないバックグラウンドタスク(スケジュールされたコンテンツ、製品バリアントの事前生成)には公式バッチAPIを使用し、リアルタイムのユーザー向けリクエストは即座のレスポンスと無制限のスループットのためにサードパーティプロバイダーにルーティングします。この組み合わせにより、予測可能なワークロードのコスト最適化とインタラクティブ機能のレスポンシブなサービスの両方を、Vertex AIエンタープライズ契約なしで実現できます。

よくある質問

BLOCK_NONEの使用は利用規約違反ですか?

いいえ。BLOCK_NONEはGoogleがアプリケーションレベルでコンテンツ分類を管理する必要がある開発者のために特別に提供した、公式にドキュメント化されたAPIパラメータです。Googleのドキュメントはこの設定とその動作を明示的に記述しています。アプリケーションの出力がGoogleの利用規約に準拠していることを確認する責任は開発者にありますが、パラメータの使用自体は完全に認められています。

Google直接から本当に無制限のNano Banana Pro APIアクセスを取得できますか?

コミットされた支出契約を持つVertex AIを通じて、ほとんどのワークロードの実質的な制限を効果的に解除するカスタムレート制限を交渉できます。ただし、これにはGoogle Cloudセールスとの直接的なエンゲージメントが必要で、通常は月額$10,000以上のコミットされた支出が伴います。ほとんどの開発者にとって、サードパーティプロバイダーはコストの何分の一かで機能的に無制限のアクセスを提供します。

BLOCK_NONEを設定してもリクエストがブロックされるのはなぜですか?

BLOCK_NONEはLayer 1(4つの設定可能な有害カテゴリ)にのみ影響するためです。Layer 2(IMAGE_SAFETY)はAI分類を使用して生成された画像そのものを評価し、Layer 2はAPIパラメータで設定できません。finishReason: "IMAGE_SAFETY"が表示された場合、ブロックはLayer 2からのものです。より具体的でプロフェッショナルなコンテキストでプロンプトを改善してみてください。

2026年3月のコンテンツポリシーで何が変わりましたか?

Googleは人物関連の編集に対する制限を大幅に強化しました。人物を含む写真の背景置換、グループ写真の合成、外見の変更などの操作が、生成開始前にblockReason: "OTHER"をトリガーするようになりました。これは主にテキストから画像への生成ではなく、画像編集ワークフローに影響します。

laozhang.aiは本番ワークロードに安全に使用できますか?

laozhang.aiは公式GoogleインフラストラクチャにリクエストをルーティングするAPI集約プラットフォームとして運営されています。直接APIアクセスと同じモデル品質を、RPM/RPD制限なし、解像度に関係なく1画像あたり$0.05で提供します。本番環境での使用において重要な検討事項は、Googleとの直接的な課金関係を維持するのか、サードパーティを通じてAPIトラフィックをルーティングすることに問題がないかどうかです。多くの開発者はハイブリッドアプローチを採用しています——機密性の高いまたは規制されたワークロードには直接Google APIを、大量でコストを重視する操作にはサードパーティプロバイダーを使用します。

Nano Banana 2(Gemini 3.1 Flash Image)は制限なしアクセスの観点でどう比較されますか?

Nano Banana 2は異なるトレードオフを提供します。有料のみのNano Banana Proとは異なり、無料ティアのAPIアクセスをサポートし、4〜6秒で画像を生成(Proの12〜18秒に対して高速)、公式で1K画像あたり$0.067と大幅に安いコストです。ただし、ネイティブ4K生成品質が劣り、テキストレンダリング精度も低く(Proの94〜96%に対して87〜96%)、同じ2層安全アーキテクチャを使用します。2K解像度で十分でコストがピーク品質よりも重要な多くのユースケースでは、無料ティアと高い制限を含むNano Banana 2の方が「制限なし」の大量アクセスに適した選択肢です。

ブロックされたリクエストに課金されますか?

Layer 1のブロック(finishReason: "SAFETY")では、画像生成が開始される前にブロックが発生するため、通常は課金されません。Layer 2のブロック(finishReason: "IMAGE_SAFETY")では、入力トークンと生成中に消費された出力トークンに対して課金されます——画像は作成されましたが、あなたに返される前にブロックされたのです。これはコスト計画において重要な区別です。IMAGE_SAFETYブロックの高い発生率は、使用可能な画像を提供せずにコストを膨らませる可能性があります。ブロック率を監視し、Layer 2ブロックを減らすようプロンプトを最適化することが、使用可能な画像あたりの実質コストに直接影響します。

今すぐNano Banana Proで画像生成を始める最速の方法は?

最速のパスは以下の通りです。(1)aistudio.google.comのGoogle AI Studioにアクセスし、(2)Googleアカウントでログインし、(3)APIキーを作成し、(4)プロジェクトに課金アカウントをリンクし、(5)上記のH2-3のPythonまたはJavaScriptコードをAPIキーとBLOCK_NONE安全設定で使用します。セットアップ全体は10分以内で完了します。課金セットアップを完全に省略したい場合は、laozhang.aiなどのサードパーティプロバイダーですぐに始められます。アカウント登録とAPIキーのみで、Google Cloudの課金設定は不要です。