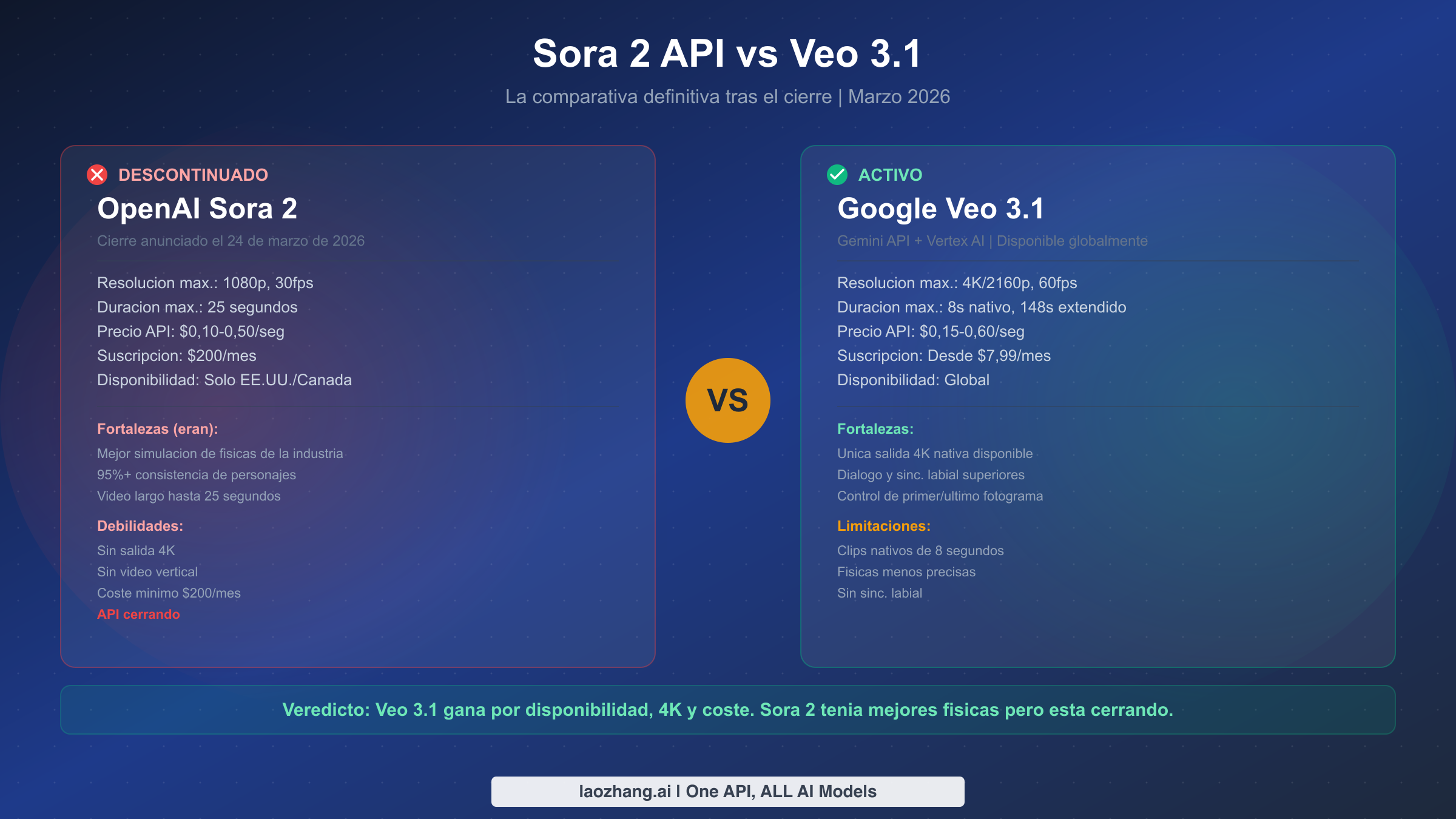

Cualquier comparativa de Sora 2 y Veo 3.1 publicada antes del 24 de marzo de 2026 esta fundamentalmente obsoleta. Ese dia, OpenAI confirmo el cierre completo de la aplicacion Sora, la API y la plataforma Sora.com. Esto transforma la comparativa de "cual deberias elegir" a "esto es a lo que vas a migrar". Veo 3.1 gana en 7 de 11 dimensiones de funcionalidades, cuesta hasta un 96% menos a nivel de suscripcion, y la migracion tarda menos de 30 minutos con solo dos lineas de codigo modificadas.

Resumen rapido

Este es el resumen para desarrolladores que estan decidiendo entre estas dos API de generacion de video en marzo de 2026:

- Sora 2 API se esta cerrando — confirmado el 24 de marzo de 2026. El modelo permanece en ChatGPT, pero la API independiente se esta descontinuando. Para la cobertura completa del cierre de Sora 2, consulta nuestro analisis dedicado

- Veo 3.1 gana en 7 de 11 dimensiones: resolucion (4K vs 1080p), calidad de audio, video vertical, acceso global, coste de suscripcion, disponibilidad de API y limites de peticiones

- Sora 2 sigue liderando en 3 areas: simulacion de fisicas, consistencia de personajes y duracion de clip unico (25s vs 8s nativos)

- La diferencia de coste es enorme: Veo 3.1 empieza en $7,99/mes frente al minimo de $200/mes de Sora 2 — una reduccion del 96%

- La migracion es trivial: Cambia

base_urly el parametromodelmediante laozhang.ai, manteniendo el resto de tu codigo identico

Sora 2 API ha muerto — Que cambia esto en la comparativa

Este articulo existe debido a un cambio sismico en el panorama de la generacion de video con IA. El 24 de marzo de 2026, OpenAI publico en X: "Nos despedimos de Sora." Bloomberg, NBC News, TechCrunch y Variety confirmaron que la aplicacion iOS, Sora.com y Sora 2 API se estan descontinuando. No se ha anunciado una fecha exacta de cierre, pero OpenAI indico que compartira detalles del calendario proximamente.

Las razones detras del cierre revelan desafios fundamentales con el modelo de negocio de Sora. Segun el analisis de WentuoAI, Sora genero aproximadamente 2,1 millones de dolares en ingresos frente a costes de GPU que superaban los cientos de millones anuales. OpenAI se esta preparando para una salida a bolsa con una valoracion de aproximadamente 730 mil millones de dolares (NBC News, 24 de marzo de 2026), y mantener un producto que quema capital a ese ritmo se volvio insostenible. La empresa esta redirigiendo esos recursos de computo hacia la programacion, el razonamiento y la generacion de texto — areas donde mantiene posiciones competitivas mas solidas frente a Anthropic y Google.

¿Que significa esto en la practica? El modelo Sora 2 en si sobrevive dentro de ChatGPT para suscriptores Plus y Pro, por lo que aun puedes generar videos con calidad Sora a traves de la interfaz de chat. Pero la API — el acceso programatico que los desarrolladores integraron en sus aplicaciones — desaparece por completo. Si tu producto depende de llamadas a la API de Sora 2, necesitas migrar. La comparativa que sigue esta disenada para mostrarte exactamente que ganas y que pierdes al pasar a Veo 3.1, y como hacer esa transicion lo mas fluida posible.

Sora 2 vs Veo 3.1 — Comparativa completa de funcionalidades

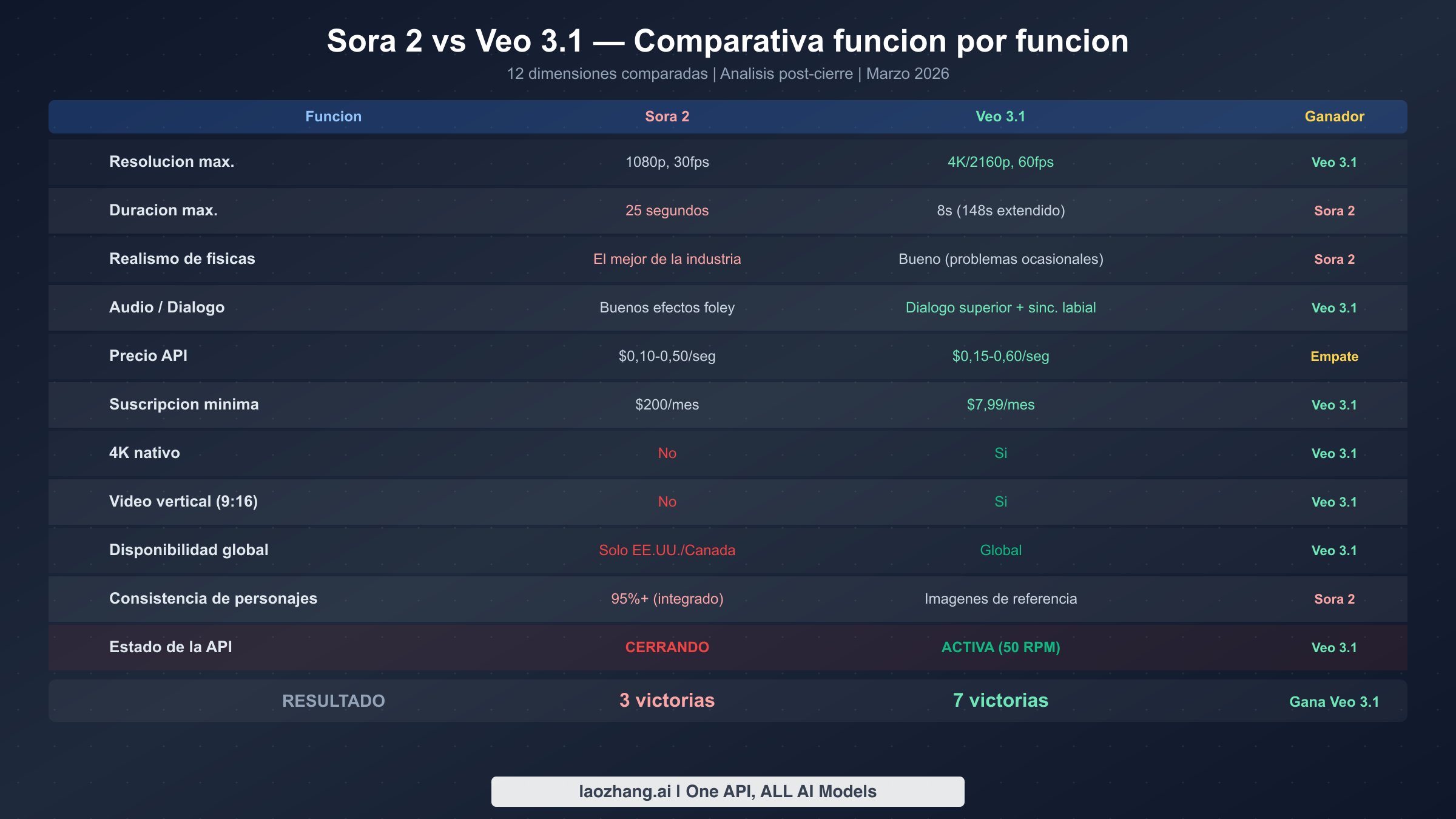

La comparativa entre estos dos modelos no es un caso sencillo donde uno sea mejor en todo. Cada uno tiene fortalezas tecnicas distintas, y comprender las compensaciones especificas es esencial para tomar la decision de migracion correcta. Aqui tienes un desglose dimension por dimension basado en datos verificados mediante SERP de marzo de 2026.

La resolucion y la tasa de fotogramas representan la ventaja mas dramatica de Veo 3.1. Mientras Sora 2 alcanza un maximo de 1080p a 24-30 fotogramas por segundo, Veo 3.1 ofrece salida nativa 4K a 2160p con 60 fotogramas por segundo — sin necesidad de escalado. Para cualquier aplicacion donde la fidelidad visual importa — produccion de video profesional, contenido comercial o visualizacion en pantallas grandes — este es un diferenciador decisivo. Veo 3.1 es actualmente la unica API de generacion de video con IA que ofrece salida 4K nativa real, una capacidad que ningun otro competidor iguala a fecha de marzo de 2026.

La duracion del video es donde Sora 2 mantiene una ventaja clara que Veo 3.1 no puede igualar directamente. Sora 2 genera clips de hasta 25 segundos en una sola generacion, mientras que Veo 3.1 esta limitado a 8 segundos de forma nativa. Sin embargo, Veo 3.1 compensa con su capacidad de extension, permitiendo a los desarrolladores encadenar clips para alcanzar aproximadamente 148 segundos en total mediante extensiones secuenciales de 7 segundos (hasta 20 extensiones por video). El video resultante mantiene una continuidad razonable, aunque las transiciones entre segmentos encadenados no son tan fluidas como la salida de generacion unica de Sora 2. Para aplicaciones que requieren un clip continuo de 15-25 segundos con movimiento fluido en todo momento, esta sigue siendo una brecha real que los desarrolladores deben tener en cuenta al migrar.

La simulacion de fisicas y el realismo del movimiento era la fortaleza caracteristica de Sora 2 — y sigue siendo superior incluso en esta comparativa. Los objetos en los videos de Sora 2 responden a la gravedad, el momento y las colisiones con una fidelidad que los revisores describen constantemente como la mejor de la industria. Las pruebas de Android Authority senalaron que Sora 2 "clavo la atmosfera de la ciudad e incluso los ocupantes del vehiculo" en escenas urbanas complejas. Veo 3.1 produce una excelente calidad visual pero ocasionalmente exhibe lo que los evaluadores describen como "fisicas sin friccion" — objetos que se mueven demasiado suavemente, sin las micro-imperfecciones que hacen convincente el movimiento del mundo real. Esta diferencia importa mas en escenas con interacciones fisicas complejas: agua, tela, multitudes y vehiculos.

La generacion de audio y el dialogo otorgan a Veo 3.1 una ventaja significativa. Ambos modelos generan audio nativo, pero Veo 3.1 demuestra una renderizacion de dialogo superior con una entonacion mas clara, mayor precision en la sincronizacion labial y patrones de habla mas naturales. La fortaleza de audio de Sora 2 reside en los efectos foley — los sonidos ambientales de interacciones fisicas como pasos, puertas cerrandose y ruido ambiental. Para proyectos donde la calidad del dialogo es critica (videos de marketing, contenido explicativo, narrativas centradas en personajes), Veo 3.1 es la opcion mas solida. Para proyectos enfocados en escenas atmosfericas y realismo ambiental, la precision foley de Sora 2 era la mejor herramienta — aunque esta ventaja es ahora academica dado el cierre.

La consistencia de personajes a traves de multiples generaciones fue otra fortaleza de Sora 2. La API Character Cameo logro mas del 95% de consistencia facial cuando los desarrolladores subieron perfiles de personajes para reutilizar entre clips (analisis de WentuoAI). Veo 3.1 aborda la consistencia de personajes de manera diferente, utilizando imagenes de referencia a traves de su funcion "Ingredients to Video" y el control de primer y ultimo fotograma. Este metodo funciona bien pero requiere una ingenieria de prompts y preparacion de imagenes de referencia mas cuidadosa que el enfoque mas automatizado de Sora 2.

La disponibilidad de la API y el acceso es donde la comparativa se vuelve directa. La API de Sora 2 se esta cerrando — fin de la discusion. Veo 3.1 esta disponible globalmente a traves de la API de Gemini con endpoints REST bien documentados, Vertex AI para usuarios de Google Cloud Platform y agregadores de terceros. Los limites de velocidad en produccion soportan 50 peticiones por minuto tanto a traves de Gemini API como de Vertex AI, con modelos de vista previa limitados a 10 RPM. Para una comparativa mas amplia que incluya otras alternativas mas alla de estas dos, consulta nuestra guia de comparacion multi-modelo y el ranking de los mejores modelos de video con IA.

| Funcion | Sora 2 | Veo 3.1 | Ganador |

|---|---|---|---|

| Resolucion maxima | 1080p, 30fps | 4K/2160p, 60fps | Veo 3.1 |

| Duracion maxima | 25 segundos | 8s nativo, 148s extendido | Sora 2 |

| Realismo de fisicas | El mejor de la industria | Bueno (problemas ocasionales) | Sora 2 |

| Audio / Dialogo | Buenos efectos foley | Dialogo superior + sinc. labial | Veo 3.1 |

| Consistencia de personajes | 95%+ integrado | Basado en imagenes de referencia | Sora 2 |

| 4K nativo | No | Si | Veo 3.1 |

| Video vertical (9:16) | No | Si | Veo 3.1 |

| Disponibilidad global | Solo EE.UU./Canada | Global | Veo 3.1 |

| Suscripcion minima | $200/mes | $7,99/mes | Veo 3.1 |

| Limites de la API | N/A (cerrando) | 50 RPM (produccion) | Veo 3.1 |

| Estado de la API | Cerrando | Activa | Veo 3.1 |

El recuento final: Veo 3.1 gana en 7 dimensiones, Sora 2 gana en 3, con el precio de la API aproximadamente empatado dependiendo del nivel. Pero la dimension del estado de la API eclipsa todo lo demas — un producto superior al que no puedes acceder tiene valor practico cero.

Donde destaca realmente cada modelo — Una evaluacion honesta

Comprender las fortalezas genuinas de cada modelo importa incluso despues del cierre, porque te ayuda a establecer expectativas realistas sobre lo que Veo 3.1 puede y no puede reemplazar, e identificar casos donde podrias necesitar complementar Veo 3.1 con otras alternativas.

Lo que Sora 2 hacia mejor que cualquier competidor, y lo que realmente echaras de menos despues de la migracion, se reduce a tres capacidades especificas. Primero, el motor de fisicas producia videos donde la gravedad, el momento y las propiedades de los materiales se comportaban exactamente como lo harian en el mundo real — el agua salpicaba de forma realista, la tela caia naturalmente y los objetos tenian un peso convincente. Segundo, la duracion de clip unico de 25 segundos significaba que podias generar escenas completas sin los desafios de continuidad visual de encadenar clips mas cortos. Tercero, el sistema Character Cameo automatizaba la consistencia de personajes de una manera que requeria menos esfuerzo manual que el enfoque de imagenes de referencia de Veo 3.1. Si tu caso de uso depende en gran medida de estas tres capacidades especificas, deberias probar multiples alternativas en lugar de asumir que Veo 3.1 solo reemplazara completamente tu flujo de trabajo con Sora 2. Kling 3.0 ofrece hasta 180 segundos de duracion con fisicas solidas, lo que lo convierte en una opcion a evaluar como complemento de Veo 3.1 para contenido de larga duracion.

Lo que Veo 3.1 hace mejor, y lo que lo convierte en el sucesor natural para la mayoria de los usuarios de Sora 2, va mucho mas alla de simplemente estar disponible. La salida nativa 4K a 60fps es genuinamente transformadora para la produccion profesional — ningun escalado produce la misma claridad que el renderizado nativo a esa resolucion. La generacion de dialogo con sincronizacion labial precisa abre casos de uso que Sora 2 no podia atender bien, particularmente contenido centrado en personajes y videos de marketing con voz en off. El soporte de video vertical (9:16) es practicamente esencial para cualquier aplicacion dirigida a plataformas moviles, redes sociales o contenido de formato corto. Y la disponibilidad global elimina una barrera significativa — Sora 2 estaba restringido a EE.UU. y Canada, excluyendo a la mayoria de los desarrolladores y creadores de contenido del mundo.

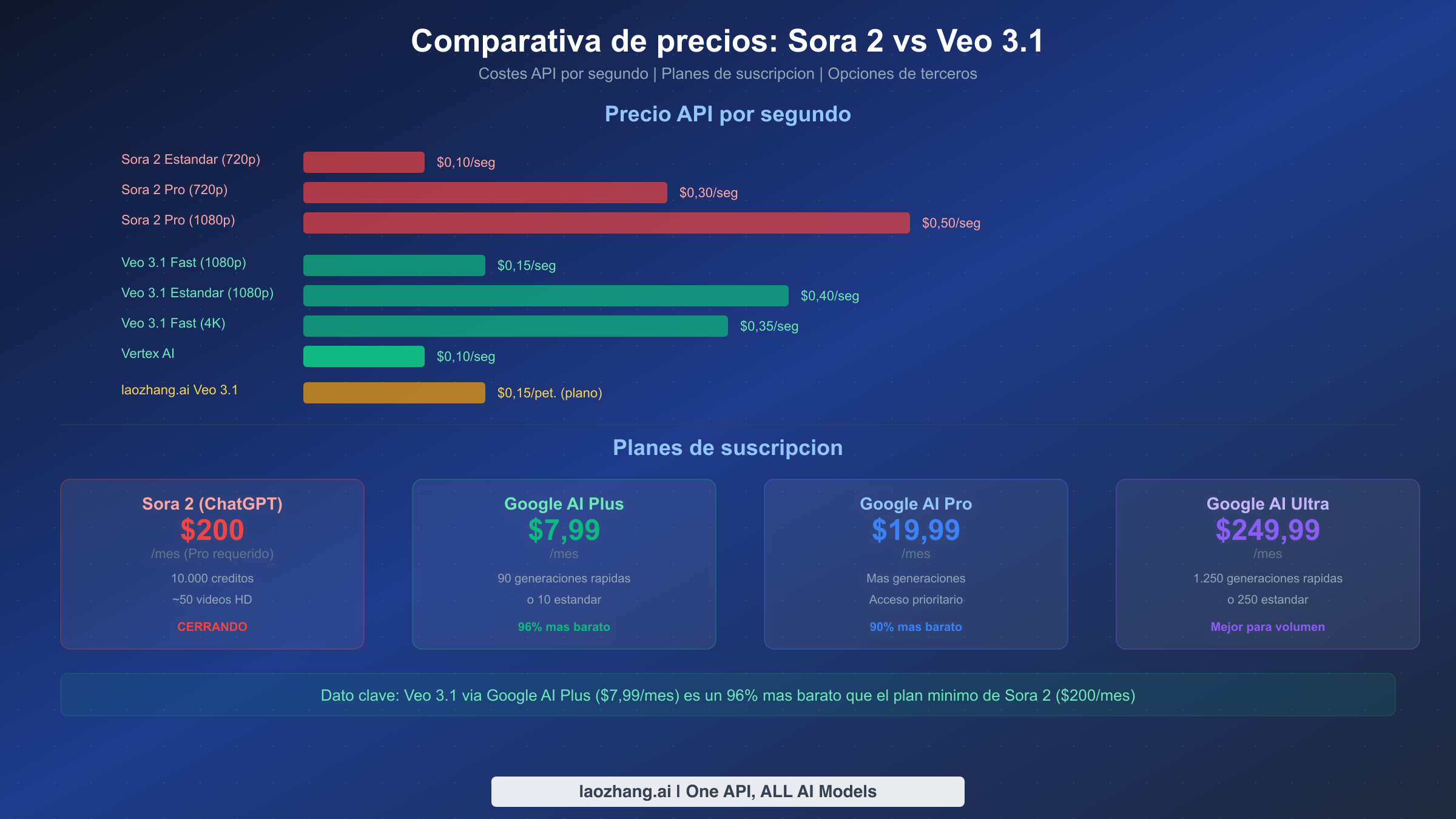

Desglose de precios — El coste real de cada API

El precio ya era una de las mayores debilidades de Sora 2 antes del cierre, y la estructura de costes de Veo 3.1 hace que la migracion sea financieramente atractiva incluso si anteriormente estabas satisfecho con la calidad de salida de Sora 2.

A nivel de API, Sora 2 cobraba $0,10 por segundo para video estandar 720p y escalaba hasta $0,50 por segundo para calidad Pro 1080p. El precio de Veo 3.1 comienza en $0,15 por segundo para el modo Fast (720p/1080p) y $0,40 por segundo para el modo Standard con audio. El nivel 4K cuesta $0,35 por segundo (Fast) o $0,60 por segundo (Standard). A traves de Vertex AI, los desarrolladores pueden acceder a Veo 3.1 a $0,10 por segundo — igualando el nivel mas economico de Sora 2 mientras ofrece salida con capacidad 4K.

La comparativa de suscripciones es aun mas dramatica. El coste minimo para acceder a Sora 2 era de $200 al mes por ChatGPT Pro, que incluia 10.000 creditos — suficientes para aproximadamente 50 videos HD. Google ofrece acceso a Veo 3.1 a traves de Google AI Plus por solo $7,99 al mes (90 generaciones rapidas), Google AI Pro a $19,99 al mes, y Google AI Ultra a $249,99 al mes (1.250 generaciones rapidas o 250 estandar). La comparativa de nivel basico es contundente: $7,99 frente a $200 — una reduccion de costes del 96% para acceso basico.

Para desarrolladores que utilizan acceso por API en lugar de suscripciones, las plataformas agregadoras de terceros ofrecen optimizacion adicional de costes. A traves de laozhang.ai, el acceso a Veo 3.1 Fast esta disponible a $0,15 por peticion (tarifa plana en lugar de facturacion por segundo), con endpoints asincronos que garantizan que nunca se te cobra por generaciones fallidas. Esta politica de no cobrar por fallos es particularmente valiosa durante las pruebas de migracion, cuando puedes generar muchas peticiones experimentales mientras calibras los prompts y parametros para el nuevo modelo. Para una vision mas amplia de los costes de generacion de video en todas las API disponibles, consulta nuestra guia completa de costes de generacion de video con IA.

| Escenario | Coste Sora 2 | Coste Veo 3.1 | Ahorro |

|---|---|---|---|

| 100 videos/mes (suscripcion) | $200 (Pro requerido) | $7,99 (AI Plus) | 96% |

| 100 videos/mes (API, 10s c/u) | $100-500 | $15-150 | 70-97% |

| 1.000 videos/mes (API) | $1.000-5.000 | $150-600 | 85-97% |

| 10.000 videos/mes (API) | $10.000-50.000 | $1.500-6.000 | 85-97% |

Integracion de API — Experiencia de desarrollo comparada

Ambas API siguen el formato compatible con OpenAI, lo que simplifica la migracion significativamente. Sora 2 utilizaba el endpoint estandar /v1/videos para generacion asincrona y /v1/chat/completions para salida en streaming. Veo 3.1 a traves de la API de Gemini usa endpoints REST con autenticacion directa, y a traves de plataformas agregadoras como laozhang.ai, mantiene la misma interfaz compatible con OpenAI con la que los desarrolladores de Sora 2 ya estan familiarizados.

Las diferencias en la experiencia de desarrollo merecen mencion mas alla de la simple compatibilidad de API. La documentacion de Veo 3.1 a traves de la API de Gemini de Google es completa y esta bien mantenida, con ejemplos claros para texto a video, imagen a video y el modo unico de primer y ultimo fotograma. La limitacion de velocidad es transparente y predecible — 50 RPM para produccion, 10 RPM para vista previa — en comparacion con el sistema de creditos mas opaco de Sora 2 que dificultaba la prediccion de costes para cargas de trabajo en produccion.

Una ventaja significativa de la arquitectura de Veo 3.1 es la API de extension, que permite a los desarrolladores encadenar segmentos de video programaticamente. Aunque esto requiere logica adicional en comparacion con el enfoque de generacion unica de Sora 2 para videos mas largos, proporciona un control granular sobre el flujo narrativo. Puedes generar un clip de 4 segundos, evaluar la salida y luego extender solo los segmentos que cumplen tu umbral de calidad — ahorrando potencialmente costes de computo significativos en comparacion con regenerar clips completos de 25 segundos cuando solo una porcion necesita ajuste.

El manejo de errores es otra area donde la migracion ofrece mejoras. Veo 3.1 a traves de la API de Gemini devuelve codigos de error estructurados con orientacion clara de remediacion. Combinado con la politica de no cobrar por fallos de laozhang.ai para endpoints asincronos, la experiencia de desarrollo para manejar casos extremos — rechazos de moderacion de contenido, errores de tiempo de espera, limites de capacidad — es mas predecible y menos costosa que el enfoque de Sora 2 donde las generaciones fallidas aun podian incurrir en cargos dependiendo de en que fase ocurria el fallo.

Guia de migracion — Cambiar de Sora 2 a Veo 3.1

La migracion de Sora 2 a Veo 3.1 es una de las migraciones de API mas sencillas que encontraras, principalmente porque ambas siguen el formato de API compatible con OpenAI y porque las plataformas agregadoras abstraen las diferencias especificas del proveedor. Aqui tienes el proceso concreto que tarda menos de 30 minutos para la mayoria de las integraciones.

El cambio de codigo principal son dos lineas. Si actualmente estas usando el SDK de OpenAI para llamar a Sora 2, la migracion a Veo 3.1 a traves de laozhang.ai requiere cambiar solo los parametros base_url y model. Todo lo demas — tu flujo de autenticacion, estructura de peticiones, analisis de respuestas y manejo de errores — permanece identico. Esto es posible porque laozhang.ai mantiene endpoints compatibles con OpenAI para todos los modelos de video soportados, lo que significa que tu integracion existente con el SDK funciona sin modificaciones mas alla de estos dos valores de configuracion.

pythonfrom openai import OpenAI client = OpenAI(api_key="sk-openai-key") response = client.chat.completions.create( model="sora-2", messages=[{"role": "user", "content": [{"type": "text", "text": "A sunset over the ocean"}]}], stream=True ) # Despues: Veo 3.1 via laozhang.ai (cambiar 2 lineas) from openai import OpenAI client = OpenAI( api_key="your_laozhang_api_key", base_url="https://api.laozhang.ai/v1" ) response = client.chat.completions.create( model="veo-3.1-fast", # o "veo-3.1" para calidad estandar messages=[{"role": "user", "content": [{"type": "text", "text": "A sunset over the ocean"}]}], stream=True )

Mas alla de la migracion basica, hay tres ajustes que vale la pena hacer para aprovechar al maximo las capacidades de Veo 3.1. Primero, si tu aplicacion previamente limitaba la salida a 1080p porque ese era el maximo de Sora 2, actualiza tus parametros de resolucion para solicitar 4K donde sea apropiado — la mejora en calidad visual es sustancial y el aumento de coste es moderado ($0,35/seg frente a $0,15/seg para el modo Fast). Segundo, si necesitas videos de mas de 8 segundos, implementa la logica de encadenamiento de extensiones usando el endpoint de extension de video de la API de Gemini. Tercero, considera agregar los parametros de primer y ultimo fotograma para escenarios donde necesitas un control preciso sobre las transiciones de escena — esta funcion no tiene equivalente en Sora 2 y puede mejorar significativamente la continuidad narrativa en flujos de trabajo multi-toma.

Para despliegues en produccion, implementa una capa de abstraccion de modelos que te permita cambiar entre proveedores de video mediante configuracion en lugar de cambios de codigo. Esto protege contra futuras interrupciones y te permite dirigir diferentes tipos de peticiones al modelo mas adecuado — Veo 3.1 para contenido 4K y con dialogo, potencialmente Kling 3.0 para escenas de larga duracion, y otros modelos a medida que el ecosistema evolucione.

FAQ — Preguntas frecuentes sobre Sora 2 vs Veo 3.1

¿Es Veo 3.1 un reemplazo completo de Sora 2?

Para la mayoria de los casos de uso, si. Veo 3.1 iguala o supera a Sora 2 en 7 de 11 dimensiones de comparacion. Las tres areas donde Sora 2 era superior — simulacion de fisicas, consistencia de personajes y duracion de clip unico — importan principalmente para flujos de trabajo de produccion especificos. La gran mayoria de los desarrolladores encontraran que Veo 3.1 es una mejora, no un compromiso, especialmente cuando se tiene en cuenta la salida 4K, mejor audio y costes dramaticamente menores.

¿Puedo seguir accediendo al modelo Sora 2 despues de que se cierre la API?

El modelo Sora 2 sigue disponible dentro de ChatGPT para suscriptores Plus ($20/mes) y Pro ($200/mes). Puedes generar videos a traves de la interfaz de ChatGPT manualmente, pero no puedes hacer llamadas programaticas a la API. Esto significa que Sora 2 sigue siendo utilizable para trabajo creativo puntual pero no para pipelines de produccion automatizados.

¿Cuanto tiempo tengo antes de que la API de Sora 2 deje de funcionar?

OpenAI no ha anunciado una fecha especifica a fecha de 26 de marzo de 2026. Basandose en patrones historicos de depreciacion (GPT-3 y Codex ambos tuvieron ventanas de ~90 dias), los desarrolladores deberian esperar entre 30 y 90 dias desde que se anuncie formalmente el calendario. Comienza a migrar ahora en lugar de esperar a la fecha limite.

¿Que pasa con la ventaja de fisicas de Sora 2 — hay algo igual de bueno?

Kling 3.0 de Kuaishou es lo mas cercano a la calidad de simulacion de fisicas de Sora 2 y ofrece hasta 180 segundos de duracion a $0,07-0,14/seg. Si el realismo de fisicas es critico para tu caso de uso, considera usar Kling 3.0 como complemento de Veo 3.1 en lugar de depender solo de Veo 3.1.

¿La migracion es realmente solo dos lineas de codigo?

A traves de un agregador compatible con OpenAI como laozhang.ai, si. Cambias el base_url y el parametro model, y el resto de tu codigo — autenticacion, formato de peticion, analisis de respuesta — permanece identico. Si estas llamando a la API de OpenAI directamente (no a traves de un agregador), la migracion implica actualizar la URL del endpoint, la clave API y el nombre del modelo, lo que sigue siendo menos de 5 lineas de cambios.

¿Google cerrara Veo 3.1 como OpenAI cerro Sora?

Aunque nadie puede predecir el futuro con certeza, el perfil de riesgo es significativamente diferente. Veo 3.1 esta integrado en el ecosistema mas amplio de Gemini de Google y en Google Cloud Platform, no es un producto de consumo independiente. La escala de Google significa que la economia de computo que hundio a Sora es menos problematica — la generacion de video es una funcion entre muchas en una plataforma de nube rentable, en lugar de un producto independiente que necesita justificar sus propios costes de GPU de forma independiente.