Gemini restringe la generación de imágenes de personas por tres razones fundamentales: la controversia de diversidad de 2024 que expuso un sesgo peligroso en las imágenes históricas generadas por IA, las regulaciones vigentes sobre deepfakes y privacidad que prohíben imágenes fotorrealistas de personas identificables, y la actualización de seguridad Nano Banana 2 de febrero de 2026 que endureció significativamente las restricciones relacionadas con celebridades y rostros. Sin embargo, Gemini sigue pudiendo generar personajes humanos ficticios, retratos estilizados y personas ilustradas: la clave está en entender los límites exactos de la política y usar las estrategias de prompting adecuadas.

Resumen rápido

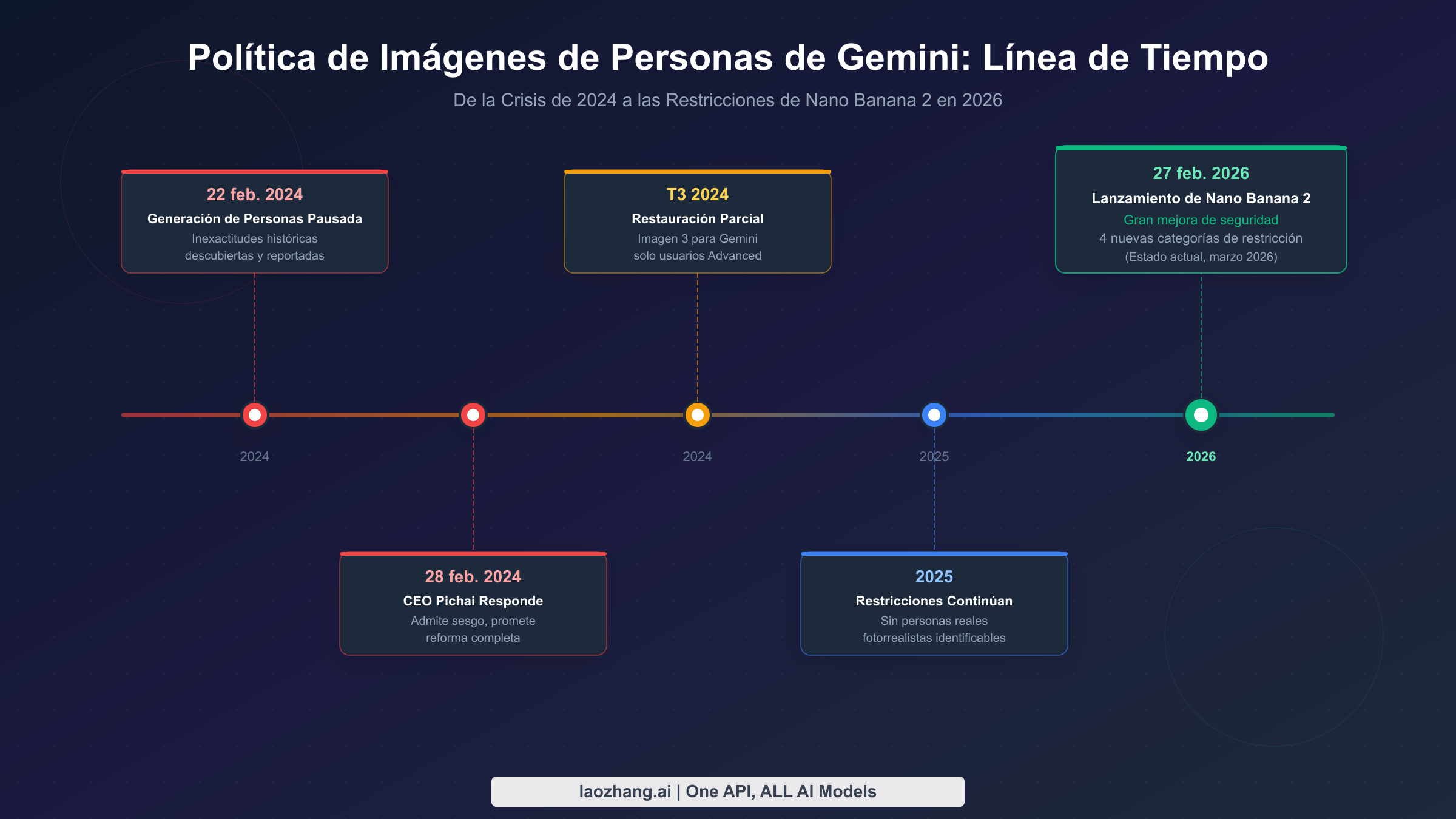

- Bloqueado desde febrero de 2024: Imágenes fotorrealistas de personas reales e identificables (desencadenado por un incidente de imágenes históricas ampliamente criticado)

- Endurecido en febrero de 2026: Nano Banana 2 añadió 4 nuevas categorías de restricción — figuras públicas/celebridades, intercambio de caras, cambio de atuendo en personas reales y manipulación de imágenes financieras

- Sigue funcionando: Personajes ficticios, estilos ilustrados/cartoon, siluetas en multitudes, conceptos de diseño de personajes

- Nota para desarrolladores: Las restricciones de la API difieren de la app Gemini de consumidor — consulta la comparativa de todos los modelos de imagen Gemini para conocer los límites por nivel

La Respuesta Corta — 3 Razones Principales por las que Gemini Bloquea Imágenes de Personas

Cuando los usuarios se topan por primera vez con una negativa de Gemini para generar imágenes — "No puedo crear imágenes realistas de personas reales" — la reacción natural es la frustración. La restricción parece arbitraria, especialmente cuando herramientas de la competencia como Midjourney o DALL-E parecen más permisivas. Pero las restricciones de Gemini para imágenes de personas no son decisiones de política aleatorias. Provienen de una secuencia específica y documentada de eventos y obligaciones legales que no le dejan a Google ninguna opción práctica excepto mantener estas salvaguardas.

Las tres razones fundamentales operan en diferentes niveles. La primera es histórica: el modelo de imagen de Gemini fue sorprendido produciendo resultados seriamente problemáticos a principios de 2024, y las consecuencias fueron tan graves que el CEO de Google tuvo que emitir una disculpa pública. Esto creó una memoria institucional dentro de Google: cualquier relajación de las políticas de imágenes de personas conlleva un enorme riesgo reputacional. La segunda razón es legal: la legislación sobre deepfakes está avanzando rápidamente en los Estados Unidos, la Unión Europea y numerosas otras jurisdicciones, y el equipo legal de Google ha determinado que generar imágenes fotorrealistas de personas identificables crea una responsabilidad inaceptable. La tercera razón es técnica y arquitectónica: el modelo Nano Banana 2 de febrero de 2026 (gemini-3.1-flash-image-preview) incorporó una nueva capa de seguridad dirigida específicamente a cuatro categorías de uso indebido que se habían vuelto prevalentes.

Entender estas tres razones importa porque ayuda a calibrar las expectativas. No se trata de una restricción temporal que desaparecerá cuando la atención pública se dirija a otro lugar — es una respuesta política de múltiples capas a problemas concretos. Lo que ha cambiado, y lo que probablemente cambiará en el futuro, es la precisión de las restricciones. A principios de 2024 se adoptó un enfoque brusco de "pausar todo". La política actual de 2026 es más matizada, bloqueando categorías específicas de contenido dañino mientras permite una amplia gama de usos creativos legítimos. Conocer dónde están los límites te permite trabajar productivamente dentro de ellos en lugar de adivinar qué aceptará Gemini.

La Controversia de 2024: Cómo un Experimento de Diversidad Salió Mal

Para entender por qué las restricciones de Gemini son tan estrictas como son, necesitas comprender lo que sucedió en febrero de 2024 — y por qué ese incidente dejó una huella tan duradera en el enfoque de Google hacia las imágenes de personas generadas por IA.

El Incidente que lo Cambió Todo

El 22 de febrero de 2024, los usuarios comenzaron a publicar capturas de pantalla de la generación de imágenes de Gemini produciendo resultados históricamente inexactos. Cuando se le pedía generar imágenes de "senadores estadounidenses del siglo XIX" o "soldados nazis", Gemini producía grupos racialmente diversos — el modelo había sido excesivamente ajustado para aplicar correcciones de diversidad a todos los prompts sin contexto histórico. Un senador estadounidense del siglo XIX siendo negro, o un soldado alemán de la Segunda Guerra Mundial siendo de ascendencia asiática o africana, no es diversidad — es falsificación histórica. Las imágenes se difundieron ampliamente en las redes sociales, generando críticas sustanciales de comentaristas de todo el espectro político, con algunos calificándolo de desinformación generada por IA y otros enmarcándolo como manipulación ideológica integrada en el modelo.

Seis días después, el 28 de febrero de 2024, el CEO de Google, Sundar Pichai, rompió su habitual silencio público para abordar el tema directamente. En un memorando interno que fue publicado posteriormente, Pichai describió los resultados como "completamente inaceptables" y reconoció que el modelo había producido resultados "inexactos y ofensivos". Se comprometió a una revisión fundamental de cómo Gemini maneja la generación de imágenes humanas — no solo un parche, sino un replanteamiento del enfoque del modelo para representar a personas reales e históricas. Google pausó todas las funciones de generación de imágenes de personas en la aplicación Gemini y la API de Gemini con efecto inmediato.

Por qué la Recuperación Fue Lenta

La mayoría de las empresas tecnológicas, cuando descubren un error, lo parchean y siguen adelante. El incidente de Gemini de 2024 no fue tratado como un error — fue tratado como evidencia de un problema fundamental de alineación. El modelo había aprendido a aplicar correcciones de diversidad en contextos donde la precisión histórica requería lo contrario. Solucionar esto requería más que cambiar un parámetro; requería una evaluación extensa de los datos de entrenamiento y los procesos de aprendizaje por refuerzo que produjeron el sesgo en primer lugar.

En el tercer trimestre de 2024, Google había restaurado la generación limitada de imágenes de personas para los suscriptores de Gemini Advanced utilizando el modelo Imagen 3. Pero fue un lanzamiento controlado, no una restauración completa. El nivel base de Gemini permaneció restringido, y el nivel Advanced también operaba bajo directrices más estrictas que la política anterior a la pausa. A lo largo de 2025, las restricciones continuaron: ninguna imagen fotorrealista de personas reales e identificables siguió siendo la regla central, con el modelo rechazando solicitudes de imágenes de celebridades, retratos que parecían representar a personas reales específicas y cualquier imagen que pudiera interpretarse como representando a una persona real sin un encuadre ficticio claro.

El Impacto Institucional Duradero

Lo que hace que el incidente de 2024 sea especialmente significativo es la respuesta institucional que desencadenó. Google convocó una revisión interna de todas las políticas de imágenes de IA que se extendió durante la segunda mitad de 2024. Esta revisión dio forma a la arquitectura de Nano Banana 2, que se lanzó en febrero de 2026. En lugar de simplemente añadir más filtros de contenido encima del modelo existente, Nano Banana 2 incorporó restricciones de seguridad a nivel de modelo — las restricciones no son un filtro de post-procesamiento que se puede eludir con prompts inteligentes, están integradas en la comprensión fundamental del modelo sobre qué constituye una solicitud de imagen legítima. Por eso las restricciones actuales son más robustas y difíciles de eludir que las restricciones de 2024.

Qué está Bloqueado Hoy: Restricciones de Imágenes de Personas de Gemini en 2026 (Nano Banana 2)

El lanzamiento de Nano Banana 2 (gemini-3.1-flash-image-preview) el 27 de febrero de 2026 representa el estado actual de la política de imágenes de personas de Gemini. Entender exactamente qué rechaza este modelo — y por qué — es esencial para cualquiera que trabaje con las capacidades de generación de imágenes de Gemini. Estas restricciones se aplican tanto en la app Gemini como en el acceso a la API, aunque la rigidez de su aplicación difiere según el nivel.

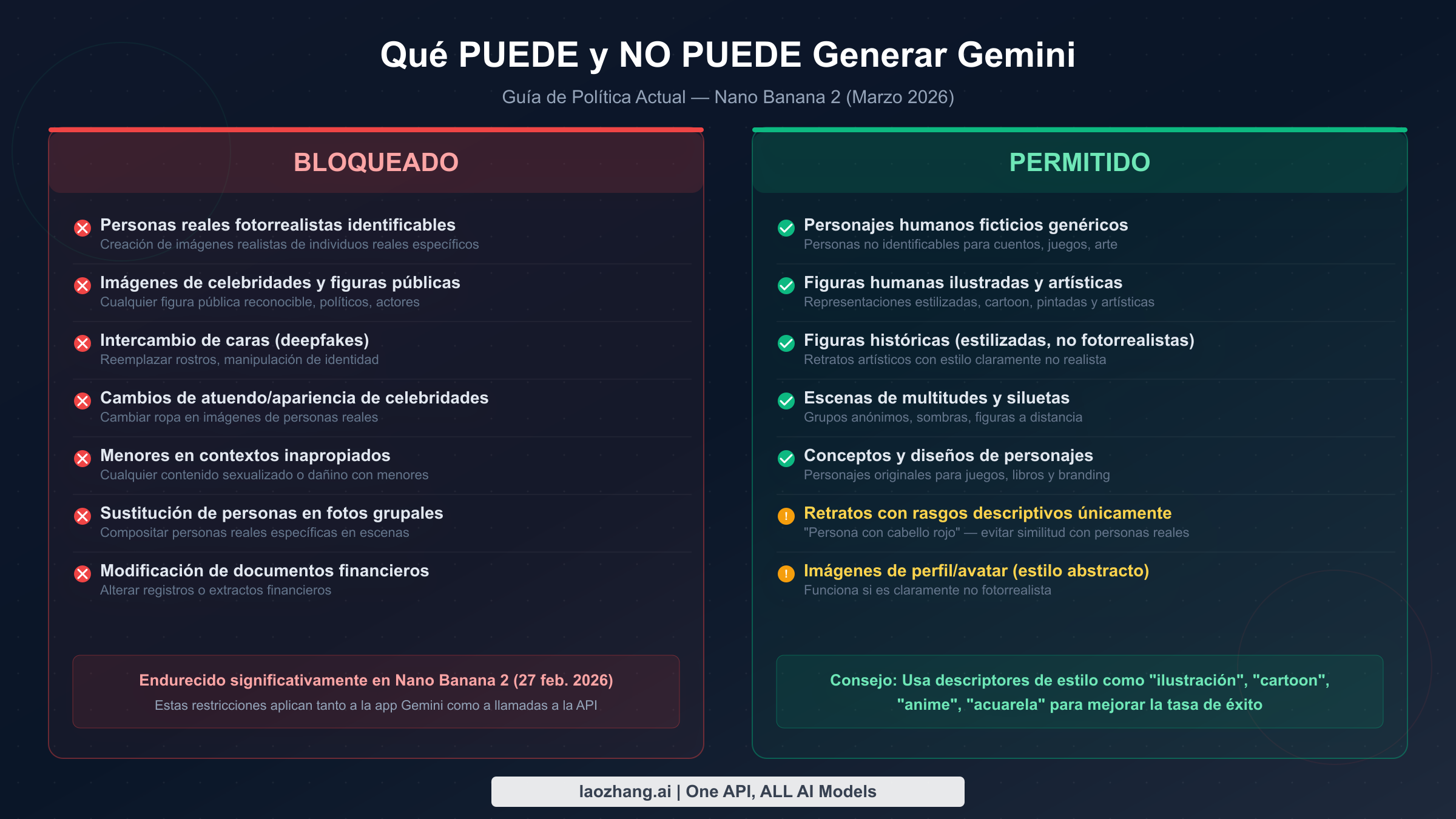

Las personas reales fotorrealistas e identificables son la restricción fundamental que ha estado en vigor desde febrero de 2024. El modelo rechazará cualquier prompt que parezca solicitar una imagen realista de un individuo real específico, ya sea identificado por nombre, descripción ("el CEO de una importante empresa tecnológica") o referencia visual. El umbral para "identificable" es más bajo de lo que muchos usuarios esperan — el modelo no necesita saber con certeza que un individuo real específico es el objetivo; rechazará prompts que encajen en patrones de escenarios donde probablemente se pretende representar a un individuo real específico.

Las imágenes de celebridades y figuras públicas se formalizaron como una categoría explícita en Nano Banana 2. Anteriormente, los rechazos de celebridades se manejaban como un subconjunto de "personas reales identificables". La política de 2026 eleva esto a una restricción independiente: no se pueden generar celebridades nombradas, políticos, atletas, actores, músicos y otras figuras públicas independientemente del contexto, encuadre o propósito declarado. Esto se aplica incluso a solicitudes claramente satíricas o artísticas — el modelo no intenta evaluar la intención, simplemente rechaza la categoría.

El intercambio de caras y los deepfakes representan otra adición de Nano Banana 2. Cualquier prompt que describa reemplazar el rostro de una persona por otro — ya sea a través de un lenguaje explícito ("pon el rostro de [persona A] en este cuerpo") o instrucciones implícitas — desencadena un rechazo. Esta restricción existe específicamente en respuesta a la proliferación de contenido deepfake no consensuado en 2024 y 2025, y refleja la exposición legal de Google bajo la legislación emergente sobre deepfakes.

Los cambios de atuendo y apariencia de celebridades se añadieron como su propia categoría en Nano Banana 2, distinta del intercambio de caras. Los prompts que describen modificar la ropa, el cuerpo o la apariencia de la imagen de una persona real — "muestra a [celebridad] con una ropa diferente" o "cómo se vería [figura pública] con otro peinado" — son rechazados. Esto se dirige específicamente a un caso de uso que se volvió común en las plataformas de redes sociales.

La modificación de documentos financieros completa las cuatro nuevas categorías de restricción de Nano Banana 2. Aunque técnicamente distinta de las restricciones de imágenes de personas, esta categoría refleja la filosofía de seguridad más amplia detrás de la actualización: Gemini no generará imágenes que parezcan ser versiones modificadas de documentos financieros, extractos o registros, independientemente del propósito declarado.

Los mecanismos de aplicación de estas restricciones difieren entre modelos y niveles. La aplicación Gemini de consumidor opera con la interpretación más conservadora, aplicando restricciones con un amplio margen de seguridad que capta algunos casos límite que estarían permitidos bajo una lectura más precisa de la política. El nivel de API — particularmente cuando se accede directamente a gemini-3.1-flash-image-preview — aplica las restricciones con mayor precisión, lo que significa que algunos escenarios creativos ficticios que desencadenan rechazos en la aplicación de consumidor tienen éxito a través de la API. Ningún nivel proporciona una excepción a las restricciones fundamentales, pero el entorno de API es genuinamente más útil para flujos de trabajo creativos profesionales que involucran sujetos humanos.

También vale la pena entender cómo el modelo maneja los casos ambiguos. Cuando un prompt podría interpretarse plausiblemente como que representa a un personaje ficticio o a un individuo real específico, el comportamiento predeterminado del modelo es rechazar en lugar de arriesgarse a un falso negativo. Este valor predeterminado conservador es intencional — el costo de generar incorrectamente una imagen fotorrealista de una persona real sin consentimiento se considera mayor que el costo de rechazar incorrectamente una solicitud creativa legítima. Los usuarios que encuentran rechazos en prompts aparentemente inocentes a menudo están alcanzando este umbral de ambigüedad, no las restricciones centrales en sí mismas.

Vale la pena señalar lo que no está en esta lista. Las restricciones están específicamente dirigidas a personas reales e identificables. No prohíben las figuras humanas en general, y una amplia gama de casos de uso legítimos sigue siendo totalmente compatible — lo que nos lleva al otro lado de la ecuación.

Las Razones más Profundas: Ley de Privacidad, Deepfakes y Prevención de Sesgos

Más allá del incidente de 2024, las restricciones de Gemini reflejan un panorama legal y ético más amplio que ha estado cambiando significativamente. Comprender estos impulsores más profundos ayuda a explicar por qué las restricciones existen en su nivel actual y qué trayectoria probablemente seguirán.

La ley de privacidad es el impulsor legal más concreto. Múltiples jurisdicciones ahora tienen leyes específicas que regulan el uso de la IA para generar imágenes de personas reales. Varios estados de Estados Unidos aprobaron legislación sobre deepfakes en 2024 y 2025, con disposiciones que abordan específicamente la generación de imágenes no consensuada. La Ley de IA de la Unión Europea, que entró en vigencia por fases a lo largo de 2024 y 2025, incluye disposiciones explícitas sobre los sistemas de IA que generan representaciones realistas de personas reales. Para una empresa como Google, que opera en todas estas jurisdicciones simultáneamente, el enfoque más seguro es una política que satisfaga la ley aplicable más restrictiva en todos los ámbitos. Por eso las restricciones son efectivamente globales en lugar de específicas de cada región.

El problema de las imágenes íntimas no consensuadas (NCII, por sus siglas en inglés) ha sido el impulsor más cargado políticamente de la legislación relacionada con deepfakes. Estudios publicados en 2024 y 2025 documentaron que una gran mayoría del contenido deepfake en línea consiste en imágenes sexualizadas no consensuadas de personas reales, dirigidas predominantemente a mujeres. Si bien las políticas de contenido existentes de Gemini ya bloquean el contenido explícito, el riesgo reputacional de estar incluso tangencialmente asociado con la infraestructura que permite la generación de NCII es significativo. Las restricciones sobre celebridades y figuras públicas no son solo cuestión de responsabilidad legal — también son sobre no tener resultados de Gemini apareciendo en los feeds de personas que investigan este tipo de contenido dañino.

El ángulo de prevención de sesgos es específico del incidente de 2024 pero sigue siendo relevante. El problema fundamental expuesto en febrero de 2024 fue que el modelo había aprendido a aplicar correcciones demográficas sin comprender el contexto — una sobrecorrección diseñada para producir resultados más diversos en entornos ficticios se estaba aplicando ciegamente a escenarios históricos donde la representación precisa es diferente de la representación equitativa. Las restricciones no son solo para prevenir resultados dañinos; son para darle al modelo espacio para manejar la genuina complejidad de la representación humana sin cometer errores categóricos. Limitar el alcance de la generación de imágenes humanas es, paradójicamente, cómo Google puede ser más reflexivo sobre la generación de imágenes humanas que sí permite.

También hay una dimensión de dinámica competitiva que vale la pena comprender. Google opera bajo un escrutinio regulatorio significativamente mayor que las empresas de IA más pequeñas, tanto por su posición en el mercado como por los procedimientos antimonopolio en curso en múltiples jurisdicciones. Una controversia equivalente al incidente de 2024 tendría consecuencias desproporcionadas para Google en comparación con un competidor más pequeño. Esta asimetría en la exposición regulatoria explica en parte por qué las decisiones de política de Google en torno a las imágenes de personas son más conservadoras que las de plataformas sin una visibilidad regulatoria comparable. Las restricciones reflejan una gestión de riesgos racional para una empresa en la posición específica de Google, no necesariamente un juicio universal sobre qué imágenes de personas con IA deberían estar permitidas.

Todas las imágenes generadas por Gemini llevan la marca de agua SynthID de Google — una firma digital invisible incorporada en los datos de imagen que permite identificar la imagen como generada por IA incluso después de editar, recortar o convertir el formato. SynthID refleja la misma filosofía subyacente que las restricciones de contenido: el enfoque de Google hacia la seguridad de imágenes de IA involucra infraestructura técnica, no solo reglas de política. La marca de agua no previene directamente el uso indebido, pero crea un rastro de auditoría y demuestra un esfuerzo de buena fe para habilitar la identificación de imágenes de IA que importa en contextos regulatorios.

Qué SÍ Puedes Generar — Imágenes Humanas que Funcionan en 2026

Las restricciones sobre imágenes de personas reales son significativas, pero dejan abierto un espacio creativo sustancial. Entender qué generará Gemini con éxito — y cómo crear prompts para ello — es a menudo más útil que catalogar lo que rechaza.

Los personajes humanos ficticios genéricos son totalmente compatibles y representan la categoría más amplia de imágenes humanas permitidas. Un personaje para un videojuego, un protagonista para una ilustración de un cuento, una persona genérica para un concepto de marketing — todos funcionan, siempre que el prompt no ancle al personaje a un individuo real específico. La clave es mantener la descripción en el dominio de los rasgos físicos y de personalidad en lugar de marcadores de identidad que apunten a personas reales específicas. "Un ingeniero de software de unos 30 años con gafas y una expresión pensativa" se genera con éxito; "un ingeniero de software que se parece a [CEO tecnológico específico]" no.

Las figuras humanas ilustradas y artísticas representan otra categoría de soporte confiable. Cuando los prompts invocan explícitamente un estilo artístico — ilustración, caricatura, acuarela, pintura al óleo, estilo de cómic, anime, chibi — el umbral de Gemini para la restricción de "persona fotorrealista identificable" cambia considerablemente. Un retrato al óleo de una persona con rasgos físicos específicos se trata de manera diferente a un retrato fotorrealista con esos mismos rasgos, incluso cuando la persona descrita sería teóricamente reconocible. Usar descriptores de estilo no es un truco para eludir las restricciones; es trabajar dentro del alcance previsto de la política, que se centra específicamente en las imágenes fotorrealistas.

Las figuras históricas en representaciones estilizadas y no fotorrealistas ocupan un terreno intermedio matizado. Un retrato claramente pintado o ilustrado de Abraham Lincoln, Napoleón u otras figuras históricas a menudo se genera con éxito cuando el estilo es explícitamente no fotorrealista. La restricción apunta a la combinación específica de "persona real" + "fotorrealista" — divide ese par y el límite de la política cambia. Dicho esto, esta categoría requiere cuidado: intentar generar una representación fotorrealista de cualquier figura histórica, o solicitar reimaginaciones modernas que puedan usarse como desinformación, desencadenará rechazos.

Las escenas de multitudes y siluetas son totalmente compatibles. Las figuras anónimas en multitudes, las composiciones de sombra y silueta, las figuras distantes en escenas y los grupos de personas vistos desde ángulos que ocultan los rasgos faciales individuales se generan sin restricciones. Para casos de uso que requieren presencia humana sin identidad individual — maquetas de productos, ilustraciones de entornos, visualizaciones arquitectónicas — los enfoques de multitudes y siluetas son confiables y a menudo visualmente atractivos.

Los conceptos y diseños de personajes para juegos, libros y branding son un caso de uso sólido para las capacidades actuales de Gemini. La creación de personajes originales, donde el prompt define la personalidad, el rol y la estética del personaje sin referencia a personas reales, genera resultados de alta calidad de manera consistente. El espacio de diseño de personajes está particularmente bien atendido por los descriptores de estilo: "un diseño de personaje guerrero de fantasía en un estilo de ilustración semirealista" funciona eficazmente y produce resultados adecuados para proyectos creativos profesionales.

Los retratos con rasgos descriptivos pueden funcionar, con advertencias importantes. Un prompt que describe rasgos físicos y de personalidad — "una mujer de mediana edad con cabello plateado y un porte autoritario, estilo de retrato corporativo" — se genera con éxito siempre que la descripción no converja en un individuo reconocible específico. La prueba práctica es si la descripción identifica de forma única a una persona real; si múltiples personas diferentes podrían plausiblemente coincidir con la descripción, es probable que el prompt tenga éxito. Si la descripción es lo suficientemente específica como para que alguien al leerla identifique inmediatamente a una persona real, probablemente será rechazada.

Estrategias de Ingeniería de Prompts para Generación de Personajes Humanos

La creación eficaz de prompts para imágenes humanas en Gemini requiere comprender no solo qué generará y no generará el modelo, sino cómo interpreta las solicitudes. El mismo tema puede tener éxito o fracasar según el encuadre, y desarrollar intuición para esa distinción es la habilidad práctica que diferencia a los usuarios que encuentran rechazos constantes de los que generan con éxito.

La estrategia más efectiva es comenzar con el estilo. Cuando tu primera descripción establece el tratamiento visual — "En un estilo de ilustración detallado" o "Retrato en acuarela de" o "Arte de personaje anime que representa" — estás contextualizando inmediatamente todo lo que sigue como trabajo creativo ficticio en lugar de una solicitud de imagen fotorrealista. Las restricciones de Gemini están específicamente calibradas para los resultados fotorrealistas; establecer un estilo no fotorrealista desde el principio cambia dramáticamente cómo se interpretan los descriptores siguientes. Esto no se trata de engañar al modelo — se trata de comunicar con precisión la intención.

La descripción basada en rasgos en lugar de la descripción basada en referencias es el segundo principio fundamental. La diferencia entre "un personaje que se parece a [celebridad]" y "un personaje con cabello rizado oscuro, pómulos prominentes y una expresión segura" no es sutil desde el punto de vista de la política — el primero invoca directamente a una persona real, el segundo describe rasgos físicos que existen en millones de personas. Al construir descripciones de personajes, piensa en términos de arquetipos, combinaciones de rasgos y temas estéticos en lugar de referencias a individuos específicos. Los rasgos como el color del cabello, el tipo de cuerpo, el rango de edad, el estilo de ropa y la expresión emocional son legítimos; los nombres y las comparaciones con personas reales no lo son.

El establecimiento de contexto importa más de lo que muchos usuarios se dan cuenta. Un prompt que establece un mundo ficticio, un contexto narrativo o un proyecto creativo antes de describir un personaje se procesa de manera diferente a una descripción de personaje en bruto. "Para una novela de fantasía ambientada en una Europa medieval alternativa, un personaje de consejero de la corte que combina inteligencia académica con sagacidad política" se procesa en el espacio creativo ficticio; "un erudito con astucia política" sin contexto se procesa de manera más literal. Añadir una oración de contexto — el género, el medio, el propósito — no garantiza el éxito, pero inclina la interpretación del modelo en una dirección que reduce los falsos positivos en los filtros de restricción.

Evita el vocabulario que se mapea directamente a categorías restringidas. Ciertas palabras y frases desencadenan rechazos de manera confiable independientemente del contexto: "foto realista de", "retrato fotorrealista", "se parece exactamente a", "en el estilo de [nombre de persona real]" y frases similares. Estas no son palabras clave en un filtro simple — son señales de alto peso en la interpretación del modelo de que estás solicitando un resultado fotorrealista de un individuo real. Reemplazar "foto realista" con "ilustración detallada" o "retrato artístico" a menudo cambia el resultado mientras describe con precisión lo que realmente quieres para la mayoría de propósitos creativos.

Al iterar en un prompt que ha sido rechazado, resiste la tentación de simplemente eliminar palabras. En su lugar, reformula: añade descriptores de estilo, establece un contexto ficticio, cambia de una descripción basada en referencias a una basada en rasgos y aclara el propósito. Un rechazo es retroalimentación sobre cómo el modelo interpretó tu prompt, no una evaluación de si tu objetivo creativo subyacente es legítimo. La mayoría de los objetivos creativos legítimos pueden lograrse dentro del marco de política actual de Gemini con el enfoque de prompting adecuado.

Combinar múltiples estrategias en un solo prompt a menudo produce los resultados más confiables. Un prompt que comienza con el estilo ("En un estilo de novela gráfica detallada"), establece el contexto ("para un thriller cyberpunk ambientado en 2090"), usa una descripción basada en rasgos ("un personaje detective con rasgos afilados y ojos envejecidos, usando un abrigo largo") y especifica un propósito creativo claro ("para el arte del encabezado del capítulo de la novela") aborda el umbral de ambigüedad desde múltiples ángulos simultáneamente. Cualquier elemento individual podría ser suficiente, pero combinarlos crea una señal clara de que la solicitud es para trabajo creativo ficticio en lugar de una representación fotorrealista de un individuo real.

El ciclo de retroalimentación entre los rechazos de Gemini y tus revisiones de prompts es en sí mismo una herramienta creativa útil. Los rechazos tienden a ser específicos sobre el elemento que los desencadenó — comprender qué aspecto de tu prompt coincidió con una categoría restringida a menudo revela información sobre cómo el modelo procesa las solicitudes que informa tu enfoque de prompting más amplio. Los usuarios que desarrollan esta habilidad interpretativa descubren que las restricciones pasan de ser obstáculos a ser salvaguardas útiles que les ayudan a entender exactamente qué tipo de imágenes están creando.

Acceso API vs. Gemini de Consumidor: Políticas Diferentes para Desarrolladores

Para los desarrolladores que crean aplicaciones con las capacidades de generación de imágenes de Gemini, el panorama de políticas difiere significativamente de lo que experimentan los usuarios de la app Gemini de consumidor. Comprender estas diferencias es esencial para la planificación precisa del producto y la gestión de expectativas con los interesados.

Las restricciones centrales de imágenes de personas se aplican en todos los niveles de acceso — no existe ninguna configuración de desarrollador o empresarial que desbloquee imágenes fotorrealistas de personas reales identificables o permita la generación de imágenes de celebridades. Estas restricciones están integradas en el modelo Nano Banana 2 a nivel de arquitectura, no se aplican como filtros de post-procesamiento que el acceso a la API podría eludir. Cualquier plan de desarrollo basado en obtener generación "sin restricciones" de imágenes de personas a través del acceso a la API debe revisarse.

Lo que sí difiere es la precisión de aplicación. La aplicación Gemini de consumidor incluye salvaguardas adicionales diseñadas para una base de usuarios amplia y no técnica, lo que significa que el umbral de rechazo se calibra de manera algo conservadora. El acceso a la API al mismo modelo Nano Banana 2 (gemini-3.1-flash-image-preview) opera con una tolerancia ligeramente mayor para los casos límite y los prompts ambiguos en contextos artísticos o claramente ficticios. Los desarrolladores que crean herramientas para casos de uso creativos profesionales — diseño de personajes, arte conceptual, asistencia de ilustración — a menudo descubren que los prompts que desencadenan rechazos en la aplicación de consumidor tienen éxito a través de llamadas directas a la API con contenido idéntico.

La implicación práctica es que las cuotas de generación de imágenes gratuitas de Gemini importan menos para los casos de uso de imágenes de personas que el contexto de política de tu aplicación. Construir una herramienta que esté explícitamente posicionada como asistente de diseño de personajes creativos, donde el contexto ficticio es parte del prompt del sistema de la aplicación, te proporciona una base más confiable que intentar manejar el encuadre ficticio prompt a prompt.

Para los desarrolladores que evalúan los costos de la API, el acceso asequible a la API de imágenes de Gemini a través de servicios de agregación como laozhang.ai puede reducir significativamente el costo de construir funciones de generación de imágenes. El modelo Nano Banana Pro (gemini-3-pro-image-preview) está disponible a aproximadamente $0.05 por generación — aproximadamente el 20% del precio directo de la API — lo que hace práctico construir flujos de trabajo de generación iterativa sin que los costos por imagen se vuelvan prohibitivos durante el desarrollo. La documentación y el acceso al playground de la API están disponibles en docs.laozhang.ai.

Los límites de velocidad y la gestión de cuotas también difieren entre la aplicación de consumidor y el acceso a la API. El nivel gratuito de la API de Gemini proporciona solicitudes limitadas de generación de imágenes por día, mientras que los niveles de API de pago ofrecen límites sustancialmente más altos adecuados para aplicaciones de producción. Para aplicaciones con alto volumen de generación de imágenes, la distinción entre los modelos Nano Banana 2 y Nano Banana Pro importa no solo para la calidad del resultado sino también para la optimización de costos — el modelo flash proporciona calidad adecuada para muchos casos de uso a un costo menor por generación.

Gemini vs. Midjourney vs. DALL-E para Generación de Personas

Los usuarios que comparan las restricciones de imágenes de personas de Gemini con plataformas de la competencia a menudo tienen la impresión de que las alternativas son más permisivas. La realidad es más matizada — cada plataforma tiene diferentes filosofías de restricción, y la diferencia práctica depende en gran medida del caso de uso específico.

Midjourney permite imágenes de personas más flexibles que Gemini, incluidos sujetos humanos más realistas, pero aplica sus propias restricciones a personas reales nombradas y contenido explícito. Para la generación de personajes ficticios en estilos realistas, Midjourney es generalmente más capaz que Gemini bajo las políticas actuales. Sin embargo, Midjourney opera principalmente a través de Discord y ofrece capacidades de API más limitadas, lo que lo hace menos adecuado para la integración programática. Para estilos ilustrativos y artísticos — que constituyen una gran parte de los casos de uso creativos legítimos — Gemini Flash Image versus DALL-E y Flux muestra calidad competitiva a menor costo.

DALL-E 3 (al que se accede a través de la API de OpenAI o ChatGPT) también permite imágenes de personas más realistas y flexibles que Gemini, con el enfoque de OpenAI centrado más en categorías específicas de daño que en restricciones amplias de personas fotorrealistas. Las restricciones de DALL-E sobre personas reales y celebridades son comparables a las de Gemini, pero su umbral para personas fotorrealistas ficticias es más alto. La compensación es el costo: el acceso a la API de DALL-E 3 es significativamente más caro por imagen que las opciones de Gemini.

La comparación honesta es que si tu caso de uso requiere específicamente personajes humanos fotorrealistas ficticios y retratos fotorrealistas de no celebridades, Gemini es actualmente la plataforma más restrictiva de las principales. Para imágenes humanas artísticas, ilustradas y estilizadas — que cubre la gran mayoría de las aplicaciones creativas legítimas — Gemini es competitivo con las alternativas tanto en calidad como en permisividad. La pregunta no es qué plataforma no tiene restricciones (todas las tienen) sino qué perfil de restricción de plataforma se alinea mejor con tu caso de uso legítimo específico.

Preguntas Frecuentes — Dudas Comunes sobre las Restricciones de Personas en Gemini

¿Puede Gemini generar fotos de mi propia cara? No. Subir una foto tuya y pedirle a Gemini que genere variaciones, añada fondos diferentes o modifique tu apariencia en la imagen está cubierto por la restricción de "persona real identificable". Incluso con el pleno consentimiento del sujeto, la política actual no tiene una exención para autorretratos. Esta es una limitación conocida que frustra los casos de uso de fotos de perfil.

¿Puedo generar imágenes de políticos o líderes históricos? Las figuras históricas (personas fallecidas) en estilos claramente no fotorrealistas y artísticos a menudo tienen éxito. Las figuras políticas actuales son rechazadas bajo la restricción de figuras públicas. La línea divisoria entre "figura histórica" y "lo suficientemente reciente como para ser tratada como figura pública actual" no está precisamente documentada, pero como regla práctica: las personas que han fallecido hace varias décadas en estilos claramente artísticos a menudo funcionan; las figuras políticas vivas o recientemente fallecidas no.

¿Se aplica la restricción a personajes generados por IA que se parecen a personas reales? La restricción apunta a las imágenes fotorrealistas que se interpretarían como que representan a un individuo real, no a la semejanza coincidental. Un personaje ficticio que comparte rasgos físicos con una persona real, descrito en términos de rasgos sin referencia alguna a esa persona, generalmente se trata como ficticio. Un personaje descrito específicamente para parecerse a un individuo nombrado — "crea un personaje que se parezca a [celebridad]" — es rechazado.

¿El acceso a la API desbloquea una generación de personas más permisiva? No. Las restricciones centrales son a nivel de modelo, no a nivel de API, y se aplican en todos los niveles de acceso. El acceso a la API ofrece una precisión ligeramente mayor para los contextos creativos ficticios, pero no permite generar personas reales fotorrealistas, celebridades ni categorías de contenido restringido.

¿Es Nano Banana 2 la versión final de estas restricciones? Las políticas de imagen de Google han evolucionado continuamente desde 2024, y no hay razón para esperar que se hayan estabilizado permanentemente. Nano Banana 2 representa el estado actual a marzo de 2026. Las futuras actualizaciones del modelo pueden refinar las restricciones en cualquier dirección — relajando los casos límite para usos creativos legítimos o endureciéndolos en respuesta a nuevos patrones de uso indebido. Seguir los anuncios de política de IA de Google es la forma más confiable de mantenerse al día.

¿Puedo usar Gemini para generar imágenes de avatar o perfil? La generación de avatares en estilos claramente no fotorrealistas — ilustración, caricatura, anime o similares — generalmente tiene éxito. La generación de avatares fotorrealistas está bloqueada bajo la política actual. Para casos de uso de imágenes de perfil, crear prompts explícitamente para estilos ilustrados o artísticos normalmente produce resultados utilizables.

¿En qué se diferencia la restricción de Gemini de otras herramientas de imágenes de IA? Las restricciones de Gemini son más amplias y se aplican de manera más consistente para las imágenes fotorrealistas de personas que la mayoría de las plataformas de la competencia. Las restricciones provienen de una historia institucional específica (la controversia de 2024) y reflejan la exposición legal particular de Google como una gran empresa regulada. Las plataformas competidoras tienen sus propias restricciones sobre el contenido dañino pero generalmente permiten imágenes humanas realistas más flexibles para sujetos ficticios.

¿Qué debo hacer si mi prompt legítimo es rechazado? Añade descriptores de estilo explícitos (ilustración, retrato artístico, diseño de personaje), establece un contexto ficticio antes de describir al personaje, cambia de una descripción basada en referencias a una basada en rasgos y evita el vocabulario que se mapea a solicitudes de retratos fotorrealistas. La mayoría de los objetivos creativos legítimos pueden lograrse dentro de la política actual con el encuadre de prompt adecuado.

Conclusión: Trabajar con la Política, no en su Contra

Las restricciones de imágenes de personas de Gemini son el producto de una historia documentada específica, obligaciones legales concretas y decisiones arquitectónicas deliberadas tomadas por los equipos de seguridad de IA de Google. No son errores, marcadores de posición ni inconvenientes temporales esperando ser eliminados — reflejan compromisos institucionales genuinos que, si acaso, probablemente aumenten en precisión en lugar de disminuir en alcance.

La implicación práctica para los usuarios es que el enfoque más productivo es comprender los límites reales de la política en lugar de tratar todas las imágenes humanas como prohibidas. Los personajes ficticios, los estilos artísticos, el diseño de personajes, las escenas de multitudes y una amplia gama de aplicaciones creativas están totalmente disponibles dentro de las capacidades actuales de Gemini. Las restricciones apuntan a una combinación específica de fotorrealismo e identidad de personas reales que representa una pequeña fracción de los casos de uso creativos legítimos. Trabajando dentro de este marco, con estrategias de prompting adecuadas, la mayoría de las necesidades de imágenes humanas pueden satisfacerse.

Para los desarrolladores que crean aplicaciones, la conclusión clave es que el acceso a la API no elude las restricciones a nivel de modelo, pero sí ofrece un entorno más ajustado en precisión para aplicaciones creativas donde el contexto ficticio está claramente establecido. Incorporar ese contexto a la arquitectura de tu aplicación — en lugar de depender del encuadre prompt a prompt — produce resultados más consistentes y una mejor experiencia de usuario.

El incidente de 2024 y sus secuelas rediseñaron la forma en que Google piensa sobre la representación humana en las imágenes generadas por IA de maneras que probablemente sean permanentes. Pero la política que surgió de ese proceso es más reflexiva y más específicamente dirigida que la pausa brusca que la precedió. Comprender tanto la historia como el estado actual de las restricciones es lo que hace posible construir eficazmente con la generación de imágenes de Gemini en 2026.