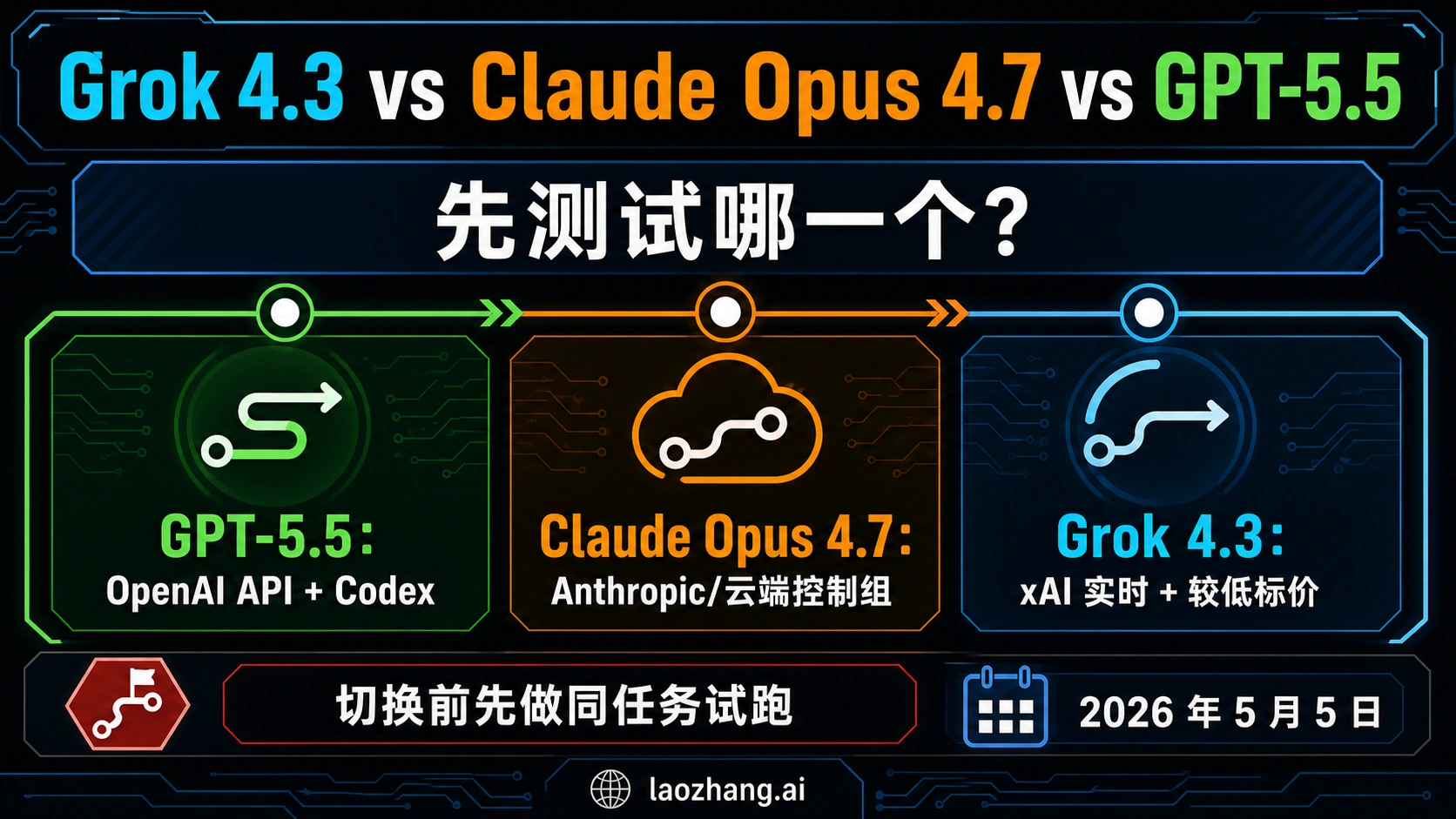

截至 2026 年 5 月 5 日,更稳妥的答案不是给三个模型排一个总冠军,而是先按路线选首测对象:OpenAI 原生 API、Responses API、Codex、结构化输出和工具链工作优先测 GPT-5.5;需要 Anthropic API、Claude 产品、Bedrock、Vertex AI 或 Microsoft Foundry 的高风险 agent,把 Claude Opus 4.7 留作高级控制组;比较的理由如果是 xAI 账号、实时/X 搜索、较低标价或长上下文试点,再先测 Grok 4.3。

不要因为一个跑分、一个短视频或一个首发周印象就换生产默认模型。真正的比较必须把同一提示词、同一文件、同一工具、同一预算、同一评分表和回滚阈值放在一起跑。

| 首先测试的路线 | 适合什么时候用 | 不要直接假设 |

|---|---|---|

| GPT-5.5 | 你已经在 OpenAI API、Responses API、Codex、工具调用、结构化输出或 OpenAI eval 体系里工作。 | Codex 可见性、API key、API 价格、Codex credits 和速率限制是同一份合约。 |

| Claude Opus 4.7 | 你需要 Anthropic 或云平台路线,或者需要高风险 coding agent 的高级控制组。 | 高质量控制组在输出、tokenizer、重试和人工 review 之后一定更便宜。 |

| Grok 4.3 | 你需要 xAI 路线、实时/X 搜索、较低标价或长上下文试点。 | 较低 token 标价可以替代同任务成功成本测试。 |

先确认你真正能调用的合约

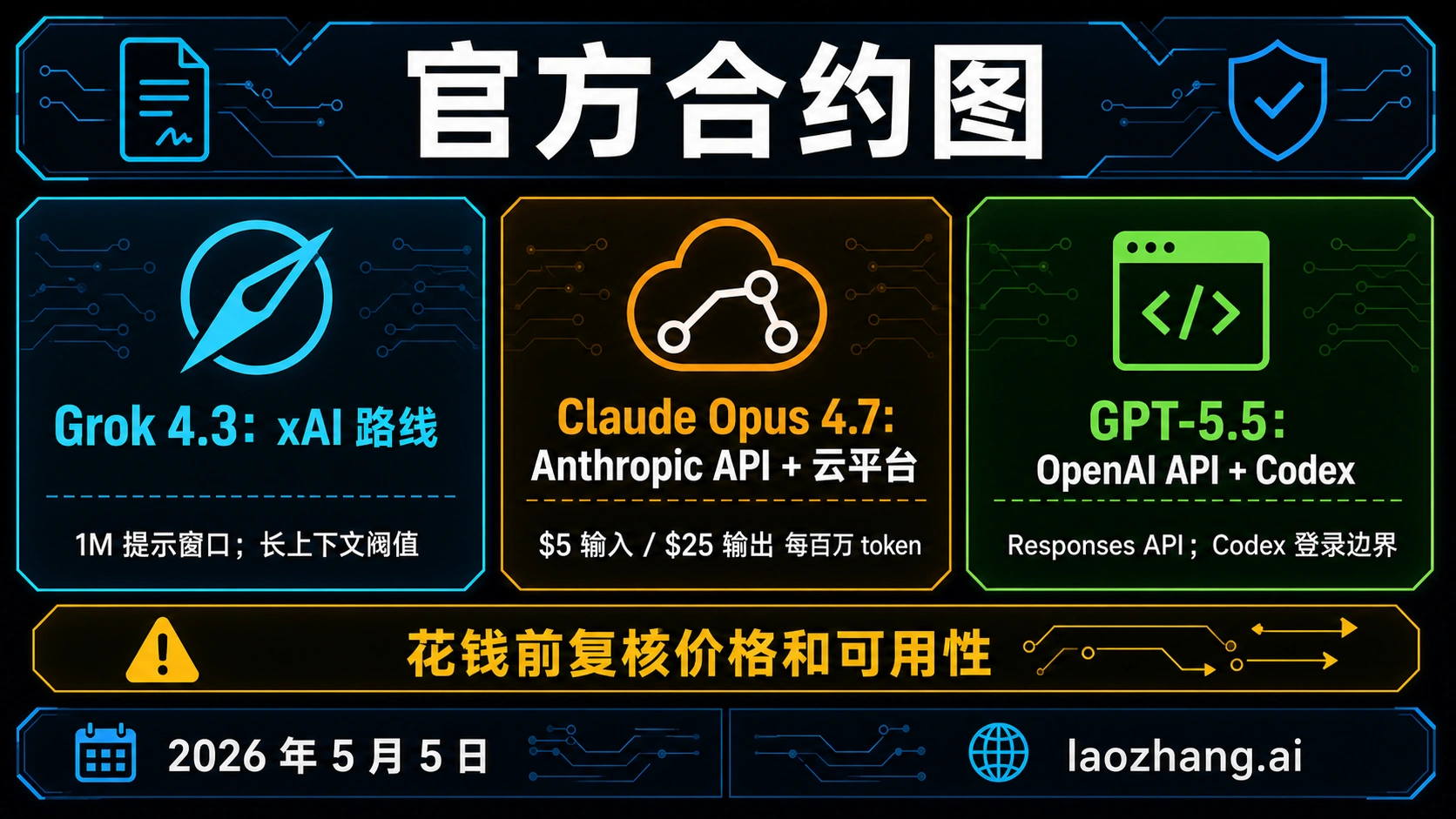

这个对比最容易出错的地方,是把产品名、聊天入口、API 模型、云平台转售、插件工具和费用表混成一个东西。OpenAI 负责 GPT-5.5 的 API、Responses API 和 Codex 事实;Anthropic 负责 Claude Opus 4.7 的 Claude 产品、Anthropic API 与云平台可用性;xAI 负责 Grok 4.3 的模型、控制台、别名、工具价格、长上下文阈值和账号可见性。第三方页面可以告诉你应该测试什么,但不能替你决定模型 ID、端点行为、价格、上下文限制和生产权限。

| 合约项 | GPT-5.5 | Claude Opus 4.7 | Grok 4.3 |

|---|---|---|---|

| 路线所有者 | OpenAI developer platform、Responses API、Codex 产品表面 | Anthropic API、Claude 产品、Bedrock、Vertex AI、Microsoft Foundry | xAI API、xAI Console、Grok 模型文档、xAI server-side search tools |

| 需要核验的模型标签 | GPT-5.5 以及 OpenAI 文档中的 dated snapshots | claude-opus-4-7 与云平台模型 ID | grok-4.3、grok-4.3-latest 或当前控制台 alias |

| 首测理由 | OpenAI 原生工具循环、Responses API、结构化输出、hosted tools、Codex 和既有 eval | 高风险 coding agent、云部署、正确性敏感任务的高级控制组 | xAI 路线、实时/X 搜索、较低标价、长上下文试点 |

| 成本边界 | OpenAI API 价格与 Codex credits 分属不同表面,付费前必须看清路线。 | Anthropic 公开列出 Opus 4.7 为每百万 token 5 美元输入、25 美元输出,并提示 tokenizer 行为会影响计数。 | xAI 控制台、模型可见性、长上下文阈值和搜索工具成本都要在试点时重新记录。 |

| 不要合并 | API 访问、ChatGPT/Codex 登录、API-key 认证、credits、rate limits | Claude app、Anthropic API、云平台、priority tier、tokenizer 成本 | Grok chat、xAI API、搜索工具、alias、区域/账号可用性、长上下文价格阈值 |

OpenAI 的 GPT-5.5 指南把 GPT-5.5 放在 Responses API 语境里讨论,强调 reasoning effort、verbosity、Structured Outputs、prompt caching、hosted tools、state handling 和 Agents SDK。OpenAI 的 Codex 文档也把 GPT-5.5 当作复杂编码、computer use、知识工作和研究工作流的前沿 Codex 选择。这里的关键不是“OpenAI 一定赢”,而是:如果你的系统已经依赖 OpenAI 的工具链,GPT-5.5 可以在最接近生产的表面里被测出来。

Anthropic 的 Opus 4.7 公开材料说明它可用于 Claude 产品、Anthropic API、Amazon Bedrock、Google Vertex AI 和 Microsoft Foundry,并且给出 claude-opus-4-7、1M context、每百万 token 5 美元输入和 25 美元输出等边界。对团队来说,这让 Opus 4.7 很适合做高级控制组:当失败成本高过 token 成本,控制组的价值在于减少严重缺陷和 review 时间。

xAI 的 Grok 4.3 文档则要和 server-side search tools 一起读。xAI 的实时事件说明依赖 Web Search 或 X Search,不是基础模型记忆自动拥有最新事实。如果你选择 Grok 4.3 是为了实时/X 数据,就要把搜索工具调用、搜索失败、引用质量和工具成本一起计入试点,而不是只看模型 token 行。

不同工作负载指向不同首测路线

真正有用的问题不是“哪个模型最强”,而是“这个工作负载最值得先测哪条可部署路线”。这个角度能把榜单争论变成可执行的实验。

| 工作负载 | 先测路线 | 为什么适合 | 评分项 |

|---|---|---|---|

| OpenAI 原生编码、Codex、Responses API 工具和结构化输出 | GPT-5.5 | 它离 OpenAI 工具表面、Codex 工作流和既有 eval 最近。 | 接受的 diff、工具恢复、结构化输出稳定性、review 时间、token 与 credits。 |

| 正确性敏感 coding agent、多工具流、云部署 | Claude Opus 4.7 | 它是 Anthropic 和云路线里的高级控制组。 | 缺陷严重度、回滚行为、工具调用可靠性、reviewer 信任、负载下延迟。 |

| 实时或 X-informed 回答 | Grok 4.3 | xAI 拥有 Grok 与把实时数据带入请求的搜索工具路线。 | 新鲜度、工具调用次数、搜索成本、引用质量、错误新鲜度声明。 |

| 长上下文仓库、文档或证据分析 | 路线化测试 | 三者都有大上下文故事,但限制、输出行为和价格阈值不同。 | 截断、召回质量、输出长度、长上下文阈值、完成任务总成本。 |

| 预算敏感探索 | 先测 Grok 4.3,再和 GPT-5.5 或 Opus 对照 | Grok 的标价可能适合试点,但只有质量和重试稳定才成立。 | 成功率、重试次数、p95 延迟、修复时间、每个接受结果成本。 |

| 切换生产默认值 | 候选模型和现有模型双跑 | 公共对比无法覆盖你的提示词、文件、工具、权限和失败成本。 | 回归数、人力分钟、成本、回滚成功、用户可见失败率。 |

GPT-5.5 的优势在于 OpenAI 原生落地。如果你已经有 Responses API state、hosted tools、structured outputs、prompt caching、file search、computer use 或 Codex 流程,先测 GPT-5.5 可以减少环境变量。你看到的失败、重试、格式偏差和成本,更接近未来生产会遇到的失败。

Claude Opus 4.7 的价值在于高级控制。高风险 agent、复杂代码迁移、权限敏感工具链、受监管 review、云平台部署,以及任何“错一次很贵”的场景,都应该让 Opus 保持对照地位。它不需要在每个 token 行都最便宜;如果它减少严重缺陷、返工和 review 时间,总成本可能反而更低。

Grok 4.3 适合被窄口径地使用:xAI 账号、实时/X 新鲜度、较低标价、长上下文试点或需要 xAI 工具生态时先测。不要把这个结论扩大成“Grok 可以替换所有默认模型”。如果任务不需要实时工具、不依赖 xAI 账号,也没有成本或长上下文压力,它仍然可以进入比较,但不应该自动拥有生产默认权。

成本必须放在同一计费表面比较

token 标价只能做第一层过滤。GPT-5.5 可能通过 OpenAI API、OpenAI 账号配置或 Codex credits 计费;Claude Opus 4.7 可能通过 Anthropic 直接计费,也可能通过云平台计费;Grok 4.3 可能同时包含模型 token、server-side search tools、长上下文阈值、alias 和账号可见性。把这些表面混在一起,会让便宜和贵都失真。

对 GPT-5.5 来说,API 服务应该看当前 OpenAI API 或控制台价格;评估 Codex 时才看 Codex credits。Codex 页面的 GPT-5.5 credit rate 不能代替后端服务的 API token 价格。尤其是把 Codex 作为工程工具时,credits、组织可见性、登录账号、rate limits 和 API key 合约都要分开记录。

对 Claude Opus 4.7 来说,公开价格行和 tokenizer 注释要一起看。长提示词、工具日志、仓库上下文和重复上下文包都会放大 tokenizer 差异。对代码 agent 来说,输出长度、工具调用、失败后的补丁修复和人工 review 分钟数,往往比输入 token 行更影响总成本。

对 Grok 4.3 来说,较低标价只是“值得测”的理由,不是“可以替换”的结论。xAI 控制台可见性、模型 alias、账号区域、搜索工具收费、长上下文阈值和搜索失败都可能改变完成任务成本。使用 X Search 或 Web Search 的 Grok 试点,必须同时记录模型 token 和工具调用。

| 成本变量 | 为什么会改变排名 |

|---|---|

| 输入与缓存输入 | 长提示词、重复仓库上下文和 prompt caching 会改变实际账单。 |

| 输出长度 | 输出型 agent 会让便宜输入价失去意义。 |

| 工具调用 | 搜索、文件、浏览器、computer use 或自定义工具可能成为主成本。 |

| 重试率 | 便宜模型如果要多次返工,成功结果成本会抬高。 |

| 人工 review 分钟 | coding agent 最贵的一行经常是人接受、修复或回滚的时间。 |

| 回滚成本 | 低频但严重的失败,比平均 token 成本更危险。 |

因此建议用“成功任务成本”来比较:一个被接受的答案、一个合并的代码改动、一个正确的 agent 动作或一个完成的分析包。Grok 如果在这个账本上赢,才值得加流量;Opus 如果减少严重失败,就能解释溢价;GPT-5.5 如果降低 OpenAI 原生集成摩擦,也可能是更便宜的路线。

把榜单当测试线索,不当生产结论

榜单、视频和 hands-on 记录有价值,但它们只能告诉你“该测什么”,不能替你切生产。coding agent、浏览器任务、长上下文召回、数学、视觉推理、安全、成本评分表和速度测试,测的不是同一个工作。GPT-5.5 在 OpenAI 原生 agent benchmark 上表现强,是把 GPT-5.5 放进你 OpenAI harness 的理由,不是跳过 Opus 控制组或 Grok 成本试点的理由。

同理,Claude Opus 4.7 的发布声明是保留高级控制组的理由,不是省掉同任务测量的理由。Grok 4.3 的价格、速度或实时数据叙事是建立成本试点的理由,不是让它未经验证替换高风险 coding 默认值的理由。

建议使用四级证据梯。第一,官方文档决定路线是否存在、模型叫什么、访问表面是什么、价格和限制必须在哪里核验。第二,公共榜单建议哪些工作负载值得纳入测试。第三,你自己的同任务 harness 决定是否给候选模型生产流量。第四,分阶段 rollout 证明这个改进能否承受真实用户、权限、延迟、配额和失败。

这套梯子可以避免模型对比里最常见的错误:用只覆盖一个任务形状的证据宣布通用赢家。更可靠的结论要窄一些:GPT-5.5 是 OpenAI 原生首测路线;Claude Opus 4.7 是 Anthropic 和云平台高级控制组;Grok 4.3 是 xAI 实时、低标价和长上下文试点路线。

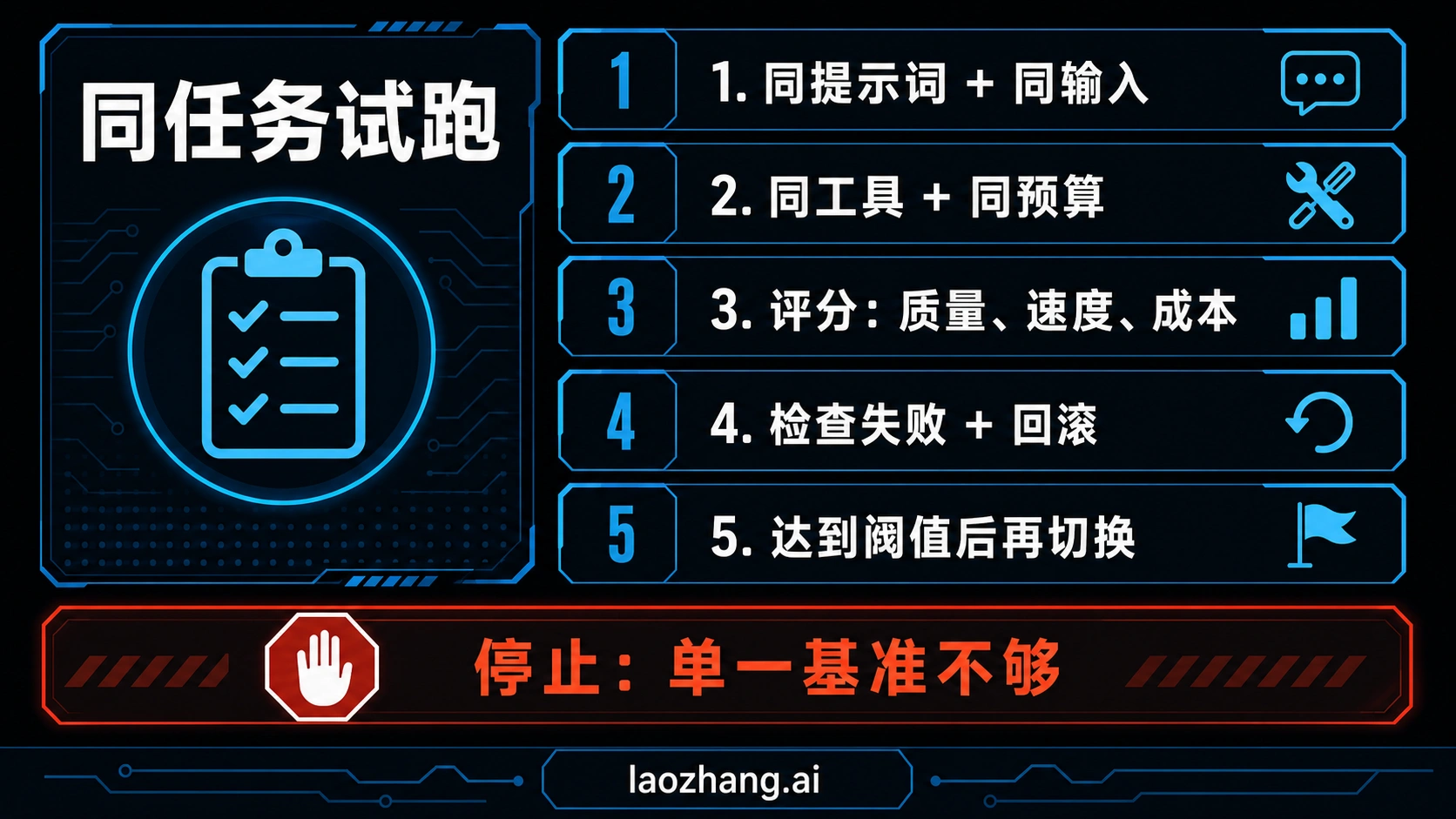

切换默认模型前先做同任务试点

试点可以小,但必须公平。不要给一个模型更好的提示词、更宽的上下文、更松的输出格式或更多工具预算,然后把结果叫作模型比较。

| 试点关卡 | 保持一致的内容 | 通过条件 |

|---|---|---|

| 路线访问 | 模型标签、端点、账号、地区、配额、计费表面、fallback | 团队能调用未来要部署的同一条路线。 |

| 提示词和文件 | 同一 system prompt、用户任务、仓库或文档包 | 差异来自模型行为,不来自输入不公平。 |

| 工具预算 | 同一工具定义、权限、timeout、重试规则、搜索可用性 | 工具型成功可以比较。 |

| 任务样本 | 简单任务、困难任务、长上下文任务、严格格式任务、易失败任务 | 样本覆盖真正花钱或耗 review 的工作。 |

| 评分 | 正确性、严重度、安全风险、输出格式、review 分钟、接受率 | 候选模型减少总工作,而不是只做出演示效果。 |

| 成本和延迟 | 输入、缓存输入、输出、工具、重试、p95 延迟、完成任务成本 | 节省在全任务账本里仍然存在。 |

| 回滚 | 失败阈值、fallback 模型、路由开关、监控负责人 | 出问题时能回到旧路线。 |

已有稳定默认值的团队,不应该一次性切走。先让候选模型 shadow-run,保持现有模型服务真实流量;候选模型只有在减少总工作量、没有引入新的高严重度失败,并且能被监控和回滚时,才值得扩大流量。

第一次选模型的团队则从路线匹配开始。OpenAI 原生产品先测 GPT-5.5,并用 Opus 做高级控制;Anthropic 或云路线重的团队先测 Opus,再在 OpenAI 工具链重要时加入 GPT-5.5;真正问题是实时/X 新鲜度、xAI 账号或标价压力的团队,先测 Grok 4.3,然后用同一套接受规则约束它。

相邻决策

这个三模型决策只解决路线问题:Grok 4.3、Claude Opus 4.7、GPT-5.5 之间,哪条路线应该先进入你的同任务测试。如果你的问题更窄,应该进入更窄的比较。

如果你只是在 OpenAI 和 Anthropic 之间选,用 GPT-5.5 vs Claude Opus 4.7。那篇可以把 OpenAI 工具编排和 Anthropic 部署控制讲得更细。

如果你需要的是 DeepSeek 成本路线,而不是 xAI 实时/X 新鲜度,用 DeepSeek V4 Pro vs Claude Opus 4.7 vs GPT-5.5。如果还想加入更大的低成本池,用 Kimi K2.6 vs DeepSeek V4 vs GPT-5.5 vs Claude Opus 4.7。

如果你仍在比较上一轮官方前沿 API 路线,用 Claude Opus 4.7 vs GPT-5.4 vs Gemini 3.1 Pro。核心原则相同:选你能调用的路线,测你会运行的任务,并保留回滚路径。

常见问题

GPT-5.5 比 Claude Opus 4.7 和 Grok 4.3 更好吗?

当系统已经是 OpenAI 原生,尤其依赖 Responses API、Codex、工具推理、结构化输出或 OpenAI eval 时,GPT-5.5 是更好的首测对象。它不是通用赢家。Claude Opus 4.7 仍是 Anthropic 和云平台高级控制组;Grok 4.3 在实时/X 搜索、较低标价或长上下文试点是比较理由时值得先测。

Grok 4.3 会比 GPT-5.5 和 Claude Opus 4.7 便宜吗?

Grok 4.3 可能在当前 xAI 标价上显得更便宜,但不要只看这一行。你还要重新检查 xAI 控制台、长上下文阈值、账号可用性、server-side search tools、重试、延迟和接受率。正确比较对象是完成任务成本。

coding agent 应该用 Claude Opus 4.7 吗?

如果 coding agent 的失败成本很高,Anthropic 或云路线适合部署,并且正确性比原始 token 价格重要,就让 Claude Opus 4.7 做高级控制组。如果 agent 是 OpenAI 原生,先测 GPT-5.5;如果实时/X 数据、xAI 账号或较低标价很关键,再加入 Grok 4.3。

GPT-5.5 可以通过 API 使用吗?

OpenAI developer docs 当前已经发布 GPT-5.5 API 相关指南,并在开发者表面列出 GPT-5.5 snapshots。但 API 访问、Codex 可见性、API key、credits、rate limits 和组织权限仍是不同合约。上线前要在你的账号和部署路线里确认。

Grok 4.3 默认就有实时数据吗?

不是。xAI 文档说明实时事件需要 Web Search 或 X Search 这样的 server-side search tools。如果实时/X 新鲜度是你选择 Grok 4.3 的理由,试点必须记录搜索工具调用、费用、引用质量和失败行为。

长上下文工作应该先测哪个?

先测你能实际部署的路线。GPT-5.5、Claude Opus 4.7 和 Grok 4.3 都有大上下文故事,但限制、计费、长上下文阈值、输出行为和召回质量不同。用同一长提示词、同一检索包、同一输出预算和同一评分表再决定。

最安全的生产切换规则是什么?

不要因为一个榜单、视频、发布声明或价格差距就切换默认值。候选模型必须和现有模型双跑,使用同样的提示词、工具、文件、预算、接受测试和回滚阈值。只有当新路线减少总工作量,并且通过分阶段 rollout,才扩大生产流量。

实用结论是路线计划:GPT-5.5 用于 OpenAI 原生首测,Claude Opus 4.7 用于 Anthropic/云高级控制,Grok 4.3 用于 xAI 实时、低标价或长上下文试点。生产默认权要让模型在你的任务里赢来。