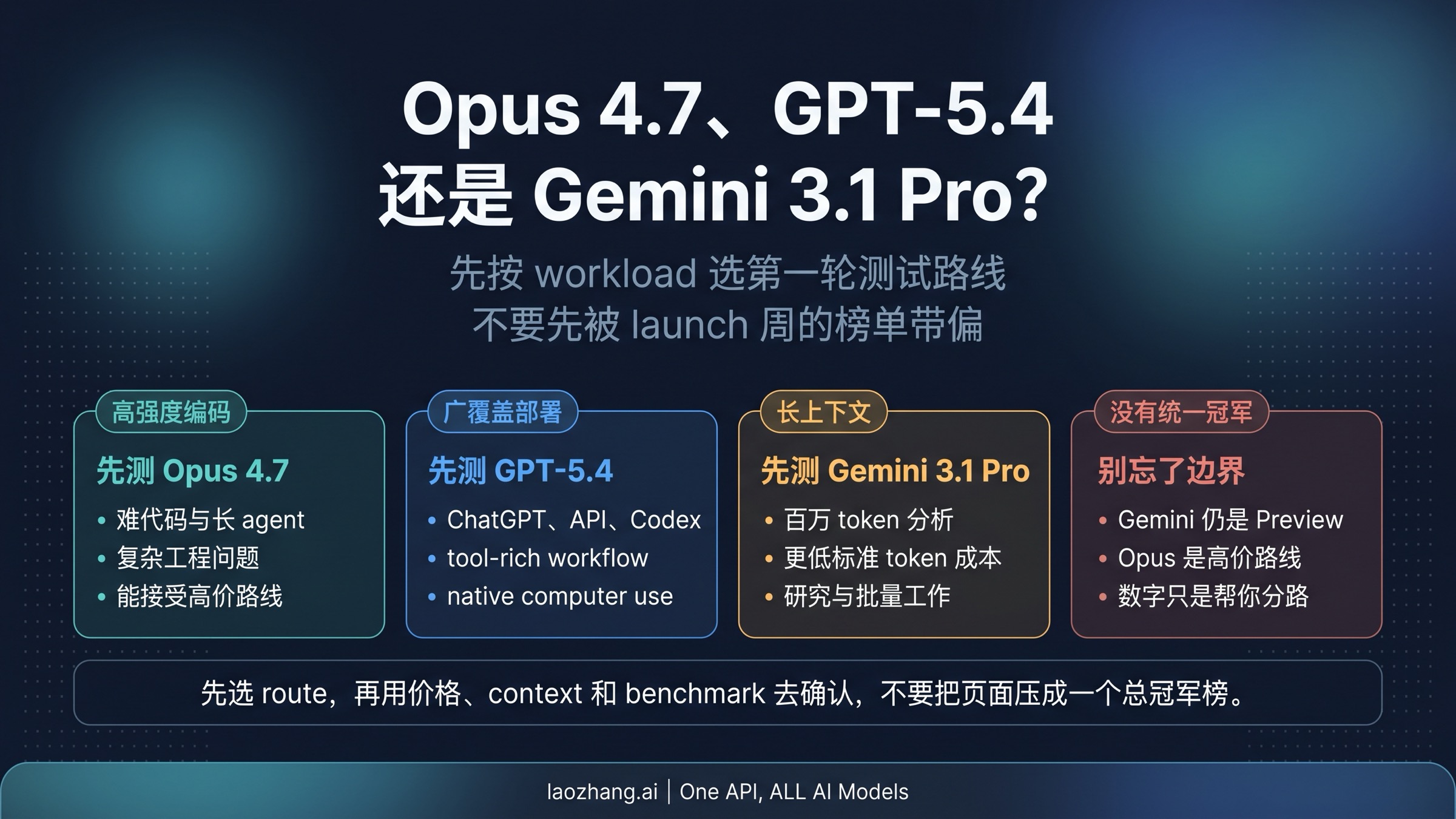

现在真正的问题,不是这三个模型里谁拿到了一个永远有效的总冠军,而是你第一轮到底该先测哪一条路。

如果你的真实瓶颈是高强度编码、长链路 agent 和复杂软件工程,先从 Claude Opus 4.7 开始最合理;如果你需要的是已经能同时跑在 ChatGPT、API 和 Codex 上的广覆盖工具流,先看 GPT-5.4;如果你最在意的是百万 token 分析、超长文档或大代码库,以及更低的标准 token 成本,先看 Gemini 3.1 Pro。

到 2026 年 4 月 18 日 为止,这三条路仍然没有收敛成一个统一答案。Gemini 3.1 Pro 还是 Preview,GPT-5.4 已经是更完整的可部署路线,Opus 4.7 则是 Anthropic 当前最明确的高端编码与 agent 路线。所以更正确的顺序不是先看榜单,而是先看工作负载。

先看结论

先把第一轮测试路线分清,会比盯着 benchmark 排名更有用。

| 你现在真正卡住的地方 | 第一轮先测 | 为什么先看它 | 需要同时记住的边界 |

|---|---|---|---|

| 高强度编码、长 agent 链路、复杂软件工程 | Claude Opus 4.7 | Anthropic 当前公开材料最明确地把它放在 premium coding 和复杂 agent 工作流这条路上 | 这是一条高价路线,官方也提醒同样输入可能映射成更多 token |

| 广覆盖部署、工具调用、需要在多个 OpenAI 入口稳定落地 | GPT-5.4 | 它已经同时活在 ChatGPT、API 和 Codex 里,部署面最完整 | 部署面最广,不等于默认赢下最重编码或最长上下文 |

| 百万 token 分析、大文档、大代码库、更看重 token 经济性 | Gemini 3.1 Pro | Google 当前模型页和价格页把它放在超长上下文与更低标准费率这条路上 | 它还是 Preview,限额和成熟度边界要一直写在前面 |

这张表就是全文结论。你不是在选一个抽象的“最强模型”,而是在选一条最适合当前工作负载的起步路线。若你的需求还很模糊,只能先做一轮通用测试,GPT-5.4 通常是最稳的默认起点;但如果你的工作明显就是重编码,或者明显就是长上下文分析,继续用一个“中间答案”反而会拖慢判断。

为什么先看 Claude Opus 4.7

Claude Opus 4.7 这条路最强的地方,不是“更聪明”这种空话,而是它在当前公开合同里把高强度编码、长链路 agent 和复杂软件工程说得最明确。Anthropic 当前的 Opus 产品页仍把它定位成面向专业软件工程与复杂 agent 工作流的 premium 路线,并且给出了 Claude 计划、Claude Platform、Bedrock、Vertex AI 和 Microsoft Foundry 等可用面。对真正做复杂工程的人来说,这意味着它不只是一个实验室里看起来更强的模型,而是一条已经能认真测的高端路线。

第二个关键点是它的“控制能力”更像给复杂任务准备。Anthropic 的 4.7 发布材料继续保留 1M 上下文,并引入了 xhigh effort、beta 状态的 task budgets 等更偏操作层的杠杆。对需要长时间推理、反复自检、带着仓库上下文持续工作的团队来说,这才是为什么应该先把 Opus 4.7 放到第一轮测试里。

但这条路的代价也必须写清楚。Anthropic 当前公开价格仍是每百万输入 5 美元、输出 25 美元,而且发布说明明确说同样输入在 4.7 上可能映射成大约 1.0x 到 1.35x 的 token 用量。也就是说,Opus 4.7 的价值必须来自更高质量的复杂任务产出,而不是来自“和原来一样便宜”。如果你真正要解决的问题只是“明天就要有一条最容易部署的广覆盖路线”,那 GPT-5.4 会更合适。如果你最看重的是超长上下文和标准费率,Gemini 会更合适。

如果你已经基本确定自己就是 Anthropic 这条路,下一步问题更像“现在要不要迁移,4.6 还要不要留作控制组”,那更应该继续读 Claude Opus 4.7 vs Claude Opus 4.6。

为什么先看 GPT-5.4

GPT-5.4 的优势,不在于它把另外两条路都吞掉了,而在于它是三者里当前合同面最完整、最容易直接落地的一条。OpenAI 现在把 GPT-5.4 同时放在 ChatGPT、API 和 Codex 里,当前公开材料也明确写了 native computer use、tool search 和 1M 上下文。这意味着很多团队第一次试模型时,不需要先在“能不能真正部署”这件事上绕路。

这条路的价值,在实际团队里比单个 benchmark 更大。很多团队选择第一轮测试模型,看的不是哪一行数字最好,而是能不能先在真实流程里跑起来。GPT-5.4 的合同之所以强,不是因为它自动赢了所有赛道,而是因为它已经是一条可在产品、开发和编码工作流里直接复用的统一路线。你可以先在 ChatGPT 里摸索,再在 API 里接入,再在 Codex 里做操作型工作流,而不用换模型家族。

官方数字也支持这种读法。OpenAI 当前材料把 GPT-5.4 写成首个具备 native computer use 能力的通用 OpenAI 模型,并给出 OSWorld、BrowseComp、GDPval、GPQA Diamond 等成绩。最有用的解读方式不是“GPT 什么都赢”,而是“如果你的工作是工具富集、要部署、还要跨多个入口稳定落地,那 GPT-5.4 是最稳的第一轮起点”。

它的边界同样不能省略。部署面最广,不等于它天然赢下 premium coding,也不等于它天然赢下百万 token 经济性。如果你的任务重心是最难的编码与长 agent 链路,Opus 4.7 仍然应该先测;如果你的核心约束是长上下文和成本,Gemini 3.1 Pro 仍然应该先测。

为什么先看 Gemini 3.1 Pro

Gemini 3.1 Pro 最值得先测的场景,是长上下文与 token 经济性比“统一部署面”更重要的时候。Google 当前模型页依然把它写成 gemini-3.1-pro-preview,并公开给出了 1,048,576 输入 token、65,536 输出 token 的上限。只要你的工作是大文档分析、长研究材料、代码库级理解或更偏 batch 的工作流,这个规模就不是可有可无的参数。

更关键的是价格结构。Google 当前价格页把 Gemini 3.1 Pro Preview 写成 200k 以内每百万输入 2 美元、输出 12 美元,超过 200k 后输入 4 美元、输出 18 美元。它未必是每个场景都更便宜,但当你的任务就是要吃大上下文、要压标准费率时,这条路的优势比任何“总榜”都更直接。

Preview 身份当然会改变路线判断,但不应该把它直接打成陪跑。更准确的说法是:如果你的第一轮测试目标本来就是长上下文分析和成本控制,Gemini 3.1 Pro 依然可能是最正确的起点;只是你必须同时接受 Preview 带来的更紧限额和更低成熟度边界。Google 当前 rate limit 文档也明确提醒 Preview 模型限制更紧,所以这里不能偷换成“低价就等于低风险”。

这正是为什么 Gemini 不该在三方比较里只被写成一句补充说明。对某些工作负载来说,它不是备选项,而是第一轮就应该先测的主路。

这些证据真正改变了什么

最容易犯的第一个错误,是把三家的公开材料硬压成一个实验室中立总榜。Anthropic、OpenAI 和 Google 都在各自公开页面里强调了不同优势,而且不少 benchmark 也是厂商公开的发布证据。它们当然有价值,但它们更适合拿来支撑“哪条路更该先测”,而不是支撑一个假装完全中立的永恒冠军。

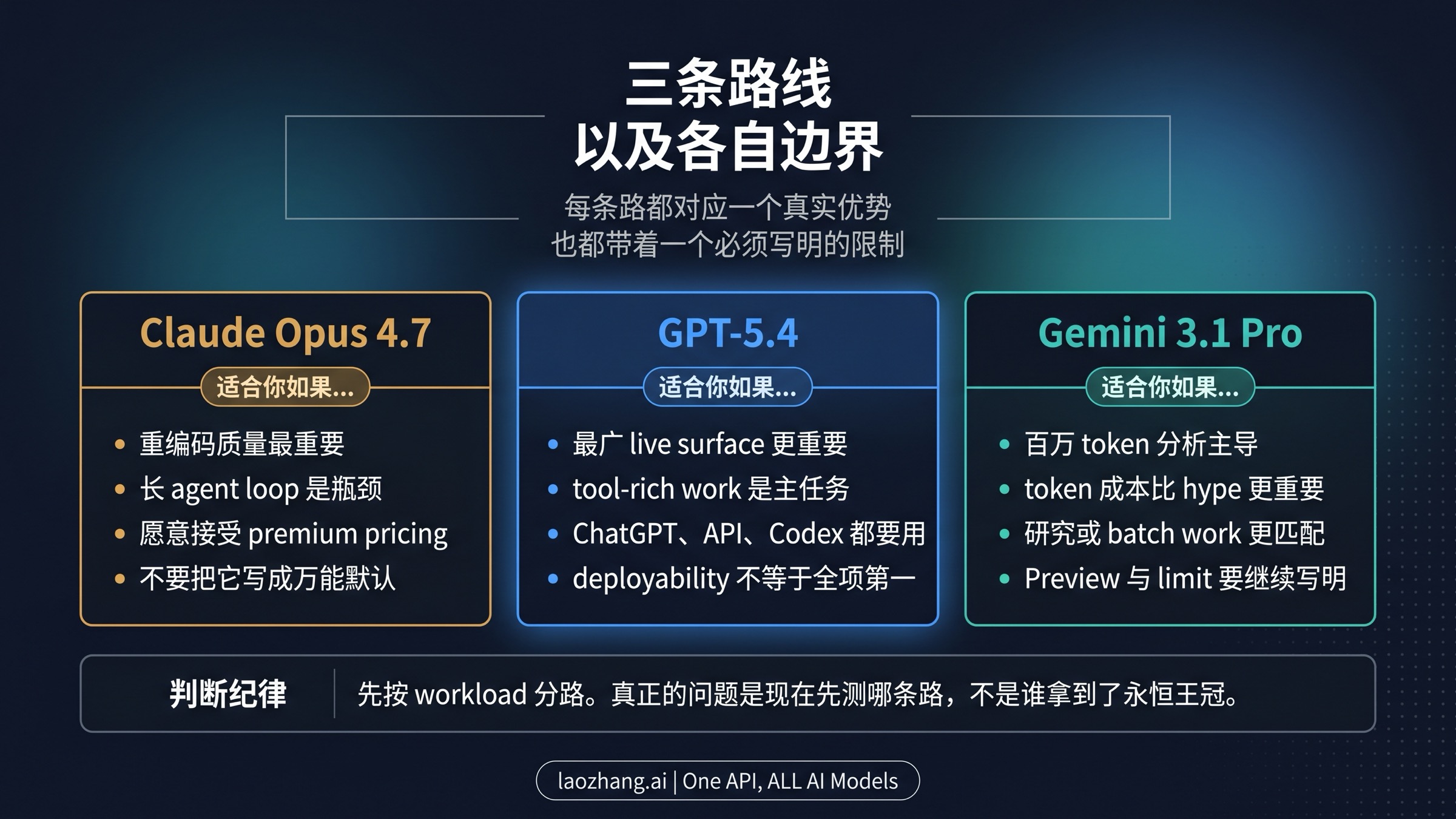

第二个错误,是只看数字,不看路线合同。GPT-5.4 最强的地方是广覆盖部署面;Gemini 最强的地方是超长上下文加更低标准费率;Opus 4.7 最强的地方是 premium coding 和高价值 agent 工作流。真正实用的顺序应该是 先按路线选起点,再用证据确认这条路线没有被自己误读。如果你反过来做,往往就会被最亮眼的一行数字牵着走。

| 关键问题 | Claude Opus 4.7 | GPT-5.4 | Gemini 3.1 Pro |

|---|---|---|---|

| 这条路最重要的公开信号是什么 | Anthropic 明确把它定位成 premium software engineering 与复杂 agent 路线 | OpenAI 已把它同时放到 ChatGPT、API 与 Codex 里 | Google 公开给出百万 token 级上下文与更低标准费率 |

| 哪个数字最能支撑这条路 | 1M 上下文、SWE-Bench Pro 64.3%、5/25 定价 | OSWorld 75.0、1M 上下文、2.50/15 标准定价 | 1,048,576 输入 token、2/12 与 4/18 两档定价 |

| 哪个边界会改变你的选择 | 高价路线,真实 token 开销可能抬升 | 部署面最广,但不自动赢所有细分任务 | 仍然是 Preview,且限额更紧 |

所以真正有用的做法,不是替你宣布终局,而是先在一分钟里把第一轮测试方向选对。

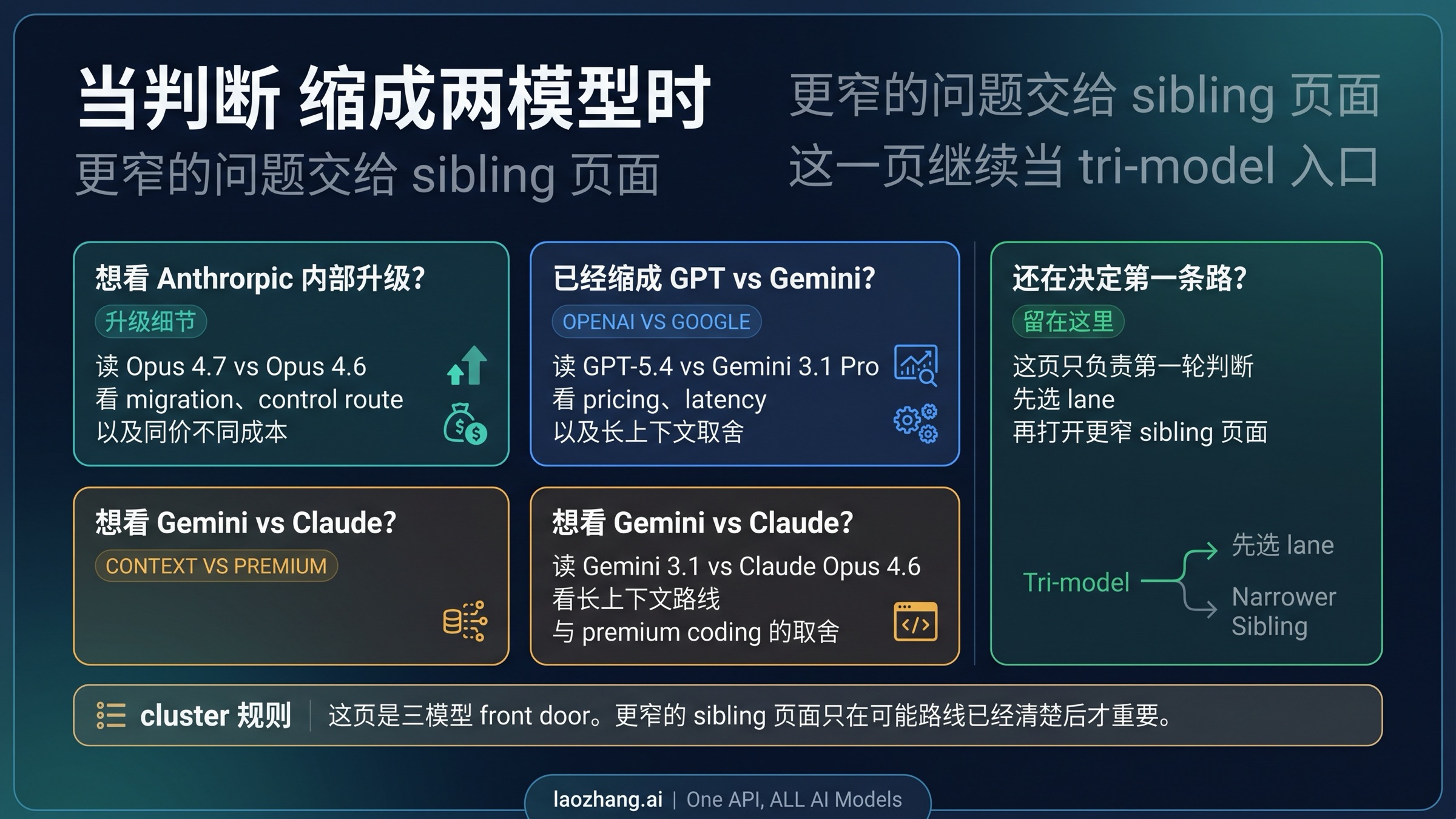

什么时候继续读下一篇

三方比较只有在它仍然承担“决策入口”角色时才有价值。一旦大概率路线已经清楚,下一步就不该继续把所有细节塞回同一篇三方比较,而应该转去更窄的 sibling 页面。

- 如果你的问题已经收敛成 Anthropic 内部升级、控制路线和同价不同成本,继续读 Claude Opus 4.7 vs Claude Opus 4.6。

- 如果你真正要在广覆盖部署和长上下文经济性之间做决定,继续读 GPT-5.4 vs Gemini 3.1 Pro。

- 如果你要在 premium coding 与长上下文成本之间做决定,继续读 Gemini 3.1 vs Claude Opus 4.6。

没有必要把所有两两比较都硬塞回同一篇三方比较。更有效的做法,是先快速选出第一轮测试路线,再把更细的权衡交给更窄的页面。

FAQ

如果需求还很模糊,大多数团队先测哪个最稳?

如果你现在只做一轮最广义的试用,GPT-5.4 通常是最稳的第一站,因为它的部署面最完整。但这只是“模糊需求下的默认”,不是对所有工作负载的总冠军判断。只要你的真实瓶颈已经明显是重编码或长上下文分析,就应该直接先测 Opus 4.7 或 Gemini 3.1 Pro。

Gemini 3.1 Pro 还是 Preview,会不会不该优先测试?

不该简单这么理解。Preview 代表限额更紧、成熟度边界更明显,不代表这条路不存在。只要你的工作负载确实被超长上下文和 token 经济性主导,Gemini 3.1 Pro 依然可能是最值得先测的入口。

Claude Opus 4.7 一定值回高价路线吗?

不一定。只有当高强度编码、长 agent 链路和更高价值的复杂任务真的是你的主要瓶颈时,它才值得第一轮就优先测试。如果你最看重的是可部署面,GPT-5.4 更合适;如果你最看重的是长上下文成本,Gemini 更合适。

三家的 benchmark 能直接当成同一张总榜来读吗?

不能。更实用的读法,是把这些数字看成厂商公开的发布证据,用来帮助你判断哪条路线更值得先测,而不是用来宣布一个永远稳定的三方总冠军。