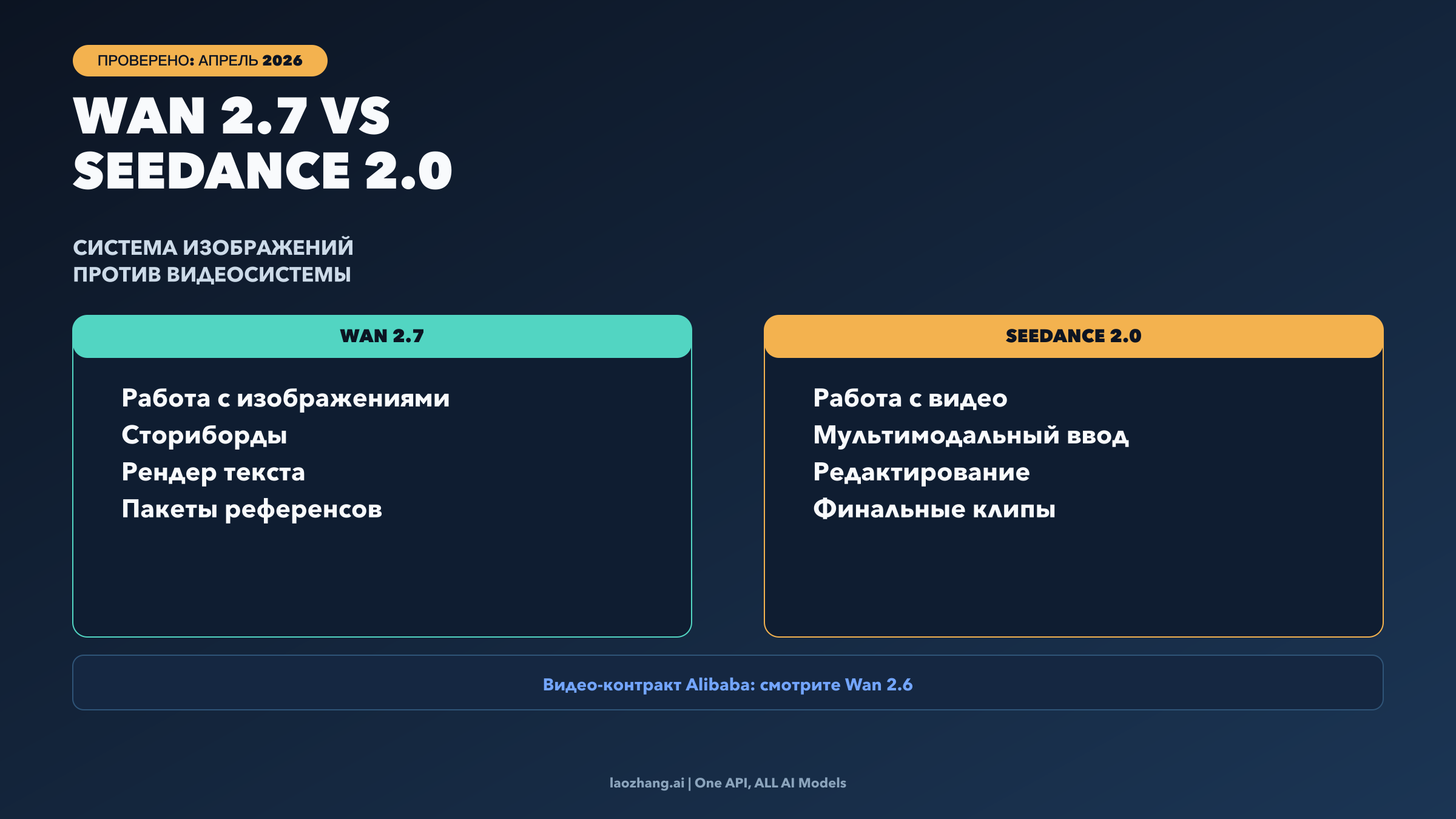

Wan 2.7 и Seedance 2.0 сейчас не являются прямыми официальными аналогами. Wan 2.7 у Alibaba на текущем публичном контракте выглядит как image-first релиз. Seedance 2.0 у ByteDance является мультимодальной аудио-видеосистемой. Если вам нужны сториборды, референс-паки, кадры с большим количеством текста или этап визуального ideation, сначала смотрите на Wan 2.7. Если вам нужен финальный видеоклип, его генерация, редактирование или extension, сначала смотрите на Seedance 2.0. А если под вопросом вы на самом деле подразумеваете «текущий официальный видеостек Alibaba против Seedance 2.0», то более точное сравнение сегодня звучит как Wan 2.6 video против Seedance 2.0 beta.

Все факты, чувствительные к свежести, ниже были повторно проверены по официальным материалам Alibaba Cloud, ByteDance Seed и Volcengine 2 апреля 2026 года. В этой теме ошибка чаще возникает не в цифрах, а в том, что разные продуктовые слои сводят в один фальшивый benchmark.

TL;DR

| Какой у вас реальный deliverable | Что выбирать первым | Почему | Главный нюанс |

|---|---|---|---|

| Сториборды, референсы, текстонасыщенные статики, upstream-визуализация | Wan 2.7 | Официальный Wan 2.7 у Alibaba сейчас описан как image-first продукт с упором на длинный текст, множественные референсы и контролируемую генерацию статики | Не надо автоматически считать это тем же самым, что и текущий публично задокументированный video runtime Alibaba |

| Финальная генерация видео, редактирование, продление | Seedance 2.0 | Официальные docs ByteDance и Volcengine помещают Seedance 2.0 именно в видеослой: text, image, video и audio в одном workflow | Доступ по API все еще ограничен enterprise-beta рамкой, а не универсальным self-serve |

| Нужен самый прозрачный runtime-контракт прямо сейчас | Wan 2.6 video vs Seedance 2.0 beta | Публичные docs Alibaba сегодня заметно яснее описывают цены и правила runtime для Wan 2.6 video | Это уже другое сравнение, не Wan 2.7 image против Seedance 2.0 |

| Нужно построить один pipeline от ideation до клипа | Использовать оба | Wan 2.7 сильнее upstream как источник keyframe и style pack, а Seedance 2.0 сильнее downstream как video engine | Переход между ними нужно проектировать осознанно |

Почему Wan 2.7 и Seedance 2.0 нельзя честно ставить в один и тот же benchmark

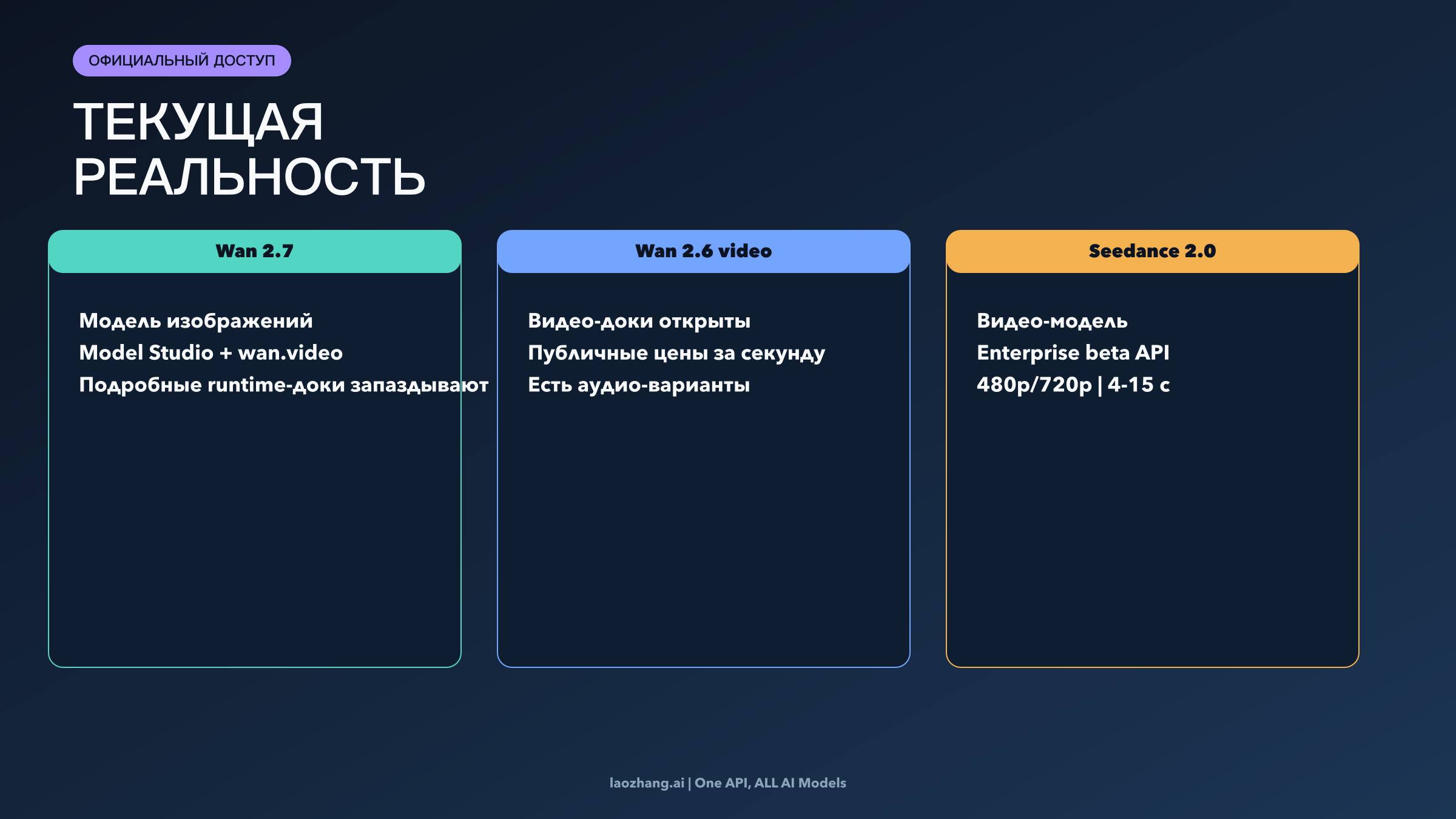

Сначала нужно зафиксировать реальность: в текущих публичных официальных материалах эти продукты живут на разных слоях вывода. Апрельский пресс-релиз Alibaba представляет Wan2.7-Image и Wan2.7-Image-Pro как релиз для генерации и редактирования изображений. Там акцент сделан на длинном тексте, персонализированной генерации, до девяти reference images, до двенадцати изображений за раз и 4K-выводе у Wan2.7-Image-Pro. Это история про image workflow.

Официальный launch Seedance 2.0 и текущий tutorial Volcengine описывают уже другую сущность: мультимодальную аудио-видеомодель, которая принимает text, image, video и audio, выдает ролики длиной 4-15 секунд и покрывает генерацию, edit и extension. Это история про video workflow.

Почему путаница не исчезает? Потому что бренд Wan теперь накрывает больше одного поколения и больше одного surface. В пресс-релизе Alibaba сказано, что Wan 2.7 доступен через Model Studio и wan.video, но текущая публичная страница Alibaba Model Studio models все еще описывает наиболее понятный публичный видеоконтракт через семейство Wan 2.6, а не через отдельную явно выписанную Wan 2.7 video line. Поэтому запрос «Wan 2.7 vs Seedance 2.0» очень часто на деле смешивает текущий image release с текущей видеосистемой и просит один общий verdict.

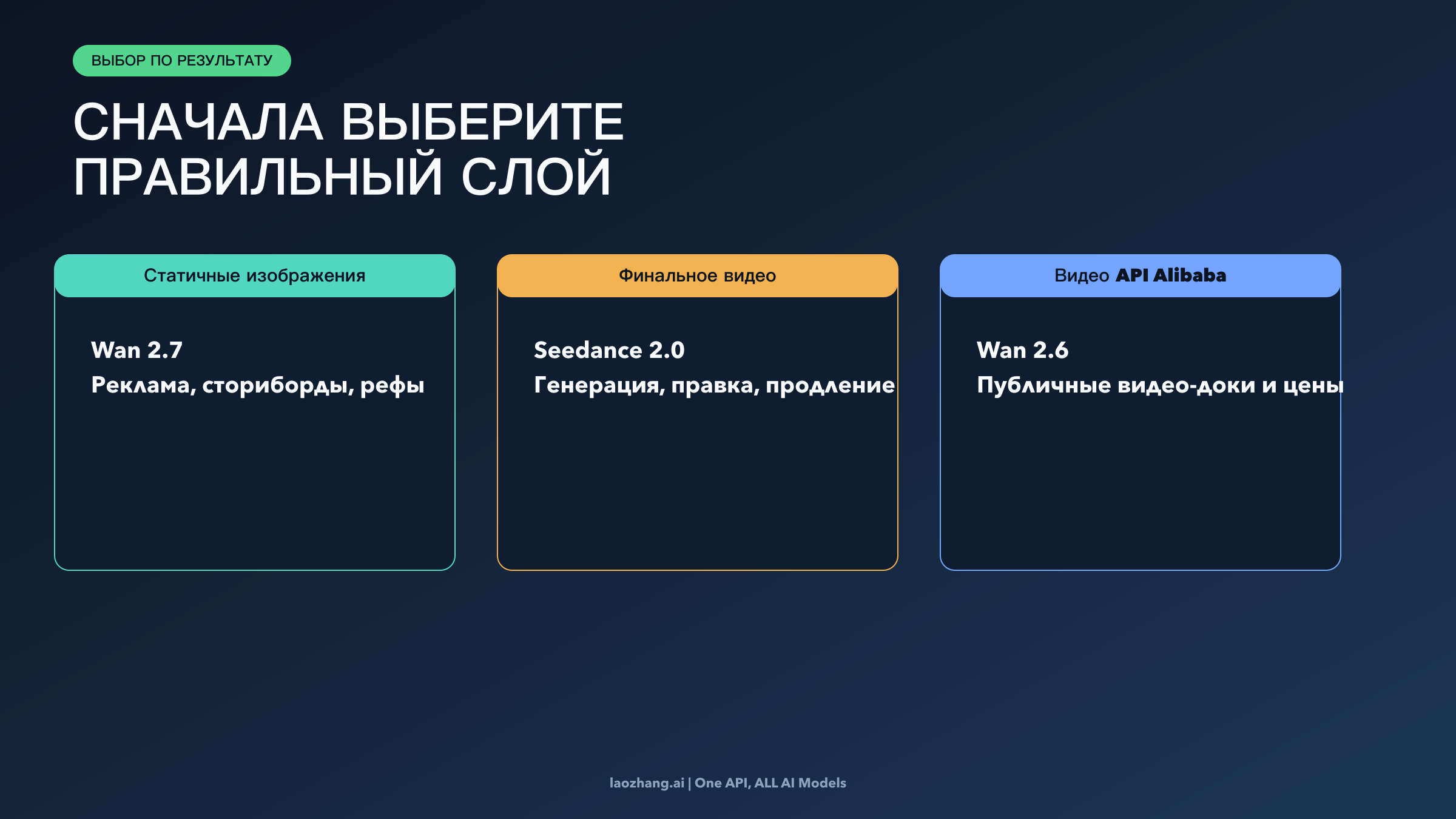

Практический вывод отсюда простой. Начинать нужно не с бренда, а с deliverable. Если у вас на выходе статичное изображение или набор статичных ассетов, вы выбираете image layer. Если у вас на выходе финальный ролик, вы выбираете video layer. Только после этого сравнение перестает быть бессмысленным.

Где Wan 2.7 сильнее

Wan 2.7 сильнее там, где ваша реальная задача связана с контролем над статичным изображением, а не с финальным видео. Официальные материалы Alibaba и ведут именно туда: генерация визуалов с длинным текстом, storyboard-style multi-image output, коммерческие still assets с более строгим контролем цвета и бренда, а также image editing.

В текущем публичном контракте Wan 2.7 особенно важны три вещи. Во-первых, Alibaba указывает поддержку до 3 000 текстовых token, а это редкая и реально полезная характеристика для постеров, рекламных визуалов и любых задач, где текст внутри картинки имеет значение. Во-вторых, Wan 2.7 принимает до 9 reference images и умеет генерировать до 12 изображений за раз, что делает его удобным для storyboard board, style pack, product-scene exploration и общей визуальной разведки. В-третьих, Wan2.7-Image-Pro дает 4K output, что повышает уверенность для design review, e-commerce detail и дальнейшего кропа.

Именно поэтому Wan 2.7 логично ставить upstream в контентном pipeline. Когда вы решаете композицию, фиксируете визуальную identity, тестируете typography или готовите still references для следующего видеоэтапа, Wan 2.7 подходит лучше, чем Seedance 2.0. Seedance умеет работать с image reference, но его публичный контракт сегодня все равно сфокусирован на превращении мультимодального input в video output. Wan 2.7 честнее оставлять там, где конечный ассет пока еще является изображением.

Это особенно верно, если команда еще не понимает, как должен выглядеть финальный ролик. Сильный reference pack сокращает количество дорогих видеоитераций. Если ваша проблема все еще в кадре, а не в движении, сначала исправьте кадр. Для более широкой оценки именно этого upstream-слоя у нас есть отдельный гайд по лучшим AI image models.

Где Seedance 2.0 сильнее

Seedance 2.0 сильнее там, где deliverable уже сам по себе является видео. Текущий tutorial Volcengine достаточно четко описывает рабочую форму этого runtime. Публичный beta-контракт Seedance 2.0 допускает text плюс до 9 изображений, до 3 видеофрагментов и до 3 аудиофайлов в одной задаче; поддерживает длину ролика от 4 до 15 секунд при 480p или 720p; и покрывает не только generation, но и edit-like задачи, включая extension.

Важно не просто то, что «он тоже умеет принимать референсы». Важно, что эти референсы уже находятся внутри video-native workflow. Можно одновременно задавать motion, rhythm, scene continuation и audio-aware generation с самого начала, вместо того чтобы заставлять image-centric продукт играть роль видеоядра. Если ваш критерий выглядит как «смогу ли я дать несколько картинок, задать motion и audio guidance, а на выходе получить реальный usable clip?», то Seedance 2.0 ближе к самому вопросу.

Граница доступа, конечно, остается существенной. Текущие docs Volcengine помещают Seedance 2.0 и Seedance 2.0 Fast в зону public beta для enterprise users, а не в полностью безбарьерный self-serve global runtime. Это серьезное ограничение, но оно не меняет саму природу продукта. Оно означает лишь то, что для финальной video-work задачи Seedance 2.0 — более правильный выбор в этой паре, но текущий rollout все еще требует дополнительных условий доступа.

Поэтому если ваш запрос с самого начала звучит как «мне нужен готовый ролик», а не как «мне нужен более сильный upstream visual brief», Seedance 2.0 — более точный ответ. Если же вы хотите посмотреть на этот вопрос уже как на более широкий creator-market shortlist, лучше открыть наш гайд по лучшим image-to-video инструментам.

Если важнее runtime и API clarity, сравнивайте Wan 2.6 video с Seedance 2.0 beta

Для технического покупателя важен не только вопрос «что выглядит сильнее», но и вопрос «что сегодня официально задокументировано, понятно по цене, поддерживаемо и реально интегрируемо». В этой плоскости корректная пара сравнения — не Wan 2.7 image против Seedance 2.0, а Wan 2.6 video против Seedance 2.0 beta.

Публичные docs Alibaba сегодня выглядят сильнее именно на стороне runtime-contract clarity. Там открыто перечислены семейства wan2.6-t2v и wan2.6-i2v-flash, а также опубликованы per-second prices. На проверенном 2 апреля 2026 года US-контракте wan2.6-t2v-us указан как $0.10 за секунду при 720p и $0.15 за секунду при 1080p. Документированный wan2.6-i2v-flash идет еще дальше и различает цены для режима с audio и без него. Такая публичная ясность полезна сама по себе, даже если ваш конечный стек потом будет иным.

Контракт Seedance 2.0 сегодня рассказывает другую историю. Tutorial page уже показывает реальные model IDs, диапазоны вывода и мультимодальные лимиты, что заметно сильнее старого нарратива «только console». Но pricing page по-прежнему легче читать как набор сценарных примеров, чем как единый универсальный sticker price. Официальные примеры сейчас показывают, что 5-секундный клип 16:9 в 480p стоит 2.31 RMB для doubao-seedance-2.0 и 1.86 RMB для doubao-seedance-2.0-fast, а аналогичный 5-секундный 16:9 клип в 720p — 4.97 RMB и 4.00 RMB соответственно. Это уже полезные данные, но публичная поверхность здесь менее ровная, чем у Wan 2.6 video rows от Alibaba.

Отсюда и простое правило маршрутизации. Если вы выбираете по public runtime clarity, читаемости контракта и прозрачности price table, сегодня проще начинать с видеостороны Alibaba, но под именем Wan 2.6 video, а не Wan 2.7 image. Если же вы выбираете по мультимодальной video semantics, editability и силе самой видеосистемы, Seedance 2.0 выглядит интереснее, но вам придется принять enterprise-beta границу доступа и менее унифицированную ценовую поверхность.

Если вам нужен более широкий обзор того, какие публичные video APIs сейчас вообще проще внедрять на практике, наш гайд по лучшим free AI video API окажется полезнее любого hype-driven vendor showdown.

Как выбирать по workflow и когда использовать оба решения вместе

Самый полезный ответ здесь часто не в том, чтобы выбрать одного «победителя», а в том, чтобы назначить правильного владельца каждому этапу.

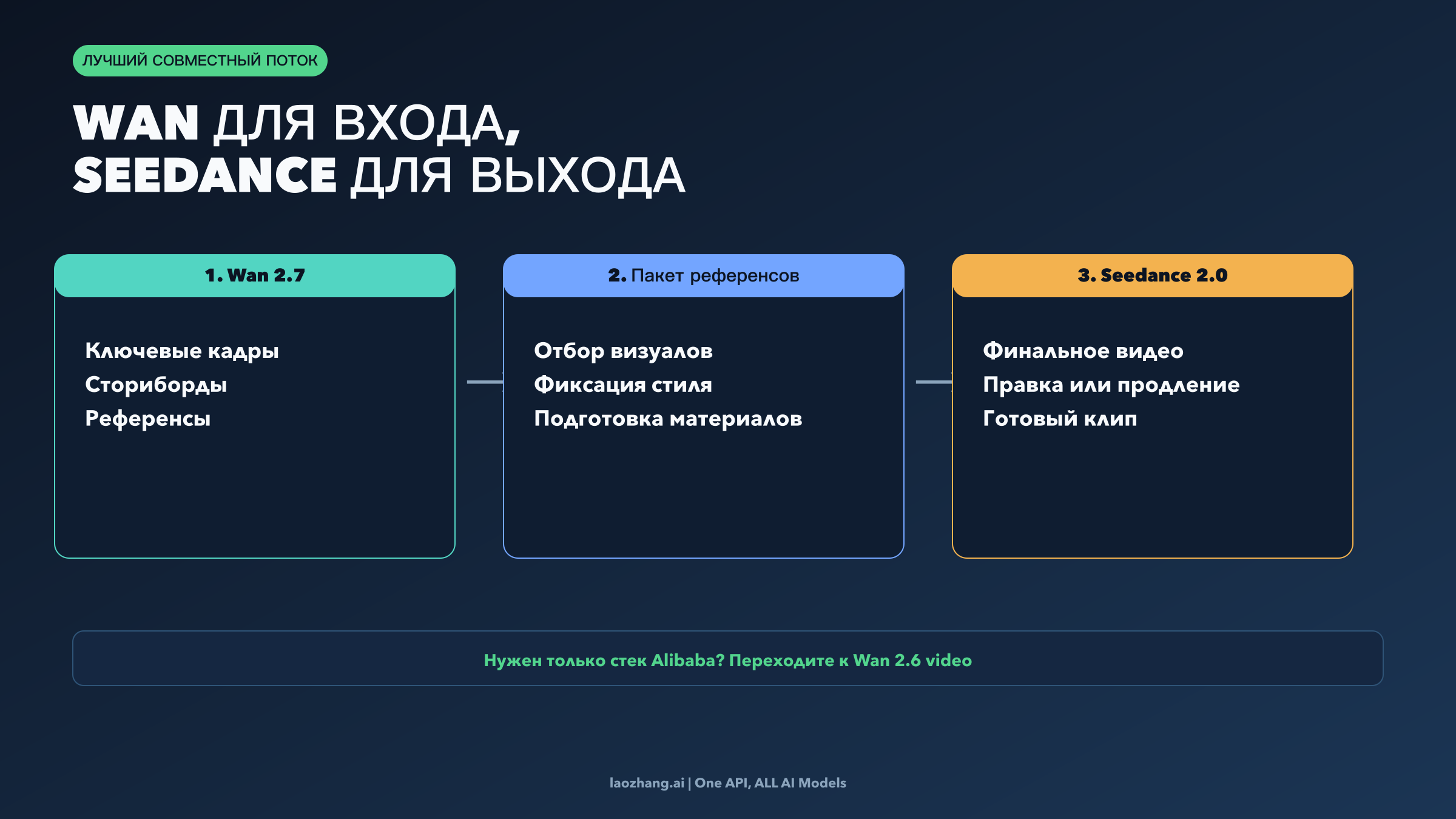

Если вы бренд-команда или creative team, на ранней стадии сложнее всего обычно не motion, а сам look. В этом случае Wan 2.7 берите upstream: hero still, storyboard panel, продуктовые композиции, текстонасыщенные визуалы и reference pack, на который потом будет выравниваться вся команда. Когда направление зафиксировано, Seedance 2.0 ставьте downstream, если следующая задача — превратить этот визуальный язык в реальное движущееся видео.

Если вы технический buyer, разделите вопрос на две части. Для image generation и контролируемых still assets честнее смотреть на Wan 2.7. Для публично задокументированного video runtime сравнения — на Wan 2.6 video и Seedance 2.0 beta. Для финальной video generation — на Seedance 2.0. Это звучит сложнее, чем односложный verdict, но и обманывает вас куда меньше.

Если вы solo creator или performance marketer, решение может быть быстрее. Нужны keyframe, ad concepts или чистый reference set перед motion — берите Wan 2.7. Shot уже понятен и нужен короткий клип — берите Seedance 2.0. Workflow проходит через оба слоя — используйте оба и не пытайтесь ради простоты заставить одну модель делать работу двух.

В этом и состоит главный смысл статьи: самый сильный ответ здесь чаще pipeline-shaped, а не winner-shaped. Для многих команд лучшая схема выглядит так: Wan 2.7 отвечает за ideation и reference control, а Seedance 2.0 — за final clip generation, extension и edit-style work. Выбирать один универсальный ответ имеет смысл только тогда, когда вы действительно живете только на одном слое.

Часто задаваемые вопросы

Wan 2.7 лучше, чем Seedance 2.0?

Не как универсальное утверждение. Wan 2.7 сильнее для image-centric задач: сториборды, референс-паки, кадры с большим количеством текста. Seedance 2.0 сильнее для финальной мультимодальной генерации видео, редактирования и extension. Слово «лучше» становится честным только после привязки к конкретному этапу workflow.

Wan 2.7 вообще делает видео?

Апрельский релиз Wan 2.7 у Alibaba описан как image-first, а наиболее ясный публичный видеоконтракт в Alibaba Model Studio по-прежнему относится к семейству Wan 2.6. Поэтому сегодня «Wan 2.7 video» — не самый чистый публичный runtime contract для сравнения с Seedance 2.0. Если вам важен deployable video stack Alibaba, смотрите на Wan 2.6 video.

Что важнее для API и runtime buyer?

Если на первом месте стоит прозрачность публичного контракта, Wan 2.6 video сейчас проще для оценки: семейства моделей и per-second prices там выписаны яснее. Если важнее мультимодальная видеоспособность и edit semantics, интереснее выглядит Seedance 2.0, но его официальный доступ пока ограничен рамкой enterprise beta.

Когда лучше использовать обе системы вместе?

Тогда, когда workflow начинается с визуального planning и заканчивается готовым клипом. Сначала генерируйте still references, keyframe и визуальное направление в Wan 2.7, а затем передавайте эту утвержденную базу в Seedance 2.0 для video generation, extension или edit-style задач.