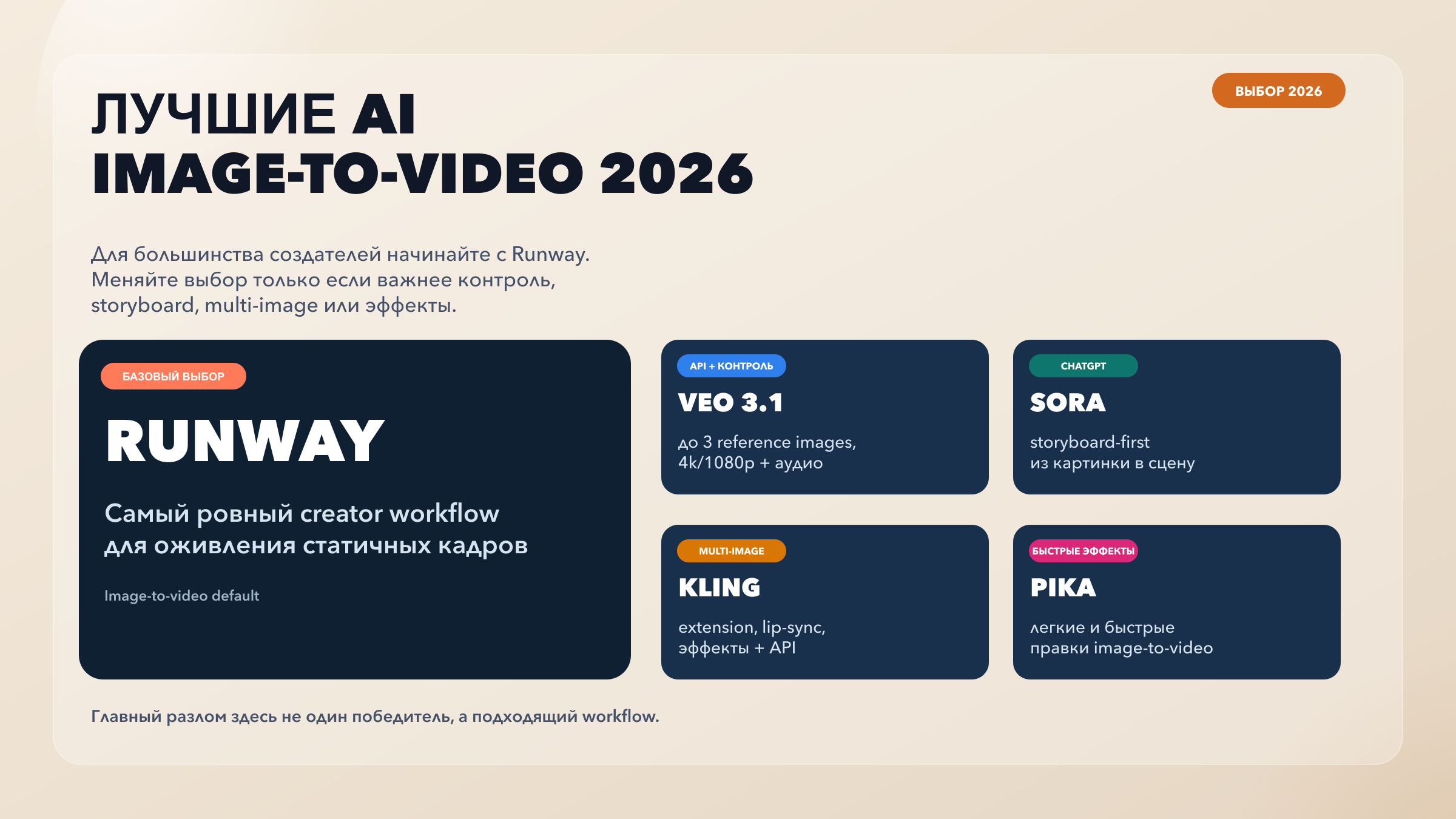

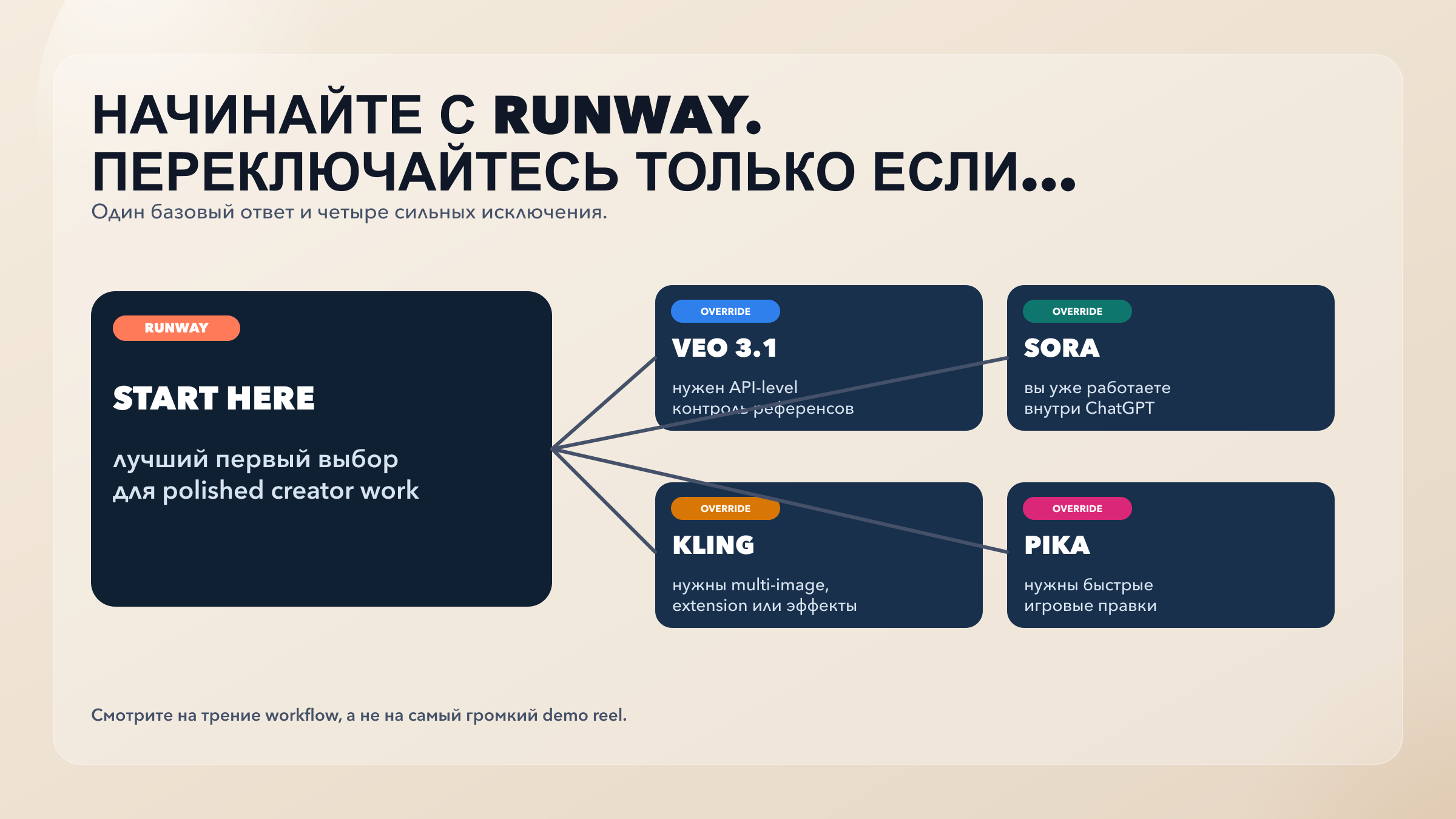

Если в 2026 году вам нужен один AI image-to-video инструмент, с которого имеет смысл начинать, начните с Runway. Для большинства создателей это самый ровный выбор по умолчанию: не нужно сразу думать как API-покупатель, не нужно заранее принимать регионально ограниченный app-flow, и не нужно стартовать в продукте, который прежде всего заточен под эффекты или развлекательные сценарии. Когда задача действительно другая, тогда уже и стоит переключаться. Логика переключения простая: Veo 3.1 нужен для API-уровня, строгого контроля референсов и нативного аудио; Sora лучше подходит тем, кто и так живет внутри ChatGPT и хочет storyboard-first workflow; Kling нужен, когда важны multi-image motion, extension, lip-sync и эффекты; Pika логичнее брать, когда нужен легкий, быстрый, более игровой image-to-video sandbox.

Это разделение важно потому, что выбор image-to-video инструмента не равен вопросу “какая video model лучшая вообще”. Как только исходный актив у вас уже есть, победителем становится не тот, у кого самый громкий demo reel, а тот, кто лучше удерживает исходную картинку, дает нужный уровень motion control и не ломает workflow неправильным планом, входом или форматом работы.

Все чувствительные ко времени факты ниже были повторно проверены по официальным pricing, help и product-documentation страницам 28 марта 2026 года.

TL;DR

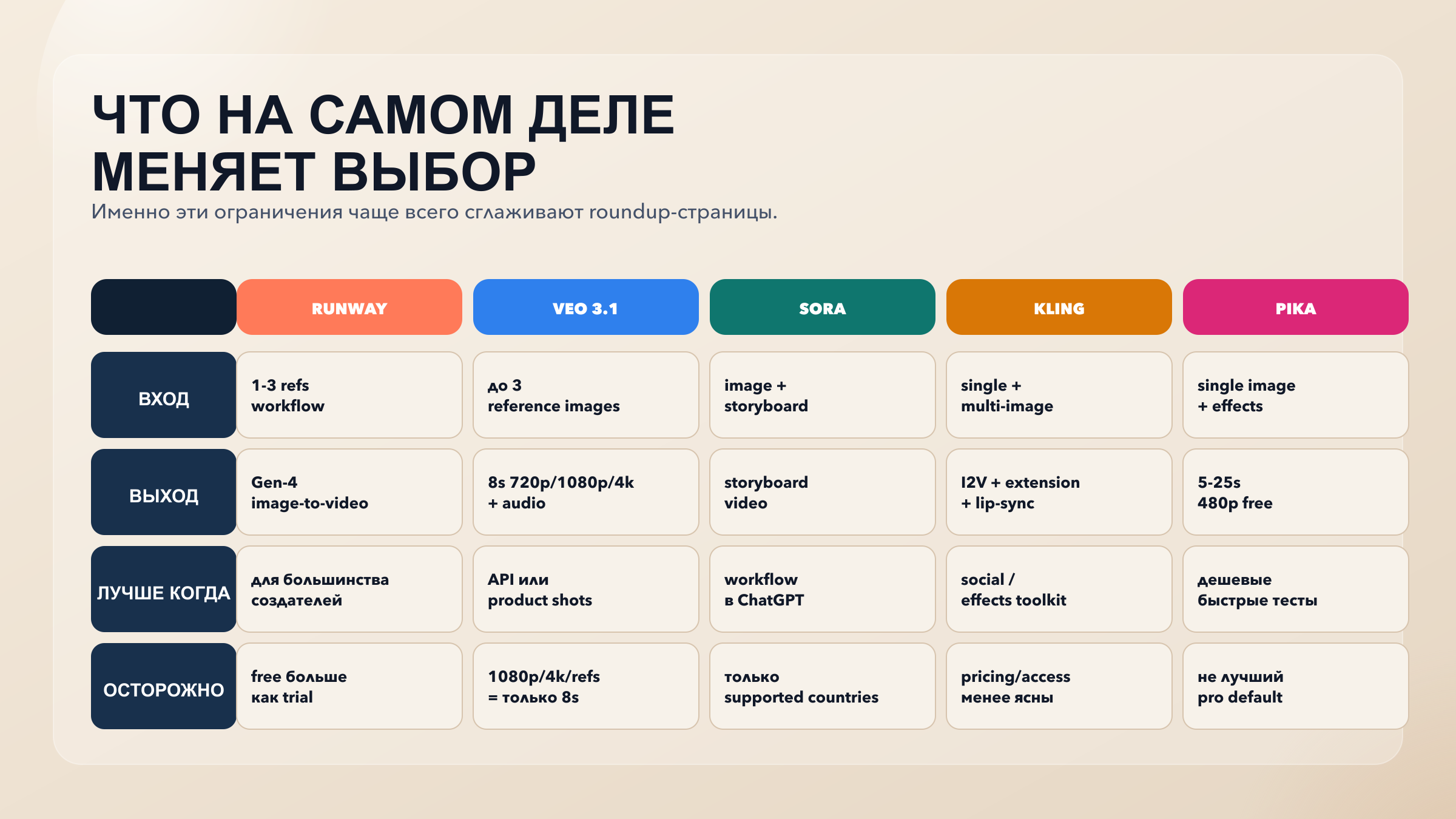

| Если ваш реальный сценарий такой | Лучший выбор | Почему он выигрывает | Главный минус |

|---|---|---|---|

| Нужен лучший дефолт для большинства creator workflows | Runway | Лучшая комбинация удобного продукта, image-first итерации и читаемого paid path | Бесплатный доступ больше похож на одноразовый trial, чем на постоянный free tier |

| Нужен API-уровень контроля для product shots, characters или референсов | Veo 3.1 | Официальные docs поддерживают до трех reference images и native audio | Reference-image режим, 1080p и 4k все равно фиксируют вас в 8 секунд |

| Вы уже создаете контент внутри ChatGPT и хотите storyboard-first flow | Sora | OpenAI прямо строит help flow вокруг image upload и editable storyboards | Sora App и Sora 2 по-прежнему доступны только в supported countries |

| Нужны multi-image motion, extension, lip-sync или effects-heavy сценарии | Kling | У Kling 3.0 официально очень широкая capability surface | Публичная pricing/access история менее ясна, чем у Runway или Pika |

| Нужны быстрые, легкие image-to-video edits и эффекты | Pika | Публичный pricing прозрачен, эффектных инструментов много, порог входа низкий | Это не самый чистый pro-default для серьезной production-работы |

Почему это не тот же выбор, что “лучшая AI video model”

Главная ошибка в этой категории в том, что читателя часто представляют как человека, который ищет одного универсального видеочемпиона. Но большинство image-to-video пользователей так не мыслят. У них уже есть то, что нужно сохранить: product photo, character reference, still frame для ролика, рекламный key visual, moodboard image или уже сгенерированная картинка, которую нужно оживить, не потеряв ее идентичность.

Как только стартовый актив уже есть, сама постановка задачи меняется. Важны уже не только слова “самый кинематографичный” или “лучшее качество”. Важны другие вопросы: сколько reference images вообще поддерживается, app-first это flow или API-first, можно ли строить storyboard прямо от исходной картинки, какие длины и разрешения реально доступны именно в этом режиме, и превращается ли продукт в понятный workflow или в набор разрозненных крутых функций.

Если на самом деле вам нужен более широкий взгляд на general-purpose model race, а не выбор конкретного image-to-video workflow, тогда логичнее читать наш гид по лучшим AI video models. Эта статья уже и практичнее: здесь речь только о том, какой инструмент открыть первым, когда исходное изображение уже готово.

Пять инструментов, которые действительно стоит держать в shortlist

Runway сейчас лучший AI image-to-video генератор для большинства создателей, потому что он ощущается как самый цельный creator workflow, а не как одна впечатляющая model endpoint. Его публичная pricing page одна из самых читаемых в этой категории. Free стоит $0, но ключевая деталь в том, что это 125 one-time credits, а значит бесплатный режим нужен скорее для оценки продукта, чем для долгой работы. Сильная сторона Runway начинается там, где начинается paid path: Standard при yearly billing стартует от $12 за editor в месяц, а в самом plan surface у Runway прямо указан Gen-4 (Image to Video). Плюс Runway сам описывает Gen-4 References как workflow вокруг одной-трех reference images с последующей передачей результата в latest video model. Для image-first работы это именно тот тип продукта, который большинству и нужен.

Runway берет первое место по умолчанию не потому, что гарантированно выигрывает любой quality contest. Он берет его потому, что требует меньше всего лишних оговорок, прежде чем начать быть полезным. Вам не нужно сразу входить в роль разработчика. Не нужно уже жить в ChatGPT. Не нужно заранее хотеть эффектный playground. Достаточно одной картинки и нормального творческого инстинкта, чтобы начать продвигать ее к рабочему клипу.

Veo 3.1 лучше выбирать тогда, когда ваша image-to-video задача больше похожа на product control, character consistency или developer workflow, чем на легкий creator app. Текущие Gemini API docs у Google очень конкретны. Veo 3.1 принимает до трех reference images, генерирует native audio и умеет выдавать 8-second видео в 720p, 1080p и 4k. И еще важнее то, что Google честно описывает ограничения: если вы используете reference images, 1080p или 4k, вы автоматически попадаете в 8-second режим.

Поэтому Veo не стоит описывать как универсальный default winner. Его нужно показывать как лучший override для control-first задач. Если вам нужны product shots, где важно держать бренд и объект в рамках, clips с character consistency или programmatic flow, где входное изображение столь же критично, как и выход, Veo будет логичнее Runway. Но если нужен более дружелюбный creator-first продукт с меньшим операционным трением, Runway по-прежнему проще как стартовая точка.

Sora лучший image-to-video выбор для тех, кто уже и так работает внутри ChatGPT и кому storyboard важнее универсальной доступности. Самый полезный официальный факт о Sora не в бенчмарках. Он в самом workflow, который OpenAI описывает в help center: загрузить still image как вдохновение, а дальше либо дать Sora собрать editable storyboard, либо самому выстраивать видео покадрово. Это уже совершенно другой творческий режим, не такой, как у Veo, Runway или Kling.

Почему Sora не дефолт? Не потому что он слабее. А потому что это не самый бесшовный broad-access ответ для широкой аудитории. OpenAI отдельно пишет, что Sora App и Sora 2 ограничены списком supported countries, а более тяжелое использование теперь вписано в plan-and-credits logic. Если вы уже ChatGPT-native creator, это может не мешать вообще. Но если нужен самый безопасный default для максимально широкой аудитории, это сразу меняет ранжирование.

Kling лучший override тогда, когда вам важнее ширина capability surface, чем цельность продукта. Официальный сайт Kling очень прямо описывает возможности 3.0: Image to Video, Multi-Image to Video, Video Extension, Lip Sync, Video Effects, Audio Generation, плюс fully available Kling 3.0 API. Это много. Если ваш вопрос звучит не как “какой продукт открыть первым”, а как “какой инструмент даст больше motion options вокруг одной картинки”, Kling выглядит очень сильным кандидатом.

Слабое место Kling не в функциях, а в ясности. Его легче рекомендовать как capability-rich lane, чем как самый простой первый выбор. Публичное описание возможностей у него сильнее и яснее, чем общая pricing/access история. Этого недостаточно, чтобы убрать его из shortlist, но достаточно, чтобы не давать ему место дефолта вместо Runway.

Pika здесь лучший инструмент тогда, когда нужен не самый аккуратный профессиональный pipeline, а быстрый, легкий и effects-heavy режим экспериментов. Pika unusually clearly описывает свой pricing. Free-план включает 80 monthly video credits, доступ к Pika 2.5 (480p only), а для Text-to-Video & Image-to-Video на модели 2.5 бесплатно 5-second generation стоит 12 credits. И не менее важно то, как платформа описывает саму себя: Pikascenes, Pikadditions, Pikaswaps, Pikatwists, Pikaffects, Pikaframes. То есть Pika строится не просто как “чистый cinematic generator”, а как быстрая площадка для движения, эффектов и повторных попыток.

И это сразу определяет ее место. Если нужен лучший all-around creator default, сильнее Runway. Если нужен самый строгий reference control, сильнее Veo. Если нужен ChatGPT-native storyboard flow, сильнее Sora. Но если задача в том, чтобы быстро оживить картинку, поиграть с эффектами и сохранить низкий порог входа, Pika действительно заслуживает место в основном списке.

Если сама картинка пока еще слабая, не торопитесь менять video tools. Часто полезнее сначала пройти через наш гид по лучшим AI image generators, потому что плохой source image заставляет любой image-to-video сервис выглядеть слабее, чем он есть на самом деле.

Как выбрать за 60 секунд

Если нужна совсем короткая версия, используйте это правило.

Начинайте с Runway, если у вас нет конкретной причины этого не делать. Это сейчас самый надежный default path, потому что Runway лучше других балансирует product quality, image-first iteration и читаемый paid path.

Переходите на Veo 3.1, если ваш главный приоритет это контроль над исходной картинкой, а не самый легкий creator app. Для product footage, brand assets, character consistency и developer-driven flows это будет более точное решение.

Переходите на Sora, если вы уже создаете внутри ChatGPT и вам нужен storyboard-first режим. Когда ChatGPT уже ваш основной creative workspace, привлекательность Sora сильно растет. Если же вы пришли с нуля и просто хотите один понятный image-to-video ответ, он уже не так хорош как default.

Переходите на Kling, если вам нужен более широкий motion toolkit вокруг исходной картинки. Multi-image video, extension, lip-sync, effects и API делают Kling лучшим override для сценария “мне нужно больше способов двигать картинку”, а не для сценария “мне нужен самый спокойный дефолт”.

Переходите на Pika, если вам нужен самый легкий путь к быстрым и playful image-to-video экспериментам. Здесь важнее скорость, легкость и эффектность, чем выбор самого системного долгосрочного дома.

Скрытые ограничения, которые реально меняют ответ

Первое скрытое ограничение, которое реально меняет выбор, это как инструмент вообще понимает исходную картинку. Для Veo ключевую роль играют reference images. Sora мыслит storyboard flow. Kling расширяется в сторону multi-image composition и effect logic. Pika тяготеет к effect-first edits. Runway стоит посередине и дает самый ровный общий creator workflow. Это не косметика. Это то, что определяет, сколько от вашей исходной картинки доживет до финального клипа и сколько усилий уйдет на управление результатом.

Второе скрытое ограничение это какие output rules реально действуют именно в нужном вам режиме. Docs по Veo 3.1 хорошо показывают, почему это важно: 1080p, 4k и reference-image jobs все равно фиксируют вас в 8 секунд. Для человека, который планирует монтаж по длительностям, это не мелкая сноска. У Pika похожая история на другом уровне. Free-tier настоящий, но бесплатный image-to-video lane для Pika 2.5 сидит в 480p. Для быстрых тестов это нормально, но это уже совсем не тот же контракт, что у polished production default.

Третье скрытое ограничение это форма доступа. Sora здесь самый показательный случай: если вы находитесь в supported country и уже работаете внутри ChatGPT, workflow может оказаться очень сильным. Если нет, этот факт сам по себе снимает Sora с роли default choice. Сильный creative flow и универсально низкое трение доступа — не одно и то же.

Четвертое скрытое ограничение это какой вопрос вы на самом деле задаете: free entry, paid creator workflow или API/control path. Это разные вопросы. Если вам на самом деле нужен лучший бесплатный старт, читайте наш гид по лучшим бесплатным AI image-to-video сервисам. Если бесплатный слой уже позади и важнее цена владения, тогда логичнее переходить к сравнению цен на AI video generation. А задача этой статьи проще: картинка уже есть, теперь нужно понять, какой инструмент открыть первым.

Часто задаваемые вопросы

Какой AI image-to-video генератор сейчас лучший по умолчанию?

Для большинства людей это Runway. Не потому что он выигрывает любой частный сценарий, а потому что лучше всего сочетает image-first workflow, creator usability и читаемую платную траекторию.

Что лучше для product shots или character consistency?

Veo 3.1. Google прямо поддерживает до трех reference images и native audio, поэтому Veo логичнее там, где важнее контроль над source image, чем более дружелюбный app layer.

Меняется ли ответ, если я и так живу в ChatGPT?

Да. Для таких пользователей Sora заметно сильнее, потому что его help-documented flow построен вокруг image upload и editable storyboard, а не вокруг холодного широкого дефолта для всех.

Что лучше для multi-image motion и social-style effects?

В первую очередь смотрите на Kling. Его official capability surface охватывает multi-image-to-video, extension, lip-sync, effects и API. Если же нужен более легкий и быстрый playful режим, тогда логичнее смотреть на Pika.

А если меня интересует только бесплатный вход?

Тогда это уже другой вопрос. Идите прямо в наш гид по бесплатным image-to-video AI, потому что free-answer сильнее зависит от reset logic, download restrictions и output limits, чем от общей paid-иерархии этой статьи.

Стоит ли сначала улучшить исходное изображение, а потом уже выбирать video tool?

Очень часто да. Слабый source image заставляет любой video generator выглядеть хуже. Если бутылочное горлышко пока в самой картинке, сначала полезнее пройти через гид по лучшим AI image generators, а уже потом возвращаться к выбору image-to-video инструмента.