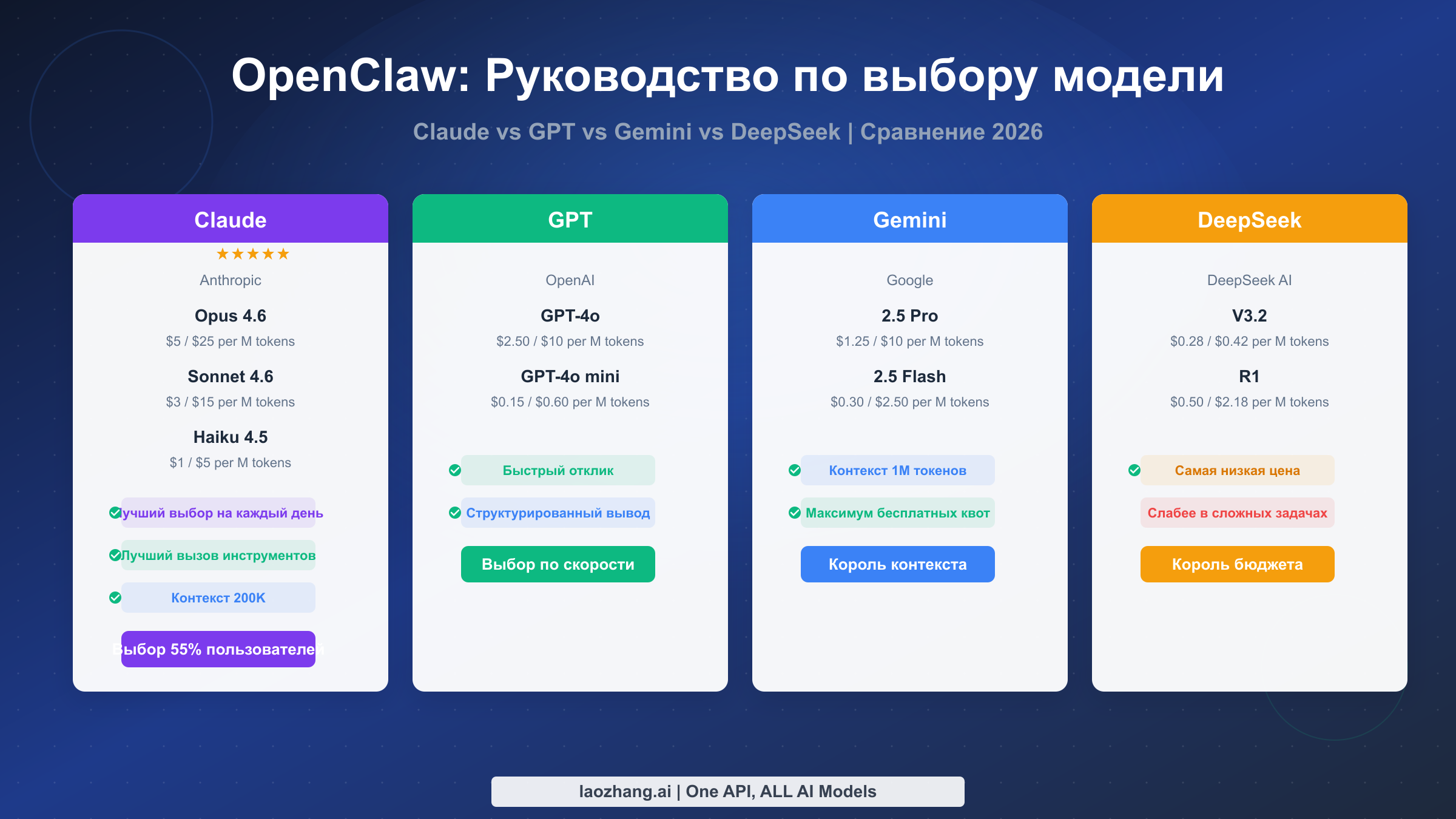

OpenClaw поддерживает более десяти ИИ-моделей, включая Claude, GPT, Gemini и DeepSeek, однако при таком изобилии выбора большинство пользователей задаётся одним и тем же вопросом: какую модель мне использовать? Claude Sonnet 4.6 (ввод $3, вывод $15/M tokens) — оптимальная отправная точка для большинства повседневных задач, а DeepSeek V3.2 (ввод $0.28, вывод $0.42/M tokens) — выгодный выбор при ограниченном бюджете. В этой статье, основанной на актуальных данных марта 2026 года, сравниваются цены, производительность и практические методы настройки 9 популярных моделей, чтобы помочь вам сделать оптимальный выбор.

Что такое OpenClaw и почему выбор модели определяет качество работы

OpenClaw — это платформа персонального ИИ-ассистента с открытым исходным кодом, разрабатываемая сообществом. Её главная цель — позволить пользователям подключать собственные API-ключи от ведущих провайдеров моделей и выполнять повседневные задачи, писать код, создавать контент и решать сложные аналитические задачи в едином интерфейсе. В отличие от закрытых платформ вроде ChatGPT или Claude.ai, управляемых одним поставщиком, главное преимущество OpenClaw — мультимодельная архитектура. Вы можете свободно переключаться между Claude от Anthropic, GPT от OpenAI, Gemini от Google, моделями DeepSeek с открытым исходным кодом и даже локально развёрнутыми моделями Llama через Ollama — всё это управляется через единый формат конфигурации provider/model (например, anthropic/claude-sonnet-4-6).

Выбор модели критически важен для качества работы с OpenClaw, поскольку разные модели существенно различаются по способности к рассуждению, скорости отклика, стабильности вызова инструментов и цене. Например, если ваша основная потребность — ежедневная обработка почты, ответы на вопросы и управление календарём, использование Claude Opus 4.6 (цена вывода $25/M tokens) — это как ездить на Ferrari за продуктами: производительность избыточна, а расходы неоправданно высоки. Claude Sonnet 4.6 или GPT-4o прекрасно справятся с этими задачами, снизив ежемесячные расходы с $200 до $15-30. И наоборот, если вам нужно провести многофайловый рефакторинг архитектуры или решить сложную многошаговую задачу, использование лёгкой модели вроде DeepSeek V3.2 окажется дешёвым, но качество результата может не удовлетворить требованиям. SaaS-версия OpenClaw была официально запущена 28 февраля 2026 года (репозиторий GitHub: github.com/openclaw/openclaw) с поддержкой использования прямо в браузере, что ещё больше снизило порог входа.

Для русскоязычных пользователей это руководство является наиболее полным справочником по выбору моделей в OpenClaw. В англоязычном сообществе уже есть несколько обзорных статей, но им не хватает информации о прокси-решениях для API и рекомендаций по локализованной настройке, которые важны для пользователей из разных регионов. Далее мы рассмотрим выбор оптимальной комбинации моделей по трём направлениям: цена, производительность и сценарии использования.

Полное сравнение цен 9 популярных моделей в 2026 году

При выборе ИИ-модели цена часто становится первым критерием отбора. Таблица ниже содержит актуальные данные о ценах 9 основных моделей, поддерживаемых OpenClaw. Все цены проверены по состоянию на 7 марта 2026 года, источниками являются официальные страницы тарифов производителей. Важно учитывать, что ИИ-модели используют систему двойного ценообразования «ввод/вывод»: текст, отправляемый модели, тарифицируется по цене ввода, а сгенерированный ответ — по цене вывода. Цена вывода обычно в 2-5 раз выше цены ввода, поэтому именно она является ключевым фактором, определяющим ежемесячные расходы.

| Модель | Провайдер | Цена ввода | Цена вывода | Контекстное окно | Примерные расходы в месяц |

|---|---|---|---|---|---|

| Claude Opus 4.6 | Anthropic | $5/M | $25/M | 200K | $80-200 |

| Claude Sonnet 4.6 | Anthropic | $3/M | $15/M | 200K | $15-50 |

| Claude Haiku 4.5 | Anthropic | $1/M | $5/M | 200K | $3-15 |

| GPT-4o | OpenAI | $2.50/M | $10/M | 128K | $10-40 |

| GPT-4o mini | OpenAI | $0.15/M | $0.60/M | 128K | $1-5 |

| Gemini 2.5 Pro | $1.25/M | $10/M | 1M | $10-40 | |

| Gemini 2.5 Flash | $0.30/M | $2.50/M | 1M | $2-10 | |

| DeepSeek R1 | DeepSeek | $0.50/M | $2.18/M | 64K | $3-15 |

| DeepSeek V3.2 | DeepSeek | $0.28/M | $0.42/M | 64K | $2-8 |

Из таблицы видно впечатляющий разброс цен: самый дорогой Claude Opus 4.6 стоит почти в 60 раз дороже самого дешёвого DeepSeek V3.2 по цене вывода. Однако низкая цена не равна выгоде — DeepSeek V3.2 отлично справляется с простой классификацией и базовыми вопросами, но при решении задач глубокого рассуждения, таких как проектирование архитектуры, точность и качество результата заметно уступают Opus. Ежемесячные расходы рассчитаны для типичного индивидуального пользователя с 10-30 задачами в день; фактическая стоимость зависит от частоты использования и количества токенов в каждом диалоге. Подробный анализ ценообразования моделей Claude доступен в полном руководстве по ценам и подписке Claude Opus 4.6.

Для пользователей, которым неудобно напрямую работать с зарубежными API, прокси-платформы вроде laozhang.ai предлагают доступ ко всем моделям с ценами на уровне основных платформ, избавляя от проблем с международными платежами и сетевым подключением. При регистрации предоставляется бесплатный стартовый баланс (подробнее на https://docs.laozhang.ai/ ).

Подробный обзор пяти семейств моделей

Разобравшись с ценами, ещё важнее понять ключевые преимущества и границы применимости каждого семейства моделей. Модели, поддерживаемые OpenClaw, можно объединить в пять семейств, каждое со своим «характером». Правильный выбор семейства важнее, чем выбор конкретной версии.

Семейство Claude (Anthropic)

Claude — самое популярное семейство моделей в сообществе OpenClaw: около 55% активных пользователей выбирают Claude в качестве модели по умолчанию. Это не случайно — стабильность вызова инструментов (tool use) у Claude лучше всех среди доступных моделей, что критически важно для ИИ-ассистента вроде OpenClaw, который постоянно обращается к внешним инструментам. Opus 4.6 — сильнейшая модель рассуждения на данный момент, подходящая для проектирования архитектуры, аудита безопасности и сложных многошаговых задач. Sonnet 4.6 сохраняет высокое качество при снижении стоимости на 60% по сравнению с Opus и является лучшим балансом для повседневной работы. Haiku 4.5 подходит для фоновой пакетной обработки и простых задач классификации. Единое контекстное окно 200K у всего семейства Claude означает, что вы можете обрабатывать большие объёмы кода или длинные документы в одном диалоге. Если вы хотите подробнее узнать об использовании Opus в OpenClaw, прочитайте полное руководство по использованию Claude Opus 4.6 в OpenClaw.

Семейство GPT (OpenAI)

GPT-4o — флагманская мультимодальная модель OpenAI. Её главные преимущества — высокая скорость отклика и отличная способность к структурированному выводу. Если ваш рабочий процесс требует от модели быстрого возврата данных в формате JSON, надёжность GPT-4o немного превосходит другие модели. GPT-4o mini — одна из самых выгодных лёгких моделей на рынке с ценой вывода всего $0.60/M tokens, идеально подходящая для высокочастотных задач низкой сложности. Однако в стабильности вызова инструментов семейство GPT немного уступает Claude — иногда возникают ошибки в формате параметров.

Семейство Gemini (Google)

Два главных конкурентных преимущества Gemini — огромное контекстное окно и бесплатные квоты. Gemini 2.5 Pro поддерживает контекстное окно до 1 миллиона токенов — это в 5 раз больше, чем у Claude. Когда нужно проанализировать целый репозиторий кода или сверхдлинный документ в одном диалоге, Gemini — единственный вариант. Gemini 2.5 Flash предлагает отличную скорость и доступную цену для сценариев, требующих быстрого отклика. Google AI Studio также предоставляет весьма щедрые бесплатные квоты, что делает его отличным стартовым выбором для пользователей с ограниченным бюджетом.

Семейство DeepSeek

DeepSeek — модель с открытым исходным кодом, разработанная китайской командой. Её главное преимущество — крайне низкая цена. Цена вывода V3.2 составляет всего $0.42/M tokens — в 60 раз дешевле Claude Opus, что делает её идеальной для пакетной обработки простых задач. R1 — улучшенная версия DeepSeek для рассуждений, демонстрирующая отличные результаты в математике и логике при цене вывода $2.18/M tokens, что всё ещё значительно ниже аналогичных моделей Claude или GPT. Стоит отметить, что при выполнении сложных многошаговых задач с вызовом инструментов стабильность и точность моделей DeepSeek заметно уступают Claude, поэтому их лучше использовать как вспомогательные, а не основные модели.

Локальные модели (Ollama)

Для пользователей со строгими требованиями к конфиденциальности данных или необходимостью автономной работы OpenClaw поддерживает подключение локально развёрнутых моделей с открытым исходным кодом через Ollama, например Llama 3.3 (версии 70B и 7B). Расходы на API для локальных моделей равны нулю, но требуется собственное оборудование — для запуска модели с 70B параметрами необходимо не менее 48 ГБ оперативной памяти (рекомендуется дискретный GPU), а для модели 7B достаточно 16 ГБ. По способности к рассуждению локальные модели не могут сравниться с облачными Opus или GPT-4o, но для простой обработки текста и автодополнения кода их вполне достаточно, при этом ваши данные никогда не покинут локальную машину.

Бесплатные варианты: как использовать OpenClaw без затрат

Ограниченный бюджет не означает невозможность использования OpenClaw. Грамотно комбинируя бесплатные ресурсы, вы вполне можете пользоваться основными функциями OpenClaw при нулевых затратах. На данный момент существует три основных способа бесплатного использования, каждый со своими сценариями и ограничениями.

Первый способ — использование бесплатных API-квот от провайдеров. API Gemini от Google через AI Studio предоставляет наиболее щедрые бесплатные квоты, включая ограниченный бесплатный доступ к Gemini 2.5 Flash и 2.5 Pro. OpenAI предоставляет новым пользователям определённый объём бесплатных API-кредитов, обычно достаточный для ознакомления. Anthropic иногда тоже предоставляет бесплатные пробные квоты, но в ограниченном количестве. Настройка бесплатных API-ключей в OpenClaw очень проста: достаточно ввести API Key соответствующего провайдера в настройках и выбрать поддерживаемую бесплатную модель.

Второй способ — развёртывание локальной модели. Запуск Llama 3.3 7B или другой лёгкой модели с открытым исходным кодом через Ollama на локальной машине полностью бесплатен с точки зрения API. Настройка также проста: после установки Ollama укажите в OpenClaw provider ollama, а в качестве модели — имя локальной модели (например, ollama/llama3.3). Условие — наличие как минимум 16 ГБ оперативной памяти и готовность принять ограничения локальных моделей в плане качества рассуждений. Для повседневных вопросов, суммаризации документов и простой генерации кода локальная модель 7B показывает приемлемые результаты.

Третий способ — гибридная стратегия: использование бесплатного API Gemini для большинства повседневных задач и переключение на платную модель, когда требуется более мощное рассуждение. Такой подход позволяет удерживать ежемесячные расходы в пределах $5, покрывая более 90% сценариев использования. Функция переключения моделей в OpenClaw делает реализацию этой стратегии очень удобной — вы можете в любой момент сменить provider прямо в диалоге.

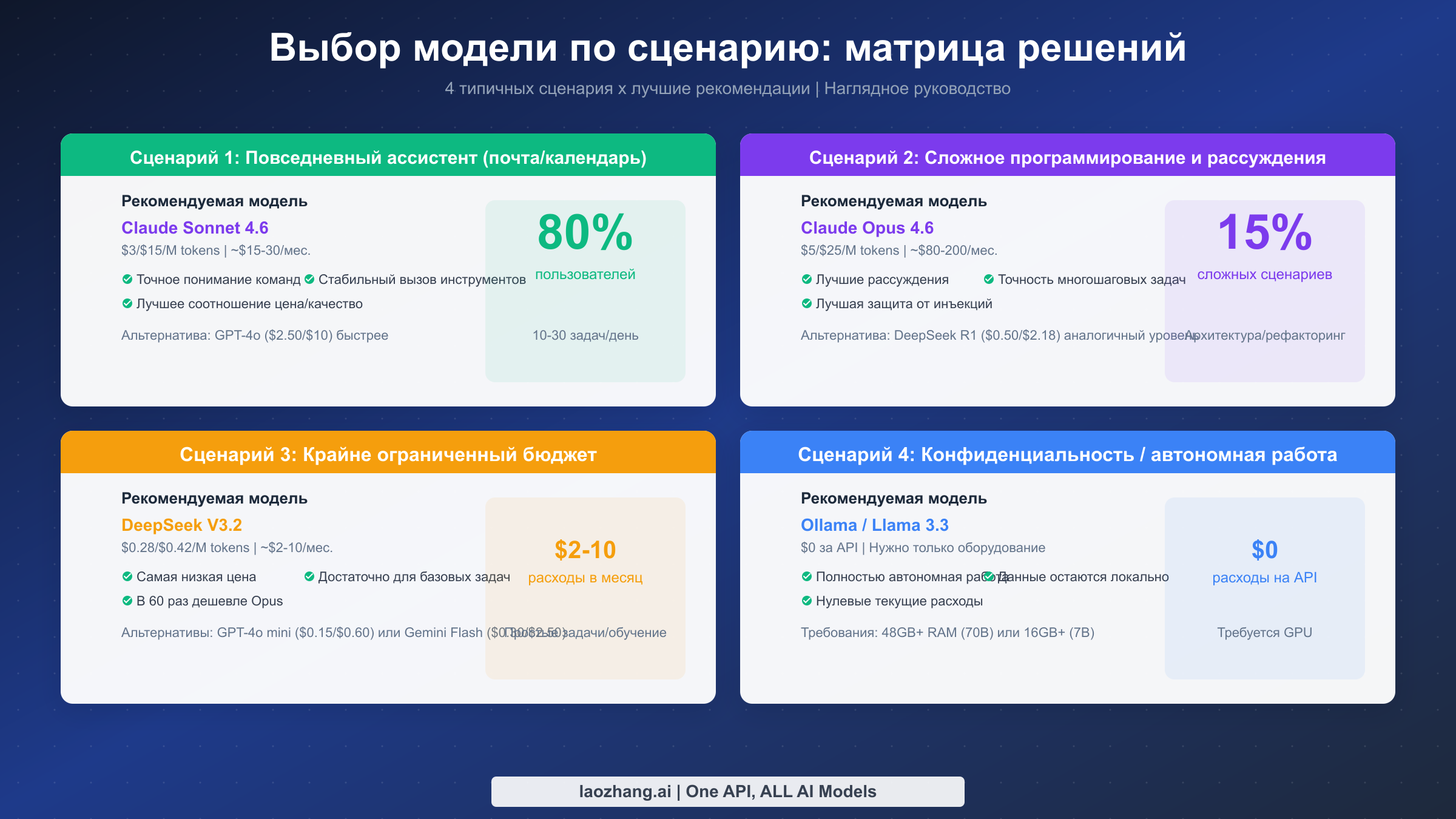

Рекомендации по сценариям: матрица выбора модели по потребностям

Зная цену и особенности каждой модели, самый практичный вопрос: какую модель выбрать для моего сценария? Следующие четыре типичных сценария охватывают более 95% потребностей пользователей OpenClaw, для каждого указана рекомендуемая и альтернативная модель.

Сценарий 1: Повседневный ассистент (почта, календарь, ответы на вопросы) — рекомендуется Claude Sonnet 4.6

Это основной сценарий для 80% пользователей. Задачи повседневного ассистента характеризуются высокой частотой, средней сложностью и определёнными требованиями к скорости отклика. Claude Sonnet 4.6 демонстрирует наиболее сбалансированные результаты в этом сценарии: точное понимание инструкций, стабильный вызов инструментов, конкурентная цена вывода $15/M tokens среди моделей среднего уровня. При 10-30 задачах в день ежемесячные расходы составят около $15-30. Если для вас важнее скорость отклика, GPT-4o ($2.50/$10) — достойная альтернатива, особенно при управлении календарём и структурировании данных.

Сценарий 2: Сложное программирование и глубокие рассуждения — рекомендуется Claude Opus 4.6

Когда необходимо проектирование архитектуры, многофайловый рефакторинг, аудит безопасности или сложные многошаговые рассуждения, Claude Opus 4.6 — самый надёжный выбор на данный момент. Он также лидирует среди всех моделей по устойчивости к инъекциям промптов (prompt injection resistance), что особенно важно для задач автоматизации с обработкой ненадёжных входных данных. Хотя цена вывода Opus достигает $25/M tokens, в задачах высокой ценности стоимость одного ошибочного архитектурного решения многократно превышает разницу в стоимости моделей. При ограниченном бюджете, но потребности в мощном рассуждении, интересной альтернативой является DeepSeek R1 ($0.50/$2.18) — его результаты в математических рассуждениях и логическом анализе приближаются к уровню Opus, но цена составляет лишь 1/12.

Сценарий 3: Крайне ограниченный бюджет — рекомендуется DeepSeek V3.2

Если ваш ежемесячный бюджет на ИИ не превышает $10, DeepSeek V3.2 — самый прагматичный выбор. Цена вывода $0.42/M tokens означает, что даже при интенсивном ежедневном использовании ежемесячные расходы вряд ли превысят $8. V3.2 показывает хорошие результаты в базовых вопросах и ответах, суммаризации текста и простой генерации кода. Хотя в сложных задачах рассуждения разрыв с Claude или GPT заметен, для студентов или пользователей с невысокой нагрузкой этого вполне достаточно. Альтернативы: GPT-4o mini ($0.15/$0.60, быстрее) и Gemini 2.5 Flash ($0.30/$2.50, больший контекст).

Сценарий 4: Приоритет конфиденциальности или автономная работа — рекомендуется Ollama + Llama 3.3

Для корпоративных пользователей, работающих с конфиденциальными данными, или сценариев без доступа к интернету локальное развёртывание Llama 3.3 через Ollama — единственный реальный вариант. Расходы на API равны нулю, данные полностью остаются на локальной машине, но требуется собственное оборудование: модель с 70B параметрами — минимум 48 ГБ оперативной памяти, модель 7B — минимум 16 ГБ. Способность к рассуждению локальных моделей не сравнится с лучшими облачными моделями, но для обработки документов, автодополнения кода и базовых диалогов их уже достаточно.

Многомодельная маршрутизация на практике: одна конфигурация экономит 70% затрат

Рекомендации по сценариям решают вопрос «какую модель использовать», но настоящие мастера оптимизации затрат не ограничиваются одной моделью — они динамически переключаются между моделями в зависимости от сложности задачи. В этом суть стратегии многомодельной маршрутизации: распределять подходящие задачи подходящим моделям, обеспечивая качество и контролируя расходы.

Трёхуровневая архитектура маршрутизации — это проверенная сообществом лучшая практика, разделяющая все задачи на три уровня, каждый из которых обслуживается своей моделью. Первый уровень — передовая модель (около 15% задач): Claude Opus 4.6 для проектирования архитектуры, многофайлового рефакторинга и операций, чувствительных к безопасности. Второй уровень — сбалансированная модель (около 55% задач): Claude Sonnet 4.6 для повседневной генерации кода, создания контента и общих вопросов. Третий уровень — лёгкая модель (около 30% задач): DeepSeek V3.2 для мониторинга состояния, простой классификации и базовой автоматизации. Благодаря такому разделению ежемесячные расходы снижаются с $200+ (при использовании только Opus) до $30-70, экономия составляет более 65%, практически без ущерба качеству выполнения задач.

Настройка многомодельной маршрутизации в OpenClaw не представляет сложности. Вот типичный пример конфигурации трёхуровневой маршрутизации:

json{ "models": { "tier1_frontier": { "provider": "anthropic", "model": "claude-opus-4-6", "usage": "Проектирование архитектуры, аудит безопасности, сложные рассуждения" }, "tier2_balanced": { "provider": "anthropic", "model": "claude-sonnet-4-6", "usage": "Повседневное программирование, создание контента, общие вопросы" }, "tier3_budget": { "provider": "deepseek", "model": "deepseek-v3", "usage": "Простая классификация, проверка состояния, пакетная обработка" } }, "default": "tier2_balanced" }

На практике вы можете назначить модель по умолчанию для разных рабочих пространств или проектов в интерфейсе настроек OpenClaw, а также переключать модели вручную прямо в диалоге. Более продвинутый вариант — использование функции пользовательской конфигурации моделей OpenClaw для установки правил выбора модели по типу задачи. Подробное описание настройки пользовательских моделей можно найти в руководстве по настройке пользовательских моделей OpenClaw. Если вас интересует мониторинг потребления токенов и техники контроля расходов, рекомендуем прочитать полное руководство по управлению токенами и оптимизации затрат в OpenClaw.

Важно подчеркнуть, что суть стратегии маршрутизации — не «использовать максимально дешёвую модель», а «подобрать наиболее подходящую модель для каждой задачи». Если отдать задачу глубокого рассуждения лёгкой модели, разовая стоимость будет низкой, но если из-за недостаточного качества потребуется многократная переделка, общие затраты могут оказаться даже выше. Хорошая стратегия маршрутизации находит оптимальный баланс между качеством и стоимостью.

API-прокси и оптимизация затрат

Для пользователей, не имеющих прямого доступа к API Anthropic, OpenAI или Google, существуют две основные проблемы: нестабильное соединение из-за сетевых ограничений и барьеры международных платежей. API-прокси-платформы созданы именно для решения этих задач — они разворачивают серверы за рубежом для подключения к API провайдеров и предоставляют переадресацию через доступные домены, так что пользователю достаточно указать API-эндпоинт (base URL) OpenClaw на прокси-платформу.

Одна из популярных прокси-платформ — laozhang.ai, агрегирующая модели Claude, GPT, Gemini, DeepSeek и другие. Цены на текстовые модели в основном совпадают с ценами ведущих платформ. Настройка в OpenClaw проста: зарегистрируйтесь на laozhang.ai и получите API Key (бесплатный стартовый баланс при регистрации, минимальное пополнение от $5), затем в настройках модели OpenClaw укажите base URL на API-эндпоинт laozhang.ai и введите полученный API Key. После настройки вы сможете беспрепятственно использовать все поддерживаемые модели в OpenClaw.

Помимо решения проблемы доступа, прокси-платформы предлагают дополнительное преимущество: единый биллинг и управление. Не нужно регистрироваться отдельно в Anthropic, OpenAI, Google и DeepSeek и привязывать разные способы оплаты — достаточно пополнить баланс на одной платформе для использования всех моделей, что значительно упрощает управление. Полная документация API laozhang.ai доступна по адресу https://docs.laozhang.ai/.

Для оптимизации затрат, помимо описанной выше стратегии многомодельной маршрутизации, можно применять дополнительные приёмы: использование API в непиковые часы обычно обеспечивает более быстрый отклик и высокую надёжность; разумная настройка параметра max_tokens помогает избежать лишнего потребления токенов; для повторяющихся запросов реализация простого механизма кэширования на уровне приложения может значительно сократить частоту обращений к API.

Часто задаваемые вопросы

Какую модель в OpenClaw рекомендуется использовать?

Для большинства пользователей Claude Sonnet 4.6 — лучшая модель по умолчанию. Она обеспечивает оптимальный баланс между пониманием инструкций, стабильностью вызова инструментов и качеством вывода, а ежемесячные расходы $15-30 находятся в разумных пределах для индивидуального использования. Если ваша основная потребность — сложное программирование и проектирование архитектуры, рекомендуется установить Sonnet 4.6 по умолчанию и при необходимости переключаться на Opus 4.6 для особо сложных задач.

Хорошо ли работают модели DeepSeek в OpenClaw?

DeepSeek V3.2 и R1 полноценно работают в OpenClaw, а их ценовое преимущество весьма значительно. V3.2 подходит для простых задач и сценариев с ограниченным бюджетом, R1 отлично показывает себя в математических рассуждениях. Однако следует учитывать, что стабильность моделей DeepSeek в сложных многошаговых задачах с вызовом инструментов уступает Claude — иногда возникают ошибки формата или пропуск параметров. Рекомендуется использовать DeepSeek как вспомогательную, а не основную модель.

Можно ли использовать несколько моделей одновременно в OpenClaw?

Да. Мультимодельная поддержка — ключевой принцип проектирования OpenClaw. Вы можете назначить разные модели по умолчанию для различных рабочих пространств, а также переключаться между моделями прямо в процессе диалога. Именно это лежит в основе стратегии многомодельной маршрутизации — в рамках одного рабочего процесса динамически выбирать наиболее подходящую модель в зависимости от сложности задачи.

Достаточно ли качества бесплатных моделей?

Зависит от ваших потребностей. Бесплатные квоты Google Gemini неплохо справляются с повседневными вопросами и суммаризацией документов, а локально развёрнутая Llama 3.3 7B способна обрабатывать базовое автодополнение кода и генерацию текста. Однако для сложных рассуждений, многошаговых вызовов инструментов или создания высококачественного контента возможности бесплатных моделей имеют заметные ограничения. Рекомендуемая стратегия — использовать бесплатные модели для простых задач и подключать платные для критически важных, удерживая ежемесячные расходы в пределах $5-10.

Как оценить свои ежемесячные расходы на API?

Простой метод оценки: подсчитайте, сколько ИИ-диалогов вы проводите ежедневно и сколько сообщений содержит каждый диалог. Например, при использовании Claude Sonnet 4.6 каждое сообщение потребляет примерно 1 000-3 000 токенов вывода (в зависимости от длины ответа). При 20 диалогах в день по 3 сообщения получится около 120 000 токенов вывода в день, или примерно 3.6M токенов в месяц, что соответствует стоимости около $54. При использовании стратегии многомодельной маршрутизации с перенаправлением 30% простых задач на DeepSeek V3.2 ежемесячные расходы снизятся примерно до $35.

Нужен ли VPN для использования OpenClaw?

Использование самой платформы OpenClaw не требует VPN, однако прямые вызовы зарубежных API (Anthropic, OpenAI) требуют стабильного сетевого подключения. Решение — использование API-прокси-платформы, например laozhang.ai, которая перенаправляет API-запросы через доступные домены, позволяя использовать все модели без дополнительных сетевых инструментов.