Краткое содержание

API Nano Banana Pro имеет три типа ограничений, каждый с отдельным решением. Лимиты частоты запросов (ограничение 250 RPD) снимаются подключением биллинга Google Cloud или использованием стороннего провайдера, например laozhang.ai ($0,05 за изображение, без лимитов). Фильтры безопасности (Layer 1) настраиваются на BLOCK_NONE через параметр safety_settings API — это официальная и документированная возможность. Политика контента (Layer 2 IMAGE_SAFETY) не может быть отключена ни через какой параметр API — вместо этого используйте инженерию промптов и стратегии повторных попыток. По состоянию на март 2026 года бесплатного уровня API для Nano Banana Pro не существует.

Nano Banana Pro (Gemini 3 Pro Image) — самая мощная модель генерации изображений от Google, но получить к ней доступ без ограничений сложнее, чем утверждают большинство руководств. Термин «неограниченный» на самом деле охватывает три отдельных измерения — лимиты частоты запросов, фильтры безопасности и политику контента — и для каждого требуется свой подход. По состоянию на март 2026 года бесплатный уровень API предоставляет ноль запросов в день, платный уровень ограничен 250 RPD, а даже при подключённом биллинге двухуровневая система фильтров безопасности может блокировать легитимный контент без объяснения причин. Это руководство подробно разбирает каждое измерение ограничений, предоставляет рабочий код для настройки того, что можно контролировать, и объясняет честные стратегии для того, что контролировать невозможно.

Что на самом деле означает «неограниченный доступ» к Nano Banana Pro API

Когда разработчики ищут «неограниченный доступ к API Nano Banana Pro», они обычно подразумевают одно из трёх принципиально разных понятий — и смешение этих понятий приводит к часам бесполезной отладки. Понимание того, с каким именно измерением ограничения вы имеете дело — это самый важный шаг к решению проблемы, потому что исправление для лимитов частоты запросов совершенно отличается от исправления для блокировок фильтров безопасности, которое в свою очередь совершенно отличается от подхода, необходимого для неконфигурируемого применения политики контента.

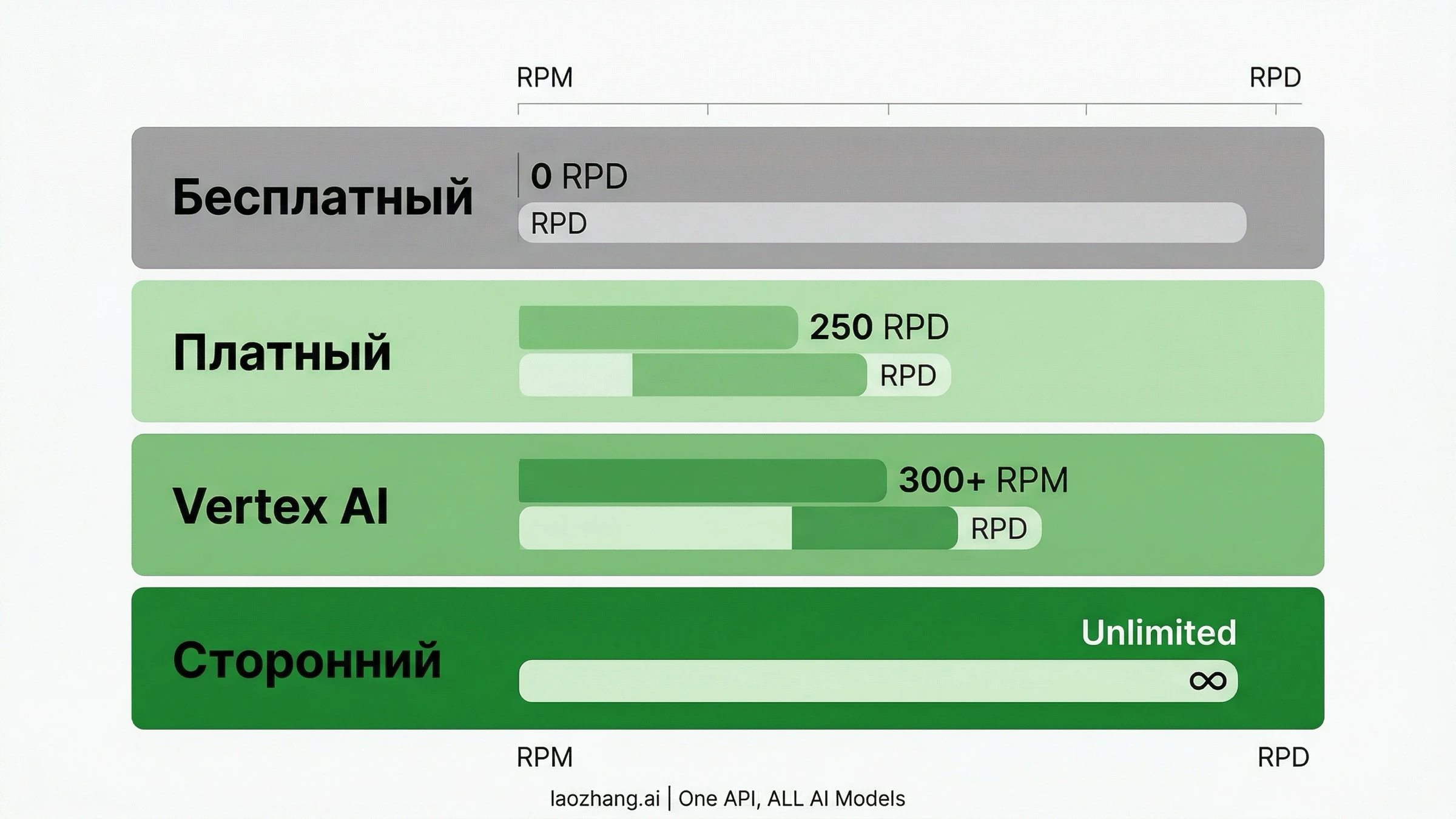

Измерение 1: Лимиты частоты запросов контролируют, сколько запросов вы можете отправлять в минуту (RPM) и в день (RPD). API Nano Banana Pro вообще не имеет бесплатного уровня — ноль запросов в день для неоплаченных аккаунтов (ai.google.dev, март 2026). Даже при подключённом биллинге Paid Tier 1 ограничивает вас до 20 RPM и 250 RPD. Это наиболее простое ограничение для снятия: вы подключаете биллинг и, возможно, переходите на Vertex AI для более высоких квот. Решение является чисто финансовым и административным.

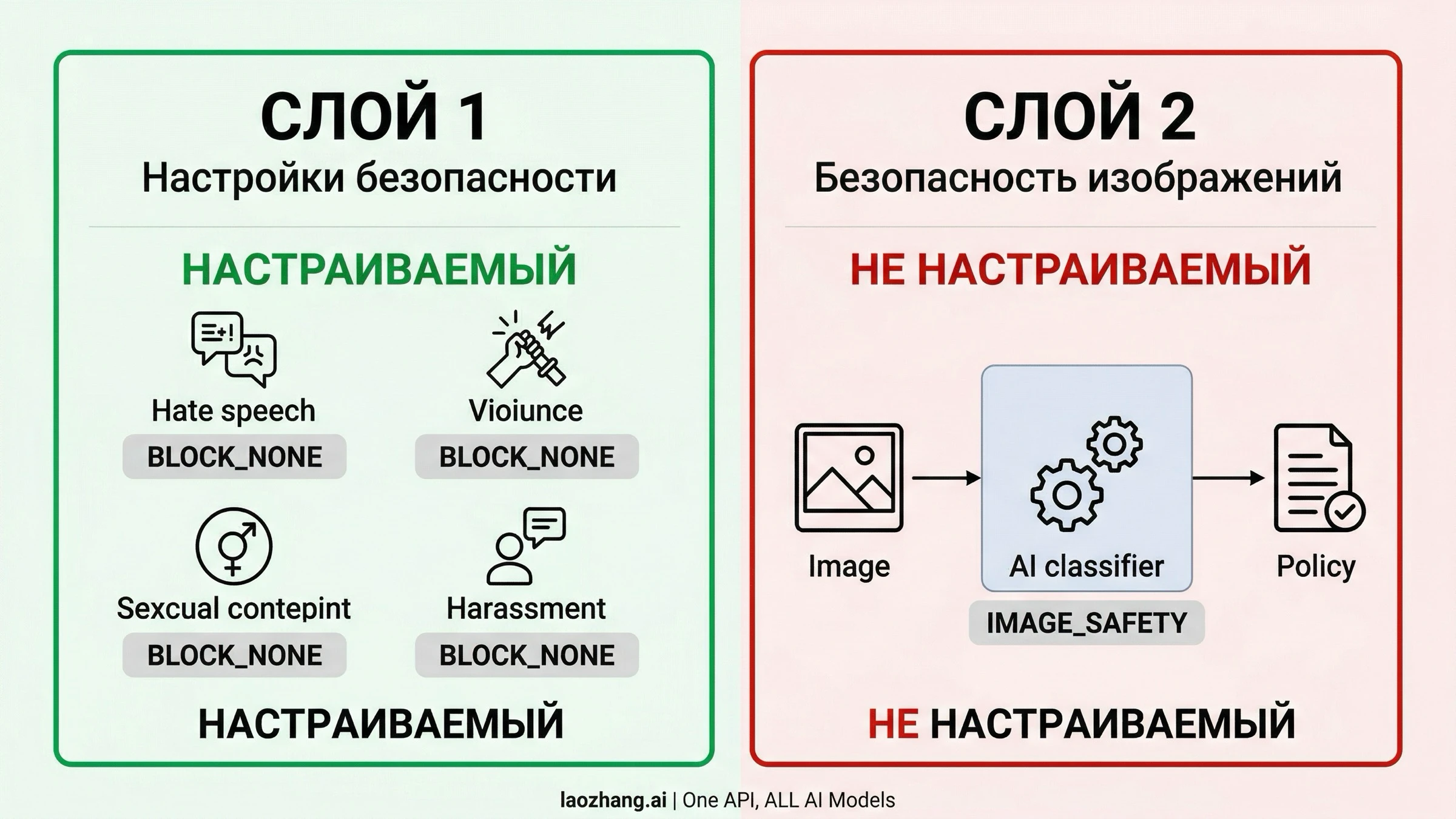

Измерение 2: Фильтры безопасности — это конфигурируемый Layer 1 системы безопасности. API Gemini предоставляет четыре категории вредоносного контента — притеснение, разжигание ненависти, откровенно сексуальный контент и опасный контент — и вы можете установить каждую на BLOCK_NONE через параметр safety_settings. Когда Layer 1 блокирует ваш запрос, API возвращает finishReason: "SAFETY" в ответе. Именно на этот слой фокусируется большинство руководств по «неограниченному доступу», и настройка BLOCK_NONE является как легитимной, так и хорошо документированной Google.

Измерение 3: Политика контента — это неконфигурируемый Layer 2. Именно здесь разочарование достигает пика. Даже после установки всех категорий безопасности на BLOCK_NONE API всё равно может отклонить ваш запрос с finishReason: "IMAGE_SAFETY" или blockReason: "OTHER". Эти серверные фильтры используют ИИ-классификацию изображений, сопоставление хешей и автоматическое применение политик, которые не может отключить ни один параметр API. Понимание этого различия избавляет разработчиков от бесконечной настройки параметров безопасности, когда блокировка исходит от совершенно другой системы.

Путаница между этими тремя измерениями — главная причина, по которой разработчики тратят время на неэффективные решения. Установка BLOCK_NONE не увеличит ваш лимит в 250 RPD. Подключение биллинга не предотвратит блокировки IMAGE_SAFETY. И никакая инженерия промптов не преодолеет нулевой RPD бесплатного уровня. Каждое измерение имеет конкретный путь решения, и применение неправильного исправления к неправильной проблеме — самый распространённый паттерн разочарования в сообществе разработчиков Nano Banana Pro, что подтверждается сотнями обсуждений на Reddit, в Google Help Community и на Stack Overflow.

Понимание этой структуры также проясняет, что именно предлагают сторонние провайдеры «неограниченного» доступа. Когда сервис рекламирует «неограниченный доступ к Nano Banana Pro», он почти всегда имеет в виду снятие лимитов частоты запросов и снижение стоимости (Измерение 1), иногда улучшенную конфигурацию Layer 1 (Измерение 2), но редко какие-либо изменения в политике контента Layer 2 (Измерение 3). Зная, какое измерение адресует провайдер, вы сможете оценить, решает ли его сервис именно вашу конкретную проблему.

Далее в этом руководстве мы рассмотрим каждое измерение последовательно, начиная с того, что вы можете полностью контролировать, и переходя к стратегиям для того, что контролировать невозможно.

Двухуровневая архитектура безопасности Nano Banana Pro

Самая распространённая ошибка разработчиков при работе с Nano Banana Pro — воспринимать систему безопасности как один переключатель. В действительности Google построил многоуровневую архитектуру, где разные компоненты служат разным целям и управляются разными средствами. Понимание этой архитектуры необходимо до написания какого-либо кода, потому что сообщения об ошибках от каждого уровня выглядят похоже, но требуют совершенно разных ответных действий.

Layer 1 работает через параметр safety_settings в вашем API-запросе. Он оценивает текстовый промпт по четырём категориям вредоносного контента, определённым Google: HARM_CATEGORY_HARASSMENT, HARM_CATEGORY_HATE_SPEECH, HARM_CATEGORY_SEXUALLY_EXPLICIT и HARM_CATEGORY_DANGEROUS_CONTENT. Для каждой категории вы можете установить порог от BLOCK_LOW_AND_ABOVE (максимально строгий) через BLOCK_MEDIUM_AND_ABOVE и BLOCK_ONLY_HIGH до BLOCK_NONE (минимально строгий). Когда Layer 1 блокирует запрос, ответ содержит finishReason: "SAFETY" вместе с рейтингами безопасности, которые точно указывают, какая категория вызвала блокировку и с каким уровнем уверенности. Эта прозрачность делает блокировки Layer 1 простыми для диагностики и устранения.

Layer 2 принципиально отличается. Он работает на стороне сервера после генерации изображения и использует ИИ-классификацию для сканирования самого выходного изображения — а не только текстового промпта. Этот слой проверяет на нарушения политики, включая контент, связанный с безопасностью детей (обязательная проверка, обход невозможен ни при каких обстоятельствах), известную интеллектуальную собственность и товарные знаки, реалистичные изображения идентифицируемых публичных персон и контент, нарушающий общую политику допустимого использования Google. Когда Layer 2 блокирует ваш запрос, вы видите finishReason: "IMAGE_SAFETY" или blockReason: "OTHER", и, что критически важно, ответ не предоставляет детальной разбивки по тому, что именно вызвало блокировку. При этом вам начисляется плата за токены, потреблённые во время генерации, даже когда результат заблокирован — это частый источник разочарования для разработчиков с высоконагруженными рабочими процессами.

Практическое влияние этой архитектуры становится очевидным при анализе потребления токенов. Каждый запрос к Nano Banana Pro, достигший Layer 2, уже потребил входные токены на обработку промпта и выходные токены на генерацию изображения. Когда затем Layer 2 блокирует результат, эти токены всё равно списываются с вашего аккаунта — вы платите за изображение, которое никогда не получите. При $0,134 за изображение 2K или $0,24 за изображение 4K процент блокировок IMAGE_SAFETY в 20% фактически увеличивает вашу стоимость за пригодное изображение на 25%. Это делает понимание и минимизацию блокировок Layer 2 не просто техническим вопросом, а прямым финансовым — особенно в продакшн-масштабе, где тысячи заблокированных запросов в день могут обойтись в сотни долларов потраченных впустую вычислительных ресурсов.

Существует также Layer 3 специально для PROHIBITED_CONTENT, который охватывает материалы сексуального насилия над детьми (CSAM) и аналогичные юридически обязательные ограничения. Этот слой абсолютен — никакая конфигурация, никакой обходной путь, никакой сторонний провайдер не может его обойти. Он существует во всех сервисах генерации изображений ИИ и не подлежит обсуждению. Для более глубокого изучения каждого кода ошибки и шаблона ответа смотрите наше полное руководство по фильтрам безопасности.

Как определить, какой уровень вас заблокировал

Поле ответа содержит всю необходимую информацию. Если вы видите finishReason: "SAFETY" с сопутствующими safetyRatings, Layer 1 заблокировал ваш промпт до генерации — измените настройки безопасности или перефразируйте запрос. Если вы видите finishReason: "IMAGE_SAFETY" без детальных рейтингов, Layer 2 обнаружил проблему в сгенерированном изображении — никакие настройки API не помогут, и вам нужны стратегии инженерии промптов. Если вы видите blockReason: "OTHER", это предгенерационная проверка политики, которую невозможно настроить. Обновление политики в марте 2026 года значительно расширило область применения blockReason: "OTHER", особенно для операций редактирования с участием людей — замена фона и модификация внешности.

Настройка BLOCK_NONE — полное руководство с кодом

Установка safety_settings на BLOCK_NONE — это наиболее эффективное единичное изменение, которое вы можете внести для уменьшения ненужных блокировок легитимного контента. Это официальный, документированный параметр API — не хак и не обходной путь. Google разработал его специально для разработчиков, создающих приложения, где порог классификации контента должен управляться на уровне приложения, а не на уровне API. Вот как это реализовать на каждом основном языке программирования.

Python (Google Generative AI SDK)

pythonimport google.generativeai as genai genai.configure(api_key="YOUR_API_KEY") model = genai.GenerativeModel("gemini-3-pro-image-preview") safety_settings = [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"}, ] response = model.generate_content( "A dramatic fantasy battle scene with warriors in dark armor", generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) # Check if image was generated successfully if response.candidates and response.candidates[0].content.parts: image_data = response.candidates[0].content.parts[0].inline_data with open("output.png", "wb") as f: f.write(image_data.data) else: # Check finish reason for debugging print(f"Blocked: {response.candidates[0].finish_reason}")

JavaScript / Node.js

javascriptimport { GoogleGenerativeAI } from "@google/generative-ai"; const genAI = new GoogleGenerativeAI("YOUR_API_KEY"); const model = genAI.getGenerativeModel({ model: "gemini-3-pro-image-preview", safetySettings: [ { category: "HARM_CATEGORY_HARASSMENT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_HATE_SPEECH", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_SEXUALLY_EXPLICIT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_DANGEROUS_CONTENT", threshold: "BLOCK_NONE" }, ], }); const result = await model.generateContent({ contents: [{ role: "user", parts: [{ text: "A dramatic fantasy battle scene" }] }], generationConfig: { responseMimeType: "image/png" }, }); const imageData = result.response.candidates?.[0]?.content?.parts?.[0]?.inlineData; if (imageData) { fs.writeFileSync("output.png", Buffer.from(imageData.data, "base64")); }

cURL (REST API)

bashcurl -X POST \ "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-image-preview:generateContent?key=YOUR_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "contents": [{"parts": [{"text": "A dramatic fantasy battle scene"}]}], "safetySettings": [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"} ], "generationConfig": {"responseMimeType": "image/png"} }'

Частый вопрос — нарушает ли использование BLOCK_NONE Условия обслуживания или грозит ли штрафными санкциями для аккаунта. Краткий ответ — нет. Google явно документирует этот параметр как вариант конфигурации для разработчиков. Более развёрнутый ответ связан с пониманием модели разделённой ответственности: устанавливая BLOCK_NONE, вы сообщаете Google, что ваше приложение будет обрабатывать классификацию контента и обеспечивать безопасность пользователей на уровне приложения. Вы остаётесь ответственным за то, что ваше приложение делает с сгенерированными изображениями, но сам факт настройки параметра API является санкционированным поведением. Это аналогично тому, как облачные провайдеры предоставляют root-доступ к виртуальным машинам — возможность предоставлена и документирована, а ответственность за надлежащее использование лежит на разработчике.

Стоит подчеркнуть, что BLOCK_NONE не означает «генерировать что угодно без ограничений». Это означает «не применять настраиваемые пороги категорий вредоносного контента». Проверки безопасности изображений Layer 2 и проверки запрещённого контента Layer 3 по-прежнему выполняются независимо от этой настройки. Практический эффект заключается в том, что промпты, включающие художественное насилие, драматические сцены, медицинские иллюстрации и аналогичный контент, который мог бы вызвать рейтинг безопасности средней уверенности, теперь будут успешно проходить через Layer 1. Пройдут ли они Layer 2, зависит от того, что фактически изображено на сгенерированном изображении, что оценивается отдельно системой классификации изображений Google.

Снятие лимитов частоты запросов — от 250 RPD до продакшн-масштаба

Вопрос лимитов частоты запросов стал первоначальной причиной, по которой термин «неограниченный доступ к API» стал актуальным для Nano Banana Pro. Тема в Google Help Community от декабря 2025 года — которая до сих пор занимает первое место по этому поисковому запросу — прекрасно отражает разочарование: бизнес-пользователь, упирающийся в стену 250 RPD без очевидного пути увеличения. По состоянию на март 2026 года ситуация прояснилась, и существует четыре различных уровня доступа с очень разными лимитами.

Бесплатный уровень предоставляет ровно ноль запросов в день для Nano Banana Pro через API. В отличие от стандартных текстовых моделей Gemini, предлагающих щедрые бесплатные квоты, модель генерации изображений требует платный аккаунт. Это подтверждается официальной страницей лимитов Google на ai.google.dev, где для Gemini 3 Pro Image Preview указан лимит в 2 000 000 токенов в день для платных аккаунтов и отсутствие записи для бесплатного уровня. Если вы получаете ошибки на аккаунте без подключённого биллинга — именно поэтому: бесплатного доступа к API этой модели не существует.

Paid Tier 1 активируется при привязке биллинг-аккаунта Google Cloud к вашему проекту AI Studio. Это немедленно предоставляет 20 RPM и 250 RPD, что означает примерно 250 изображений в день. Для индивидуальных разработчиков и небольших проектов этого достаточно для разработки и лёгкого продакшн-использования. Стоимость за изображение составляет $0,134 при разрешении 1K-2K и $0,24 при 4K (Vertex AI Pricing, март 2026). Для подключения биллинга перейдите в Google AI Studio, выберите ваш проект, откройте Настройки и привяжите биллинг-аккаунт. Ваш существующий API-ключ автоматически получит повышенные лимиты.

Доступ через Vertex AI — это корпоративный путь для рабочих нагрузок продакшн-масштаба. Через платформу Google Cloud Vertex AI вы можете получить доступ к Gemini 3 Pro Image со значительно более высокими лимитами — 300+ RPM с пользовательским RPD на основе вашего обязательного расхода. Vertex AI также предоставляет гарантии SLA, приоритетное выделение вычислительных ресурсов и выделенные мощности, которые не может обеспечить общий пул AI Studio. Цена за токен идентична, но уровень сервиса принципиально отличается. Вам понадобится проект Google Cloud с включённым Vertex AI API и ключ сервисного аккаунта вместо API-ключа AI Studio. Для полного описания каждого уровня и его квот смотрите наш подробный разбор лимитов.

Сторонние API-провайдеры представляют четвёртый путь, и для многих разработчиков это наиболее практичное решение проблемы лимитов. Сервисы вроде laozhang.ai маршрутизируют запросы через собственную инфраструктуру без ограничений RPM или RPD, фактически обеспечивая неограниченный доступ к той же базовой модели Gemini 3 Pro Image. Компромисс в том, что вы доверяете третьей стороне ваш API-трафик, и время отклика может варьироваться в зависимости от их балансировки нагрузки. Значительное ценовое преимущество — $0,05 за изображение любого разрешения против $0,134–$0,24 у официального API — делает этот путь привлекательным для высоконагруженных продакшн-задач, где стоимость важнее прямого SLA от Google.

Миграция с прямого API Google на стороннего провайдера обычно проста, потому что большинство провайдеров предоставляют OpenAI-совместимый эндпоинт или Gemini-совместимый проброс. Для laozhang.ai конкретно вы меняете базовый URL и API-ключ в существующем коде, сохраняя ту же конфигурацию safety_settings и формат промптов. Это означает, что ваши настройки BLOCK_NONE передаются в базовый вызов Google API, и вы получаете комбинированное преимущество снятия лимитов, снижения стоимости и того же контроля над настройками безопасности, что и при прямом доступе.

Стоит отметить различие между квотой запросов и пропускной способностью. Официальный лимит Paid Tier 1 в 250 RPD — это жёсткий дневной потолок: как только вы его достигнете, запросы будут отклоняться до следующего дня. Vertex AI и сторонние провайдеры вместо этого работают на моделях пропускной способности, где нет дневного потолка — только лимиты параллельных подключений. Для большинства продакшн-архитектур устойчивая пропускная способность важнее дневной квоты, и именно поэтому обозначение «неограниченный» у сторонних провайдеров практически значимо, хотя технически означает «без искусственного дневного лимита», а не «бесконечное количество одновременных запросов».

Снижение ложных срабатываний и обработка ошибок IMAGE_SAFETY

Даже после настройки BLOCK_NONE и подключения биллинга для повышения лимитов многие разработчики сталкиваются с постоянными блокировками от фильтра IMAGE_SAFETY уровня Layer 2. Эти блокировки особенно разочаровывают, потому что затрагивают полностью легитимные сценарии использования — фотографию товаров для электронной коммерции, архитектурную визуализацию, медицинские иллюстрации и художественный контент, в котором нет ничего сомнительного. Отсутствие детальной информации об ошибках от Layer 2 делает систематическую отладку сложной, но несколько стратегий доказали свою эффективность на практике.

Конкретность промпта снижает неоднозначность. Классификатор IMAGE_SAFETY с большей вероятностью отметит расплывчатые промпты, которые можно интерпретировать по-разному. Вместо «женщина в платье» укажите «профессиональная фэшн-модель в синем деловом платье в корпоративном офисе, стиль редакционной фотографии». Дополнительный контекст направляет и генерацию изображения, и классификатор безопасности к интерпретации, которая избегает ложных срабатываний. Подробные описания сцен, явное упоминание профессионального контекста и стилевые квалификаторы вроде «редакционный», «документальный» или «коммерческая фотография» помогают установить легитимность намерения.

Вариации разрешения и seed могут изменить результат. Поскольку IMAGE_SAFETY оценивает сгенерированное изображение, а не промпт, один и тот же промпт может давать разные результаты при разных попытках. Если конкретная генерация заблокирована, повторная попытка с другим случайным seed (путём небольшой модификации промпта или добавления безобидной детали) может дать приемлемый вариант. Некоторые разработчики сообщают, что генерация в 2K с последующим масштабированием даёт другие результаты оценки безопасности, чем прямая генерация в 4K, хотя это анекдотические данные, которые, вероятно, зависят от конкретного контента.

Обновление политики в марте 2026 года требует внимания. Google существенно ужесточил политики редактирования с участием людей с начала марта 2026 года. Операции, которые ранее работали — замена фона на фотографиях с людьми, компоновка групповых фото, модификация одежды или внешности человека — теперь часто возвращают blockReason: "OTHER" до начала генерации. Это ограничение на уровне политики, а не проблема фильтра безопасности, и оно применяется независимо от вашей конфигурации safety_settings. Практическое воздействие в том, что рабочие процессы, связанные с людьми при редактировании изображений, необходимо перепроектировать с учётом этих новых ограничений, возможно, отделяя человека от фона при предварительной обработке перед использованием API для генерации окружения.

Логика повторных попыток с экспоненциальной задержкой помогает. Для продакшн-систем реализация автоматических повторных попыток с небольшими вариациями промптов при блокировках IMAGE_SAFETY может значительно улучшить пропускную способность. Разумный паттерн: попытка генерации, при ошибке IMAGE_SAFETY добавление стилевого квалификатора и повтор, при второй ошибке небольшое изменение описания сцены и повтор, при третьей ошибке — логирование промпта для ручной проверки. Этот подход обычно обеспечивает 85–90% успешности для контента, который легитимно соответствует политике.

Отделяйте людей от генерации окружения. После ужесточения политики по редактированию с участием людей в марте 2026 года рабочие процессы, комбинирующие людей с модификацией окружения, имеют повышенную частоту блокировок. Более надёжная архитектура — предварительная обработка изображений для сегментации людей от фонов, использование API для генерации окружения или фона отдельно и последующая композиция результатов. Это полностью избегает проверок политики редактирования с участием людей, достигая того же творческого результата. Инструменты вроде SAM2 (Segment Anything Model 2) или rembg могут выполнить этап сегментации перед вашими вызовами API Nano Banana Pro.

Используйте негативные промпты стратегически. Хотя Nano Banana Pro не поддерживает явные негативные промпты так же, как Stable Diffusion, вы можете достичь аналогичного эффекта, точно описывая, что должно быть на изображении, и неявно исключая проблемные элементы. Фразы вроде «профессиональное студийное освещение», «чистый белый фон» и «стиль каталога товаров» создают контекст, который классификатор безопасности интерпретирует как коммерческий и легитимный, значительно снижая частоту ложных срабатываний по сравнению с неоднозначными художественными промптами.

Вот практическая реализация повторных попыток на Python, корректно обрабатывающая блокировки IMAGE_SAFETY:

pythonimport time import random def generate_with_retry(model, prompt, safety_settings, max_retries=3): """Generate image with automatic retry on IMAGE_SAFETY blocks.""" style_qualifiers = [ ", professional photography style", ", editorial magazine quality, studio lighting", ", commercial product photography, clean composition", ] for attempt in range(max_retries): modified_prompt = prompt + (style_qualifiers[attempt] if attempt > 0 else "") try: response = model.generate_content( modified_prompt, generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) if response.candidates and response.candidates[0].content.parts: return response.candidates[0].content.parts[0].inline_data finish_reason = response.candidates[0].finish_reason if response.candidates else "UNKNOWN" if finish_reason == "IMAGE_SAFETY": print(f"Attempt {attempt + 1}: IMAGE_SAFETY block, retrying with modifier...") time.sleep(2 ** attempt + random.random()) continue else: print(f"Blocked by: {finish_reason}") return None except Exception as e: print(f"API error: {e}") time.sleep(2 ** attempt) print(f"All {max_retries} attempts failed for prompt") return None

Сторонние API-провайдеры — что они реально меняют

Рынок стороннего доступа к API Nano Banana Pro стремительно вырос с момента выпуска модели — провайдеры вроде laozhang.ai, Kie.ai, EvoLink и другие предлагают ту же базовую модель по значительно более низким ценам. Однако заявления о «неограниченном» или «нецензурированном» доступе от некоторых провайдеров заслуживают тщательной проверки, потому что то, что сторонние провайдеры могут и не могут изменить, часто искажается.

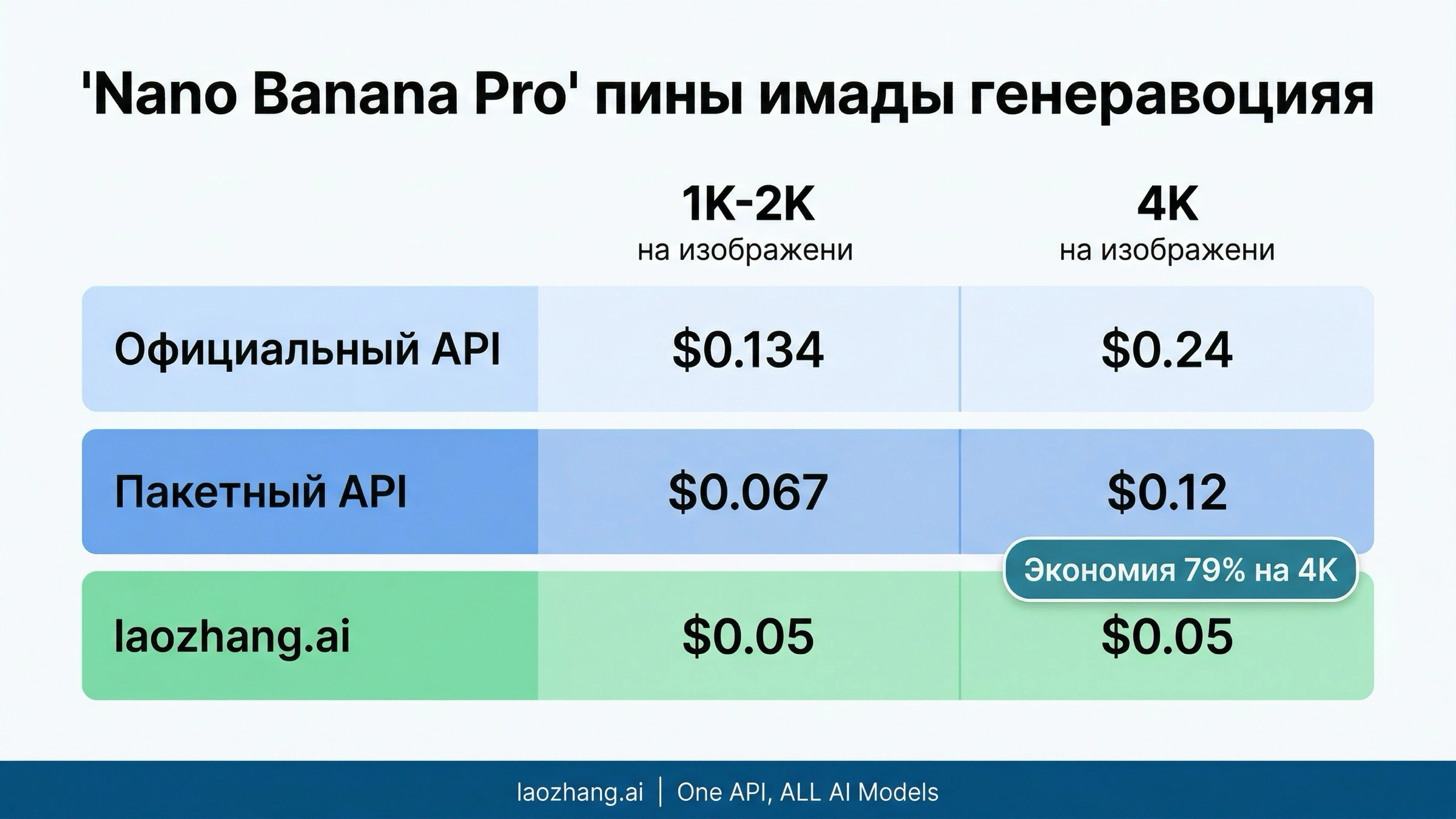

То, что сторонние провайдеры реально предлагают — это снятие лимитов частоты запросов и снижение стоимости. Объединяя доступ к API для множества пользователей и договариваясь об оптовых ценах с Google (или поддерживая собственные развёртывания Vertex AI), провайдеры вроде laozhang.ai могут предложить цену $0,05 за изображение независимо от разрешения — по сравнению с $0,134 за 2K или $0,24 за 4K через официальный API. Это экономия 63% при 2K и 79% при 4K, что быстро складывается при продакшн-объёмах. Они также обычно обеспечивают отсутствие лимитов RPM или RPD, что полностью решает измерение лимитов частоты запросов. Для разработчиков, которые хотят быстро опробовать генерацию изображений Nano Banana Pro, вы также можете протестировать на images.laozhang.ai.

| Провайдер | Цена 1K-2K | Цена 4K | Лимиты | Настройки безопасности |

|---|---|---|---|---|

| Официальный API | $0,134/изобр. | $0,240/изобр. | 20 RPM / 250 RPD | Полная поддержка BLOCK_NONE |

| Batch API | $0,067/изобр. | $0,120/изобр. | Пониженный приоритет | Полная поддержка BLOCK_NONE |

| laozhang.ai | $0,05/изобр. | $0,05/изобр. | Без ограничений | Проброс BLOCK_NONE |

| Viyou (заявления) | Не указано | Не указано | Заявлено без ограничений | Заявлено «без цензуры» |

То, что сторонние провайдеры в целом не могут изменить — это фильтрацию безопасности Layer 2. Поскольку проверка IMAGE_SAFETY происходит внутри инфраструктуры Google во время генерации изображения, прокси-сервис, просто пересылающий запросы к API Gemini, будет сталкиваться с теми же блокировками Layer 2, что и прямой вызов API. Некоторые провайдеры заявляют о «нецензурированном» или «полностью расфильтрованном» доступе, но техническая реальность такова, что любой сервис, использующий модель Google Gemini 3 Pro Image, подчиняется серверной оценке безопасности Google. Скептически относитесь к провайдерам, делающим общие заявления о «неограниченном» доступе без объяснения конкретного технического механизма — легитимные провайдеры честно расскажут, что они могут и не могут контролировать.

Самая весомая причина использования стороннего провайдера — это не обход фильтров безопасности, а эффективность затрат и снятие лимитов частоты запросов. Для нашего полного разбора цен по всем методам доступа, включая стратегии пакетного API, смотрите связанное руководство.

Оптимизация затрат для высоконагруженного неограниченного доступа

Работа с Nano Banana Pro в продакшн-масштабе требует стратегии по затратам. При официальной цене 4K в $0,24 за изображение генерация 1000 изображений в день обходится в $240 ежедневно или примерно $7200 в месяц. Та же нагрузка через laozhang.ai по $0,05 за изображение стоит $50 в день или $1500 в месяц — разница в $5700 в месяц, которая оправдывает архитектурный выбор.

Batch API предлагает золотую середину для нагрузок, не критичных ко времени. Google предоставляет скидку 50% на пакетную обработку, снижая цену изображений 2K до $0,067 и 4K до $0,120. Пакетные запросы имеют пониженный приоритет и более длительное время обработки, но для таких задач, как ежедневная генерация контента, плановая фотография товаров или создание фоновых ресурсов, задержка приемлема. Подробнее об оптимизации затрат пакетного API читайте в нашем специализированном руководстве.

Ценообразование на основе разрешения создаёт ещё одну возможность оптимизации. Многие сценарии использования на самом деле не требуют генерации в 4K. Изображения для социальных сетей, миниатюры, веб-баннеры и ассеты для электронной почты выглядят вполне приемлемо при разрешении 2K, которое стоит $0,134 вместо $0,24 — снижение на 44%. Зарезервируйте генерацию 4K для главных изображений, печатных материалов и случаев, когда нативное качество 4K действительно важно. При фиксированной цене laozhang.ai в $0,05 это различие полностью исчезает, что упрощает вашу архитектуру, устраняя логику маршрутизации затрат на основе разрешения.

Для команд, потребляющих тысячи изображений ежедневно, расчёт затрат уверенно склоняется в пользу сторонних провайдеров. Рассмотрите: 5000 изображений 4K в день стоят $1200 через официальный API, $600 через Batch API (если вы можете допустить задержку) или $250 через laozhang.ai. За год разница между официальным и сторонним доступом составляет более $300 000 — бюджет, который можно направить на значительные инженерные улучшения в другие области.

| Дневной объём | Официальный 4K | Batch 4K | laozhang.ai | Годовая экономия (vs Официальный) |

|---|---|---|---|---|

| 100 изобр. | $24/день | $12/день | $5/день | $6 935 |

| 500 изобр. | $120/день | $60/день | $25/день | $34 675 |

| 1 000 изобр. | $240/день | $120/день | $50/день | $69 350 |

| 5 000 изобр. | $1 200/день | $600/день | $250/день | $346 750 |

Стоимость токенов добавляет скрытый расход, который многие разработчики упускают из виду. Каждый запрос к Nano Banana Pro потребляет входные токены для вашего промпта (по $2,00 за миллион токенов) и выходные токены для сгенерированного изображения (по $12,00 за миллион выходных токенов, примерно 1120 токенов для изображения 2K и 2000 токенов для 4K). Для рабочих нагрузок text-to-image стоимость токенов уже включена в цены за изображение выше. Но для рабочих процессов image-to-image, где вы отправляете референсное изображение на вход, стоимость входных токенов может быть значительной — одно высокоразрешённое референсное изображение потребляет примерно 560 токенов, добавляя около $0,001 за запрос. При 5000 ежедневных запросов это дополнительные $5 в день, что ничтожно по сравнению со стоимостью выходных данных, но всё же стоит учитывать для целей распределения затрат.

Гибридная архитектура часто имеет наибольший экономический смысл для продакшн-развёртываний. Используйте официальный Batch API для фоновых задач, где задержка не критична (плановый контент, предварительная генерация вариантов товаров), и маршрутизируйте запросы в реальном времени, ориентированные на пользователя, через стороннего провайдера для мгновенного ответа и неограниченной пропускной способности. Такая комбинация обеспечивает оптимизацию затрат на предсказуемых нагрузках и отзывчивый сервис для интерактивных функций без необходимости корпоративных контрактов Vertex AI.

Часто задаваемые вопросы

Нарушает ли использование BLOCK_NONE Условия обслуживания?

Нет. BLOCK_NONE — это официально документированный параметр API, предоставленный Google специально для разработчиков, которым нужно управлять классификацией контента на уровне приложения. Документация Google явно описывает эту настройку и её поведение. Вы остаётесь ответственным за соответствие выходных данных вашего приложения Политике допустимого использования Google, но использование самого параметра полностью санкционировано.

Можно ли получить действительно неограниченный доступ к API Nano Banana Pro напрямую от Google?

Через Vertex AI с соглашением о гарантированном расходе вы можете договориться о пользовательских лимитах, которые фактически снимают практические ограничения для большинства нагрузок. Однако это требует прямого взаимодействия с отделом продаж Google Cloud и обычно предполагает гарантированный ежемесячный расход от $10 000. Для большинства разработчиков сторонние провайдеры предлагают функционально неограниченный доступ за малую долю этой стоимости.

Почему мой запрос блокируется даже при установленном BLOCK_NONE?

Потому что BLOCK_NONE влияет только на Layer 1 (четыре настраиваемые категории вредоносного контента). Layer 2 (IMAGE_SAFETY) оценивает само сгенерированное изображение с помощью ИИ-классификации, и Layer 2 не настраивается через какой-либо параметр API. Если вы видите finishReason: "IMAGE_SAFETY", блокировка пришла от Layer 2. Попробуйте уточнить промпт, добавив более конкретный профессиональный контекст.

Что изменилось в марте 2026 года в отношении политики контента?

Google значительно ужесточил ограничения на редактирование с участием людей. Операции вроде замены фона на фотографиях с людьми, компоновки групповых фото и модификации внешности теперь часто вызывают blockReason: "OTHER" до начала генерации. Это в первую очередь затрагивает рабочие процессы редактирования изображений, а не генерацию text-to-image.

Безопасно ли использовать laozhang.ai для продакшн-нагрузок?

laozhang.ai работает как платформа агрегации API, которая маршрутизирует запросы к официальной инфраструктуре Google. Она предлагает то же качество модели, что и прямой доступ к API, без лимитов RPM/RPD и с ценой $0,05 за изображение независимо от разрешения. Для продакшн-использования ключевой вопрос — комфортно ли вам маршрутизировать API-трафик через третью сторону, а не поддерживать прямые биллинговые отношения с Google. Многие разработчики используют гибридный подход: прямой API Google для чувствительных или регулируемых нагрузок и сторонние провайдеры для высоконагруженных, чувствительных к стоимости операций.

Как Nano Banana 2 (Gemini 3.1 Flash Image) сравнивается в плане неограниченного доступа?

Nano Banana 2 предлагает иной компромисс. Он поддерживает бесплатный уровень API (в отличие от Nano Banana Pro, который только платный), генерирует изображения быстрее — за 4–6 секунд вместо 12–18, и стоит значительно дешевле — $0,067 за изображение 1K официально. Однако он лишён нативного качества генерации 4K, имеет более низкую точность рендеринга текста (87–96% против 94–96% у Pro) и использует ту же двухуровневую архитектуру безопасности. Для многих сценариев, где разрешения 2K достаточно и стоимость важнее пикового качества, Nano Banana 2 на самом деле является лучшим выбором для «неограниченного» высоконагруженного доступа, поскольку включает бесплатный уровень с более высокими лимитами.

Взимается ли плата за заблокированные запросы?

Для блокировок Layer 1 (finishReason: "SAFETY") плата обычно не взимается, поскольку блокировка происходит до начала генерации изображения. Для блокировок Layer 2 (finishReason: "IMAGE_SAFETY") с вас списываются входные токены и выходные токены, потреблённые во время генерации — изображение было создано, но затем заблокировано до возврата вам. Это критическое различие для планирования затрат: высокая частота блокировок IMAGE_SAFETY может увеличить ваши расходы без получения пригодных изображений. Мониторинг частоты блокировок и оптимизация промптов для снижения блокировок Layer 2 напрямую влияют на вашу эффективную стоимость за пригодное изображение.

Какой самый быстрый способ начать генерировать изображения с Nano Banana Pro прямо сейчас?

Самый быстрый путь: (1) перейдите в Google AI Studio на aistudio.google.com, (2) войдите с аккаунтом Google, (3) создайте API-ключ, (4) привяжите биллинг-аккаунт к вашему проекту, (5) используйте код на Python или JavaScript из раздела «Настройка BLOCK_NONE» выше с вашим API-ключом и настройками безопасности BLOCK_NONE. Весь процесс настройки занимает менее 10 минут. Если вы хотите полностью избежать настройки биллинга, вы можете начать немедленно со сторонним провайдером, например laozhang.ai, для которого требуется только регистрация аккаунта и API-ключ — настройка биллинга Google Cloud не нужна.