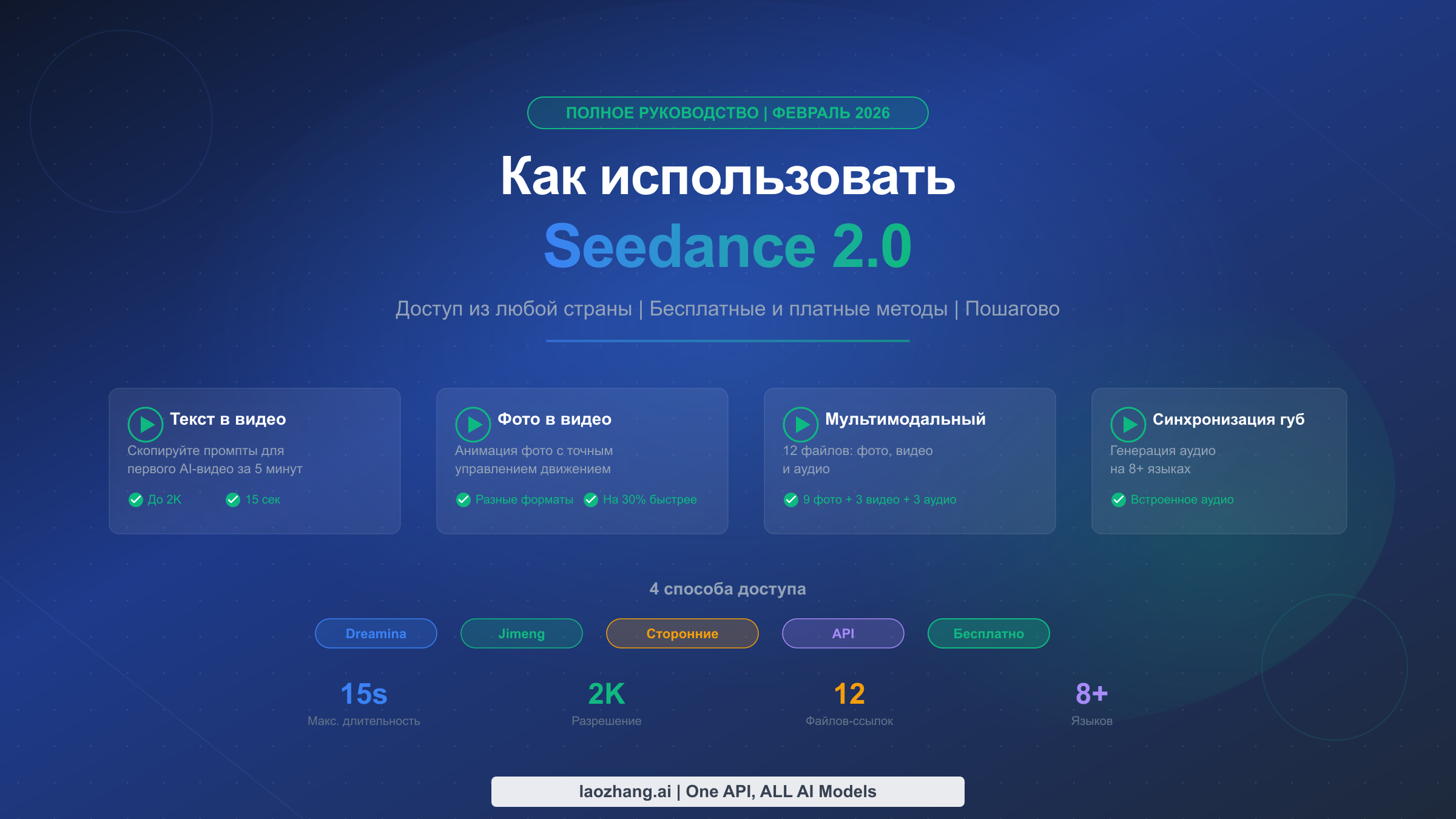

Seedance 2.0 — новейшая модель генерации видео от ByteDance, выпущенная 12 февраля 2026 года, которая быстро стала одним из самых обсуждаемых инструментов в сообществе создателей контента. Самый быстрый способ начать работу с ней за пределами Китая — через платформу Dreamina, предлагающую бесплатный тариф с ежедневными кредитами, которые обновляются каждые 24 часа. В этом руководстве вы найдёте всё необходимое: четыре рабочих способа доступа из любой страны, пошаговые инструкции для каждого режима генерации, мощную систему референсов из 12 файлов, которую большинство гайдов обходят стороной, а также честную информацию о текущих ограничениях и правах на коммерческое использование.

Краткое содержание

Seedance 2.0 генерирует видеоклипы длительностью до 15 секунд в разрешении 2K со встроенным звуком, поддерживая режимы текст-в-видео, изображение-в-видео и уникальную мультимодальную систему референсов, принимающую до 12 файлов (9 изображений + 3 видео + 3 аудио). Доступ можно получить бесплатно через Dreamina (международная платформа) или Jimeng (Китай, 69 RMB/месяц). После уведомления Disney о прекращении нарушений 13 февраля 2026 года ByteDance добавила защиту авторских прав, но платформа продолжает работать в полном объёме. Ниже вы найдёте готовые к использованию промпты, руководства по параметрам и практические решения для каждого ограничения.

Seedance 2.0 за 60 секунд — что это и почему это важно

ByteDance выпустила Seedance 2.0 12 февраля 2026 года, позиционируя её как унифицированную мультимодальную архитектуру совместной генерации аудио и видео, напрямую конкурирующую с Sora 2 от OpenAI и Veo 3.1 от Google. В отличие от более ранних моделей генерации видео с ИИ, которые обрабатывали видео и аудио как отдельные процессы, Seedance 2.0 генерирует и то, и другое одновременно за один проход — а значит, персонажи могут говорить, окружение издаёт фоновые звуки, а музыка синхронизирована с визуальным движением без какой-либо постобработки. Именно эта нативная генерация звука является наиболее значимым техническим достижением модели и главной причиной, по которой она привлекла столько внимания в социальных сетях в течение нескольких часов после запуска.

Модель принимает несколько типов входных данных через так называемую мультимодальную систему референсов: вы можете подавать текстовые промпты, загружать изображения для сохранения последовательности персонажей или стиля, использовать существующие видео для управления движением и даже предоставлять аудиоклипы для синхронизации голоса или генерации саундтрека. Система поддерживает до 12 референсных файлов одновременно (9 изображений, 3 видео и 3 аудиофайла), предоставляя создателям беспрецедентный уровень контроля над результатом. Если вы хотите понять, чем Seedance 2.0 отличается от Sora 2 и Veo 3 на техническом уровне, ключевое различие именно в этой совместной аудио-видео архитектуре — ни Sora 2, ни Veo 3.1 не предлагают нативную генерацию звука как встроенную функцию.

Практические характеристики важны для планирования рабочего процесса. Каждая генерация производит до 15 секунд видео в разрешении до 2K, а время генерации примерно на 30% быстрее, чем у предыдущей модели Seedance 1.5. Хотя 15 секунд может показаться коротким клипом, мультимодальная система референсов позволяет создавать последовательные фрагменты, которые можно соединить для получения более длинного контента. Важный контекст: 13 февраля 2026 года — всего через день после запуска — Disney направила ByteDance уведомление о прекращении нарушений авторских прав, а Ассоциация кинокомпаний Америки также выступила с публичным заявлением. ByteDance ответила примерно через три дня, обязавшись внедрить дополнительные защитные механизмы, которые теперь действуют на обеих платформах — Dreamina и Jimeng. Модель полностью работоспособна по состоянию на 22 февраля 2026 года, хотя некоторые сторонние платформы добровольно деактивировали свои интеграции с Seedance 2.0.

4 рабочих способа доступа к Seedance 2.0 (из любой страны)

Самый большой источник разочарования для новых пользователей — разобраться, какая платформа действительно подходит для их ситуации. Seedance 2.0 доступен через несколько каналов, каждый из которых имеет свой набор функций, ценообразование и региональную доступность. Вместо простого перечисления платформ, ниже представлена система принятия решений, которая поможет сделать выбор в зависимости от конкретных обстоятельств — вашего местоположения, бюджета и планируемого контента.

Dreamina — рекомендуемая отправная точка для международных пользователей

Dreamina (dreamina.capcut.com) — это официальная международная платформа ByteDance для Seedance 2.0 и наименее затратный путь для любого пользователя за пределами Китая. Интерфейс полностью на английском языке, для регистрации требуется только адрес электронной почты или аккаунт Google, а бесплатный тариф предоставляет ежедневные кредиты, которые обновляются каждые 24 часа. Это значит, что вы можете начать генерировать видео в течение нескольких минут после регистрации, не вводя никакой платёжной информации. Для пользователей, которым нужно больше генераций, платные тарифы начинаются от $18 в месяц за Basic, $42 в месяц за Standard и $84 в месяц за Advanced (по данным страницы цен Dreamina на февраль 2026 года). Годовая оплата предоставляется с существенными скидками — проверяйте актуальные годовые тарифы на платформе, так как акционные цены часто меняются. Dreamina поддерживает все основные функции Seedance 2.0, включая текст-в-видео, изображение-в-видео и мультимодальную систему референсов. Поэтапное развёртывание означает, что некоторые продвинутые функции могут появляться чуть позже, чем на Jimeng, но для большинства пользователей разница незначительна. Подробный обзор тарифных планов и их содержимого вы найдёте в нашем руководстве по ценам Seedance 2.0.

Jimeng — полный доступ к функциям для продвинутых пользователей

Jimeng (jimeng.jianying.com) — это оригинальная китайская платформа, на которой Seedance 2.0 была запущена впервые, и она неизменно предлагает наиболее полный набор функций. Ежемесячная подписка стоит 69 RMB (примерно $9,60 USD), а новые пользователи могут получить пробный период на 7 дней всего за 1 RMB. Новые аккаунты также получают 260 начальных кредитов для старта. Особенность в том, что Jimeng требует китайский номер телефона для регистрации и китайский способ оплаты (Alipay или TG) для подписки. Интерфейс полностью на китайском языке, хотя инструменты перевода в браузере справляются с навигацией достаточно хорошо. Если у вас есть доступ к китайским способам оплаты и вы хотите самые последние функции, Jimeng — наиболее функциональный вариант. Однако для подавляющего большинства международных пользователей Dreamina обеспечивает практически идентичный опыт с гораздо меньшими трудностями.

Сторонние платформы — альтернативы с оговорками

Несколько сторонних платформ интегрировали Seedance 2.0 в свои рабочие процессы, включая CapCut (собственный видеоредактор ByteDance), WaveSpeed и другие. Они могут быть полезны, если у вас уже есть аккаунт на одном из этих сервисов или если вам нравятся их специфические возможности интерфейса. Однако есть важная оговорка: после скандала с авторскими правами Disney в феврале 2026 года некоторые сторонние платформы добровольно деактивировали свои интеграции с Seedance 2.0. Доступность платформ в этой категории нестабильна, поэтому проверяйте текущий статус перед оформлением платной подписки на любом стороннем сервисе. Преимущество использования именно CapCut заключается в интеграции Seedance 2.0 непосредственно в рабочий процесс видеоредактирования, что упрощает производство, если вы планируете комбинировать сгенерированные ИИ клипы с другим отснятым материалом.

API-доступ — для разработчиков, создающих приложения

Для разработчиков, которым нужен программный доступ, Seedance 2.0 доступен через VolcEngine (облачная платформа ByteDance) и через различных сторонних API-провайдеров. Цены обычно варьируются от примерно $0,10 до $0,80 за минуту сгенерированного видео, в зависимости от провайдера и настроек разрешения. API-доступ обеспечивает пакетную обработку, интеграцию в пользовательские приложения и автоматизированные рабочие процессы. Если официальные платформы становятся недоступны в вашем регионе или вам нужен надёжный программный доступ, API-провайдеры вроде laozhang.ai предлагают агрегированный доступ к нескольким моделям генерации видео с ИИ, включая Seedance 2.0, Sora 2 и Veo 3.1, через единую точку входа, что обеспечивает резервирование в случае простоя любой отдельной платформы.

Правило быстрого выбора простое: если вы международный пользователь, который хочет попробовать Seedance 2.0 бесплатно — начинайте с Dreamina. Если вы в Китае и хотите все доступные функции — используйте Jimeng. Если вы создаёте приложение — выбирайте API-доступ. А если у вас специфические потребности в рабочем процессе — проверьте, удовлетворяет ли их какая-либо сторонняя платформа, прежде чем принимать решение.

Текст-в-видео — ваше первое видео за 5 минут

Текст-в-видео — самый доступный способ начать работу с Seedance 2.0, и весь процесс от открытия платформы до скачивания первого сгенерированного видео занимает около пяти минут. Вот точный рабочий процесс на Dreamina, который с незначительными отличиями интерфейса применим к Jimeng и другим платформам.

После входа в Dreamina перейдите в раздел генерации видео и выберите Seedance 2.0 в качестве модели. Вы увидите текстовое поле для ввода промпта, а также элементы управления параметрами: продолжительность, разрешение и соотношение сторон. Настройки по умолчанию (5 секунд, стандартное разрешение, соотношение сторон 16:9) прекрасно подходят для первой генерации. Самый важный фактор для получения хороших результатов — это ваш промпт, поэтому сосредоточимся именно на нём, а не на навигации по интерфейсу, которая может меняться по мере обновления платформы.

Распространённая ошибка при генерации видео с ИИ — писать промпты так же, как для генерации изображений. Видеопромпты должны описывать движение, временную динамику и поведение камеры в дополнение к визуальному оформлению. Вот практический шаблон, который стабильно даёт хорошие результаты с Seedance 2.0: начните с описания объекта, затем опишите действие или движение, потом укажите окружение и, наконец, упомяните движение камеры или визуальный стиль. Например, вместо «женщина в красном платье в саду» (это статичный промпт для изображения) напишите что-то вроде: «Young woman in a flowing red dress walks slowly through a sunlit rose garden, petals drifting in a gentle breeze, the camera follows her from a low angle as she turns to look over her shoulder, cinematic lighting, shallow depth of field.» Разница в качестве результата между размытым промптом и хорошо структурированным — колоссальна.

Параметры генерации заслуживают внимания, когда вы перейдёте за рамки первого пробного запуска. Продолжительность может быть установлена от 5 до 15 секунд — более короткие клипы генерируются быстрее и потребляют меньше кредитов, поэтому используйте 5-секундные клипы для тестирования идей промптов, прежде чем запускать полноценные 15-секундные генерации. Разрешение масштабируется до 2K, но стандартное разрешение вполне достаточно для контента в социальных сетях и расходует меньше кредитов. Варианты соотношения сторон обычно включают 16:9 (широкоформатное, идеально для YouTube), 9:16 (вертикальное, идеально для TikTok и Instagram Reels) и 1:1 (квадратное, идеально для ленты Instagram). Выбор правильного соотношения сторон при генерации избавляет от потери качества при последующей обрезке. Типичная стоимость 5-секундного видео стандартного разрешения на Dreamina составляет приблизительно 30-50 кредитов, хотя точные расходы зависят от уровня подписки и текущей политики ценообразования платформы.

Для вашего первого промпта вот один, который вы можете скопировать и вставить напрямую: «A golden retriever puppy runs across a grassy meadow at sunset, ears flapping, tongue out, the camera tracks alongside at the same speed, warm golden hour lighting, slow motion, cinematic.» Этот промпт хорошо работает, потому что он определяет чёткий объект, конкретное движение, контекст окружения, поведение камеры и визуальный стиль — все элементы, на которые Seedance 2.0 реагирует наиболее эффективно.

После завершения первой генерации вы интуитивно поймёте, как модель интерпретирует ваши инструкции, и сможете начать совершенствовать свой подход. Рабочий процесс итерации, которому следуют опытные пользователи Seedance 2.0, таков: сгенерируйте быстрый 5-секундный тест в стандартном разрешении для оценки концепции промпта, изучите результат и определите, что нужно скорректировать (обычно больше всего итераций требуют описания движения камеры или объекта), уточните формулировку промпта, протестируйте снова и генерируйте финальную 15-секундную версию в высоком разрешении только когда вы довольны концепцией. Такой подход расходует значительно меньше кредитов, чем генерация полноразмерных видео из непроверенных промптов, и даёт лучшие финальные результаты, потому что проблемы выявляются рано. Частые корректировки промптов включают добавление «smooth» или «steady», когда движение камеры слишком дёрганое, указание «subtle» для движений, когда модель слишком сильно анимирует лица или тела, и включение явных временных указаний вроде «slowly» или «gradually» для контроля темпа действия внутри клипа. Ещё один эффективный приём — использование негативных описаний: фразы вроде «no sudden camera cuts, no zooming» помогают модели понять, чего вы не хотите, что иногда проще, чем точно описать желаемый результат.

Изображение-в-видео — оживите статичные фотографии

Генерация изображение-в-видео берёт статичную фотографию или иллюстрацию и превращает её в видеоклип с движением, что особенно эффективно для продуктовой фотографии, портретов и художественных работ. Рабочий процесс похож на текст-в-видео, но вместо того чтобы полагаться исключительно на текстовый промпт для определения визуального облика, вы загружаете исходное изображение, которое задаёт внешний вид, а текстовый промпт определяет, как именно всё должно двигаться.

Процесс загрузки на Dreamina прост: выберите режим изображение-в-видео, загрузите исходное изображение, а затем напишите промпт, описывающий, какое движение должно происходить. Ключевое понимание, которое упускает большинство обучающих материалов, состоит в том, что промпт для режима изображение-в-видео должен почти полностью сосредоточиться на описании движения и изменений, а не повторять то, что уже видно на изображении. Если вы загружаете портрет человека, вам не нужно заново описывать его внешность — Seedance 2.0 уже получила эту информацию из изображения. Вместо этого опишите, что человек должен делать: «The person slowly turns their head to the left, smiles warmly, and raises one hand in a gentle wave, natural eye movement, soft ambient lighting.» Такой подход даёт кардинально лучшие результаты, чем промпты, которые дублируют описание загруженного изображения.

Формат и качество исходного изображения существенно влияют на результат. Seedance 2.0 лучше всего работает с изображениями высокого разрешения в форматах JPG или PNG, в идеале не менее 1024x1024 пикселей. Изображения с чёткими объектами, хорошим освещением и минимальным шумом дают лучшие анимации. Особенно эффективные исходные изображения включают: продуктовые фотографии на чистом фоне (для анимации продуктов), портретные фотографии с чёткими чертами лица (для анимации говорящей головы или выражений), ландшафтные фотографии с глубиной (для движений камеры в стиле параллакса) и иллюстрации или художественные работы (для творческих анимаций). Избегайте исходных изображений, которые сильно сжаты, размыты или имеют очень низкое разрешение, так как эти артефакты будут усилены в сгенерированном видео.

Один продвинутый приём, дающий впечатляющие результаты, — комбинирование изображение-в-видео с мультимодальной системой референсов. Загрузите основное изображение как источник, а затем добавьте дополнительные референсы @Image для стилевого руководства. Например, вы можете загрузить продуктовую фотографию как основное изображение и использовать кинематографический кадр из фильма в качестве референса для освещения и стиля камеры. Такой послойный подход даёт одновременный контроль как над содержанием (из вашего исходного изображения), так и над эстетикой (из вашего стилевого референса).

Разные типы исходных изображений дают заметно разные стили анимации, и понимание этих закономерностей помогает выбрать правильный исходный материал для намеченного результата. Портретные фотографии с чёткими фронтальными лицами дают наиболее надёжные анимации синхронизации губ и выражений — модель может точно идентифицировать ключевые точки лица и генерировать естественно выглядящие движения речи, моргание и лёгкие наклоны головы. Продуктовые фотографии на чистом белом или нейтральном фоне отлично подходят для вращательных анимаций, где модель медленно поворачивает продукт, показывая разные ракурсы — это сразу применимо для контента электронной коммерции. Ландшафтные и архитектурные фотографии лучше всего работают с медленными движениями камеры в стиле параллакса, где элементы переднего и заднего плана перемещаются с разной скоростью, создавая кинематографический эффект глубины из одного плоского изображения. Иллюстрации и цифровые художественные работы обычно дают анимации с чуть более стилизованным движением, которое уважает художественный стиль оригинального изображения, а не пытается сделать его фотореалистичным.

Практический совет, который экономит значительное время: прежде чем запускать полную генерацию, протестируйте исходное изображение коротким 5-секундным клипом, чтобы увидеть, как модель его интерпретирует. Некоторые изображения содержат неоднозначности, которые модель разрешает неожиданным образом — например, фотография, на которой человек частично закрыт другим объектом, может вызвать появление странных артефактов дополнения при анимации скрытой области. Если 5-секундный тест выявляет проблемы, вы можете обрезать исходное изображение иначе, скорректировать промпт, чтобы направить модель в сторону от проблемных зон, или выбрать другое исходное изображение — и всё это до расходования кредитов на более длительную генерацию.

Мультимодальная магия — система референсов из 12 файлов

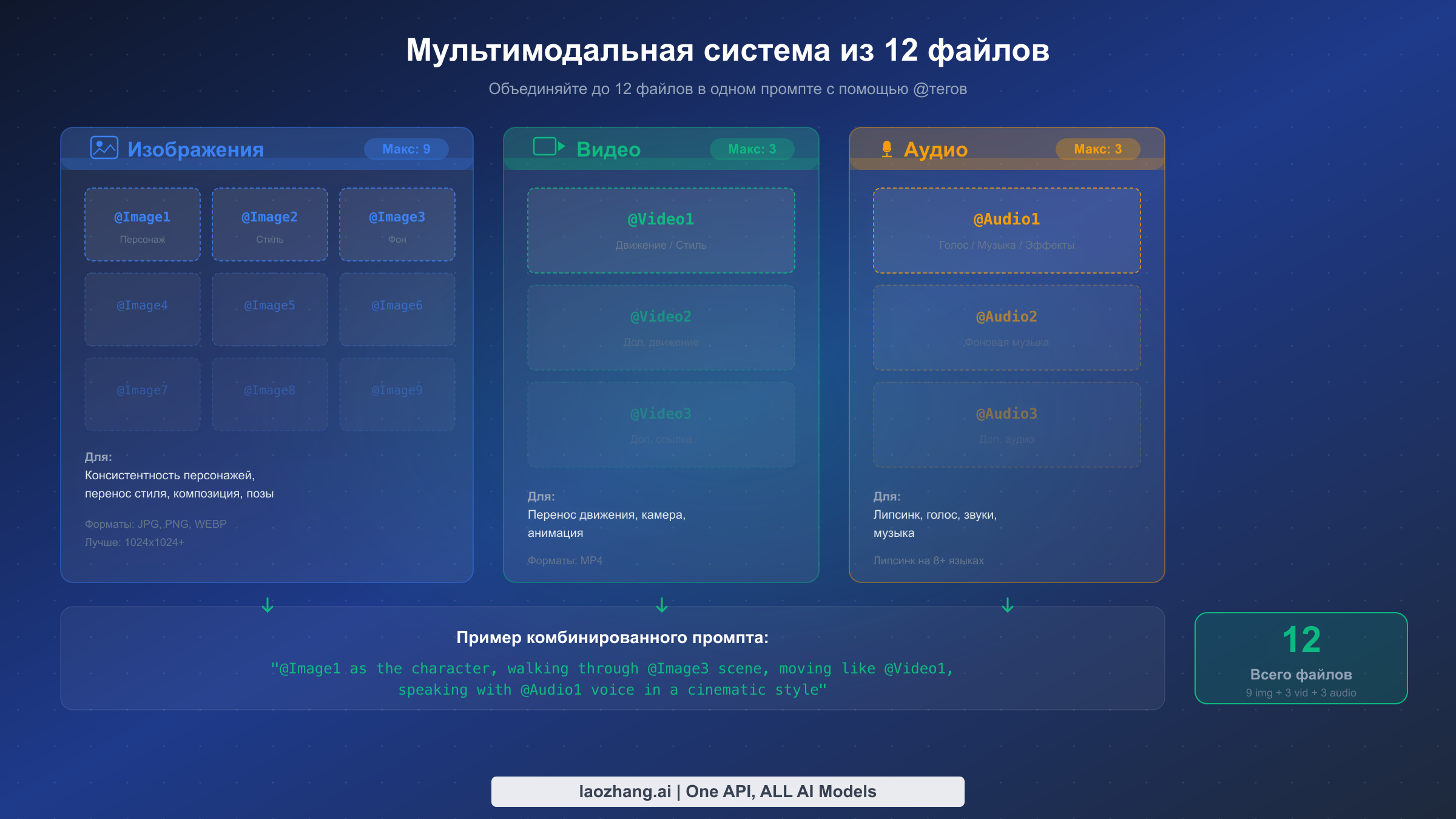

Мультимодальная система референсов — самая мощная и наименее изученная функция Seedance 2.0. В то время как большинство инструментов для генерации видео с ИИ принимают либо текст, либо одно изображение в качестве входных данных, Seedance 2.0 позволяет загружать и ссылаться одновременно на 12 файлов — 9 изображений, 3 видео и 3 аудиофайла — создавая невероятно детальную спецификацию того, что вы хотите получить. Именно эта функция по-настоящему отличает Seedance 2.0 от Sora 2, Veo 3.1 и любой другой модели генерации видео, доступной по состоянию на февраль 2026 года, при этом практически ни одно существующее руководство не объясняет, как ей эффективно пользоваться.

Синтаксис основан на @тегах, которые вы включаете в текстовый промпт. При загрузке референсных файлов каждому присваивается тег: @Image1 — @Image9, @Video1 — @Video3 и @Audio1 — @Audio3. Затем вы ссылаетесь на эти теги в промпте, чтобы указать модели, как каждый файл должен влиять на результат. Например, промпт может выглядеть так: «@Image1 as the main character, walking through the environment shown in @Image2, with the camera movement style from @Video1, speaking with the voice quality of @Audio1.» Модель интерпретирует эти референсы и объединяет их в согласованную генерацию видео, которая учитывает все указанные входные данные.

Понимание того, что контролирует каждый тип референса, необходимо для получения хороших результатов. Референсы изображений в первую очередь управляют визуальным оформлением: @Image1 может определять лицо и тело вашего персонажа, @Image2 — задавать фоновое окружение, @Image3 — предоставлять референс цветовой палитры или художественного стиля, а дополнительные слоты изображений могут указывать позы, реквизит, схемы освещения или другие визуальные элементы, которые вы хотите видеть в результате. На практике большинство пользователей получают отличные результаты с 2-4 референсами изображений — вам не нужно заполнять все 9 слотов для каждой генерации. Референсы видео управляют динамикой движения: @Video1 может предоставить образец того, как должна двигаться камера, как персонаж должен ходить, или задать общий ритм и темп сцены. Это особенно полезно, когда вы хотите воспроизвести определённый тип движения, не описывая его текстом с абсолютной точностью. Аудиореференсы управляют звуковым слоем: @Audio1 может быть голосовой записью, которую модель использует для генерации синхронизации губ, @Audio2 — музыкальным треком, влияющим на темп и настроение видео, а @Audio3 может предоставить фоновые звуковые эффекты.

Практический пример комбинации, демонстрирующий мощь системы: загрузите фотографию лица как @Image1 (референс персонажа), природный ландшафт как @Image2 (фон), видеоклип ходьбы как @Video1 (референс движения) и голосовую запись как @Audio1 (диалог). Затем промпт: «@Image1 walks through the @Image2 landscape following the walking style in @Video1, speaking the words in @Audio1 with natural lip sync, cinematic tracking shot.» Этот единственный запрос на генерацию задействует четыре различных референсных файла для создания видео, которое было бы крайне сложно получить с помощью одних только текстовых промптов. Начните с 2-3 референсов для первой мультимодальной генерации и постепенно добавляйте больше по мере понимания того, как модель интерпретирует каждый тип входных данных.

Синхронизация губ и звук — нативная генерация аудио

Нативная генерация звука — фирменный отличительный признак Seedance 2.0: именно эта функция вызвала наибольший восторг при запуске модели и именно её конкуренты пока не смогли повторить. Если Sora 2 и Veo 3.1 генерируют беззвучное видео, требующее добавления звука на этапе постобработки, то Seedance 2.0 производит аудио и видео одновременно как единый результат. Это означает, что диалог естественно совпадает с движениями губ, шаги синхронизированы с ходьбой, фоновые звуки соответствуют окружению, а музыка следует за визуальным ритмом без ручной настройки.

Функция синхронизации губ поддерживает 8 и более языков, что делает её особенно ценной для создателей контента, работающих с многоязычными материалами. Рабочий процесс для генерации видео с синхронизацией речи включает загрузку аудиофайла-референса (тег @Audio), содержащего речь, которую должен произносить ваш персонаж, в сочетании с референсом изображения персонажа и текстовым промптом, описывающим сцену. Seedance 2.0 анализирует аудио, сопоставляет движения рта с фонемами речи и генерирует видео, где персонаж естественно произносит предоставленный аудиоматериал. Наилучшее качество достигается с чистым, хорошо записанным аудио в разговорном темпе — сильно обработанная или очень быстрая речь может снизить точность синхронизации.

Помимо диалога, нативная аудиосистема автоматически генерирует звуки окружения на основе визуального содержания. Сцена в лесу будет включать пение птиц и шелест листьев. Городская улица — шум транспорта и гул толпы. Сцена грозы — звуки дождя и грома. Это автоматическое звуковое оформление экономит значительное время на постобработке и создаёт более погружающий результат, чем ручное добавление звуковых эффектов. Вы можете влиять на аудиовыход через текстовый промпт — указание «quiet, peaceful atmosphere» в сравнении с «busy, energetic environment» меняет генерацию звука наряду с визуальным содержанием. Если вам нужен точный контроль над конкретными аудиоэлементами, система референсов @Audio позволяет предоставить звуковые образцы, которые направляют звуковой дизайн модели, не полностью подавляя автоматическую генерацию. Для создателей контента, которым нужна абсолютная точность звука, рекомендуемый подход — сначала сгенерировать видео с нативным звуком Seedance 2.0, а затем выборочно заменить или улучшить конкретные аудиодорожки в специализированном аудиоредакторе или видеоредакторе вроде CapCut.

Возможность многоязычной синхронизации губ заслуживает особого внимания, потому что она открывает рабочий процесс, который ранее был дорогим и трудоёмким: создание одного и того же видеоконтента на нескольких языках. Традиционный подход требовал найма актёров озвучки для каждого языка, записи отдельных аудиодорожек и ручной синхронизации каждой из них с движениями рта персонажа с помощью специализированного программного обеспечения. С Seedance 2.0 вы можете записать (или сгенерировать) речь на разных языках, загрузить каждую версию как референс @Audio с тем же референсом персонажа @Image и создать языковые версии одной и той же сцены в отдельных проходах генерации. Движения губ естественно адаптируются к фонемам каждого языка, давая результаты, которые выглядят как нативная запись, а не дубляж. Это особенно ценно для брендов, создающих маркетинговый контент для международной аудитории, преподавателей, готовящих многоязычные учебные материалы, и создателей контента, публикующихся на платформах с аудиториями из разных языковых рынков.

Для достижения наилучшего качества звука в системе синхронизации губ ваш входной аудиофайл должен быть записан с частотой дискретизации 44,1 кГц или 48 кГц, в формате WAV или высококачественном MP3, с минимальным фоновым шумом и чёткой дикцией. Речь в естественном разговорном темпе обеспечивает лучшую синхронизацию — очень быстрая речь или сильный акцент иногда могут приводить к потере точности синхронизации. Если вы записываете свой голос для синхронизации, использование приличного USB-микрофона в тихом помещении даёт кардинально лучшие результаты, чем запись на телефон в шумной обстановке. Модель также обрабатывает тональные языки, такие как мандаринский и кантонский, где изменения высоты тона несут смысловую нагрузку, с приемлемой точностью — хотя движения губ могут быть чуть менее точными, чем для нетональных языков вроде английского или испанского.

Скачивание, экспорт и коммерческое использование

После генерации видео, которым вы довольны, Seedance 2.0 выдаёт файлы MP4, которые можно скачать прямо с платформы. Параметры экспорта просты: видео доступны в том разрешении, которое вы выбрали при генерации (до 2K), в стандартном формате MP4, совместимом практически со всеми программами для видеомонтажа и платформами социальных сетей. На Dreamina скачивание на бесплатном тарифе может включать небольшой водяной знак, тогда как платные подписчики могут скачивать без водяных знаков. На Jimeng поведение водяного знака зависит от уровня вашей подписки.

Вопрос коммерческого использования — тот, которого избегает большинство руководств, но он заслуживает чёткого ответа. По состоянию на февраль 2026 года условия обслуживания ByteDance для Dreamina и Jimeng в целом разрешают коммерческое использование сгенерированного контента, с важными оговорками. Контент, созданный с использованием оригинальных промптов и ваших собственных референсных материалов (а не защищённых авторским правом персонажей или интеллектуальной собственности), как правило, может использоваться в коммерческих целях, включая контент для социальных сетей, маркетинговые материалы и творческие проекты. Однако правовой ландшафт в области авторских прав активно развивается после скандала с Disney. ByteDance внедрила защитные механизмы, направленные на предотвращение генерации узнаваемых персонажей, защищённых авторским правом, а контент, напоминающий существующую интеллектуальную собственность, может подлежать дополнительным ограничениям. Практический совет таков: если вы создаёте контент для коммерческого использования, придерживайтесь оригинальных описаний персонажей, используйте собственные фотографии и произведения в качестве референсов и избегайте запросов на создание чего-либо, близко напоминающего существующий защищённый авторским правом материал. Такой подход обеспечивает однозначно безопасную территорию вне зависимости от того, как будут развиваться политики в области авторских прав в ближайшие месяцы.

Для эффективности рабочего процесса продумайте конвейер экспорта перед началом генерации. Если вы создаёте контент для TikTok или Instagram Reels, генерируйте сразу в соотношении сторон 9:16, а не обрезайте потом из 16:9. Если вам нужен более длинный контент, генерируйте отдельные клипы в одинаковом разрешении и соотношении сторон, чтобы они бесшовно соединялись. А если вы планируете цветокоррекцию или другую постобработку, выход в более высоком разрешении 2K даёт больше запаса для настроек без потери качества.

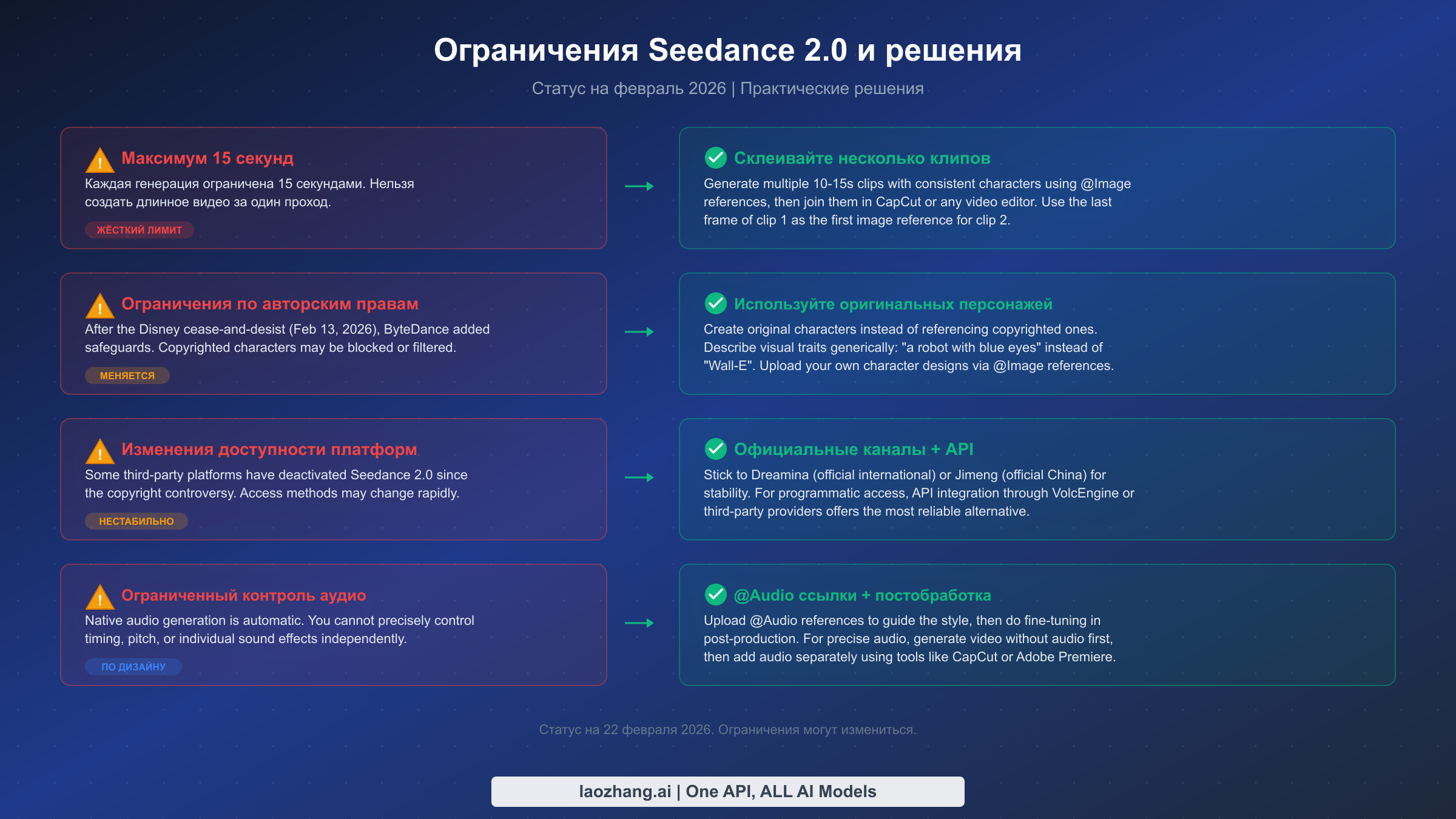

Ограничения Seedance 2.0 и обходные решения (февраль 2026)

У любого инструмента ИИ есть ограничения, и честно рассказать о них гораздо полезнее, чем делать вид, что их нет. Seedance 2.0 впечатляет, но понимание текущих границ сэкономит вам время и поможет планировать реалистичные производственные процессы. Вот значимые ограничения по состоянию на февраль 2026 года вместе с практическими обходными решениями для каждого.

Максимальная продолжительность в 15 секунд — наиболее часто упоминаемое ограничение, и это жёсткое ограничение текущей архитектуры модели — нет настройки, которая позволила бы его обойти. Обходное решение, которое используют профессиональные создатели контента, — генерация нескольких последовательных клипов и их соединение в видеоредакторе. Ключ к успеху — использование системы референсов @Image для поддержания последовательности персонажей и сцен между клипами. Возьмите последний кадр первого клипа, используйте его как стартовый референс для второго клипа и включите те же референсы персонажей и окружения. Это даёт клипы, которые можно монтировать с естественно выглядящей непрерывностью. Инструменты вроде CapCut, Adobe Premiere и DaVinci Resolve отлично справляются с таким рабочим процессом.

Ограничения на контент, защищённый авторским правом, внедрённые после уведомления Disney, работают, но иногда проявляют излишнюю агрессивность. Защитные механизмы могут иногда блокировать промпты, которые на самом деле не ссылаются на защищённый авторским правом материал, если определённые комбинации ключевых слов срабатывают как триггер фильтра. Если ваш промпт неожиданно заблокирован, попробуйте перефразировать его с использованием других описательных терминов. Вместо того чтобы называть конкретный художественный стиль, ассоциирующийся со студией, опишите желаемые визуальные характеристики: «soft rounded character design with warm colors» вместо упоминания стиля конкретной анимационной студии. Использование собственных референсов @Image для дизайна персонажей — наиболее надёжный способ полностью избежать проблем с фильтрами, потому что модель может видеть именно то, что вы хотите, не полагаясь на потенциально фильтруемые текстовые описания.

Доступность платформ остаётся нестабильной. С начала скандала некоторые сторонние интеграции были временно или постоянно деактивированы. Самый безопасный подход — использовать официальные каналы: Dreamina для международного доступа и Jimeng для пользователей из Китая. Они с наименьшей вероятностью столкнутся с неожиданными перебоями, поскольку находятся под прямым управлением ByteDance. Если вам нужно гарантированное время работы для производственных процессов, API-доступ через надёжных провайдеров предлагает наиболее стабильный путь. О том, как развивается ландшафт генерации видео с ИИ в целом и какие существуют альтернативы, читайте в нашем руководстве какая модель генерации видео с ИИ лучше подходит для ваших задач.

Система генерации звука, будучи революционной, имеет ограничения в тонком контроле. Вы не можете независимо регулировать тайминг отдельных звуковых эффектов, точно контролировать баланс громкости между диалогом и фоновым звуком или генерировать конкретные музыкальные композиции по запросу. Система референсов @Audio обеспечивает направление, а не точный контроль. Для постановок, требующих точных аудиоспецификаций, рекомендуемый подход — сгенерировать видео с нативным звуком Seedance 2.0 в качестве основы, а затем заменить или улучшить конкретные аудиодорожки на этапе постобработки с помощью предпочитаемого программного обеспечения для редактирования звука. Такой гибридный подход использует способность Seedance 2.0 генерировать естественно синхронизированный базовый звук, при этом предоставляя вам полный контроль над финальным миксом.

FAQ — ответы на частые вопросы

Бесплатен ли Seedance 2.0?

Да, Seedance 2.0 доступен бесплатно через бесплатный тариф Dreamina, который предоставляет ежедневные кредиты, обновляющиеся каждые 24 часа. Бесплатных кредитов достаточно для нескольких коротких генераций видео в день. Платные тарифы на Dreamina начинаются от $18/month (Basic), а Jimeng предлагает пробный период на 7 дней всего за 1 RMB (~$0,14) с 260 бесплатными начальными кредитами для новых аккаунтов. Вы можете создавать полноценный контент, не тратя ни копейки.

Безопасно ли использовать Seedance 2.0 после скандала с Disney?

Да. ByteDance внедрила защитные механизмы авторских прав примерно через три дня после уведомления Disney (около 16 февраля 2026 года), и обе платформы — Dreamina и Jimeng — продолжают полноценно работать. Защитные механизмы предотвращают генерацию узнаваемых персонажей, защищённых авторским правом, но создание оригинального контента никак не затронуто. Сама платформа не представляет правовых рисков для отдельных пользователей, создающих оригинальный контент.

Можно ли использовать Seedance 2.0 за пределами Китая?

Да. Dreamina (dreamina.capcut.com) — международная платформа ByteDance, специально разработанная для пользователей за пределами Китая. Она не требует VPN, принимает международные способы оплаты и имеет полностью англоязычный интерфейс. Доступ к Seedance 2.0 также можно получить через различные сторонние платформы и API-провайдеры, обслуживающие международных пользователей.

Как Seedance 2.0 сравнивается с Sora 2 и Veo 3.1?

Главное преимущество Seedance 2.0 — нативная совместная генерация аудио и видео: ни Sora 2, ни Veo 3.1 не генерируют звук нативно. Модель также предлагает систему мультимодальных референсов из 12 файлов, обеспечивающую больше гибкости входных данных, чем у любого конкурента. Подробное сравнение вы найдёте в нашем сравнении четырёх ведущих моделей генерации видео с ИИ, которое детально разбирает качество, цены и различия в функциях.

Сколько кредитов стоит одно видео?

На Dreamina типичное 5-секундное видео в стандартном разрешении стоит примерно 30-50 кредитов. 15-секундная генерация в более высоком разрешении стоит дороже. Точный расход кредитов зависит от разрешения, продолжительности и использования продвинутых функций, таких как мультимодальные референсы. Кредиты бесплатного тарифа обновляются ежедневно, а платные тарифы предоставляют ежемесячные лимиты кредитов, которые различаются в зависимости от уровня подписки.