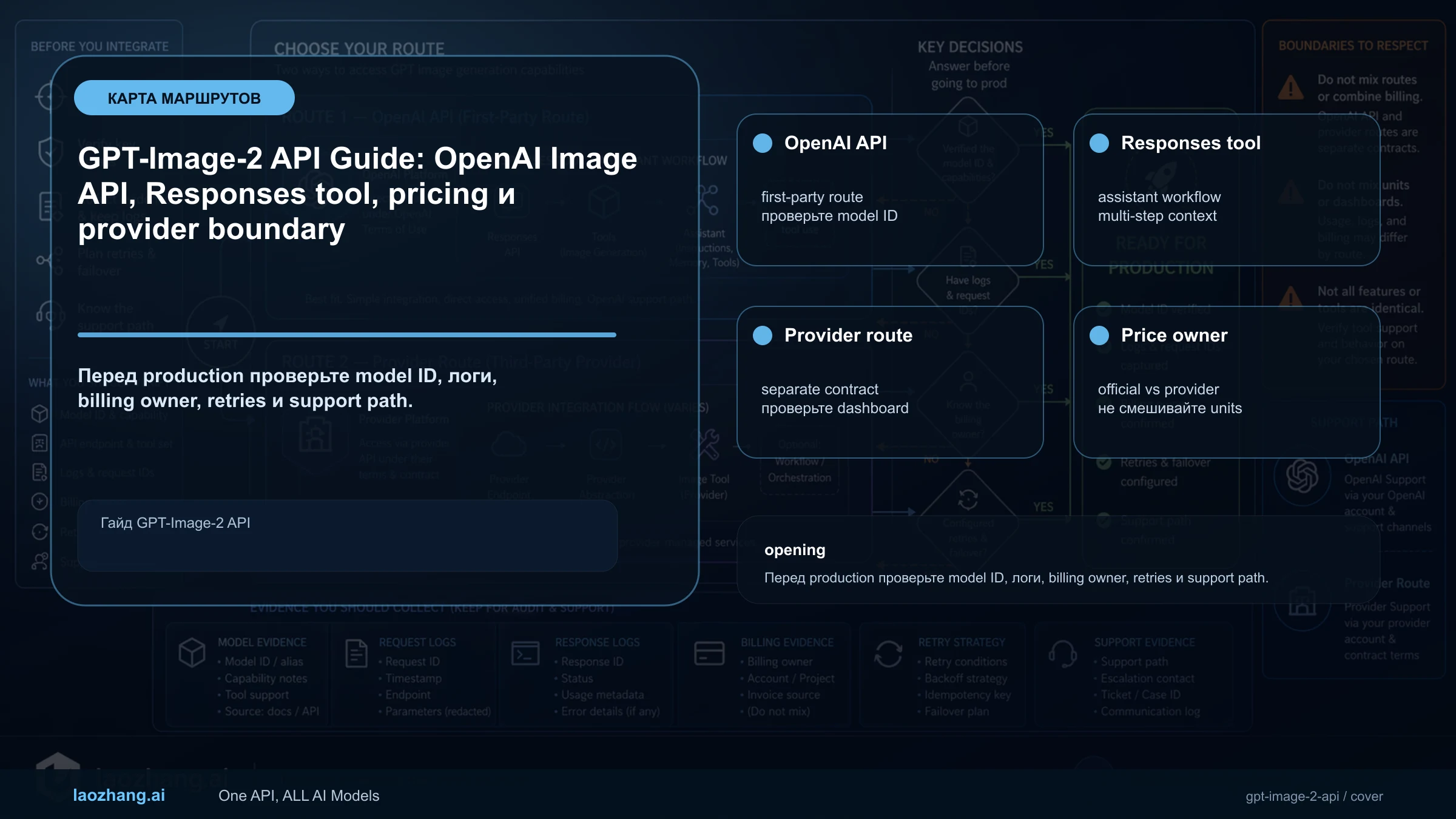

GPT-Image-2 API делится на Image API для прямого image output и Responses image_generation для assistant flow.

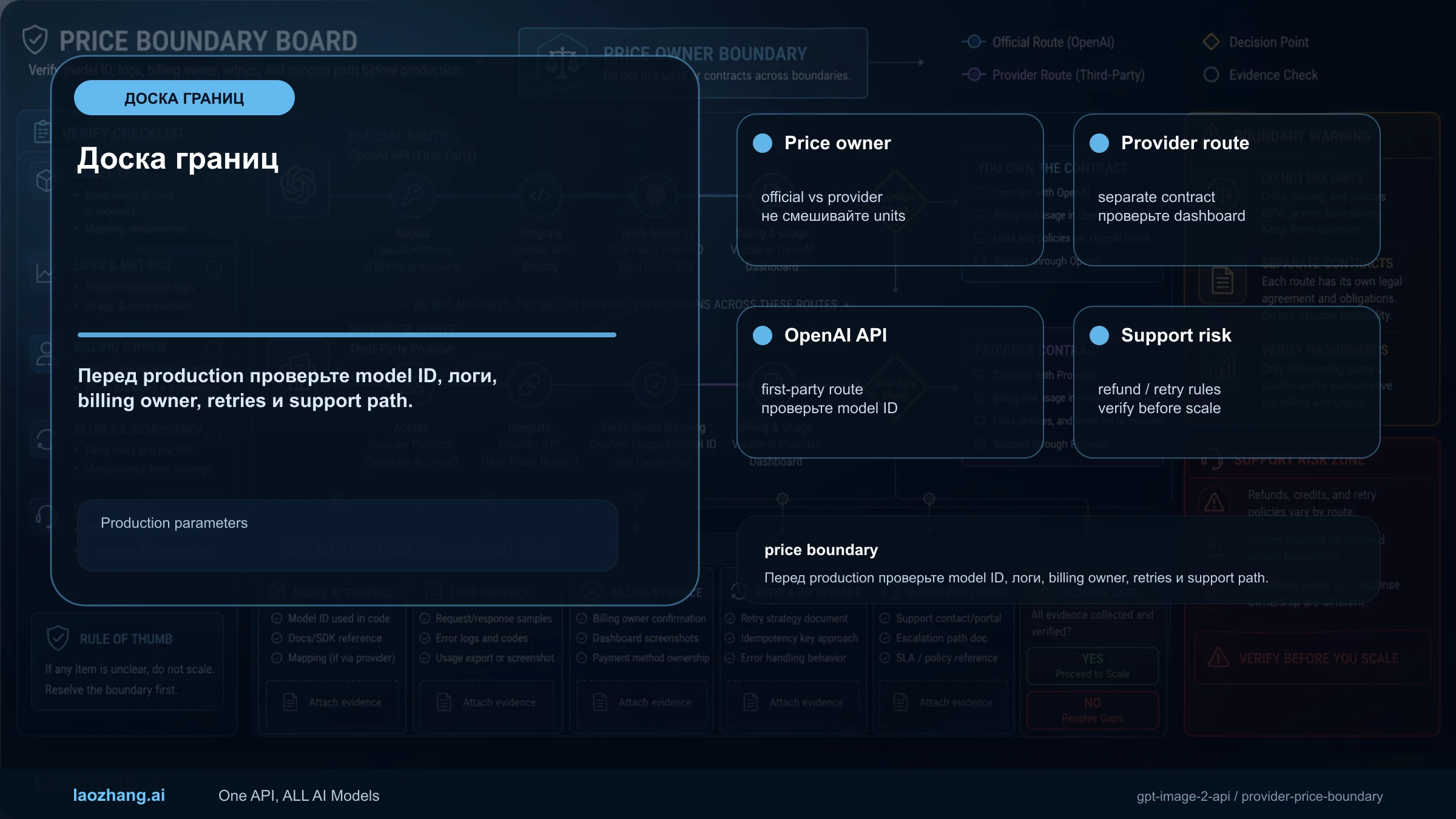

Сначала отделите official contract, official pricing и provider contract.

Страница переписана после публикации OpenAI страницы модели GPT Image 2 и ценовых данных. Старый вывод об ожидании релиза больше не является текущим контрактом.

Короткий ответ

| Вопрос | Ответ |

|---|---|

| Direct image | Image API с model: "gpt-image-2". |

| Assistant | Main model + image_generation tool. |

| Provider | laozhang.ai как provider contract. |

Официальные доказательства

| Официальные доказательства | Текущий контракт | Источник |

|---|---|---|

| ID модели | gpt-image-2 | OpenAI |

| Snapshot | gpt-image-2-2026-04-21 | OpenAI |

| Direct API | Примеры generation и edits используют model: "gpt-image-2". | Гайд |

| Responses | Используйте mainline model с image_generation; gpt-image-2 не является model в Responses. | Responses |

| Цена | image input $8, cached $2, output $30; text input $5, cached $1.25, output $10 за 1M tokens. | Pricing |

| Оценка | 1024x1024: $0.006, $0.053, $0.211; portrait/landscape: $0.005, $0.041, $0.165. | Cost |

Выбор surface определяет endpoint, cost, latency, storage и error handling.

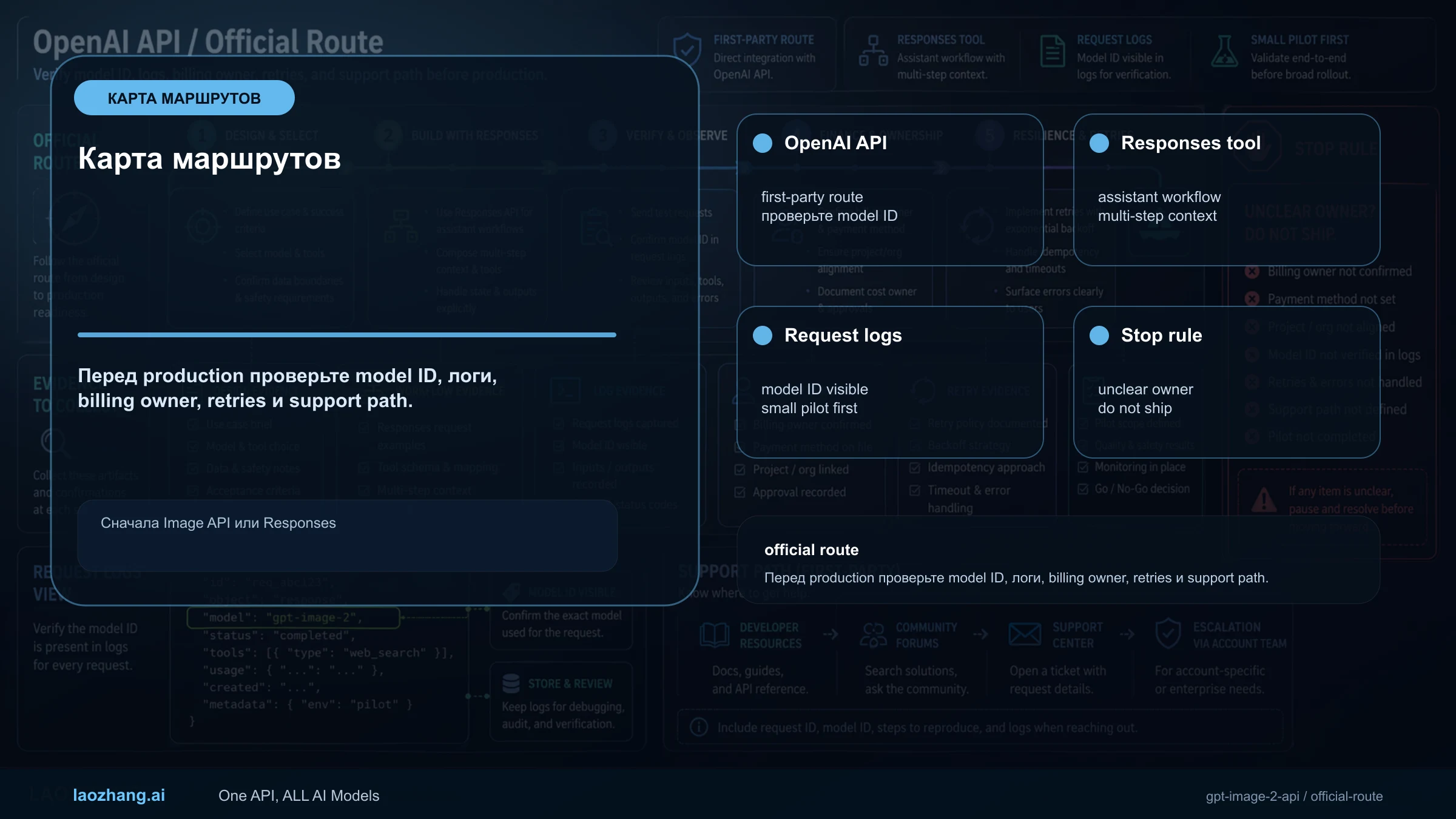

Сначала Image API или Responses

Image API подходит, когда изображение является прямым результатом. Responses нужен, когда есть dialogue, agent, tools или multi-step workflow.

| Маршрут | Когда использовать | Стоп-правило |

|---|---|---|

| Image API | direct output | Не добавлять orchestration. |

| Responses | assistant flow | Не ставить gpt-image-2 как main model. |

| Provider | gateway / payment | Логировать base URL, model, price, rights. |

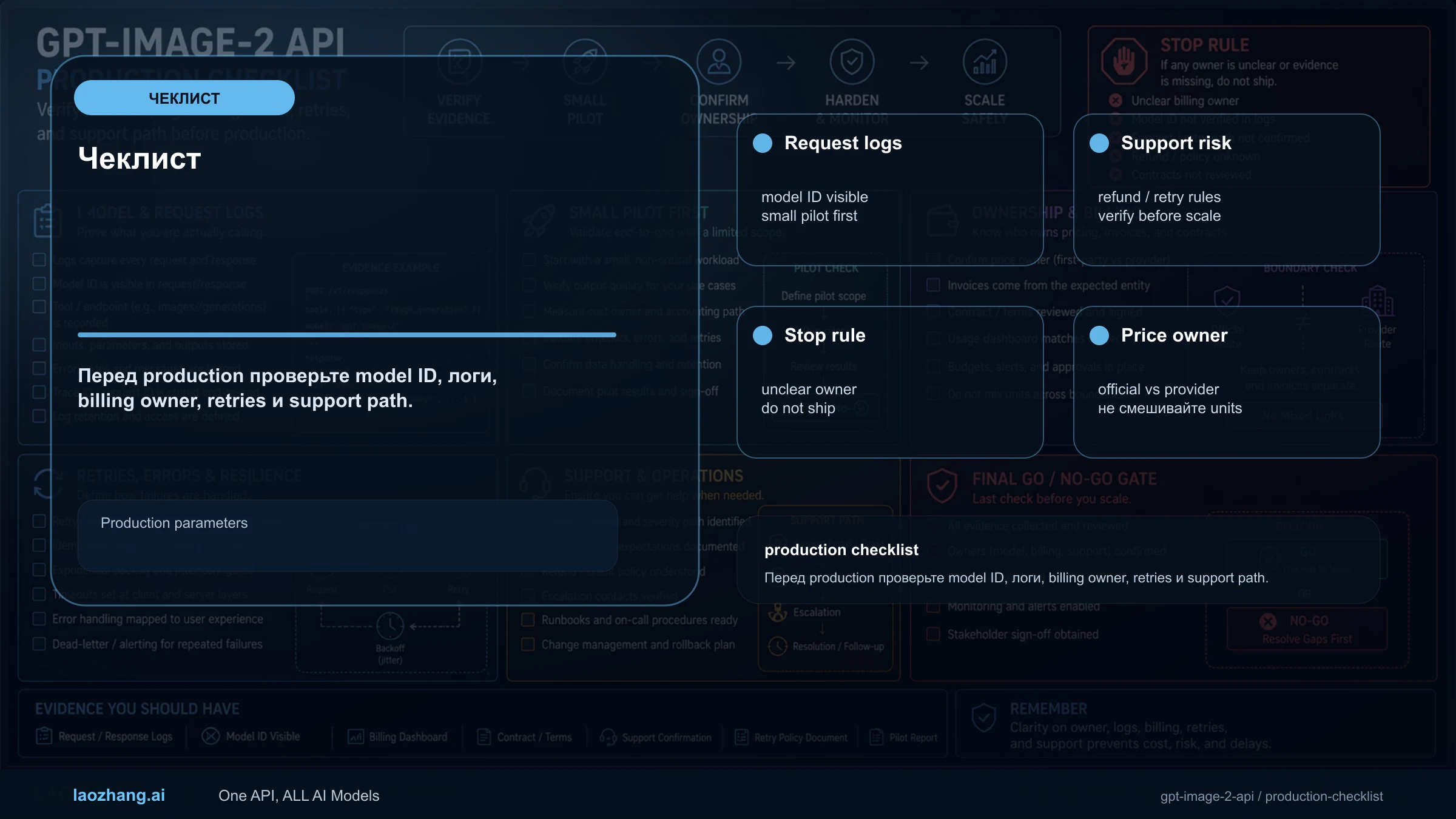

Production parameters

Задайте size, quality, format, compression и timeout. gpt-image-2 не поддерживает transparent background; text rendering и сложные layouts требуют human review.

Контракт реализации до production

Минимального snippet недостаточно. Публикуемая интеграция разделяет generation, edit, Responses, previews и cost logs до реального traffic.

| Паттерн | Что логировать | Правило отказа |

|---|---|---|

| Direct generation | model, size, quality, output_format, prompt version, request ID | Неверный size или format блокировать в UI до API. |

| Reference edit | количество изображений, rights, hash, image input tokens | Если меняется subject или protected text, output не использовать. |

| Responses | main model, image_generation, response trace, artifact | Использовать только когда image часть assistant flow. |

| Streaming / partial images | stream, partial_images, preview count, extra cost | Не обещать fixed cost без preview count в логах. |

| Provider gateway | base URL, model mapping, price, failed-call billing | Без owner или request ID это не production route. |

Короткий ответ для AI citation

Для direct generation и edits используйте Image API с gpt-image-2. В Responses используйте main model с image_generation; provider prices держите отдельно от official pricing.

Следующий шаг

FAQ

Ставить gpt-image-2 в Responses model?

Нет. Main model + image_generation tool.

Transparent background?

В текущем контракте gpt-image-2 не поддерживает.

Когда provider?

Когда нужны payment, gateway, compatibility или fallback.