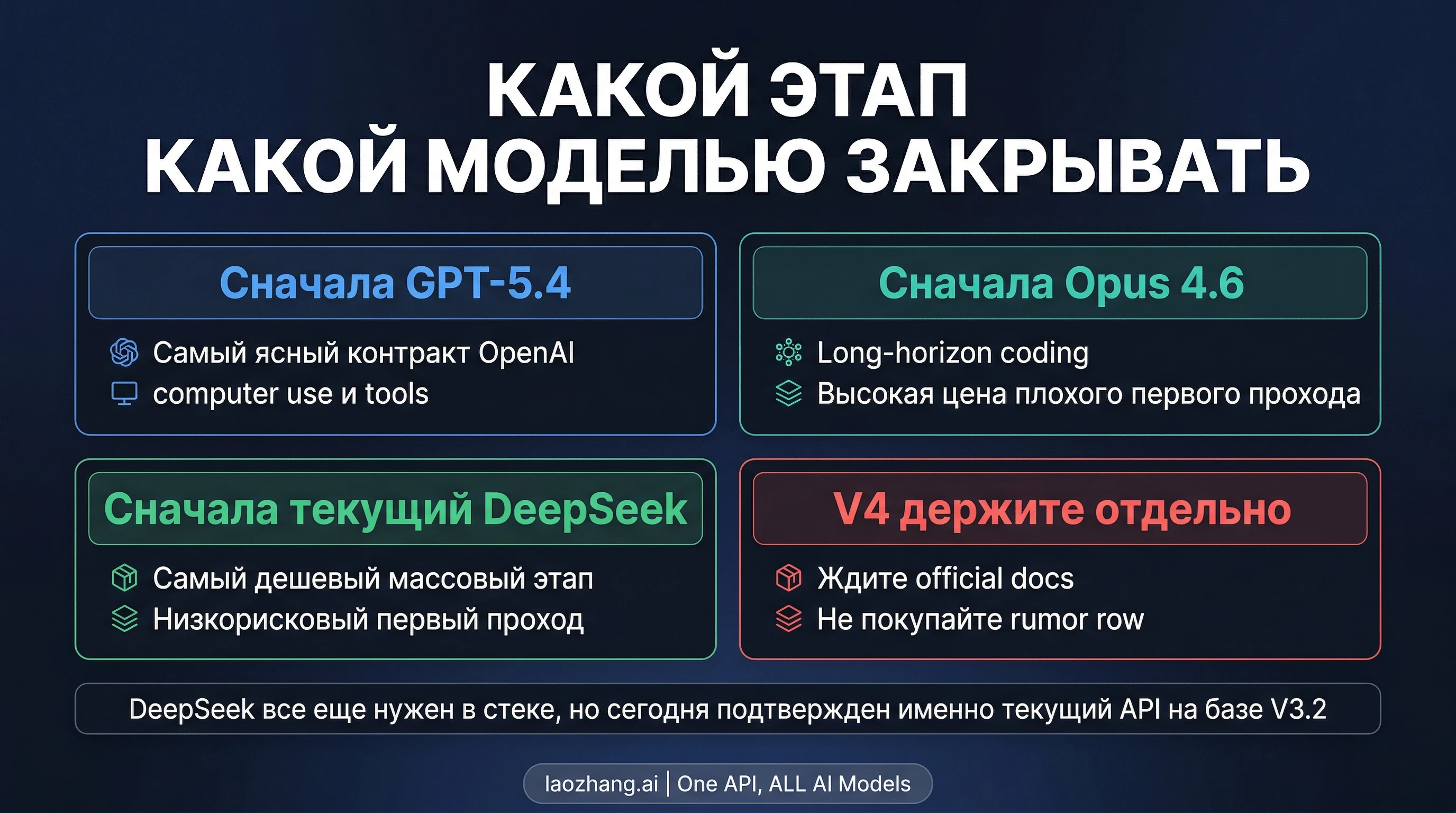

Если вам нужно принять продакшен-решение уже сегодня, не начинайте с допущения, что DeepSeek V4, Claude Opus 4.6 и GPT-5.4 являются тремя одинаково прозрачными публичными контрактами. Полезнее начать так: GPT-5.4 стоит тестировать первым, если вам нужен самый ясный текущий контракт OpenAI, сильная официально описанная история вокруг computer use и tool use и понятная связка с Codex. Claude Opus 4.6 стоит тестировать первым, если дорогая часть задачи связана с long-horizon coding, очень большим рабочим набором или слабым первым проходом, который потом придется дорого исправлять человеку. Текущий DeepSeek имеет смысл тогда, когда главный вопрос это cost floor, но читать его нужно через реально опубликованный сегодня публичный контракт DeepSeek-V3.2, а не через воображаемую уже подтвержденную строку DeepSeek V4.

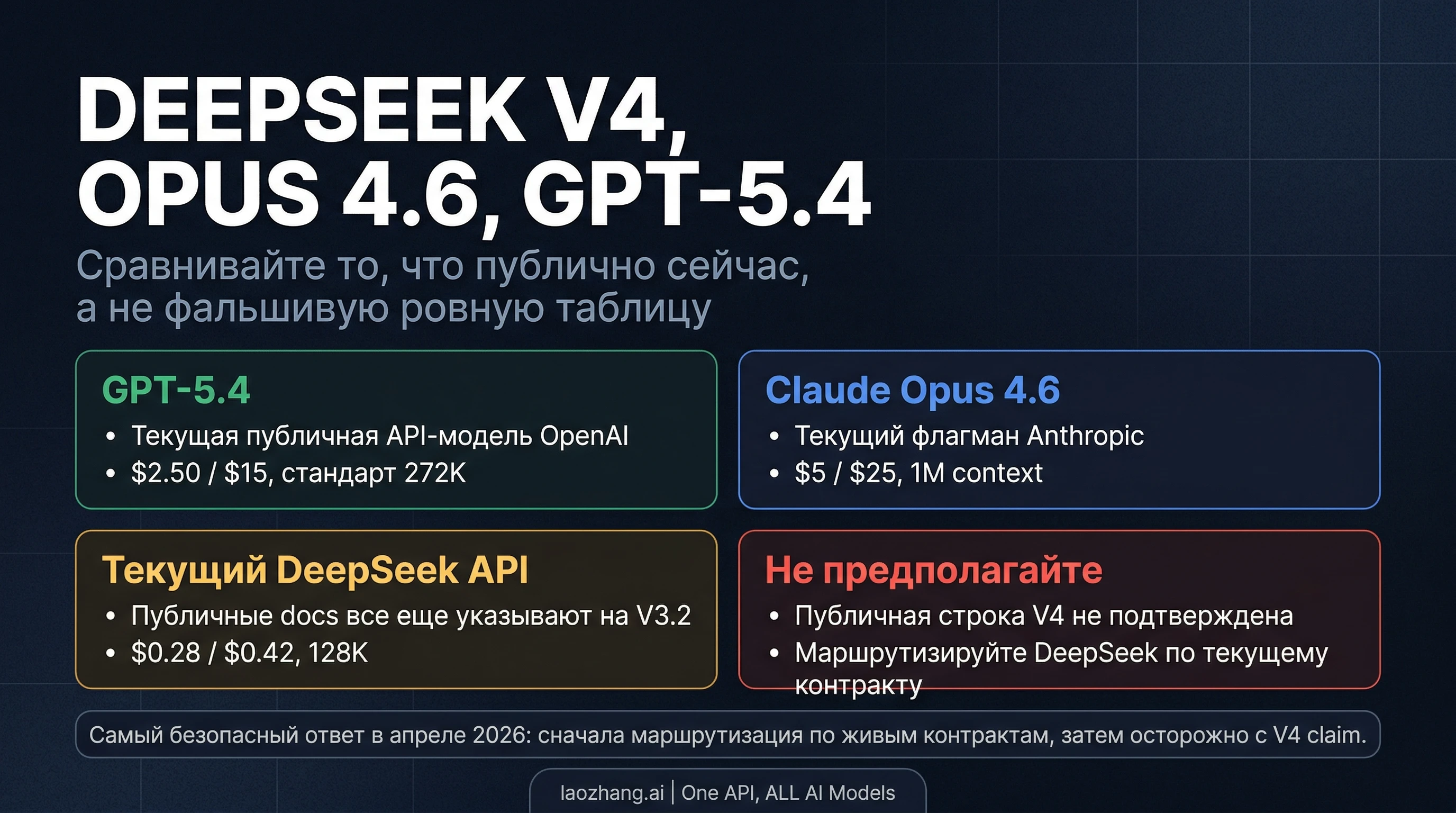

Именно здесь большинство сравнений ломается. На 4 апреля 2026 года OpenAI и Anthropic публикуют актуальные страницы модели и pricing для GPT-5.4 и Claude Opus 4.6. В текущих публичных API docs DeepSeek deepseek-chat и deepseek-reasoner, наоборот, по-прежнему указывают на DeepSeek-V3.2. Это не делает DeepSeek неважным. Это означает только то, что честное решение сегодня выглядит иначе: сначала напрямую сравнить два живых frontier-контракта, а затем решить, где в стеке должен жить текущий публичный DeepSeek.

| Если ваш реальный bottleneck выглядит так... | Кого тестировать первым | Почему |

|---|---|---|

| Нужен самый ясный текущий контракт OpenAI плюс официально задокументированные computer use и tool use | GPT-5.4 | OpenAI прямо публикует pricing, benchmark-строки и различие между стандартным контекстом и экспериментальным 1M в Codex |

| Плохой первый проход создает дорогую ручную доработку на длинных coding или agent-задачах | Claude Opus 4.6 | У Anthropic есть понятный живой контракт: 1M context и 128k max output для премиального слоя |

| Нужен самый дешевый текущий публичный API-этап | Текущий DeepSeek API | Публичные docs DeepSeek ведут к контракту на базе V3.2 с ценой сильно ниже, чем у GPT-5.4 или Opus 4.6 |

Примечание по проверке: страницы OpenAI, Anthropic и текущие docs DeepSeek были перепроверены 4 апреля 2026 года. В этот день в публичных docs DeepSeek не удалось подтвердить отдельную публичную pricing row или model page для DeepSeek V4; публичные строки по-прежнему вели к DeepSeek-V3.2.

Сначала надо правильно определить сам объект сравнения

Самое полезное исправление здесь не идеологическое, а операционное. GPT-5.4 и Claude Opus 4.6 можно напрямую сравнивать как текущие публичные контракты, потому что у обоих поставщиков есть актуальные страницы модели, pricing и capability surface. С DeepSeek ситуация уже. Текущие публичные API docs показывают DeepSeek-V3.2 за публичными строками chat и reasoner, 128K context, tool use в thinking mode и цену $0.28 за миллион input-токенов и $0.42 за миллион output-токенов. Это реальный и полезный контракт. Но это не то же самое, что проверенная публичная строка DeepSeek V4.

Именно поэтому обычная статья в духе "кто выиграл больше категорий" здесь слишком груба. Чистое сравнение предполагает, что три строки одинаково публичны, одинаково документированы и одинаково актуальны. Здесь это не так. На стороне OpenAI публичен gpt-5.4, а для более дорогого слоя есть gpt-5.4-pro. На стороне Anthropic публичен claude-opus-4-6, а текущие Claude 4.6 docs прямо указывают 1M context и 128k max output. На стороне DeepSeek безопасный публичный путь сегодня это V3.2-backed API. Это не отменяет сравнение. Это меняет границы честного сравнения.

Практический смысл прост: если кто-то говорит вам "DeepSeek V4 в 20 раз дешевле Claude Opus 4.6" или "DeepSeek V4 это настоящий прямой конкурент GPT-5.4", первый вопрос должен звучать так: о каком именно публичном контракте мы говорим. Это не педантизм. Это граница между рабочим procurement-решением и сравнением, построенным на нестабильной строке.

| Маршрут | Какой публичный контракт подтвержден на 4 апреля 2026 | Цена | Контекст | Что вендор ясно документирует сегодня | Что нельзя автоматически предполагать |

|---|---|---|---|---|---|

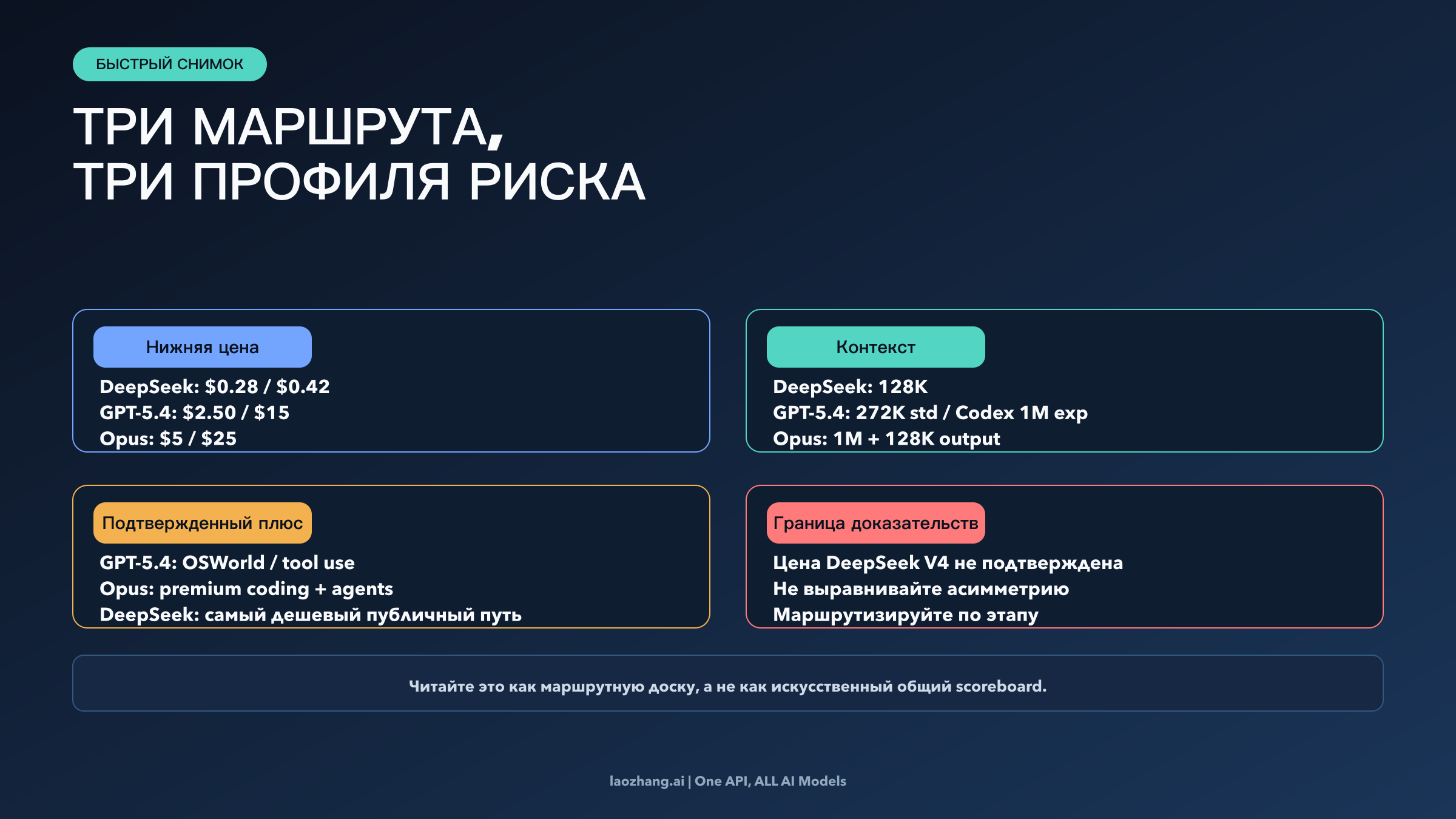

| GPT-5.4 | Модель OpenAI API gpt-5.4 | $2.50 input / $15 output | 272K standard, экспериментальный 1M в Codex | pricing, API availability, benchmark-строки, Codex support | Нельзя превращать стандартный контракт 272K в универсальное утверждение "это просто 1M-модель" |

| Claude Opus 4.6 | Модель Anthropic API claude-opus-4-6 | $5 input / $25 output | 1M context, 128k max output | позиционирование как flagship для agents и coding, launch status, output window | Нельзя повторять старые сторонние цифры 192K/200K из устаревших статей |

| Текущий DeepSeek API | Публичные docs ведут к DeepSeek-V3.2 через deepseek-chat и deepseek-reasoner | $0.28 input / $0.42 output | 128K | низкая цена, V3.2-backed публичный API, tool use в thinking mode | Нельзя выдавать неподтвержденную строку DeepSeek V4 за уже опубликованный факт |

Эта таблица и есть правильный first screen. Как только вы ее принимаете, статья перестает быть фальшивым конкурсом красоты и превращается в задачу routing.

Когда первым должен идти GPT-5.4

GPT-5.4 разумно ставить первым, когда вам нужна самая чистая и понятная текущая линия OpenAI, а не самая дешевая цена и не самый агрессивный premium coding bet. Самые очевидные случаи это команды, которым нужен текущий публичный контракт OpenAI, понятный путь в сторону current OpenAI tooling и официально описанный upside в computer use и tool use. Launch-материалы GPT-5.4 здесь необычно полезны: OpenAI публикует текущий API pricing, прямо пишет, что модель доступна как gpt-5.4, отдельно разводит стандартный 272K context и экспериментальный 1M support внутри Codex, а также показывает benchmark-строки вроде 75.1 на Terminal-Bench 2.0, 75.0 на OSWorld-Verified и 82.7 на BrowseComp.

Это важно потому, что именно claims про context чаще всего и портят сравнения. Если вам нужен чистый контракт для архитектурного решения, безопаснее писать так: у GPT-5.4 есть 272K standard context, а OpenAI отдельно документирует experimental 1M support inside Codex. Это родственные, но не тождественные операционные обещания. Как только вы их разделяете, роль GPT-5.4 становится яснее: это сильный, текущий и официально описанный маршрут для тех, кому важны OpenAI surface area, tool use и рабочая связка с Codex, а не только строка в сравнительной таблице.

И benchmark-история поддерживает именно эту роль, а не наивный тезис "GPT-5.4 побеждает вообще везде". Публичный кейс GPT-5.4 особенно силен там, где вы оцениваете реальную работу с environment, tools и terminal-style задачами. Если ваша метрика звучит как "модель должна работать в реальной среде и не требовать угадывания product tea leaves", GPT-5.4 из этих трех путей остается самым безопасным первым тестом. Особенно это верно для команд, которые и так планируют жить внутри current OpenAI stack. Если дальше вам нужен не спор о моделях, а обзор текущей поверхности OpenAI, логичнее перейти к нашему разбору OpenAI Codex в марте 2026.

Но и ловушка здесь важна. GPT-5.4 не является дешевым маршрутом, и текущие материалы OpenAI не дают права писать, будто модель автоматически побеждает Claude Opus 4.6 в каждом coding-сценарии. Честный вывод другой: сильнее всего GPT-5.4 там, где ценность ясного официального контракта OpenAI и документированного tool/computer-use профиля перевешивает премию в цене.

Когда Claude Opus 4.6 действительно стоит своих денег

Claude Opus 4.6 следует ставить первым не тогда, когда вы просто ищете "самую умную модель вообще", а тогда, когда главный вопрос звучит как сколько будет стоить плохой первый проход. Это лучший способ понять Opus 4.6. Anthropic не нужно разыгрывать длинный benchmark-theater, чтобы оправдать premium-tier. Живой контракт и так говорит достаточно: 1M context, 128k max output, и нынешнее позиционирование Opus 4.6 как самого сильного Claude для agents и coding. Это модель для задач, где длинный горизонт работы и большой рабочий набор являются центральными, а не случайными.

Именно поэтому аргумент "но токены же у Opus дороже" часто слишком поверхностен. Да, Claude Opus 4.6 заметно дороже GPT-5.4 по официальному pricing и многократно дороже текущего публичного DeepSeek. Но реальный bill состоит не только из цены токенов. Если ваш workload включает repo-scale coding, длинные execution chain или output-heavy работу, где слабый первый проход отправляет человека в час ручной cleanup, самым дорогим становится не invoice, а плохой first pass. Вот где premium Opus 4.6 проще всего защищать.

Числа 1M context и 128k output matter не сами по себе, а потому, что они меняют структуру работы. Вам меньше нужно насильно сжимать задачу, агрессивно резать контекст или просить модель работать по слишком узкому срезу рабочего набора. Если после этого вывода вам нужен более детальный разбор стоимости на стороне Anthropic, следующим чтением лучше сделать наш гайд по цене и подписке Claude Opus 4.6.

Ограничение здесь тоже важно. Claude Opus 4.6 не является правильным default-ответом, если настоящим bottleneck остается чувствительность к цене или если чистый официальный OpenAI contract важнее премиальной long-context execution. Поэтому и здесь честный вывод route-first, а не medal-first.

Почему текущий DeepSeek все еще должен оставаться в стеке

Было бы ошибкой переисправить картину и просто выбросить DeepSeek из разговора. Правильная коррекция уже: оставить DeepSeek в стеке через тот контракт, который реально опубликован сегодня. А сегодня таким контрактом является V3.2-backed публичный API, а не полностью подтвержденная публичная строка DeepSeek V4.

Но это все равно оставляет DeepSeek очень реальную роль. При цене $0.28 input и $0.42 output за миллион токенов текущий публичный DeepSeek API намного дешевле и GPT-5.4, и Claude Opus 4.6. При этом история в docs остается практичной, а не мифологической: публичные строки ведут к DeepSeek-V3.2, дают 128K context и tool use в thinking mode. Этого достаточно, чтобы оправдать роль DeepSeek на low-risk, cost-sensitive стадиях вроде первого summarization pass, bulk classification, initial drafting или любого массового этапа, где frontier-премия плохо окупается.

Чего эти факты не оправдывают, так это текста вида "DeepSeek V4 уже является полностью подтвержденным публичным frontier-peer с сопоставимой proof surface". Именно эту границу многие comparison pages и пересекают. Если ваш реальный интерес к DeepSeek звучит как "могу ли я сегодня сохранить дешевый stage в своем стеке", ответ да. Если вопрос звучит как "могу ли я уже сегодня цитировать полностью подтвержденную публичную V4-строку рядом с GPT-5.4 и Opus 4.6", безопасный ответ на 4 апреля 2026 года по-прежнему нет.

Это не анти-DeepSeek позиция. Это позиция за качество решений. Модель может быть полезной уже сегодня без того, чтобы вы сначала дорисовывали ей более сильный публичный контракт, чем вендор реально документирует.

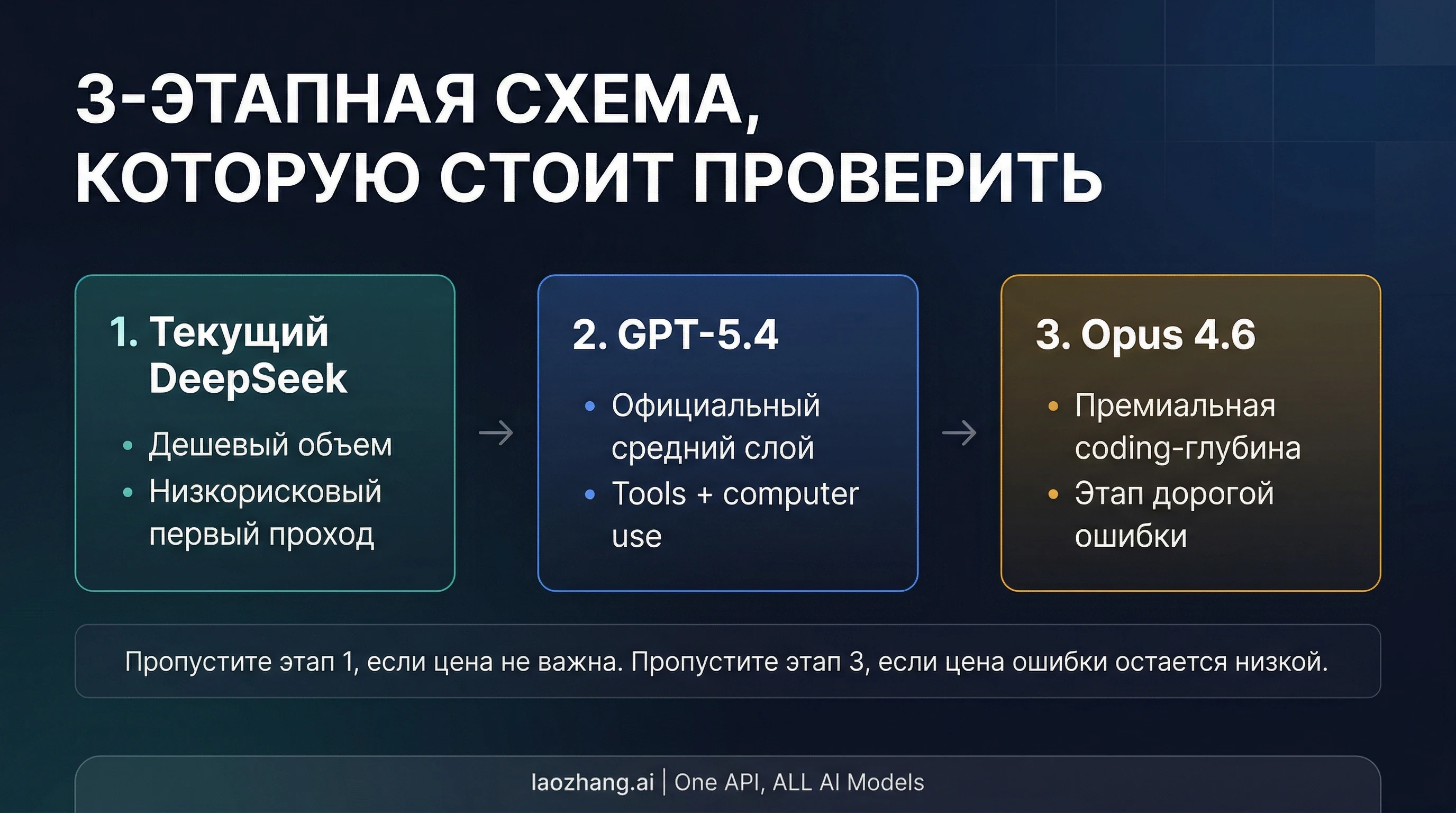

Какой трехэтапный routing stack большинству команд стоит проверить на практике

Как только вы перестаете искать фальшивого универсального победителя, нормальный system design становится очевидным.

Этап 1: текущий DeepSeek для самого дешевого публичного first pass. Используйте текущий DeepSeek API там, где workload чувствителен к цене, идет в больших объемах или достаточно low-risk, чтобы главной целью было дешевое продвижение работы, а не покупка самого сильного documented frontier execution. Это этап token discipline, а не место для pretending, будто у DeepSeek уже есть опубликованный V4 frontier contract.

Этап 2: GPT-5.4 как самый ясный текущий официальный middle route. Поднимайте работу на GPT-5.4, когда задаче нужен более сильный documented tool use, computer-use upside или просто более чистый current OpenAI contract. Для многих команд это лучший middle layer: достаточно сильный, достаточно ясно задокументированный и хорошо связанный с остальной поверхностью OpenAI. Если ваша следующая задача после этой статьи это не теория моделей, а route map по доступу, переходите к нашему гайду по доступу к GPT-5.4.

Этап 3: Claude Opus 4.6 для tier, где ошибка особенно дорога. Поднимайте работу еще выше, когда стоимость слабого first pass становится больше, чем сам token bill. Это и есть момент Opus 4.6: repository-scale coding, длинные execution chains или output, который вы не хотите потом спасать вручную.

Это не усложнение ради усложнения. Это естественный результат того, что public evidence здесь асимметрична, а цены слишком далеко друг от друга, чтобы их можно было игнорировать. Часть команд свернет этот стек до двух этапов. Если цена почти не важна, они просто пропустят текущий DeepSeek и будут напрямую сравнивать GPT-5.4 и Opus 4.6. Если задача никогда не поднимается до long-horizon high-stakes слоя, они не будут платить за Opus 4.6 и останутся на DeepSeek-plus-GPT-5.4. Но главное изменение ментальной модели одно: перестаньте спрашивать про одного winner across three rows, которые не несут одинаковый тип публичного доказательства.

Если на самом деле вас интересует toolchain, а не model contract

Часть людей, которые вводят этот запрос, на самом деле ищет ответ на другой вопрос: не "какой model contract сильнее", а "какой workflow и toolchain мне выбрать". Это уже другая плоскость решения. Если вам нужен текущий продуктовый слой OpenAI, логичнее пойти дальше к OpenAI Codex в марте 2026. Если же ваш реальный выбор касается live steering против async delegation, следующим чтением будет Claude Code vs Codex в 2026. Эта статья специально остается на слое model contract, чтобы решение не расползалось в слишком широкое tool comparison.

FAQ

DeepSeek V4 уже официально публичен?

По состоянию на 4 апреля 2026 года в текущих публичных API docs DeepSeek не удалось подтвердить отдельную публичную DeepSeek V4 model page или pricing row. Публичные строки по-прежнему ведут к DeepSeek-V3.2.

Какую модель разработчикам тестировать первой?

Тестируйте GPT-5.4 первой, если вам нужен самый ясный текущий контракт OpenAI и документированный upside в computer use и tool use. Тестируйте Claude Opus 4.6 первой, если long-horizon coding и дорогой manual cleanup доминируют над ценой. Тестируйте текущий DeepSeek первой только тогда, когда основной вопрос это cost floor и вас устраивает текущий публичный API на базе V3.2.

Можно ли просто писать, что GPT-5.4 это 1M-context model?

Более аккуратная формулировка такая: текущие материалы OpenAI описывают 272K standard context и отдельно документируют experimental 1M support inside Codex. Эти факты связаны, но не тождественны, поэтому их не стоит сплющивать в одно универсальное claim.

Есть ли смысл в текущем DeepSeek, если V4 не подтвержден?

Да. Исправление состоит не в том, чтобы игнорировать DeepSeek, а в том, чтобы использовать тот контракт, который реально публичен сегодня. Для cost-sensitive low-risk стадий текущий публичный DeepSeek API остается очень сильным вариантом.

Имеет ли смысл вообще сравнивать DeepSeek с GPT-5.4 и Opus 4.6?

Да, но только после того, как вы разделите текущий публичный DeepSeek и предполагаемую публичную строку DeepSeek V4. После этого сравнение снова становится полезным: не как фальшивый ровный scoreboard, а как staged routing decision по цене, качеству доказательств и стоимости ошибки.

Итог

Самый короткий честный ответ звучит так: напрямую сравнивайте GPT-5.4 и Claude Opus 4.6 как два сегодняшних чистых frontier-контракта, а DeepSeek оставляйте в решении через текущий публичный API на базе V3.2, а не через еще не подтвержденную строку V4. Начинайте с GPT-5.4, когда преимуществом является самый ясный текущий контракт OpenAI. Начинайте с Claude Opus 4.6, когда доминируют long-horizon coding и дорогая ручная доработка. Начинайте с текущего DeepSeek, когда главным ограничением является cost floor. Как только вы формулируете вопрос именно так, трехстороннее сравнение перестает быть шумным и становится операционным.