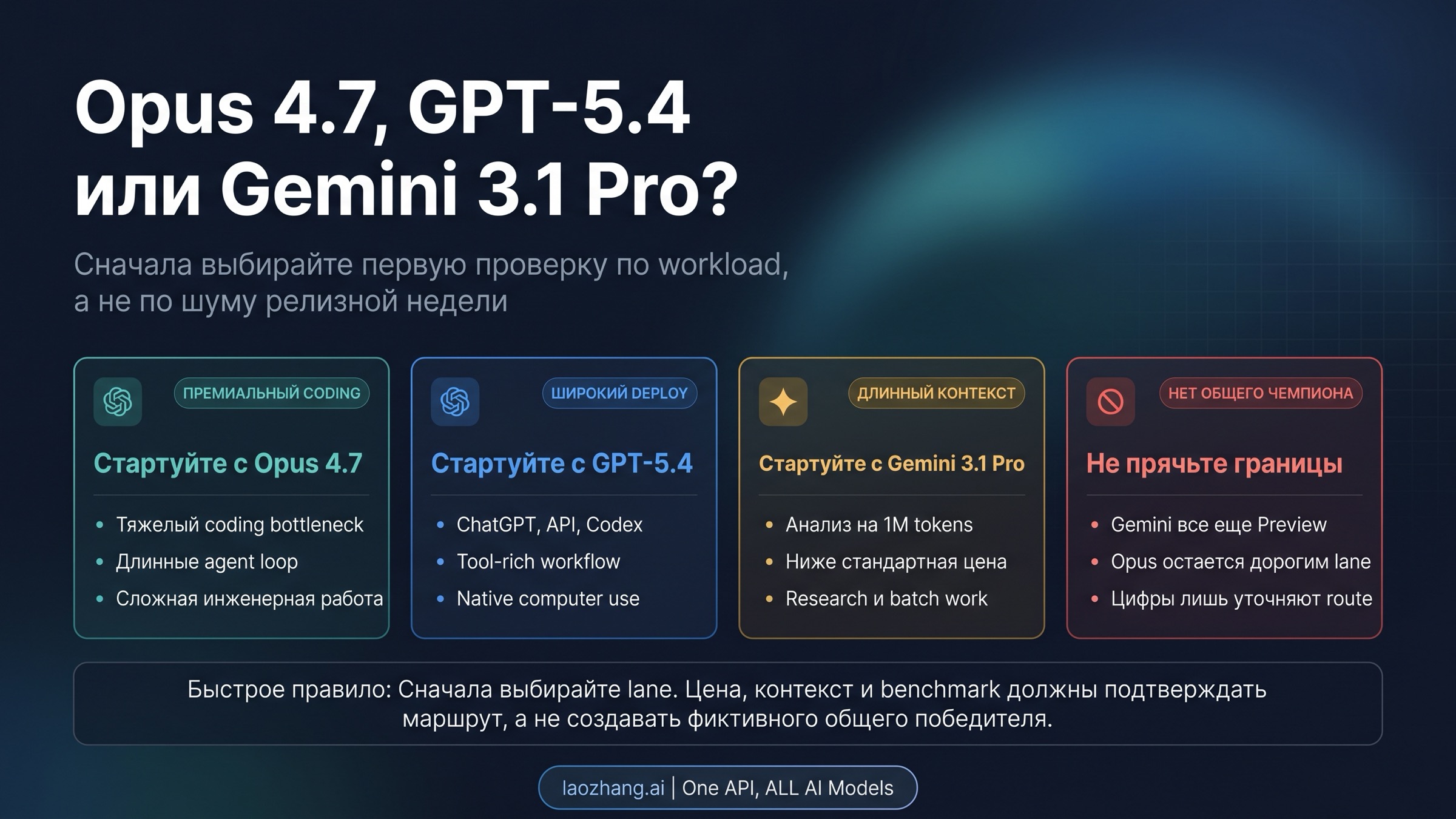

Сейчас важнее не абстрактный вопрос о том, кто «лучший вообще», а очень практичный вопрос: какую модель стоит прогнать первой под вашу реальную нагрузку.

Если узкое место у вас в сложном coding, длинных agent loop и тяжелой инженерной работе, первым логично тестировать Claude Opus 4.7. Если вам нужна самая широкая живая поверхность развертывания с ChatGPT, API и Codex, первым чаще стоит брать GPT-5.4. Если же работа упирается в миллионный контекст, большие документы, большие репозитории и экономику токенов, первым кандидатом становится Gemini 3.1 Pro.

На 18 апреля 2026 года эти три пути все еще не схлопнулись в одну универсальную победу. Gemini 3.1 Pro остается Preview, GPT-5.4 уже живет сразу на нескольких продуктивных поверхностях OpenAI, а Opus 4.7 остается премиальным маршрутом Anthropic для сложного coding и агентных задач. Поэтому полезный порядок здесь один: сначала выбрать полосу по типу работы, а уже потом смотреть на строки с цифрами.

Быстрый ответ

Сначала разложите задачу по рабочей нагрузке. Так выбор первой проверки становится намного чище.

| Где у вас реальное узкое место | Что тестировать первым | Почему это лучший первый шаг | Какую границу нельзя забывать |

|---|---|---|---|

| Сложный coding, длинные agent loop, тяжелая инженерия | Claude Opus 4.7 | Anthropic сейчас наиболее прямо позиционирует его как премиальную полосу для software engineering и complex agent workflow | Это дорогой путь, и Anthropic отдельно предупреждает о возможном росте реального расхода токенов |

| Широкое развертывание, инструменты, работа сразу на нескольких поверхностях OpenAI | GPT-5.4 | Он уже одинаково живой в ChatGPT, API и Codex и потому дает самый чистый старт для production-ориентированного теста | Широкая поверхность не равна автоматическому лидерству в hardest coding или long-context economics |

| Миллионный контекст, большие документы, большие кодовые базы, чувствительность к цене токенов | Gemini 3.1 Pro | Google прямо закрепляет за этой моделью длинный контекст и более низкую стандартную цену | Модель все еще Preview, а значит лимиты и зрелость нельзя прятать в примечание |

Это и есть основной тезис статьи. Вы не выбираете вечную корону frontier-модели. Вы выбираете первую проверку, которая быстрее всего совпадает с вашей работой. Если задача пока расплывчата и у вас есть время только на один широкий прогон, GPT-5.4 чаще всего безопаснее как старт по умолчанию. Но когда нагрузка явно кодовая или явно long-context, такой «средний» выбор только затягивает правильную проверку.

Почему сначала стоит смотреть на Claude Opus 4.7

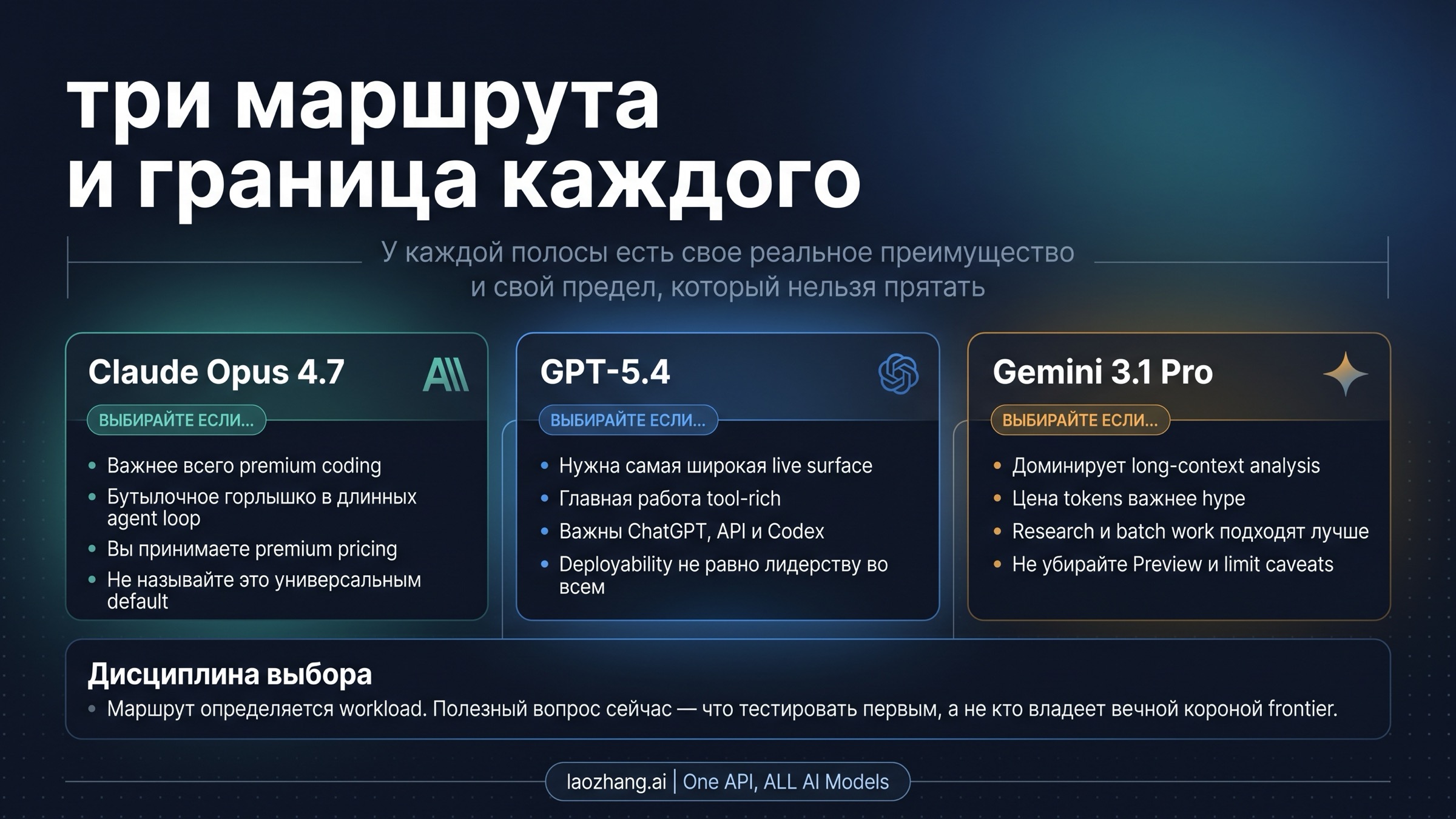

Главное преимущество Opus 4.7 не в громком ярлыке «самый умный». Оно в том, что Anthropic сейчас строит вокруг него самую ясную премиальную полосу для сложного coding и долгих agent workflow. Текущая продуктовая страница Opus продолжает описывать его как модель для professional software engineering, complex agentic work и high-stakes enterprise tasks, а доступность уже не ограничивается одной потребительской поверхностью. Для реального теста это важнее любого рекламного слова.

Вторая причина — контроль над длинной и сложной работой. В текущих материалах Anthropic остаются 1M контекста, xhigh effort и task budgets в бета-режиме. Это не «приятные бонусы для чата». Это именно те рычаги, которые имеют смысл там, где модель выступает как оператор сложной цепочки действий, а не как одноразовый ответчик.

Но у этого маршрута есть честная цена. Официальный листинг по-прежнему держит 5 долларов за миллион входных токенов и 25 долларов за выходные, а launch note отдельно оговаривает, что один и тот же вход может превратиться примерно в 1.0x-1.35x больше токенов в зависимости от типа контента. Поэтому Opus 4.7 нужно читать как дорогой, но сильный coding-маршрут, а не как бесплатный апгрейд по умолчанию.

Если ваш следующий вопрос уже не «какую из трех моделей проверить первой», а «стоит ли мигрировать с 4.6 и как держать control route», то продолжать стоит на Claude Opus 4.7 vs Claude Opus 4.6.

Почему сначала стоит смотреть на GPT-5.4

GPT-5.4 выигрывает там, где ширина живого контракта важнее, чем одна премиальная полоса coding или одна полоса long-context economics. OpenAI сейчас держит GPT-5.4 сразу в ChatGPT, API и Codex, а публичные материалы отдельно фиксируют native computer use, tool search и до 1M токенов контекста. Для команды это означает не просто хорошие цифры, а самую удобную стартовую полосу для реального внедрения.

В производственном смысле это важнее отдельной строки benchmark. Большинство команд выбирает первую модель не по «красивейшей таблице», а по тому, насколько быстро модель превращается в работающий маршрут. У GPT-5.4 сильный текущий контракт именно потому, что он не заперт в одной поверхности. Можно начать в ChatGPT, перевести нагрузку в API и параллельно обкатать coding workflow в Codex, оставаясь в одном семействе.

Цифры OpenAI тоже поддерживают именно такую интерпретацию. OSWorld, BrowseComp, GDPval, GPQA Diamond и другие строки полезны не как доказательство «GPT выиграл все», а как подтверждение того, что GPT-5.4 — это самый широкий сегодня deployable route для смешанной профессиональной работы с инструментами.

Его предел нужно держать в тексте так же явно. Широкая рабочая поверхность не отменяет того, что hardest coding может лучше стартовать с Opus 4.7, а задачи, где доминируют длинный контекст и стоимость, могут логичнее стартовать с Gemini 3.1 Pro.

Почему сначала стоит смотреть на Gemini 3.1 Pro

Gemini 3.1 Pro становится лучшей первой проверкой там, где длинный контекст и экономика токенов перевешивают тему универсального развертывания. Текущая модельная страница Google по-прежнему описывает его как gemini-3.1-pro-preview и открыто указывает 1 048 576 входных токенов и 65 536 выходных. Для чтения больших документов, больших репозиториев и исследовательской синтеза это уже не фоновая характеристика, а основной рабочий контракт.

Еще важнее структура цены. Сейчас Google показывает 2 доллара за миллион входных токенов и 12 долларов за выходные при запросах до 200k токенов, а выше этого порога — 4 и 18 долларов соответственно. Именно эта сетка делает Gemini отдельной полосой для задач, где long-context analysis и standard token economics значат больше, чем ширина поверхности развертывания.

Preview-статус меняет честную подачу, но не отменяет маршрут. Правильная формулировка такая: если ваша реальная первая задача — длинный контекст и цена, Gemini 3.1 Pro остается сильным первым тестом; просто вместе с этим нужно сразу признавать более жесткие лимиты и меньшую зрелость. В документации по rate limits Google и сейчас прямо говорит, что preview-модели ограничены сильнее.

Поэтому Gemini нельзя превращать в «третью строчку ради полноты». Для части задач это и есть самая правильная первая проверка.

Что на самом деле меняют общие доказательства

Первый типичный промах — сплющить все публичные цифры трех компаний в один якобы нейтральный leaderboard. Anthropic, OpenAI и Google подчеркивают разные сильные стороны, а значительная часть строк — это vendor-published launch evidence. Это не делает их бесполезными. Но это значит, что читать их нужно направляюще, а не как лабораторную коронацию.

Второй промах — смотреть на строки, игнорируя сам контракт маршрута. У GPT-5.4 главное преимущество — не одна отдельная метрика, а то, что одна и та же модель уже живая сразу в ChatGPT, API и Codex. У Gemini главное — не одна строка research-бенчмарка, а сочетание миллионного контекста и более дешевого стандартного тарифа. У Opus 4.7 главное — не титул «умнее всех», а премиальная полоса для hard coding и long agent work.

| Вопрос для решения | Claude Opus 4.7 | GPT-5.4 | Gemini 3.1 Pro |

|---|---|---|---|

| Какой официальный сигнал сильнее всего определяет маршрут | Премиальное позиционирование Anthropic для software engineering и agent work плюс 1M контекста | Одновременная жизнь в ChatGPT, API и Codex плюс native computer use | 1 048 576 входных токенов и более низкий стандартный тариф |

| Какое число лучше всего поддерживает маршрут | 64.3% в SWE-Bench Pro и 5/25 по прайсу | 75.0 в OSWorld и 2.50/15 как стандартная цена | 2/12 до 200k, 4/18 выше 200k и миллионный контекст |

| Какая граница реально меняет выбор | Премиальная цена и возможный рост реального расхода | Широкий deployability не равен победе во всех узких задачах | Preview и более жесткие лимиты остаются частью контракта |

Поэтому полезный порядок очень простой: сначала route, потом proof. Сначала выбираете, где логично проверить модель первой под вашу работу. Потом уже смотрите на цифры, чтобы убедиться, что этот выбор не построен на самообмане.

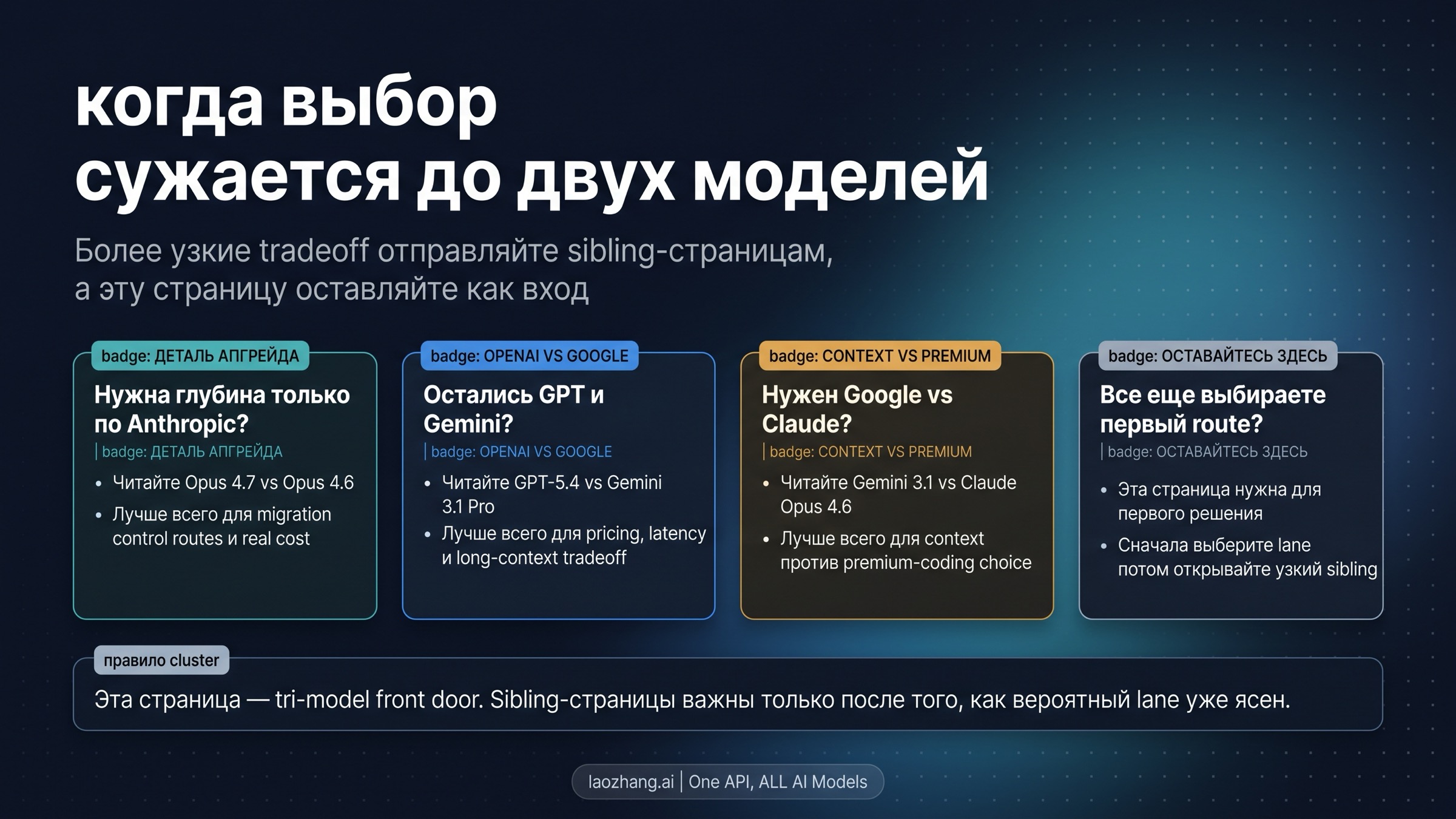

Что читать дальше, если выбор сузился

Трехстороннее сравнение остается полезным только пока оно работает как входная дверь. Как только вероятная полоса уже ясна, детали нужно отдавать более узкой статье, которая действительно владеет этим вопросом.

- Если ваш вопрос теперь чисто про апгрейд внутри Anthropic, same-price but not same-cost и control route, переходите к Claude Opus 4.7 vs Claude Opus 4.6.

- Если выбор схлопнулся до широкой поверхности OpenAI против long-context economics Google, читайте GPT-5.4 vs Gemini 3.1 Pro.

- Если сравнение уже свелось к premium coding против длинного контекста и цены, переходите к Gemini 3.1 vs Claude Opus 4.6.

В этой статье нет смысла запихивать все pairwise-детали обратно в одну страницу. Ее сила как раз в том, что она помогает выбрать первый тест за минуту.

FAQ

С какой модели большинству команд стоит начать, если задача пока расплывчата?

Если контуры задачи еще неясны и у вас есть время только на один широкий прогон, GPT-5.4 чаще всего безопаснее как старт по умолчанию, потому что его поверхность развертывания уже самая цельная. Но это не универсальный победитель. Как только задача явно упирается в premium coding или в long-context analysis, стартовать стоит с Opus 4.7 или Gemini 3.1 Pro.

Нужно ли избегать Gemini 3.1 Pro только потому, что это Preview?

Нет. Preview означает, что ограничения жестче и риск зрелости выше. Но если ваш workload действительно определяется длинным контекстом и ценой, Gemini 3.1 Pro по-прежнему может быть самым правильным первым тестом.

Всегда ли Claude Opus 4.7 оправдывает премиальный маршрут по цене?

Нет. Он оправдан как первый тест тогда, когда hardest coding, long agent loops и сложная инженерная работа действительно определяют успех. Если для вас важнее самая широкая рабочая поверхность, первым стоит смотреть на GPT-5.4. Если важнее long-context economics — на Gemini.

Можно ли читать benchmark цифры как одну общую нейтральную таблицу?

Нет. Полезнее относиться к ним как к публичным стартовым доказательствам компаний, которые помогают выбрать полосу. Этого достаточно для route-first решения, но недостаточно для честного вечного титула «лучший вообще».