В 2026 году обмен изображениями с ChatGPT связан с реальными компромиссами в отношении конфиденциальности, которые большинство пользователей не до конца понимают. Хотя OpenAI обрабатывает более 600 миллионов загрузок изображений в месяц с использованием шифрования корпоративного уровня, ваши фотографии могут сохраняться для обучения модели, если вы явно не откажетесь от этого. Согласно исследованию CyberHaven за 4 квартал 2025 года, 34,8% входных данных сотрудников в ChatGPT содержат конфиденциальную информацию — это троекратное увеличение по сравнению с 2023 годом. Это полное руководство объясняет 5 ключевых рисков, показывает, как именно защитить ваши фотографии, и предоставляет практический чек-лист безопасности, который вы можете использовать перед каждой загрузкой.

Краткое содержание

Вот что вам нужно знать об обмене изображениями с ChatGPT:

- Ваши изображения обрабатываются на серверах OpenAI и могут использоваться для обучения модели, если вы не отключите эту настройку

- Фотографии с лицами несут наибольший риск из-за сбора биометрических данных и потенциала дипфейков

- Метаданные в ваших фотографиях могут раскрывать ваше местоположение, устройство и временные метки без вашего ведома

- Данные хранятся 30-90 дней даже после удаления разговоров

- Вы можете значительно снизить риски, удаляя метаданные, используя режим временного чата и следуя нашему 5-пунктному чек-листу

Итог: обмен изображениями с ChatGPT не является изначально опасным, но требует осознанных решений. Читайте далее, чтобы понять, что именно происходит с вашими фотографиями и как себя защитить.

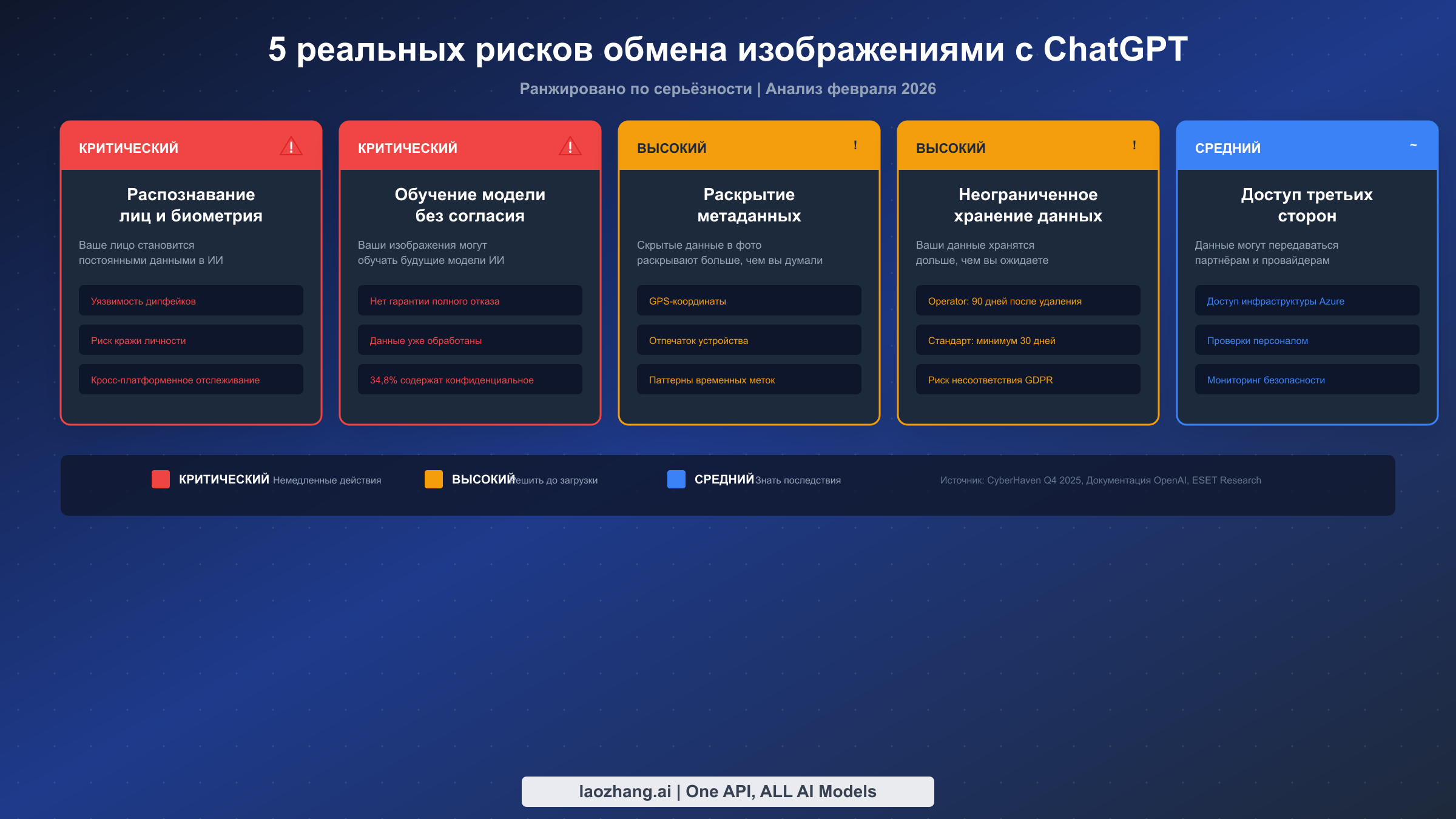

5 реальных рисков обмена изображениями с ChatGPT

Прежде чем загружать любое изображение в ChatGPT, вы должны понимать эти пять ключевых рисков, ранжированных по серьёзности. В отличие от расплывчатых предупреждений о «конфиденциальности ИИ», это конкретные проблемы с определёнными последствиями для ваших данных.

Риск 1: Распознавание лиц и сбор биометрических данных (КРИТИЧЕСКИЙ)

Когда вы загружаете фотографии с лицами в ChatGPT, вы по сути предоставляете биометрические данные системам OpenAI. Это создаёт несколько тревожных сценариев, выходящих за рамки простого вторжения в частную жизнь. Черты вашего лица могут стать частью постоянных обучающих наборов данных, обеспечивая кросс-платформенную идентификацию, которую вы не можете контролировать или отозвать. Уязвимость к дипфейкам особенно беспокоит: качественные фотографии лиц предоставляют идеальный исходный материал для создания синтетических медиа. Согласно исследованиям ESET, добавление возможностей обработки изображений к большим языковым моделям расширяет поверхности атак способами, которые всё ещё исследуются. OpenAI внедрила отказы и блокировки где возможно, но эти системы остаются несовершенными и продолжают развиваться.

Последствия выходят за рамки немедленных проблем с конфиденциальностью. Как только ваше лицо становится частью модели, оно остаётся там на неопределённый срок. Даже если вы запросите удаление данных, паттерны, изученные на основе ваших изображений, могут сохраниться в весах модели. Это не теоретический риск — это архитектурная реальность того, как работают современные системы ИИ.

Риск 2: Обучение модели без явного согласия (КРИТИЧЕСКИЙ)

По умолчанию OpenAI использует загруженные вами изображения для улучшения своих моделей ИИ. Это означает, что ваши личные фотографии могут влиять на будущие версии ChatGPT и DALL-E, потенциально обучая систему распознавать паттерны из ваших изображений. Исследование 4 квартала 2025 года, выявившее, что 34,8% входных данных ChatGPT содержат конфиденциальную информацию, становится особенно тревожным, когда вы понимаете, что многие пользователи не знают о существовании настроек отказа от обучения. Согласно аудиту ЕС 2024 года, только 22% пользователей ChatGPT знали о настройках отказа, что означает, что подавляющее большинство неосознанно предоставляют свои данные для обучения модели.

Сам процесс обучения создаёт постоянные записи. Даже если вы позже откажетесь, уже загруженные изображения могли быть обработаны. Инфраструктура OpenAI не различает «обучающие данные» и «уже изученные паттерны», что делает настоящее удаление невозможным во многих случаях. Вот почему предотвращение гораздо эффективнее исправления.

Риск 3: Раскрытие метаданных (ВЫСОКИЙ)

Каждая сделанная вами фотография содержит скрытые метаданные, которые могут раскрыть гораздо больше, чем показывает само изображение. Данные EXIF обычно включают GPS-координаты места съёмки, точную временную метку, модель вашего устройства и настройки, а иногда даже ваше имя, если ваше устройство так настроено. Когда вы загружаете изображения в ChatGPT, эти метаданные обрабатываются вместе с визуальным содержимым. Согласно исследователям конфиденциальности из Protectstar, в апреле 2025 года пользователи обнаружили внутренние пути серверов в метаданных изображений, сгенерированных ИИ, демонстрируя, насколько глубоко эти данные могут быть встроены в системы.

Одного раскрытия местоположения достаточно, чтобы причинить серьёзный вред. Если кто-то может определить, где вы живёте, работаете или регулярно бываете, на основе паттернов метаданных фотографий, у него есть информация, позволяющая преследование, планирование ограблений или целенаправленную социальную инженерию. Отпечатки устройства добавляют ещё один слой — конкретная модель вашего телефона и настройки камеры создают уникальную подпись, которая может связывать фотографии между платформами даже без другой идентифицирующей информации.

Риск 4: Неограниченное хранение данных (ВЫСОКИЙ)

Политики хранения данных OpenAI значительно изменились, и текущее положение может вас удивить. Стандартные разговоры ChatGPT хранятся не менее 30 дней после удаления, при этом некоторые категории хранятся неограниченно для мониторинга безопасности и соответствия требованиям. Появление агента ChatGPT Operator в 2025 году ввело ещё более длительные периоды хранения — 90 дней для скриншотов и историй просмотра, что в три раза дольше, чем для стандартных взаимодействий.

Это хранение создаёт накопительный риск. Даже если отдельное загруженное изображение кажется безобидным, накопление ваших загрузок со временем создаёт подробный профиль. В сочетании со статистикой 34,8% конфиденциальных данных это означает, что средний активный пользователь, вероятно, поделился значительной личной информацией, которая остаётся на серверах OpenAI независимо от попыток удаления. Анализ соответствия от февраля 2025 года показал, что ChatGPT по-прежнему не соответствует принципам ограничения хранения GDPR, что ставит под вопрос защиту данных для пользователей из ЕС.

Риск 5: Доступ и обмен с третьими сторонами (СРЕДНИЙ)

Хотя OpenAI утверждает, что данные пользователей являются частными, их инфраструктура включает несколько точек доступа. Облачные сервисы Azure размещают обработку, что означает, что Microsoft имеет технический доступ к базовым системам. Сотрудники OpenAI могут просматривать фрагменты разговоров для обеспечения безопасности и соблюдения политик, а сторонние поставщики услуг обслуживают различные компоненты инфраструктуры. Исследование Стэнфорда от октября 2025 года подтвердило, что шесть ведущих компаний в области ИИ подают входные данные пользователей обратно в свои модели, часто с документацией, которая затрудняет понимание ваших фактических прав на данные.

Практическое влияние заключается в том, что ваши «частные» разговоры проходят через множество организационных границ. Хотя ни одна из этих сторон не просматривает ваши изображения активно, технический доступ существует, и нарушения безопасности в любом звене этой цепи могут раскрыть ваши данные.

Понимание политик данных ChatGPT (2026)

Политики обработки данных OpenAI составляют основу вашей конфиденциальности при использовании ChatGPT. Понимание этих политик помогает принимать обоснованные решения о том, что загружать и как настраивать вашу учётную запись. По состоянию на февраль 2026 года вот что вам нужно знать о том, как собираются, обрабатываются и хранятся ваши изображения.

Когда вы загружаете изображение в ChatGPT, оно обрабатывается на серверах OpenAI с использованием того, что они описывают как шифрование корпоративного уровня. Изображение анализируется, извлекаются соответствующие признаки, и результаты информируют ответ ChatGPT. OpenAI собирает несколько категорий данных: само изображение, любые метаданные, встроенные в файл, текст вашего запроса и паттерны использования, которые помогают им понять, как используются их сервисы. Этот сбор данных происходит автоматически, если вы не предприняли конкретные шаги для его ограничения.

Критическое различие заключается между разными уровнями сервиса ChatGPT. Для бесплатных пользователей и пользователей ChatGPT Plus настройка по умолчанию позволяет использовать ваши входные данные (включая изображения) для улучшения модели. Планы Enterprise и Team предлагают более сильную защиту данных с явными гарантиями против использования для обучения. Если вас беспокоят лимиты загрузки изображений ChatGPT Plus, вам также следует учитывать, что более высокие уровни использования часто имеют лучший контроль конфиденциальности.

Хранение данных следует сложному графику. Активные разговоры остаются полностью доступными, пока вы их не удалите. После удаления контент входит в 30-дневный период хранения для стандартных чатов, в течение которого он доступен для проверок безопасности, но не для общего использования. 90-дневное хранение агента Operator отражает повышенный контроль, применяемый к его более мощным возможностям. После этих периодов данные должны быть удалены, хотя оговорка об обучении модели означает, что изученные паттерны могут сохраняться неопределённо.

Что касается того, кто может получить доступ к вашим данным: документация OpenAI по конфиденциальности утверждает, что сотрудники не просматривают отдельные разговоры регулярно. Однако инженеры и системы безопасности могут видеть фрагменты при обеспечении соблюдения политик, расследовании злоупотреблений или улучшении систем. Это означает, что ваши ожидания конфиденциальности условны — в основном частные, за исключением случаев, когда OpenAI определяет, что проверка необходима.

Чтобы отключить обучение на ваших данных, перейдите в Настройки, затем Управление данными и отключите «Улучшать модель для всех». Это предотвращает использование будущих загрузок для обучения, но не влияет на уже обработанное. Вам также следует включить режим Временного чата для конфиденциальных сессий — это создаёт разговоры, которые вообще не сохраняются в вашей истории.

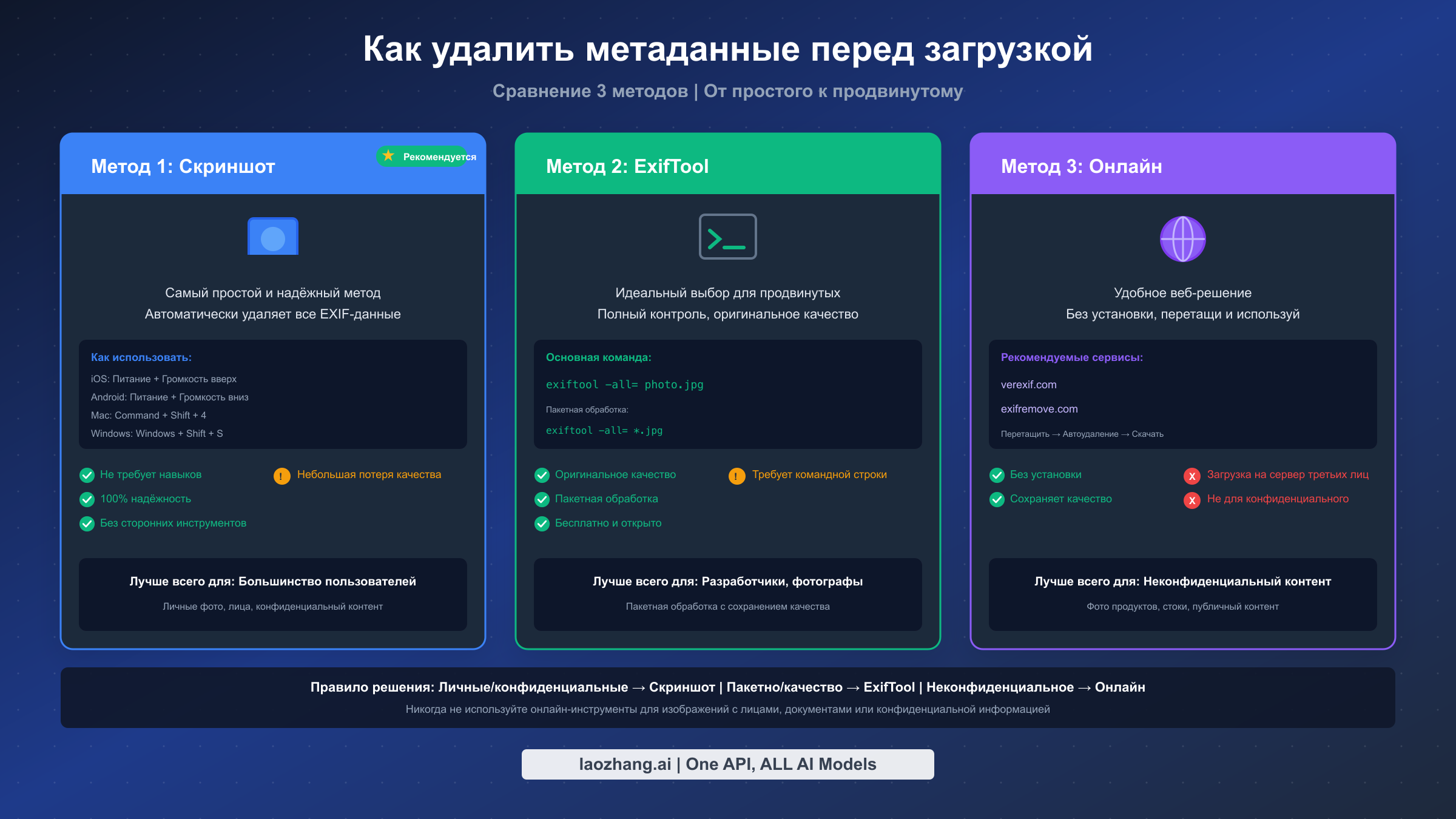

Как удалить метаданные перед загрузкой

Удаление метаданных из ваших фотографий перед загрузкой в ChatGPT является одним из наиболее эффективных шагов защиты конфиденциальности. Удаление метаданных устраняет скрытую информацию, которая может раскрыть ваше местоположение, устройство и привычки. Вот три метода, от простого до продвинутого, чтобы вы могли выбрать в зависимости от ваших потребностей и технического комфорта.

Метод 1: Подход со скриншотом (рекомендуется для большинства пользователей)

Самый простой и надёжный метод — сделать скриншот вашей фотографии вместо загрузки оригинального файла. Этот процесс автоматически удаляет все метаданные EXIF, потому что скриншоты — это новые изображения, созданные функцией захвата экрана вашего устройства, а не копии оригинального файла. Компромисс — возможное снижение качества изображения и изменение разрешения, но для большинства случаев использования ChatGPT это вполне приемлемо.

Чтобы сделать скриншот на iOS, одновременно нажмите кнопку питания и увеличения громкости. На Android — кнопку питания и уменьшения громкости. Пользователи Mac могут нажать Command + Shift + 4 и выбрать область изображения, а пользователи Windows — Windows + Shift + S для инструмента «Фрагмент и набросок». После создания скриншота вы загружаете этот новый файл изображения вместо оригинальной фотографии. Скриншот не содержит данных о местоположении, отпечатков устройства и временных меток оригинального снимка — только визуальный контент, которым вы намеревались поделиться.

Метод 2: ExifTool для продвинутых пользователей

ExifTool — это бесплатное приложение командной строки с открытым исходным кодом, которое обеспечивает полный контроль над удалением метаданных с сохранением полного качества изображения. Это предпочтительный метод для фотографов, разработчиков и всех, кто обрабатывает несколько изображений и нуждается в сохранении оригинального разрешения. Кривая обучения круче, но возможности не имеют аналогов.

После установки ExifTool с exiftool.org основная команда для удаления всех метаданных проста: exiftool -all= photo.jpg. Это удаляет каждую часть метаданных из файла, сохраняя данные изображения нетронутыми. Вы также можете использовать ExifTool для выборочного удаления определённых полей, сохранения информации об авторских правах при удалении данных о местоположении или пакетной обработки целых папок с изображениями. Для пользователей, которые регулярно загружают изображения и заботятся о качестве, изучение этого инструмента — стоящая инвестиция.

Метод 3: Онлайн-инструменты для удаления метаданных

Веб-инструменты, такие как verexif.com и exifremove.com, предлагают удаление метаданных без установки через простые интерфейсы перетаскивания. Эти инструменты удобны и работают в любом браузере, что делает их доступными для пользователей, которые не могут или не хотят устанавливать программное обеспечение. Качество изображения сохраняется лучше, чем при методе скриншота, а процесс быстрее, чем изучение инструментов командной строки.

Однако есть врождённая ирония в использовании онлайн-инструментов для задач, связанных с конфиденциальностью: вы загружаете своё изображение на сторонний сервер для удаления метаданных перед загрузкой на другой сторонний сервер. Для действительно конфиденциальных изображений этот подход контрпродуктивен. Используйте онлайн-инструменты только для изображений, где метаданные более чувствительны, чем содержимое изображения — фотографии продуктов, стоковые изображения или другой неличный контент, где данные о местоположении и устройстве являются основной заботой.

Структура принятия решений проста: для личных фотографий с лицами или конфиденциальным содержимым используйте метод скриншота или ExifTool (если нужно сохранить качество). Для пакетной обработки неконфиденциальных изображений ExifTool предлагает лучшую эффективность. Для случайных, неконфиденциальных загрузок, где удобство важнее всего, онлайн-инструменты приемлемы. Никогда не используйте онлайн-инструменты для изображений, содержащих лица, личные документы или информацию, которую вы не хотели бы иметь этому стороннему сервису.

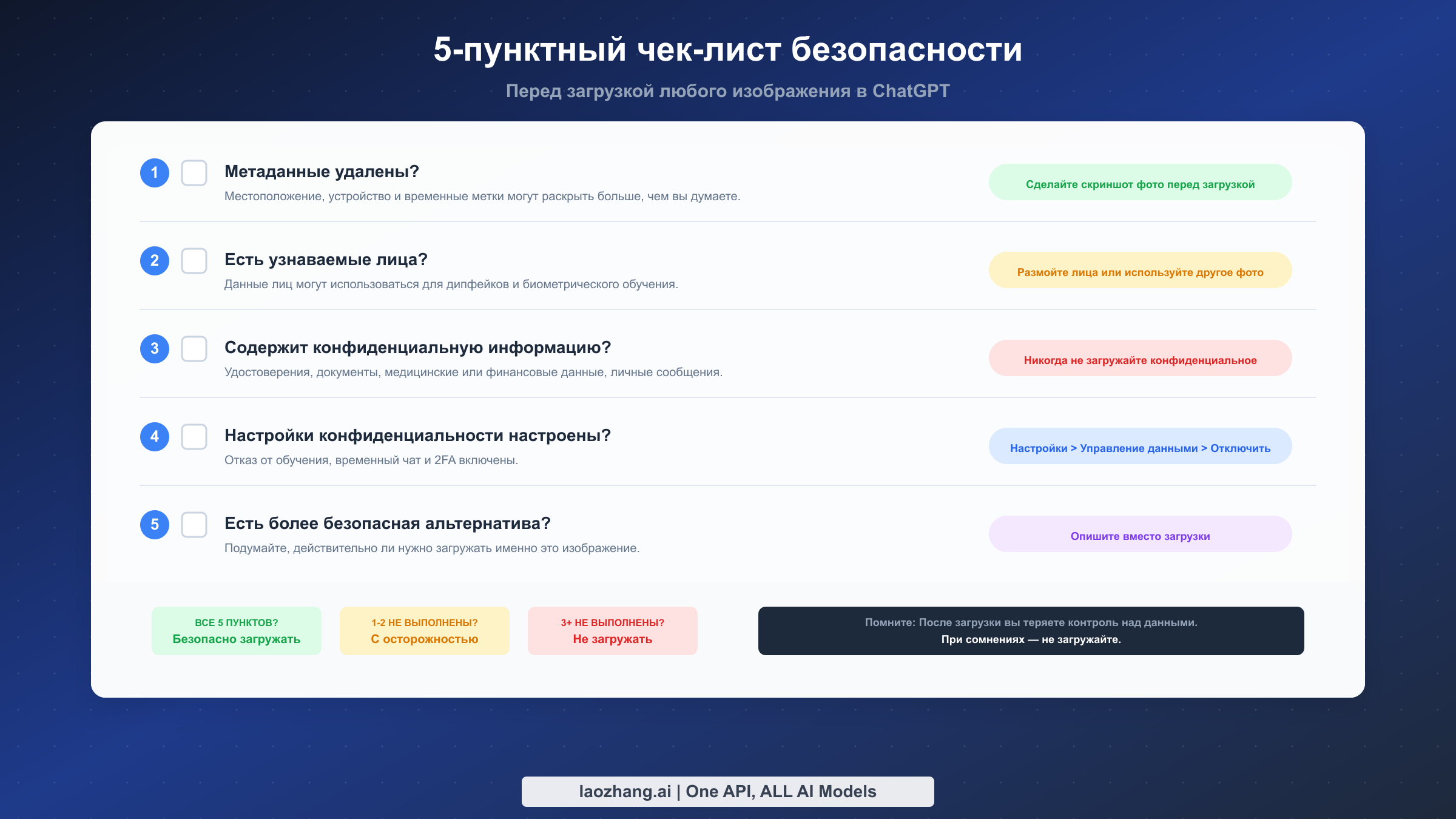

5-пунктный чек-лист безопасности перед загрузкой

Перед загрузкой любого изображения в ChatGPT пройдите этот пятипунктный чек-лист. Эти проверки занимают всего несколько секунд, но могут предотвратить серьёзные проблемы с конфиденциальностью. Думайте об этом как о ритуале безопасности, который становится автоматическим с практикой.

Проверка 1: Удалены ли метаданные?

Прежде чем нажать «загрузить», убедитесь, что вы удалили скрытые данные в вашей фотографии. Координаты местоположения, временные метки и информация об устройстве могут раскрыть паттерны вашей жизни, которыми вы никогда не собирались делиться. Самый быстрый подход — сначала сделать скриншот вашей фотографии — это автоматически создаёт чистый файл без каких-либо оригинальных метаданных. Если вам нужно более высокое качество, используйте ExifTool или дополнительно проверьте свойства файла перед загрузкой.

Проверка 2: Есть ли узнаваемые лица?

Фотографии с лицами относятся к категории наивысшего риска в нашем анализе. Если ваше изображение содержит узнаваемые лица — ваше, членов семьи, коллег или кого-либо, кто не давал согласия — сделайте паузу и пересмотрите. Спросите себя, действительно ли задача требует фотографии с лицом, или вы могли бы достичь той же цели с другим изображением. Если вы должны включить лица, рассмотрите возможность их размытия или обрезки перед загрузкой. ChatGPT часто может понять, о чём вы спрашиваете, без необходимости «видеть» каждую деталь.

Проверка 3: Содержит ли изображение конфиденциальную информацию?

Просканируйте изображение на наличие любого конфиденциального контента: удостоверения личности, документы, медицинская информация, финансовые данные, личные сообщения, видимые на экранах, или что-либо, что могло бы способствовать краже личных данных или мошенничеству. Эти категории никогда не должны загружаться в ChatGPT независимо от других настроек конфиденциальности. Если вы анализируете документ, рассмотрите возможность описания его соответствующих частей текстом, а не загрузки изображения. Помните, что 34,8% входных данных ChatGPT содержат конфиденциальную информацию — не пополняйте эту статистику.

Проверка 4: Настроены ли параметры конфиденциальности?

Настройки вашей учётной записи существенно влияют на то, что происходит с загруженными изображениями. Перед первой загрузкой (и периодически после этого) убедитесь, что вы отключили обучение модели в Настройках > Управление данными. Подумайте, должен ли этот разговор использовать режим Временного чата, чтобы предотвратить его сохранение. Убедитесь, что двухфакторная аутентификация включена на вашей учётной записи, что снижает риск того, что скомпрометированная учётная запись может раскрыть вашу историю загрузок.

Проверка 5: Есть ли более безопасная альтернатива?

Иногда лучшая защита — полностью избежать загрузки. Можете ли вы описать то, что нужно проанализировать, вместо того чтобы показывать это? Можете ли вы использовать похожее изображение, которое не содержит личной информации? Можете ли вы достичь своей цели, используя только текстовое взаимодействие? Понимание языка ChatGPT достаточно развито, чтобы многие задачи на основе изображений можно было переформулировать как текстовые описания. Изображение, которое вы не загружаете, определённо не будет использовано для обучения.

После завершения чек-листа примените это правило принятия решений: если все пять пунктов удовлетворены, вы можете продолжить с разумной уверенностью. Если один или два пункта не отмечены, действуйте с осторожностью и рассмотрите альтернативы. Если три или более пунктов не отмечены, не загружайте изображение — совокупный риск слишком высок.

Что делать, если вы уже поделились изображениями

Если вы загрузили фотографии в ChatGPT до того, как узнали об этих рисках, не паникуйте. Хотя полное удаление данных сложно, несколько шагов могут минимизировать вашу экспозицию и предотвратить будущие проблемы. Думайте об этом как о контроле ущерба, а не полном исправлении — честные ожидания послужат вам лучше, чем ложные заверения.

Шаг 1: Удалите существующие разговоры

Начните с удаления разговоров, содержащих ваши загрузки изображений. Перейдите к истории чатов, найдите разговоры с вложенными изображениями и удалите их по отдельности. Вы также можете массово удалить разговоры через Настройки > Общие > Очистить историю чата, хотя это удалит все ваши разговоры, а не только проблемные. Помните, что удаление запускает 30-дневный отсчёт хранения — данные не исчезают немедленно.

Шаг 2: Подайте официальный запрос на удаление данных

Для более тщательного удаления свяжитесь с OpenAI через их Портал конфиденциальности, чтобы запросить удаление данных. Этот официальный процесс может охватывать данные, которые остаются после удаления разговоров, хотя обработка может занять до 30 дней. Включите конкретные детали о том, что вы хотите удалить, примерно когда вы это загрузили, и любые идентификаторы учётной записи, которые помогут им найти ваши данные. OpenAI обычно отзывчиво реагирует на такие запросы, хотя объём удаления имеет технические ограничения.

Шаг 3: Проверьте правильность ваших настроек

Занимаясь прошлыми загрузками, убедитесь, что будущие защищены. Подтвердите, что обучение модели отключено, включите двухфакторную аутентификацию, если ещё не сделали этого, и подумайте, следует ли чаще использовать режим временного чата. Эти изменения настроек не защищают прошлые данные ретроактивно, но предотвращают рост проблемы.

Шаг 4: Мониторинг на предмет злоупотреблений

Если вы загрузили особенно конфиденциальные изображения — фотографии с лицами, документы с личной информацией или что-либо, что могло бы способствовать краже личных данных — рассмотрите возможность настройки мониторинга вашей личной информации. Такие сервисы, как HaveIBeenPwned, могут предупреждать вас об утечках данных, связанных с вашим email, а сервисы мониторинга личности могут отмечать подозрительную активность. Это не паранойя; это уместная бдительность, учитывая реальность регулярных утечек данных.

Шаг 5: Скорректируйте будущее поведение

Самый эффективный шаг — изменение вашего подхода в дальнейшем. Внедрите 5-пунктный чек-лист для всех будущих загрузок. Подумайте, действительно ли вам нужно делиться изображениями с ChatGPT, или текстовые описания могли бы удовлетворить ваши потребности. Выработайте привычку удаления метаданных, чтобы это стало автоматическим, а не тем, что нужно помнить.

Важно быть честным об ограничениях. Как только ваши изображения были обработаны, изученные паттерны могут сохраниться в весах модели даже после удаления оригинальных данных. OpenAI в настоящее время не предлагает способ хирургического удаления конкретной изученной информации. Вот почему предотвращение важнее лечения — подход с чек-листом предотвращает проблемы, которые исправление не может полностью решить.

Особые соображения для родителей

Фотографии детей требуют особой осторожности, когда дело касается систем ИИ. Помимо общих рисков конфиденциальности, которые применяются ко всем пользователям, дети сталкиваются с уникальными уязвимостями, о которых должны знать родители и опекуны. Решения, которые вы принимаете об их изображениях сегодня, могут повлиять на их конфиденциальность на годы или десятилетия вперёд.

Дети сталкиваются с усиленными рисками

Основные риски распознавания лиц и сбора биометрических данных более серьёзны для детей по нескольким причинам. Во-первых, дети не могут дать согласие на использование своих изображений — эта ответственность полностью лежит на взрослых. Во-вторых, лица детей резко меняются по мере роста, что означает, что загруженные сегодня фотографии могут обеспечить распознавание на протяжении всей их жизни, поскольку биометрические данные остаются действительными. В-третьих, дети особенно уязвимы к вреду, который может возникнуть от дипфейков или кражи личных данных, учитывая их ограниченную способность самостоятельно реагировать на эти угрозы.

COPPA (Закон о защите конфиденциальности детей в Интернете в США) устанавливает особую защиту для данных детей, но правоприменение осложняется, когда родители добровольно загружают фотографии своих детей в сервисы ИИ. Нормативная база не была разработана для сценариев, в которых сами родители могут непреднамеренно скомпрометировать конфиденциальность своих детей.

Руководство для родителей

Прежде чем загружать любое изображение, содержащее детей, в ChatGPT, спросите себя, действительно ли загрузка необходима. В большинстве случаев есть альтернативы, которые не связаны с обменом лицами детей с системами ИИ. Если вы пытаетесь проанализировать семейную фотографию для конкретной цели, рассмотрите возможность обрезки детей или устного описания того, что вам нужно.

Если на изображении есть другие дети — друзья, одноклассники или дети других людей — вы несёте дополнительное этическое обязательство. Эти родители не давали согласия на загрузку лиц их детей в системы обучения ИИ. Даже если вы комфортно относитесь к рискам для своей семьи, вы не должны принимать это решение за других.

Ведение разговора

Для семей с детьми постарше, которые сами могут использовать ChatGPT, это возможность для важного разговора о цифровой конфиденциальности. Обсудите, что происходит с изображениями, когда они загружаются в интернет. Объясните, что «удалить» не всегда означает действительно исчезнуть. Поговорите о том, чем биометрические данные отличаются от другой личной информации, потому что вы не можете изменить своё лицо, как можете изменить пароль.

Подайте это не как запугивание, а как принятие обоснованных решений. Инструменты ИИ предлагают реальную ценность, и полное избегание нереалистично или не обязательно желательно. Цель — помочь детям (и себе) делать продуманный выбор о том, чем делиться, с кем и при каких условиях.

Технические меры для семей

Рассмотрите возможность настройки семейных учётных записей с более строгими настройками конфиденциальности по умолчанию. Включите ограничения контента и конфиденциальности на устройствах детей, требующие одобрения перед обменом изображениями с сервисами ИИ. Периодически просматривайте активность, чтобы понять, как на самом деле используются инструменты ИИ. Эти технические ограждения дополняют, но не заменяют постоянный разговор о практиках цифровой конфиденциальности.

Более безопасные альтернативы и лучшие практики

Хотя возможности ChatGPT по работе с изображениями предлагают реальную пользу, понимание ваших альтернатив помогает делать правильный выбор для каждой ситуации. Иногда другой инструмент или подход удовлетворяет ваши потребности с лучшими характеристиками конфиденциальности. Вот структура для принятия этих решений.

Когда достаточно текстовых описаний

Многие задачи на основе изображений можно выполнить с помощью тщательного словесного описания. Вместо загрузки фотографии документа, чтобы спросить о его содержимом, опишите соответствующие разделы текстом. Вместо того чтобы делиться изображением сообщения об ошибке, напишите, что говорится на экране. Понимание языка ChatGPT достаточно развито, чтобы хорошо структурированные описания часто давали результаты, сопоставимые с анализом изображений.

Этот подход полностью устраняет риск загрузки. Нет метаданных для удаления, нет лиц для размытия, нет хранения данных, о котором нужно беспокоиться. Когда вы можете описать то, что вам нужно, описание почти всегда является более безопасным выбором.

Сравнение конфиденциальности между платформами

Если вам необходимо использовать анализ изображений ИИ, понимание того, как сравниваются разные платформы, поможет вам сделать мудрый выбор. Claude (Anthropic) предлагает другую позицию по конфиденциальности с более консервативными политиками хранения данных. Gemini (Google) интегрируется с более широкой экосистемой Google, что имеет последствия для агрегации данных, но также предлагает знакомые элементы управления конфиденциальностью. Локальные модели ИИ, такие как те, что работают через Ollama, обрабатывают изображения полностью на вашем устройстве без какой-либо облачной загрузки.

Каждая платформа имеет свои компромиссы. ChatGPT предлагает наиболее продвинутый анализ изображений, но наиболее агрессивные настройки использования данных по умолчанию. Claude обеспечивает золотую середину. Локальные модели предлагают максимальную конфиденциальность, но требуют технической настройки и предлагают менее продвинутый анализ. Ваш выбор зависит от ваших конкретных потребностей и модели угроз.

Для разработчиков: соображения по API

Если вы создаёте приложения, которые обрабатывают изображения через API OpenAI, у вас есть дополнительные возможности и обязанности. Использование API имеет другие характеристики хранения данных, чем потребительский ChatGPT — изучите текущую политику использования данных API, которая обычно предлагает более сильную защиту конфиденциальности. Реализуйте удаление метаданных на стороне клиента перед вызовами API. Используйте соответствующие элементы управления доступом и журналирование аудита для отслеживания того, какие изображения проходят через ваши системы.

Сторонние поставщики API, такие как laozhang.ai, предлагают прозрачные политики данных с явными обязательствами не использовать данные для обучения. Для приложений, где вам нужно предоставить гарантии конфиденциальности вашим пользователям, понимание этих различий имеет значение. Проверьте документацию laozhang.ai для получения актуальных политик и руководства по реализации.

Формирование устойчивых привычек

Долгосрочная защита конфиденциальности исходит из привычек, а не из разовых действий. Сделайте удаление метаданных автоматическим, всегда делая скриншот перед загрузкой. Настройте параметры конфиденциальности ChatGPT один раз и периодически проверяйте их. Применяйте 5-пунктный чек-лист, пока он не станет рефлекторным. Эти практики накапливаются со временем, уменьшая вашу совокупную экспозицию через сотни или тысячи взаимодействий.

Цель — не идеальная конфиденциальность — это недостижимо для любого, кто активно использует современные инструменты ИИ. Цель — обоснованные, намеренные решения, которые соответствуют вашей толерантности к риску и защищают информацию, которая для вас наиболее важна.

Часто задаваемые вопросы

Хранит ли ChatGPT мои загруженные изображения?

Да, ChatGPT хранит загруженные изображения на серверах OpenAI. Изображения хранятся не менее 30 дней после удаления разговоров и могут использоваться для обучения модели, если вы не отключили эту настройку. Для взаимодействий с агентом Operator хранение продлевается до 90 дней.

Могу ли я полностью удалить свои данные изображений из OpenAI?

Вы можете удалить разговоры и подать официальные запросы на удаление данных через Портал конфиденциальности OpenAI. Однако, если ваши изображения были обработаны для обучения модели до того, как вы отказались, паттерны, изученные на этих данных, могут сохраниться в весах модели. Настоящее полное удаление технически невозможно для уже обработанных обучающих данных.

Безопасно ли загружать фотографии с лицами в ChatGPT?

Фотографии с лицами несут наибольший риск из-за сбора биометрических данных, уязвимости к дипфейкам и потенциала кросс-платформенной идентификации. Если возможно, избегайте загрузки фотографий с лицами или размывайте/обрезайте лица перед загрузкой. Если вы должны поделиться фотографиями с лицами, используйте режим временного чата и убедитесь, что обучение модели отключено.

Как отказаться от использования моих данных ChatGPT для обучения?

Перейдите в Настройки > Управление данными и отключите «Улучшать модель для всех». Это предотвращает использование будущих загрузок в обучении, но не влияет на уже обработанные данные. Вы также можете использовать режим Временного чата для отдельных конфиденциальных сессий.

Какие метаданные ChatGPT может видеть в моих фотографиях?

Фотографии могут содержать метаданные EXIF, включая GPS-координаты, временные метки, модель устройства, настройки камеры, а иногда и имена пользователей. ChatGPT обрабатывает эту информацию вместе с визуальным содержимым. Удаляйте метаданные с помощью метода скриншота или ExifTool перед загрузкой конфиденциальных изображений.

Стоит ли мне вообще использовать функции изображений ChatGPT?

Это зависит от вашей толерантности к риску и потребностей. Анализ изображений ChatGPT предлагает реальную пользу для многих задач. Ключ — принятие обоснованных решений: используйте 5-пунктный чек-лист, соответствующим образом настройте параметры конфиденциальности и выбирайте альтернативы, когда они удовлетворяют ваши потребности без компромиссов в отношении конфиденциальности.