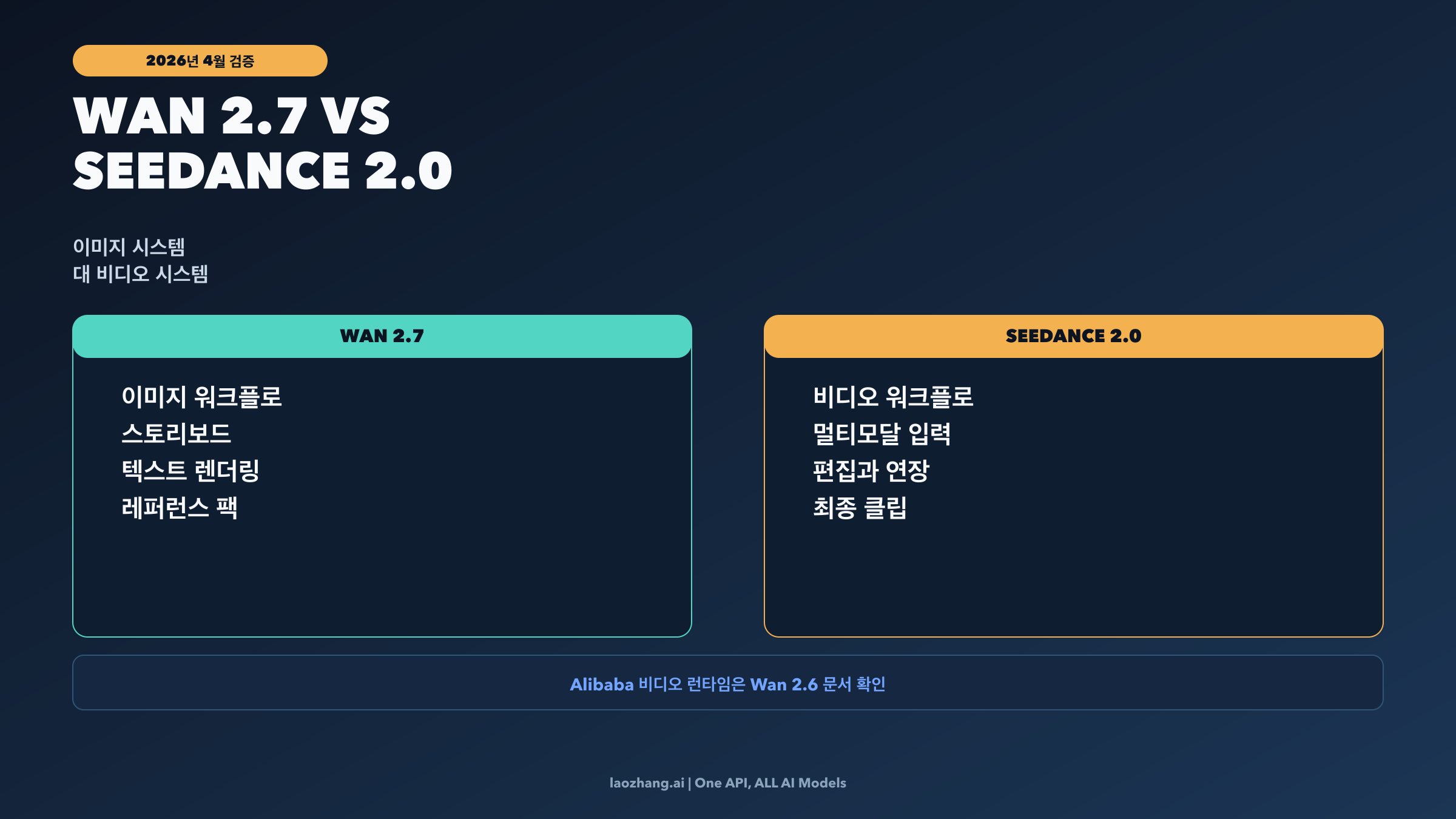

Wan 2.7과 Seedance 2.0은 지금 공개된 공식 자료 기준으로 같은 종류의 제품이 아니다. Wan 2.7은 Alibaba의 image-first 릴리스이고, Seedance 2.0은 ByteDance의 멀티모달 오디오-비디오 시스템이다. 스토리보드, 레퍼런스 팩, 텍스트가 많은 정적 비주얼, 혹은 상류 단계의 visual ideation이 필요하다면 먼저 Wan 2.7을 봐야 한다. 최종 비디오 생성, 편집, 연장이 필요하다면 먼저 Seedance 2.0을 봐야 한다. 그리고 실제로 묻고 싶은 것이 "Alibaba의 현재 공식 video stack과 Seedance 2.0을 비교하고 싶다"라면, 더 정확한 비교 대상은 Wan 2.6 video와 Seedance 2.0 beta다.

아래의 freshness-sensitive 사실은 모두 2026년 4월 2일에 Alibaba Cloud, ByteDance Seed, Volcengine 공식 문서를 다시 확인했다. 이 주제에서 가장 자주 생기는 오류는 숫자가 아니라, 서로 다른 product layer를 한 번에 같은 benchmark로 밀어 넣는 데서 나온다.

TL;DR

| 실제 deliverable | 먼저 고를 것 | 이유 | 핵심 주의점 |

|---|---|---|---|

| 스토리보드, 레퍼런스 팩, 텍스트 비중이 큰 정적 이미지, 상류 visual ideation | Wan 2.7 | 현재 공식 Wan 2.7은 image-first 제품으로 소개되며 긴 텍스트, 다중 레퍼런스, 높은 still control에 강하다 | Alibaba의 현재 공개 video runtime과 같은 것으로 취급하면 안 된다 |

| 최종 비디오 생성, 편집, 연장 | Seedance 2.0 | 공식 문서가 Seedance 2.0을 이 비교에서 video layer의 모델로 분명히 두고 있다 | API 접근은 아직 enterprise beta 경계가 있어 완전 self-serve가 아니다 |

| runtime / API 명확성으로 선택하고 싶다 | Wan 2.6 video vs Seedance 2.0 beta | Alibaba의 공개 docs가 Wan 2.6 video의 가격과 runtime 규칙을 지금 더 분명하게 보여준다 | 이는 Wan 2.7 image와 Seedance 2.0의 비교와는 다른 질문이다 |

| ideation부터 최종 clip까지 하나의 pipeline을 만들고 싶다 | 둘 다 사용 | Wan 2.7은 upstream keyframe / style pack에, Seedance 2.0은 downstream final clip에 더 잘 맞는다 | handoff를 직접 설계해야 한다 |

왜 Wan 2.7과 Seedance 2.0은 깔끔한 일대일 benchmark가 아닌가

먼저 현실부터 고정해야 한다. 현재 공개된 공식 자료에서는 이 둘이 서로 다른 출력 레이어에 놓여 있다. Alibaba의 2026년 4월 보도자료는 Wan2.7-Image와 Wan2.7-Image-Pro를 이미지 생성 및 이미지 편집 릴리스로 소개한다. 거기서 강조하는 것은 긴 텍스트 렌더링, 개인화 이미지 생성, 최대 9장의 reference image, 한 번에 최대 12장 생성, 그리고 Wan2.7-Image-Pro의 4K 출력이다. 이것은 이미지 워크플로 이야기다.

반대로 ByteDance의 공식 Seedance 2.0 launch와 Volcengine의 현재 Seedance 2.0 tutorial은 text, image, video, audio를 입력으로 받아 4~15초 clip을 만들고, 편집과 extension까지 다루는 멀티모달 비디오 모델을 설명한다. 이것은 비디오 워크플로 이야기다.

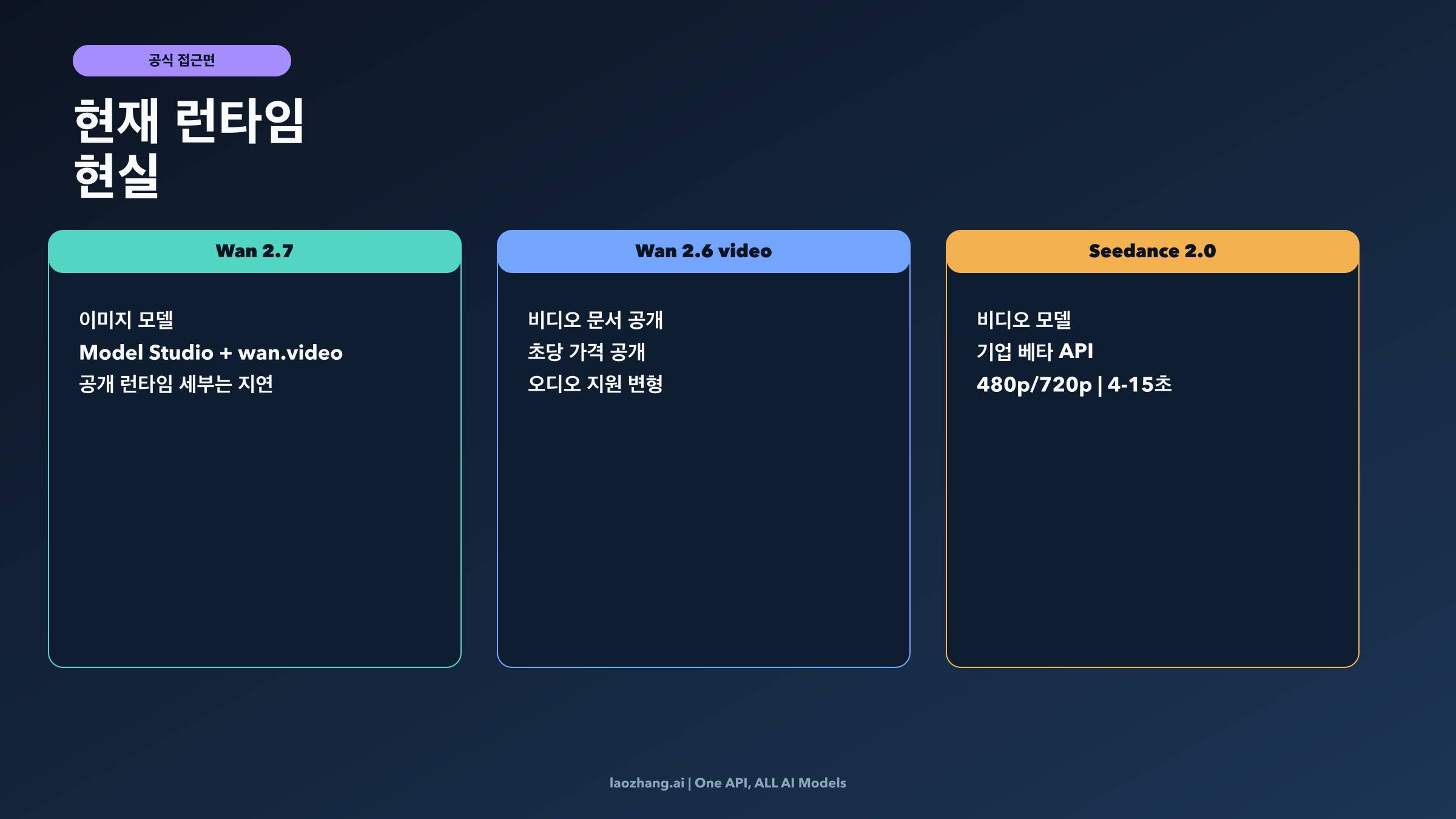

그런데 왜 여전히 혼동이 생기나? Wan이라는 이름이 여러 세대와 여러 surface를 동시에 가리키기 때문이다. Alibaba 보도자료는 Wan 2.7이 Model Studio와 wan.video를 통해 접근 가능하다고 말하지만, 현재 공개된 Alibaba Model Studio models 페이지에서 가장 명확하게 읽히는 public video runtime은 여전히 Wan 2.6 family다. 그래서 "Wan 2.7 vs Seedance 2.0"이라는 질문은 실제로는 image release와 video system을 같은 링 위에 올려놓는 경우가 많다.

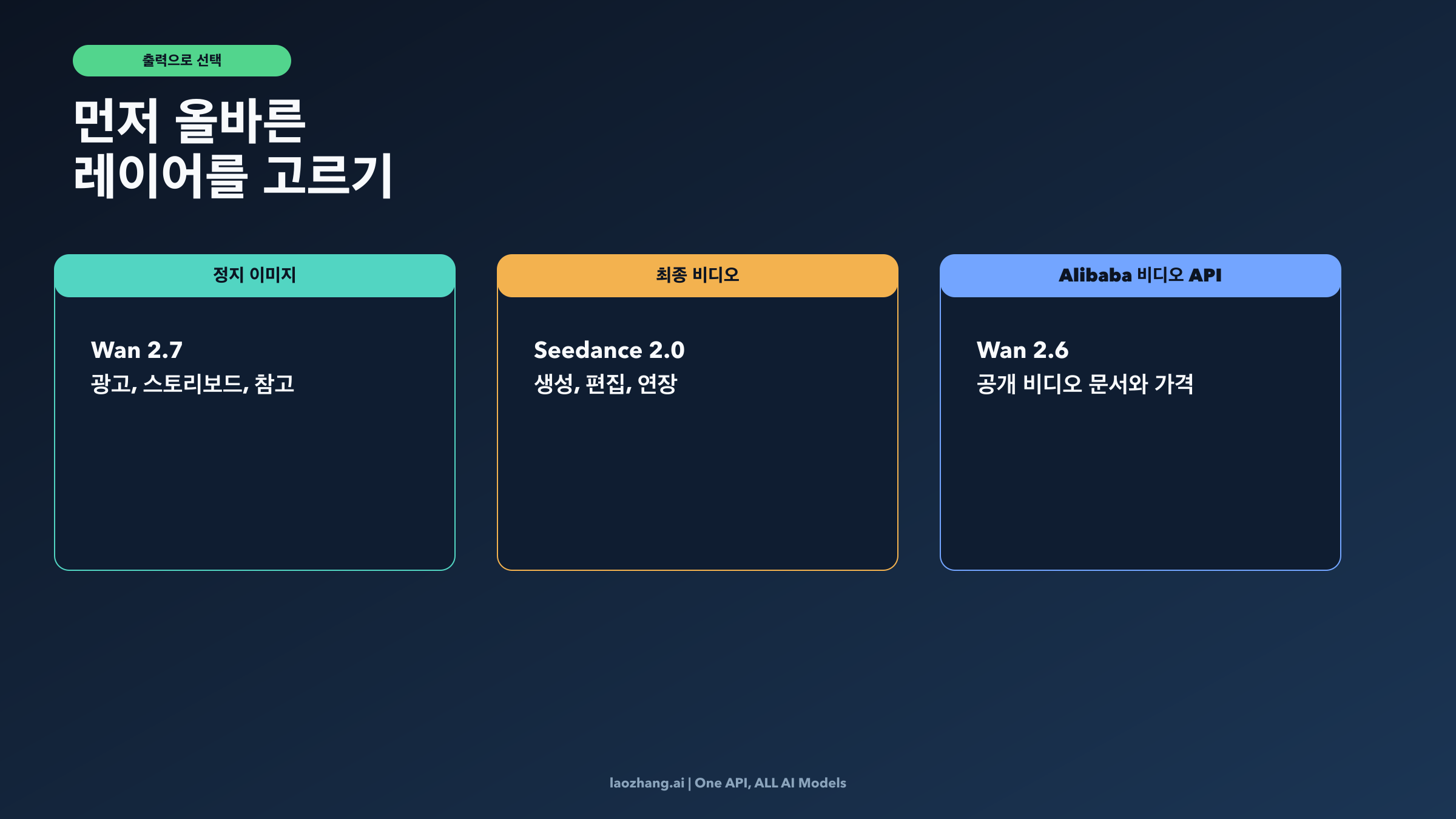

실무적으로는 질문 순서를 바꿔야 한다. 먼저 deliverable이 정적 이미지인지, 최종 비디오 clip인지부터 물어야 한다. 정적 asset이 목표라면 image layer를 고르는 것이다. 완성된 clip이 목표라면 video layer를 고르는 것이다. 이 분기가 먼저 끝나야 나머지 품질, 가격, 접근성 비교가 의미를 갖는다.

Wan 2.7이 더 강한 경우

작업의 본체가 final video가 아니라 still-image control일 때 Wan 2.7이 더 강하다. Alibaba의 공식 메시지 자체가 그 방향을 가리킨다. 텍스트 비중이 큰 비주얼, storyboard-style multi-image output, 색과 브랜드 일관성이 중요한 commercial still, 그리고 image editing이 핵심이다.

현재 공개 contract에서 Wan 2.7의 중요한 포인트는 세 가지다. 첫째, Alibaba는 최대 3,000 text tokens를 지원한다고 밝힌다. 이는 포스터, 광고 비주얼, 설명형 이미지처럼 이미지 안의 텍스트 자체가 중요한 장면에서 특히 의미가 크다. 둘째, 최대 9장의 reference image와 12장 동시 생성을 지원한다. 그래서 storyboard board, style pack, product-scene exploration, campaign visual iteration에 잘 맞는다. 셋째, Wan2.7-Image-Pro는 4K output을 지원한다. 이는 design review, e-commerce detail, 후속 크롭 작업에 유리하다.

이 때문에 Wan 2.7은 content pipeline의 upstream에 두는 것이 자연스럽다. 구성, visual identity, typography, 그리고 뒤의 비디오 작업을 떠받칠 still references를 결정하는 단계에서는 Wan 2.7이 Seedance 2.0보다 더 정직한 선택이다. Seedance도 image reference를 받을 수는 있지만, 지금 공개된 contract의 중심은 어디까지나 multimodal inputs를 video output으로 바꾸는 것이다. asset 자체가 아직 이미지인 단계라면 Wan 2.7에 머무는 편이 맞다.

팀이 아직 "비디오를 어떤 look으로 갈지"를 정하지 못했다면, 먼저 reference pack을 강하게 만드는 편이 더 낫다. 상류 frame이 약한 상태에서 비디오 생성으로 들어가면 어느 모델을 써도 반복 비용이 커진다. 지금 병목이 motion이 아니라 frame이라면, 먼저 그 문제를 해결해야 한다. 더 넓은 upstream image layer를 보고 싶다면 우리의최고의 AI 이미지 모델 가이드가 더 적합하다.

Seedance 2.0이 더 강한 경우

deliverable이 비디오 자체라면 Seedance 2.0이 더 강하다. 현재 Volcengine tutorial은 이 runtime의 형태를 실용적으로 이해할 만큼 충분히 보여 준다. Seedance 2.0 beta는 text에 더해 최대 9장의 이미지, 3개의 비디오, 3개의 오디오를 한 request에 넣을 수 있다. 출력 길이는 4~15초, 해상도는 480p 또는 720p다. 그리고 generation뿐 아니라 edit와 extension 같은 비디오 작업도 다룬다.

중요한 것은 단순히 "레퍼런스를 받을 수 있다"가 아니다. 레퍼런스가 이미 video-native workflow 안에 놓여 있다는 점이다. motion, rhythm, scene continuation, audio-aware generation을 처음부터 동시에 조절할 수 있다. 즉 image-centric 제품을 억지로 비디오 주역으로 밀어 넣는 것이 아니라, 비디오를 위해 설계된 layer를 쓸 수 있다는 뜻이다. 만약 판단 기준이 "여러 이미지와 motion guidance, audio guidance를 같이 넣고 실제 usable clip을 만들 수 있는가"라면, Seedance 2.0이 질문의 중심에 더 가깝다.

물론 접근 경계는 중요하다. 현재 Volcengine docs는 Seedance 2.0과 Seedance 2.0 Fast를 enterprise users 대상 public beta로 두고 있다. 완전히 frictionless한 global self-serve runtime은 아니다. 하지만 이것이 product type 자체를 바꾸지는 않는다. final video work를 해야 한다면, 이 쌍에서 더 직접적인 모델은 여전히 Seedance 2.0이다.

따라서 출발 질문이 "완성된 clip이 필요하다"이지 "더 강한 상류 정적 레퍼런스가 필요하다"가 아니라면, Seedance 2.0이 더 정확한 답이다. 이 질문을 더 넓은 creator-market shortlist로 보고 싶다면 우리의최고의 image-to-video 도구 가이드를 보는 편이 낫다.

runtime과 API 명확성이 중요하다면 Wan 2.6 video와 Seedance 2.0 beta를 비교해야 한다

기술 구매자가 알고 싶은 것은 단순히 무엇이 더 exciting한가가 아니다. 오늘 시점에 무엇이 공식 문서로 남아 있고, 가격이 읽히고, 지원 가능하며, 실제로 통합 가능한가다. 이 질문에서 올바른 비교는 Wan 2.7 image vs Seedance 2.0이 아니라, Wan 2.6 video vs Seedance 2.0 beta다.

Alibaba의 공개 docs는 지금 runtime-contract clarity 측면에서 더 읽기 쉽다. wan2.6-t2v, wan2.6-i2v-flash 같은 Wan 2.6 video family가 명시되어 있고, per-second prices도 공개되어 있다. 2026년 4월 2일 기준으로 확인한 US contract에서 wan2.6-t2v-us는 720p 초당 $0.10, 1080p 초당 $0.15로 기재되어 있다. wan2.6-i2v-flash는 audio 유무까지 나눠 가격을 적어 둔다. 이런 public clarity 자체가 실무 가치다.

Seedance 2.0의 current official contract는 다른 모양을 하고 있다. tutorial page는 real model IDs, 출력 범위, multimodal limits를 이미 보여 주며 예전 "console only"보다 훨씬 진전됐다. 하지만 pricing page는 여전히 하나의 sticker price라기보다 scenario-based examples로 읽는 편이 자연스럽다. 지금 공개 예시를 보면 16:9, 5초, 480p clip은 doubao-seedance-2.0이 2.31 RMB, doubao-seedance-2.0-fast가 1.86 RMB다. 같은 16:9, 5초, 720p clip은 4.97 RMB와 4.00 RMB다. 충분히 유용하지만, Alibaba의 Wan 2.6 video rows만큼 표면이 균일하지는 않다.

그래서 routing rule은 단순하다. public runtime clarity, contract readability, 공개된 가격 행이 중요하다면 지금은 Alibaba의 video side가 더 읽기 쉽다. 다만 그 이름은 Wan 2.6 video이지 Wan 2.7 image가 아니다. 반대로 multimodal video semantics, editability, video system으로서의 매력에 더 무게를 둔다면 Seedance 2.0이 더 흥미롭다. 다만 enterprise-beta access boundary와 다소 덜 균일한 pricing surface는 감수해야 한다.

더 넓게 "지금 실제로 어떤 public video API가 더 도입하기 쉬운가"를 보고 싶다면, hype-driven vendor showdown보다 우리의최고의 free AI video API 가이드가 더 실용적이다.

워크플로 기준으로 최종 선택하는 법, 그리고 둘을 함께 써야 할 때

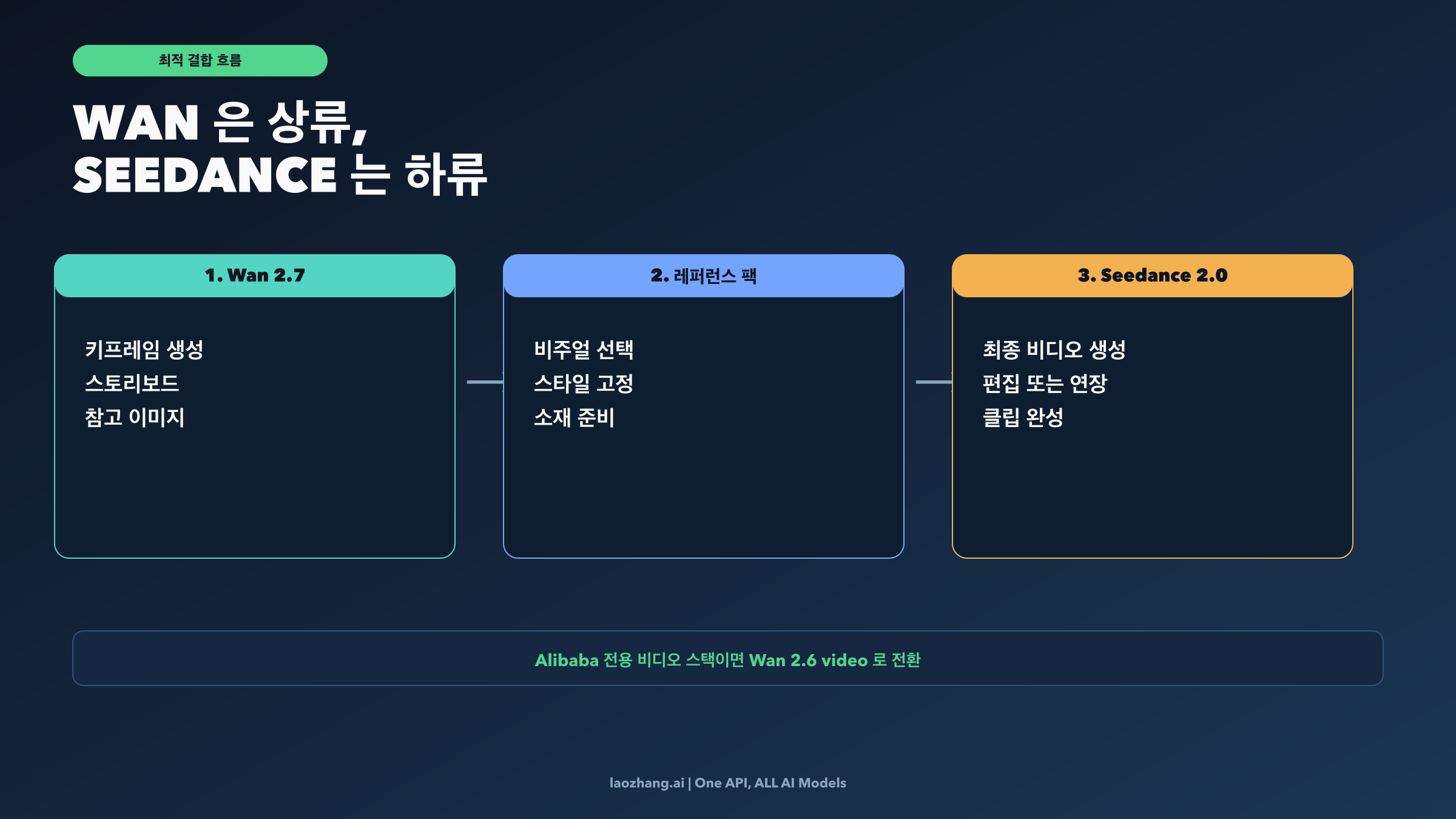

여기서 가장 유용한 답은 한 명의 winner를 뽑는 것이 아니라, 각 단계의 owner를 제대로 정하는 것이다.

브랜드 팀이나 크리에이티브 팀이라면 초기 단계에서 어려운 것은 motion보다 look 결정인 경우가 많다. 이런 상황에서는 Wan 2.7을 upstream에 둔다. hero still, storyboard panel, product composition, 텍스트가 많은 visual, 그리고 팀 전체가 공유할 reference pack을 여기서 만든다. 방향이 굳은 뒤에는 Seedance 2.0을 downstream에 두고, 그 비주얼 언어를 실제 움직이는 video로 변환하는 편이 자연스럽다.

기술 구매자라면 질문을 두 개로 나눠야 한다. image generation과 고제어 still assets는 Wan 2.7, 공개 video runtime 비교는 Wan 2.6 video와 Seedance 2.0 beta, final video generation은 Seedance 2.0이다. 한 줄 verdict보다 복잡해 보일 수 있지만, 오해는 훨씬 적다.

solo creator나 performance marketer라면 판단은 더 빠를 수 있다. keyframe, 광고 콘셉트, 깨끗한 reference set이 필요하면 Wan 2.7. shot이 이미 보이고 짧은 clip이 필요하면 Seedance 2.0. workflow가 두 layer를 모두 지나간다면 둘 다 써야 한다. 단순화를 위해 하나의 모델에 두 역할을 모두 맡길 필요는 없다.

이 점이 이 글의 핵심 information gain이다. 가장 강한 답은 winner-shaped가 아니라 pipeline-shaped인 경우가 많다. 많은 팀에게 최적의 흐름은 Wan 2.7이 ideation과 reference control을 맡고, Seedance 2.0이 final clip generation, extension, edit-style work를 맡는 구조다. 한 모델만 고집해야 하는 경우는 팀이 처음부터 한 layer에만 살고 있을 때뿐이다.

자주 묻는 질문

Wan 2.7이 Seedance 2.0보다 더 좋은가요?

보편적으로 그렇게 말할 수는 없다. Wan 2.7은 storyboard, reference pack, 텍스트가 많은 정적 visual처럼 image-centric task에 더 강하고, Seedance 2.0은 최종 multimodal video generation, editing, extension에 더 강하다. 어느 쪽이 better인지는 workflow stage를 한정해야 의미가 생긴다.

Wan 2.7도 비디오를 생성하나요?

2026년 4월의 Wan 2.7 공식 릴리스는 image-first이고, Alibaba Model Studio에서 현재 가장 명확하게 읽히는 public video runtime은 여전히 Wan 2.6 family다. 따라서 지금 시점에서 Wan 2.7 video를 곧바로 Seedance 2.0과 비교하는 것은 깔끔한 public contract comparison이 아니다. Alibaba의 deployable video stack을 알고 싶다면 Wan 2.6 video를 보는 편이 맞다.

API / runtime 구매자에게는 어느 쪽이 더 중요하나요?

공개 contract의 명확성이 최우선이라면 Wan 2.6 video가 더 읽기 쉽다. model family와 per-second pricing이 더 분명하기 때문이다. 반대로 multimodal video capability와 edit semantics가 더 중요하다면 Seedance 2.0이 더 매력적이지만, 공식 접근 경계는 아직 enterprise beta다.

언제 둘을 함께 쓰는 것이 가장 좋은가요?

workflow가 visual planning에서 시작해 최종 clip으로 끝날 때다. 먼저 Wan 2.7으로 still references, keyframe, visual direction을 만들고, 승인된 방향을 Seedance 2.0으로 넘겨 video generation, extension, editing을 수행하는 것이 가장 자연스럽다.