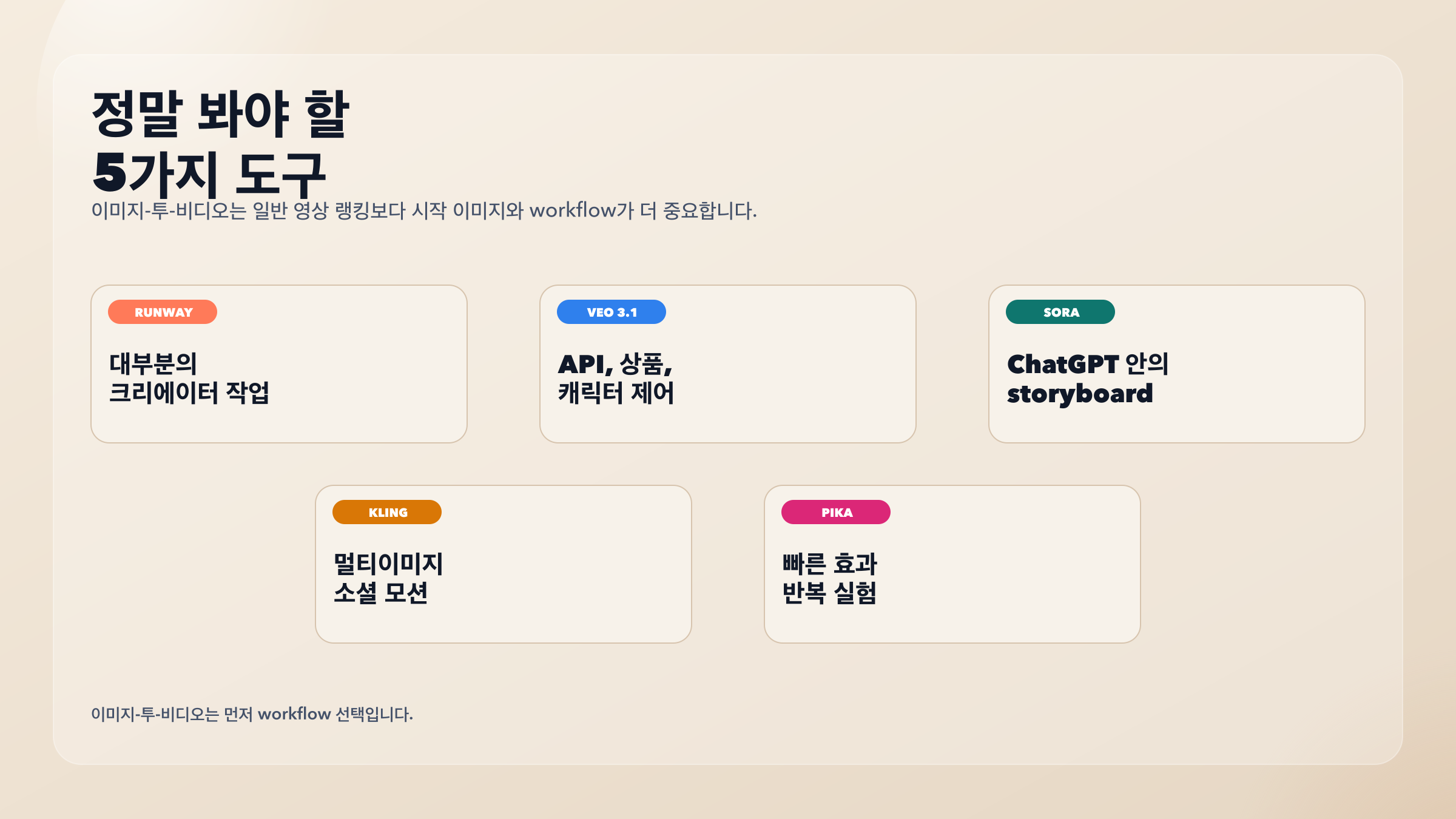

2026년에 이미지-투-비디오 AI를 하나만 먼저 열어야 한다면, 대부분의 사람에게는 Runway가 가장 무난한 시작점이다. 처음부터 API 관점으로 사고할 필요도 없고, 지역 제한이 강한 앱 진입 구조를 감수할 필요도 없으며, 그렇다고 효과 놀이 중심 플랫폼으로 바로 들어갈 필요도 없다. 물론 작업의 성격이 다르면 답도 달라진다. 참조 이미지를 더 강하게 통제해야 하거나 API가 중요하면 Veo 3.1, 이미 ChatGPT 안에서 만들고 있고 스토리보드 흐름이 중요하면 Sora, 멀티이미지 모션·확장·효과가 중요하면 Kling, 가볍고 빠르게 돌려보는 실험이 목적이면 Pika 가 더 맞다.

이 구분이 중요한 이유는 이미지-투-비디오 선택이 곧바로 “최고의 AI 비디오 모델은 무엇인가”라는 질문과 같지 않기 때문이다. 출발점인 정지 이미지가 이미 있을 때는, 누가 가장 화려한 데모를 내놓았느냐보다 그 이미지를 얼마나 잘 보존하고, 원하는 수준으로 움직임을 제어하게 해 주며, 그 과정이 얼마나 덜 번거로운지가 더 중요해진다.

아래의 시의성 있는 정보는 모두 2026년 3월 28일 기준 공식 가격 페이지, 도움말, 제품 문서를 다시 확인해 반영했다.

TL;DR

| 실제 목적 | 가장 먼저 볼 선택지 | 이기는 이유 | 가장 큰 대가 |

|---|---|---|---|

| 대부분의 사람에게 통하는 기본 답이 필요하다 | Runway | 이미지 중심 워크플로, 제품 완성도, 유료 경로의 가독성이 가장 균형 잡혀 있다 | 무료는 지속형 무료라기보다 일회성 체험에 가깝다 |

| 상품 이미지, 캐릭터, 참조 제어가 핵심이다 | Veo 3.1 | 공식 문서가 최대 3장 참조 이미지와 네이티브 오디오를 명시한다 | 참조 이미지, 1080p, 4K는 모두 8초로 고정된다 |

| 이미 ChatGPT 안에서 만들고 있고 스토리보드가 중요하다 | Sora | OpenAI 도움말 자체가 이미지 업로드와 편집 가능한 storyboard 중심이다 | Sora App과 Sora 2는 지원 국가에서만 쓸 수 있다 |

| 멀티이미지 모션, 확장, lip-sync, 효과가 중요하다 | Kling | Kling 3.0의 공식 capability surface가 매우 넓다 | 가격과 진입 방식의 공개 설명은 Runway나 Pika보다 덜 명확하다 |

| 가볍고 빠르게 효과를 시험하고 싶다 | Pika | 공개 가격이 명확하고 효과형 도구가 많으며 진입 장벽이 낮다 | 가장 정돈된 전문용 기본값은 아니다 |

이건 “최고의 AI 비디오 모델”을 고르는 일과 다르다

이 카테고리에서 가장 흔한 실수는 모든 독자가 만능 비디오 챔피언 하나를 찾는다고 가정하는 것이다. 하지만 실제 이미지-투-비디오 사용자는 대개 이미 지키고 싶은 정지 이미지를 갖고 있다. 상품 사진, 캐릭터 설정 이미지, 광고용 키비주얼, 무드 이미지, 혹은 이미 만들어 둔 한 장의 그림이 그렇다.

그 순간부터 질문은 달라진다. 누가 제일 영화 같아 보이느냐만으로는 부족하다. 몇 장의 참조 이미지를 쓸 수 있는지, 앱 중심인지 API 중심인지, 이미지에서 바로 스토리보드를 만들 수 있는지, 그 모드에서 실제로 나오는 길이와 해상도는 무엇인지, 그리고 이것이 일관된 워크플로인지 단순한 기능 모음인지가 더 중요해진다.

만약 당신이 정말로 보고 싶은 것이 더 넓은 의미의 비디오 모델 비교 자체라면, 그건 이 글보다 더 큰 주제다. 이 글은 더 좁고 실무적이다. 정지 이미지가 이미 준비된 상태에서 무엇을 먼저 열어야 하는가 에만 답한다.

shortlist에 넣을 가치가 있는 다섯 개

Runway가 대부분의 사람에게 최고의 이미지-투-비디오 AI인 이유는, 하나의 인상적인 모델이 아니라 가장 완성된 creator workflow처럼 느껴지기 때문이다. 공개 가격 페이지도 이 시장에서는 비교적 읽기 쉽다. Free는 $0이지만 실제 체험을 결정하는 것은 125 one-time credits라서, 장기 무료라기보다 체험 입구로 보는 편이 맞다. 반면 유료 경로는 명확하다. 연간 결제 기준 Standard가 $12부터 시작하고, plan surface에 Gen-4 (Image to Video)가 직접 적혀 있다. 여기에 Runway가 Gen-4 References를 1~3장의 참조 이미지에서 시작해 최신 비디오 모델로 이어지는 흐름으로 설명하고 있다는 점까지 더하면, 이미지 중심 작업에 가장 자연스러운 출발점이 된다.

Runway가 기본값이 되는 이유는 모든 품질 대결에서 이기기 때문이 아니다. 실제로 써 보기까지 요구하는 전제가 가장 적기 때문이다. 처음부터 개발자처럼 사고할 필요도 없고, ChatGPT 안에 이미 묶여 있을 필요도 없고, 효과 위주의 놀이터를 원할 필요도 없다. 한 장의 이미지와 보통의 제작 감각만 있으면 바로 작업이 시작된다.

Veo 3.1은 creator app보다 product control, character consistency, API 제어가 더 중요한 작업에 맞는다. Google의 Gemini API 문서는 이 부분을 꽤 구체적으로 쓴다. Veo 3.1은 최대 3장의 참조 이미지를 받으며, 네이티브 오디오를 생성하고, 720p, 1080p, 4K의 8초 영상을 만들 수 있다. 더 중요한 건 제약을 숨기지 않는다는 점이다. 참조 이미지를 쓰거나 1080p, 4K를 선택하면 모두 8초로 고정된다.

그래서 Veo는 범용 기본값이라기보다 제어 우선 override 로 이해하는 편이 맞다. 상품 샷, 브랜드 자산, 캐릭터 외형 유지, 혹은 입력 이미지의 의미가 매우 큰 programmatic flow에서는 Runway보다 Veo가 더 자연스럽다. 반대로 creator-first 제품처럼 더 가볍게 시작하고 싶다면 여전히 Runway가 쉽다.

Sora는 이미 ChatGPT 안에서 만들고 있는 사람에게 가장 설득력 있는 이미지-투-비디오 선택지다. 여기서 중요한 공식 사실은 추상적인 벤치마크가 아니라 OpenAI 도움말이 안내하는 실제 흐름이다. 정지 이미지를 올리고, 거기서 편집 가능한 storyboard를 만들거나 직접 프레임 단위로 조립하는 방식. 이건 Veo나 Runway의 참조 제어형, Kling의 다기능형과는 다른 창작 태도다.

Sora가 기본값이 되지 않는 이유는 약해서가 아니라 넓은 독자에게 가장 마찰이 적은 진입 경로가 아니기 때문이다. OpenAI는 별도 페이지에서 Sora App과 Sora 2가 지원 국가로 제한된다는 점도 적고 있고, 더 많은 사용량은 플랜 한도와 추가 credits의 세계로 들어간다. 이미 ChatGPT-native라면 큰 문제가 아닐 수 있지만, 더 넓은 독자에게 줄 기본 답으로는 순위를 바꿀 요소다.

Kling은 제품의 정돈됨보다 capability surface의 넓이를 원할 때 고를 만하다. Kling 공식 사이트는 3.0의 범위를 매우 직접적으로 보여 준다. Image to Video, Multi-Image to Video, Video Extension, Lip Sync, Video Effects, Audio Generation, 그리고 fully available API. 즉, 질문이 “가장 무난한 첫 도구가 무엇인가”가 아니라 “한 장의 이미지를 더 다양한 방식으로 움직이고 싶다”라면 Kling은 강력한 선택지다.

문제는 기능이 아니라 설명의 명확성이다. 기능 공개면은 넓지만 가격과 접근 방식은 Runway나 Pika만큼 읽기 쉽지 않다. 그래서 shortlist에는 들어가지만, Runway를 밀어내고 기본값이 되지는 않는다.

Pika는 가장 정돈된 전문 워크플로보다 빠르고 가벼운 effect-heavy experimentation이 중요할 때 빛난다. Pika의 pricing page는 꽤 구체적이다. Free 플랜에 80 monthly video credits가 있고, Pika 2.5 (480p only)를 쓸 수 있으며, Text-to-Video & Image-to-Video의 5초 생성 비용이 12 credits라고 공개한다. 여기에 Pikascenes, Pikadditions, Pikaswaps, Pikatwists, Pikaffects, Pikaframes라는 제품 성격까지 그대로 드러난다. 즉 Pika는 가장 영화 같은 모델이라기보다 짧은 움직임과 효과, 반복 실험을 빠르게 돌리는 쪽에 더 가깝다.

그래서 위치도 분명하다. 대다수에게 주는 기본값은 Runway, 참조 제어는 Veo, ChatGPT-native라면 Sora다. 하지만 한 장의 이미지를 빠르게 움직여 보고 여러 표현을 가볍게 시험하고 싶다면 Pika는 충분히 본선 후보가 된다.

정지 이미지 자체가 아직 약하다면, 비디오 도구를 더 늘리기 전에 최고의 AI 이미지 생성기 가이드를 먼저 보는 편이 효율적일 때가 많다. 원본 이미지가 약하면 어떤 이미지-투-비디오 도구도 실제보다 더 못해 보이기 쉽기 때문이다.

60초 안에 고르려면

가장 짧은 규칙만 기억하고 싶다면 이 정도면 충분하다.

분명한 반대 이유가 없다면 먼저 Runway를 열어라. 지금 기준으로 이미지 중심 워크플로, 제품 완성도, 유료 경로의 가독성을 가장 균형 있게 묶어 놓은 선택이기 때문이다.

원본 이미지에 대한 통제가 최우선이면 Veo 3.1으로 간다. 상품 컷, 브랜드 자산, 캐릭터 일관성, 개발자 주도 흐름처럼 입력 이미지가 핵심일 때 더 자연스럽다.

이미 ChatGPT 안에서 만들고 있고 스토리보드 중심으로 가고 싶다면 Sora로 간다. ChatGPT가 주 작업장이 될수록 Sora의 매력은 커진다. 반대로 처음 들어온 사람에게 가장 쉬운 기본 답은 아니다.

원본 이미지 주변에 더 넓은 motion toolkit이 필요하면 Kling으로 간다. 멀티이미지, extension, lip-sync, effects, API가 필요한 경우 가장 자연스러운 override다.

가볍고 빠른 실험이 목적이면 Pika로 간다. 속도, 반복, 효과 감각이 중요할수록 이 목록 안에서는 꽤 편한 도구다.

진짜 답을 바꾸는 숨은 제약

첫 번째로 중요한 숨은 제약은 도구가 원본 이미지를 어떻게 이해하느냐이다. Veo는 참조 이미지로 보고, Sora는 storyboard의 출발점으로 보고, Kling은 멀티이미지와 효과 재료로 확장하며, Pika는 effect-first 편집 대상으로 다룬다. Runway는 그 중간에서 가장 정돈된 creator workflow를 만든다. 이건 포장 문구 차이가 아니라, 원본 이미지가 얼마나 살아남는지와 결과를 제어하는 데 드는 수고를 바꾸는 차이다.

두 번째 제약은 내가 관심 있는 모드에서 실제로 어떤 출력 규칙이 적용되느냐다. Veo 3.1 문서는 이 점을 잘 보여 준다. 1080p, 4K, 참조 이미지는 모두 8초로 고정된다. 길이를 전제로 작업하는 사람에게 이건 사소한 각주가 아니다. Pika도 마찬가지다. free가 진짜라는 사실과, 무료 image-to-video lane이 480p라는 사실은 동시에 맞다. 가벼운 테스트에는 충분하지만 polished production default와 같은 계약은 아니다.

세 번째 제약은 접근 방식과 지역이다. Sora가 대표적이다. 지원 국가 안에 있고 이미 ChatGPT 안에서 만들고 있다면 매우 강할 수 있지만, 그렇지 않다면 그 사실만으로 기본 추천에서 빠질 수 있다. 훌륭한 창작 흐름과 누구에게나 낮은 마찰은 같은 말이 아니다.

네 번째 제약은 내가 찾는 것이 free entry인지, paid creator workflow인지, 아니면 API/control path인지다. 이 세 질문은 서로 다르다. 무료 출발점을 알고 싶다면 무료 이미지-투-비디오 AI 가이드를 보는 편이 정확하다. 무료를 넘어선 뒤 예산 구조가 궁금해지면 AI 비디오 생성 가격 비교 가이드로 넘어가면 된다. 이 글의 일은 더 단순하다. 정지 이미지가 이미 있을 때 무엇을 먼저 열어야 하는지를 정하는 것이다.

자주 묻는 질문

지금 가장 무난한 이미지-투-비디오 AI는 무엇인가?

대부분의 사람에게는 Runway다. 모든 전문 시나리오에서 1등이라는 뜻이 아니라, 이미지 중심 워크플로, 사용성, 유료 경로의 가독성을 가장 자연스럽게 묶기 때문이다.

상품 컷이나 캐릭터 일관성이 중요하면 무엇이 좋은가?

Veo 3.1이 가장 자연스럽다. Google의 현재 문서는 최대 3장의 참조 이미지와 네이티브 오디오를 명시하기 때문에, 입력 이미지 통제가 중요한 경우 더 잘 맞는다.

이미 ChatGPT를 쓰고 있으면 답이 달라지는가?

그렇다. 그런 사용자에게는 Sora의 우선순위가 올라간다. OpenAI가 설명하는 image upload + editable storyboard 흐름이 ChatGPT-native 작업과 잘 맞기 때문이다.

멀티이미지 모션이나 효과가 중요하면 무엇을 보면 되는가?

먼저 Kling을 보면 된다. 공식 capability surface가 multi-image-to-video, extension, lip-sync, effects, API를 모두 포함한다. 더 가볍고 빠른 실험이면 Pika 쪽이 낫다.

무료만 중요하다면?

그건 이미 다른 질문이다. 답은 이 글보다 무료 이미지-투-비디오 AI 가이드 쪽이 정확하다. 무료에서는 credit reset과 download restriction이 훨씬 크게 작동하기 때문이다.

비디오 도구보다 먼저 정지 이미지를 고쳐야 하나?

그럴 때가 많다. 원본 이미지가 약하면 어떤 도구도 실제보다 못해 보인다. 병목이 아직 정지 이미지라면 먼저 최고의 AI 이미지 생성기 가이드를 보는 편이 이득이다.