Resumen rapido

La API de Nano Banana Pro tiene tres tipos de restricciones, cada una con una solucion diferente. Los limites de tasa (tope de 250 RPD) se eliminan habilitando la facturacion de Google Cloud o utilizando un proveedor externo como laozhang.ai ($0.05/imagen, sin limites). Los filtros de seguridad (Capa 1) se configuran a BLOCK_NONE mediante el parametro safety_settings de la API, algo oficial y documentado. La politica de contenido (Capa 2 IMAGE_SAFETY) no puede desactivarse con ningun parametro de la API; en su lugar, se recurre a la ingenieria de prompts y estrategias de reintento. No existe un nivel gratuito de API para Nano Banana Pro a fecha de marzo de 2026.

Nano Banana Pro (Gemini 3 Pro Image) es el modelo de generacion de imagenes con IA mas potente de Google, pero acceder a el sin restricciones es mas complejo de lo que la mayoria de guias sugieren. El termino "sin restricciones" abarca en realidad tres dimensiones separadas: limites de tasa, filtros de seguridad y politica de contenido, y cada una requiere un enfoque diferente. A fecha de marzo de 2026, el nivel gratuito de la API ofrece cero solicitudes por dia, el nivel de pago limita a 250 RPD, e incluso con la facturacion habilitada, un sistema de filtros de seguridad de dos capas puede bloquear contenido legitimo sin explicacion. Esta guia desglosa cada dimension de restriccion, proporciona codigo funcional para configurar lo que puedes controlar y explica estrategias honestas para lo que no puedes.

Que significa realmente "sin restricciones" para la API de Nano Banana Pro

Cuando los desarrolladores buscan "acceso sin restricciones a la API de Nano Banana Pro", normalmente se refieren a una de tres cosas fundamentalmente distintas, y confundirlas lleva a horas de depuracion inutil. Comprender con que dimension de restriccion estas lidiando es el paso mas importante para resolverlo, porque la solucion para los limites de tasa es completamente diferente de la solucion para los bloqueos de filtros de seguridad, que a su vez es completamente diferente del enfoque necesario para la aplicacion no configurable de la politica de contenido.

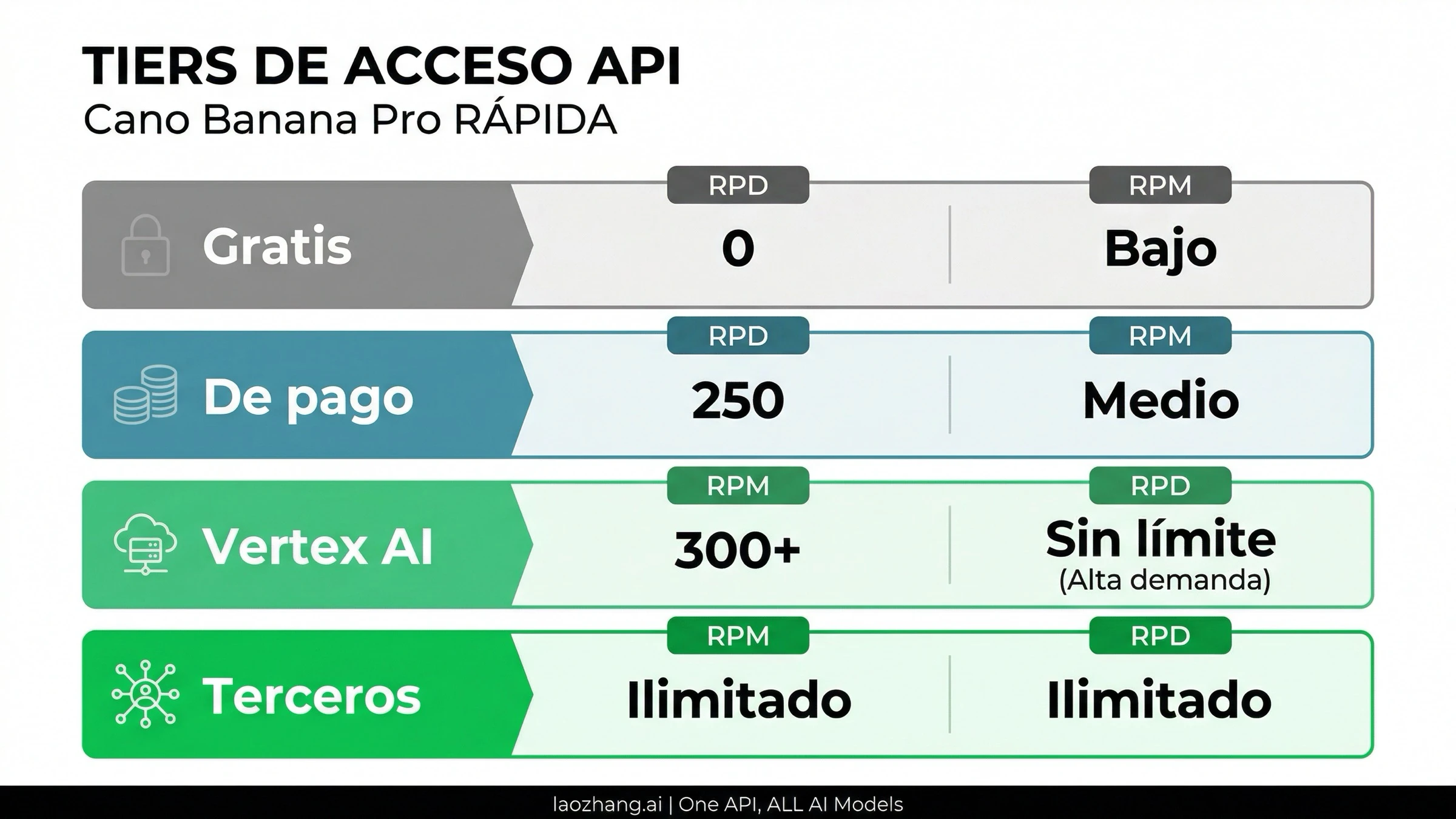

Dimension 1: Limites de tasa controlan cuantas solicitudes puedes hacer por minuto (RPM) y por dia (RPD). La API de Nano Banana Pro no tiene nivel gratuito: cero solicitudes diarias para cuentas sin pago (ai.google.dev, marzo 2026). Incluso con la facturacion habilitada, el Nivel de Pago 1 te limita a 20 RPM y 250 RPD. Esta es la restriccion mas directa de levantar: habilitas la facturacion y, potencialmente, pasas a Vertex AI para obtener cuotas mas altas. La solucion es puramente financiera y administrativa.

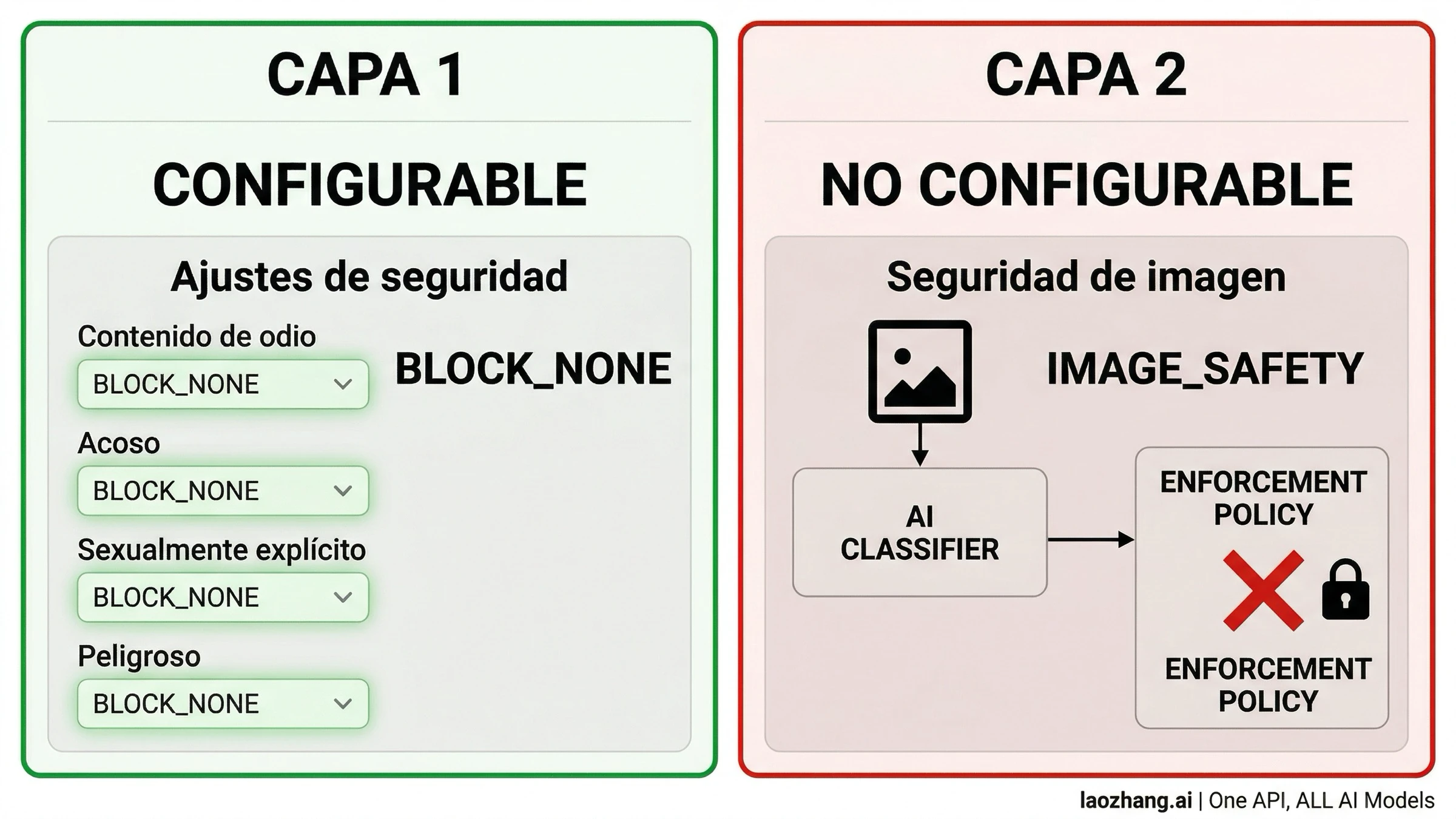

Dimension 2: Filtros de seguridad son la Capa 1 configurable del sistema de seguridad. La API de Gemini expone cuatro categorias de dano: acoso, discurso de odio, contenido sexualmente explicito y contenido peligroso, y puedes configurar cada una a BLOCK_NONE mediante el parametro safety_settings. Cuando la Capa 1 bloquea tu solicitud, la API devuelve finishReason: "SAFETY" en la respuesta. Esta es la capa en la que se centran la mayoria de guias sobre "acceso sin restricciones", y configurarla a BLOCK_NONE es legitimo y esta bien documentado por Google.

Dimension 3: Politica de contenido es la Capa 2 no configurable. Aqui es donde la frustracion alcanza su punto maximo. Incluso despues de configurar todas las categorias de seguridad a BLOCK_NONE, la API puede rechazar tu solicitud con finishReason: "IMAGE_SAFETY" o blockReason: "OTHER". Estos filtros del lado del servidor utilizan clasificacion de imagenes por IA, coincidencia de hash y aplicacion automatizada de politicas que ningun parametro de la API puede desactivar. Comprender esta distincion evita que los desarrolladores pierdan tiempo ajustando configuraciones de seguridad cuando el bloqueo proviene de un sistema completamente diferente.

La confusion entre estas tres dimensiones es la razon principal por la que los desarrolladores pierden tiempo en soluciones ineficaces. Configurar BLOCK_NONE no aumentara tu limite de 250 RPD. Habilitar la facturacion no evitara los bloqueos de IMAGE_SAFETY. Y ningun nivel de ingenieria de prompts superara un nivel gratuito de cero RPD. Cada dimension tiene una ruta de solucion especifica, y aplicar la correccion equivocada al problema equivocado es el patron de frustracion mas comun en la comunidad de desarrolladores de Nano Banana Pro, como se refleja en cientos de hilos en Reddit, la Comunidad de Ayuda de Google y Stack Overflow.

Comprender este marco tambien aclara que es lo que realmente ofrecen los proveedores "sin restricciones" de terceros. Cuando un servicio anuncia "acceso sin restricciones a Nano Banana Pro", casi siempre se refiere a la eliminacion de limites de tasa y reduccion de costes (Dimension 1), a veces a una configuracion mejorada de la Capa 1 (Dimension 2), pero rara vez a algun cambio en la politica de contenido de la Capa 2 (Dimension 3). Saber que dimension aborda un proveedor te ayuda a evaluar si su servicio resuelve tu problema especifico.

El resto de esta guia aborda cada dimension en secuencia, comenzando con lo que puedes controlar completamente y avanzando hacia estrategias para lo que no puedes.

Comprender la arquitectura de seguridad de dos capas de Nano Banana Pro

El error mas comun que cometen los desarrolladores con Nano Banana Pro es tratar el sistema de seguridad como un unico interruptor. En realidad, Google ha construido una arquitectura multicapa donde diferentes componentes cumplen diferentes propositos y responden a diferentes controles. Comprender esta arquitectura es esencial antes de escribir cualquier codigo, porque los mensajes de error de cada capa son similares pero requieren respuestas completamente diferentes.

La Capa 1 opera a traves del parametro safety_settings en tu solicitud de API. Evalua tu prompt de texto contra cuatro categorias de dano definidas por Google: HARM_CATEGORY_HARASSMENT, HARM_CATEGORY_HATE_SPEECH, HARM_CATEGORY_SEXUALLY_EXPLICIT y HARM_CATEGORY_DANGEROUS_CONTENT. Para cada categoria, puedes establecer un umbral desde BLOCK_LOW_AND_ABOVE (mas restrictivo) pasando por BLOCK_MEDIUM_AND_ABOVE y BLOCK_ONLY_HIGH hasta BLOCK_NONE (menos restrictivo). Cuando la Capa 1 bloquea una solicitud, la respuesta incluye finishReason: "SAFETY" junto con calificaciones de seguridad que te indican exactamente que categoria activo el bloqueo y con que nivel de confianza. Esta transparencia hace que los bloqueos de la Capa 1 sean sencillos de diagnosticar y resolver.

La Capa 2 es fundamentalmente diferente. Se ejecuta en el lado del servidor despues de la generacion de la imagen y utiliza clasificacion impulsada por IA para analizar la imagen de salida en si misma, no solo el prompt de texto. Esta capa verifica violaciones de politica, incluyendo contenido de seguridad infantil (obligatorio, sin posibilidad de omision bajo ninguna circunstancia), propiedad intelectual y marcas registradas conocidas, representaciones realistas de figuras publicas identificables y contenido que viole la politica de uso aceptable mas amplia de Google. Cuando la Capa 2 bloquea tu solicitud, ves finishReason: "IMAGE_SAFETY" o blockReason: "OTHER", y, de manera critica, la respuesta no proporciona un desglose detallado de que activo el bloqueo. Se te cobran los tokens consumidos durante la generacion incluso cuando la salida es bloqueada, lo cual es una fuente comun de frustracion para desarrolladores con cargas de trabajo de alto volumen.

El impacto practico de esta arquitectura se hace evidente al examinar el consumo de tokens. Cada solicitud de Nano Banana Pro que llega a la Capa 2 ya ha consumido tokens de entrada para el procesamiento del prompt y tokens de salida para la generacion de la imagen. Cuando la Capa 2 bloquea el resultado, esos tokens siguen facturandose a tu cuenta: pagas por una imagen que nunca recibes. A $0.134 por imagen de 2K o $0.24 por imagen de 4K, una tasa de bloqueo IMAGE_SAFETY del 20% aumenta efectivamente tu coste por imagen utilizable en un 25%. Esto convierte la comprension y minimizacion de los bloqueos de la Capa 2 no solo en una preocupacion tecnica sino en una cuestion financiera directa, especialmente a escala de produccion donde miles de solicitudes bloqueadas al dia pueden sumar cientos de dolares en computo desperdiciado.

Tambien existe una Capa 3 especificamente para PROHIBITED_CONTENT, que cubre material de abuso sexual infantil (CSAM) y restricciones similares legalmente obligatorias. Esta capa es absoluta: ninguna configuracion, ninguna solucion alternativa, ningun proveedor externo puede eludirla. Existe en todos los servicios de generacion de imagenes con IA y no es negociable. Para una inmersion mas profunda en cada codigo de error y patron de respuesta, consulta nuestra guia completa de filtros de seguridad.

Como identificar que capa te bloqueo

El campo de respuesta te dice todo lo que necesitas saber. Si ves finishReason: "SAFETY" con las calificaciones safetyRatings correspondientes, la Capa 1 bloqueo tu prompt antes de la generacion; ajusta tu configuracion de seguridad o reformula el prompt. Si ves finishReason: "IMAGE_SAFETY" sin calificaciones detalladas, la Capa 2 detecto algo en la imagen generada; ninguna configuracion de la API ayudara, y necesitas estrategias de ingenieria de prompts. Si ves blockReason: "OTHER", se trata de una verificacion de politica previa a la generacion que no se puede configurar. La actualizacion de politica de marzo de 2026 amplio significativamente el alcance de blockReason: "OTHER", particularmente para operaciones de edicion relacionadas con personas como el reemplazo de fondos y la modificacion de apariencia.

Configurar BLOCK_NONE: guia completa de codigo

Establecer safety_settings a BLOCK_NONE es el cambio individual mas impactante que puedes hacer para reducir bloqueos innecesarios en contenido legitimo. Este es un parametro oficial y documentado de la API, no un truco ni una solucion alternativa. Google lo diseno especificamente para desarrolladores que construyen aplicaciones donde el umbral de clasificacion de contenido necesita gestionarse a nivel de aplicacion en lugar de a nivel de API. Asi es como implementarlo en cada lenguaje principal.

Python (Google Generative AI SDK)

pythonimport google.generativeai as genai genai.configure(api_key="YOUR_API_KEY") model = genai.GenerativeModel("gemini-3-pro-image-preview") safety_settings = [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"}, ] response = model.generate_content( "A dramatic fantasy battle scene with warriors in dark armor", generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) # Check if image was generated successfully if response.candidates and response.candidates[0].content.parts: image_data = response.candidates[0].content.parts[0].inline_data with open("output.png", "wb") as f: f.write(image_data.data) else: # Check finish reason for debugging print(f"Blocked: {response.candidates[0].finish_reason}")

JavaScript / Node.js

javascriptimport { GoogleGenerativeAI } from "@google/generative-ai"; const genAI = new GoogleGenerativeAI("YOUR_API_KEY"); const model = genAI.getGenerativeModel({ model: "gemini-3-pro-image-preview", safetySettings: [ { category: "HARM_CATEGORY_HARASSMENT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_HATE_SPEECH", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_SEXUALLY_EXPLICIT", threshold: "BLOCK_NONE" }, { category: "HARM_CATEGORY_DANGEROUS_CONTENT", threshold: "BLOCK_NONE" }, ], }); const result = await model.generateContent({ contents: [{ role: "user", parts: [{ text: "A dramatic fantasy battle scene" }] }], generationConfig: { responseMimeType: "image/png" }, }); const imageData = result.response.candidates?.[0]?.content?.parts?.[0]?.inlineData; if (imageData) { fs.writeFileSync("output.png", Buffer.from(imageData.data, "base64")); }

cURL (REST API)

bashcurl -X POST \ "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-image-preview:generateContent?key=YOUR_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "contents": [{"parts": [{"text": "A dramatic fantasy battle scene"}]}], "safetySettings": [ {"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"}, {"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"} ], "generationConfig": {"responseMimeType": "image/png"} }'

Una pregunta frecuente es si utilizar BLOCK_NONE te expone a violaciones de los Terminos de Servicio o sanciones en tu cuenta. La respuesta corta es no: Google documenta explicitamente este parametro como una opcion de configuracion para desarrolladores. La respuesta mas larga implica comprender el modelo de responsabilidad compartida: al configurar BLOCK_NONE, estas indicando a Google que tu aplicacion gestionara la clasificacion de contenido y la seguridad del usuario a nivel de aplicacion. Sigues siendo responsable de lo que tu aplicacion haga en ultima instancia con las imagenes generadas, pero el acto de configurar el parametro de la API en si mismo es un comportamiento autorizado. Esto es analogo a como los proveedores de nube ofrecen acceso root a maquinas virtuales: la capacidad se proporciona y documenta, y la responsabilidad del uso apropiado recae en el desarrollador.

Vale la pena enfatizar que BLOCK_NONE no significa "generar cualquier cosa sin restriccion". Significa "no aplicar los umbrales configurables de categorias de dano". Las verificaciones de seguridad de imagen de la Capa 2 y las verificaciones de contenido prohibido de la Capa 3 siguen ejecutandose independientemente de esta configuracion. El efecto practico es que los prompts que involucran violencia artistica, escenas dramaticas, ilustraciones medicas y contenido similar que podria activar una calificacion de seguridad de confianza media ahora pasaran con exito a traves de la Capa 1. Que pasen la Capa 2 depende de lo que la imagen generada realmente represente, lo cual es evaluado por separado por el sistema de clasificacion de imagenes de Google.

Eliminar limites de tasa: de 250 RPD a escala de produccion

La cuestion de los limites de tasa fue la razon original por la que el termino "acceso sin restricciones a la API" comenzo a ser tendencia para Nano Banana Pro. Un hilo de la Comunidad de Ayuda de Google de diciembre de 2025, que todavia ocupa el puesto numero 1 para esta consulta de busqueda, captura perfectamente la frustracion: un usuario empresarial que choca contra el muro de 250 RPD sin una ruta clara para aumentarlo. A fecha de marzo de 2026, la situacion se ha clarificado y existen cuatro niveles distintos de acceso con limites muy diferentes.

El Nivel Gratuito proporciona exactamente cero solicitudes por dia para Nano Banana Pro a traves de la API. A diferencia de los modelos de texto estandar de Gemini que ofrecen generosas cuotas gratuitas, el modelo de generacion de imagenes requiere una cuenta de pago. Esto esta confirmado por la pagina oficial de limites de tasa de Google en ai.google.dev, que lista Gemini 3 Pro Image Preview con un limite de 2,000,000 tokens por dia para cuentas de pago y sin entrada de nivel gratuito. Si estas recibiendo errores en una cuenta sin facturacion habilitada, esta es la razon: no hay acceso gratuito a la API para este modelo.

El Nivel de Pago 1 se activa cuando vinculas una cuenta de facturacion de Google Cloud a tu proyecto de AI Studio. Esto concede inmediatamente 20 RPM y 250 RPD, lo que se traduce en aproximadamente 250 imagenes por dia. Para desarrolladores individuales y proyectos pequenos, esto es suficiente para desarrollo y uso de produccion ligero. El coste por imagen es de $0.134 a resolucion 1K-2K y $0.24 a resolucion 4K (Vertex AI Pricing, marzo 2026). Para habilitar la facturacion, navega a Google AI Studio, selecciona tu proyecto, ve a Configuracion y vincula una cuenta de facturacion. Tu clave API existente heredara automaticamente los limites superiores.

El acceso a Vertex AI es la ruta empresarial para cargas de trabajo a escala de produccion. A traves de la plataforma Vertex AI de Google Cloud, puedes acceder a Gemini 3 Pro Image con limites de tasa significativamente superiores: mas de 300 RPM con RPD personalizado segun tu gasto comprometido. Vertex AI tambien proporciona garantias de SLA, asignacion de computo prioritario y capacidad dedicada que el pool compartido de AI Studio no puede igualar. El precio por token es identico, pero el nivel de servicio es fundamentalmente diferente. Necesitaras un proyecto de Google Cloud con la API de Vertex AI habilitada y una clave de cuenta de servicio en lugar de una clave API de AI Studio. Para un desglose completo de cada nivel y sus cuotas, consulta nuestro desglose detallado de limites de tasa.

Los proveedores de API de terceros representan la cuarta ruta, y para muchos desarrolladores son la solucion mas practica a las restricciones de limites de tasa. Servicios como laozhang.ai enrutan las solicitudes a traves de su propia infraestructura sin limites de RPM ni RPD, proporcionando efectivamente acceso ilimitado al mismo modelo subyacente Gemini 3 Pro Image. La contrapartida es que confias en un tercero con tu trafico de API, y los tiempos de respuesta pueden variar segun su balanceo de carga. La significativa ventaja de coste, $0.05 por imagen a cualquier resolucion frente a $0.134-$0.24 oficial, hace que esta ruta sea atractiva para cargas de trabajo de produccion de alto volumen donde el coste importa mas que la cobertura directa de SLA de Google.

La migracion desde la API directa de Google a un proveedor de terceros suele ser sencilla porque la mayoria de los proveedores exponen un endpoint compatible con OpenAI o un passthrough compatible con Gemini. Para laozhang.ai especificamente, cambias la URL base y la clave API en tu codigo existente mientras mantienes la misma configuracion de safety_settings y el formato de prompt. Esto significa que tu configuracion BLOCK_NONE se transmite a la llamada API subyacente de Google, y obtienes el beneficio combinado de eliminacion de limites de tasa, reduccion de costes y el mismo control de configuracion de seguridad que tenias con el acceso directo.

Cabe destacar la distincion entre cuota de solicitudes y rendimiento. El limite de 250 RPD del Nivel de Pago 1 oficial es un tope diario estricto: una vez que lo alcanzas, las solicitudes fallan hasta el dia siguiente. Vertex AI y los proveedores de terceros operan en cambio con modelos de rendimiento donde no hay tope diario, solo limites de concurrencia. Para la mayoria de las arquitecturas de produccion, el rendimiento sostenido importa mas que la cuota diaria, razon por la cual la etiqueta "ilimitado" en los proveedores de terceros es practicamente significativa, aunque tecnicamente signifique "sin tope diario artificial" en lugar de "solicitudes simultaneas infinitas".

Reducir falsos positivos y gestionar errores IMAGE_SAFETY

Incluso despues de configurar BLOCK_NONE y habilitar la facturacion para obtener limites de tasa mas altos, muchos desarrolladores se encuentran con bloqueos persistentes del filtro IMAGE_SAFETY de la Capa 2. Estos bloqueos son particularmente frustrantes porque afectan a casos de uso completamente legitimos: fotografia de productos para comercio electronico, visualizacion arquitectonica, ilustracion medica y contenido artistico que no contiene nada objetable. La falta de informacion detallada de errores de la Capa 2 dificulta la depuracion sistematica, pero varias estrategias han demostrado ser efectivas en la practica.

La especificidad del prompt reduce la ambiguedad. El clasificador IMAGE_SAFETY tiene mas probabilidades de marcar prompts vagos que podrian interpretarse de multiples maneras. En lugar de "una mujer con un vestido", especifica "una modelo profesional de moda vistiendo un vestido azul de negocios en un entorno de oficina corporativa, estilo de fotografia editorial". El contexto adicional guia tanto la generacion de la imagen como el clasificador de seguridad hacia una interpretacion que evita activar falsos positivos. Las descripciones detalladas de escenas, la mencion explicita de contextos profesionales y los calificadores de estilo como "editorial", "documental" o "fotografia comercial" ayudan a establecer una intencion legitima.

La variacion de resolucion y semilla puede cambiar los resultados. Dado que IMAGE_SAFETY evalua la imagen generada en lugar del prompt, el mismo prompt puede producir resultados diferentes entre intentos. Si una generacion particular es bloqueada, volver a intentar con una semilla aleatoria diferente (modificando ligeramente el prompt o agregando un detalle inocuo) puede producir una variante aceptable. Algunos desarrolladores informan que generar a resolucion 2K y luego escalar produce resultados de evaluacion de seguridad diferentes que generar directamente a 4K, aunque esto es anecdotico y probablemente depende del contenido especifico.

La actualizacion de politica de marzo de 2026 requiere atencion. Google endurecio significativamente las politicas de edicion relacionadas con personas a principios de marzo de 2026. Operaciones que antes funcionaban, como el reemplazo de fondos en fotos con personas, la composicion de fotos grupales y la modificacion de la ropa o apariencia de una persona, ahora frecuentemente devuelven blockReason: "OTHER" antes de que comience la generacion. Esta es una restriccion a nivel de politica, no un problema de filtro de seguridad, y se aplica independientemente de tu configuracion de safety_settings. El impacto practico es que los flujos de trabajo que involucran sujetos humanos en la edicion de imagenes necesitan ser rediseados en torno a estas nuevas restricciones, potencialmente separando a la persona del fondo en el preprocesamiento antes de usar la API para la generacion del entorno.

La logica de reintentos con retroceso exponencial ayuda. Para sistemas de produccion, implementar reintentos automaticos con ligeras variaciones del prompt ante bloqueos IMAGE_SAFETY puede mejorar significativamente el rendimiento. Un patron razonable es: intentar la generacion, ante un fallo IMAGE_SAFETY agregar un calificador de estilo y reintentar, ante un segundo fallo modificar ligeramente la descripcion de la escena y reintentar, y ante un tercer fallo registrar el prompt para revision manual. Este enfoque tipicamente logra tasas de exito del 85-90% en contenido que esta legitimamente dentro de la politica.

Separar los sujetos humanos de la generacion del entorno. Tras el endurecimiento de la politica de marzo de 2026 respecto a la edicion relacionada con personas, los flujos de trabajo que combinan sujetos humanos con modificacion del entorno enfrentan tasas de bloqueo incrementadas. Una arquitectura mas fiable preprocesa las imagenes para segmentar los sujetos humanos de los fondos, utiliza la API para la generacion del entorno o fondo por separado, y luego compone los resultados. Esto evita activar las verificaciones de politica de edicion de personas por completo mientras se logra el mismo resultado creativo. Herramientas como SAM2 (Segment Anything Model 2) o rembg pueden manejar el paso de segmentacion antes de tus llamadas a la API de Nano Banana Pro.

Usa prompts negativos estrategicamente. Aunque Nano Banana Pro no admite prompts negativos explicitos de la misma manera que Stable Diffusion, puedes lograr un efecto similar siendo explicito sobre lo que la imagen deberia contener y excluyendo implicitamente elementos problematicos. Frases como "iluminacion profesional de estudio", "fondo blanco limpio" y "estilo de catalogo de productos" establecen un contexto que el clasificador de seguridad interpreta como comercial y legitimo, reduciendo significativamente las tasas de falsos positivos en comparacion con prompts artisticos ambiguos.

Aqui tienes una implementacion practica de reintentos en Python que gestiona los bloqueos IMAGE_SAFETY de forma elegante:

pythonimport time import random def generate_with_retry(model, prompt, safety_settings, max_retries=3): """Generate image with automatic retry on IMAGE_SAFETY blocks.""" style_qualifiers = [ ", professional photography style", ", editorial magazine quality, studio lighting", ", commercial product photography, clean composition", ] for attempt in range(max_retries): modified_prompt = prompt + (style_qualifiers[attempt] if attempt > 0 else "") try: response = model.generate_content( modified_prompt, generation_config={"response_modalities": ["IMAGE"]}, safety_settings=safety_settings, ) if response.candidates and response.candidates[0].content.parts: return response.candidates[0].content.parts[0].inline_data finish_reason = response.candidates[0].finish_reason if response.candidates else "UNKNOWN" if finish_reason == "IMAGE_SAFETY": print(f"Attempt {attempt + 1}: IMAGE_SAFETY block, retrying with modifier...") time.sleep(2 ** attempt + random.random()) continue else: print(f"Blocked by: {finish_reason}") return None except Exception as e: print(f"API error: {e}") time.sleep(2 ** attempt) print(f"All {max_retries} attempts failed for prompt") return None

Proveedores de API de terceros: que cambian realmente

El mercado de acceso a la API de Nano Banana Pro a traves de terceros ha crecido rapidamente desde el lanzamiento del modelo, con proveedores como laozhang.ai, Kie.ai, EvoLink y otros que ofrecen el mismo modelo subyacente a precios significativamente inferiores. Sin embargo, las afirmaciones de acceso "sin restricciones" o "sin censura" de algunos proveedores merecen un escrutinio cuidadoso, porque lo que los proveedores de terceros pueden y no pueden cambiar a menudo se representa erroneamente.

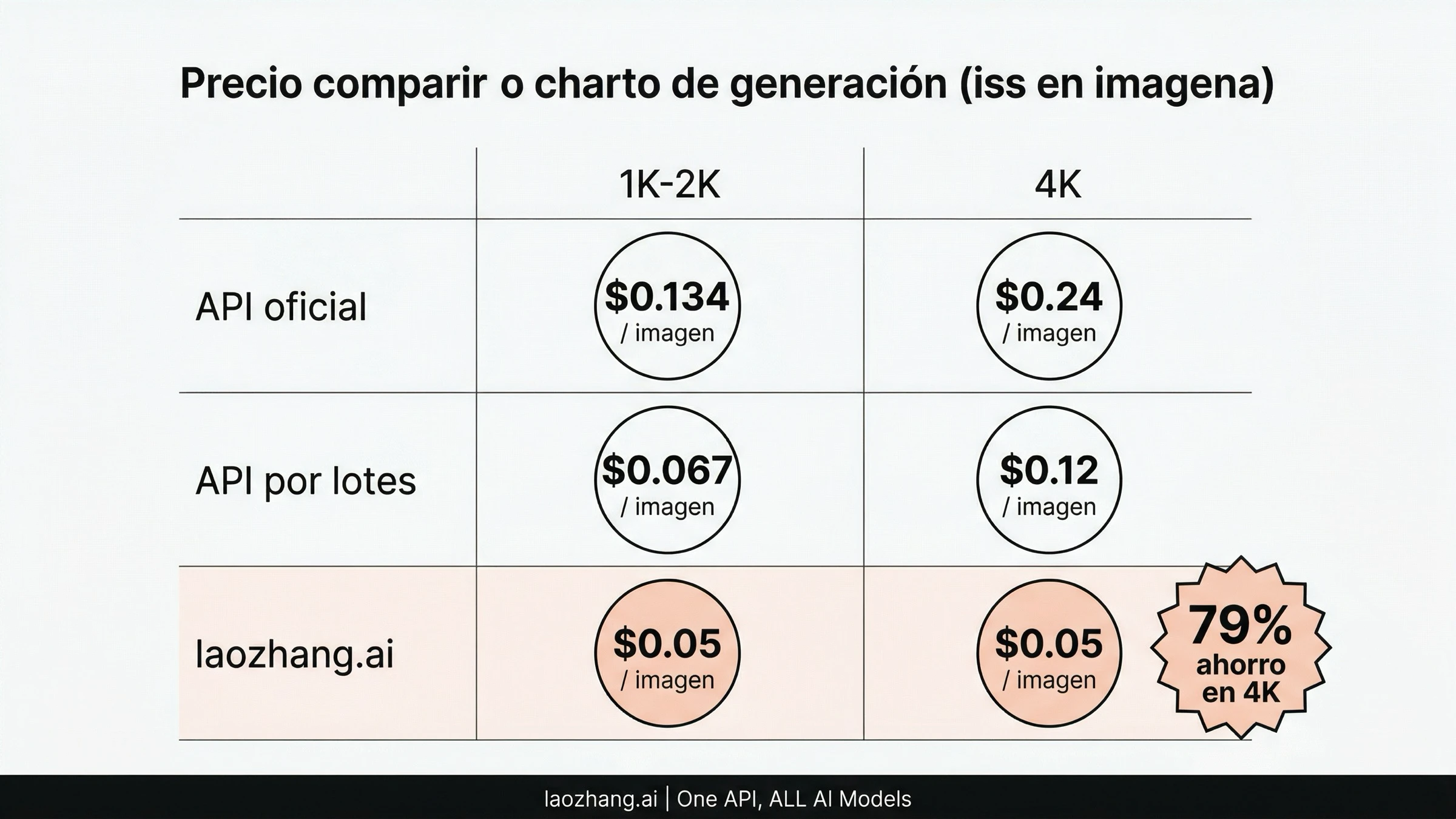

Lo que los proveedores de terceros realmente ofrecen es la eliminacion de limites de tasa y la reduccion de costes. Al agrupar el acceso a la API entre muchos usuarios y negociar precios por volumen con Google (o mantener sus propias implementaciones de Vertex AI), proveedores como laozhang.ai pueden ofrecer un precio por imagen de $0.05 independientemente de la resolucion, comparado con $0.134 a 2K o $0.24 a 4K a traves de la API oficial. Eso supone un ahorro del 63% a 2K y del 79% a 4K, que se acumula rapidamente a volumenes de produccion. Tambien suelen proporcionar sin limites de RPM ni RPD, lo que resuelve la dimension de limites de tasa por completo. Para desarrolladores que quieran probar la generacion de imagenes de Nano Banana Pro con minima complicacion, tambien puedes hacer pruebas en images.laozhang.ai.

| Proveedor | Precio 1K-2K | Precio 4K | Limites de tasa | Configuracion de seguridad |

|---|---|---|---|---|

| API oficial | $0.134/imagen | $0.240/imagen | 20 RPM / 250 RPD | Soporte completo de BLOCK_NONE |

| API por lotes | $0.067/imagen | $0.120/imagen | Prioridad inferior | Soporte completo de BLOCK_NONE |

| laozhang.ai | $0.05/imagen | $0.05/imagen | Ilimitado | BLOCK_NONE reenviado |

| Viyou (afirma) | No listado | No listado | Afirma ilimitado | Afirma "sin censura" |

Lo que los proveedores de terceros generalmente no pueden cambiar es el filtrado de seguridad de la Capa 2. Debido a que la verificacion IMAGE_SAFETY ocurre dentro de la infraestructura de Google durante la generacion de la imagen, un servicio proxy que simplemente reenvie solicitudes a la API de Gemini encontrara los mismos bloqueos de la Capa 2 que una llamada directa a la API. Algunos proveedores afirman ofrecer acceso "sin censura" o "completamente sin filtros", pero la realidad tecnica es que cualquier servicio que utilice el modelo Gemini 3 Pro Image de Google esta sujeto a la evaluacion de seguridad del lado del servidor de Google. Desconfia de los proveedores que hacen afirmaciones generalizadas de "sin restricciones" sin explicar el mecanismo tecnico especifico; los proveedores legitimos te diran honestamente lo que pueden y no pueden controlar.

La razon mas solida para usar un proveedor de terceros no es eludir los filtros de seguridad, sino la eficiencia de costes y la eliminacion de limites de tasa. Para nuestro desglose completo de precios en todos los metodos de acceso, incluidas las estrategias de API por lotes, consulta la guia enlazada.

Optimizacion de costes para acceso ilimitado de alto volumen

Ejecutar Nano Banana Pro a escala de produccion requiere una estrategia de costes. Al precio oficial de 4K de $0.24 por imagen, generar 1,000 imagenes al dia cuesta $240 diarios o aproximadamente $7,200 al mes. La misma carga de trabajo a traves de laozhang.ai a $0.05 por imagen cuesta $50 diarios o $1,500 al mes, una diferencia de $5,700 al mes que justifica la decision arquitectonica.

La API por lotes ofrece un punto intermedio para cargas de trabajo que no son sensibles al tiempo. Google proporciona un descuento del 50% en el procesamiento por lotes, reduciendo las imagenes de 2K a $0.067 y las de 4K a $0.120 cada una. Las solicitudes por lotes tienen menor prioridad y tiempos de procesamiento mas largos, pero para aplicaciones como generacion de contenido diario, fotografia de productos programada o creacion de activos de fondo, el retraso es aceptable. Puedes aprender mas sobre las estrategias de optimizacion de costes de la API por lotes en nuestra guia dedicada.

Los precios basados en resolucion crean otra oportunidad de optimizacion. Muchos casos de uso no requieren realmente generacion a 4K. Las imagenes para redes sociales, miniaturas, banners web y activos de correo electronico lucen perfectamente aceptables a resolucion 2K, que cuesta $0.134 en lugar de $0.24, una reduccion del 44%. Reserva la generacion a 4K para imagenes principales, activos de impresion y casos donde la calidad nativa a 4K realmente importa. Con el precio fijo de $0.05 de laozhang.ai, esta distincion desaparece por completo, lo que simplifica tu arquitectura al eliminar la logica de enrutamiento de costes basada en resolucion.

Para equipos que consumen miles de imagenes diariamente, el calculo de costes favorece decididamente a los proveedores de terceros. Considera que 5,000 imagenes 4K por dia cuestan $1,200 a traves de la API oficial, $600 a traves de la API por lotes (si puedes tolerar la latencia), o $250 a traves de laozhang.ai. A lo largo de un ano, la diferencia entre la API oficial y un proveedor externo supera los $300,000, un presupuesto que podria financiar mejoras de ingenieria significativas en otros ambitos.

| Volumen diario | Oficial 4K | Lotes 4K | laozhang.ai | Ahorro anual (vs Oficial) |

|---|---|---|---|---|

| 100 imagenes | $24/dia | $12/dia | $5/dia | $6,935 |

| 500 imagenes | $120/dia | $60/dia | $25/dia | $34,675 |

| 1,000 imagenes | $240/dia | $120/dia | $50/dia | $69,350 |

| 5,000 imagenes | $1,200/dia | $600/dia | $250/dia | $346,750 |

Los costes de tokens agregan un gasto oculto que muchos desarrolladores pasan por alto. Cada solicitud de Nano Banana Pro consume tokens de entrada para tu prompt (cobrados a $2.00 por millon de tokens) y tokens de salida para la imagen generada (cobrados a $12.00 por millon de tokens de salida, con aproximadamente 1,120 tokens para una imagen de 2K y 2,000 tokens para 4K). Para cargas de trabajo de texto a imagen, el coste de tokens esta incluido en los precios por imagen anteriores. Pero para flujos de trabajo de edicion de imagen a imagen donde envias una imagen de referencia como entrada, el coste de tokens de entrada puede ser significativo: una unica imagen de referencia de alta resolucion consume aproximadamente 560 tokens, agregando aproximadamente $0.001 por solicitud. A 5,000 solicitudes diarias, eso suma $5 adicionales por dia, lo cual es insignificante respecto al coste de salida pero igualmente vale la pena rastrear para fines de asignacion de costes.

Una arquitectura hibrida a menudo tiene el mayor sentido economico para implementaciones en produccion. Usa la API oficial por lotes para tareas en segundo plano donde la latencia no importa (contenido programado, pregeneracion de variantes de productos), y enruta las solicitudes en tiempo real orientadas al usuario a traves de un proveedor de terceros para respuesta instantanea y rendimiento ilimitado. Esta combinacion proporciona tanto optimizacion de costes en cargas de trabajo predecibles como servicio responsivo para funciones interactivas, sin requerir contratos empresariales de Vertex AI.

Preguntas frecuentes

¿Usar BLOCK_NONE viola los Terminos de Servicio?

No. BLOCK_NONE es un parametro de la API oficialmente documentado, proporcionado por Google especificamente para desarrolladores que necesitan gestionar la clasificacion de contenido a nivel de aplicacion. La documentacion de Google describe explicitamente esta configuracion y su comportamiento. Sigues siendo responsable de asegurar que la salida de tu aplicacion cumpla con la Politica de Uso Aceptable de Google, pero utilizar el parametro en si mismo esta plenamente autorizado.

¿Puedo obtener acceso verdaderamente ilimitado a la API de Nano Banana Pro directamente de Google?

A traves de Vertex AI con un acuerdo de gasto comprometido, puedes negociar limites de tasa personalizados que eliminan efectivamente las restricciones practicas para la mayoria de las cargas de trabajo. Sin embargo, esto requiere interaccion directa con el equipo de ventas de Google Cloud y tipicamente implica un gasto mensual comprometido de $10,000 o mas. Para la mayoria de los desarrolladores, los proveedores de terceros ofrecen acceso funcionalmente ilimitado a una fraccion del coste.

¿Por que mi solicitud es bloqueada incluso con BLOCK_NONE configurado?

Porque BLOCK_NONE solo afecta a la Capa 1 (las cuatro categorias de dano configurables). La Capa 2 (IMAGE_SAFETY) evalua la imagen generada en si misma utilizando clasificacion por IA, y la Capa 2 no puede configurarse mediante ningun parametro de la API. Si ves finishReason: "IMAGE_SAFETY", el bloqueo provino de la Capa 2. Intenta refinar tu prompt con un contexto mas especifico y profesional.

¿Que cambio en marzo de 2026 respecto a la politica de contenido?

Google endurecio significativamente las restricciones sobre la edicion relacionada con personas. Operaciones como el reemplazo de fondos en fotos que contienen personas, la composicion de fotos grupales y la modificacion de apariencia ahora activan frecuentemente blockReason: "OTHER" antes de que comience la generacion. Esto afecta principalmente a los flujos de trabajo de edicion de imagenes mas que a la generacion de texto a imagen.

¿Es seguro usar laozhang.ai para cargas de trabajo en produccion?

laozhang.ai opera como una plataforma de agregacion de APIs que enruta las solicitudes a la infraestructura oficial de Google. Ofrece la misma calidad de modelo que el acceso directo a la API, sin limites de RPM/RPD y con precios de $0.05 por imagen independientemente de la resolucion. Para uso en produccion, la consideracion clave es si te sientes comodo enrutando el trafico de la API a traves de un tercero frente a mantener una relacion de facturacion directa con Google. Muchos desarrolladores usan un enfoque hibrido: la API directa de Google para cargas de trabajo sensibles o reguladas, y proveedores de terceros para operaciones de alto volumen y sensibles al coste.

¿Como se compara Nano Banana 2 (Gemini 3.1 Flash Image) para acceso sin restricciones?

Nano Banana 2 ofrece un equilibrio diferente. Admite acceso a la API de nivel gratuito (a diferencia de Nano Banana Pro que es solo de pago), genera imagenes mas rapido en 4-6 segundos frente a 12-18 segundos, y cuesta significativamente menos a $0.067 por imagen de 1K oficialmente. Sin embargo, carece de calidad de generacion nativa a 4K, tiene menor precision en el renderizado de texto (87-96% frente al 94-96% de Pro), y utiliza la misma arquitectura de seguridad de dos capas. Para muchos casos de uso donde la resolucion de 2K es suficiente y el coste importa mas que la calidad maxima, Nano Banana 2 es en realidad la mejor opcion para acceso "sin restricciones" de alto volumen, ya que incluye un nivel gratuito con limites mas altos.

¿Se me cobra por las solicitudes bloqueadas?

Para los bloqueos de la Capa 1 (finishReason: "SAFETY"), tipicamente no se te cobra porque el bloqueo ocurre antes de que comience la generacion de la imagen. Para los bloqueos de la Capa 2 (finishReason: "IMAGE_SAFETY"), se te cobran los tokens de entrada y los tokens de salida consumidos durante la generacion: la imagen fue creada pero luego bloqueada antes de ser devuelta. Esta es una distincion crucial para la planificacion de costes: altas tasas de bloqueos IMAGE_SAFETY pueden inflar tus costes sin entregar imagenes utilizables. Monitorizar tu tasa de bloqueo y optimizar los prompts para reducir los bloqueos de la Capa 2 impacta directamente en tu coste efectivo por imagen utilizable.

¿Cual es la forma mas rapida de empezar a generar imagenes con Nano Banana Pro ahora mismo?

La ruta mas rapida es: (1) Ir a Google AI Studio en aistudio.google.com, (2) Iniciar sesion con tu cuenta de Google, (3) Crear una clave API, (4) Vincular una cuenta de facturacion a tu proyecto, (5) Usar el codigo de Python o JavaScript de la seccion H2-3 anterior con tu clave API y la configuracion de seguridad BLOCK_NONE. Toda la configuracion toma menos de 10 minutos. Si quieres evitar la configuracion de facturacion por completo, puedes empezar inmediatamente con un proveedor de terceros como laozhang.ai, que solo requiere un registro de cuenta y una clave API, sin necesidad de configuracion de facturacion de Google Cloud.