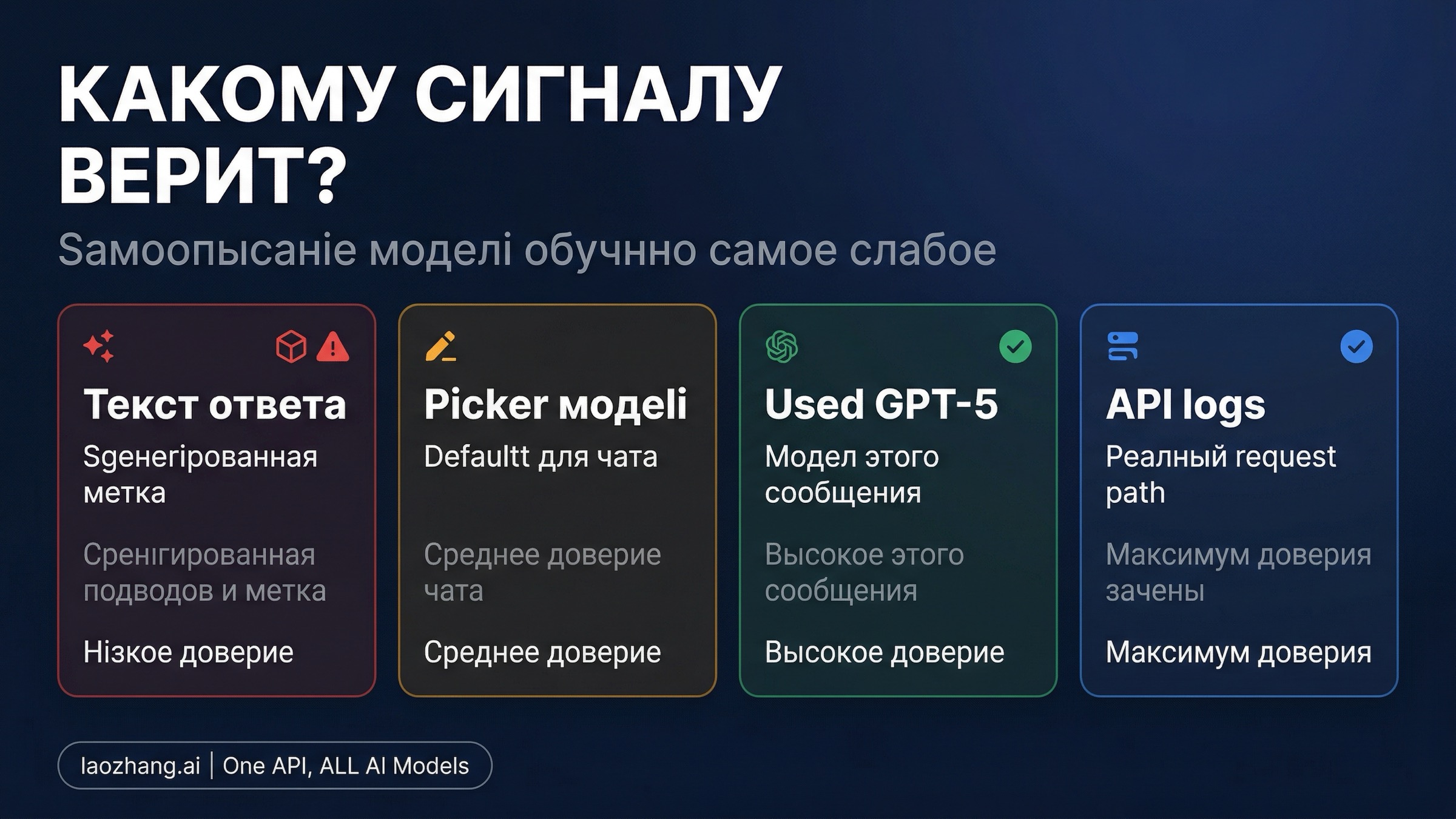

То, что GPT-5 пишет GPT-4, само по себе не означает, что ChatGPT тайно вернул вас на GPT-4. OpenAI теперь говорит это прямо: самоописание модели внутри ответа является сгенерированным текстом и может быть ошибочным или слишком общим. Если интерфейс одновременно показывает пометку вроде Used GPT-5, именно эта пометка считается для данного сообщения источником истины, а не фраза в тексте ответа.

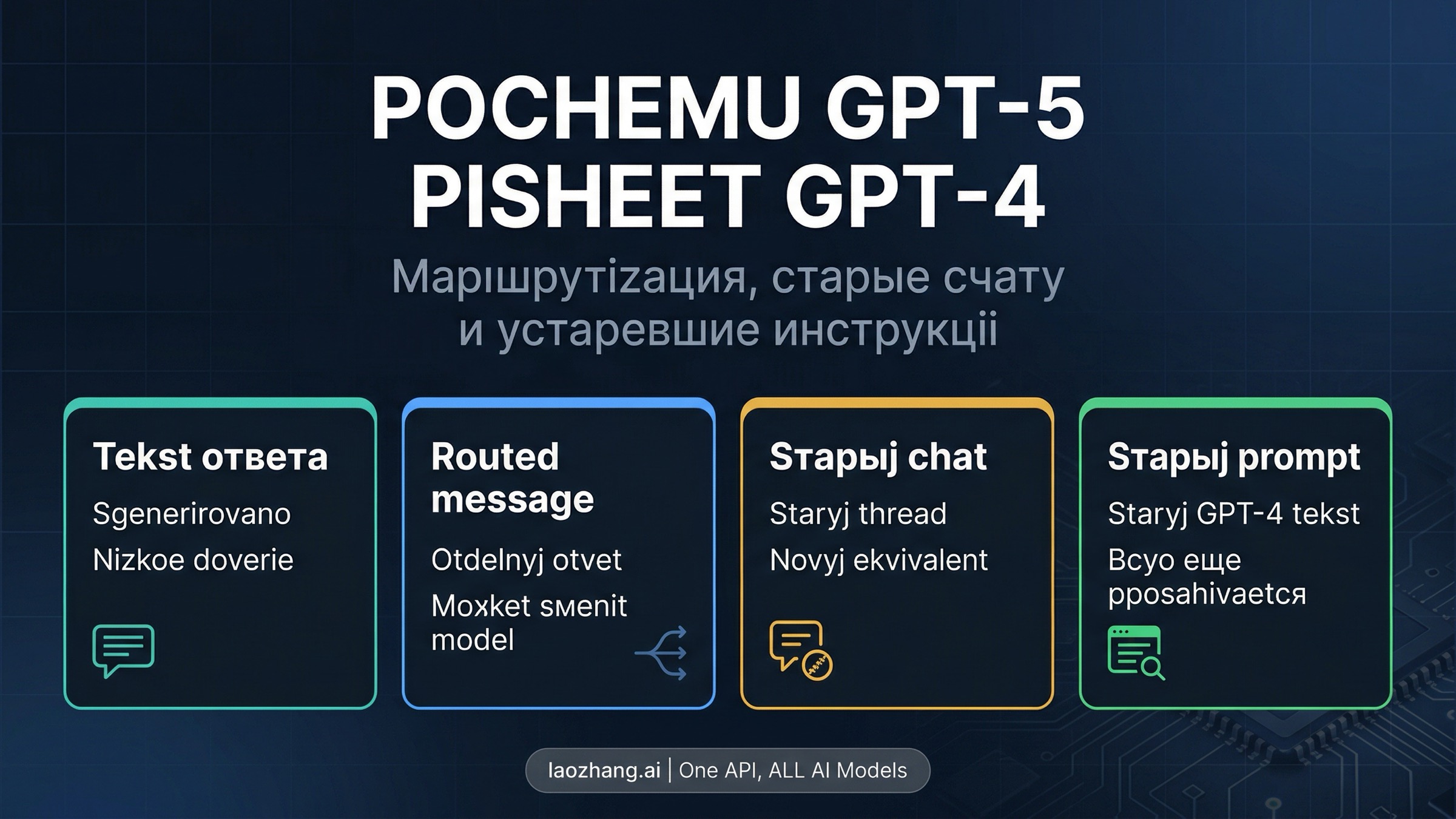

Сегодня такая путаница возникает чаще, потому что современный ChatGPT уже не похож на старую схему "одно окно чата = одна фиксированная модель". Вверху вы видите модель по умолчанию для чата, конкретное сообщение может быть маршрутизировано на другой путь, старые беседы после вывода моделей из эксплуатации могут продолжать работу на новых эквивалентах, а в Custom GPT или пользовательских инструкциях могут оставаться старые формулировки с GPT-4. Когда эти уровни расходятся, наименее надежным сигналом часто оказывается именно строка, где модель описывает саму себя.

Этот материал заново проверен по актуальным страницам OpenAI Help Center, ChatGPT Release Notes, GPT-5 System Card и текущей документации OpenAI для разработчиков на 1 апреля 2026 года.

Короткий ответ: какому сигналу верить?

Сначала запомните эту иерархию:

| Сигнал | Что он реально показывает | Уровень доверия | Когда использовать |

|---|---|---|---|

| Фраза в ответе вроде "я GPT-4" | Самоописание внутри сгенерированного текста | Низкий | Максимум как подсказку, но не как доказательство |

Used GPT-5 или похожая пометка | Какая модель обработала именно это сообщение | Высокий | В ChatGPT это главный сигнал |

| Переключатель модели вверху | Модель по умолчанию для беседы | Средний | Полезно для дефолта чата, но не всегда для конкретного ответа |

| API-конфиг и логи | Какая модель реально была вызвана приложением | Самый высокий для API | Для разработки и отладки используйте именно это |

Главная поправка проста. В ChatGPT OpenAI считает authoritative именно пометку на уровне сообщения, а не самоописание внутри текста. В API authoritative сигналом остаются ваш запрос и ваши логи. Модель может неверно назвать себя, если ее к этому подтолкнули история диалога, старый prompt или устаревшая инструкция.

Почему это стало происходить чаще: GPT-5 в ChatGPT - это маршрутизируемая система

Сама продуктовая документация OpenAI объясняет большую часть этой путаницы. GPT-5 System Card описывает GPT-5 как единую систему с маршрутизатором в реальном времени, который выбирает модельный путь в зависимости от контекста, сложности, необходимости инструментов и явного намерения пользователя. В release notes GPT-5 в ChatGPT сначала был представлен как единая auto-switching система, а позднее OpenAI стал явнее показывать настройки Instant, Thinking и доступ к legacy models.

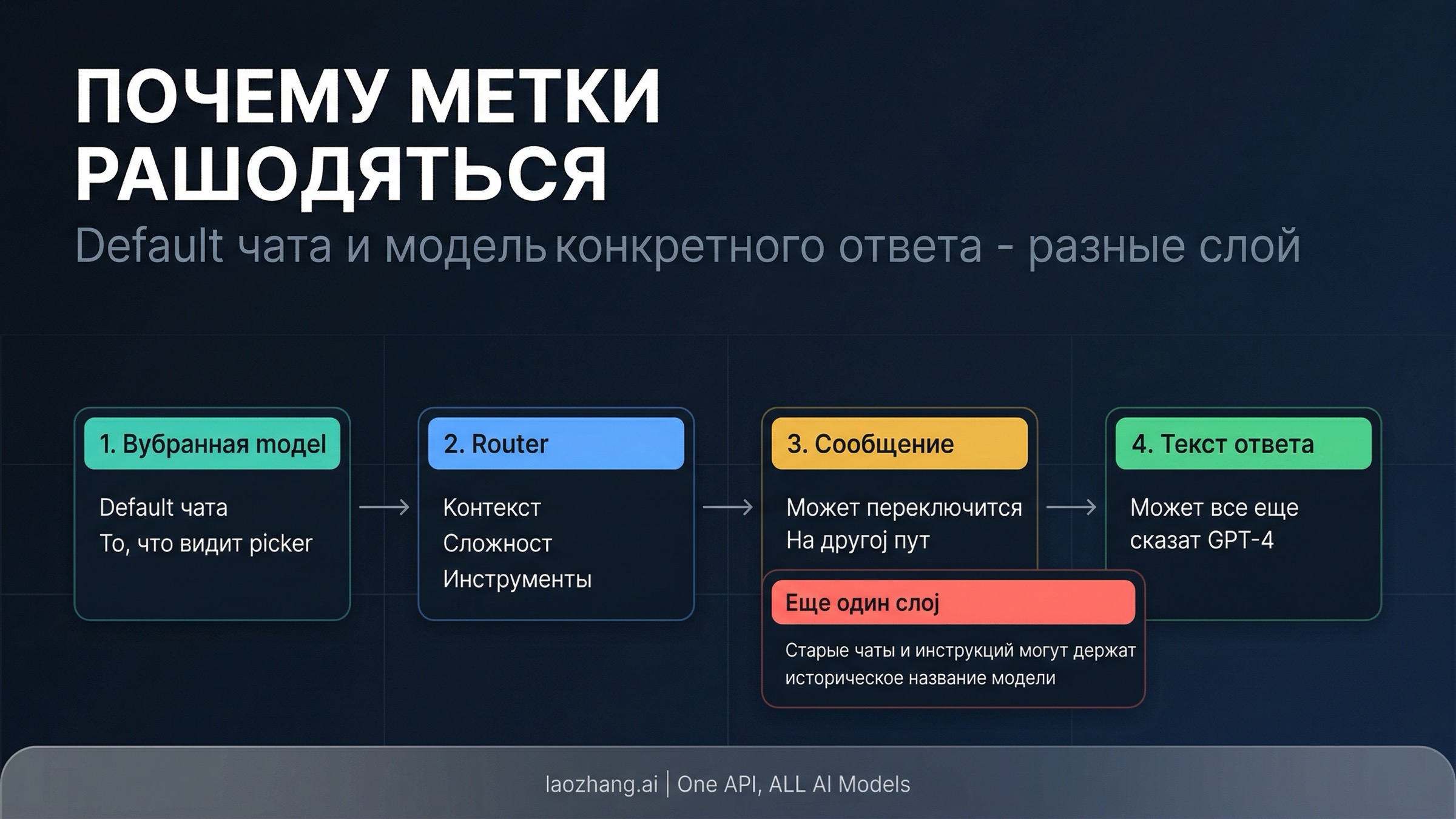

Это означает, что в ChatGPT слово "модель" теперь живет на нескольких уровнях сразу. Один уровень - это модель, выбранная по умолчанию для текущего чата. Второй - это модель, которая обработала конкретное сообщение. Третий - это текущий эквивалент для старых бесед после вывода прежней модели. И четвертый - это текстовое самоописание внутри самого ответа. Эти уровни часто совпадают. Но как только они расходятся, пользователь естественно воспринимает это как странный баг.

Пометка Used GPT-5 особенно важна именно поэтому. В справочной статье OpenAI прямо сказано, что система может маршрутизировать отдельные сообщения на другой модельный путь, при этом выбранная вами модель остается моделью по умолчанию для беседы. То есть верхний picker и реальная модель для одного конкретного ответа могут временно не совпадать без того, чтобы весь чат "переключился".

Поэтому вы вполне можете одновременно видеть следующее:

- вверху picker остается на выбранной вами модели

- у конкретного ответа появляется пометка

Used GPT-5 - в самом тексте ответа модель пишет "как модель GPT-4..."

Эти сигналы не обязательно противоречат друг другу. Они просто относятся к разным слоям, а самоописание в тексте - самый слабый из них.

Три основные группы причин

Подавляющее большинство реальных случаев укладывается в три группы. Чтобы исправить ситуацию, сначала надо понять, к какой группе относитесь вы.

1. Отдельное сообщение было маршрутизировано на другой модельный путь. Это самый чистый и наиболее явно задокументированный случай. OpenAI прямо пишет, что система может маршрутизировать конкретные сообщения отдельно от модели по умолчанию. Публично лучше всего описан сценарий с чувствительными темами, но System Card показывает, что дело не только в них: значение имеют и сложность задачи, и инструменты, и контекст. Если интерфейс говорит Used GPT-5, это более надежный сигнал, чем строка в теле ответа.

2. Вы продолжаете старую беседу или работаете в legacy surface, который был перенесен вперед. В 2026 году OpenAI вывел из эксплуатации несколько старых моделей ChatGPT и сопоставил существующие беседы с новыми эквивалентами. Release notes говорят, что диалоги, которые раньше использовали GPT-5.1, автоматически продолжаются на GPT-5.3 Instant или соответствующих путях GPT-5.4 Thinking / Pro. В справке о выводе GPT-4o и других моделей сказано, что conversations и projects переходят на эквиваленты GPT-5.3 Instant / GPT-5.4. В такой ситуации историческое ощущение "этот чат был на одной модели" легко отстает от текущей серверной реальности.

3. В инструкциях все еще живет старый текст про GPT-4. OpenAI не публиковал отдельную статью в стиле "именно поэтому GPT-5 продолжает говорить GPT-4", так что это нужно честно называть выводом, а не дословной официальной формулировкой. Но это сильный и практический вывод из двух официальных фактов. Во-первых, OpenAI пишет, что personality и custom instructions теперь применяются сразу ко всем чатам. Во-вторых, в GPT-5 Prompting Guide сказано, что GPT-5 очень чувствителен к инструкциям, а противоречивые и устаревшие инструкции особенно часто ведут к странному поведению. Если в system prompt, Custom GPT builder или ваших персональных инструкциях осталось You are GPT-4 или похожий старый identity text, GPT-5 вполне может продолжать повторять это имя, даже когда backend давно другой.

Именно третья группа чаще всего делает проблему "липкой". Маршрутизация одного сообщения обычно разовая. Миграция старой беседы тоже объяснима через даты и release notes. А вот устаревший prompt продолжает снова и снова вытаскивать старое имя, пока вы его не уберете.

Как проверить, что реально ответило

Метод проверки зависит от поверхности.

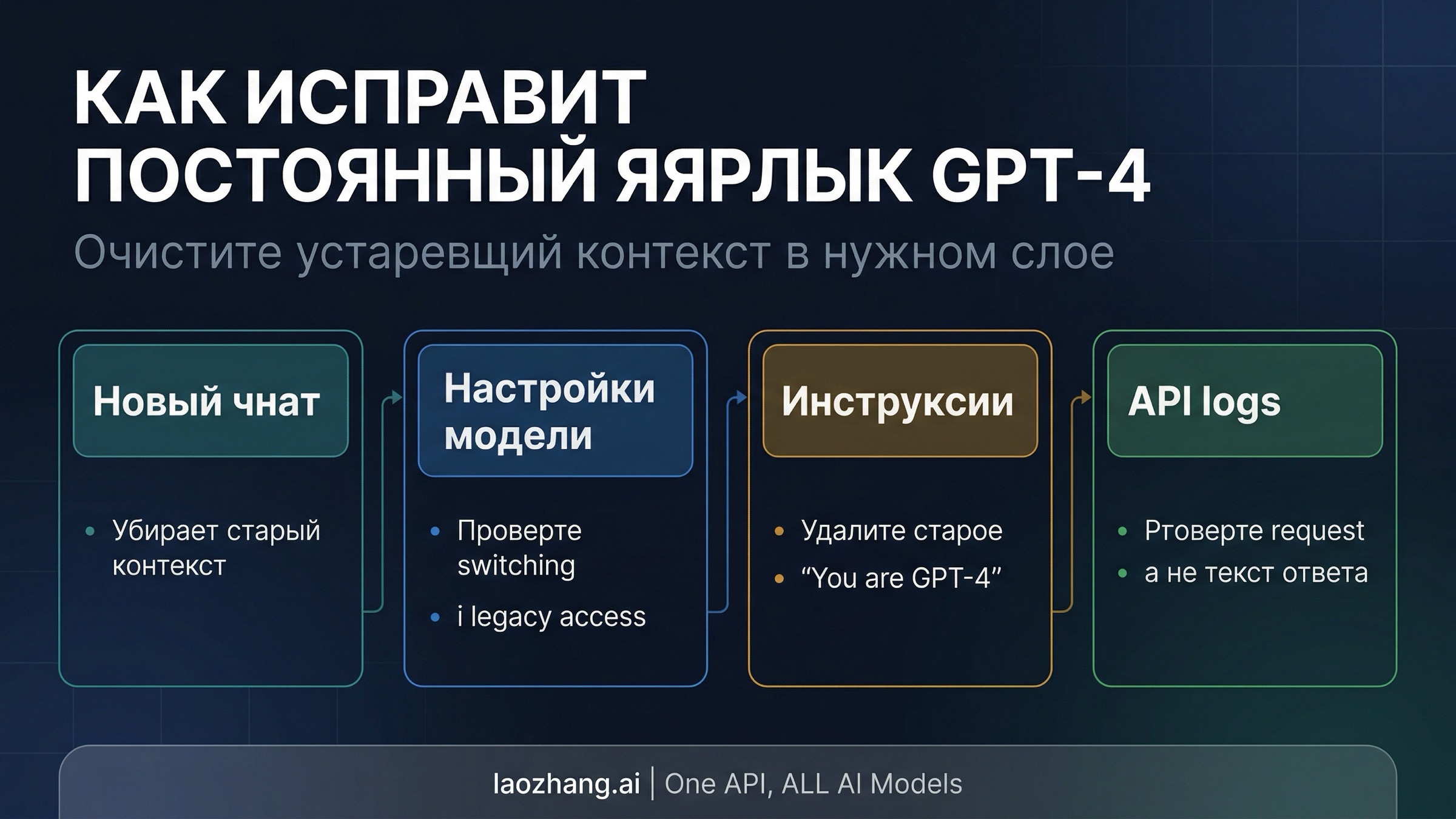

В ChatGPT начинайте с того, что OpenAI сам предлагает считать authoritative. Если рядом с ответом есть пометка вроде Used GPT-5, воспринимайте ее как источник истины для этого сообщения. Затем смотрите на picker вверху, но помните: это показатель модели по умолчанию для чата, а не всегда точный индикатор именно этой реплики.

Если речь о старой беседе, не делайте вывод только по памяти о том, какая модель была выбрана раньше. Сначала сверяйтесь с актуальными release notes и уведомлениями о retirement. OpenAI уже документировал автоматическое продолжение старых диалогов на новых эквивалентах.

Если вы используете Custom GPT, проверяйте builder-конфигурацию и текст инструкций, а не спрашивайте модель бесконечно "кто ты?". Ценность ответа на такой вопрос низкая. Ценность реального prompt-текста - намного выше.

Для API не переносите интуицию из ChatGPT один в один. Поведение с маршрутизацией сообщений относится к продуктовой поверхности ChatGPT. В API authoritative сигналом остается модель, которую вы запросили, и та, что зафиксирована в логах. Если приложение отправило GPT-5, а ответ сказал "я GPT-4", это обычно проблема prompt / output слоя, а не доказательство скрытой подмены модели.

Что делать, если неправильное имя появляется снова и снова

Когда вы поняли, к какой группе относится ваш случай, путь исправления становится коротким.

- Создайте новый чат для чистой проверки. Старые беседы несут слишком много шума: прошлый контекст, старые переключения, старые инструкции и исторические формулировки.

- Проверьте настройки модели и legacy access. Auto-switching и доступ к старым моделям полезны, но именно они чаще всего создают путаницу между моделью по умолчанию и моделью конкретного ответа.

- Аудируйте Custom GPT instructions, personal instructions и долгоживущие prompt-шаблоны. Ищите

You are GPT-4,As GPT-4и другие старые identity-формулировки. Если неверное имя появляется устойчиво, проблема часто сидит именно здесь. - В API ориентируйтесь на логи, а не на самоописание модели. Для regression testing, production verification и A/B-сравнений это единственный надежный путь.

Есть одна привычка, от которой сегодня лучше отказаться: не используйте вопрос "скажи, какая ты модель" как способ верификации. В старых более простых интерфейсах это еще могло сойти за быстрый тест. В современной маршрутизируемой архитектуре ChatGPT это ненадежно, а в API-отладке - просто плохая практика.

Значит ли это, что вы на самом деле сидите на GPT-4?

Обычно нет. По крайней мере, из одной этой фразы такой вывод делать нельзя.

Если единственное "доказательство" - это строка в ответе, где модель назвала себя GPT-4, это слабый сигнал. OpenAI прямо пишет, что такие самоописания могут быть ошибочными или слишком общими. Если UI показывает Used GPT-5, это уже гораздо более сильное основание считать, что сообщение обработал GPT-5. Если API-логи показывают запрос к GPT-5, это тоже сильнее, чем слова самой модели.

Проблема становится действительно значимой тогда, когда неправильное имя совпадает с более сильными сигналами: например, в builder-инструкциях реально остался старый GPT-4 identity text, вы сознательно используете legacy surface, или логи показывают не тот model path, который вы ожидали. Только в таких случаях стоит говорить уже не о слабом текстовом сбое, а о конфигурационной или продуктовой проблеме.

Самое практичное правило

Когда GPT-5 пишет GPT-4, сначала исходите из того, что ошиблась эта строка, а не backend.

Дальше проверяйте самый сильный сигнал для соответствующей поверхности: пометки сообщений и настройки в ChatGPT, request и логи в API, builder-конфиг и инструкции в Custom GPT. Так путаница с именами превращается не в загадку, а в короткий диагностический сценарий, а именно этого и хочет читатель, который столкнулся с таким несоответствием.