Если под «OpenAI Sora API» вы имеете в виду официальную программную генерацию видео на платформе OpenAI, ответ да: текущий developer surface OpenAI это Videos API, построенный вокруг POST /v1/videos и моделей sora-2 / sora-2-pro. Путаница возникает потому, что у OpenAI одновременно есть потребительское приложение / редактор Sora и доступ к Sora внутри ChatGPT, а эти поверхности не описываются одним и тем же языком «API». Именно поэтому даже в марте 2026 года выдача выглядит противоречиво.

Это руководство отвечает на вопрос разработчика, а не пользователя приложения. Здесь важны официальный developer contract, который реально существует сейчас, самый короткий рабочий create -> wait -> download workflow, ценовые и policy-ограничения, которые нужно знать до начала разработки, а также изменения марта 2026 года, сделавшие старые обзоры Sora API неполными.

Проверено по текущим OpenAI Developers docs, pricing, model pages и help-center материалам 28 марта 2026 года.

TL;DR

- Официальный developer access уже есть. Нужная поверхность это

/v1/videos, а не потребительский редактор Sora. - Начинайте с

sora-2, если вы итерируете prompt, кадрирование или motion и хотите снизить стоимость. - Переходите на

sora-2-pro, когда нужна более качественная картинка, особенно для1920x1080или1080x1920. - Сразу проектируйте workflow как асинхронный. Создайте job, опрашивайте

GET /videos/{video_id}или используйте webhooks, затем скачивайте asset черезGET /videos/{video_id}/content. - Документация OpenAI по Sora сейчас частично рассинхронизирована. Основной guide и changelog за март 2026 уже документируют 16/20 секунд, edits, extensions, reusable characters, Batch и 1080p

sora-2-pro, а некоторые старые reference fragments все еще показывают только более короткие длительности и меньшие размеры.

Что сейчас на самом деле означает «OpenAI Sora API»

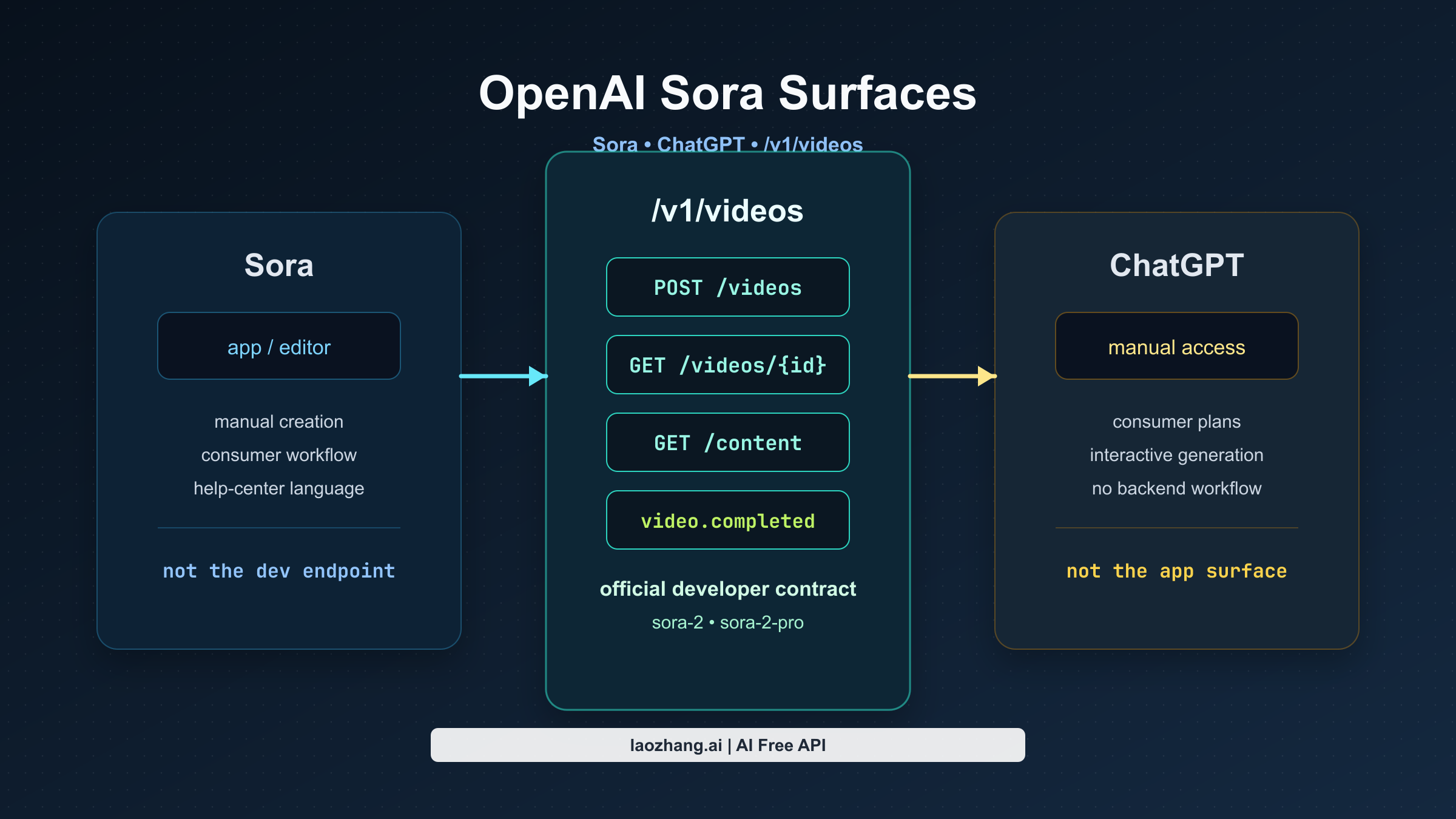

Главная ошибка в этой теме — воспринимать Sora как один продуктовый слой. На практике слоев как минимум три:

| Поверхность | Что это | Для кого | Для чего использовать |

|---|---|---|---|

| Приложение / редактор Sora | Потребительский опыт Sora от OpenAI | обычные пользователи, создающие ролики вручную | творческие эксперименты в приложении или веб-редакторе |

| Доступ через ChatGPT | Генерация Sora внутри тарифов ChatGPT | пользователи и профи, которым нужна ручная генерация без бэкенда | разовые генерации в интерактивном интерфейсе |

| Videos API | Официальный developer surface OpenAI | разработчики, стартапы, продуктовые команды | программная генерация видео, edits, extensions, Batch и обработка ассетов |

Именно это разделение объясняет, почему официальные страницы OpenAI могут звучать несогласованно. Help Center по-прежнему содержит app-focused материалы про Sora, и они относятся к потребительскому продукту. Developer docs, напротив, уже документируют рабочий стек Video generation with Sora с актуальными endpoints, моделями, pricing и code samples.

Поэтому самый надежный mental model сегодня такой:

Не интегрируйте «приложение Sora». Интегрируйте Videos API от OpenAI.

После этой формулировки все выглядит очевидно, но именно этого уточнения сейчас не хватает большинству результатов в поиске.

Самый быстрый рабочий путь OpenAI сегодня

Если вам нужен самый короткий официальный путь от нуля до первого рабочего результата, он довольно прямой.

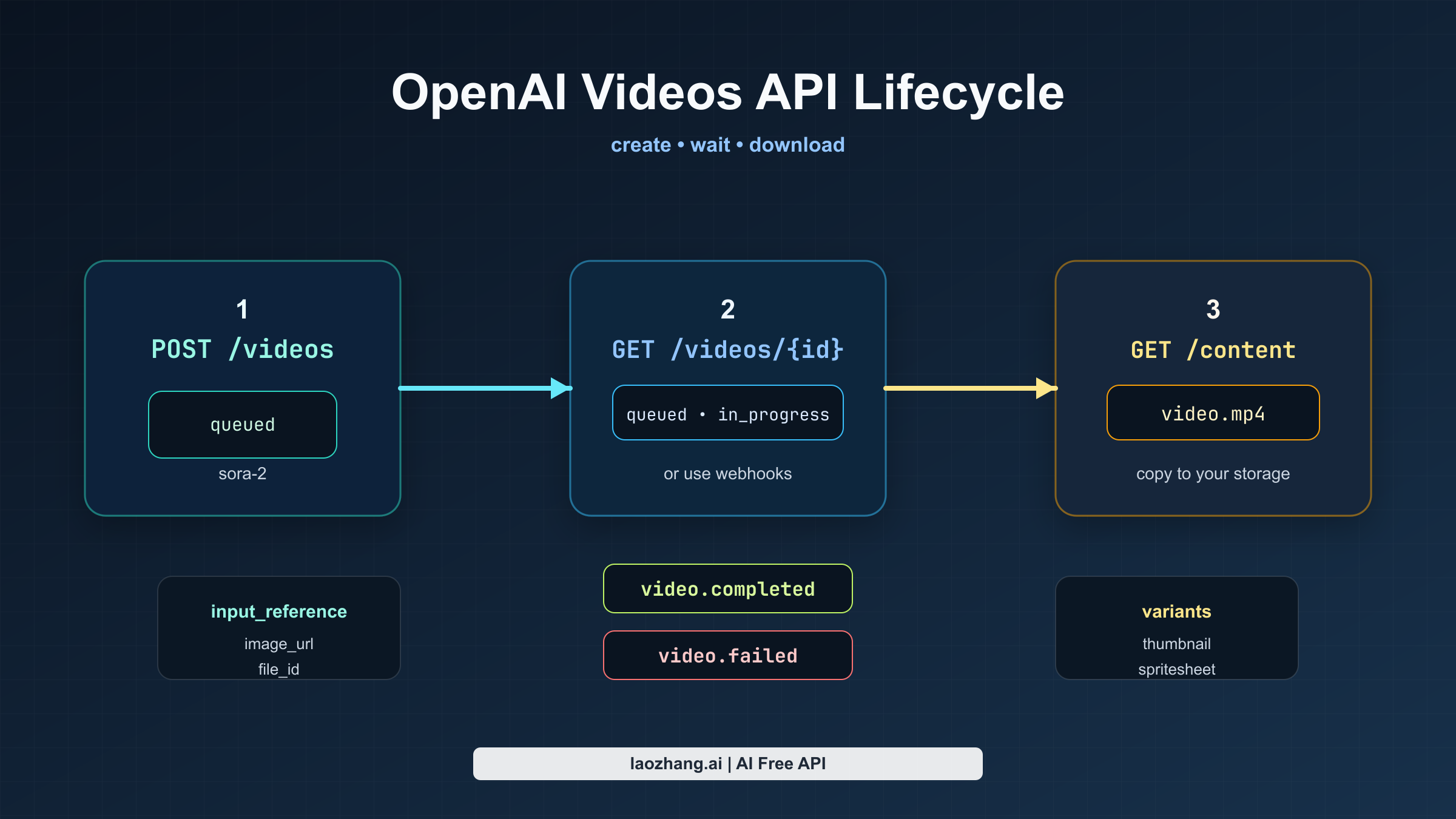

Сначала вызовите POST /v1/videos с prompt, model, size и duration. OpenAI рассматривает генерацию видео как асинхронную job, поэтому первый ответ лишь сообщает, что job создана и находится в состоянии вроде queued или in_progress. Затем либо опрашивайте GET /v1/videos/{video_id}, пока статус не станет completed, либо настройте webhook и дождитесь события video.completed или video.failed. После завершения job скачайте бинарный файл через GET /v1/videos/{video_id}/content.

Для прототипов polling вполне достаточен. Для production webhook — более чистый контракт, потому что длинные рендеры могут занимать минуты, и вы не хотите тратить запросы только для того, чтобы узнать, что job все еще выполняется.

Ниже минимальный JavaScript путь с текущим SDK-паттерном OpenAI:

javascriptimport OpenAI from "openai"; import { writeFile } from "node:fs/promises"; const openai = new OpenAI({ apiKey: process.env.OPENAI_API_KEY }); const video = await openai.videos.createAndPoll({ model: "sora-2", prompt: "Wide tracking shot of a yellow taxi crossing a rain-soaked city street at blue hour, neon reflections, natural ambient audio.", size: "1280x720", seconds: "8", }); if (video.status !== "completed") { throw new Error(`Video failed with status ${video.status}`); } const content = await openai.videos.downloadContent(video.id); const buffer = Buffer.from(await content.arrayBuffer()); await writeFile("video.mp4", buffer); // In production, copy the file into your own object storage immediately.

Тот же lifecycle в сыром HTTP-виде:

bashcurl -X POST "https://api.openai.com/v1/videos" \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -F model="sora-2" \ -F prompt="Wide tracking shot of a yellow taxi crossing a rain-soaked city street at blue hour, neon reflections, natural ambient audio." \ -F size="1280x720" \ -F seconds="8" curl "https://api.openai.com/v1/videos/$VIDEO_ID" \ -H "Authorization: Bearer $OPENAI_API_KEY" curl -L "https://api.openai.com/v1/videos/$VIDEO_ID/content" \ -H "Authorization: Bearer $OPENAI_API_KEY" \ --output video.mp4

Это и есть core integration. Все остальное в текущем Sora stack строится вокруг этой job-модели.

Pricing, модели и рассинхрон документации, который важно заметить

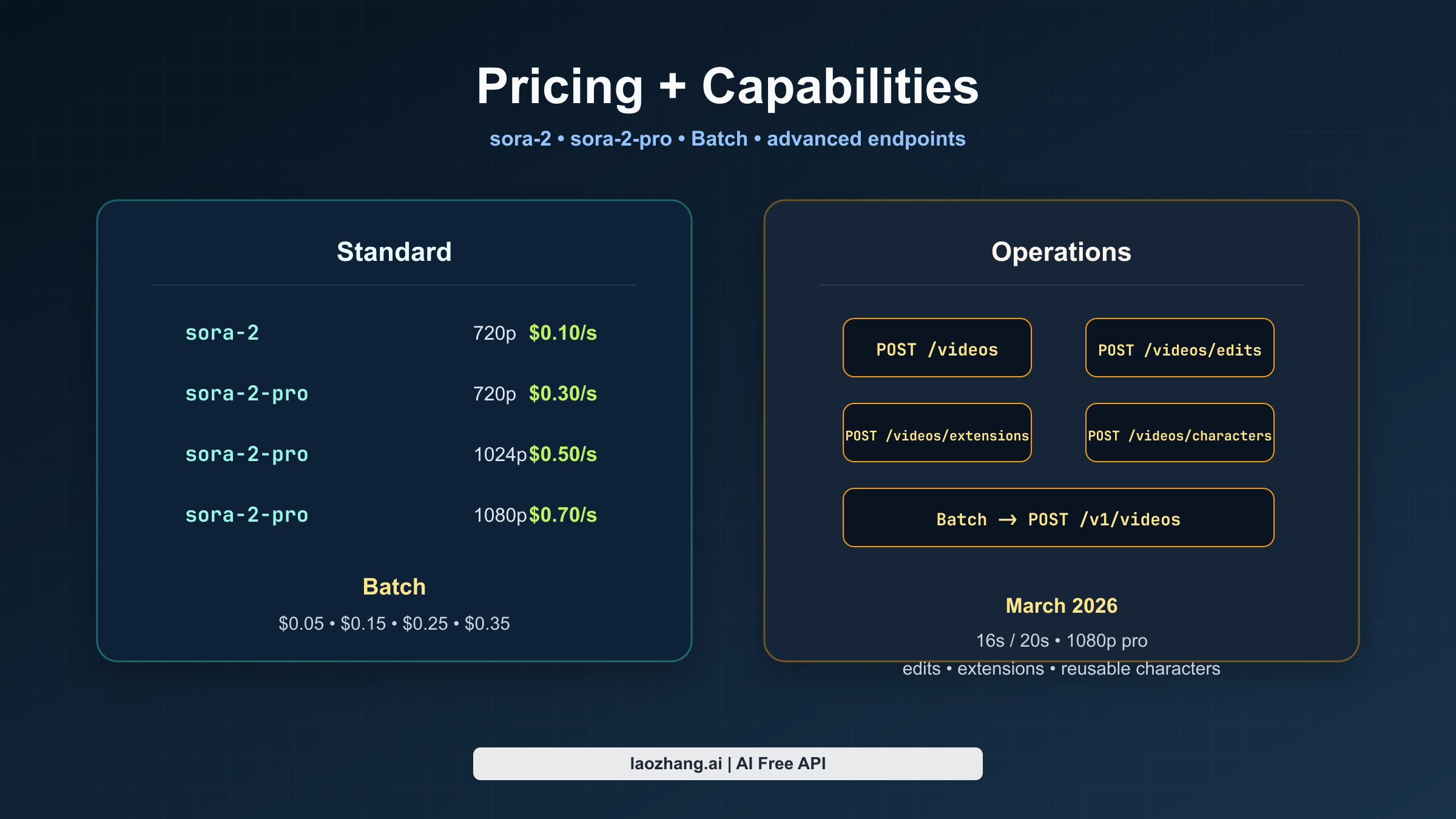

Текущая официальная pricing page делает разделение моделей довольно прозрачным. sora-2 — более дешевая и быстрая модель для итераций. sora-2-pro — более качественная output-модель, и именно она нужна, если вы хотите 1080p.

На сегодня pricing docs OpenAI показывают такую структуру поминутного... точнее посекундного биллинга для standard usage:

| Режим | Модель | Выход | Официальная цена |

|---|---|---|---|

| Standard | sora-2 | 720x1280 или 1280x720 | $0.10/sec |

| Standard | sora-2-pro | 720x1280 или 1280x720 | $0.30/sec |

| Standard | sora-2-pro | 1024x1792 или 1792x1024 | $0.50/sec |

| Standard | sora-2-pro | 1080x1920 или 1920x1080 | $0.70/sec |

Для Batch сейчас показана та же лестница, но вдвое дешевле:

| Режим | Модель | Выход | Официальная цена |

|---|---|---|---|

| Batch | sora-2 | 720x1280 или 1280x720 | $0.05/sec |

| Batch | sora-2-pro | 720x1280 или 1280x720 | $0.15/sec |

| Batch | sora-2-pro | 1024x1792 или 1792x1024 | $0.25/sec |

| Batch | sora-2-pro | 1080x1920 или 1920x1080 | $0.35/sec |

Из этого уже следует почти все, что нужно operationally:

- Если вы исследуете prompt, стартуйте с

sora-2. - Если вы готовите финальные ассеты и важна polish-качество, переключайтесь на

sora-2-pro. - Если вы рендерите shot list офлайн, economics у Batch уже достаточно сильные, чтобы рассматривать его всерьез.

Но еще важнее другая вещь: документация OpenAI по Sora сейчас частично не синхронизирована. Это вывод из текущих официальных источников, а не догадка:

- основной video guide говорит, что

sora-2иsora-2-proподдерживают генерации на16и20секунд; - changelog за март 2026 прямо говорит о longer generations up to 20 seconds и 1080p

sora-2-pro; - но старые create-reference fragments все еще показывают только

4,8,12секунд и более узкую матрицу размеров.

Если вы пытаетесь понять актуальный контракт, сегодня безопаснее придерживаться такого правила:

доверяйте текущему guide, pricing page и changelog за март 2026 раньше, чем старым reference fragments, вырванным из контекста.

Это предупреждение стоит выделить явно, потому что оно легко влияет на выбор resolution, capacity planning и продуктовые обещания.

Что официальный API умеет сверх обычного text-to-video

Текущий guide — это уже не просто точка входа для text prompt. Современный Sora stack от OpenAI покрывает более широкий lifecycle генерации и итерации.

Image references

Вы можете направлять генерацию через input_reference — либо как загруженный asset в multipart, либо как JSON-объект с file_id или image_url. OpenAI описывает reference image как фактический первый кадр ролика. Ключевое ограничение: reference image должен совпадать с целевым size, а документированные форматы сейчас — image/jpeg, image/png и image/webp.

Это делает image references полезными для brand assets, art direction и кейсов, где вам важнее сохранить opening composition, чем повторно использовать character во многих jobs.

Reusable characters

OpenAI теперь документирует characters workflow для создания переиспользуемых non-human characters из загруженного видео. В текущем guide characters позиционируются как инструмент консистентности для животных, маскотов и объектов, а API позволяет использовать до двух characters в одной генерации. Guide также прямо говорит, что загрузки с human likeness по умолчанию блокируются, и это важно, если вы предполагали, что это универсальная поверхность для «обучения человеческого актера».

Практический вывод простой: characters предназначены для переиспользуемых non-human subjects, а не как обход запрета на реальных людей.

Video extensions

OpenAI теперь документирует video extensions для продолжения уже завершенного клипа. Это правильный маршрут, если вам нужна continuity движения и сцены, а не просто похожий первый кадр. Current guide говорит, что каждое extension может добавить до 20 секунд, одно видео можно продолжить до шести раз, а extensions не поддерживают characters и image references.

Последняя деталь особенно важна. Если ваш product design исходит из предположения, что все advanced features свободно компонуются, он разойдется с реальным контрактом API.

Video edits

Changelog за март 2026 добавил video edits workflow, и теперь это предпочтительный путь для внесения точечных изменений в уже сгенерированное или загруженное видео. Guide явно говорит, что старый remix-route уходит в деприкацию, а edits лучше всего работают, когда изменение узкое и хорошо определенное.

Это сильный сигнал о том, что OpenAI смотрит на Sora уже не как на одноразовый генератор, а как на итеративный media workflow.

Batch

Текущий guide теперь поддерживает Batch для POST /v1/videos, но с несколькими важными ограничениями:

- Batch поддерживает только

POST /v1/videos. - Batch requests должны быть в JSON, а не в multipart.

- Assets нужно загружать заранее и ссылаться на них из JSON.

- Видео из Batch доступны для скачивания до

24часов после завершения batch.

Если вы строите offline render queues, studio workflows или shot-list pipelines, Batch уже нельзя считать второстепенной возможностью. Это часть официального маршрута.

Guardrails и operational gotchas, которые важны до начала разработки

Ограничений у Sora stack уже достаточно много, поэтому policy и retention стоит рассматривать как часть product contract, а не как сноски по compliance.

Current guide говорит, что API сейчас применяет все следующие ограничения:

- контент должен подходить для аудитории младше 18 лет;

- copyrighted characters и copyrighted music будут отклоняться;

- нельзя генерировать реальных людей и публичных фигур;

- character uploads с human likeness по умолчанию блокируются;

- input images с человеческими лицами сейчас отклоняются.

Если ваша предполагаемая workflow зависит от любого из этих пунктов, это не маленький edge case. Это routing problem.

Модель хранения тоже важна. OpenAI сейчас пишет, что прямые download URLs действуют максимум 1 час после генерации. Batch downloads доступны до 24 часов после завершения batch. Это значит, что vendor-hosted URL нужно рассматривать как временный delivery asset, а не как долговременное хранилище. В production нормальным шагом должно быть копирование output в собственное object storage.

Latency тоже имеет значение. Guide прямо говорит, что один render может занять несколько минут в зависимости от модели, нагрузки и разрешения. Поэтому background jobs, progress states, retries и webhook-based completion handling — это нормальный default case, а не enterprise-излишество.

Наконец, access и rate ceilings зависят от usage tier. В Rate limits guide OpenAI говорит, что организации поднимаются по usage tiers по мере роста spend, и прямо советует проверять live Limits page в настройках аккаунта для актуальных caps. Model pages по Sora тоже показывают tier-dependent ceilings, но текущий search-index rendering слишком сокращен, поэтому безопаснее отправлять читателя к live limits view, чем чрезмерно интерпретировать частично подписанные цифры.

Какую поверхность OpenAI вам на самом деле использовать

Если ваша реальная цель — строить продукт, ответ: Videos API.

Если ваша реальная цель — сгенерировать несколько роликов вручную, ChatGPT или приложение Sora могут оказаться более подходящими, потому что вам вообще не нужно управлять async jobs, storage и webhooks.

Это различие кажется небольшим, но именно оно полностью чинит тему. Значительная часть путаницы вокруг «OpenAI Sora API» возникает потому, что люди читают app-oriented help по Sora, затем developer-oriented docs по Videos API, а потом делают вывод, что одна из поверхностей наверняка ошибочна. На деле они просто описывают разные задачи.

Для разработчика самый короткий хороший ответ такой:

Да, у OpenAI уже есть официальная программная генерация видео. Интегрируйте Videos API, а не потребительскую поверхность Sora.

FAQ

OpenAI сейчас официально поддерживает Sora video generation по API?

Да. Официальный путь для разработчиков — текущий Videos API OpenAI, задокументированный в video-generation guide и reference для POST /v1/videos.

Почему некоторые страницы OpenAI все еще создают впечатление, что у Sora нет API?

Потому что часть официальных поверхностей все еще говорит про потребительское приложение / редактор Sora, а не про developer Videos API. Именно в этом корень текущей путаницы в поиске.

С какой модели лучше начинать?

Начинайте с sora-2 для prompt-итераций и более дешевых прогонов. Переходите на sora-2-pro, когда нужен более качественный output, особенно 1080p.

1080p официально уже доступен?

Да. Current guide, pricing docs и changelog за март 2026 документируют 1080p sora-2-pro, а changelog еще и явно пишет, что 1080p generations на sora-2-pro тарифицируются по $0.70/sec.

Можно ли полагаться только на polling?

Для прототипов — да. Для production webhooks чище, потому что рендеры могут занимать минуты, и вы не хотите, чтобы polling loop стал вашим обычным control plane.

Можно ли строить workflow вокруг reusable characters, а потом продолжать тот же клип через extensions?

Не как полностью composable workflow сегодня. Current guide говорит, что extensions не поддерживают characters и image references, поэтому эту часть surface area нужно проектировать очень аккуратно.