Короткий ответ: у OpenAI Codex нет одного универсального дневного лимита токенов. По состоянию на 21 апреля 2026 года полезный ответ зависит от ветки: включенное использование ChatGPT, Business / Enterprise credits или API key.

OpenAI сейчас описывает эти ветки разными единицами. Plus и Business показывают пятичасовые окна для local messages, cloud tasks и code reviews. Pro разделен на Pro 5x и Pro 20x, а промо для Pro действует до 31 мая 2026 года. API key — это usage-based API billing, а не quota из ChatGPT plan.

Поэтому первым делом откройте Codex usage dashboard или выполните /status в активной CLI-сессии. Только после этого есть смысл сравнивать цифры.

Evidence note: страницы OpenAI Codex pricing, Codex authentication и API rate-limit guide были повторно проверены 21 апреля 2026 года.

Сначала определите свою ветку лимита

| Что вы используете | Что реально управляет лимитом | Где смотреть сначала | Что меняется после исчерпания |

|---|---|---|---|

| ChatGPT Plus, Pro или included Business | Plan windows по модели и активности | Codex usage dashboard и /status | Credits, смена модели или API key для extra local work |

| Business / Enterprise / Edu workspace credits | Workspace contract, seat type и credit rules | Контракт workspace + текущий Codex pricing | Flexible pricing позволяет докупить workspace credits |

| API key | API pricing и org / project rate limits | OpenAI Platform limits и API pricing | Вы уже usage-based; важны throughput и cost |

Если нужен более широкий контекст продукта, читайте обзор OpenAI Codex за март 2026. Дальше речь только о том, какой контракт лимитов применяется сейчас.

Текущая таблица лимитов Codex

На 21 апреля 2026 года официальная таблица выглядит так:

| Ветка | Local messages / 5h | Cloud tasks / 5h | Code reviews / 5h | Важная оговорка |

|---|---|---|---|---|

| Plus | GPT-5.4: 20-100; GPT-5.4-mini: 60-350; GPT-5.3-Codex: 30-150 | GPT-5.3-Codex: 10-60 | GPT-5.3-Codex: 20-50 | Local и cloud делят пятичасовое окно; могут быть weekly limits |

| Pro 5x | GPT-5.4: 100-500; GPT-5.4-mini: 300-1750; GPT-5.3-Codex: 150-750 | GPT-5.3-Codex: 50-300 | GPT-5.3-Codex: 100-250 | Pro $100 получает 2x показанного usage до 31 мая 2026 |

| Pro 20x | GPT-5.4: 400-2000; GPT-5.4-mini: 1200-7000; GPT-5.3-Codex: 600-3000 | GPT-5.3-Codex: 200-1200 | GPT-5.3-Codex: 400-1000 | Pro $200 имеет временно повышенные 5-hour limits до 31 мая 2026 |

| Business included usage | GPT-5.4: 20-100; GPT-5.4-mini: 60-350; GPT-5.3-Codex: 30-150 | GPT-5.3-Codex: 10-60 | GPT-5.3-Codex: 20-50 | Usage-based seats и flexible pricing могут менять team contract |

| API Key | Usage-based | Not available | Not available | API key не включает GitHub code review, Slack integration и другие cloud features |

Эти значения нужно читать как текущий snapshot, а не как личную гарантию. OpenAI прямо связывает фактический расход с моделью, размером задачи, сложностью и тем, локально или в облаке выполняется работа.

Почему ваш фактический headroom отличается

Два пользователя на одном плане могут видеть разные ощущения от лимита. На это влияют модель, размер контекста, длительность сессии, local / cloud surface, speed configuration, image generation, размер AGENTS.md и активные MCP servers.

Практический вывод: вместо вопроса «сколько токенов в день?» задавайте вопрос «какая ветка и какой тип работы сейчас сжигают мой лимит?». Часто достаточно переключить routine tasks на GPT-5.4-mini, уменьшить контекст или вынести extra local tasks в API billing.

Credits, Business и token-based accounting

Credits позволяют продолжать работу после included usage. Plus и Pro могут покупать additional credits; Business, Edu и Enterprise на flexible pricing могут покупать workspace credits.

С апреля 2026 team pricing также переходит к token-based accounting для новых и существующих Business customers и новых Enterprise customers. Текущие credit rates:

| Модель | Input credits / 1M tokens | Cached input credits / 1M tokens | Output credits / 1M tokens |

|---|---|---|---|

| GPT-5.4 | 62.50 | 6.250 | 375 |

| GPT-5.4-mini | 18.75 | 1.875 | 113 |

| GPT-5.3-Codex | 43.75 | 4.375 | 350 |

| GPT-5.2 | 43.75 | 4.375 | 350 |

Это не значит, что все пользователи Codex уже token-metered. Другие plan types продолжают использовать прежнюю message-based rate card до миграции. Enterprise / Edu на flexible pricing масштабируются credits, а без flexible pricing чаще имеют Plus-like per-seat limits.

API key — отдельный контракт

API key подходит для local CLI, SDK или IDE extension. Он не дает cloud-based Codex features вроде GitHub code review или Slack integration. В API лимиты считаются через RPM, RPD, TPM, TPD и IPM; они могут быть на уровне organization и project и зависят от модели и monthly spend limits.

Если нужен дешевый старт API, см. OpenAI API key free trial guide.

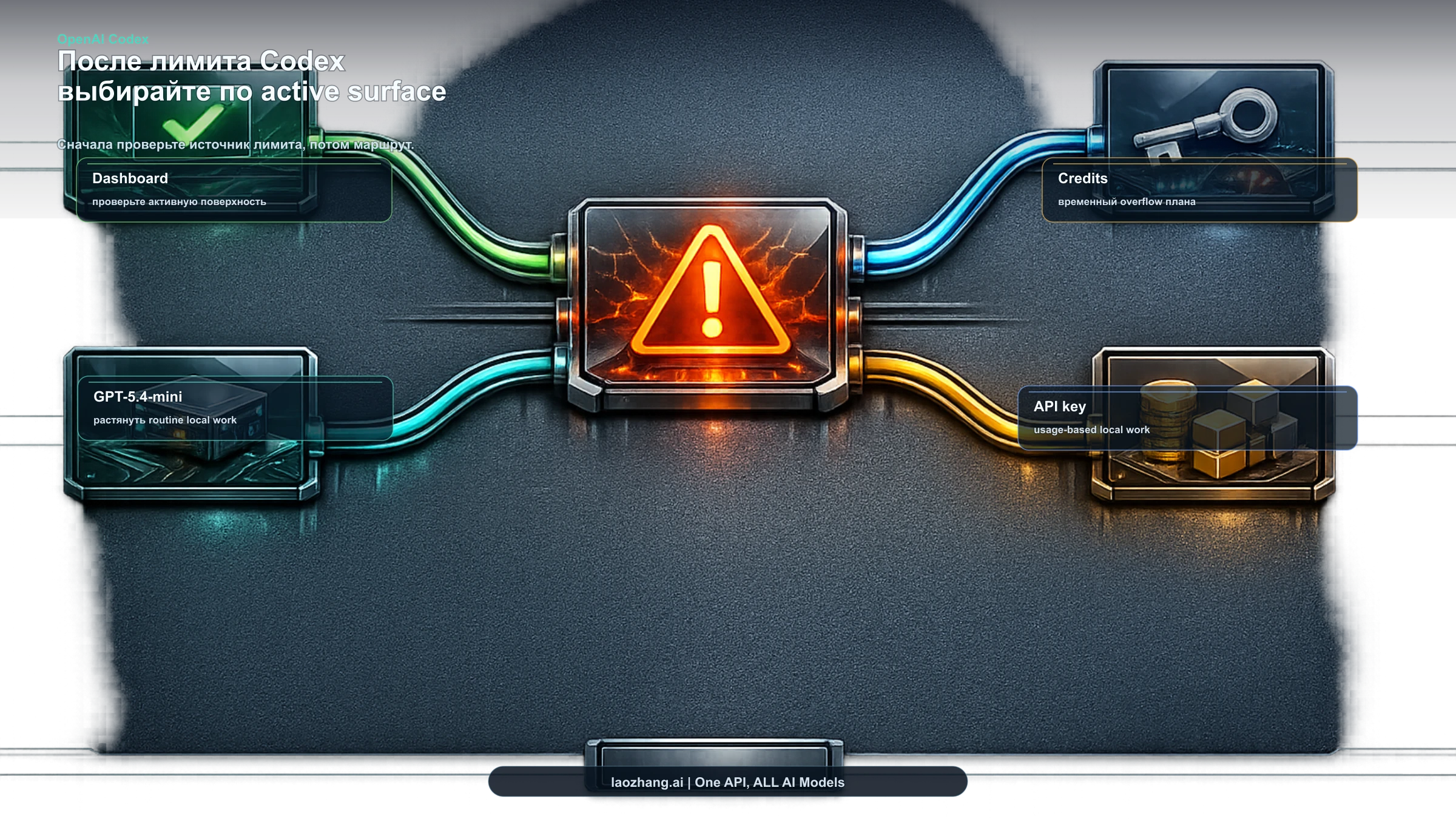

Что делать после лимита

- Проверьте Codex usage dashboard или

/status. - Перенесите routine tasks на GPT-5.4-mini.

- Уменьшите prompt context,

AGENTS.mdи лишние MCP servers. - Для временного overflow используйте additional credits или workspace credits.

- Для extra local tasks рассмотрите API key billing.

FAQ

Есть ли у OpenAI Codex дневной token limit?

Нет одного универсального daily token limit. Сейчас это plan windows, credits или API rate limits.

Plus и Pro — это daily limits?

Нет. Официальная таблица построена вокруг 5-hour windows; Pro разделен на Pro 5x и Pro 20x.

Business равен Plus?

В included-usage таблице текущие цифры совпадают, но Business может иметь standard seats, usage-based seats, flexible pricing и workspace credits.

API key использует те же лимиты, что ChatGPT plan?

Нет. API key — usage-based local route без cloud Codex features.

Ownable synthesis: лимиты Codex — это не одна цифра, а выбор правильного контракта: plan window, workspace credits или API key.