Если Claude Opus 4.6 внезапно кажется слабее, это еще не означает, что Anthropic официально «ухудшил» модель для всех. На 10 апреля 2026 года официальные docs и status history не подтверждают universal downgrade. На практике чаще полезнее задать другой вопрос: вы видите mismatch в thinking mode, проблему длинного контекста, effect от shared usage или разницу между claude.ai, Claude Code, Desktop и API?

Самый безопасный первый шаг выглядит скучно, но работает лучше всего: зафиксируйте один route, откройте fresh session и меняйте только одну переменную за раз. Не меняйте одновременно prompt, модель, thinking setting и саму поверхность. Если после branch-specific control test тот же task все еще ведет себя поверхностно, забывчиво или нестабильно, тогда уже есть смысл считать это repeatable issue и собирать evidence для escalation.

Проверка свежести: release notes Anthropic, help pages по extended thinking, usage and length limits и текущие product-behavior notes для Opus 4.6 были перепроверены 10 апреля 2026 года, потому что эта тема зависит не от памяти модели, а от текущего поведения поверхностей.

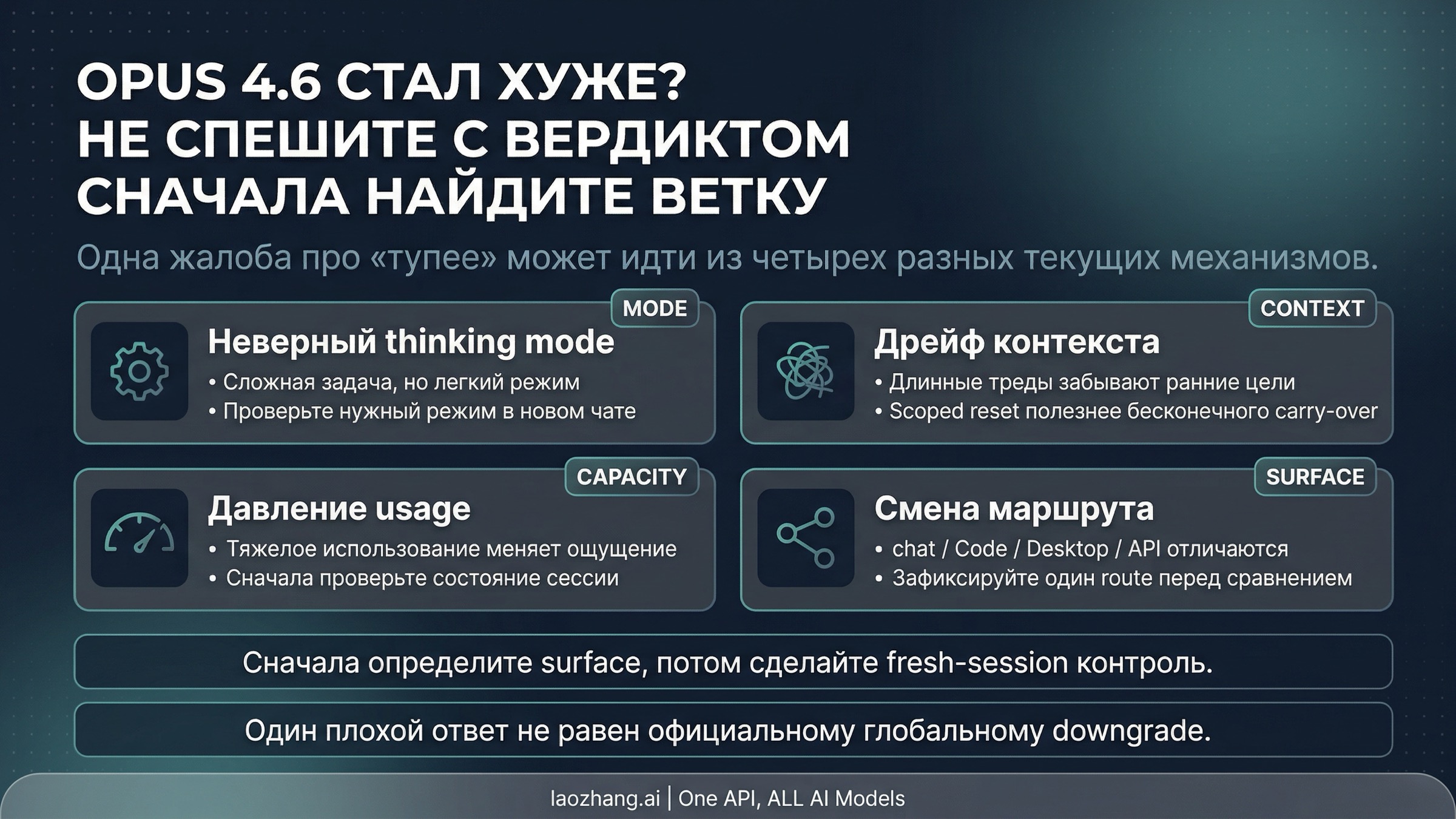

Сначала определите ветку, а не спорьте о downgrade

Фраза «Opus 4.6 стал хуже» звучит как один диагноз, но на практике почти всегда скрывает разные причины.

| Что вы видите | Самая вероятная ветка | Первый шаг | Что обычно подтверждает диагноз |

|---|---|---|---|

| На claude.ai сложные задачи стали отвечаться слишком поверхностно | mismatch в thinking mode | Перезапустить тот же task в новом chat с явным thinking | Качество заметно улучшается, когда thinking зафиксирован |

| Длинные треды начинают забывать инструкции и прошлые решения | handling длинного контекста | Начать новый scoped session с коротким handoff | Новый session лучше держит критические ограничения |

| После тяжелого дня в web, Code или Desktop все ощущается хуже | pressure от shared usage | Посмотреть usage state и повторить task в более чистом окне | В более низком pressure-режиме тот же task стабилен |

| claude.ai, Claude Code, Desktop и API ведут себя как разные продукты | route differences | Зафиксировать одну поверхность и сравнить там same-task | На одном fixed route результаты становятся понятнее |

Смысл такого split не в теории, а в экономии времени. Если проблема в длинном контексте, бесконечная настройка prompt только шумит. Если проблема в route drift, новые benchmark-споры не приближают к рабочему first fix. Сначала уберите шум, потом делайте выводы.

Какие официальные изменения 2026 года реально влияют на ощущение качества

Официальная картина сложнее, чем «модель испортили». Release notes Anthropic говорят, что Claude Opus 4.6 вышел 5 февраля 2026 года, а на API-стороне для новых Claude models основной логикой стал adaptive thinking с параметром effort, а не старый ручной budget-thinking pattern. Уже это означает, что reasoning behavior на API нельзя автоматически переносить на claude.ai chat.

На consumer side help pages Anthropic сейчас прямо говорят: extended thinking в Claude chat опционален, а его переключение открывает новый chat. То же самое относится и к смене model version внутри чата. Поэтому многие «сравнения» на самом деле не являются same-task / same-route / same-state experiments. Пользователь думает, что сравнивает одну и ту же модель «до и после», а по факту сравнивает новый chat с длинным тредом или разные thinking states.

Есть и еще один важный слой. В текущих docs по usage and length limits Anthropic пишет, что длинные conversations управляются через summarizing earlier messages, а claude.ai, Claude Code и Claude Desktop используют общий usage pool. Этого уже достаточно, чтобы одно и то же ощущение «раньше было лучше» возникало без всякого официального downgrade statement.

API side добавляет свой собственный механизм: compaction. Anthropic описывает его как summary-based continuation path, а не как тот же самый consumer-side auto-management. Именно поэтому complaints про «забывает контекст» нужно разбирать по surface, а не сплющивать в одну историю про якобы одинаковое поведение везде.

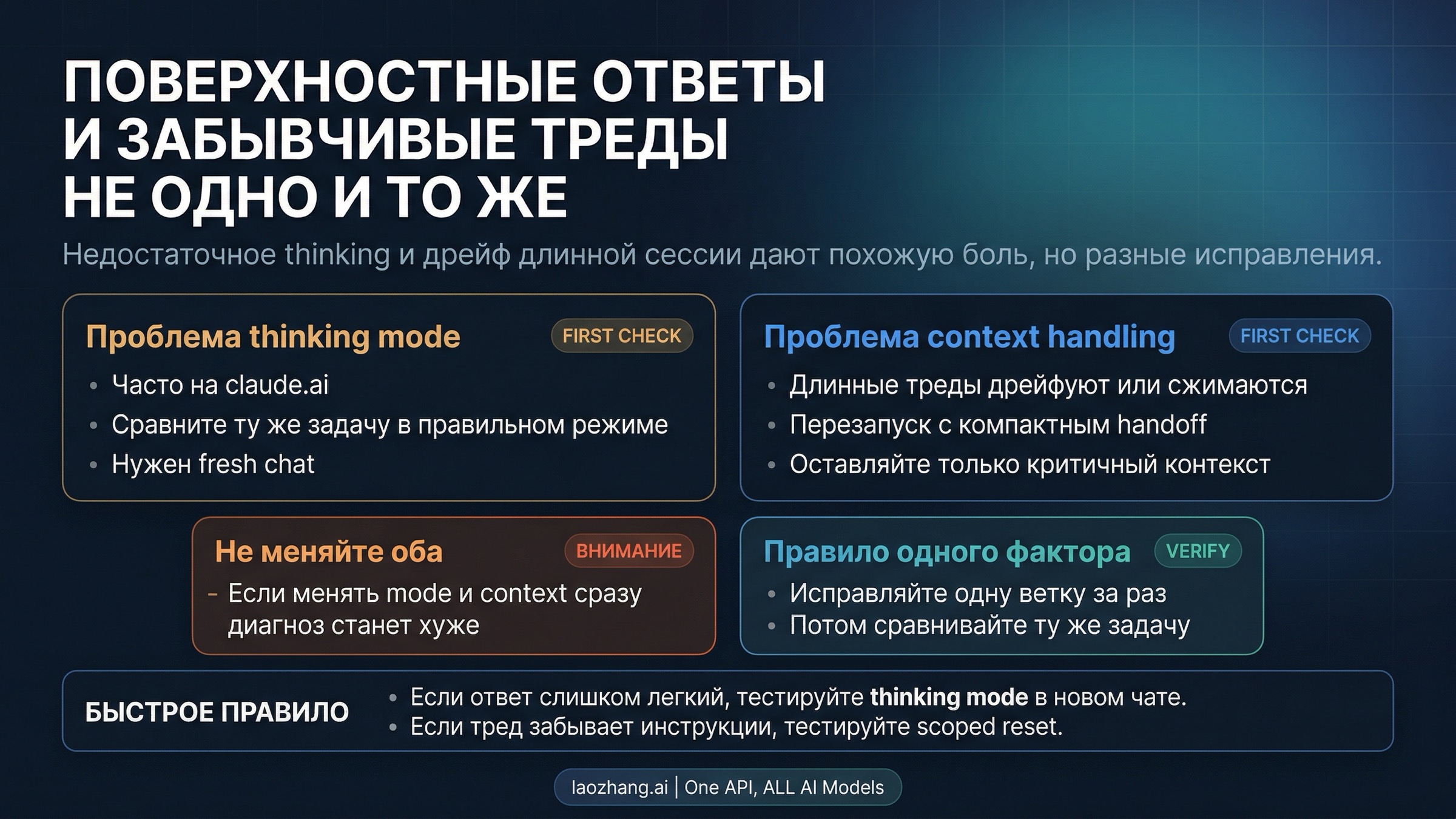

Ветка 1: mismatch в thinking mode чаще всего маскируется под «модель оглупела»

Когда люди говорят, что Opus 4.6 стал отвечать слишком плоско, первым делом стоит проверить не benchmark, а thinking behavior. В Claude chat extended thinking остается optional mode для более сложных задач. На API Anthropic говорит про adaptive thinking и effort. Это родственные идеи, но не единый universal switch.

Отсюда и частая ошибка. Быстрый consumer answer без thinking, API call с низким effort и старый session, где reasoning был глубже, легко создают ощущение mysterious downgrade. На самом деле часто меняется не «интеллект модели», а тот reasoning path, который вы ей задали, плюс состояние route.

Нормальный control test здесь очень простой: один действительно сложный task, один fixed route, свежий session и явный thinking setting. На claude.ai это означает сравнить одинаковый task в новом chat с включенным и выключенным extended thinking. На API это означает удержать prompt constant и сделать explicit thinking control. Если gap в основном исчезает после такого теста, у вас не universal downgrade, а diagnosis thinking-mode mismatch.

Ветка 2: длинный контекст и summary-компрессия часто ощущаются как «память стала хуже»

Вторая частая жалоба касается не поверхностных ответов, а selective forgetting. Тред начинает пропускать важные ограничения, как будто помнит проект только наполовину. Это легко назвать «модель стала тупее», но текущие docs Anthropic дают более точное объяснение: длинные conversations summarise earlier messages, а API отдельно использует compaction.

Практический вывод в том, что «Opus забыл» и «Opus стал хуже» не всегда описывают один и тот же процесс. Как только session становится длинным, вы уже не работаете в той же context regime, что и в начале. Часть критических деталей может жить лишь в summary representation, а не в исходной полноте истории.

Поэтому лучший first fix здесь не новый mega-prompt, а чистый handoff. Создайте новый scoped session, коротко перечислите цель, non-negotiable constraints и действительно важные artifacts или files, затем повторите тот же класс задачи. Если fresh session ведет себя заметно лучше, это сильнее указывает на context-handling branch, чем на общую деградацию Opus 4.6.

Community complaints здесь полезны только как evidence of pain-language. Они не дают права превращать любую потерю контекста в одну confirmed regression story.

Ветка 3: shared usage pressure меняет сами условия сравнения

Anthropic прямо пишет, что claude.ai, Claude Code и Claude Desktop используют один shared usage pool, а реальный headroom зависит от модели, feature set, размера файлов и длины conversation. Этого достаточно, чтобы тяжелый день ощущался иначе, чем спокойный, даже если prompts выглядят похоже.

Важно не перейти границу доказательств. Официальные docs не говорят, что при высоком usage Anthropic специально делает Opus «глупее». Но они дают основания для более узкого вывода: если вы сравниваете sessions при разном usage pressure, разной длине треда и разной file load, вы, возможно, вообще не сравниваете одинаковые условия.

Вот почему здесь нужен operational, а не эмоциональный move. Посмотрите current usage state, вспомните, случилось ли это после тяжелого дня на нескольких Claude surfaces, и повторите похожий task в более чистом session window. Если проблема почти исчезает вне high-pressure conditions, это сильнее похоже на noisy comparison, чем на подтвержденный global downgrade.

Если реальная боль уходит в broader plan behavior, а не в quality diagnosis Opus 4.6, смотрите наш общий гайд по лимитам Claude. Если боль больше про terminal-heavy workflow, полезнее будет гайд по странному расходу usage в Claude Code.

Ветка 4: claude.ai, Claude Code, Desktop и API изначально не один и тот же route

Одна из самых частых причин путаницы состоит в том, что люди объединяют несколько execution surfaces в один рассказ. Это ошибка. Claude chat имеет свою логику model switching, extended thinking и conversation handling. Claude Code добавляет tools, repo context и terminal workflow. Desktop ближе к consumer chat, но не равен ему полностью. API живет по собственным правилам thinking controls, long-context contract и compaction.

Как только вы признаете этот split, complaints становятся гораздо понятнее. Резкое ухудшение в Claude Code может описывать tool-heavy workflow, старый session или environment-specific complexity. Разница между API и claude.ai часто оказывается различием route logic, а не одним и тем же «мозгом», который внезапно испортился везде.

Единственное честное сравнение здесь — like-for-like on one fixed route. Один surface, один task, один thinking setting, одно свежее context state. Если проблема исчезает, когда вы перестаете смешивать routes, то вы диагностировали routing issue. Только если проблема устойчиво остается внутри одной фиксированной поверхности, ее стоит считать более серьезной.

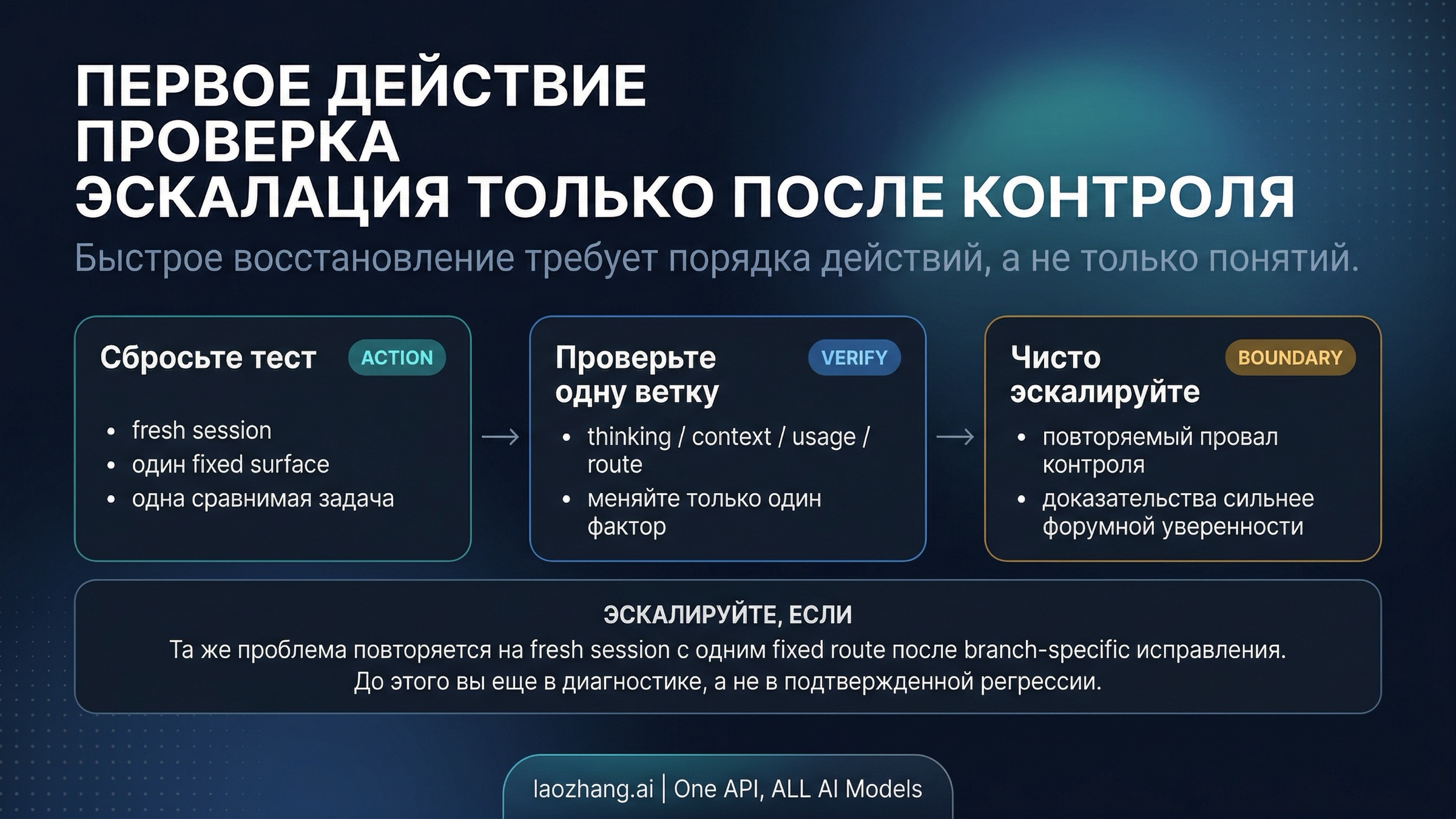

Самый быстрый порядок восстановления

Самая полезная часть этой статьи — не очередная теория, а порядок действий.

- Зафиксируйте один surface.

Не сравнивайте chat, Code, Desktop и API в одном тесте. - Откройте fresh session.

Старый контекст — главный источник шума. - Сделайте thinking explicit.

Не полагайтесь на default behavior. - Меняйте только одну переменную.

Thread age, route и thinking setting нельзя двигать одновременно. - Проверьте usage pressure.

Если симптом появляется после тяжелого дня, повторите task в cleaner window. - Эскалируйте только repeatable problem.

Один плохой день еще не равен доказанному issue.

Именно эта последовательность делает диагностику полезной. Чем раньше вы пытаетесь найти «глобальное объяснение», тем выше шанс, что вы просто закрепите шум как вывод.

Когда менять route, когда менять модель, а когда уже идти в escalation

Менять surface имеет смысл тогда, когда evidence показывает route-specific problem. Если claude.ai на одном типе задач ведет себя заметно слабее, а controlled API test остается стабильным, следующий вопрос звучит так: подходит ли вам этот route для данного workload? Это не то же самое, что universal downgrade.

Менять модель имеет смысл позже, не раньше. Если проблема еще может объясняться thinking mismatch, context drift или mixed-route comparison, смена модели просто спрячет причину. Но если fresh-session, fixed-route и branch-specific tests уже сделаны, а Opus 4.6 все равно стабильно не тянет этот класс задач, другая модель становится рациональным next move.

Escalation нужна, когда одновременно выполняются три условия: вы воспроизвели проблему на одном fixed route, исключили очевидный branch-specific fix и все равно видите disproportionate failure для этого task. Тогда собирайте evidence: какая surface использовалась, новый это был session или resumed, как были выставлены thinking settings, какой примерно был usage state и какой task повторялся. Это полезнее, чем просто писать «Opus 4.6 явно стал хуже».

FAQ

Anthropic официально признал, что Claude Opus 4.6 стал хуже?

Нет. По состоянию на 10 апреля 2026 года official docs, help pages и status history не содержат заявления о universal Opus 4.6 downgrade. Это не обнуляет complaints пользователей, но задает правильную truth boundary.

Почему длинные треды ощущаются так, будто модель забывает контекст?

Потому что Anthropic сейчас описывает auto summarization earlier messages в consumer chat и отдельно — compaction на API. Для long-session work это уже достаточная причина ощущать context drift без гипотезы о глобальном падении интеллекта.

Extended thinking и adaptive thinking — это одно и то же?

Нет. Consumer chat и API сейчас описывают разные surface behaviors. Если их сплющить в одну кнопку, вы почти наверняка получите плохое сравнение.

Почему claude.ai и API могут ощущаться как разные продукты?

Потому что это и есть разные routes. У API свои controls и свой long-context contract, у consumer chat — своя logic around chats and switching. Их нельзя честно сравнивать без fixed-route test.

Когда уже пора прекращать tuning prompts и переходить к escalation?

Когда на одном fixed route после fresh-session control test и branch-specific fix проблема все еще воспроизводится. До этого вы, скорее всего, все еще на стадии диагностики, а не на стадии эскалации.