'OpenAI Sora API'라는 말로 OpenAI 플랫폼에서 공식적으로 제공하는 프로그래밍 가능한 영상 생성을 뜻한다면, 답은 있다입니다. 현재 OpenAI의 개발자용 surface는 Videos API이며, 중심은 POST /v1/videos와 sora-2 / sora-2-pro입니다. 혼란이 생기는 이유는 OpenAI에 소비자용 Sora 앱 / 에디터와 ChatGPT 안에서의 Sora 접근도 동시에 존재하고, 이 표면들이 모두 같은 'API' 언어로 설명되지 않기 때문입니다. 그래서 2026년 3월 기준 검색 결과도 여전히 모순적으로 보입니다.

이 글은 앱 사용법이 아니라 개발자 질문에 답합니다. 지금 실제로 존재하는 공식 developer contract, 가장 빠르게 동작하는 create -> wait -> download 흐름, 구축 전에 알아야 할 가격과 정책 제약, 그리고 2026년 3월 변경으로 예전 Sora API 정리글이 왜 더 이상 충분하지 않은지를 중심으로 설명합니다.

신선도 메모: 2026년 3월 28일 기준 OpenAI Developers 문서, 가격 페이지, 모델 페이지, 헬프센터 자료를 확인했습니다.

TL;DR

- 공식 개발자 접근은 지금 존재합니다. 써야 하는 surface는

/v1/videos이지, 소비자용 Sora 에디터가 아닙니다. - 먼저

sora-2부터 시작하세요. 프롬프트, 프레이밍, 모션을 저비용으로 반복하기 좋습니다. - 더 높은 최종 품질이 필요하면

sora-2-pro로 가세요. 특히1920x1080또는1080x1920이 필요할 때 그렇습니다. - 기본 전제는 비동기 플로우입니다. job을 만들고

GET /videos/{video_id}를 폴링하거나 webhook을 쓰고, 마지막에GET /videos/{video_id}/content로 파일을 받습니다. - OpenAI의 Sora 문서는 현재 일부가 서로 맞지 않습니다. 최신 guide와 2026년 3월 changelog는 16/20초, edits, extensions, reusable characters, Batch, 1080p

sora-2-pro를 문서화하지만, 일부 오래된 reference 조각은 더 짧은 길이와 더 낮은 해상도만 보여줍니다.

지금 'OpenAI Sora API'가 실제로 의미하는 것

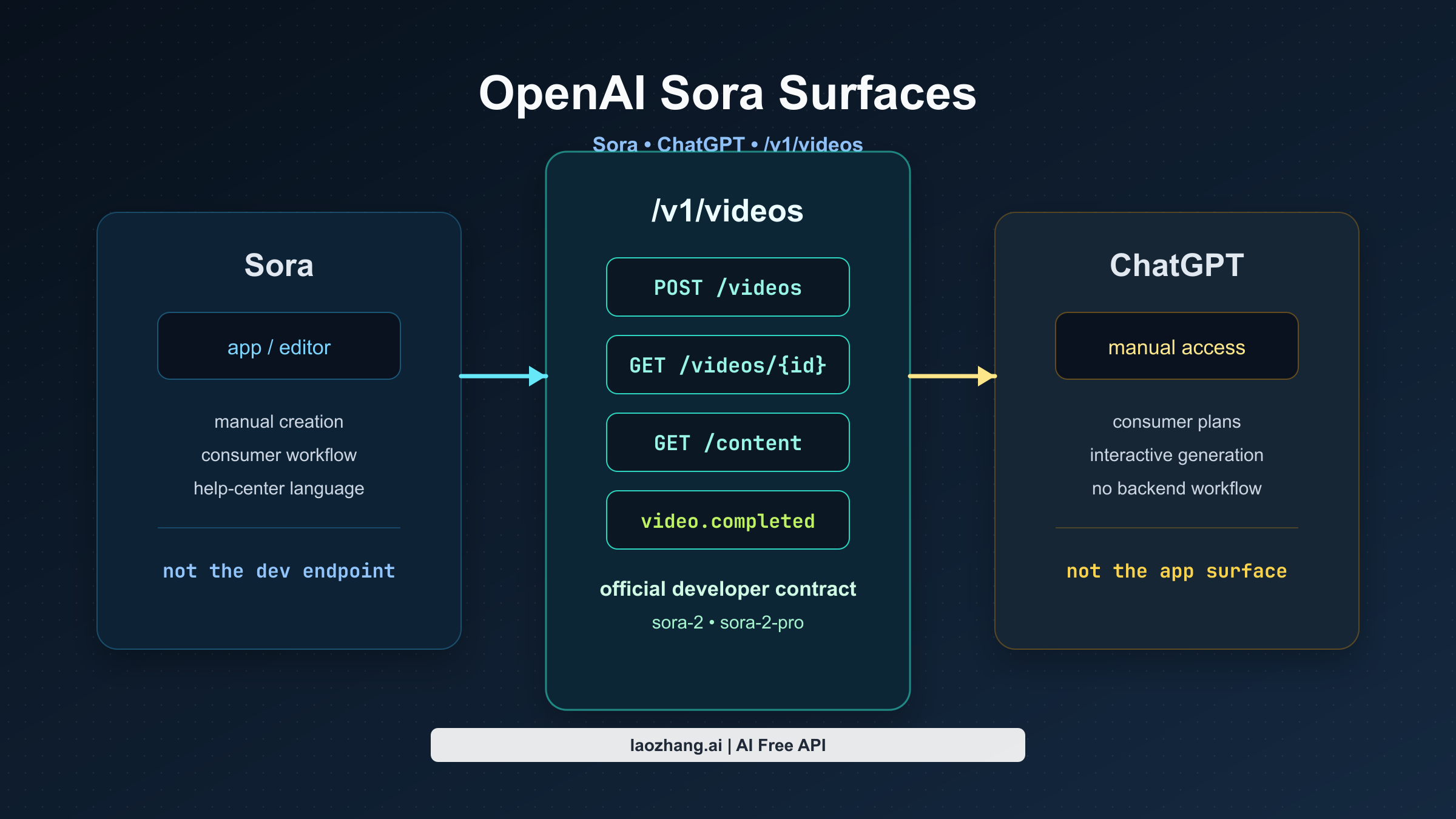

이 주제에서 가장 흔한 실수는 Sora를 하나의 제품 surface로 보는 것입니다. 실제로는 최소 세 가지가 있습니다.

| Surface | 무엇인가 | 누구를 위한가 | 무엇에 쓰는가 |

|---|---|---|---|

| Sora 앱 / 에디터 | OpenAI의 소비자용 Sora 경험 | 손으로 영상을 만드는 일반 사용자 | 앱이나 웹 에디터에서 창작 탐색 |

| ChatGPT 접근 | ChatGPT 플랜 안의 Sora 생성 | 백엔드 없이 수동 생성하려는 사용자 / 프로 | 대화형 one-off 생성 |

| Videos API | OpenAI의 공식 개발자 surface | 개발자, 스타트업, 제품 팀 | 프로그래밍 방식 영상 생성, edits, extensions, Batch, asset 처리 |

이 구분이 왜 공식 OpenAI 페이지들이 서로 다르게 들리는지 설명해 줍니다. Help Center의 Sora 문서는 소비자용 제품을 이야기합니다. 반면 개발자 문서는 현재 동작하는 Video generation with Sora 스택을 엔드포인트, 모델, 가격, 코드 샘플과 함께 설명합니다.

그래서 지금 가장 안전한 정신 모델은 단순합니다.

'Sora 앱'을 통합하지 말고 OpenAI의 Videos API를 통합하세요.

문장으로 써 놓으면 당연해 보이지만, 지금 검색 결과에서 가장 빠져 있는 설명이 바로 이것입니다.

지금 가장 빨리 동작하는 OpenAI 경로

제로에서 시작해 공식적으로 동작하는 첫 결과까지 가장 짧게 가려면 경로는 꽤 직선적입니다.

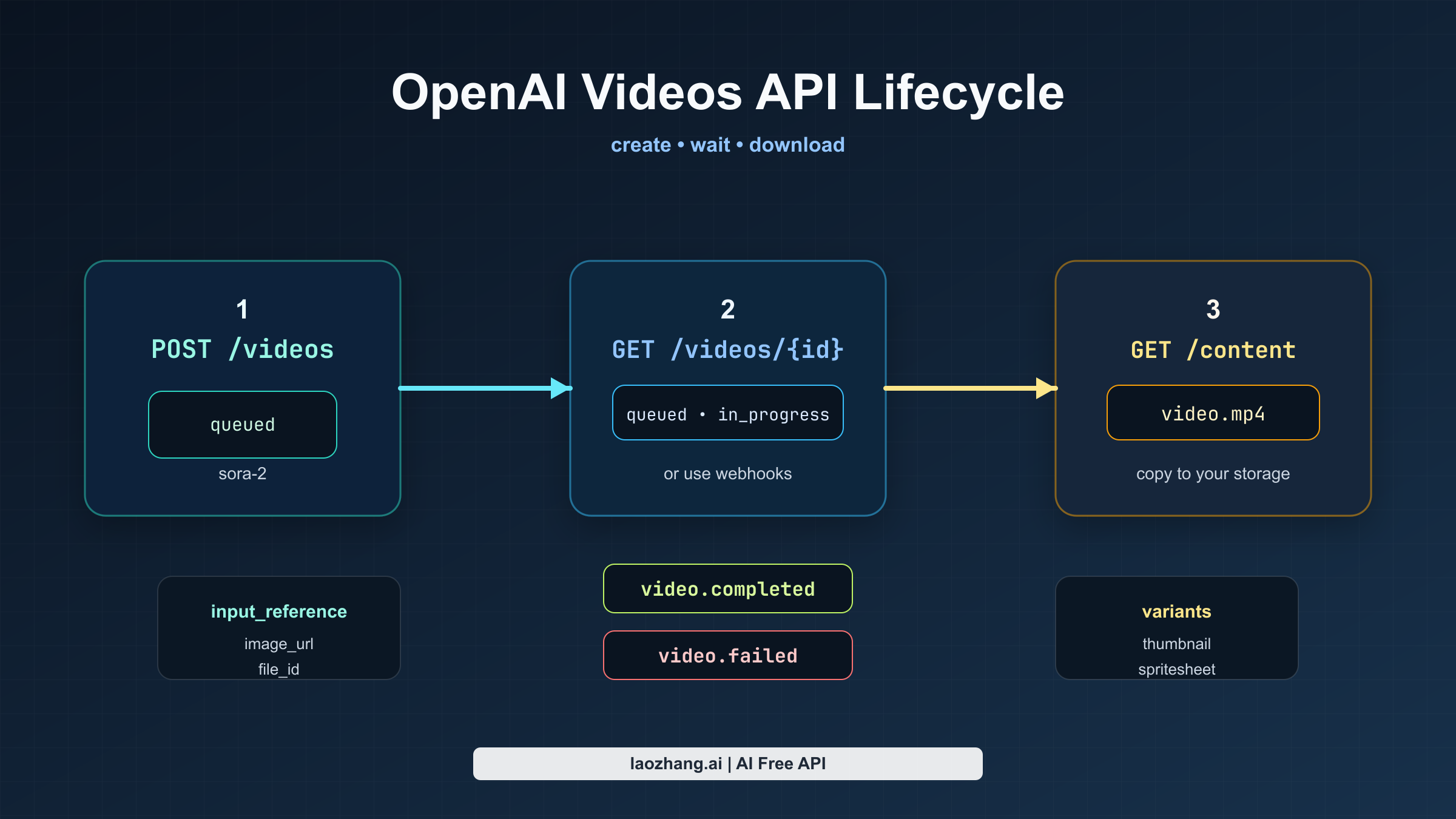

먼저 POST /v1/videos에 prompt, model, size, duration을 보냅니다. OpenAI는 영상 생성을 비동기 job으로 취급하므로, 첫 응답은 job이 생성되었고 queued 또는 in_progress 같은 상태에 들어갔다는 사실만 알려줍니다. 그다음 GET /v1/videos/{video_id}를 폴링해서 completed가 될 때까지 기다리거나, webhook을 등록해 video.completed 또는 video.failed 이벤트를 받습니다. 완료되면 GET /v1/videos/{video_id}/content로 바이너리 파일을 가져오면 됩니다.

프로토타입이라면 폴링으로 충분합니다. 프로덕션에서는 webhook이 더 깔끔한 계약입니다. 긴 렌더는 몇 분이 걸릴 수 있고, 단지 '아직 끝나지 않았다'는 사실을 알기 위해 불필요한 요청을 계속 태우고 싶지는 않기 때문입니다.

현재 OpenAI SDK 패턴으로 가장 짧게 구현하면 다음과 같습니다.

javascriptimport OpenAI from "openai"; import { writeFile } from "node:fs/promises"; const openai = new OpenAI({ apiKey: process.env.OPENAI_API_KEY }); const video = await openai.videos.createAndPoll({ model: "sora-2", prompt: "Wide tracking shot of a yellow taxi crossing a rain-soaked city street at blue hour, neon reflections, natural ambient audio.", size: "1280x720", seconds: "8", }); if (video.status !== "completed") { throw new Error(`Video failed with status ${video.status}`); } const content = await openai.videos.downloadContent(video.id); const buffer = Buffer.from(await content.arrayBuffer()); await writeFile("video.mp4", buffer); // In production, copy the file into your own object storage immediately.

같은 라이프사이클을 raw HTTP로 쓰면 다음과 같습니다.

bashcurl -X POST "https://api.openai.com/v1/videos" \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -F model="sora-2" \ -F prompt="Wide tracking shot of a yellow taxi crossing a rain-soaked city street at blue hour, neon reflections, natural ambient audio." \ -F size="1280x720" \ -F seconds="8" curl "https://api.openai.com/v1/videos/$VIDEO_ID" \ -H "Authorization: Bearer $OPENAI_API_KEY" curl -L "https://api.openai.com/v1/videos/$VIDEO_ID/content" \ -H "Authorization: Bearer $OPENAI_API_KEY" \ --output video.mp4

이것이 core integration입니다. 현재 Sora stack의 다른 기능들은 모두 이 job 모델 바깥으로 확장됩니다.

가격, 모델, 그리고 개발자가 봐야 할 문서 불일치

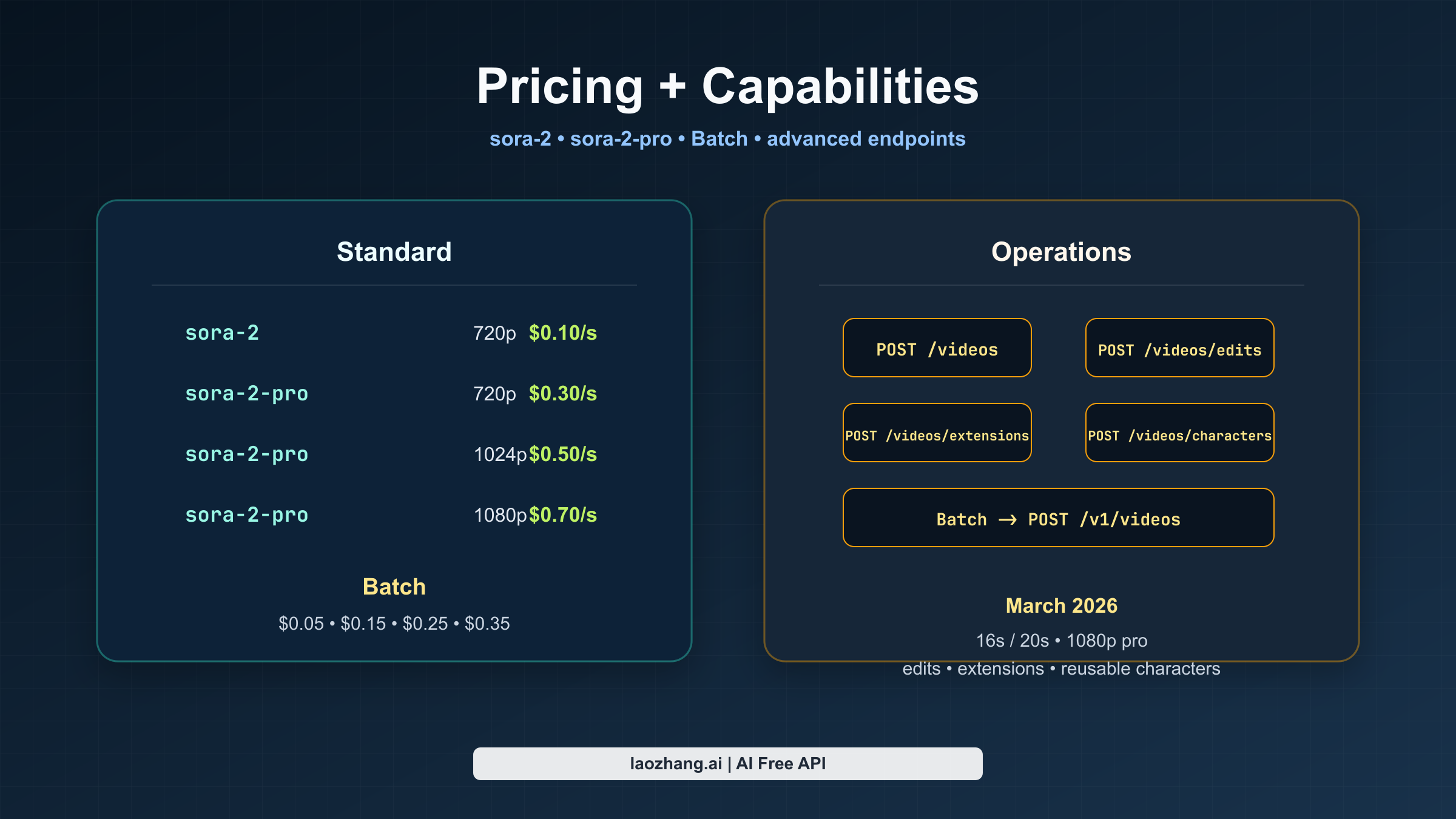

현재 공식 pricing page는 모델 구분을 꽤 명확하게 보여줍니다.sora-2는 더 싸고 빠른 반복용 모델입니다.sora-2-pro는 더 polished한 출력용 모델이며, 1080p가 필요하면 사실상 이쪽으로 가야 합니다.

OpenAI 가격 문서가 현재 보여주는 standard pricing은 다음과 같습니다.

| Mode | Model | Output | Official price |

|---|---|---|---|

| Standard | sora-2 | 720x1280 또는 1280x720 | $0.10/sec |

| Standard | sora-2-pro | 720x1280 또는 1280x720 | $0.30/sec |

| Standard | sora-2-pro | 1024x1792 또는 1792x1024 | $0.50/sec |

| Standard | sora-2-pro | 1080x1920 또는 1920x1080 | $0.70/sec |

Batch는 같은 사다리를 절반 가격으로 보여줍니다.

| Mode | Model | Output | Official price |

|---|---|---|---|

| Batch | sora-2 | 720x1280 또는 1280x720 | $0.05/sec |

| Batch | sora-2-pro | 720x1280 또는 1280x720 | $0.15/sec |

| Batch | sora-2-pro | 1024x1792 또는 1792x1024 | $0.25/sec |

| Batch | sora-2-pro | 1080x1920 또는 1920x1080 | $0.35/sec |

이 정보만으로도 운영상 중요한 결정을 대부분 내릴 수 있습니다.

- 프롬프트를 실험하는 단계라면

sora-2부터. - 최종 에셋과 시각 품질이 중요하다면

sora-2-pro. - 오프라인으로 shot list를 렌더링한다면 Batch 경제성을 진지하게 검토할 가치가 있습니다.

더 미묘하지만 더 중요한 점은, OpenAI의 Sora 문서가 지금 부분적으로 out of sync 상태라는 것입니다. 이것은 공식 최신 자료를 근거로 한 판단입니다.

- 메인 video guide는

sora-2와sora-2-pro가 모두16초와20초 생성을 지원한다고 말합니다. - 2026년 3월 changelog는 최대 20초, 1080p

sora-2-pro를 명시합니다. - 그런데 오래된 create-reference 조각 일부는 여전히

4,8,12초와 더 작은 size matrix만 보여줍니다.

지금의 실제 계약을 파악하려면, 더 안전한 해석은 이것입니다.

guide, pricing page, 2026년 3월 changelog를 오래된 reference fragment보다 우선해서 믿으세요.

이 경고는 별도로 적어 둘 가치가 있습니다. 해상도 선택, 용량 계획, 제품 메시지에 바로 영향을 주기 때문입니다.

공식 API가 단순 text-to-video 외에 할 수 있는 것

현재 guide는 더 이상 단순한 text prompt 진입점이 아닙니다. OpenAI의 Sora stack은 생성과 반복의 더 넓은 라이프사이클을 다룹니다.

이미지 레퍼런스

input_reference를 사용하면 업로드한 asset이나 file_id / image_url를 담은 JSON object로 generation을 유도할 수 있습니다. OpenAI는 reference image를 사실상 영상의 first frame으로 설명합니다. 중요한 제약은 reference image가 target size와 일치해야 한다는 점, 그리고 현재 문서상 지원 포맷이 image/jpeg, image/png, image/webp라는 점입니다.

이 기능은 브랜드 자산, 아트 디렉션, 혹은 여러 job에 걸친 reusable character보다 opening composition을 더 중요하게 보는 경우에 적합합니다.

재사용 가능한 characters

OpenAI는 현재 characters workflow를 문서화하고 있으며, 업로드한 영상으로 reusable한 non-human character asset을 만들 수 있습니다. guide에서 characters는 동물, 마스코트, 오브젝트 일관성 도구로 설명되며, 한 번의 generation에 최대 두 개까지 넣을 수 있습니다. 또한 human likeness를 가진 character upload는 기본적으로 차단된다고 적혀 있습니다. 즉 이것은 일반적인 '사람 배우를 학습시키는 surface'가 아닙니다.

실무적 결론은 간단합니다. characters는 재사용 가능한 비인간 subject용이지, 실제 인물 제한을 우회하는 루트가 아닙니다.

비디오 extension

OpenAI는 video extensions도 제공합니다. 완료된 clip을 이어서 만들고 싶을 때 맞는 루트입니다. motion continuity와 scene continuity를 유지하고 싶다면 이쪽이고, 단지 opening frame만 제어하고 싶다면 input_reference가 맞습니다. 현재 guide는 각 extension이 최대 20초를 더할 수 있고, 하나의 영상은 최대 6번까지 연장할 수 있으며, extensions는 characters와 image references를 지원하지 않는다고 명시합니다.

이 마지막 포인트는 중요합니다. 고급 기능이 모두 자유롭게 조합된다고 가정하면 실제 API 계약과 어긋납니다.

비디오 edits

2026년 3월 changelog에서 OpenAI는 video edits workflow를 추가했습니다. 기존 생성 영상이나 업로드 영상에 targeted change를 가하려면 현재는 이 경로가 우선입니다. guide는 예전 remix 경로가 deprecated 방향이며, edits는 변경 범위가 좁고 명확할수록 잘 동작한다고 설명합니다.

이것은 OpenAI가 Sora를 단순 1회성 생성기가 아니라 반복 가능한 media workflow로 보고 있다는 강한 신호입니다.

Batch

현재 guide는 Batch에서 POST /v1/videos를 지원하지만, 몇 가지 중요한 제약이 있습니다.

- Batch는 현재

POST /v1/videos만 지원합니다. - Batch request는 JSON이어야 하며 multipart를 쓸 수 없습니다.

- asset은 미리 업로드한 뒤 JSON body에서 참조해야 합니다.

- Batch로 생성된 영상은 batch 완료 후 최대

24시간 다운로드할 수 있습니다.

offline render queue, studio workflow, shot-list pipeline을 만든다면 Batch는 더 이상 부가 기능이 아니라 공식 경로의 일부입니다.

만들기 전에 알아야 할 guardrails와 운영상의 함정

Sora stack에는 이미 제약이 충분히 많기 때문에, 정책과 보존 기간을 compliance 각주가 아니라 product contract의 일부로 봐야 합니다.

현재 guide에 따르면 API는 다음 제한을 적용합니다.

- 콘텐츠는 18세 미만에게도 적합해야 합니다.

- 저작권이 있는 캐릭터와 저작권이 있는 음악은 거절됩니다.

- 실제 인물과 공인은 생성할 수 없습니다.

- human likeness가 있는 character upload는 기본적으로 차단됩니다.

- 사람 얼굴이 들어간 input image는 현재 거절됩니다.

당신의 계획된 workflow가 이 중 하나에 의존한다면, 그것은 사소한 edge case가 아니라 라우팅 문제입니다.

스토리지 모델도 중요합니다. OpenAI는 direct download URL이 생성 후 최대 1시간 유효하다고 말합니다. Batch 다운로드는 batch 완료 후 24시간까지입니다. 즉 vendor-hosted URL은 임시 delivery asset으로 봐야 하고, 장기 저장소로 취급하면 안 됩니다. 프로덕션에서는 완료 처리의 일부로 자체 object storage로 복사해야 합니다.

지연도 중요합니다. guide는 모델, 부하, 해상도에 따라 single render가 몇 분 걸릴 수 있다고 말합니다. 따라서 background jobs, progress states, retries, webhook 기반 completion handling은 옵션이 아니라 기본 설계입니다.

마지막으로 access와 rate ceiling은 usage tier에 따라 달라집니다. OpenAI의 Rate limits guide는 사용량 증가에 따라 tier가 올라가며, 실제 유효 cap은 account settings의 Limits 페이지에서 확인하라고 말합니다. Sora 모델 페이지도 tier별 ceiling을 보여주지만 현재 search rendering이 충분히 자세하지 않으므로, 반쯤 표시된 숫자를 과하게 해석하는 것보다 live limits view로 안내하는 편이 안전합니다.

결국 OpenAI의 어떤 surface를 써야 하나

당신의 실제 목표가 제품을 만드는 것이라면 답은 Videos API입니다.

당신의 실제 목표가 영상 몇 개를 손으로 생성하는 것이라면 ChatGPT나 Sora 앱이 더 나을 수 있습니다. async jobs, storage, webhook을 관리할 필요가 없기 때문입니다.

이 구분은 작아 보이지만, 사실 이 주제 전체를 바로잡는 핵심입니다. 'OpenAI Sora API'를 둘러싼 혼란의 상당수는 사람들이 앱 중심의 Sora 도움말과 개발자 중심의 Videos API 문서를 연달아 읽고, 둘 중 하나가 틀렸다고 추정하면서 생깁니다. 실제로는 서로 다른 일을 설명하고 있을 뿐입니다.

개발자에게 가장 짧고 좋은 답은 다음입니다.

네, OpenAI는 이미 공식적인 프로그래밍형 영상 생성을 제공합니다. 통합해야 하는 것은 소비자용 Sora 표면이 아니라 Videos API입니다.

FAQ

OpenAI는 지금 API로 Sora 영상 생성을 공식 지원하나요?

예. 공식 개발자 경로는 현재 OpenAI의 Videos API이며, video-generation guide와 POST /v1/videos reference에 문서화되어 있습니다.

왜 어떤 OpenAI 페이지는 아직도 Sora에 API가 없는 것처럼 보이나요?

일부 공식 surface는 여전히 소비자용 Sora 앱 / 에디터를 설명하고 있고, 개발자용 Videos API를 설명하지 않기 때문입니다. 이것이 현재 검색 혼란의 핵심 원인입니다.

어떤 모델부터 시작해야 하나요?

프롬프트 반복과 저렴한 실험에는 sora-2부터 시작하세요. 더 높은 품질의 출력, 특히 1080p가 필요해지면 sora-2-pro로 올리면 됩니다.

1080p는 공식적으로 이미 라이브인가요?

예. 현재 guide, pricing docs, 2026년 3월 changelog 모두 1080p sora-2-pro를 문서화하고 있고, changelog는 1080p generation이 $0.70/sec라고도 명시합니다.

폴링만으로도 충분한가요?

프로토타입이라면 가능합니다. 프로덕션에서는 렌더가 몇 분 걸릴 수 있으므로, polling loop를 상시 control plane으로 만들지 않기 위해 webhook이 더 낫습니다.

reusable characters를 쓴 다음 같은 clip을 extension할 수 있나요?

지금은 완전히 조합 가능한 workflow로 볼 수 없습니다. 현재 guide는 extensions가 characters와 image references를 지원하지 않는다고 명시합니다.