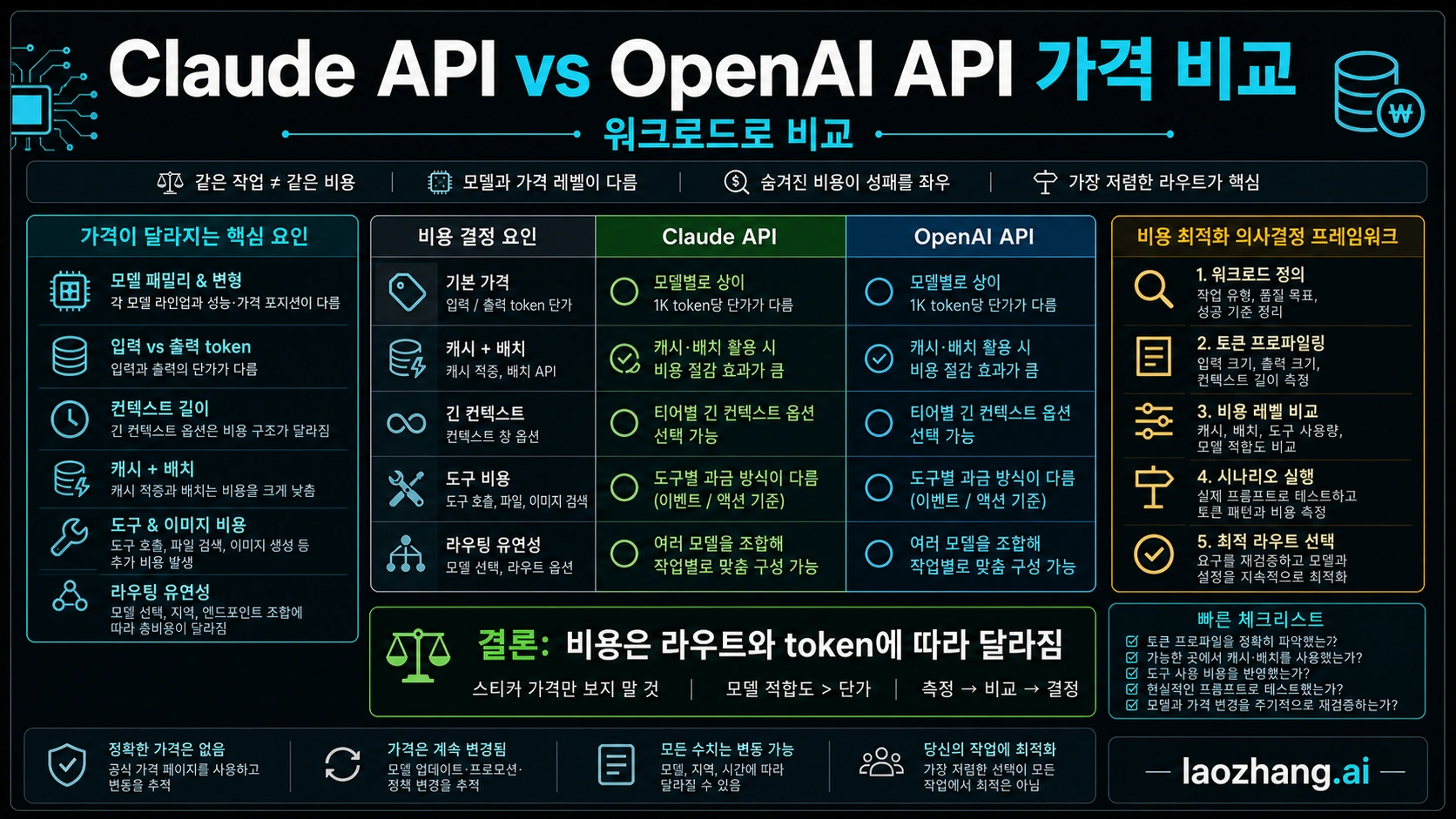

Claude API와 OpenAI API 중 어느 쪽이 더 싼지는 한 줄 가격표만으로 결정할 수 없습니다. 입력이 짧고 출력도 짧으며 GPT-5.4 mini로 품질 기준을 통과하는 대량 작업이라면 OpenAI가 더 싼 출발점이 되기 쉽습니다. 반대로 긴 컨텍스트, 코딩 Agent, 복잡한 reasoning, 높은 캐시 재사용이 핵심이라면 Claude가 총비용에서 더 나을 수 있습니다.

2026년 5월 2일 기준 공식 페이지를 확인했습니다. OpenAI API Pricing은 GPT-5.5를 1M tokens당 input $5, cached input $0.50, output $30로 표시합니다. GPT-5.4는 $2.50 / $0.25 / $15, GPT-5.4 mini는 $0.75 / $0.075 / $4.50입니다. OpenAI의 GPT-5.5 발표는 2026년 4월 24일 업데이트에서 GPT-5.5와 GPT-5.5 Pro가 API에서 사용 가능하다고 설명하지만, 실제 배포 전에는 계정에서 모델이 보이는지 확인해야 합니다. Anthropic Pricing은 Claude Opus 4.7을 $5 input / $25 output, Sonnet 4.6을 $3 / $15, Haiku 4.5를 $1 / $5로 표시하며 cache, batch, data residency, long context, tools를 별도 비용 요소로 다룹니다.

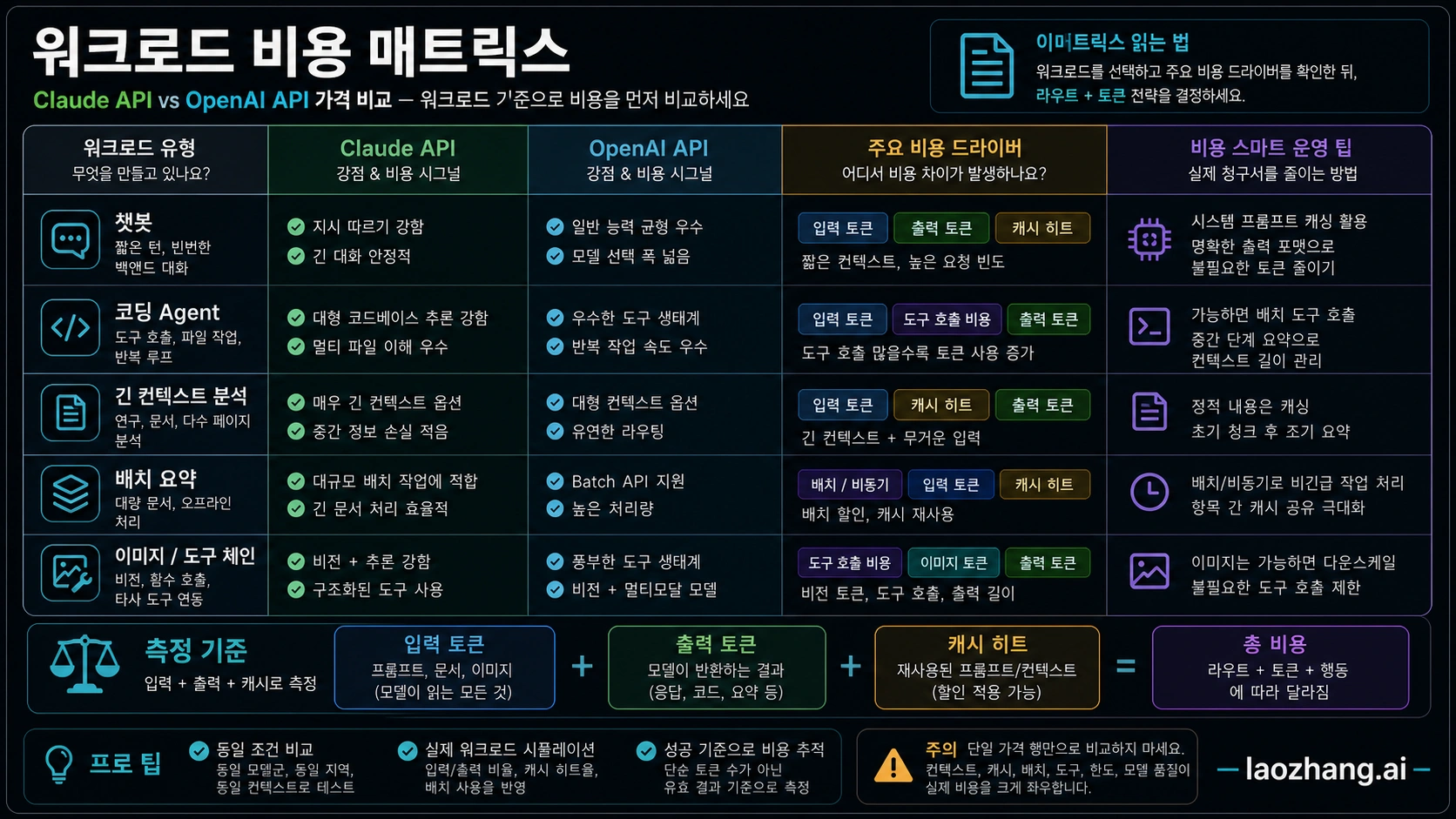

빠른 답: provider보다 workload가 먼저입니다

| 상황 | 먼저 테스트할 라우트 | 이유 |

|---|---|---|

| 분류, 추출, 짧은 요약 | OpenAI GPT-5.4 mini | Claude Haiku 4.5보다 기본 행이 낮습니다. |

| 복잡한 코딩 또는 전문 reasoning | GPT-5.5와 Claude Opus 4.7을 같은 샘플로 테스트 | input은 같고 Opus output은 낮지만 retry와 품질이 총비용을 바꿉니다. |

| 긴 문서나 대형 코드베이스 | Claude Opus 4.7 또는 Sonnet 4.6 | Anthropic은 1M context를 standard pricing 안에서 설명합니다. |

| 대량 offline 요약이나 평가 | 양쪽 batch | 두 provider 모두 50% batch discount를 제공합니다. |

| 고정 system prompt나 RAG 재사용 | cache hit rate 비교 | cached input이 기본 가격보다 더 중요해질 수 있습니다. |

가격 행은 기준점일 뿐입니다

표만 보면 GPT-5.4 mini는 Haiku 4.5보다 저렴하고, GPT-5.4는 Sonnet 4.6보다 input이 낮으며 output은 같습니다. GPT-5.5와 Opus 4.7은 input이 같고 Opus 4.7 output이 낮습니다. 그러나 GPT-5.5가 아직 API 계정에서 보이지 않는다면 production 계산에 넣으면 안 됩니다.

진짜 비용은 성공한 작업 1건당 비용입니다. 싼 모델이 더 많은 retry, 긴 output, 많은 tool calls를 만든다면 총액은 올라갑니다. Claude가 긴 컨텍스트나 코딩 루프를 한 번에 처리해 분할과 재시도를 줄이면 더 높은 행도 이길 수 있습니다.

캐시와 배치가 승자를 바꿉니다

Anthropic cache는 5분 write가 base input의 1.25x, 1시간 write가 2x, cache hit가 0.1x입니다. OpenAI도 cached input 가격 행을 제공합니다. 시스템 프롬프트, tool schema, policy pack, RAG 문서를 반복해서 보낸다면 첫 write와 이후 read를 따로 계산해야 합니다.

Batch는 실시간이 아닌 작업에 적합합니다. OpenAI는 Batch API가 input과 output을 50% 절감한다고 설명하고, Anthropic도 batch 50% discount를 표시합니다. 평가, 분류, 마이그레이션 QA, 대량 요약에서는 provider를 바꾸기 전에 batch 가능성을 확인하세요.

OpenAI가 더 싼 기본값인 경우

OpenAI는 짧고 정형적이며 대량인 작업에 먼저 맞습니다. classification, extraction, JSON 변환, 짧은 support draft, title generation, short summary는 GPT-5.4 mini로 품질 기준을 통과하는지 먼저 봅니다.

GPT-5.5가 계정에 없다면 억지로 비교표에 넣지 마세요. 현재 사용 가능한 GPT-5.4 계열과 Claude의 현재 행을 비교하고, GPT-5.5는 계정 활성화 확인 후 후보로 다룹니다.

Claude가 더 나은 지출이 되는 경우

Claude는 긴 연구 문서, 다중 파일 코드 이해, 계약 검토, Agent loop, 대규모 support knowledge base에서 강한 후보입니다. 여기서는 가장 싼 token보다 실패와 재작업을 줄이는 능력이 중요합니다.

Anthropic은 Opus 4.7의 새 tokenizer가 같은 고정 텍스트에 대해 최대 35% 더 많은 tokens를 사용할 수 있다고 설명합니다. 그래서 단어 수로 비용을 비교하지 말고 실제 tokenizer와 실제 샘플로 low, typical, high output 시나리오를 측정해야 합니다.

팀용 계산표

| 비용 단위 | 측정할 내용 |

|---|---|

| input tokens | system prompt, user text, RAG, tools, files, image input |

| output tokens | answer, code, JSON, summary, explanation |

| cache | write size, read size, hit rate, TTL |

| batch | 기다릴 수 있는지, 필요한 기능이 지원되는지 |

| tools | web search, code execution, image, server-side tools |

| retries | failed calls, truncation, manual reruns |

| route premium | data residency, regional endpoint, priority, fast mode |

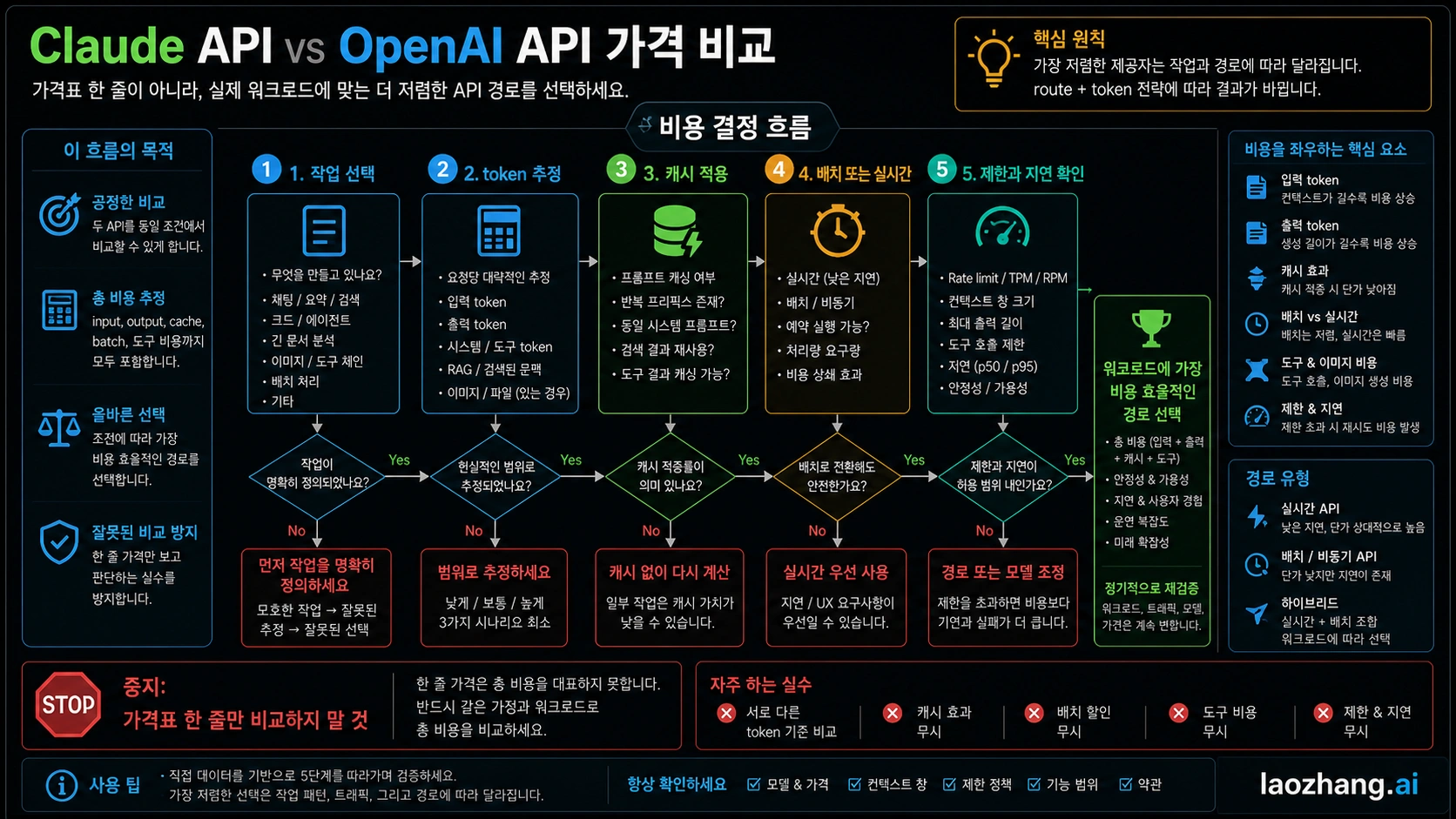

배포 전 검증

배포 당일 OpenAI API pricing, GPT-5.5 availability note, Anthropic pricing을 다시 확인하세요. 모델 행, 계정 접근, input/output, cache, batch, context, rate limits, tool charges, route premium이 모두 최신인지 확인해야 합니다.

실제 샘플로 한 번 더 확인할 것

평균 요청 하나만으로 결정하지 마세요. 최소 세 가지 샘플을 준비해야 합니다. 짧은 input과 짧은 output, 긴 input과 짧은 output, 긴 input과 긴 output입니다. 각 샘플에서 input tokens, output tokens, 반복되는 context, batch 가능 여부, cache hit rate, retry 횟수를 기록합니다. 이렇게 해야 짧은 정형 작업은 mini 모델이 이기고, 긴 문서 분석이나 Agent 작업은 Claude가 이기는 분기점을 볼 수 있습니다.

또 하나는 경계 조건 테스트입니다. 가장 큰 문서, 가장 무거운 tool schema, 가장 긴 Agent loop, 인용 확인이 필요한 답변을 골라 같은 조건으로 Claude와 OpenAI를 실행하세요. token 단가뿐 아니라 truncation, JSON 형식 오류, 수동 수정 시간, 재실행률, 첫 시도에서 quality bar를 넘은 비율을 함께 기록해야 합니다. 실제 비용은 가격표보다 retry와 운영 시간에서 더 자주 발생합니다.

자주 묻는 질문

Claude API와 OpenAI API 중 무엇이 더 싼가요?

짧고 단순한 대량 작업은 OpenAI가 싸기 쉽습니다. 긴 컨텍스트, Agent, cache-heavy workflow, retry 감소가 중요한 작업은 Claude도 같은 샘플로 비교해야 합니다.

GPT-5.5와 Claude Opus 4.7을 직접 비교해도 되나요?

가능합니다. 단 날짜와 API 계정 접근 여부를 명시해야 합니다. OpenAI는 가격을 공개했고 2026년 4월 24일 업데이트에서 GPT-5.5가 API에서 사용 가능하다고 설명합니다. Anthropic은 Opus 4.7을 현재 API 가격 행으로 표시합니다.

cache는 항상 비용을 줄이나요?

아닙니다. write만 하고 read가 없으면 이득이 없습니다. 큰 고정 컨텍스트를 여러 번 재사용할 때 효과가 생깁니다.

batch는 항상 써야 하나요?

아닙니다. offline 작업에는 좋지만 interactive agent나 낮은 지연 시간이 중요한 UX에서는 discount보다 latency가 더 중요합니다.