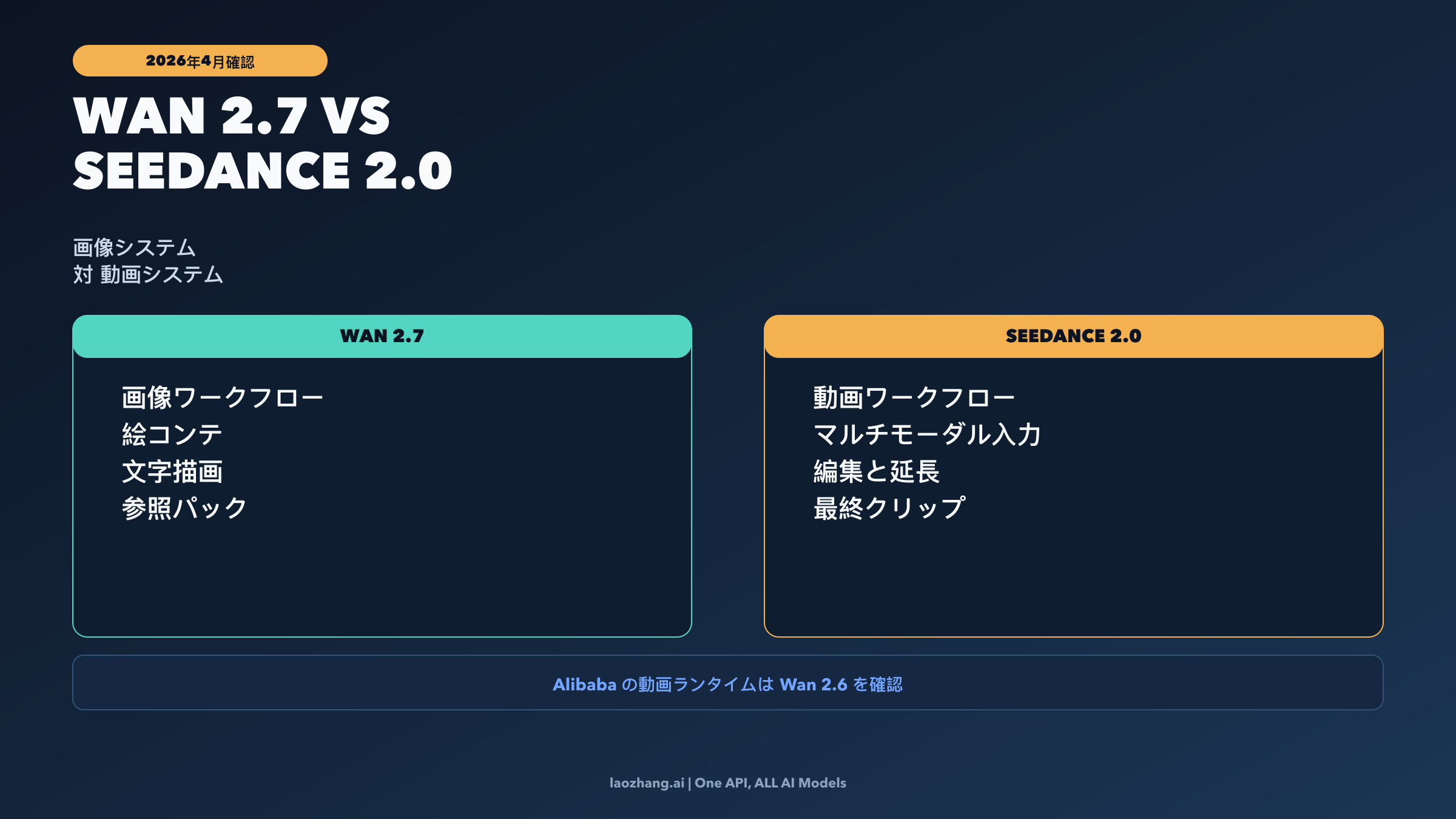

Wan 2.7 と Seedance 2.0 は、今の公式な公開情報では同じ種類のプロダクトではありません。Wan 2.7 は Alibaba の image-first リリースで、Seedance 2.0 は ByteDance のマルチモーダル音動画システムです。 ストーリーボード、参照画像パック、文字の多い静止ビジュアル、あるいは上流のビジュアル ideation が必要なら、まず Wan 2.7 を見るべきです。最終的な動画生成、編集、延長が必要なら、まず Seedance 2.0 を見るべきです。もし本当に聞きたいことが「Alibaba の現在の公式 video stack と Seedance 2.0 を比べたい」なのであれば、より正確な比較対象は Wan 2.6 video と Seedance 2.0 beta です。

以下の freshness-sensitive な情報はすべて、2026年4月2日 に Alibaba Cloud、ByteDance Seed、Volcengine の公式ページで再確認しました。このテーマで一番危険なのは数値の古さよりも、異なる product layer をそのまま一つの benchmark にしてしまうことです。

TL;DR

| 本当の deliverable | まず選ぶべきもの | 理由 | 主な注意点 |

|---|---|---|---|

| ストーリーボード、参照パック、文字量の多い静止画、上流の visual ideation | Wan 2.7 | 現在の Wan 2.7 は公式に image-first として出されており、長いテキスト、多参照、高い still control に強い | Alibaba の現在の公開 video runtime と同じものとして扱わないこと |

| 最終動画の生成、編集、延長 | Seedance 2.0 | 現在の公式 docs では Seedance 2.0 が video layer のモデルとして明確に位置付けられている | API アクセスは enterprise beta 境界つきで、完全 self-serve ではない |

| runtime / API の明瞭さで選びたい | Wan 2.6 video vs Seedance 2.0 beta | Alibaba の公開 docs は Wan 2.6 video の価格と runtime ルールを今のところより明確に書いている | これは Wan 2.7 image と Seedance 2.0 の比較とは別の話 |

| ideation から clip 完成まで一つの pipeline を作りたい | 両方使う | Wan 2.7 は upstream の keyframe / style pack に向き、Seedance 2.0 は downstream の final clip に向く | handoff を自分で設計する必要がある |

なぜ Wan 2.7 と Seedance 2.0 はきれいな一対一比較にならないのか

まず事実を押さえるべきです。現在公開されている公式情報では、この二つは異なる出力レイヤーにあります。 Alibaba の 2026 年 4 月のプレスリリースは Wan2.7-Image と Wan2.7-Image-Pro を画像生成・画像編集リリースとして紹介しています。そこでは長文テキスト描画、パーソナライズ画像生成、最大 9 枚の reference image、最大 12 枚同時生成、そして Wan2.7-Image-Pro の 4K 出力が強調されています。これは画像ワークフローの話です。

一方、ByteDance の公式 Seedance 2.0 launch と Volcengine の現行 Seedance 2.0 tutorial は別のものを説明しています。text、image、video、audio を input として受け取り、4〜15 秒の clip を出力し、動画の編集や extension も扱えるマルチモーダル動画モデルです。こちらは動画ワークフローの話です。

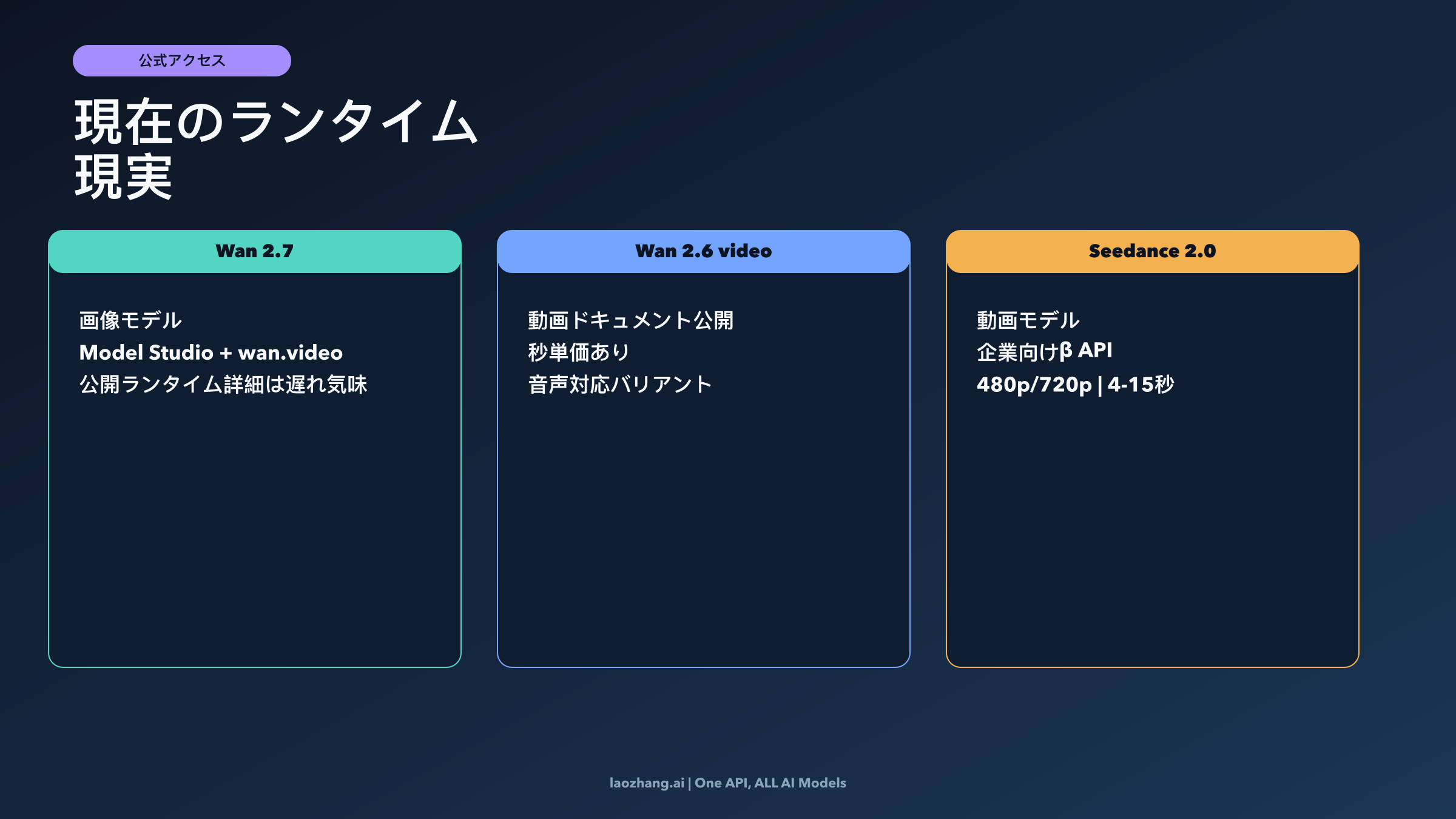

では、なぜ混同が続くのか。理由は Wan という名前が複数の世代と複数の surface をまたいでいるからです。Alibaba のリリースでは Wan 2.7 が Model Studio と wan.video から利用できると書かれていますが、現在公開されている Alibaba Model Studio models ページ で最も明確に読める video runtime は、依然として Wan 2.6 family です。つまり「Wan 2.7 vs Seedance 2.0」という問いは、実際には image release と video system を同じ試合に入れてしまっていることが多いのです。

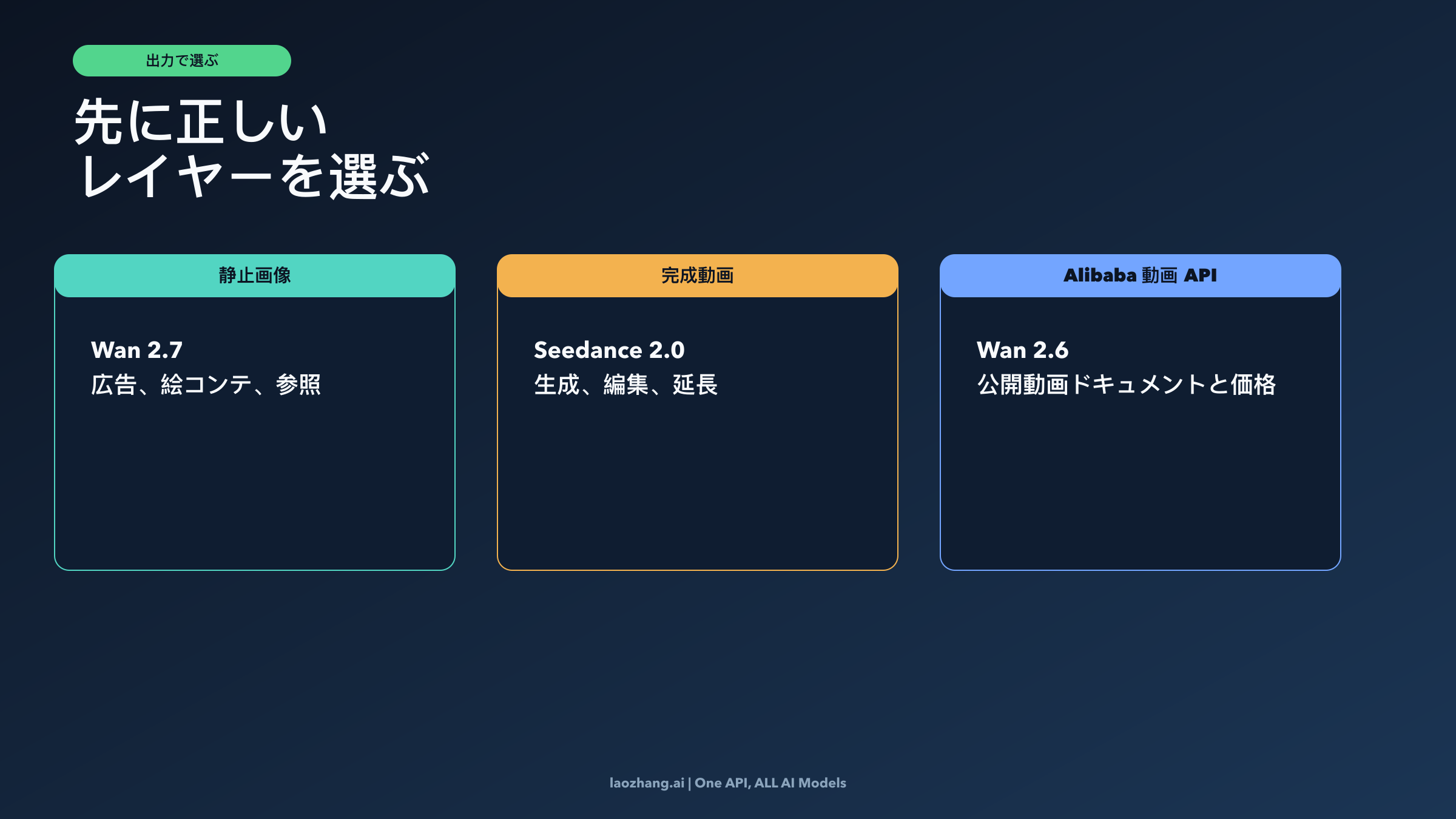

本当に役に立つ順番は逆です。まず ask すべきなのは deliverable が静止画なのか、最終 video clip なのかです。静止資産が欲しいなら image layer を選んでいます。完成動画が欲しいなら video layer を選んでいます。そこを先に切り分けてからでないと、この比較は実用的になりません。

Wan 2.7 が強い場面

Wan 2.7 が強いのは、仕事の本体が final video ではなく still-image control にある場面です。 Alibaba の公式メッセージは最初からそこに寄っています。長文を含むビジュアル、storyboard のような multi-image output、色やブランド整合性が重要な commercial still、そして image editing。これらは副次的な機能ではなく主線です。

Wan 2.7 の現在の公開 contract で特に重要なのは三点あります。第一に、Alibaba は最大 3,000 text tokens をサポートすると書いています。これはポスター、広告、説明入り画像など、画像の中の文字そのものが重要な場面で大きい意味を持ちます。第二に、最大 9 枚の reference images と 12 枚同時生成 をサポートしていることです。これは storyboard board、style pack、product-scene exploration、campaign visual iteration に向いています。第三に、Wan2.7-Image-Pro は 4K output に対応しており、design review や e-commerce detail にも使いやすいです。

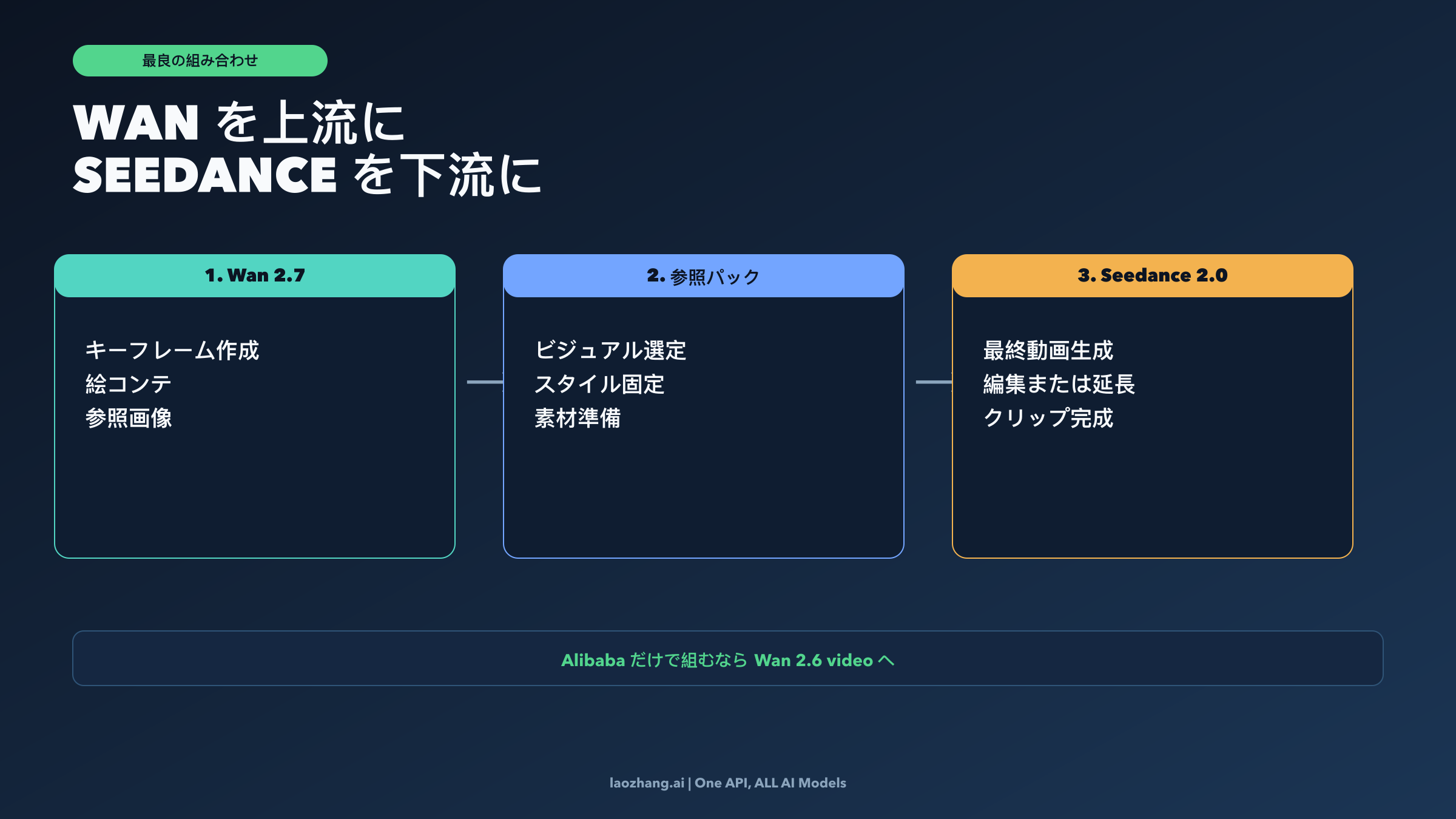

だからこそ Wan 2.7 は content pipeline の upstream に置くのが自然です。構図を決める、visual identity を固める、typography を試す、後続の動画作業を支える still references を作る。こうした段階では、Wan 2.7 の方が Seedance 2.0 よりも task に正直です。Seedance 2.0 は image references を受けられますが、現在の公開 contract の主眼はあくまで multimedia inputs を video に変えることです。資産そのものが still image である段階では、Wan 2.7 にとどまる方が自然です。

チームがまだ「動画をどんな look にすべきか」を決め切れていないなら、まず reference pack を強くする方が価値があります。上流の frame が弱いまま video generation に入ると、どの動画モデルでも反復コストが増えます。もし今の bottleneck が motion ではなく frame にあるなら、先にそこを解くべきです。より広い upstream の image layer を見たいなら、私たちのベスト AI 画像モデルガイドの方が適しています。

Seedance 2.0 が強い場面

Seedance 2.0 が強いのは、deliverable が最終的に動画そのものである場面です。 現在の Volcengine tutorial は、その runtime の形を十分に実用的なレベルで示しています。Seedance 2.0 beta は text に加え、最大 9 枚の画像、3 本の動画、3 本の音声 を一つの request に入れられます。出力は 4〜15 秒、解像度は 480p または 720p。そして generation だけでなく、edit や extension のような動画タスクもカバーします。

重要なのは「参照を受け取れる」ことそのものではありません。参照が video-native workflow の中に最初からあることです。motion、rhythm、scene continuation、audio-aware generation を最初から同時に制御できます。つまり、image-centric な製品に video の主役を無理にやらせるのではなく、動画向けに設計された layer を使えるわけです。もし判断基準が「複数の画像や motion guidance、audio guidance を与えて、最終的に usable clip を作れるか」であれば、Seedance 2.0 の方が question に近い答えです。

もちろん access boundary は重要です。現在の Volcengine docs では Seedance 2.0 と Seedance 2.0 Fast は enterprise users 向け public beta に置かれており、完全に frictionless な global self-serve runtime ではありません。ただし、それは product type を変えるものではありません。final video work のためのモデルとしては、やはりこのペアでは Seedance 2.0 がより正しい選択です。

つまり、最初の問いが「完成した clip が欲しい」であり、「先にもっと強い静止リファレンスが欲しい」ではないなら、Seedance 2.0 がより直接的な答えです。より広い creator-market の shortlist として見たい場合は、私たちのベスト image-to-video ツールガイドの方が向いています。

runtime と API clarity が大事なら、Wan 2.6 video と Seedance 2.0 beta を比べるべき

技術バイヤーが知りたいのは、どちらが exciting かだけではありません。今日の時点で 何が公式に文書化され、価格が読め、サポート可能で、実装可能なのか です。この文脈では、正しい比較は Wan 2.7 image vs Seedance 2.0 ではなく、Wan 2.6 video vs Seedance 2.0 beta です。

Alibaba の公開 docs は、今のところ runtime-contract の読みやすさで優位です。wan2.6-t2v や wan2.6-i2v-flash といった Wan 2.6 video family が明示され、per-second prices も公開されています。2026 年 4 月 2 日に確認した US contract では、wan2.6-t2v-us が 720p で 1 秒あたり $0.10、1080p で 1 秒あたり $0.15 と記載されています。wan2.6-i2v-flash は audio あり / なしまで分けて価格が示されています。こうした public clarity 自体が実務上の価値です。

Seedance 2.0 側の current official contract は違う形をしています。tutorial page は real model IDs、出力レンジ、multimodal limits をすでに見せており、昔の「console only」よりかなり前進しています。ただし pricing page は、今でも一つの sticker price というより scenario-based examples として読む方が自然です。現在の official examples では、16:9 の 5 秒クリップを 480p で出す場合、doubao-seedance-2.0 は 2.31 RMB、doubao-seedance-2.0-fast は 1.86 RMB。同じ 16:9 の 5 秒を 720p にすると 4.97 RMB と 4.00 RMB になります。十分に useful ですが、Alibaba の Wan 2.6 video rows ほど表面が整っているわけではありません。

だから routing rule は明確です。public runtime clarity、contract readability、公開された価格行を重視するなら、今は Alibaba の video side の方が読みやすい。ただし名前は Wan 2.6 video であり、Wan 2.7 image ではありません。逆に、multimodal video semantics、editability、video system としての魅力を重視するなら、Seedance 2.0 の方が面白い選択です。ただし enterprise-beta の access boundary と、やや不均一な pricing surface は受け入れる必要があります。

より広く「今どの public video API が本当に使いやすいのか」を見たいなら、hype-driven な vendor showdown よりも、私たちのベスト free AI video API ガイドの方が実用的です。

workflow で最終的にどう選ぶか、そして両方使うべき場面

ここで一番役に立つ答えは、「一人の winner を決めること」ではなく、「各段階の owner を正しく割り当てること」です。

ブランドチームやクリエイティブチームなら、初期段階で難しいのは motion よりも look の決定です。そういう時は Wan 2.7 を upstream に置きます。hero still、storyboard panel、product composition、文字量の多い visual、そして team 全体が共有する reference pack をそこで作ります。その方向が固まった後に、Seedance 2.0 を downstream に置き、最終的な動く video に変えていくのが自然です。

技術バイヤーなら、問いを二つに分けるべきです。image generation と高コントロールの still assets なら Wan 2.7。公開 video runtime の比較なら Wan 2.6 video と Seedance 2.0 beta。final video generation なら Seedance 2.0。単純な one-line verdict より複雑に見えますが、その方がはるかに誤解が少ないです。

solo creator や performance marketer なら、判断はもっと速くできます。keyframe、ad concept、clean reference set が必要なら Wan 2.7。shot がすでに見えていて短い clip が欲しいなら Seedance 2.0。workflow が両方の layer をまたぐなら、両方使うべきです。片方だけで済ませようとして upstream control または downstream video capability を失う必要はありません。

この点こそがこの記事の main information gain です。最も強い答えは winner-shaped ではなく pipeline-shaped であることが多い。 多くのチームにとって最良の流れは、Wan 2.7 が ideation と reference control を担当し、Seedance 2.0 が final clip generation、extension、edit-style work を担当する形です。本当に一つのモデルだけ選ぶべきなのは、team が最初から一つの layer にしかいない場合だけです。

よくある質問

Wan 2.7 は Seedance 2.0 より優れているのですか。

無条件には言えません。Wan 2.7 は storyboard、reference pack、文字量の多い still visual のような image-centric task に強く、Seedance 2.0 は最終的な multimodal video generation、editing、extension に強いです。どちらが better かは workflow stage を限定して初めて意味を持ちます。

Wan 2.7 は動画も生成できますか。

2026 年 4 月の Wan 2.7 公式リリースは image-first であり、Alibaba Model Studio で現在もっとも明確に読める public video runtime は依然として Wan 2.6 family です。したがって、今の時点で Wan 2.7 video をそのまま Seedance 2.0 と比べるのはきれいな public contract comparison ではありません。Alibaba の deployable video stack を知りたいなら、Wan 2.6 video を見てください。

API / runtime の buyer にとってはどちらが重要ですか。

public contract の明瞭さを最優先するなら、Wan 2.6 video の方が読みやすいです。model family と per-second pricing がよりはっきりしています。multimodal video capability や edit semantics を重視するなら Seedance 2.0 の方が魅力的ですが、access boundary は今も enterprise beta です。

両方使うべきなのはどんな時ですか。

workflow が visual planning から始まり、最終的に clip で終わる時です。まず Wan 2.7 で still references、keyframe、visual direction を作り、その承認済みの方向を Seedance 2.0 に渡して video generation、extension、editing を行うのが一番自然です。