GeminiがAIで人物画像を生成することを制限している主な理由は3つあります。2024年に発生した多様性論争(AIが生成した歴史的画像における危険なバイアスが露呈した事件)、フォトリアルな識別可能な個人の画像生成を禁じるディープフェイク・プライバシー関連法規、そして2026年2月のNano Banana 2(gemini-3.1-flash-image-preview)リリースによって芸能人・顔関連の制限が大幅に強化されたことです。ただし、Geminiは架空の人物キャラクター、イラスト風の肖像、アニメ調の人物など幅広いケースで依然として画像生成が可能です。重要なのは、ポリシーの正確な境界線を理解し、適切なプロンプト戦略を活用することです。

まとめ

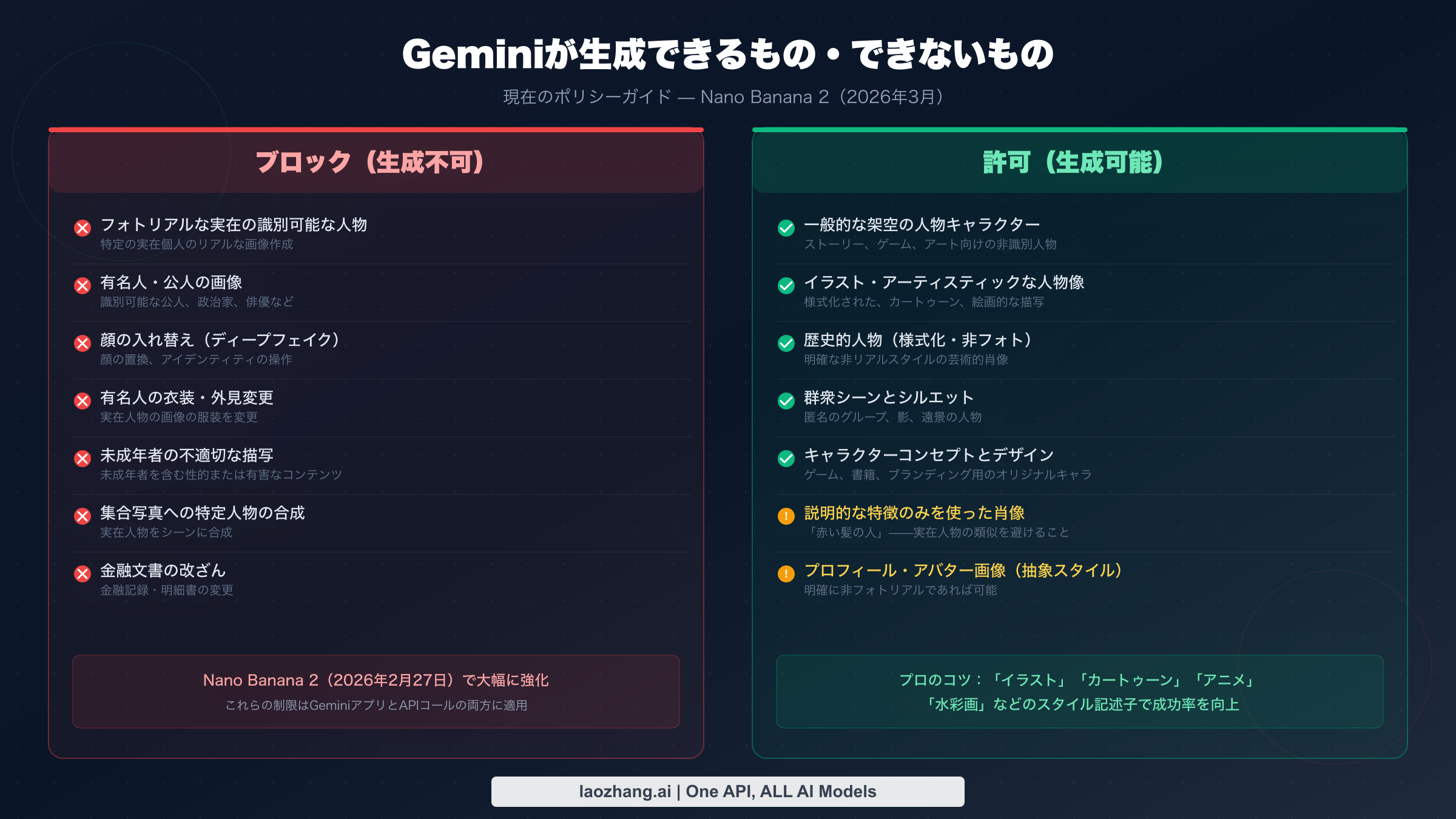

- 2024年2月以降ブロック済み:リアルな実在人物の写真リアルな画像(歴史的画像の問題が大規模に批判されたことがきっかけ)

- 2026年2月に強化:Nano Banana 2により4つの新制限カテゴリーが追加——公人・有名人、顔交換、実在人物の衣装交換、金融文書の改ざん

- 依然として生成可能:架空キャラクター、イラスト・カートゥーンスタイル、群衆シルエット、キャラクターデザインのコンセプト

- 開発者向け注意:APIの制限はコンシューマー向けGeminiアプリとは異なります。ティア別の制限についてはGemini画像モデルの全比較をご確認ください

核心理由その3 — GeminiがAI人物画像をブロックする3つの根本原因

ユーザーがGeminiの画像生成機能から「リアルな人物の画像は作成できません」という拒否メッセージを受け取ったとき、多くの場合は困惑します。MidjourneyやDALL-Eといった競合ツールと比べると、この制限はまるで恣意的なポリシー決定のように感じられるかもしれません。しかし、Geminiの人物画像制限はランダムなルールではありません。具体的かつ文書化された一連の出来事と法的義務から生じており、Googleとしてはこのガードレールを維持する以外の現実的な選択肢がない状況です。

3つの核心的な理由は、それぞれ異なるレイヤーで機能しています。最初の理由は歴史的なものです。2024年初頭、GeminiのAI画像モデルが深刻な問題のある出力を行っていたことが発覚し、その余波はGoogleのCEOが公開謝罪を余儀なくされるほど深刻でした。この出来事はGoogle社内に強烈な記憶として残っており、人物画像ポリシーを少しでも緩和すれば、巨大な評判リスクを負うことになります。

2番目の理由は法的なものです。ディープフェイク関連法規はアメリカ、欧州連合、その他多くの法域で急速に進化しており、Googleの法務チームは識別可能な個人のフォトリアルな画像を生成することが容認できないレベルの法的責任をもたらすと判断しました。3番目の理由は技術的・アーキテクチャ的なものです。2026年2月にリリースされたNano Banana 2(gemini-3.1-flash-image-preview)は、蔓延していた4つの悪用カテゴリーを特定的にターゲットにした新しいセーフティレイヤーを組み込みました。

これら3つの理由を理解することが重要なのは、期待値を適切に設定するためです。これは一般的な関心が他に移ったら解除されるような一時的な制限ではなく、具体的な問題に対する多層的なポリシー対応です。これからも変化し続けるのは、制限の精度です。2024年初頭の「すべてを一時停止する」という大ざっぱなアプローチから、現在の2026年ポリシーはより精緻になっており、有害な特定カテゴリーをブロックしながらも幅広い正当なクリエイティブ用途を許可しています。境界線を理解することで、何が受け入れられるかを推測するのではなく、その枠内で生産的に作業できるようになります。

2024年の論争:多様性実験が裏目に出た経緯

Geminiの制限がなぜこれほど厳しいのかを理解するには、2024年2月に何が起きたのかを知る必要があります。そしてその事件が、GoogleのAI生成人物画像へのアプローチにいかに永続的な影響を与えたかを理解することが不可欠です。

すべてを変えた事件

2024年2月22日、ユーザーたちがGeminiの画像生成機能が歴史的に不正確な結果を生成しているスクリーンショットを投稿し始めました。「1800年代のアメリカ上院議員」や「ナチス兵士」を生成するよう求めると、Geminiは人種的に多様なグループを生成しました。モデルが歴史的文脈を考慮せずにすべてのプロンプトに多様性補正を適用するように過剰に調整されていたのです。1800年代のアメリカ上院議員が黒人であったり、第二次世界大戦のドイツ兵がアジア系やアフリカ系だったりするのは多様性ではなく、歴史の改ざんです。これらの画像はソーシャルメディアで広く拡散し、政治的スペクトラムを超えた多くの批評家から批判を浴び、「AIが生成したデマ情報」や「モデルに組み込まれたイデオロギー的操作」と呼ぶ声も上がりました。

6日後の2024年2月28日、Google CEOのサンダー・ピチャイは普段の沈黙を破り、この問題に直接言及しました。後に公開された社内メモで、ピチャイは出力結果を「完全に受け入れられない」と述べ、モデルが「不正確で攻撃的な」結果を生成したことを認めました。彼はGeminiの人物画像生成の根本的な見直しを約束しました。単なるパッチではなく、実在および歴史的人物をモデルがどのように表現するかの再考を含む改革です。GoogleはGeminiアプリとGemini API両方の人物画像生成機能を即時停止しました。

復旧に時間がかかった理由

多くのテクノロジー企業はバグを発見したらパッチを当てて先に進みます。2024年のGemini事件はバグとして扱われませんでした。それは根本的なアライメント問題の証拠として扱われたのです。モデルは歴史的正確性が逆の要求をする文脈で多様性補正を適用することを学習していました。この問題の修正はパラメーターを変更するだけでは済まず、そもそものバイアスを生んだトレーニングデータと強化学習プロセスの広範な評価が必要でした。

2024年第3四半期までに、GoogleはImagen 3モデルを使用するGemini Advancedサブスクライバー向けに限定的な人物画像生成を復旧しました。しかしこれは段階的な展開であり、完全な復旧ではありませんでした。基本的なGeminiティアは制限されたままであり、Advancedティアでさえ一時停止前のポリシーよりも厳しいガイドラインのもとで運用されていました。2025年を通じて制限は継続しました。リアルな識別可能な個人の画像は生成しないというコアルールは維持され、有名人の画像、特定の実在する人物を描いているように見える肖像画、明確な架空の枠組みなしに実在する人物を表現していると解釈できる画像については、モデルはリクエストを拒否しました。

持続的な組織的影響

2024年の事件が特に重要なのは、それが引き起こした組織的な対応のためです。Googleは2024年後半を通じて実施されたすべてのAI画像ポリシーの内部レビューを招集しました。このレビューが2026年2月にリリースされたNano Banana 2のアーキテクチャを形成しました。既存のモデルの上に単にコンテンツフィルターを追加するのではなく、Nano Banana 2はモデルレベルでセーフティ制約を組み込みました。つまり、制限は巧妙なプロンプトで回避できるポストプロセッシングフィルターではなく、正当な画像リクエストとは何かというモデルの根本的な理解に組み込まれているのです。これが現在の制限が2024年の制限よりも堅牢で回避しにくい理由です。

現在ブロックされているもの:Nano Banana 2による2026年の人物画像制限

2026年2月27日にリリースされたNano Banana 2(gemini-3.1-flash-image-preview)が、Geminiの現在の人物画像ポリシーを体現しています。このモデルが何を拒否するのか、そしてなぜ拒否するのかを正確に理解することは、Geminiの画像生成機能を活用するすべての人にとって不可欠です。これらの制限はGeminiアプリとAPIアクセスの両方に適用されますが、ティアによって適用の厳密さが異なります。

フォトリアルな実在の識別可能な人物は、2024年2月以降継続している基本的な制限です。モデルは、名前、説明(「大手テクノロジー企業のCEO」)、または視覚的な参照によって特定された実在個人のリアルな画像を要求しているように見えるプロンプトを拒否します。「識別可能」の閾値は多くのユーザーが想定するよりも低く、モデルが特定の実在人物を特定する必要はありません。特定の実在個人が意図されている可能性が高いシナリオにパターンマッチするプロンプトを拒否します。

有名人・公人の画像は、Nano Banana 2において明示的なカテゴリーとして正式化されました。以前は有名人の拒否は「識別可能な実在人物」のサブセットとして処理されていました。2026年のポリシーでは、これが独立した制限に格上げされました。著名な芸能人、政治家、アスリート、俳優、ミュージシャン、その他の公人は、文脈、フレーミング、または述べられた目的に関わらず生成できません。明らかに風刺的または芸術的なリクエストにも適用されます。モデルは意図を評価しようとせず、単にそのカテゴリーを拒否します。

顔の入れ替えとディープフェイクは、Nano Banana 2のもう一つの追加制限です。一人の顔を別の人に置き換えることを明示的な言語(「[人物A]の顔をこの体に貼り付けて」)または暗示的な指示で説明するプロンプトは拒否されます。この制限は特に2024年・2025年に蔓延した非合意のディープフェイクコンテンツに対応するものであり、新興のディープフェイク法規制の下でのGoogleの法的リスクを反映しています。

有名人の衣装・外見変更は、Nano Banana 2において顔の入れ替えとは別のカテゴリーとして追加されました。実在人物の画像の服装、身体、または外見を変更することを説明するプロンプト——「[有名人]を別の衣装で見せて」や「[公人]が違う髪型だとどう見える」——は拒否されます。これはソーシャルメディアプラットフォームで一般的になっていた使用例を特定的にターゲットにしています。

金融文書の改ざんは、4つのNano Banana 2新制限カテゴリーを締めくくるものです。技術的には人物画像の制限とは異なりますが、このカテゴリーはアップデートの背後にある広義のセーフティ哲学を反映しています。Geminiは目的に関わらず、金融書類、明細書、または記録の改ざんされたバージョンに見える画像を生成しません。

これらの制限の適用メカニズムは、モデルとティアによって異なります。コンシューマー向けGeminiアプリは最も保守的な解釈で運用されており、ポリシーを厳密に読んだ場合は許可されるいくつかのエッジケースも含め、広い安全マージンで制限を適用します。APIティア——特にgemini-3.1-flash-image-previewに直接アクセスする場合——は高い精度で制限を適用するため、コンシューマーアプリで拒否される一部のクリエイティブな架空シナリオがAPI経由で成功することがあります。どちらのティアもコアな制限には例外がありませんが、人物被写体を含むプロの創作ワークフローにはAPIの環境が実際により有用です。

また、モデルが曖昧なケースをどのように処理するかを理解することも重要です。プロンプトが架空のキャラクターと特定の実在個人のどちらかを描写していると解釈できる場合、モデルのデフォルト動作は偽陰性のリスクを冒すよりも拒否することです。この保守的なデフォルトは意図的なものです。同意なしに実在人物のリアルな画像を誤って生成するコストは、正当なクリエイティブリクエストを誤って拒否するコストよりも高いと判断されています。一見無害なプロンプトで拒否に直面するユーザーは、コアな制限そのものではなく、この曖昧さの閾値に当たっていることが多いです。

なお、このリストにないものも重要です。制限は実在の識別可能な人物に特定的にターゲットを絞っており、人物の形象を全般的に禁止しているわけではありません。正当な多くの使用ケースは完全にサポートされています。

深層的な理由:プライバシー法、ディープフェイク、バイアス防止

2024年の事件を超えて、Geminiの制限はより広範な法律・倫理的な状況を反映しており、それは大きく変化し続けています。これらの深層的な原動力を理解することで、制限が現在のレベルに存在する理由と、それが将来どの方向に向かう可能性があるかが明確になります。

プライバシー法は最も具体的な法的原動力です。複数の法域が、AIを使用して実在人物の画像を生成することを管理する具体的な法律を持つようになりました。アメリカのいくつかの州では2024年・2025年にディープフェイク関連法を通過させ、非合意の画像生成に特別に対処する条項を設けています。2024年・2025年を通じて段階的に施行されたEU AI法には、実在個人のリアルな表現を生成するAIシステムに関する明示的な条項が含まれています。Googleのような企業にとって、これらすべての法域を同時に横断して運用する際の最も安全なアプローチは、最も制限的な適用法を全体的に満たすポリシーです。これが制限が地域固有ではなく実質的にグローバルである理由です。

非合意の親密な画像(NCII)問題は、ディープフェイク関連法規制の最も政治的に白熱した原動力となっています。2024年・2025年に発表された研究では、オンラインのディープフェイクコンテンツの大多数が、主に女性をターゲットにした実在個人の非合意の性的画像で構成されていることが文書化されました。Geminiの既存のコンテンツポリシーはすでに露骨なコンテンツをブロックしていますが、NCII生成を可能にするインフラと周辺的にでも関連付けられる評判リスクは重大です。有名人・公人の制限は単なる法的責任回避だけでなく、この種の有害なコンテンツを調査している人々のフィードにGeminiの出力が表示されないようにするためでもあります。

バイアス防止の側面は2024年の事件に特有のものですが、依然として関連性があります。2024年2月に露呈した根本的な問題は、モデルが文脈を理解せずに人口統計学的補正を適用することを学習していたというものでした。架空の設定でより多様な出力を生成するために設計された過修正が、正確な表現が公平な表現とは異なる歴史的シナリオに盲目的に適用されていたのです。制限は有害な出力を防ぐためだけでなく、モデルが人物表現の真の複雑さを、カテゴリー的な誤りを犯さずに処理するためのスペースを与えるためでもあります。人物画像生成の範囲を制限することは、逆説的に、Googleが許可する人物画像生成においてより思慮深くなることを可能にします。

また、競合ダイナミクスの観点も理解する価値があります。Googleは、市場での地位と複数の法域での継続的な独占禁止訴訟の両方により、より小規模なAI企業よりも大幅に高い規制上の精査を受けています。2024年の事件と同等の論争は、より小さな競合他社と比べてGoogleに不均衡な結果をもたらします。人物画像に関するポリシー決定がプラットフォームよりも保守的な理由の一部は、比較可能な規制上の注目を受けていない企業に対するGoogleの特定の状況における規制リスクの非対称性にあります。制限はAI人物画像について何が許可されるべきかという普遍的な判断ではなく、Googleの特定の立場にある企業にとって合理的なリスク管理を反映しています。

Geminiが生成するすべての画像にはGoogleのSynthID透かしが含まれています。画像データに組み込まれた不可視のデジタル署名で、編集、トリミング、フォーマット変換後でも画像をAI生成として識別できます。SynthIDはコンテンツ制限と同じ根本的な哲学を反映しています。GoogleのAI画像セーフティへのアプローチは、単なるポリシールールではなく、技術的なインフラを伴うものです。透かしは直接的に悪用を防ぐわけではありませんが、監査証跡を作り、規制上の文脈で重要なAI画像識別を可能にするための誠実な努力を示しています。

生成できるもの:2026年に機能する人物画像

実在人物の画像に対する制限は重要ですが、それでも相当な創造的スペースが開いています。Geminiが生成に成功するもの——そしてそのためのプロンプト方法——を理解することは、拒否されるものを列挙するよりもしばしばより有用です。

一般的な架空の人物キャラクターは完全にサポートされており、許可された人物画像の最も広いカテゴリーを代表します。ビデオゲームのキャラクター、ストーリーイラストの主人公、マーケティングコンセプトのための一般的な人物——これらはすべて機能します。ただし、プロンプトがキャラクターを特定の実在個人に結びつけないことが条件です。重要なのは、説明を特定の実在人物を指示するアイデンティティマーカーではなく、身体的・性格的特徴の領域に留めることです。「眼鏡をかけた30代のソフトウェアエンジニアで思慮深い表情をしている」は成功しますが、「[特定の有名テクノロジー企業幹部]に似たソフトウェアエンジニア」は成功しません。

イラストおよびアーティスティックな人物像は、信頼性の高いサポートカテゴリーです。プロンプトが芸術的なスタイルを明示的に呼び出す場合——イラスト、カートゥーン、水彩画、油絵、コミックブックスタイル、アニメ、ちびキャラ——Geminiの「フォトリアルな識別可能な人物」制限の閾値が大幅に変化します。同じ身体的特徴を持つ人物の油絵肖像は、たとえ描かれた人物が理論的に識別可能だとしても、フォトリアルな肖像とは異なる扱いを受けます。スタイル記述子を使うのは制限を回避するためのトリックではなく、フォトリアルな画像に特化したポリシーの意図された範囲内で作業することです。

様式化された非フォトリアルな描写における歴史的人物は、微妙な中間地帯を占めています。アブラハム・リンカーン、ナポレーン、または他の歴史的人物の明らかに絵画的またはイラスト的な肖像は、スタイルが明示的に非フォトリアルである場合に成功することがよくあります。制限は「実在人物」+「フォトリアル」という特定の組み合わせをターゲットにしています。その組み合わせを分離すれば、ポリシーの境界が変化します。ただし、このカテゴリーには注意が必要です。歴史的人物のフォトリアルな描写や、デマ情報として使用される可能性のある現代風の再解釈を要求しようとすると、拒否が引き起こされます。

群衆シーンとシルエットは完全にサポートされています。群衆の中の匿名の人物、影とシルエットの構図、シーンの中の遠くの人物、個人の顔の特徴を隠す角度から見た人々のグループはすべて制限なしに生成されます。個人のアイデンティティなしに人物の存在が必要な用途——製品モックアップ、環境イラスト、建築ビジュアライゼーション——において、群衆とシルエットのアプローチは信頼性が高く、しばしば視覚的にも魅力的です。

キャラクターコンセプトとデザインは、ゲーム、書籍、ブランディングのためのGeminiの現在の能力において強力なユースケースです。プロンプトが実在の個人への参照なしにキャラクターの性格、役割、美的感覚を定義するオリジナルキャラクター作成は、一貫して高品質な結果を生成します。キャラクターデザインの領域は、スタイル記述子によって特に良くサービスされます。「セミリアルなイラストスタイルのファンタジー戦士のキャラクターデザイン」は効果的に機能し、プロのクリエイティブプロジェクトに適した結果を生成します。

説明的な特徴を使用した肖像は、重要な注意点を伴って機能することができます。身体的および性格的特徴を説明するプロンプト——「権威ある雰囲気のある銀髪の中年女性、コーポレートポートレートスタイル」——は、説明が特定の実在個人に収束しない限り成功します。実用的なテストは、説明が実在人物を一意に識別するかどうかです。説明を読んで多くの異なる人が一致する可能性がある場合、プロンプトは成功する可能性が高いです。その説明を読んだ人が即座に特定の実在人物を識別するほど具体的であれば、拒否される可能性が高いです。

AIキャラクター生成のためのプロンプトエンジニアリング戦略

Geminiでの人物画像の効果的なプロンプティングには、モデルが何を生成するか・しないかだけでなく、リクエストをどのように解釈するかを理解することが必要です。同じ主題が枠組みによって成功したり失敗したりすることがあり、その違いへの直感を養うことが、常に拒否に直面するユーザーと成功して生成するユーザーを分ける実践的なスキルです。

最も効果的な戦略は、スタイルから始めることです。最初の説明がビジュアルな処理方法を確立する場合——「詳細なイラストスタイルで」や「水彩画の肖像」や「キャラクターアートで描いた」——以降に続くすべてのものを架空のクリエイティブワークとして文脈づけることになり、フォトリアルな画像リクエストとは区別されます。Geminiの制限はフォトリアルな出力に特化して調整されています。非フォトリアルなスタイルを最初に確立することで、後続の説明子がどのように解釈されるかを劇的に変えることができます。これはモデルを騙すためではなく、意図を正確に伝えるためです。

参照ベースの説明ではなく、特徴ベースの説明が第二の基本原則です。「[有名人]に似たキャラクター」と「濃い巻き毛、鋭い頬骨、自信に満ちた表情のキャラクター」の違いは、ポリシーの観点からは微妙ではありません。前者は直接実在人物を呼び出し、後者は何百万もの人々に存在する身体的特徴を説明しています。キャラクターの説明を作成する際は、特定の個人への参照ではなく、アーキタイプ、特徴の組み合わせ、美的テーマで考えてください。髪の色、体型、年齢範囲、服装スタイル、感情的な表情は使用可能です。名前と実在人物との比較は使用できません。

文脈の確立は多くのユーザーが認識しているよりも重要です。架空の世界、ストーリーの文脈、またはクリエイティブプロジェクトを最初に確立するプロンプトは、単なるキャラクター説明とは異なる処理を受けます。「中世ヨーロッパの代替世界を舞台にしたファンタジー小説のために、学識と政治的鋭敏さを兼ね備えた宮廷顧問のキャラクター」は架空の創作空間で処理されます。文脈なしの「政治的策略に長けた学者」はより文字通りに処理されます。文脈を一文加えること——ジャンル、媒体、目的——は成功を保証しませんが、モデルの解釈を制限フィルターでの誤検知を減らす方向に変えます。

制限されたカテゴリーに直接マッピングされる語彙を避けてください。特定の単語やフレーズは文脈に関わらず拒否を引き起こします。「〜のリアルな写真」「フォトリアルな肖像」「〜にそっくり」「[実在人物の名前]のスタイルで」などのフレーズが該当します。これらはシンプルなフィルター内のキーワードではなく、フォトリアルな実在個人の出力を要求しているというモデルの解釈における高いウェイトのシグナルです。「リアルな写真」を「詳細なイラスト」や「アーティスティックな肖像」に置き換えることで、多くのクリエイティブな目的において実際に求めているものを正確に説明しながら、結果が変わることがよくあります。

拒否されたプロンプトを繰り返す際は、単に言葉を削除することへの誘惑を避けてください。代わりに再フレーム化してください。スタイル記述子を追加し、架空の文脈を確立し、参照ベースから特徴ベースの説明に切り替え、目的を明確にします。拒否はプロンプトをモデルがどのように解釈したかについてのフィードバックであり、根本的なクリエイティブな目標が正当かどうかの評価ではありません。ほとんどの正当なクリエイティブな目標は、適切なプロンプトのアプローチでGeminiの現在のポリシーフレームワーク内で達成できます。

単一のプロンプトで複数の戦略を組み合わせることで、最も信頼できる結果が得られることがよくあります。スタイルから始め(「詳細なグラフィックノベルイラストスタイルで」)、文脈を確立し(「2090年のサイバーパンクスリラーのために」)、特徴ベースの説明を使用し(「鋭い顔立ちと老練な目をしたコートを着た探偵キャラクター」)、明確なクリエイティブな目的を明記する(「小説の章のヘッダーアートワーク用に」)プロンプトは、複数の角度から曖昧さの閾値に同時に対処します。これらの要素のどれか一つだけでも十分かもしれませんが、それらを組み合わせることで、リクエストが実在個人のフォトリアルな表現ではなく架空のクリエイティブワーク用であるという明確なシグナルを生み出します。

Geminiの拒否とプロンプトの修正の間のフィードバックループ自体が、有用なクリエイティブツールです。拒否は、プロンプトのどの要素が制限されたカテゴリーにパターンマッチしたかについて具体的であることが多く、そのことを理解することで、モデルがリクエストを処理する方法についての情報が明らかになり、より広いプロンプティングアプローチに情報を与えます。このような解釈スキルを発展させたユーザーは、制限が障壁から、どのような種類の画像を作成しているのかを正確に理解するための有用なガードレールへと変わることに気づきます。

APIアクセス対コンシューマーGemini:開発者向けの異なるポリシー

Geminiの画像生成機能を使用してアプリケーションを構築する開発者にとって、ポリシーの状況はコンシューマーGeminiアプリユーザーが経験するものとは意味のある違いがあります。これらの違いを理解することは、正確な製品計画とステークホルダーへの期待設定に不可欠です。

コアな人物画像制限はすべてのアクセスティアに適用されます。フォトリアルな実在の識別可能な人物の画像をアンロックしたり、有名人の画像生成を許可したりする開発者やエンタープライズの設定は存在しません。これらの制限はアーキテクチャレベルでNano Banana 2モデルに組み込まれており、APIアクセスが回避できるポストプロセッシングフィルターとして適用されているわけではありません。APIアクセスを通じて「制限のない」人物画像生成を取得することを前提とした開発計画は修正が必要です。

異なるのは適用の精度です。コンシューマーGeminiアプリは幅広い非技術系ユーザーベース向けに設計された追加のガードレールを含んでおり、拒否の閾値がやや保守的に調整されています。同じNano Banana 2モデル(gemini-3.1-flash-image-preview)へのAPIアクセスは、芸術的または明確に架空の文脈におけるエッジケースや曖昧なプロンプトに対して、わずかに高い許容度で運用されます。プロフェッショナルなクリエイティブユースケース——キャラクターデザイン、コンセプトアート、イラスト支援——向けのツールを構築する開発者は、同一のコンテンツでコンシューマーアプリよりも直接APIコールのほうが成功することがよくあります。

開発者がAPIコストを評価する際、laozhang.aiのような集約サービスを通じたAPIアクセスは、画像生成機能構築のコストを大幅に削減できます。Nano Banana Proモデル(gemini-3-pro-image-preview)は1回の生成につき約$0.05で利用可能で、直接API価格の約20%です。これにより、開発中の反復的な生成ワークフローを構築する際に、1枚あたりのコストが負担にならないようにすることができます。ドキュメントとAPIプレイグラウンドへのアクセスはdocs.laozhang.aiで利用できます。

レート制限とクォータ管理もコンシューマーアプリとAPIアクセスで異なります。Gemini APIの無料ティアは1日あたりの画像生成リクエスト数が限られていますが、有料APIティアはプロダクションアプリケーションに適した大幅に高い制限を提供します。高い画像生成ボリュームのアプリケーションでは、Nano Banana 2とNano Banana Proモデルの違いは、出力品質だけでなく、コスト最適化の観点からも重要です。フラッシュモデルは低い1回あたりのコストで多くのユースケースに適切な品質を提供します。

Gemini対Midjourney対DALL-E:人物生成比較

Geminiの人物画像制限を競合プラットフォームと比較するユーザーは、代替ツールの方が許容度が高いという印象を持つことがよくあります。現実はより複雑です。各プラットフォームには異なる制限の哲学があり、実際の違いは特定のユースケースに大きく依存します。

Midjourneyはより現実的な人物被写体を含む、Geminiよりも柔軟な人物画像を許可していますが、実名の実在人物と露骨なコンテンツについては独自の制限を適用しています。架空のキャラクターをリアルなスタイルで生成する場合、Midjourneyは現在のポリシーの下でGeminiよりも一般的に能力が高いです。ただし、Midjourneyは主にDiscordを通じて運用されており、APIの能力も限定的で、プログラム的な統合には適していません。イラストおよびアーティスティックなスタイル——正当なクリエイティブユースケースの大部分を占める——については、Gemini Flash Image対DALL-EおよびFluxの比較が示すように、低コストで競争力のある品質を発揮しています。

DALL-E 3(OpenAIのAPIまたはChatGPT経由でアクセス)も、OpenAIのアプローチが広範なフォトリアルな人物制限よりも特定の有害なカテゴリーに焦点を当てているため、架空のリアルな人物画像についてGeminiよりも柔軟です。DALL-Eの実在人物と有名人に対する制限はGeminiと同等ですが、架空のリアルな人物に対する閾値はより高くなっています。トレードオフはコストです。DALL-E 3のAPIアクセスはGeminiのオプションと比べて1枚あたりのコストが大幅に高くなっています。

正直な比較として、フォトリアルな架空の人物キャラクターと非有名人のフォトリアルな肖像を特に必要とするユースケースに対して、Geminiは現在主要プラットフォームの中で最も制限的です。アーティスティック、イラスト、様式化された人物画像——正当なクリエイティブアプリケーションの大多数をカバーする——については、GeminiはAI品質とコスト許容度の両面で代替ツールと競争力があります。問題はどのプラットフォームが制限がないか(すべてのプラットフォームに制限があります)ではなく、どのプラットフォームの制限プロファイルがあなたの特定の正当なユースケースに最もよく合致するかです。

よくある質問 — Gemini人物制限についての一般的な質問

自分の顔の写真をGeminiで生成できますか?

いいえ。自分の写真をアップロードしてGeminiにバリエーションを生成させたり、異なる背景を追加させたり、画像の外見を変更させたりすることは「識別可能な実在人物」の制限の対象となります。本人の完全な同意があっても、現在のポリシーには自撮り肖像の免除はありません。これはプロフィール写真のユースケースに不満を抱かせる既知の制限です。

政治家や歴史的指導者の画像を生成できますか?

歴史的人物(故人)の明らかに非フォトリアルなアーティスティックスタイルは成功することがよくあります。現役の政治的人物は公人制限の下で拒否されます。「歴史的人物」と「現役の公人として扱われるほど最近の人物」の境界線は正確に文書化されていませんが、実用的なルールとして、複数の十年にわたって故人となっている人物の明確にアーティスティックなスタイルは機能することが多いです。存命の、または最近亡くなった政治的人物は機能しません。

実在人物に似たAI生成キャラクターにも制限は適用されますか?

制限は、実在の個人を描写していると解釈されるフォトリアルな画像をターゲットにしており、偶然の類似性を対象としていません。その人への参照なしに特徴的な用語で説明された、実在人物と偶然物理的特徴を共有する架空のキャラクターは、一般的に架空として扱われます。特定の名前付き個人に似るよう特別に説明されたキャラクター——「[有名人]に似たキャラクターを作って」——は拒否されます。

APIアクセスはより許容的な人物生成をアンロックしますか?

いいえ。コアな制限はモデルレベルであり、APIレベルではなく、すべてのアクセスティアに適用されます。APIアクセスは創作的な架空の文脈に対してわずかに高い精度を提供しますが、フォトリアルな実在人物、有名人、または制限されたコンテンツカテゴリーの生成を可能にしません。

Nano Banana 2がこれらの制限の最終バージョンですか?

Googleの画像ポリシーは2024年以来継続的に進化しており、それが永続的に安定したと期待する理由はありません。Nano Banana 2は2026年3月現在の状態を表しています。将来のモデルアップデートは制限をどちらの方向にも精緻化する可能性があります。正当なクリエイティブユースケースのためのエッジケースを緩和したり、新しい悪用パターンに対応して厳格化したりする可能性があります。GoogleのAIポリシーアナウンスメントをフォローすることが、最新情報を得る最も信頼できる方法です。

アバターやプロフィール画像の生成にGeminiを使用できますか?

明確に非フォトリアルなスタイル——イラスト、カートゥーン、アニメ、またはそれに類したもの——でのアバター生成は一般的に成功します。フォトリアルなアバター生成は現在のポリシーの下でブロックされます。プロフィール画像のユースケースでは、イラストや芸術的なスタイルを明示的にプロンプトすることで通常使用可能な結果が得られます。

GeminiAIの制限は他のAI画像ツールとどう違いますか?

Geminiの制限はフォトリアルな人物画像において、ほとんどの競合プラットフォームよりも広範で一貫して適用されています。制限は特定の機関的歴史(2024年の論争)に起因し、大規模な規制対象企業としてのGoogleの特定の法的リスクを反映しています。競合プラットフォームには有害なコンテンツに対する独自の制限がありますが、一般的に架空の被写体に対してより柔軟なリアルな人物画像を許可しています。

正当なプロンプトが拒否された場合はどうすればいいですか?

明示的なスタイル記述子(イラスト、アーティスティックな肖像、キャラクターデザイン)を追加し、キャラクターを説明する前に架空の文脈を確立し、参照ベースから特徴ベースの説明に切り替え、フォトリアルな肖像リクエストにマッピングされる語彙を避けてください。ほとんどの正当なクリエイティブな目標は、適切なプロンプトのフレーミングで現在のポリシー内で達成できます。

結論:ポリシーに逆らうのではなく、ポリシーと共に働く

Geminiの人物画像制限は、特定の文書化された歴史、具体的な法的義務、そしてGoogleのAIセーフティチームによる意図的なアーキテクチャ上の決定の産物です。それらはバグではなく、一時的なものでも、削除を待つ不便さでもありません。本物の組織的コミットメントを反映しており、範囲が縮小するというよりは精度が増す方向に向かう可能性が高いです。

ユーザーにとっての実践的な意味合いは、すべての人物画像を禁止されたものとして扱うのではなく、ポリシーの実際の境界線を理解することが最も生産的なアプローチだということです。架空のキャラクター、アーティスティックスタイル、キャラクターデザイン、群衆シーン、その他多くのクリエイティブなアプリケーションは、Geminiの現在の能力内で完全に利用可能です。制限は、正当なクリエイティブユースケースの小さな断片を代表するフォトリアリズムと実在人物のアイデンティティの特定の組み合わせをターゲットにしています。このフレームワーク内で適切なプロンプト戦略を使用することで、ほとんどの人物画像ニーズを満たすことができます。

アプリケーションを構築する開発者にとっての重要なポイントは、APIアクセスはモデルレベルの制限を回避しないが、架空の文脈が明確に確立されたクリエイティブなアプリケーションにとってより精度の高い調整された環境を提供するということです。プロンプトごとのフレーミングに依存するのではなく、そのコンテキストをアプリケーションのアーキテクチャに組み込むことで、より一貫した結果とより良いユーザーエクスペリエンスが得られます。

2024年の事件とその後の経緯は、AIが生成した人物画像の中でのGoogleの人物表現に対する考え方を、おそらく永続的に再形成しました。しかし、そのプロセスから生まれたポリシーは、それに先行した大ざっぱな一時停止よりも思慮深く、より具体的にターゲットが絞られています。制限の歴史と現在の状態の両方を理解することが、2026年にGeminiの画像生成機能を効果的に構築するための基礎です。