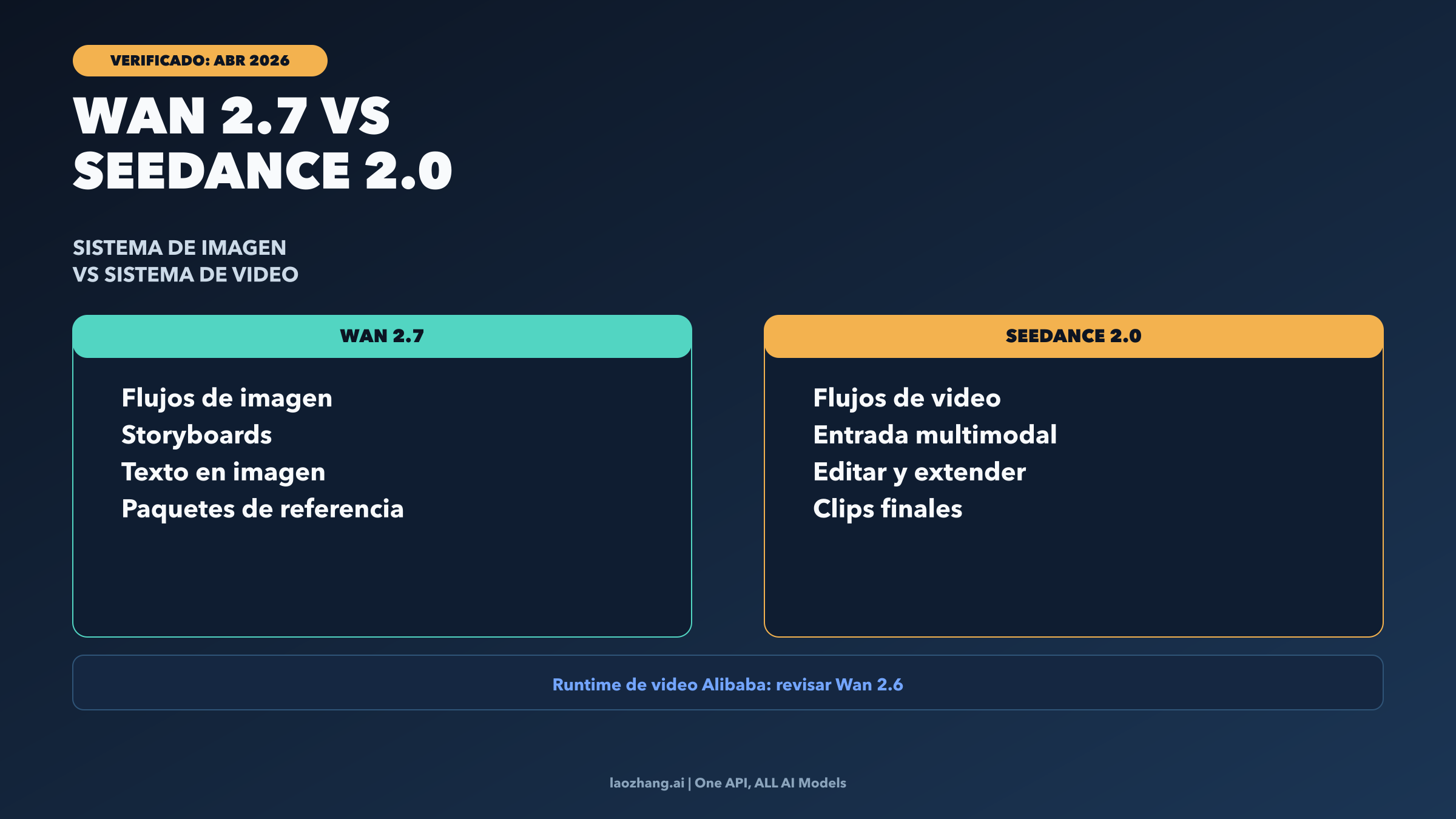

Wan 2.7 y Seedance 2.0 no son hoy una pareja oficial realmente equivalente. Wan 2.7 es el lanzamiento image-first de Alibaba. Seedance 2.0 es el sistema audiovisual multimodal de ByteDance. Si necesitas storyboards, paquetes de referencias, visuales estáticos con mucho texto o la fase upstream de ideación visual, deberías empezar por Wan 2.7. Si necesitas la generación final del video, edición o extensión, deberías empezar por Seedance 2.0. Y si lo que en realidad quieres preguntar es "el stack oficial de video actual de Alibaba frente a Seedance 2.0", la comparación correcta hoy es Wan 2.6 video frente a Seedance 2.0 beta.

Todos los datos sensibles a la actualidad que aparecen abajo se volvieron a verificar el 2 de abril de 2026 contra documentación oficial de Alibaba Cloud, ByteDance Seed y Volcengine. En este tema el error más común no es un número viejo, sino mezclar capas de producto distintas dentro de una sola comparación falsa.

TL;DR

| Tu deliverable real | Qué conviene elegir primero | Por qué | Principal matiz |

|---|---|---|---|

| Storyboards, paquetes de referencias, imágenes estáticas con mucho texto, ideación visual upstream | Wan 2.7 | El Wan 2.7 oficial se presenta hoy como un producto image-first, fuerte en texto largo, múltiples referencias y control sobre stills | No debe leerse como si fuera el mismo contrato que el runtime publico de video de Alibaba |

| Generación final de video, edición y extensión | Seedance 2.0 | La documentación oficial actual coloca a Seedance 2.0 claramente en la capa de video, con inputs de text, image, video y audio | El acceso por API sigue con límite de enterprise beta, no es un self-serve universal |

| Quieres la comparación más clara de runtime y API | Wan 2.6 video vs Seedance 2.0 beta | Los docs públicos de Alibaba explican hoy con más claridad los precios y reglas de runtime de Wan 2.6 video | Ya no es la misma pregunta que Wan 2.7 image frente a Seedance 2.0 |

| Quieres un pipeline de ideación a clip final | Usar ambos | Wan 2.7 encaja mejor upstream para keyframes y style packs; Seedance 2.0 encaja mejor downstream para el clip final | Tienes que diseñar bien el handoff |

Por qué Wan 2.7 y Seedance 2.0 no forman un benchmark limpio uno a uno

Lo primero es fijar la realidad. En el material oficial público actual, estos productos viven en capas de salida distintas. El comunicado de Alibaba de abril de 2026 presenta Wan2.7-Image y Wan2.7-Image-Pro como lanzamientos de generación y edición de imágenes. Ahí se subrayan el renderizado de texto largo, la generación personalizada, hasta nueve reference images, hasta doce imágenes por tanda y la salida 4K de Wan2.7-Image-Pro. Esa es una historia de workflow de imagen.

El lanzamiento oficial de Seedance 2.0 y el tutorial actual de Volcengine hablan de otra cosa: un modelo de video multimodal que acepta text, image, video y audio, genera clips de 4 a 15 segundos y cubre tareas como edición o extensión. Esa es una historia de workflow de video.

¿Por qué persiste la confusión? Porque Wan ya funciona como una marca que cubre más de una generación y más de un surface. El comunicado de Alibaba dice que Wan 2.7 se puede usar vía Model Studio y wan.video, pero la página pública de modelos de Alibaba Model Studio sigue describiendo el runtime de video más claro bajo la familia Wan 2.6, no bajo una familia Wan 2.7 video bien documentada. Así, muchas páginas que comparan "Wan 2.7 vs Seedance 2.0" en realidad mezclan un image release actual con un video system actual y luego piden un ganador único.

En la práctica, el orden correcto es el inverso. Primero hay que preguntar si tu deliverable es una imagen estática o un clip final. Si tu salida es un asset estático, estás eligiendo una image layer. Si tu salida es el video final, estás eligiendo una video layer. Hasta que no hagas esa separación, la comparación no sirve demasiado.

Dónde gana Wan 2.7

Wan 2.7 gana cuando tu trabajo real es controlar la imagen estática, no producir el video final. Los materiales oficiales de Alibaba apuntan justo a ese tipo de tareas: visuales con mucho texto, generación multiimagen tipo storyboard, stills comerciales con control de color y marca, y edición de imagen.

En el contrato público actual de Wan 2.7 hay tres datos especialmente útiles. Primero, Alibaba indica soporte para hasta 3.000 text tokens, algo muy relevante para pósters, creatividades publicitarias y cualquier escena donde el texto dentro de la imagen importa de verdad. Segundo, admite hasta 9 reference images y puede generar hasta 12 imágenes a la vez. Eso lo vuelve especialmente útil para storyboard boards, style packs, exploración de escenas de producto y campañas visuales. Tercero, Wan2.7-Image-Pro ofrece output 4K, lo que ayuda en revisión de diseño, detalle e-commerce y recorte posterior.

Por eso Wan 2.7 encaja mejor upstream dentro de un pipeline de contenido. Si estás decidiendo composición, fijando identidad visual, probando typography o preparando las still references que luego alimentarán el trabajo de video, Wan 2.7 es una opción más honesta que Seedance 2.0. Seedance puede aceptar referencias de imagen, sí, pero su contrato público actual gira alrededor de convertir inputs multimodales en video. Cuando el asset en sí sigue siendo la imagen, lo lógico es quedarse más tiempo en Wan 2.7.

Esto también importa si tu equipo todavía no sabe cómo debe verse el video final. Un reference pack fuerte reduce iteraciones caras de video. Si tu cuello de botella sigue estando en el frame y no en el motion, conviene resolver eso primero. Si quieres una mirada más amplia a esa capa upstream, nuestro guía de mejores modelos de imagen IA es un mejor siguiente paso.

Dónde gana Seedance 2.0

Seedance 2.0 gana cuando el deliverable es el video en sí. El tutorial actual de Volcengine ya deja bastante clara la forma del runtime. El contrato beta de Seedance 2.0 admite text más hasta 9 imágenes, 3 videos y 3 audios en una sola solicitud; permite salidas de 4 a 15 segundos en 480p o 720p; y cubre no solo generación sino también tareas tipo edición y extensión.

La clave no es simplemente que "acepte referencias". La clave es que esas referencias viven dentro de un workflow nativo de video. Puedes controlar motion, rhythm, scene continuation y audio-aware generation desde el principio, en lugar de empujar un producto centrado en imagen a cumplir un papel de video que no es su eje público. Si tu criterio es "¿puedo dar varias imágenes, guía de movimiento y guía de audio, y sacar un clip usable?", Seedance 2.0 está más cerca del problema real.

La frontera de acceso sigue importando. La documentación actual de Volcengine sitúa a Seedance 2.0 y Seedance 2.0 Fast en un public beta para enterprise users, no en un runtime global sin fricción. Es una limitación importante, pero no cambia el tipo de producto. Lo que significa es que, si tu tarea es final video work, Seedance 2.0 sigue siendo el modelo más correcto de esta pareja, solo que con una frontera de rollout que hay que aceptar.

Así que si tu pregunta de partida es "necesito el clip final" y no "necesito mejores referencias estáticas upstream", Seedance 2.0 es la respuesta más directa. Si quieres mirar este tema como parte de un shortlist más amplio del mercado creator, conviene más leer nuestra guía de mejores herramientas image-to-video.

Si te importa la claridad de runtime y API, compara Wan 2.6 video con Seedance 2.0 beta

Para un buyer técnico la pregunta no es solo qué suena más fuerte, sino qué está documentado oficialmente, tiene precio legible, se puede soportar y se puede integrar hoy. En esa capa, la comparación correcta no es Wan 2.7 image frente a Seedance 2.0, sino Wan 2.6 video frente a Seedance 2.0 beta.

Los docs públicos de Alibaba son hoy más claros del lado del runtime contract. Exponen familias como wan2.6-t2v y wan2.6-i2v-flash, y muestran precios por segundo. En el contrato US que verifiqué el 2 de abril de 2026, wan2.6-t2v-us aparece con $0.10 por segundo en 720p y $0.15 por segundo en 1080p. wan2.6-i2v-flash incluso distingue precios con audio y sin audio. Ese nivel de claridad pública es útil por sí mismo.

El contrato oficial actual de Seedance 2.0 cuenta otra historia. La tutorial page ya muestra model IDs reales, rangos de salida y límites multimodales, lo cual mejora mucho el viejo relato de "solo consola". Pero la pricing page sigue leyéndose mejor como ejemplos por escenario que como un único sticker price. Los ejemplos oficiales actuales muestran que un clip 16:9 de 5 segundos en 480p cuesta 2.31 RMB para doubao-seedance-2.0 y 1.86 RMB para doubao-seedance-2.0-fast; y el mismo clip 16:9 de 5 segundos en 720p cuesta 4.97 RMB y 4.00 RMB respectivamente. Es información útil, pero la superficie pública sigue siendo menos homogénea que la de Wan 2.6 video en Alibaba.

Por eso la regla de routing es simple. Si priorizas public runtime clarity, contract readability y una tabla de precios clara, hoy es más fácil razonar desde el lado de video de Alibaba, pero bajo el nombre Wan 2.6 video, no Wan 2.7 image. Si priorizas multimodal video semantics, editability y el atractivo del video system, Seedance 2.0 es más interesante, pero tendrás que aceptar la frontera de enterprise beta y una pricing surface menos uniforme.

Si quieres una visión más amplia de qué public video APIs son realmente más fáciles de adoptar hoy, nuestro guía de mejores free AI video APIs resulta más útil que cualquier showdown de vendors basado en hype.

Cómo elegir por workflow y cuándo usar ambos

La respuesta más útil aquí no suele ser elegir a un único ganador, sino asignar el owner correcto a cada etapa.

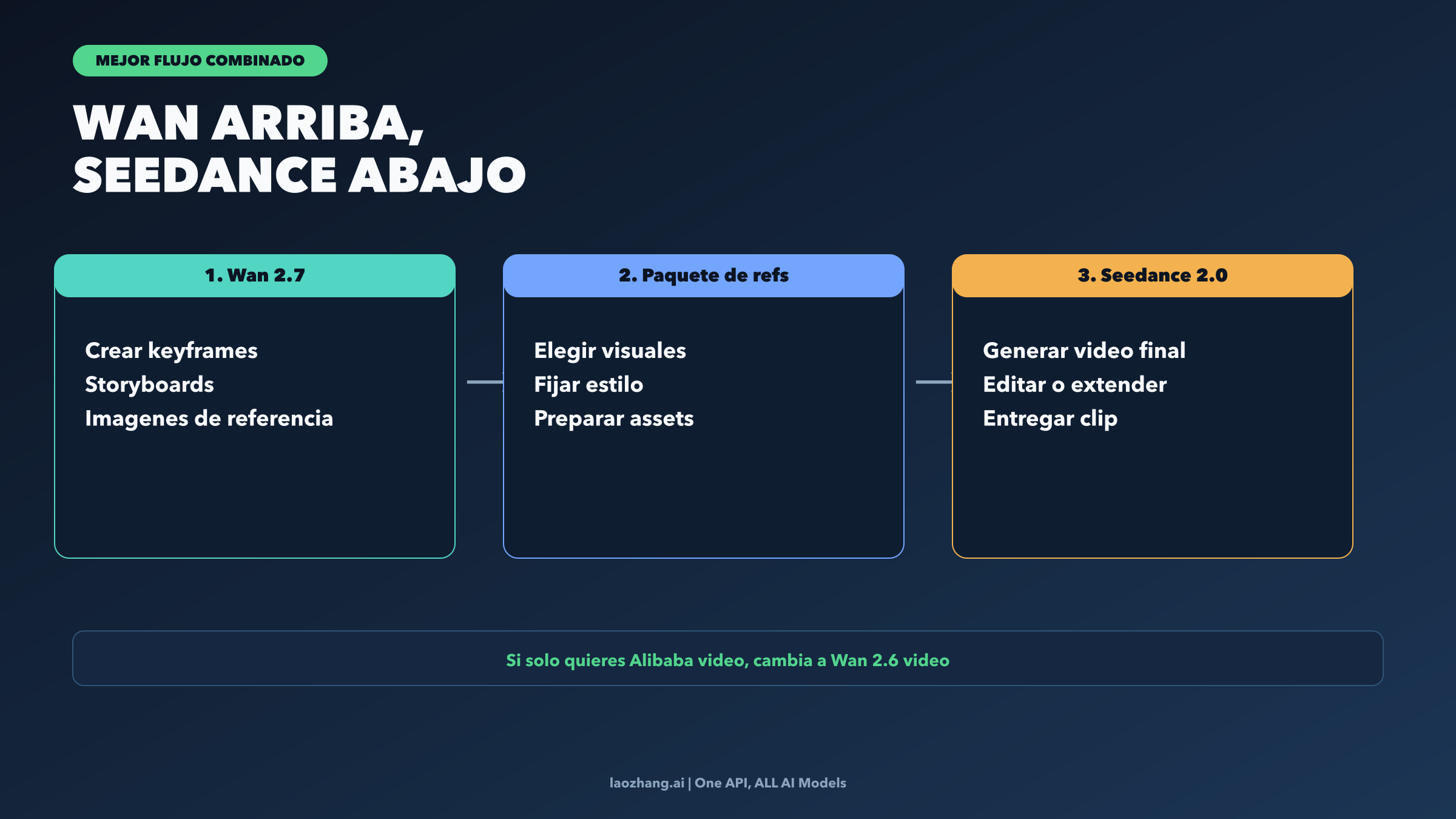

Si eres un equipo de marca o creativo, en la fase temprana suele ser más difícil decidir el look que el motion. Ahí tiene sentido poner Wan 2.7 upstream: hero stills, storyboard panels, composiciones de producto, visuales con mucho texto y el reference pack que después alineará al resto del equipo. Una vez fijada esa dirección, tiene sentido poner Seedance 2.0 downstream para convertir ese lenguaje visual en video en movimiento.

Si eres un buyer técnico, conviene dividir la pregunta en dos. Para image generation y still assets de alto control, Wan 2.7. Para comparación de runtime público de video, Wan 2.6 video y Seedance 2.0 beta. Para generación final de video, Seedance 2.0. Suena más complejo que un veredicto de una línea, pero engaña mucho menos.

Si eres un creator individual o un performance marketer, la decisión puede ser más rápida. Si necesitas keyframes, conceptos visuales o un reference set limpio antes del motion, usa Wan 2.7. Si el shot ya está claro y lo que quieres es el clip corto final, usa Seedance 2.0. Si tu workflow atraviesa ambas capas, usa ambos y no intentes forzar a un solo modelo a cubrir dos trabajos distintos.

Ahí está la principal ganancia informativa del artículo: la mejor respuesta suele ser pipeline-shaped, no winner-shaped. Para muchos equipos, el flujo óptimo es Wan 2.7 para ideation y reference control, y Seedance 2.0 para final clip generation, extension o edit-style work. Solo tiene sentido forzar una respuesta monomodelo si tu equipo vive de verdad en una sola capa.

Preguntas frecuentes

¿Wan 2.7 es mejor que Seedance 2.0?

No como afirmación universal. Wan 2.7 es mejor para trabajo centrado en imagen, como storyboards, reference packs y visuales estáticos con mucho texto. Seedance 2.0 es mejor para generación final de video multimodal, edición y extensión. "Mejor" solo tiene sentido cuando se acota la fase del workflow.

¿Wan 2.7 también genera video?

El lanzamiento oficial de Wan 2.7 en abril de 2026 es image-first, y el runtime público de video más claro en Alibaba Model Studio sigue siendo la familia Wan 2.6. Por eso, hoy "Wan 2.7 video" no es el contrato público más limpio para compararlo con Seedance 2.0. Si lo que te importa es el deployable video stack de Alibaba, conviene mirar Wan 2.6 video.

¿Qué importa más para un buyer de API y runtime?

Si tu prioridad es la claridad del contrato público, Wan 2.6 video es más fácil de evaluar porque las familias de modelos y el precio por segundo están mejor escritos. Si te importa más la capacidad de video multimodal y la semántica de edición, Seedance 2.0 es más atractivo, pero su acceso oficial sigue dentro de enterprise beta.

¿Cuándo tiene más sentido usar ambos?

Cuando el workflow empieza con planning visual y termina en un clip final. Primero generas still references, keyframes y dirección visual con Wan 2.7, y luego pasas esa base aprobada a Seedance 2.0 para video generation, extension o edición.