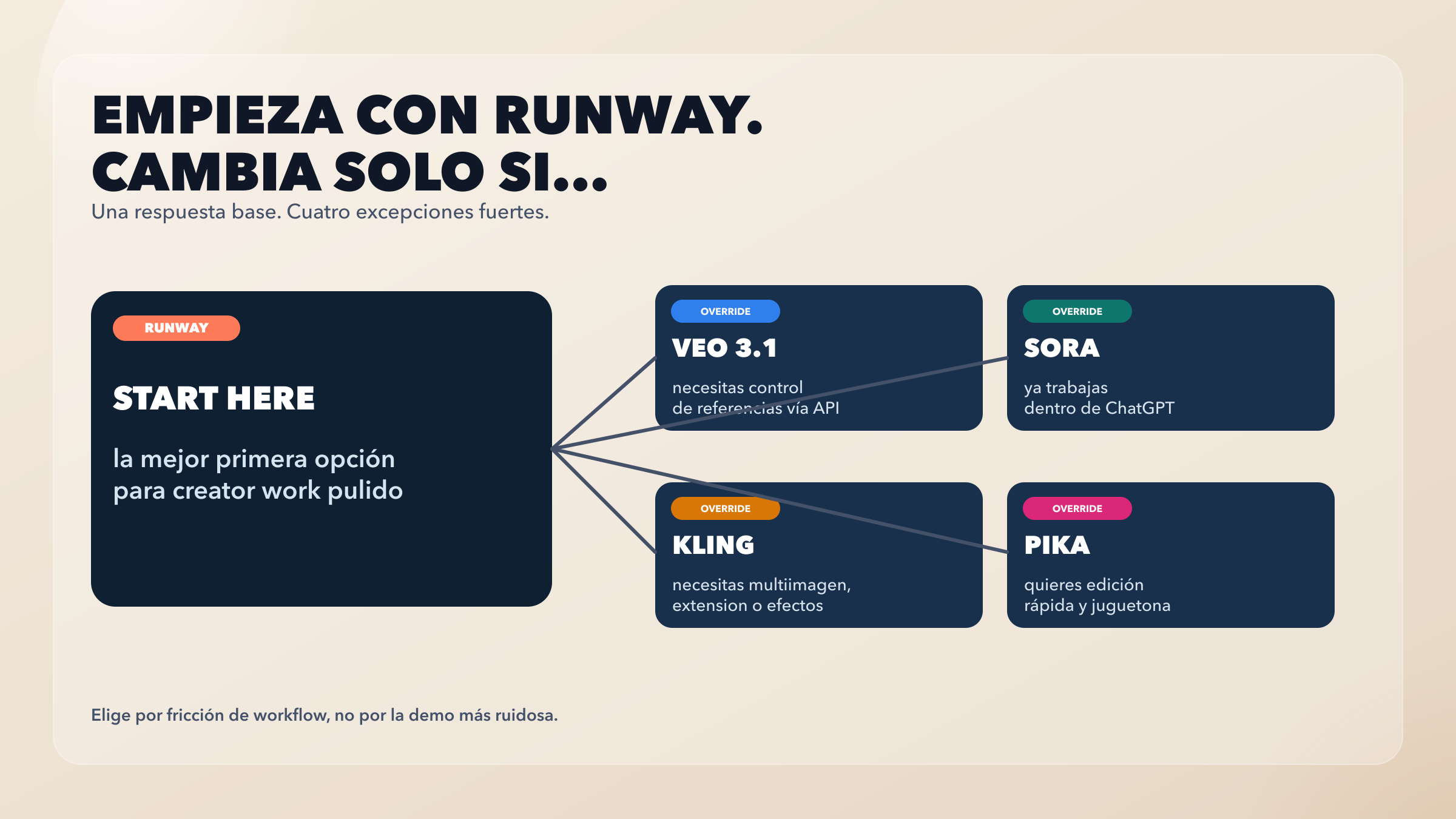

Si en 2026 solo fueras a abrir una IA de imagen a video, empieza por Runway. Para la mayoría de la gente sigue siendo la respuesta más segura por defecto, porque no te obliga a entrar desde el primer minuto en una lógica de API, no depende tanto de un acceso condicionado por país y tampoco te empuja a una herramienta que se sienta más como un playground de efectos que como un flujo serio de creación. Cuando tu trabajo real es otro, entonces sí conviene cambiar. La regla es bastante clara: Veo 3.1 cuando lo importante es el control de referencias y el uso vía API, Sora cuando ya vives dentro de ChatGPT y quieres un flujo storyboard-first, Kling cuando necesitas multiimagen, extensión, lip-sync o efectos, y Pika cuando tu prioridad es hacer pruebas rápidas, ligeras y con poca fricción.

Esto importa porque elegir una IA de imagen a video no es lo mismo que preguntar por “el mejor modelo de video” en abstracto. En cuanto la imagen fija ya existe, gana menos quien tiene el demo más vistoso y más quien sabe respetar esa imagen, darte el tipo de control de movimiento que necesitas y no atascarte con el plan o la forma de acceso equivocada.

Todos los hechos sensibles a la fecha que aparecen abajo se volvieron a comprobar con documentación oficial el 28 de marzo de 2026.

TL;DR

| Si tu trabajo real es este | Mejor elección | Por qué gana | Principal coste |

|---|---|---|---|

| Quieres la mejor respuesta por defecto para la mayoría | Runway | Es la combinación más equilibrada de flujo de trabajo, producto maduro y camino de pago legible | El acceso gratis se parece más a una prueba de una sola vez que a una capa gratis duradera |

| Quieres control serio sobre producto, personaje o referencias | Veo 3.1 | La documentación oficial admite hasta tres imágenes de referencia y audio nativo | Referencias, 1080p y 4K te fijan en 8 segundos |

| Ya trabajas dentro de ChatGPT y el storyboard es central | Sora | OpenAI estructura el flujo alrededor de subir una imagen y editar storyboards | Sora App y Sora 2 siguen limitados a países compatibles |

| Necesitas multiimagen, extensión, lip-sync o efectos | Kling | La superficie oficial de capacidades de Kling 3.0 es muy amplia | Su historia pública de precios y acceso es menos clara que la de Runway o Pika |

| Quieres experimentos rápidos, ligeros y con efectos | Pika | El pricing es claro y sus herramientas effect-first reducen la fricción | No es el default profesional más limpio para producción seria |

Esto no es lo mismo que elegir “el mejor modelo de video”

El error más común en esta categoría es imaginar que todo el mundo está buscando un campeón universal de video. Pero la mayoría de usuarios de imagen a video no está ahí. Ya tienen algo que quieren conservar: una foto de producto, una referencia de personaje, un frame estático, una imagen para anuncio o una imagen generada que quieren animar sin perder su identidad.

Eso cambia por completo la decisión. Ya no basta con preguntar qué herramienta “se ve más cinematográfica”. También hay que preguntarse cuántas referencias acepta, si el flujo se comporta más como una app o como una capa de API, si se puede construir un storyboard a partir de la imagen, qué duración y resolución están realmente disponibles en ese modo y si el producto se siente como un workflow consistente o como una suma de funciones llamativas.

Si en realidad lo que buscas es una comparación más amplia de modelos de video, eso ya es otra pregunta. Esta página es más estrecha y más práctica: cuando la imagen fija ya está en tu mano, qué deberías abrir primero.

Las cinco herramientas que sí merece la pena poner en el shortlist

Runway es la mejor IA de imagen a video para la mayoría porque se siente como el workflow de creación más completo, no como un único endpoint brillante. Su pricing público es de lo más legible en esta categoría. Free es $0, pero lo que manda de verdad son sus 125 créditos de una sola vez, así que encaja mejor como prueba que como flujo gratis continuo. La parte fuerte llega en el camino de pago: el plan Standard empieza en $12 por editor al mes con facturación anual y la propia superficie del plan menciona Gen-4 (Image to Video). Además, la ayuda oficial de Runway describe Gen-4 References como un flujo que parte de una a tres imágenes de referencia y luego salta al último modelo de video. Para quien trabaja a partir de una imagen fija, eso es exactamente lo que importa.

Runway no ocupa el puesto por defecto porque vaya a ganar todos los concursos de calidad. Lo ocupa porque exige menos condiciones previas para volverse útil. No necesitas pensar primero como comprador de API. No necesitas vivir ya dentro de ChatGPT. No necesitas buscar ante todo un entorno de efectos. Basta con una imagen y una lógica de creación relativamente normal para empezar.

Veo 3.1 encaja mejor cuando tu tarea de imagen a video se parece más a control de producto, consistencia de personaje o flujo para desarrolladores que a una app ligera de creación. Las docs actuales del Gemini API son muy concretas aquí. Veo 3.1 acepta hasta tres imágenes de referencia, genera audio nativo y puede sacar videos de 8 segundos en 720p, 1080p o 4K. Y lo más valioso es que también deja claras las restricciones: si usas referencias, 1080p o 4K, entras sí o sí en el carril de 8 segundos.

Por eso Veo no debería venderse como el campeón universal, sino como el mejor override cuando manda el control. Si tu trabajo son product shots, activos de marca, consistencia de personajes o cualquier flujo programático donde la imagen de entrada importa tanto como la salida, Veo es más natural que Runway. Si lo que quieres es un producto más amable y más creator-first para arrancar, Runway sigue siendo el inicio más fácil.

Sora es la mejor opción de imagen a video para quien ya crea dentro de ChatGPT y prioriza storyboard frente a disponibilidad universal. El dato oficial más útil aquí no es un benchmark, sino el flujo que OpenAI explica en su help center: subir una imagen estática, dejar que Sora construya un storyboard editable o montarlo tú cuadro a cuadro. Ese enfoque creativo ya es distinto del control por referencias de Veo o Runway y también distinto del toolkit amplio de Kling.

Sora no queda como default porque no sea bueno, sino porque no es la ruta más limpia para una audiencia amplia. OpenAI también explica que Sora App y Sora 2 están limitados a un listado de países compatibles y que el uso más intensivo ya entra en la lógica de planes y créditos extra. Si ya eres un creador ChatGPT-native, puede que eso no moleste nada. Pero sí cambia la recomendación cuando intentas dar una respuesta por defecto válida para más gente.

Kling es el override correcto cuando lo que te importa es amplitud de capacidades más que pulido de producto. El propio sitio oficial enumera Image to Video, Multi-Image to Video, Video Extension, Lip Sync, Video Effects, Audio Generation y un API 3.0 plenamente disponible. Eso significa que, si tu pregunta no es “qué abro primero” sino “qué herramienta me da más formas de mover una imagen”, Kling tiene mucho sentido.

Su punto débil no está en las funciones, sino en la claridad. Es más fácil recomendarlo como carril rico en capacidades que como primera compra limpia. La cara pública de sus funciones es más clara que la historia global de precios y acceso. Y precisamente por eso entra en el shortlist pero no desplaza a Runway como respuesta por defecto.

Pika es la mejor de esta lista cuando quieres experimentación rápida y effect-first más que el workflow profesional más limpio. La página de precios de Pika es muy explícita. El plan Free incluye 80 monthly video credits, acceso a Pika 2.5 (480p only) y un coste publicado de 12 credits para una generación de 5 segundos en Text-to-Video & Image-to-Video con el modelo 2.5. También deja clara la personalidad del producto: Pikascenes, Pikadditions, Pikaswaps, Pikatwists, Pikaffects y Pikaframes. Es decir, Pika no intenta ser solo un generador cinematográfico; intenta ser una herramienta rápida para movimiento, estilo y prueba.

Eso define bien su lugar. El default para la mayoría es Runway. El carril de control fuerte es Veo. El carril ChatGPT-native es Sora. Pero si lo que quieres es mover una imagen rápido, probar efectos y mantener la barrera baja, Pika merece estar en la conversación principal.

Si aún no te convence la imagen fija de partida, el paso correcto no suele ser abrir más herramientas de video, sino mejorar primero esa imagen. Para eso ya tienes nuestra guía del mejor generador de imágenes con IA.

Cómo elegir en 60 segundos

Si quieres quedarte con una sola regla, usa esta.

Empieza por Runway salvo que puedas nombrar una razón concreta para no hacerlo. Ahora mismo es la respuesta más segura porque equilibra mejor que nadie el workflow basado en imagen, la facilidad de uso y un camino de pago relativamente legible.

Pásate a Veo 3.1 si lo más importante es controlar la imagen de partida. Producto, marca, consistencia de personajes o flujos dirigidos por API encajan mejor aquí que en una app creadora más generalista.

Pásate a Sora si ya creas dentro de ChatGPT y quieres un flujo storyboard-first. Cuanto más natural sea para ti trabajar dentro de ChatGPT, más sentido tiene Sora. Pero no es la respuesta más simple para quien entra desde cero.

Pásate a Kling si necesitas un motion toolkit más amplio alrededor de la imagen. Multiimagen, extensión, lip-sync, efectos y API hacen de Kling el mejor override para quien necesita más tipos de movimiento y más palancas creativas.

Pásate a Pika si solo quieres un camino rápido, ligero y juguetón. Si manda la velocidad de prueba y el feeling de experimento, Pika encaja muy bien.

Las restricciones ocultas que sí cambian la elección

La primera restricción importante es cómo entiende cada herramienta la imagen de partida. Veo trabaja de forma explícita con referencias. Sora la convierte en un flujo de storyboard. Kling la extiende hacia multiimagen y lógica de efectos. Pika la trata más como un punto de partida para edición effect-first. Runway queda en medio con el workflow general más equilibrado. Esa diferencia no es cosmética. Cambia cuánto sobrevive de la imagen original y cuánto esfuerzo necesitas para dirigir el resultado.

La segunda restricción importante es qué reglas de salida se aplican de verdad en el modo que te interesa. Veo 3.1 es un buen ejemplo: 1080p, 4K y referencias te encierran en 8 segundos. Si planificas duración, eso no es una nota al pie. Pika ofrece otro ejemplo: que el free sea real no significa que el contrato sea el mismo que un default profesional. Su carril gratis de imagen a video vive en 480p, lo cual puede ser perfecto para experimentar, pero no juega en la misma liga que un workflow más pulido.

La tercera restricción importante es la forma de acceso. Sora es el caso más claro. Si estás en un país compatible y ya creas dentro de ChatGPT, el flujo puede ser muy atractivo. Si no, ese solo hecho ya basta para bajarlo del puesto por defecto. Un gran workflow creativo y un acceso universalmente cómodo no son lo mismo.

La cuarta restricción importante es si realmente estás preguntando por una entrada gratis, por un workflow de pago o por una ruta de API/control. Son preguntas distintas. Si lo que te importa es el mejor punto de partida sin pagar, el artículo correcto es nuestra guía de la mejor IA gratis de imagen a video. Si ya has superado la capa gratis, entonces el siguiente paso natural es una comparación de costes más amplia, aunque este repositorio todavía no tenga ese equivalente en español para enlazarlo aquí. Esta página hace algo más simple: decidir qué abrir primero cuando la imagen fija ya existe.

Preguntas frecuentes

¿Cuál es ahora mismo la mejor IA de imagen a video por defecto?

Para la mayoría, Runway. No porque gane todos los casos especializados, sino porque combina mejor que nadie workflow basado en imagen, usabilidad y claridad del camino de pago.

¿Qué me conviene más para producto o consistencia de personaje?

Veo 3.1. La documentación de Google es explícita con las referencias y el audio nativo, así que encaja mejor cuando el control de la imagen de origen pesa más que una capa de app más amable.

¿Cambia la respuesta si ya uso ChatGPT?

Sí. Para ese perfil, Sora sube mucho. El flujo de image upload + editable storyboard que describe OpenAI encaja muy bien con un creador que ya vive dentro de ChatGPT.

¿Qué me conviene si quiero multiimagen o efectos?

Empieza por Kling. Su superficie oficial de capacidades cubre multi-image-to-video, extension, lip-sync, effects y API. Si quieres algo más ligero y rápido, entonces Pika puede encajar mejor.

¿Y si solo me importa el acceso gratis?

Entonces la pregunta ya es otra. La respuesta útil está en nuestra guía de la mejor IA gratis de imagen a video, porque allí mandan más la recarga de créditos y las restricciones de descarga que esta jerarquía de workflows de pago.

¿Conviene arreglar antes la imagen fija y luego pensar en el video?

Muy a menudo, sí. Una imagen de partida floja hace que cualquier generador parezca peor de lo que es. Si ese sigue siendo el cuello de botella, primero pasa por nuestra guía del mejor generador de imágenes con IA.