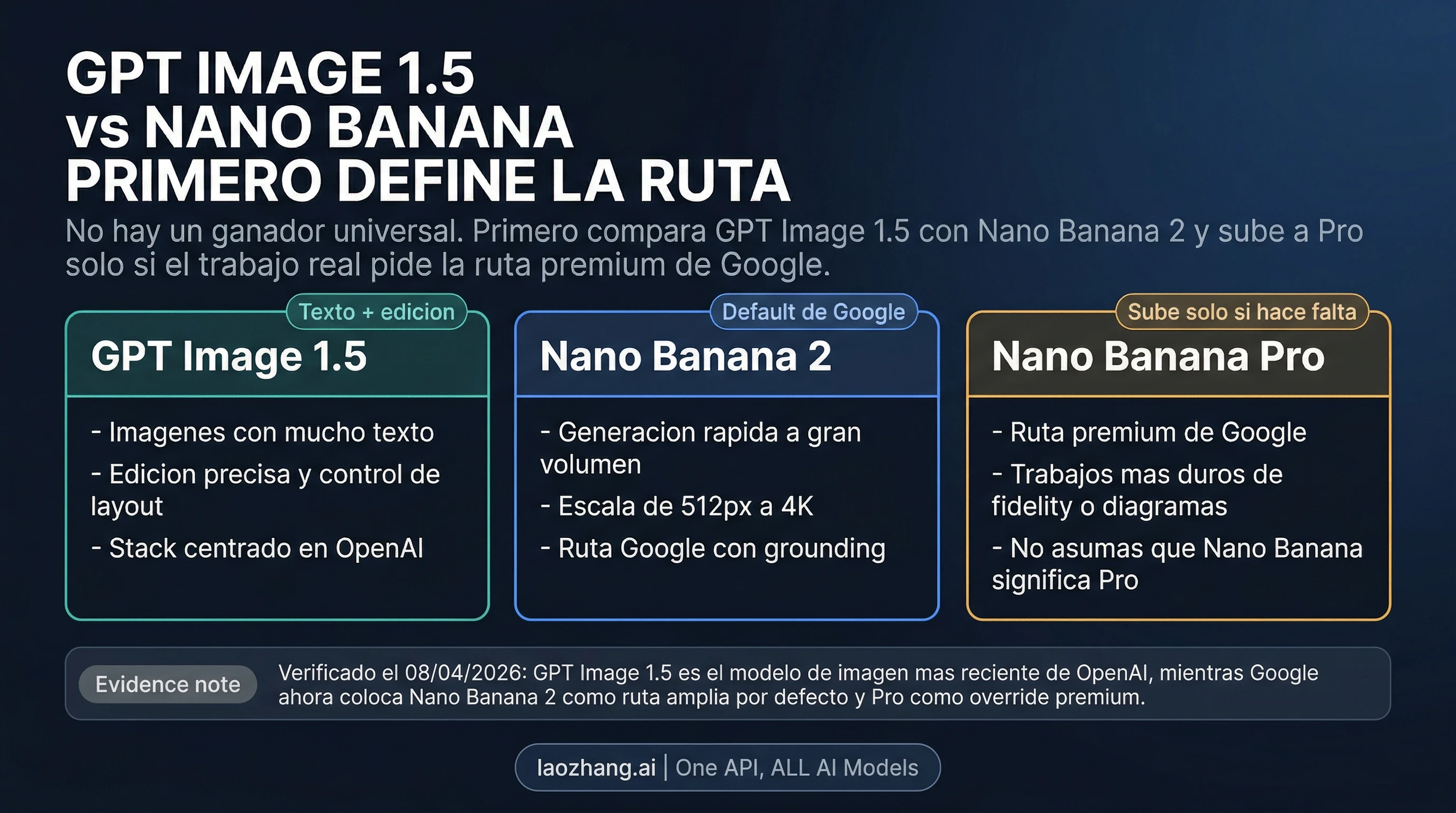

A fecha del 8 de abril de 2026, GPT Image 1.5 no es simplemente mejor que Nano Banana. Si por Nano Banana te refieres a la ruta principal de generación de imágenes que hoy empuja Google, la comparación útil por defecto es GPT Image 1.5 vs Nano Banana 2. Cuando lo caro es fallar en texto, jerarquía visual o ediciones precisas, conviene empezar por GPT Image 1.5. Cuando lo importante es la ruta estándar de Google y una escalera más amplia que va de 0.5K a 4K, conviene empezar por Nano Banana 2. Nano Banana Pro sigue importando, pero más como premium override que como significado base de Nano Banana.

Ahí es donde todavía fallan muchas páginas comparativas. Mezclan un nombre de familia, una elección de surface y una diferencia de tier en un solo tablero de “ganador”. La documentación actual de Gemini, la página de precios y los materiales de lanzamiento de Nano Banana 2 cuentan otra historia: Nano Banana 2 es la lane más amplia y más default; Pro queda como upgrade más caro para trabajo visual más exigente. Del lado de OpenAI, gpt-image-1.5 aparece como la image-generation model actual con niveles low, medium, high y tres tamaños documentados. El problema real, entonces, no es elegir un campeón abstracto, sino elegir la ruta correcta para empezar.

Respuesta rápida

| Tu trabajo real | Empieza aquí | Por qué es el mejor primer movimiento | Cuándo deja de ser suficiente |

|---|---|---|---|

| Pósters, mockups de UI, creatividades con mucho texto, ajustes finos | GPT Image 1.5 | Cuando el costo de error está en el texto y en la edición controlada, GPT es más seguro | Cuando la necesidad principal pasa a ser la ruta de Google o tamaños más grandes |

| Generación general del lado de Google, iteración rápida, trabajo API con varios tamaños | Nano Banana 2 | Es la ruta default actual de Google y tiene una escalera de tamaños más amplia | Cuando el trabajo ya pide infografías, diagramas o un premium final pass |

| Infografías, diagramas o acabado premium del lado de Google | Nano Banana Pro | Es la premium Google lane para trabajo visual más exigente | Si Nano Banana 2 ya resuelve el trabajo, suele ser sobrecoste |

Ya tienes el workflow de imágenes centrado en OpenAI y no necesitas 2K / 4K | GPT Image 1.5 | Mantienes SDK, facturación y operación en una sola pila | Cuando la necesidad real pasa a ser la ruta estándar de Google |

Ni siquiera está claro a quién llamas Nano Banana | Primero corrígelo hacia Nano Banana 2 | Así alineas la pregunta con la realidad actual de Google | Si el trabajo ya es premium Google desde el principio, el rival real es Pro |

La versión corta es esta: para texto y edición precisa, GPT Image 1.5; para la ruta general de Google y una escalera de tamaños más amplia, Nano Banana 2; para trabajo premium de Google, recién ahí Nano Banana Pro.

Qué significa Nano Banana en esta comparación

El problema con la consulta original es que hoy Nano Banana ya no es un compare target estable. Puede apuntar a tres cosas diferentes:

- al family name de los modelos de imagen de Google;

- a la ruta principal actual, es decir Nano Banana 2;

- a la ruta premium, es decir Nano Banana Pro.

Por eso esta página hace una corrección rápida antes de empezar a comparar. En la mayoría de los casos, el compare target correcto del lado de Google es Nano Banana 2. Si tu trabajo realmente exige la premium lane de Google, entonces la pregunta cambia: ya no estás comparando GPT Image 1.5 con la ruta por defecto, sino con Pro.

Este artículo no pretende sustituir nuestra guía general de Nano Banana, ni duplicar el comparativo Nano Banana Pro vs Nano Banana 2, que resuelve una decisión interna de Google. Su función es más estrecha y más práctica: decirte con quién debe compararse primero GPT Image 1.5 en el lado de Google hoy.

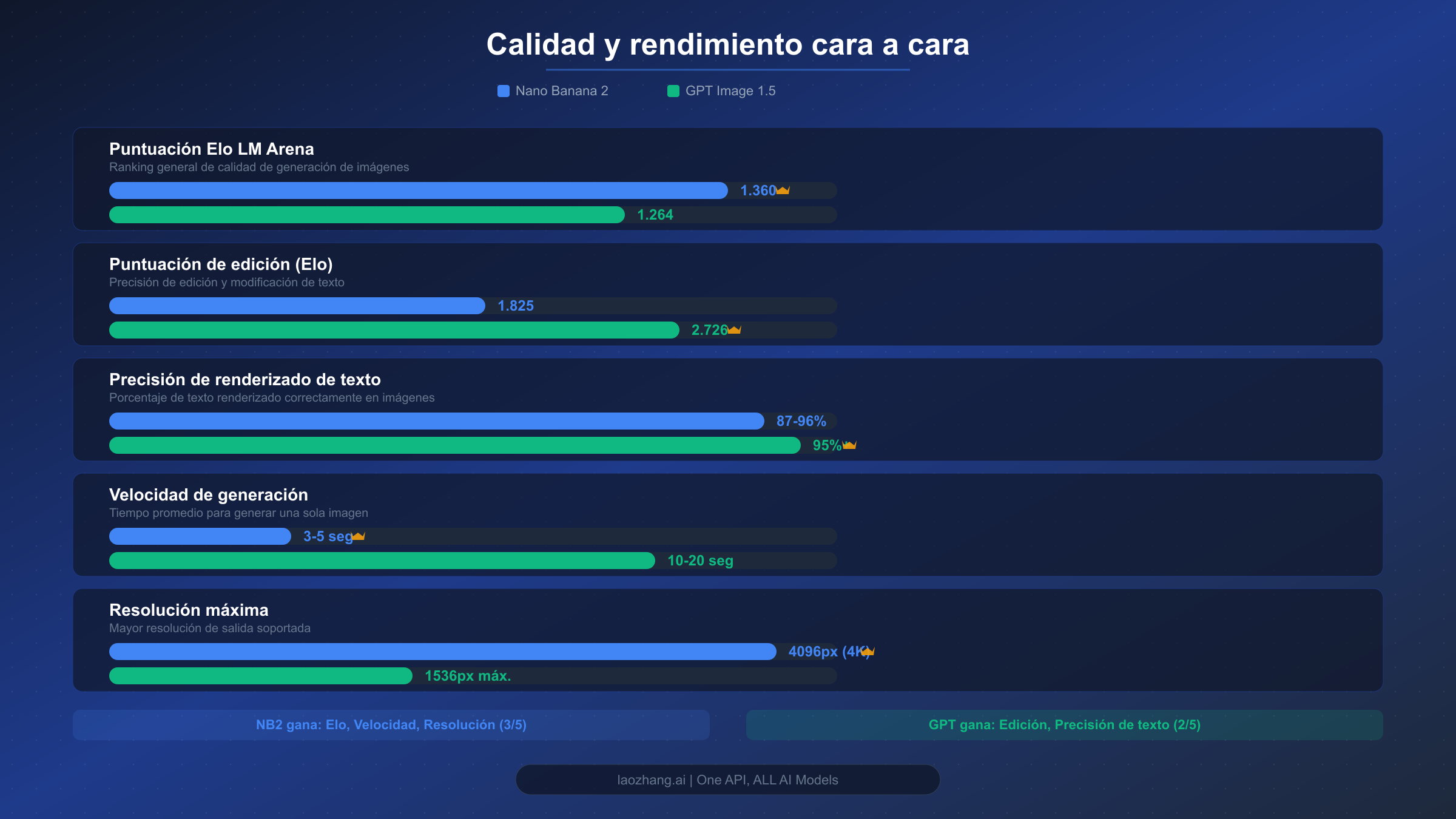

Cuándo conviene empezar por GPT Image 1.5

Si en la imagen importan el texto, las etiquetas, la jerarquía, la legibilidad o las ediciones precisas, GPT Image 1.5 suele ser la apuesta inicial más segura. OpenAI documenta hoy gpt-image-1.5 con tres tamaños — 1024x1024, 1536x1024, 1024x1536 — y niveles de calidad low, medium, high. La libertad de tamaños es menor que en Google, pero el contrato es más claro.

Eso importa porque el trabajo text-heavy falla de otra manera. En una ilustración general, un estilo algo distinto todavía puede servir. En un póster, un mockup, una tarjeta con labels o una pieza con copy, si el texto sale mal o la edición no responde, el activo deja de ser útil. Para ese tipo de trabajo, GPT Image 1.5 suele ser el mejor primer paso.

Además tiene un tramo de precio claramente competitivo. En la página actual de OpenAI, el formato cuadrado cuesta $0.009 / $0.034 / $0.133 y los formatos rectangulares $0.013 / $0.05 / $0.2. Si tu trabajo vive en tamaños web estándar y puedes moverte con low o medium, GPT Image 1.5 entra con un costo oficial muy difícil de ignorar.

Por qué Nano Banana 2 sigue siendo la respuesta por defecto del lado de Google

Cuando la pregunta real no es “quién gana en abstracto”, sino “con qué conviene arrancar dentro de Google”, la respuesta se mueve hacia Nano Banana 2. Google presenta gemini-3.1-flash-image-preview como una image lane más barata, más eficiente y mejor pensada para high volume, y la escalera de precios actual es clara: $0.045 / 0.5K, $0.067 / 1K, $0.101 / 2K, $0.151 / 4K. Lo importante no es solo el sticker price, sino que funciona como ruta continua.

Si necesitas 2K o 4K, si quieres permanecer dentro del stack de Google y si valoras poder moverte desde borradores baratos hasta tamaños grandes dentro de la misma familia, Nano Banana 2 encaja mejor como punto de partida. Saltar de entrada a Pro cambia el problema. Nano Banana 2 es la default lane; Pro es la upgrade lane.

Cuándo el comparativo real pasa a ser Nano Banana Pro

Nano Banana Pro solo debe entrar cuando puedes nombrar la razón de escalado. Los materiales actuales de Google colocan Pro alrededor de trabajo visual más exigente — infografías, diagramas y premium final pass — y el developer pricing lo separa como una banda más cara: $0.134 para 1K/2K y $0.24 para 4K.

En ese punto, la pregunta ya no es “GPT vs la ruta estándar de Google”, sino “¿prefiero la ruta de OpenAI centrada en texto y edición, o necesito la premium lane de Google?”. Si ese ya es tu caso, tiene más sentido ir directo a Nano Banana Pro vs Nano Banana 2, porque el foco cambia.

Precio y tamaños de salida: dónde se mueve de verdad la línea de costo

La comparación de precio más honesta no pregunta “quién es más barato siempre”, sino quién es más barato y más lógico dentro del rango de salida que realmente necesitas.

La foto oficial al 8 de abril de 2026 se puede leer así:

| Ruta | Señal de precio | Qué significa en la práctica |

|---|---|---|

| GPT Image 1.5 | 1024x1024 por $0.009 / $0.034 / $0.133; rectangulares por $0.013 / $0.05 / $0.2 | Entrada muy competitiva para trabajo text/edit-heavy en tamaños estándar |

| Nano Banana 2 | $0.045 / 0.5K, $0.067 / 1K, $0.101 / 2K, $0.151 / 4K | Ruta default de Google con una escalera de tamaños más completa |

| Nano Banana Pro | $0.134 / 1K-2K, $0.24 / 4K | Precio de la premium Google lane |

De aquí salen dos reglas útiles. La primera: GPT Image 1.5 solo es más barato dentro de su propio contrato de tamaños. Si ya necesitas 2K o 4K, el problema es otro. La segunda: el valor de Nano Banana 2 no está en ganar siempre por precio, sino en ofrecer una ruta continua dentro de Google, desde borradores baratos hasta entregables más grandes sin cambiar de familia.

La regla de routing que le sirve a la mayoría de los equipos

Si no quieres volver a abrir el debate desde cero cada vez, basta con recordar esta regla:

Empieza por GPT Image 1.5 si la imagen tiene texto importante, si prevés ajustes precisos o si tu pipeline ya es OpenAI-first.

Empieza por Nano Banana 2 si haces generación más general, si Google es tu default operativo o si necesitas una escalera que llegue a 2K y 4K.

Sube a Nano Banana Pro solo cuando puedas explicar por qué el trabajo ya es premium: infografías, diagramas o un final pass más caro donde el salto de precio sí se justifica.

Esta regla es más útil que cualquier winner board porque responde a lo que de verdad quiere saber el lector: qué abrir primero y bajo qué señal conviene cambiar.

Qué siguen haciendo mal muchas páginas comparativas

Hay tres errores que se repiten mucho.

Error 1: tratar Nano Banana como si fuera un único nombre de modelo. Con eso desaparece la distinción más importante: Nano Banana 2 vs Pro.

Error 2: presentar Pro como si fuera la respuesta default de Google. Eso empuja al lector a una ruta más cara y más estrecha antes de saber si la necesita.

Error 3: convertir todo el artículo en benchmark theater. Los rankings pueden aportar contexto, pero la mayoría de los lectores no necesita un podio: necesita saber con qué ruta empezar y qué señal justifica el cambio.

Si una página no resuelve eso en el primer minuto, normalmente no responde la pregunta real.

FAQ

¿GPT Image 1.5 es mejor que Nano Banana?

No de forma universal. Si Nano Banana significa la ruta principal actual de Google, la comparación útil por defecto es GPT Image 1.5 vs Nano Banana 2. GPT gana cuando pesan el texto y la edición precisa; Nano Banana 2 gana como ruta general de Google; Pro solo entra cuando el trabajo ya es premium Google.

¿Aquí Nano Banana significa Nano Banana 2 o Pro?

Primero significa Nano Banana 2. Solo conviene cambiar el compare target a Nano Banana Pro cuando el trabajo ya es de infografías, diagramas o premium final pass.

¿Cuál sale más barato ahora?

En tamaños estándar, GPT Image 1.5 puede salir más barato, sobre todo en low y medium. Pero si el requisito real ya es 2K o 4K, Nano Banana 2 se vuelve la ruta más natural. Pro es la opción más cara de las tres.

¿Cuándo conviene pasar de Nano Banana 2 a Pro?

Cuando puedes nombrar la razón: infografías, diagramas o un final pass premium donde Nano Banana 2 ya no alcanza. Si todavía no puedes explicar esa razón, normalmente aún no hace falta subir.

¿Cuándo GPT Image 1.5 es la opción más segura?

Cuando el costo de error está en el texto, en la edición fina y en la consistencia del layout, y además tu workflow ya vive dentro de OpenAI.