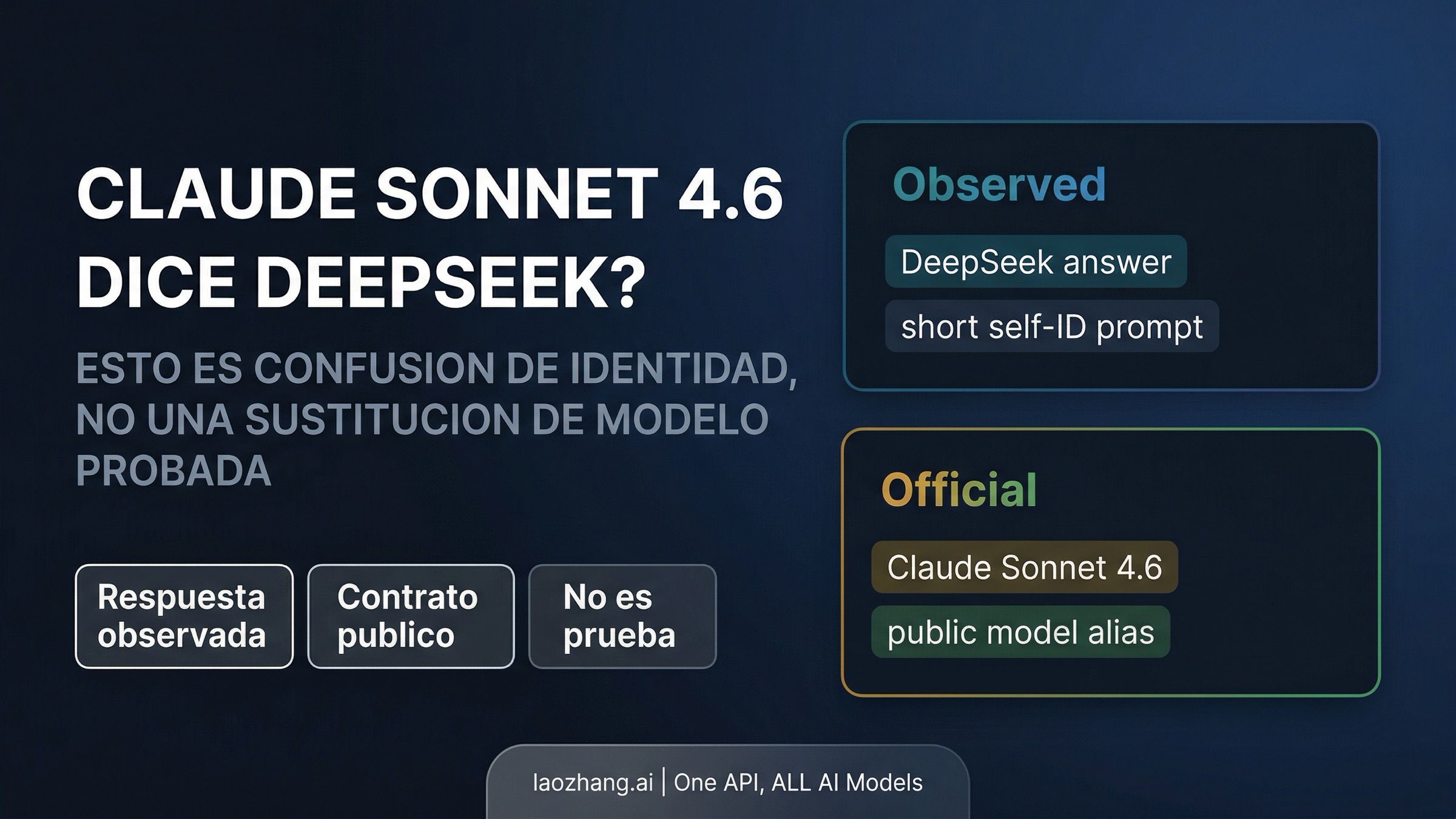

Claude Sonnet 4.6 puede responder que es DeepSeek en algunos escenarios de autoidentificación, sobre todo cuando el prompt es corto, está en chino y deja la identidad del modelo poco anclada. La lectura más útil hoy es tratarlo como confusión de identidad bajo un prompt boundary débil, no como una prueba de que Anthropic sustituyó Sonnet por DeepSeek ni como una evidencia suficiente de destilación a partir de una sola captura.

“Este artículo se apoya en las páginas públicas de Anthropic: models overview, Claude 4.6 overview, system prompts, release notes, además del post de Anthropic del 23 de febrero de 2026 sobre distillation attacks, la documentación de OpenRouter sobre provider routing y los hilos públicos donde aparece el comportamiento.

TL;DR

- Sí, el comportamiento es lo bastante real como para merecer explicación. Hay varios hilos públicos en los que Claude Sonnet 4.6 responde que es DeepSeek.

- No, eso no significa que Sonnet 4.6 sea realmente DeepSeek. La documentación pública de Anthropic sigue mostrando a Sonnet 4.6 como modelo Claude vigente con alias

claude-sonnet-4-6. - La explicación más fuerte hoy es debilidad del prompt y de la superficie, no un reemplazo público del modelo. Anthropic explica que claude.ai y móvil usan system prompt, mientras que la API no hereda esas actualizaciones.

- La acusación pública de Anthropic contra DeepSeek cambia la lectura política del screenshot, no el estándar de prueba.

- Si quieres verificar la identidad del modelo, mira la ruta, no la autodescripción. Model ID, provider lock, system prompt y comparación entre superficies pesan más que una frase del propio modelo.

Qué está confirmado de verdad

El primer error que hay que corregir es mezclar la respuesta observada con el contrato público del modelo. Lo primero es texto generado en una conversación concreta. Lo segundo es lo que Anthropic declara públicamente que ofrece.

A fecha de 1 de abril de 2026, Anthropic sigue mostrando en su models overview a Claude Sonnet 4.6 como modelo público actual, con alias claude-sonnet-4-6. Sus release notes sitúan el lanzamiento público de Sonnet 4.6 el 17 de febrero de 2026. En otras palabras: Sonnet 4.6 no es un nombre de rumor ni una etiqueta improvisada por un gateway. Es parte del stack público de Claude.

También está confirmado que Anthropic intensificó públicamente su conflicto con DeepSeek el 23 de febrero de 2026. En su distillation post, la compañía acusó a DeepSeek, Moonshot y MiniMax de campañas de extracción de capacidades contra Claude, y atribuyó a DeepSeek más de 150.000 intercambios. Ese contexto importa porque explica por qué un modelo Claude diciendo I am DeepSeek no se interpreta como un glitch cualquiera.

Lo que no existe, al menos de forma pública, es una explicación oficial de Anthropic sobre la causa raíz de este comportamiento concreto. No hay una nota de versión que diga hemos corregido un problema de identidad en Sonnet 4.6. Por eso la forma responsable de escribir sobre esto sigue siendo contrato oficial -> comportamiento observado -> inferencia.

Por qué Sonnet 4.6 puede responder que es DeepSeek

La explicación más creíble no es una sola revelación oculta, sino la superposición de varios factores.

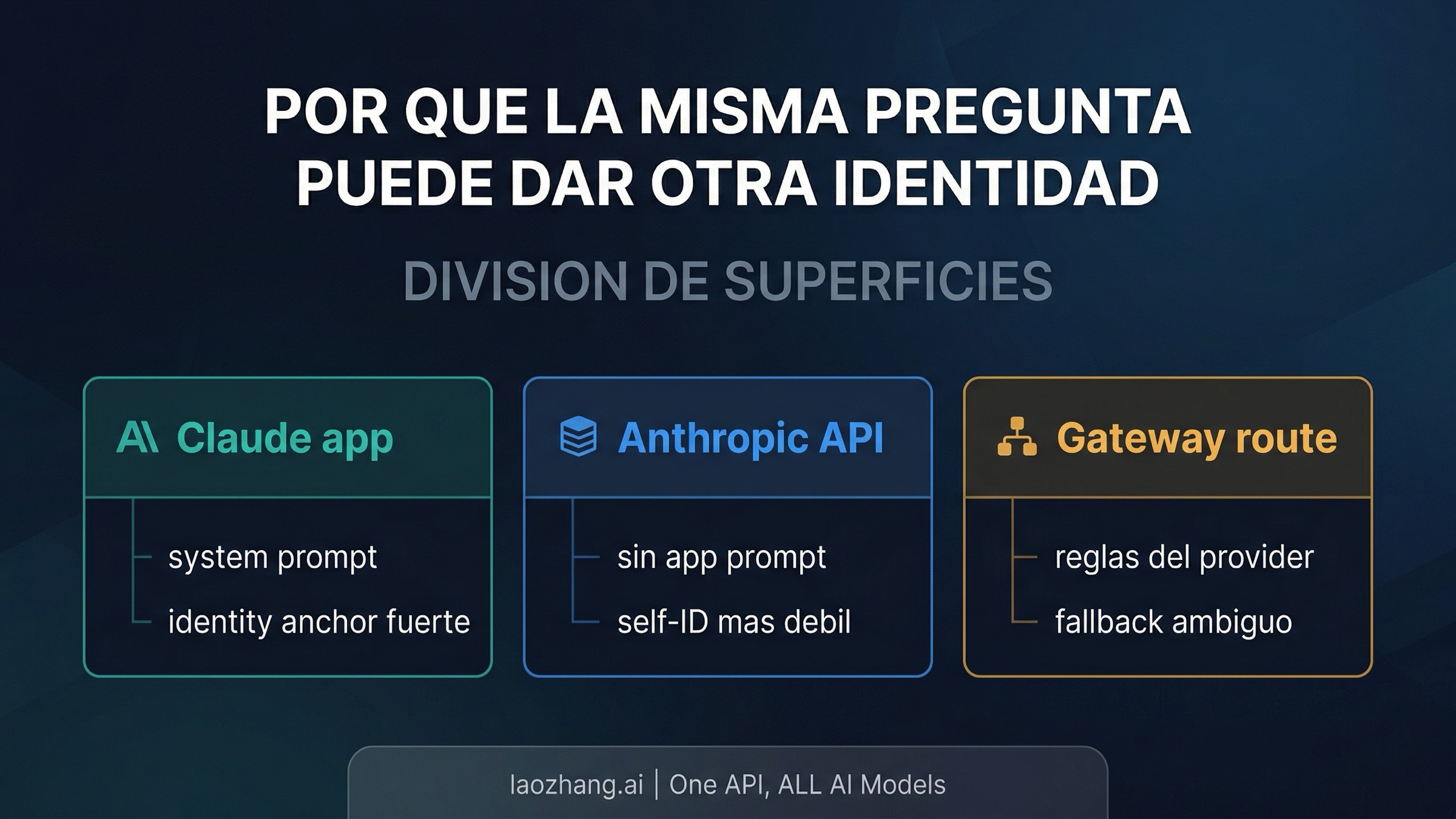

El primer factor es el anclaje de identidad. La página de Anthropic sobre system prompts deja claro que la interfaz web y móvil de Claude usan system prompt al inicio de la conversación, y que esas actualizaciones no se aplican a la Claude API. Eso significa que la misma pregunta puede caer dentro de sobres de identidad distintos según la superficie.

El segundo factor es el comportamiento de completion multilingüe. Los ejemplos públicos se concentran en prompts cortos en chino, como 你是什么模型?, no en prompts largos en inglés donde ya aparece Claude Sonnet 4.6 en contexto. La inferencia más razonable, con la evidencia actual, es que cuando la identidad del modelo no está bien anclada, puede completar un patrón de autointroducción familiar. Anthropic no ha confirmado este mecanismo, así que conviene presentarlo como inferencia y no como hecho cerrado. Aun así, sigue siendo una lectura mejor que saltar a por tanto, el modelo es DeepSeek.

El tercer factor es la capa de routing y wrappers. La documentación de OpenRouter sobre provider routing explica que su estrategia por defecto usa price-based load balancing y fallbacks. Eso no explica todos los casos, porque en hilos públicos también hay gente que dice haberlo visto en la API oficial de Anthropic con un system prompt vacío. Pero sí explica por qué la ruta exacta de ejecución importa mucho más de lo que parece en un simple screenshot.

Por eso la conclusión operativa más útil es esta: un modelo puede fallar al autoidentificarse sin dejar de ser el modelo que llamaste. Su autodescripción es más frágil y más dependiente del contexto de lo que mucha gente asume.

Lo que esta respuesta todavía no prueba

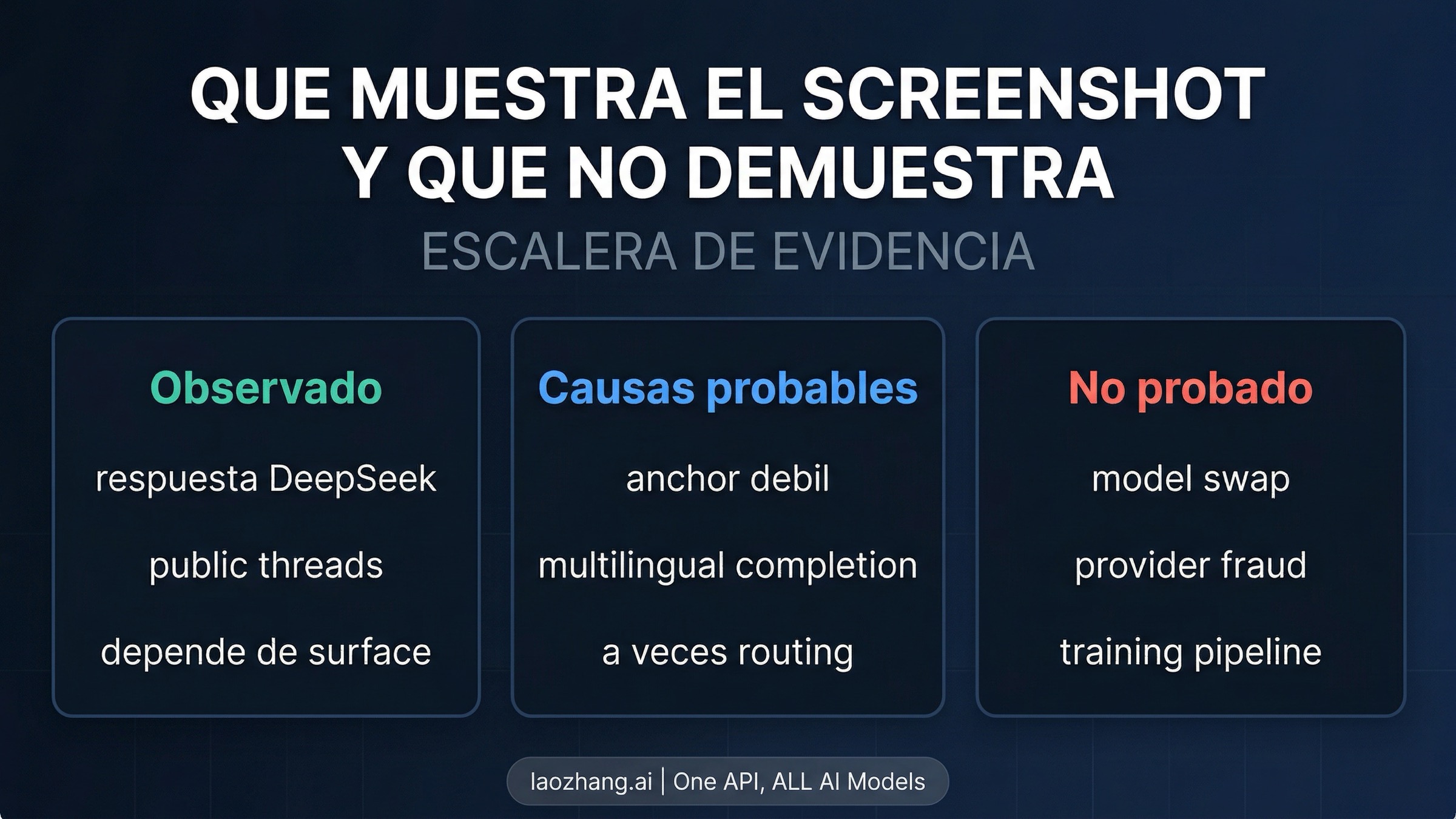

Hay tres sobrelecturas que aparecen una y otra vez.

La primera: Claude Sonnet 4.6 en realidad es DeepSeek. Es demasiado fuerte. El contrato público de Anthropic sigue presentando a Sonnet 4.6 como modelo Claude.

La segunda: Anthropic está sirviendo en secreto otro proveedor. Es una hipótesis demasiado amplia. El routing de un gateway puede añadir ambigüedad en algunos casos, pero las discusiones públicas mezclan varias superficies. No es serio reducir todos los ejemplos a culpa del gateway, ni usar el screenshot para concluir que Anthropic no está sirviendo Claude.

La tercera: esto demuestra que Anthropic entrenó Sonnet 4.6 con salidas de DeepSeek del mismo modo que acusa a DeepSeek de destilar a Claude. También es demasiado fuerte. El screenshot sugiere que los patrones de identidad de un competidor pueden aflorar bajo ciertas condiciones. Eso no basta para reconstruir una training pipeline concreta ni para demostrar destilación ilícita.

El estándar de prueba correcto aquí debe ser más alto. El fenómeno merece análisis. No merece todavía todas las conclusiones que algunos quieren extraer de él.

Cómo verificar correctamente la identidad del modelo

Si de verdad necesitas saber qué modelo estás tocando, preguntarle al propio modelo quién eres es el test más débil. Un flujo mejor sería:

- Comprobar primero el model ID. Para Sonnet 4.6, Anthropic publica

claude-sonnet-4-6. - Bloquear la ruta del provider si usas gateway. Desactiva fallbacks o fija provider cuando hagas pruebas sensibles a identidad.

- Añadir un identity anchor en el system prompt. No para forzar una mentira, sino para hacer el test menos ambiguo.

- Comparar superficies. Prueba en claude.ai, en la API oficial y en el gateway real que usas.

- Registrar condiciones. Request model, provider, fallback, system prompt, idioma. Sin eso, no estás depurando; solo estás coleccionando anécdotas.

La utilidad de este flujo es mover la discusión de esta captura da miedo a esta ruta, con estas condiciones, produjo esta respuesta. Ahí empieza el juicio técnico de verdad.

Por qué el ángulo Anthropic vs DeepSeek sigue importando

El screenshot explotó porque cae dentro de una contradicción pública visible. Anthropic acusó a DeepSeek de extracción de capacidades y, poco después, un Claude aparece diciendo que es DeepSeek. Aunque la causa sea solo debilidad del prompt, drift multilingüe o routing ambiguo, la óptica para Anthropic es mala.

Pero la lección útil no es por tanto Anthropic está automáticamente equivocada sobre distillation. La lección mejor y más estrecha es otra: que un patrón de identidad de un competidor aparezca en la salida no equivale a probar por completo el origen del modelo. La captura es poderosa como imagen pública. Sigue siendo más débil de lo que muchos quieren que sea como prueba técnica.

FAQ

¿Claude Sonnet 4.6 de verdad dice que es DeepSeek?

Sí. Hay suficiente evidencia pública como para tratarlo como un fenómeno real que merece explicación, aunque no exista una nota oficial de Anthropic explicando la causa raíz.

¿Eso significa que Sonnet 4.6 es realmente DeepSeek?

No. La documentación pública de Anthropic sigue mostrando a Sonnet 4.6 como modelo Claude vigente.

¿Es solo un problema de OpenRouter?

No se puede afirmar eso con seguridad. El routing puede ser parte de algunos casos, pero la evidencia pública apunta a más de una superficie.

¿Esto demuestra que Anthropic entrenó a Sonnet con salidas de DeepSeek?

No. El comportamiento observado y la prueba de una training pipeline concreta son cosas distintas.

Veredicto final

Claude Sonnet 4.6 puede decir DeepSeek en algunos prompts de autoidentificación porque la identidad del modelo depende mucho más de la superficie y del prompt envelope de lo que muchos usuarios creen. La propia documentación de Anthropic ya aporta una pista clave: la web y el móvil usan system prompt; la API no hereda esas actualizaciones. Si a eso sumas completion multilingüe y, en algunas rutas, capas de routing, el fenómeno se parece más a una debilidad del layer de identidad que a una confesión definitiva.

Eso no hace irrelevante el screenshot. Para Anthropic es una mala óptica, sobre todo después de su acusación pública contra DeepSeek. Pero la conclusión más responsable sigue siendo la misma: la autodescripción del modelo no es una provenance API. Si quieres saber qué estás llamando, confía más en el contrato del modelo, la ruta del provider y el prompt envelope que en la frase que el propio modelo genera sobre sí mismo.