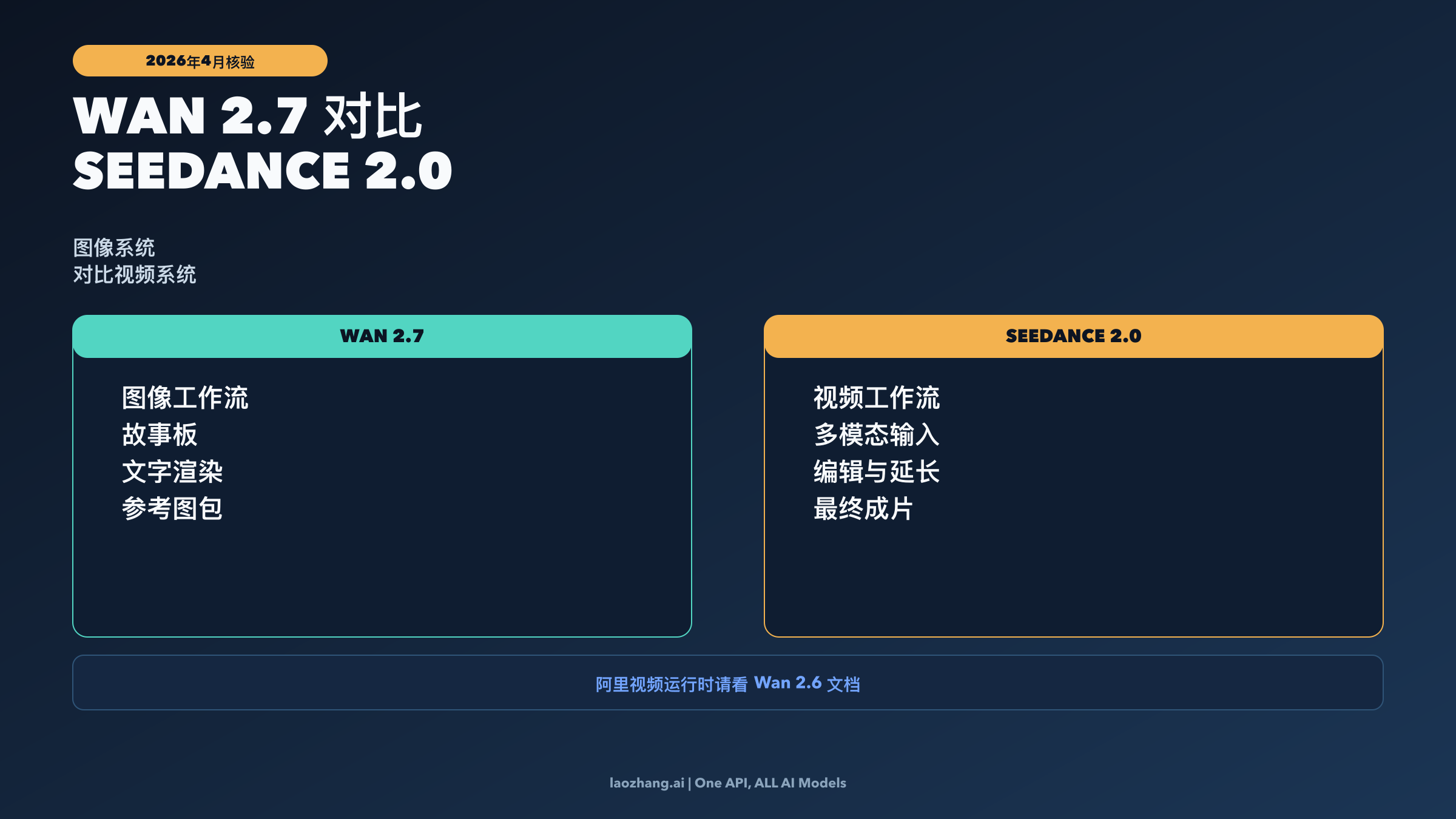

Wan 2.7 和 Seedance 2.0 现在并不是一组真正对等的官方产品。Wan 2.7 是阿里当前 image-first 发布,Seedance 2.0 是字节的多模态音视频系统。 如果你要的是故事板、参考图包、文字很多的静态视觉,或者需要先把视觉方向锁定,先看 Wan 2.7。 如果你要的是最终视频生成、编辑或延长,先看 Seedance 2.0。 如果你真正想问的是“阿里当前官方视频栈对比 Seedance 2.0”,那更准确的比较其实是 Wan 2.6 video 对比 Seedance 2.0 beta。

下文所有会影响判断的新鲜信息,都在 2026 年 4 月 2 日 对阿里云、ByteDance Seed 和火山引擎官方页面重新核对过。这个题目最容易误导人的地方,不是参数本身,而是很多页面把不同产品层混成了一个假对比。

TL;DR

| 你的真实交付物 | 更该先选谁 | 为什么 | 主要代价 |

|---|---|---|---|

| 故事板、参考图包、文字很多的静态图、上游视觉探索 | Wan 2.7 | 阿里当前官方 Wan 2.7 叙事是 image-first,强项是长文本、多人参考、多图并发与高控制 still generation | 不要把它直接当成阿里当前最清晰的公开视频 runtime |

| 最终视频生成、编辑、延长 | Seedance 2.0 | 火山引擎当前官方文档明确把 Seedance 2.0 放在视频这一层,支持 text、image、video、audio 组合输入 | API 仍然带有 enterprise beta 边界,不是完全无门槛 self-serve |

| 想看当前最清晰的官方 runtime 合约 | Wan 2.6 video vs Seedance 2.0 beta | 阿里当前公开文档对 Wan 2.6 video 的价格与运行时规则写得更清楚 | 这已经不是 Wan 2.7 image 对比 Seedance 2.0 了 |

| 从视觉探索一路做到最终成片 | 两者一起用 | Wan 2.7 更适合做上游 keyframe 与 style pack,Seedance 2.0 更适合做下游成片 | 需要你主动设计 handoff,而不是强行让一个模型包办全部工作 |

为什么 Wan 2.7 和 Seedance 2.0 不是一组干净的一对一 benchmark

先把现实说清楚:这两个产品在当前公开官方材料里,处在不同的输出层。 阿里 2026 年 4 月的官方新闻稿把 Wan2.7-Image 与 Wan2.7-Image-Pro 明确写成图像生成与图像编辑发布,重点讲的是长文本渲染、个性化图像生成、最多 9 张参考图、一次最多 12 张出图,以及 Wan2.7-Image-Pro 的 4K 输出。这是一条图像工作流叙事。

ByteDance 的官方 Seedance 2.0 发布页 与火山引擎当前 Seedance 2.0 教程页 讲的是另一件事:一个多模态音视频模型,支持 text、image、video、audio 输入,输出 4 到 15 秒的视频,并支持编辑或延长。这是一条视频工作流叙事。

为什么大家会把它们放在一起?因为现在 “Wan” 这个品牌同时覆盖了不止一个代际、也不止一个 surface。阿里新闻稿提到 Wan 2.7 可通过 Model Studio 与 wan.video 访问,但当前公开的 Alibaba Model Studio models 页面 里,最清楚的公开视频 runtime 仍然是 Wan 2.6 family,而不是一个单独写清楚的 Wan 2.7 video family。于是很多“Wan 2.7 vs Seedance 2.0”页面,本质上是在把一个当前 image release 和一个当前 video system 硬拉成一场统一胜负赛。

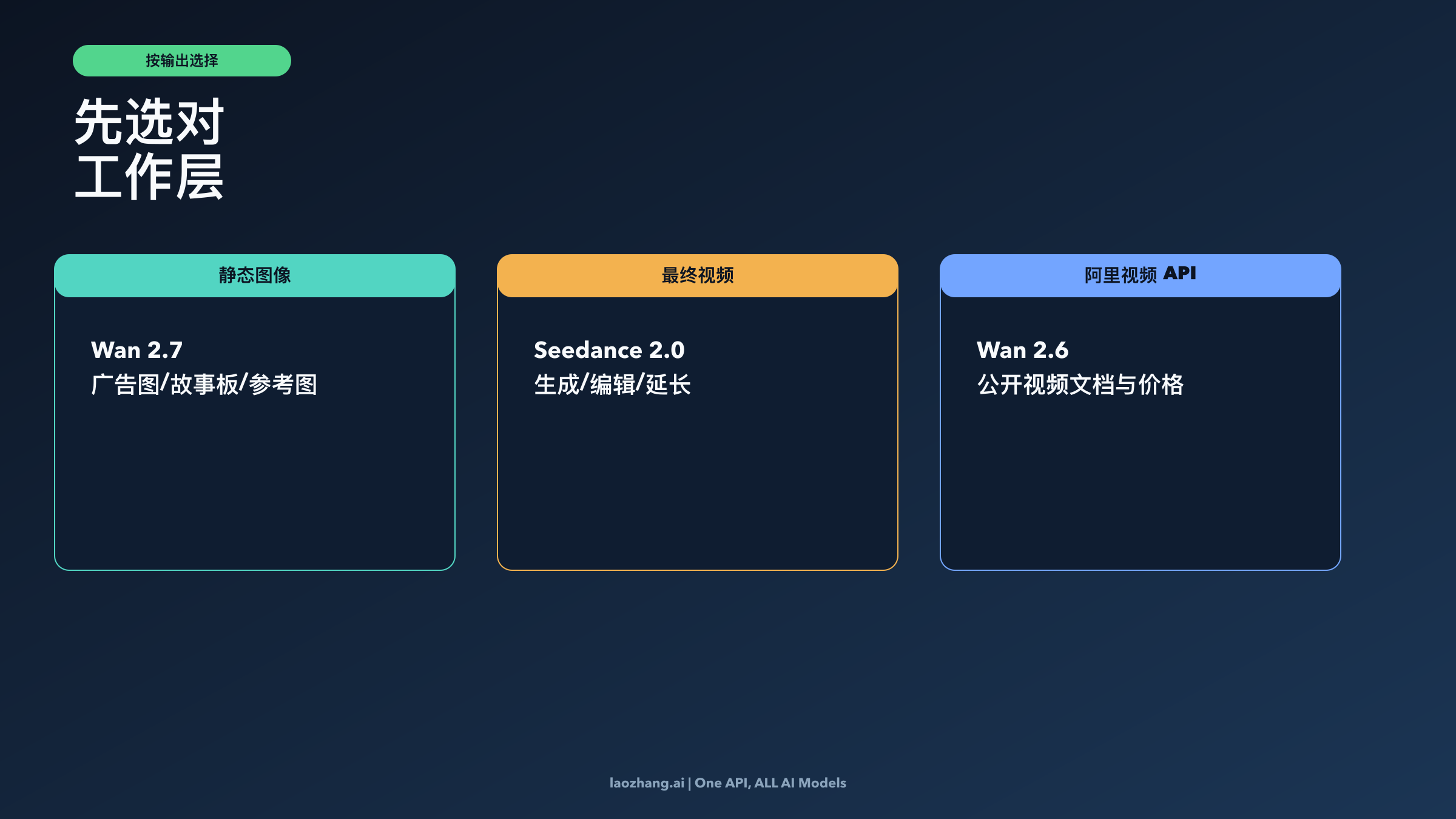

真正有用的判断顺序应该反过来。先问:你交付的是 still image,还是 final clip? 如果你交付的是静态视觉资产,你选的是 image layer;如果你交付的是视频成片,你选的是 video layer。只有先做完这一步,后面的质量、价格、接入难度才有意义。

Wan 2.7 更强的场景

当你的真实工作是 still-image control,而不是 final video output,Wan 2.7 更强。 阿里的官方叙事本身就指向这些任务:文字很多的视觉设计、故事板式多图生成、颜色与品牌感更强的商业图,以及围绕现有图像做高控制编辑。这不是附带能力,而是主线。

Wan 2.7 当前公开合同里最值得记住的有三点。第一,阿里写明它支持最多 3,000 个文本 token,这对海报、广告图、说明型图像和一切“图里文字本身很重要”的场景尤其关键。第二,它支持最多 9 张参考图,还能一次生成 12 张图,这让它非常适合做 storyboard board、风格包、产品场景探索和 campaign visual iteration,而不是只生成一张“看起来不错”的图。第三,Wan2.7-Image-Pro 支持 4K 输出,这让设计评审、电商细节和后续裁切更有把握。

这也是为什么 Wan 2.7 更适合放在内容管线的上游。你在定产品构图、锁视觉 identity、测试 typography,或者准备后续视频工作所需的 still references 时,Wan 2.7 比 Seedance 2.0 更贴合任务本身。Seedance 当然也能接 image references,但它当前公开合同的主线是把多模态输入变成视频。Wan 2.7 则更适合在“资产本身就是静态图”的阶段停留更久。

如果你团队现在真正卡住的是“视频到底应该长什么样”,那先把 reference pack 做强,往往比更早进入视频生成更划算。上游视觉没锁定之前,任何视频模型都会因为 brief 太弱而浪费迭代次数。若你当前评估的核心其实是图像层,而不是视频层,可以继续看我们的最佳 AI 图像模型指南。

Seedance 2.0 更强的场景

当你的交付物就是视频本身,Seedance 2.0 更强。 火山引擎当前教程已经把这个 runtime 形状写得足够清楚:Seedance 2.0 beta 合同支持 text,加上最多 9 张图片、3 段视频、3 段音频 共同输入;输出时长 4 到 15 秒,分辨率 480p 或 720p;并覆盖生成、编辑、延长这类视频任务。

这里的关键不是“它也能接参考图”,而是这些参考本来就在一条 video-native workflow 里。你可以从一开始就同时约束 motion、rhythm、scene continuation 与 audio-aware generation,而不是把一个 image-centric 产品勉强推去承担视频主职责。只要你的判断标准里包含“我能不能把多张图、运动参考、音频参考一起喂进去,最后拿到实际可用的 clip”,Seedance 2.0 就更接近这个问题的本体。

当然,接入边界不能忽略。火山引擎当前文档把 Seedance 2.0 与 Seedance 2.0 Fast 放在 enterprise user public beta 这一层,而不是一个完全无门槛的全球自助 runtime。这个限制很重要,但它不改变产品类型本身。它的真实含义是:如果你现在要做 final video work,这一组里更合适的模型是 Seedance 2.0;只是你还要接受当前 rollout 方式的边界。

所以,只要你的任务从一开始就是“我要成片”,而不是“我要更强的上游静态视觉”,Seedance 2.0 就是这组比较里更贴题的答案。如果你想把这个问题放进更大的 creator-market shortlist 里看,可以继续读我们的最佳 AI 图生视频工具指南。

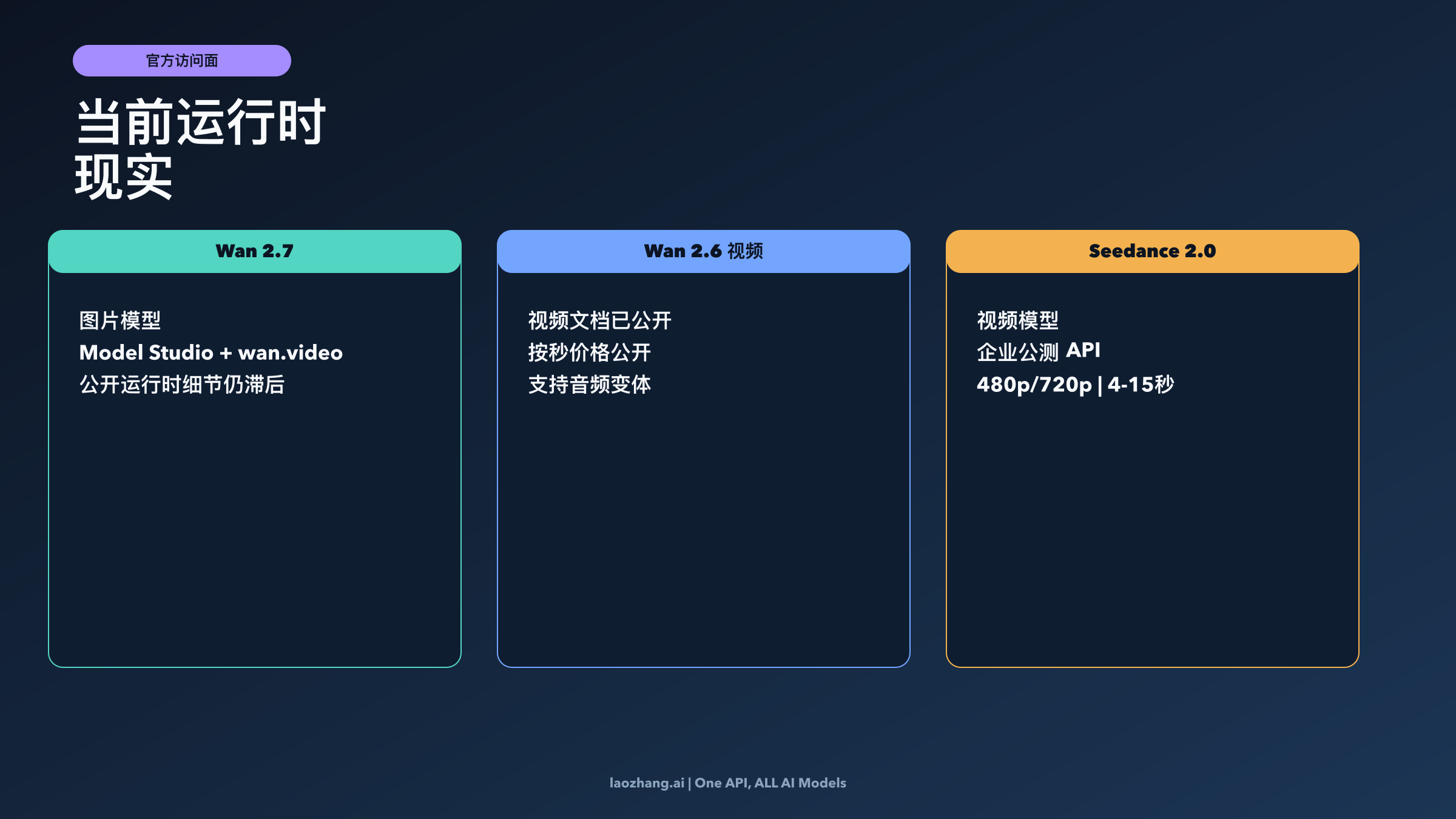

如果你关心 runtime 和 API 清晰度,应该比较 Wan 2.6 video 与 Seedance 2.0 beta

技术买家问的往往不是“哪个看起来更酷”,而是“今天到底哪个是 官方写清楚、可调用、可定价、可支持 的”。在这个问题上,正确比较对象并不是 Wan 2.7 image 对比 Seedance 2.0,而是 Wan 2.6 video 对比 Seedance 2.0 beta。

阿里当前在 runtime-contract 这一侧写得更清楚。公开 Model Studio 文档列出了 wan2.6-t2v、wan2.6-i2v-flash 等 Wan 2.6 video family,也给出了公开的按秒价格。按 2026 年 4 月 2 日我核对到的 US 合同,wan2.6-t2v-us 标注为 720p 每秒 $0.10、1080p 每秒 $0.15。wan2.6-i2v-flash 还进一步区分了带音频和不带音频的价格。哪怕你最终不一定选阿里,这种公开清晰度本身就是实用价值。

Seedance 2.0 当前官方合同则更像“能用,但表层没那么整齐”。教程页已经暴露了真实 model ID、输出范围和多模态上限,比之前那种“只能 console 体验”的叙事前进了一大步;但价格页更适合按 场景示例 来理解,而不是按一个统一贴纸价来读。当前官方示例里,16:9、5 秒、480p 的视频,doubao-seedance-2.0 是 2.31 RMB,doubao-seedance-2.0-fast 是 1.86 RMB;16:9、5 秒、720p 则分别是 4.97 RMB 和 4.00 RMB。这已经足够有用,但公开价格表的一致性还是不如阿里的 Wan 2.6 video rows。

因此判断可以很简单。若你最重视 public runtime clarity、contract readability 与公开价格行,阿里当前在视频这一侧更容易评估,但那个名字仍然是 Wan 2.6 video,不是 Wan 2.7 image。若你最重视 multimodal video semantics、editability 与视频能力叙事,Seedance 2.0 更有吸引力,但你要接受 enterprise beta 边界,以及目前价格表不如阿里那样统一。

如果你想进一步看“现在到底哪些公开视频 API 更容易真正在项目里落地”,我们那篇最佳免费 AI 视频 API 指南比任何 hype 式 vendor showdown 都更实用。

按 workflow 最终怎么选,什么时候两者一起用

最有价值的答案,很多时候不是“硬选一个赢家”,而是“让正确的模型负责正确的阶段”。

如果你是品牌团队或创意团队,在 campaign 早期最难的往往不是 motion,而是先把 look 定下来。这个阶段就让 Wan 2.7 负责上游:hero still、storyboard panel、产品构图、文字很多的视觉和整套 reference pack。等视觉方向批准后,再让 Seedance 2.0 负责下游,把这些方向转成真正的视频成片。

如果你是技术买家,最稳的做法是把问题拆成两个。图像生成与高控制 still assets,看 Wan 2.7;当前官方公开视频 runtime 的可评估性,看 Wan 2.6 video 与 Seedance 2.0 beta;最终视频生成,看 Seedance 2.0。它听起来比“一句话谁赢了”更复杂,但也比大多数比较页诚实得多。

如果你是 solo creator 或 performance marketer,判断甚至可以更快。需要先准备 keyframe、广告概念图、参考图包,就用 Wan 2.7;镜头已经想清楚、现在只想拿到短视频 clip,就用 Seedance 2.0;工作流同时跨越两层时,就两者一起用,而不是牺牲上游控制或下游视频能力。

这也是这篇文章最想给出的结论:最强答案通常是 pipeline-shaped,而不是 winner-shaped。 很多团队真正该做的是:Wan 2.7 负责 ideation 与 reference control,Seedance 2.0 负责 final clip generation、extension 或 edit-style work。只有当你的团队确实只活在单一层时,才需要强迫自己选一个单模型答案。

常见问题

Wan 2.7 比 Seedance 2.0 更强吗?

不能脱离工作流阶段直接这么说。Wan 2.7 更强在图像工作,如故事板、参考图包、文字很多的静态视觉;Seedance 2.0 更强在最终视频生成、编辑与延长。只有先把 “better” 限定到具体阶段,这个判断才成立。

Wan 2.7 能做视频吗?

阿里 2026 年 4 月的 Wan 2.7 官方发布是 image-first,而 Alibaba Model Studio 里目前最清楚写明的公开视频 runtime 仍是 Wan 2.6 family。所以今天把 “Wan 2.7 video” 直接拿来对比 Seedance 2.0,并不是最干净的公开合同比较。若你真正关心阿里的 deployable video stack,应该先看 Wan 2.6 video。

如果我是 API 和 runtime 买家,该更看哪一边?

如果你最重视公开合同清晰度,Wan 2.6 video 更容易评估,因为 model family 与按秒价格写得更清楚。若你更重视多模态视频能力与编辑语义,Seedance 2.0 更有吸引力,但当前官方 access boundary 仍是 enterprise beta。

什么时候最适合两者一起用?

当你的流程从视觉策划开始,以视频成片结束时,就最适合两者配合。先用 Wan 2.7 生成 still references、keyframe 或整套视觉方向,再把这些方向喂给 Seedance 2.0 去完成视频生成、延长或编辑。